ARC-AGI-2:抽象推理与泛化能力的终极测试

随着AI模型能力的快速演进,传统的知识密集型基准测试(如MMLU、GPQA)已经面临严重的饱和 问题。ARC-AGI-2(Abstraction and Reasoning Corpus for AI)应运而生,这是一个由François Chollet等人提出的专家级基准测试,旨在评估AI模型在全新问题上的泛化推理能力,而非测试其记忆能力。

核心定位与适用场景

ARC-AGI-2的核心定位是抽象推理与泛化能力评估 。与MMLU等知识密集型基准不同,ARC-AGI-2的问题设计完全基于流体智能(fluid intelligence) ------即在全新任务中高效获取技能和适应新环境的能力,而非测试晶体智能(crystallized intelligence)------即已掌握的知识和技能。

适用场景包括:

- 前沿模型推理能力评估:区分顶级模型(GPT-5.2、Claude Opus 4.6、Gemini 3 Pro等)在抽象推理能力上的差异

- 泛化能力测试:评估模型在面对训练时未见过的全新任务时的适应能力

- 纯推理能力验证:不依赖语言知识、数学符号或专业领域知识

- 智力基准的"北极星":提供向AGI进展的长期、稳定评估标准

评测方法论

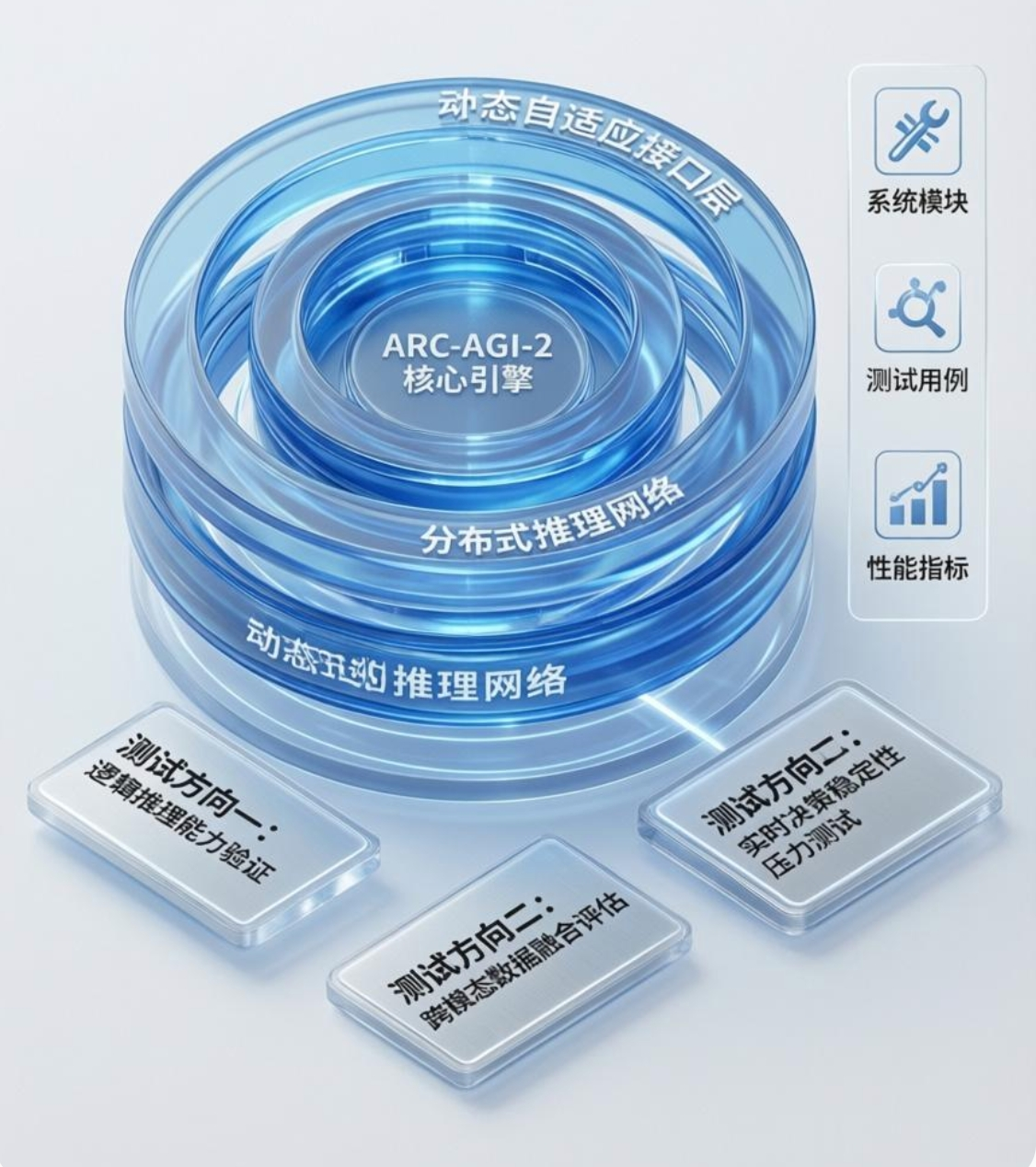

任务构成

ARC-AGI-2的任务具有以下特征:

- 网格变换谜题:1×1到30×30的彩色网格,每个单元格有0-9的值

- 输入输出对:每个任务有2-5个演示对,展示变换规则

- 测试对:1-2个需要解决的测试输入

- 目标:识别隐藏的变换规则并应用到测试输入上

- 成功标准:所有测试对必须正确解决(单元格级精确匹配)

Pass@2 评估机制

ARC-AGI-2采用Pass@2评估方式:

- 每个测试输入允许2次尝试

- 分数为所有测试对都正确解决的任务百分比

- 人类和AI遵循相同的2次尝试规则

数据集构成

| 数据集 | 任务数 | 用途 | 可访问性 |

|---|---|---|---|

| 公开训练集 | 1,000 | 演示和模型训练 | 公开 |

| 公开评估集 | 120 | 测试和验证 | 公开 |

| 半私有评估集 | 120 | 商业模型测试 | 私有,低泄露 |

| 私有评估集 | 120 | 最终竞赛评分 | 私有,接近零泄露 |

校准保证:

- 所有评估集都是**独立同分布(IDD)**校准的

- 人类面临的难度在不同子集间差异≤1%

- 确保分数可比较(<1pp预期差异)

人类测试协议

受控研究设计:

- 407名参与者,共515次会话

- 13,405次测试对尝试(62%成功率)

- 在圣地亚哥会议受控环境进行测试(2024年11月-2025年5月)

- 报酬:基础115-150 + 每正确题目5

- 随机任务分配,通过自定义UI进行

参与者背景:

- 多元专业背景

- 技术、数学、编程经验差异大

- 人口统计特征与表现无显著相关性

- 这表明任务测试的是通用问题解决能力,而非专业知识

最新评测结果

截至2026年1月,ARC-AGI-2的最新评测结果显示,顶级模型表现如下:

| 模型 | 分数 | 成本/任务 | 备注 |

|---|---|---|---|

| GPT-5.2 | 54% | ~$2.20/任务 | 当前SOTA(State of the Art) |

| Poetiq(Gemini 3 Pro精炼) | 54% | $30.57/任务 | 最高精炼解决方案 |

| Claude Opus 4.6 | ~38% | N/A | |

| Gemini 3.1 Pro | 77.1% | N/A | 2026年2月最新更新,显著改进 |

| Opus 4.5 | 37.6% | $2.20/任务 |

Kaggle竞赛结果(ARC Prize 2025):

- 1,455个团队 参与,15,154次提交

- 私有评估集最高分 :24%,成本$0.20/任务

- 90篇论文提交(比2024年几乎翻倍)

- 大奖($700,000):仍未被领取(要求≥85%准确率)

人类性能基准

- 平均人类准确率:校准评估集上60-66%

- 100%的任务可被至少2名参与者在≤2次尝试内解决

- 中位解决时间:每个任务2.2-2.7分钟

值得注意的是,即使是当前表现最好的GPT-5.2,其得分也仅略超50%,而人类平均达到60-66%。这表明ARC-AGI-2对AI模型来说仍然是一个极具挑战性的基准,与MMLU等传统基准上顶级模型往往能达到80-90%的分数形成鲜明对比。

与其他基准的关系

知识密集型基准对比

| 基准 | 主要焦点 | 性质 | ARC-AGI-2对比 |

|---|---|---|---|

| MMLU | 通用知识 | 57个科目,多选题 | 奖励记忆 ;ARC-AGI-2奖励适应 |

| MMLU-Pro | 复杂推理 | 扩展选项,CoT友好 | 仍然知识密集;ARC-AGI-2需要核心知识先验 |

| Big-Bench Hard (BBH) | 多任务推理 | 23个BigBench任务 | 在推理上有一定重叠,但BBH包含语言任务 |

| GPQA | 专家级知识 | 物理、化学、生物等 | 需要领域专业知识;ARC-AGI-2使用仅基础先验 |

关键差异

1. 核心知识 vs 世界知识

- ARC-AGI-2 :仅需要核心知识先验(对象持久性、计数、几何、拓扑)

- 其他基准 :通常需要专业知识(历史事实、科学术语、数学符号)

2. 过拟合抗性

- ARC-AGI-2 :每个任务都是唯一的;无法提前记忆

- MMLU/GPQA:静态问题;存在训练数据污染和记忆风险

3. 评估哲学

- ARC-AGI-2 :测量技能获取效率(智能被定义为高效适应)

- 传统基准 :测量现有技能掌握(知识回忆)

4. 人类-AI差距

- ARC-AGI-2 :巨大差距------人类60-85%,AI 0-54%

- MMLU :差距缩小------人类89.7%,GPT-5.2 ~89%

基准演进历程

ARC-AGI系列时间线:

- ARC-AGI-1(2019):建立流体智能基准;2024年达到~55%

- ARC-AGI-2(2025):设计更困难;AI分数从~50%降至个位数

- ARC-AGI-3 (2026年3月):将测试交互式推理(探索、规划、记忆)

行业认可度:

- 所有4大AI实验室现在在模型卡片中报告ARC-AGI表现(OpenAI、Anthropic、Google DeepMind、xAI)

- 确立ARC-AGI作为AI推理评估的行业标准

局限性(⚠️)

尽管ARC-AGI-2是当前最具挑战性的基准测试之一,但它也存在一些需要关注的局限性:

设计层面局限

1. 视觉符号偏差

- 任务是网格视觉谜题

- 可能偏向具有强视觉/空间推理的系统

- 不测试其他智能模态(语言、音频、具身交互)

2. 窄域范围

- 专注于流体智能(通用问题解决)

- 不测量晶体智能(积累的知识)

- 可能不能全面评估"AGI"的全部意义

3. 成本-复杂度权衡

- 当前SOTA需要昂贵计算(精炼高达$30/任务)

- 引发关于评估的是否真正测量效率的质疑

- 可能评估的是计算成本 而非智能

实现问题

1. 基准污染

- 知识依赖过拟合:模型可能从训练数据中间接学习模式

- 信息泄露:重复评估同一测试集产生反馈循环

- 半私有集:对第三方有限暴露仍存在一定污染风险

2. 评估自由度

- 基准分数取决于多个变量:

- 采样设置(temperature、top_p)

- Few-shot数量

- 思维链(CoT)允许

- 测试时计算(自一致性)

- 提示工程

- 使得模型间直接比较具有挑战性

3. 暴力易感性(ARC-AGI-1遗留问题)

- 49%的ARC-AGI-1任务易受计算密集搜索影响

- ARC-AGI-2解决了此问题,但仍存在一定残留风险

- 可能奖励计算能力 而非通用智能

社区批评

1. "半作弊"担忧(来自Hacker News讨论)

"OpenAI也可能使用许多人ARC数据来训练(半作弊)。如果不完全公开训练数据,你永远无法确定良好的表现是来自记忆还是'半记忆'。"

2. 特定模型过拟合

"5和5.1都感觉过拟合,当你在它们的能力范围之外时会变得顽固。"

3. 基准针对

- 模型可能专门针对基准性能进行优化

- **"为考试而教"**而非发展真正智能的风险

- 可能不反映实际推理能力

4. 难度校准

- ARC-AGI-2比ARC-AGI-1显著更难

- 一些论点可能过于困难,无法提供有效信号

- 当前AI分数大多处于噪声级(<5%阈值用于有意义信号)

对开发者的启示

1. 理性解读基准分数

开发者应当理性解读ARC-AGI-2分数。一个模型在ARC-AGI-2上得分为30%,并不意味着它"只能解决30%的专家级问题",而应该理解为"在这个特定的3460个任务集合上,该模型答对了30%"。实际应用中的表现会因任务类型、上下文环境等因素而有所差异。

2. ARC-AGI-2是能力上限的指示器

ARC-AGI-2的价值在于它揭示了模型的推理能力上限,而非日常应用的平均表现。如果一个模型在ARC-AGI-2上表现出色,那么它在处理复杂的、全新的、需要泛化推理的任务时更有可能取得好结果。

3. 关注泛化而非记忆

ARC-AGI-2提醒我们:在预训练中增加更多数据不足以推动智能突破。真正的智能来自于:

- 泛化能力:在新任务上的快速适应

- 推理机制:而非简单的模式匹配

- 学习效率:而非记忆容量

4. 谨慎比较不同基准

不同基准之间的分数不可直接比较。MMLU上85%的分数和ARC-AGI-2上30%的分数,其难度和意义完全不同。开发者应当根据任务需求选择合适的基准进行评估。

5. 持续跟踪动态更新

ARC-AGI-2是一个动态发展的基准,问题和评分机制可能会更新。开发者应当持续跟踪官方发布的变化,及时调整评估策略。

总结与展望

ARC-AGI-2代表了AI评测从"能做什么"转向"能做到多好"的重要转变。它通过独特的网格变换谜题设计,揭示了AI模型在面对全新、无先验知识任务时的真实能力差距。

随着AI模型的持续进步,ARC-AGI-2的分数必然会不断提升。但更重要的是,它为开发者提供了一个可靠的标尺,用于评估和比较前沿模型的真正泛化推理能力。在未来,我们可能会看到更多类似ARC-AGI-2的专家级基准出现,推动AI评测向更精细、更专业的方向发展。

对于研究者和开发者而言,理性使用ARC-AGI-2、理解其局限性、结合实际应用场景进行评估,是充分利用这一工具的关键。

参考来源

- ARC Prize Foundation:官方网站

- ARC-AGI-2官方页面:https://arcprize.org/arc-agi/2/

- ARC-AGI-2技术报告(arXiv 2505.11831):论文链接

- ARC Prize 2025技术报告:论文链接

- GitHub仓库:https://github.com/arcprize/ARC-AGI-2

- Hacker News讨论:社区讨论

- Effective Altruism Forum:分析文章

- The Decoder访谈:François Chollet访谈

(本文基于公开信息整理,所有数据和观点均标注来源。来源包括ARC Prize Foundation官网、arXiv论文、GitHub项目、社区讨论等。)