安装Ollama

Ollama是一个用于本地运行大型语言模型的工具,支持多种开源模型。以下是安装步骤:

确保系统已安装Docker,Ollama依赖Docker环境运行。访问Docker官网下载并安装对应版本。

通过终端运行以下命令安装Ollama:

bash

curl -fsSL https://ollama.com/install.sh | sh启动Ollama服务:

bash

ollama serve拉取需要的模型,例如deepseek-r1:1.5b

bash

ollama pull deepseek-r1:1.5b列出安装的大模型:

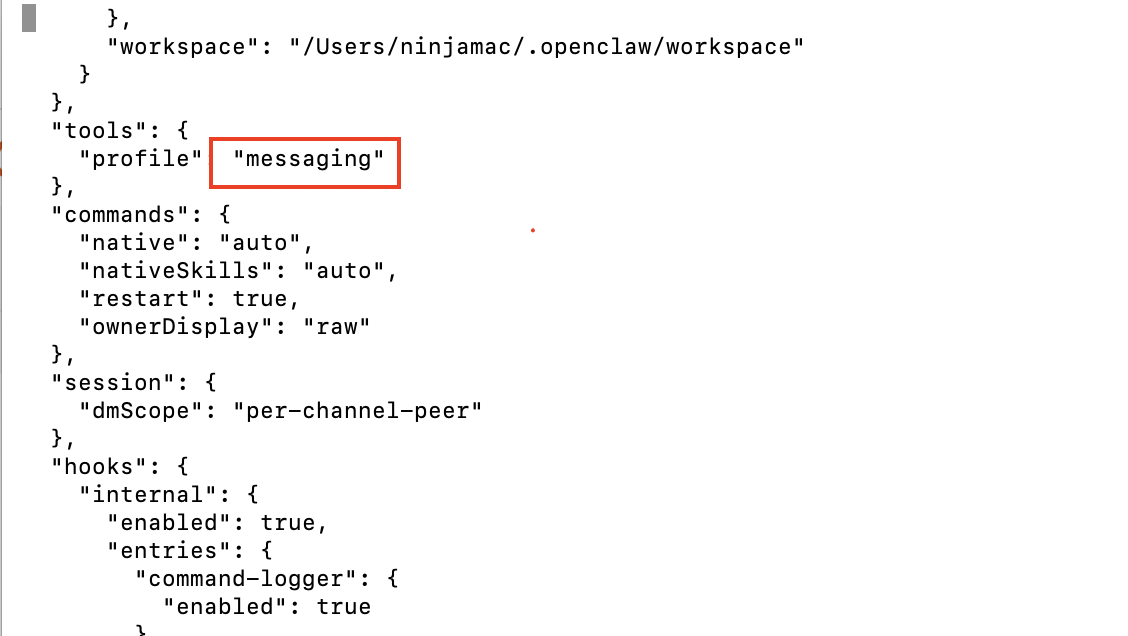

(base) ninjamac@ninjamacdeMacBook-Air ~ % ollama list

NAME ID SIZE MODIFIED

llama3:8b 365c0bd3c000 4.7 GB 13 hours ago

deepseek-r1:1.5b e0979632db5a 1.1 GB 19 hours ago

deepseek-r1:7b 755ced02ce7b 4.7 GB 19 hours ago Ollama 运行:

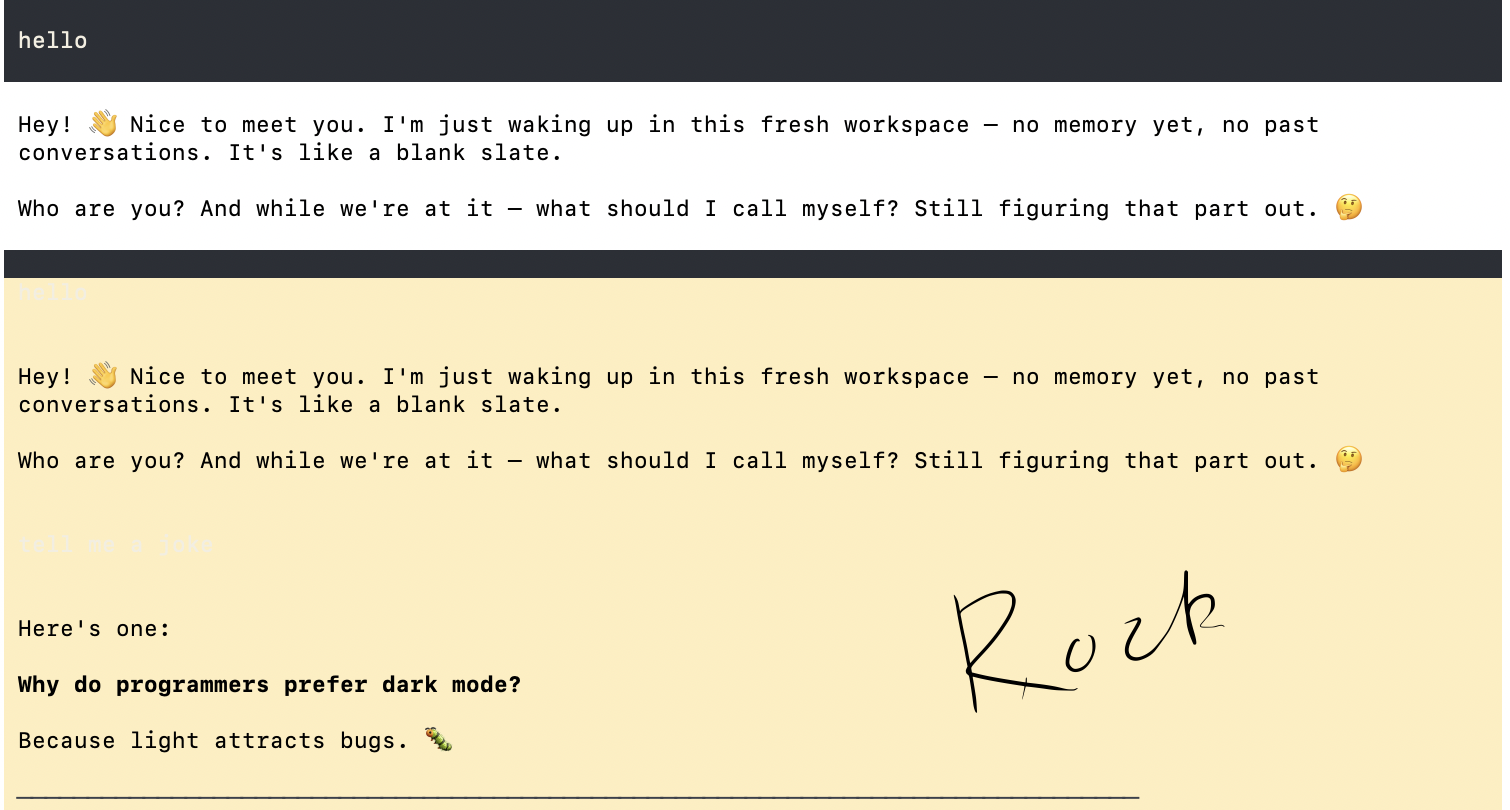

以下示例展示了如何使用"Ollama run"命令拉取指定的 LLM 并启动其在本地的执行。拉取并启动后,您可以尝试像下面这样查询 LLM。

安装OpenClaw

开始之前,请确保您已具备以下条件:

- macOS(任何较新的版本)

- Node.js 22 或更高版本------如果尚未安装,安装脚本会自动处理,但建议您检查一下

- API 密钥------OpenClaw 团队推荐使用 Anthropic 密钥

- 大约需要 5 分钟时间

要查看您当前的 Node 版本,请打开终端并运行:

bash

node --version步骤 1:通过安装脚本安装 OpenClaw(推荐)

在 macOS 上安装 OpenClaw 最快的方法是使用一行安装脚本。它能一步完成节点检测、命令行安装和启动引导向导。

打开终端并运行:

bash

curl -fsSL https://openclaw.ai/install.sh | bash步骤 2:运行引导向导

如果安装脚本没有自动启动引导向导,请手动启动它:

bash

openclaw onboard --install-daemon该向导会引导您完成身份验证、网关设置和可选通道连接的配置。它还会将 OpenClaw 安装为后台服务(守护进程),因此即使您关闭终端,网关也会继续运行。

向导配置内容

- 身份验证 --- 为网关生成令牌,以便本地和远程客户端进行身份验证

- 网关设置 --- 端口、绑定地址和服务安装

- 通道连接 --- 可选设置,支持 WhatsApp、Telegram、Discord 等

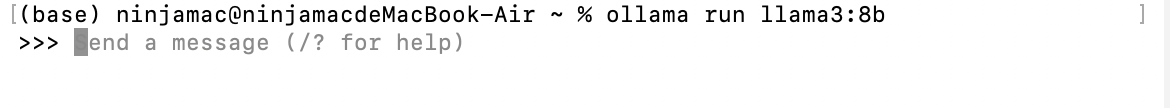

步骤 3:验证网关是否运行

完成配置后,检查网关是否正常运行:

bash

openclaw gateway status

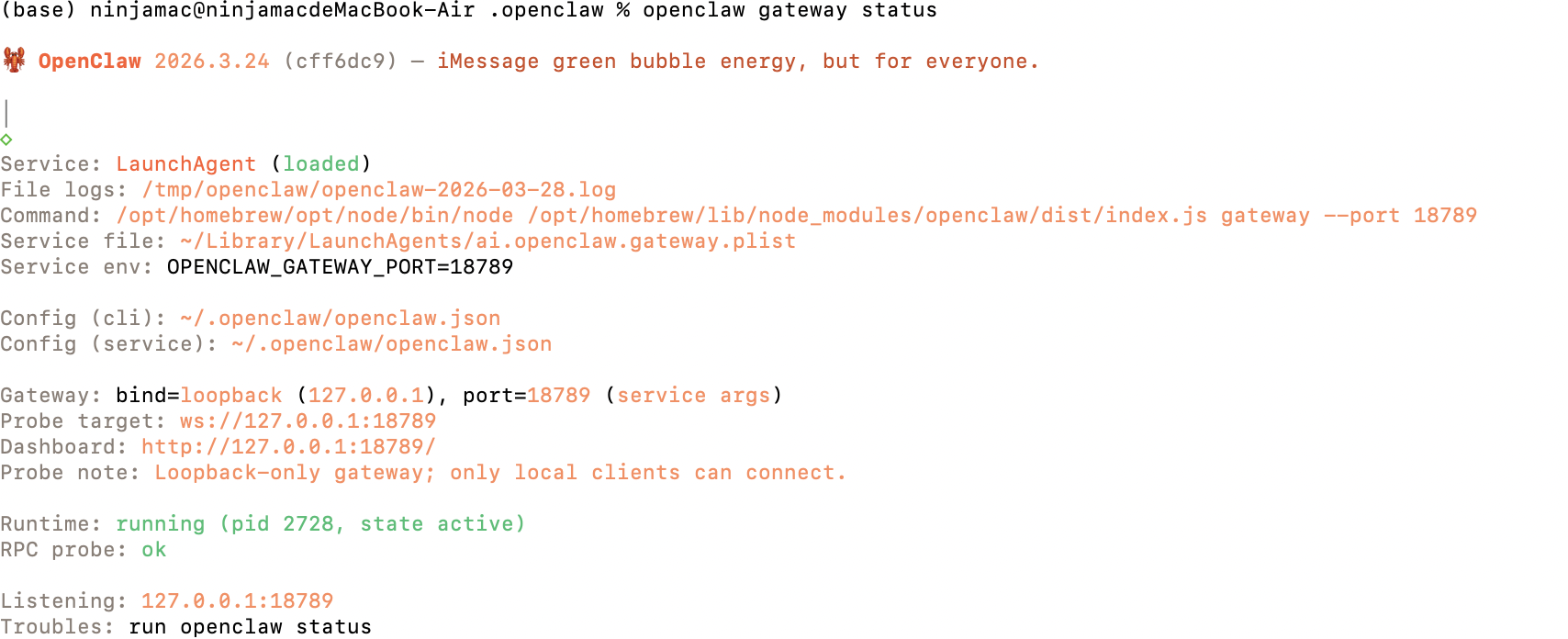

修改openclaw.json文件支持本地大模型

关键配置修改

修改agents.defaults.models部分 将原有配置:

json

"models": {

"ollama/kimi-k2.5:cloud": {}

}更新为:

json

"models": {

"ollama/kimi-k2.5:cloud": {},

"ollama/deepseek-r1:1.5b": {}

}建议同步修改默认模型

json

"primary": "ollama/kimi-k2.5:cloud"完整配置示例

操作流程

修改配置后需要完全重启OpenClaw服务

bash

# 终止现有进程

Ctrl + C

# 重新启动服务

openclaw技术原理说明

OpenClaw的模型访问控制分为:

- 全局模型池:定义可用模型资源

- Agent模型白名单:限定具体可调用范围 当前问题是由于模型虽在全局注册但未加入Agent许可列表导致。

验证阶段:

我们使用的profile 为messaging,目前只提供聊天功能:

输入消息hello ,或者tell me a joke: