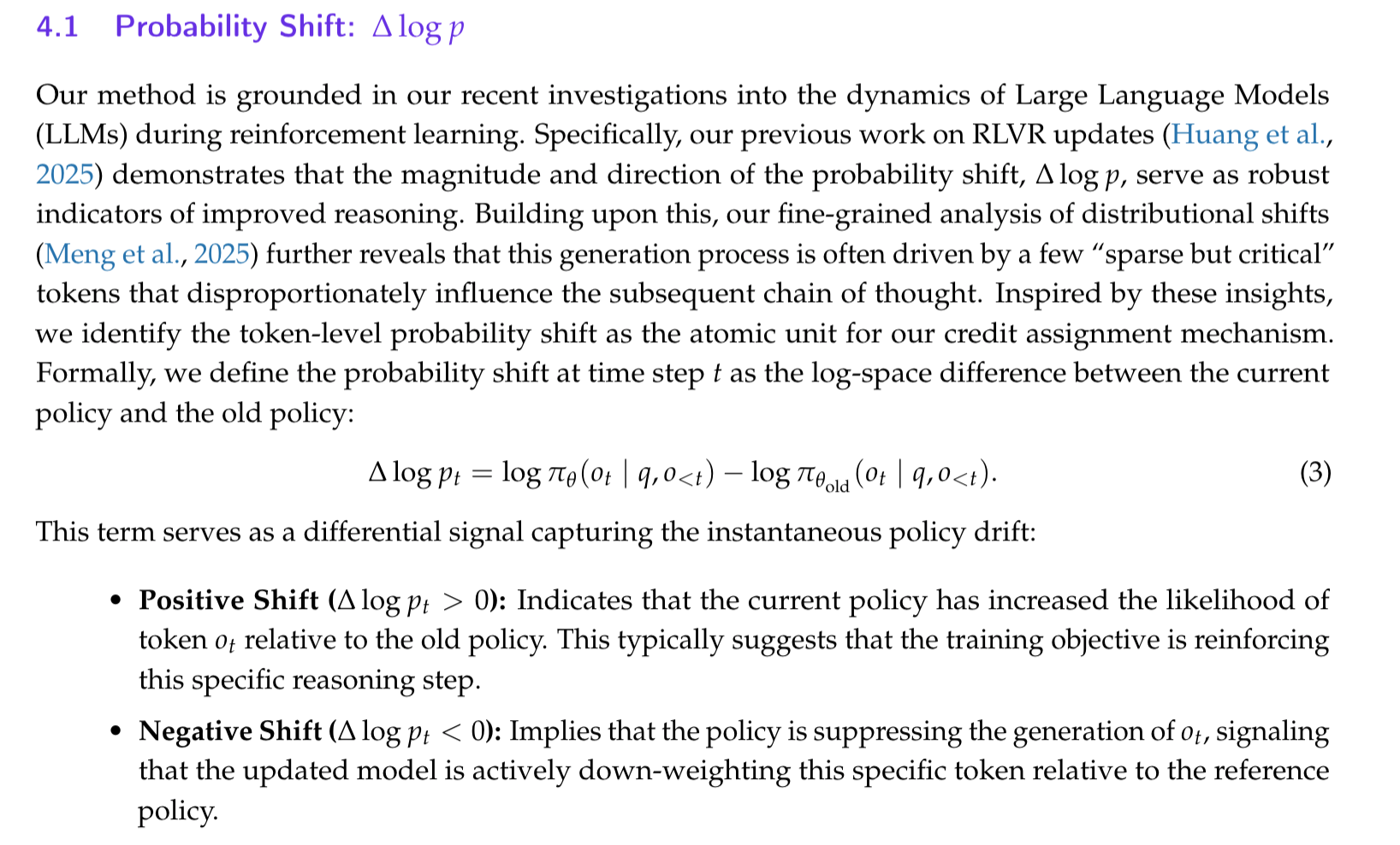

Sparse but Critical: A Token-Level Analysis of Distributional Shifts in RLVR Fine-Tuning of LLMs

来自 arxiv.org/abs/2603.22446,从介绍看没比之前二八开那篇多多少认知,感觉是描述类似的事情

On the Direction of RLVR Updates for LLM Reasoning: Identification and Exploitation

来自https://arxiv.org/pdf/2603.22117

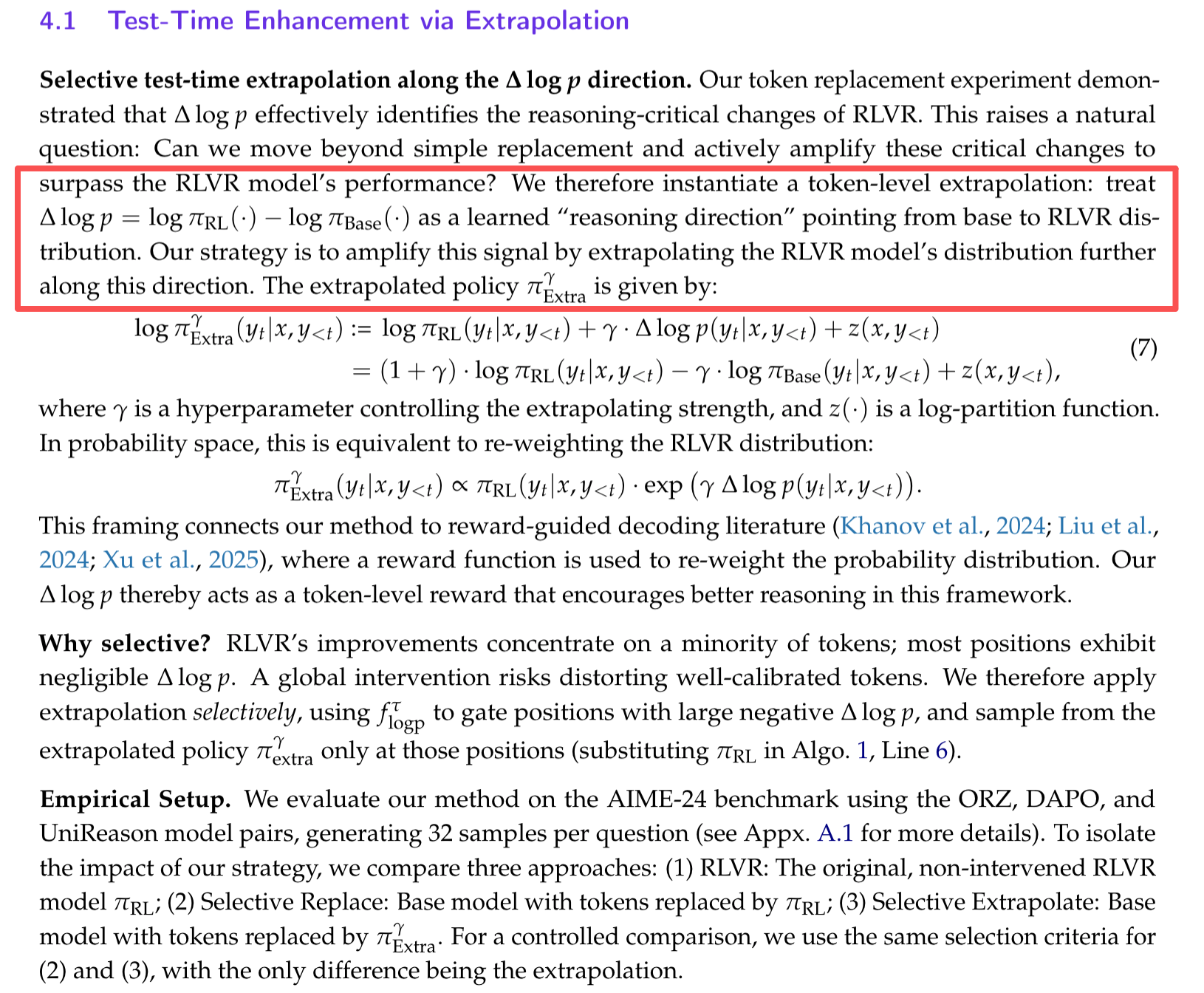

不训练,只在推理时增强关键 Token 的信号,准确率就能原地起飞,朝着delta logp的方向优化

"Oops Moment"多于"Aha 'Moment "

来自 https://qwen-pilot.notion.site/rlvr-secrets

在长序列推理中,模型常常已经推导出了正确答案,却由于冗余的自我反思而将其推翻。这种破坏性的 "Oops"时刻发生的频率比自我纠正的 "Aha"时刻高出 3 倍。

罪魁祸首? 标准 RL(如 GRPO)中采用的粗粒度信用分配 (Credit Assignment),它将奖励简单地平均分配给了整个推理链。

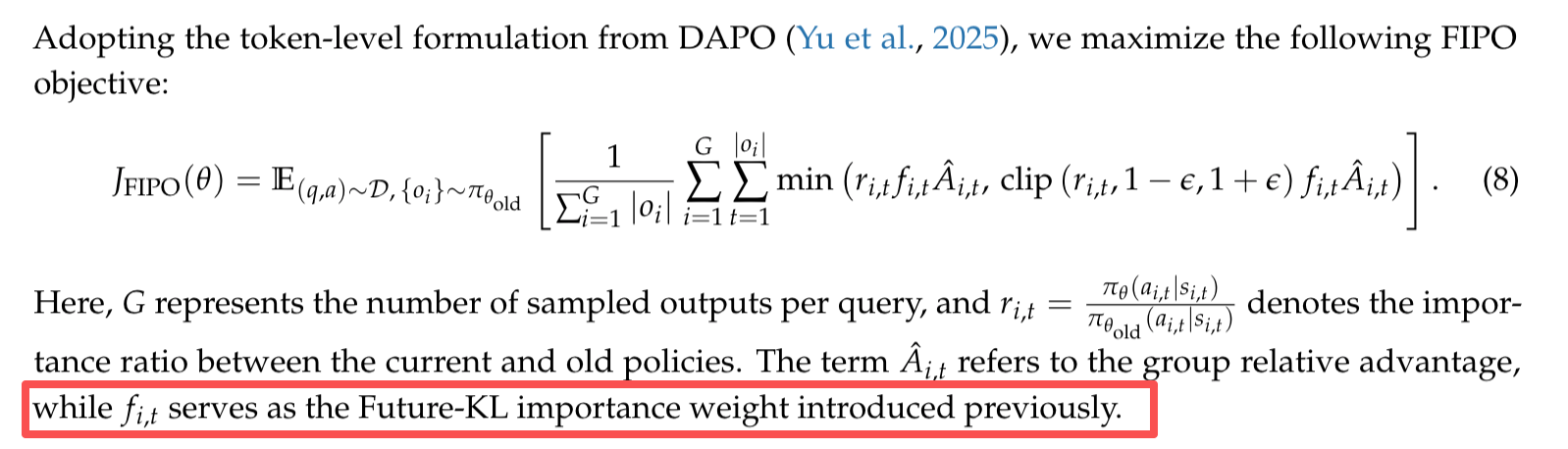

FIFO

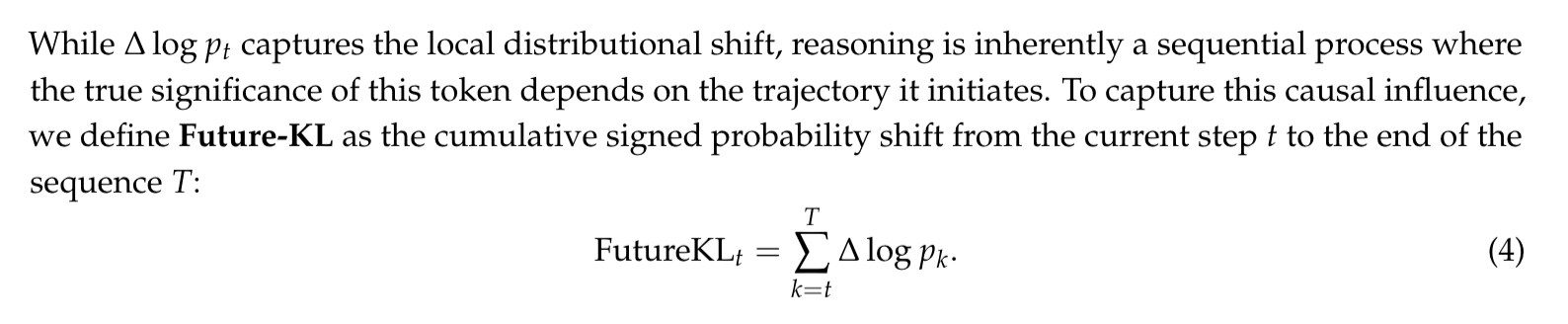

FIFO更像是把第二篇delta logp的观察做了一个实现: