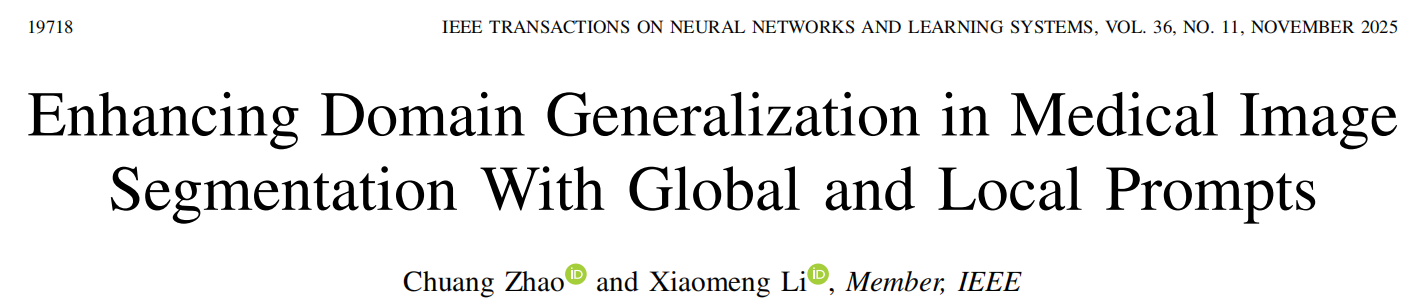

在医学图像分割的临床落地中,一个长期存在的痛点是**"领域偏移 (Domain Shift)"**。一个在A医院(源域)表现完美的深度学习模型,当部署到使用不同成像设备、不同扫描参数的B医院(未知目标域)时,往往会遭遇性能的断崖式下跌 。如图1所示,同样的糖尿病视网膜病变影像由于不同的拍摄设备展示出来的效果完全不同,虽然从分割mask的结果看,眼球结构类似。

近年来,大视觉模型(PVM,如 Vision Transformer)在自然图像领域展现了强大的特征表达能力。然而,直接将 PVM 引入医学领域泛化(Domain Generalization, DG)任务中,面临着极易过拟合源域、微调成本过高以及灾难性遗忘等问题 。现有的自然图像提示学习(Prompt Tuning)方法往往只在输入层插入提示,且高度依赖类别标签,无法适应仅有领域标签的医学分割任务 。

近期,发表于人工智能顶级期刊 IEEE TNNLS (2025) 的论文《Enhancing Domain Generalization in Medical Image Segmentation With Global and Local Prompts》(香港科技大学团队主导)提出了一种极具工程价值与理论深度的破局方案。该研究通过**"特征解耦"**的思想,创新性地提出了全局与局部提示框架(GLP),赋予了模型在跨院异构数据上强大的泛化思考能力 。

本文将结合该论文的理论架构与底层开源代码拆解这一框架的核心机制。

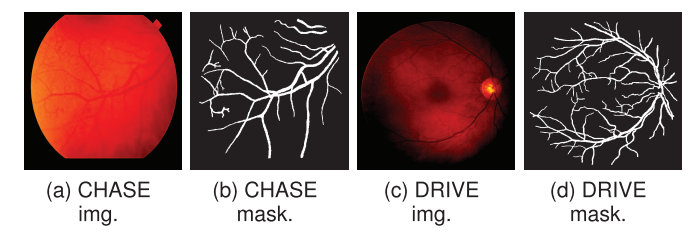

一、 核心架构:特征解耦与双重提示机制

医学影像数据同时包含"共性"与"个性"。共性即不同设备下均遵循的器官解剖结构;个性则是特定设备带来的独特对比度或伪影("设备签名")。GLP 框架的核心逻辑,就是用两种不同的 Prompt 将这二者剥离开来。

1. 全局提示 (Global Prompt) 与层次化插入

全局提示的目的是学习跨越所有医院的"领域共享知识"。不同于以往只在网络第一层拼接 Prompt 的粗糙做法,GLP 采用了层次化自适应插入 (Hierarchical Insertion)。

在 meta_encoder.py 的 Transformer 块(Block 类)中,提示并非简单的静态拼接,而是根据当前层特征动态计算的:

# 提取自注意力特征

xs = self.attn(self.norm1(x))

# 动态计算并插入当前层的全局提示 (Adapter本质是一个残差MLP)

if self.adapt_method:

xs = self.adapter1[int_d](xs, size)

# 加上残差连接,送入下一层

x = x + self.drop_path(xs)这种基于当前层特征实时"计算"出专属提示的方式,使得提示的语义随网络深度逐层递进,极大增强了大模型对医学特征的适应力。

2. 元学习 (Meta-Learning) 淬炼绝对共性

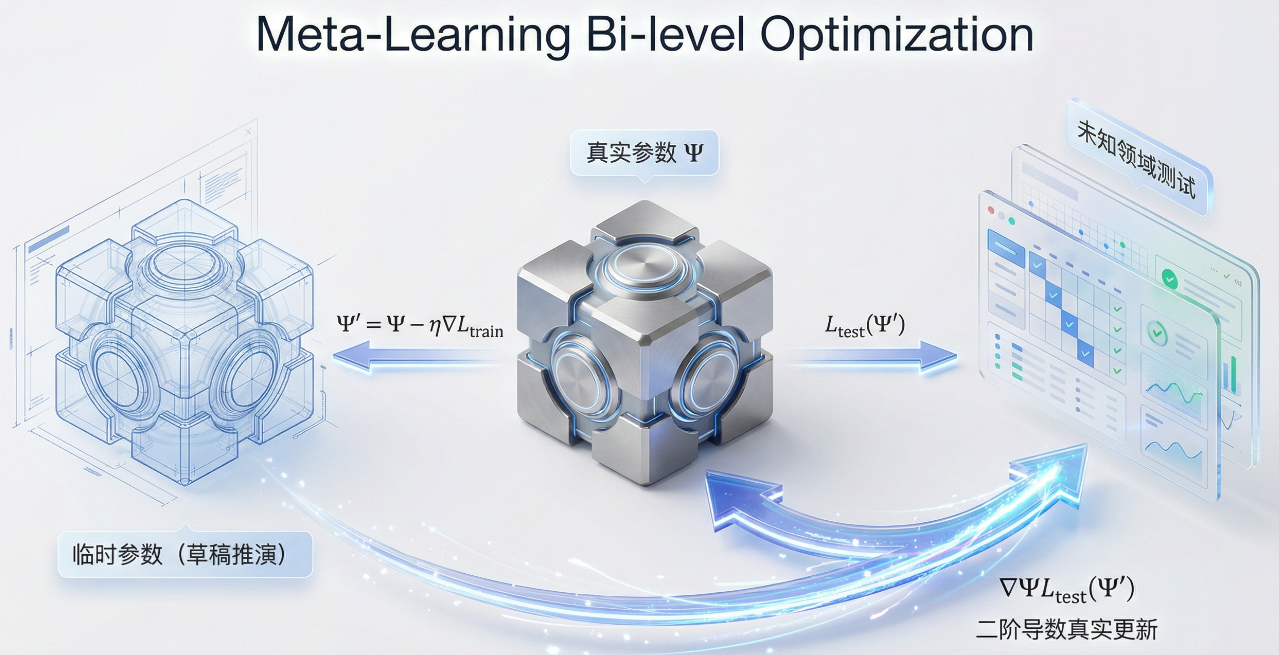

为了确保全局提示真正学到了跨域共性,而非仅仅死记硬背训练集的特征,作者引入了基于双层优化(Bi-level Optimization)的元学习策略:在草稿纸上推演,在真实环境里进化。

在 main.py 的训练循环中,作者将源域动态划分为 meta_train(练习题)和 meta_test(模拟考)。当模型在 meta_test 上前向传播时,它直接把刚才在 meta_train 上算出的 Loss 当作参数传了进去!

# 1. 在 meta_train 计算出 batch_loss

batch_loss = prior_loss + reco_loss + ...

# 2. 极其关键:将 batch_loss 传入 meta_test 的前向传播

mask, reco, ... = model(imgs, labels, 'training', meta_loss=batch_loss)为什么要传 Loss?在底层的 meta_adapter.py 中,我们可以看到真相:

if meta_loss is not None:

# 底层算子 meta_ops.linear 会拦截前向传播

# 动态计算出 临时参数 Ψ' = Ψ - lr * ∇L_train,并用 Ψ' 进行矩阵乘法

x = linear(x, self.input.weight, self.input.bias,

meta_loss=self.meta_loss, ...)这意味着:模型在内存中动态生成了"影子参数",并用它去试错,而显存中真正保存的物理权重 .weight 完全没有被修改! 直到最后链式法则求出二阶导数并执行 optimizer.step() 时,才完成真正的泛化进化。

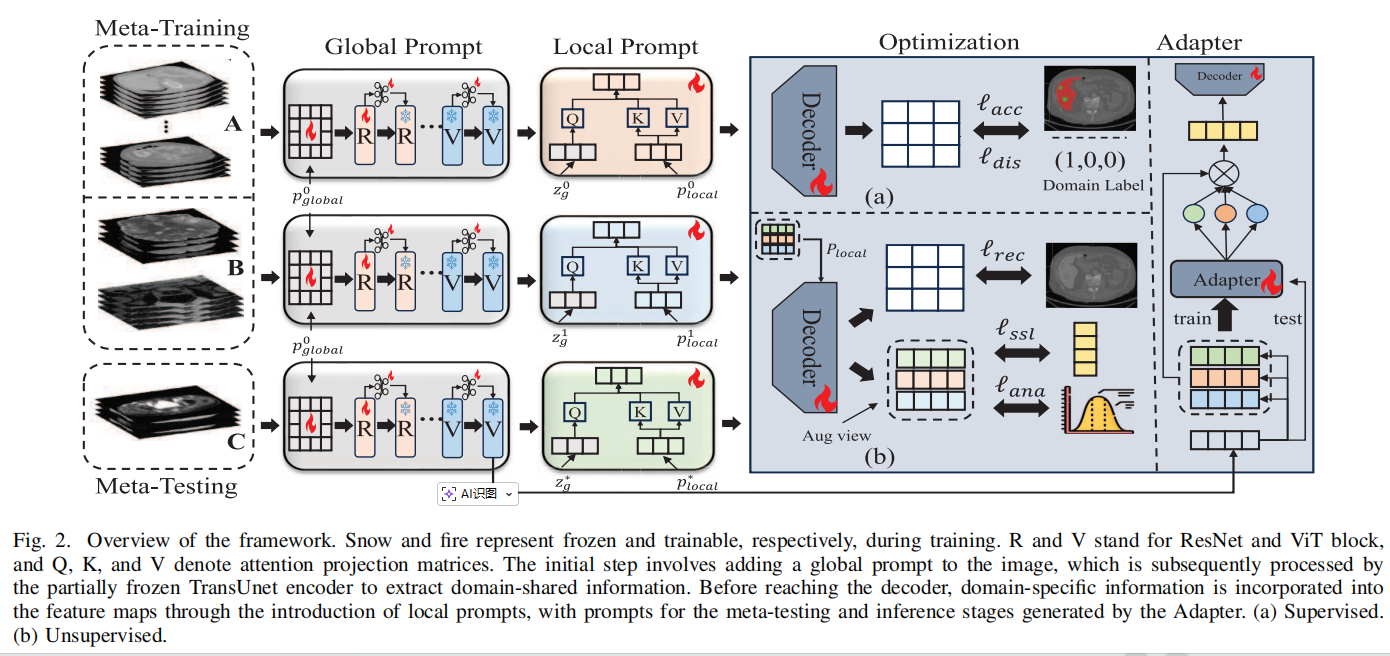

为了方便不熟悉元学习的读者了解,我补充一下关于元学习(Meta-Learning)中"双层优化(Bi-level Optimization)"的背景,论文中用了一个伪代码展示:

(1)"临时更新"的数学真相:计算并保存"影子参数"

当模型在元训练集(Dtr\mathcal{D}{tr}Dtr,相当于平时的练习题)上计算完损失 Lmeta_train\mathcal{L}{meta\_train}Lmeta_train 后,它会根据梯度下降公式计算出一个新的参数状态。

论文中的公式 (5) 是这样写的:

ψ′←ψ−η∇ψLmeta_train(ψ)\psi' \leftarrow \psi - \eta\nabla_{\psi}\mathcal{L}_{meta\_train}(\psi)ψ′←ψ−η∇ψLmeta_train(ψ)

θ′←θ−η∇θLmeta_train(θ)\theta' \leftarrow \theta - \eta\nabla_{\theta}\mathcal{L}_{meta\_train}(\theta)θ′←θ−η∇θLmeta_train(θ)

注意这里的撇号(')!

-

在代码实现层面,这意味着:

-

模型读取了真实的权重参数 ψ\psiψ。

-

模型计算了 ψ\psiψ 的梯度。

-

模型用 ψ\psiψ 减去学习率乘以梯度,得到一个全新的张量(Tensor),我们把它叫做 ψ′\psi'ψ′。

关键点: 模型将这个 ψ′\psi'ψ′ 保存在了内存的另一个地方,它并没有去覆盖覆盖掉原来的 ψ\psiψ。

所以,这就像是你在草稿纸上写下:"如果我现在顺着这个错题的思路改正,我的大脑回路会变成 ψ′\psi'ψ′ 的样子。" 但你的大脑本身(真实参数 ψ\psiψ)在这个瞬间并没有发生改变。

(2)为什么要制造这个"影子参数"?为了在元测试集上"试错"

生成了临时参数(ψ′,θ′\psi', \theta'ψ′,θ′)之后,算法进入了第 10 步:在元测试集(Dte\mathcal{D}{te}Dte,相当于没见过的新题型)上进行前向传播计算损失。此时,模型强行把刚才算出来的"影子参数 ψ′,θ′\psi', \theta'ψ′,θ′" 塞进了网络中 ,代替真实的 ψ,θ\psi, \thetaψ,θ 来处理 Dte\mathcal{D}{te}Dte 的数据,并计算出此时的测试损失 Lmeta_test\mathcal{L}{meta\test}Lmeta_test。 这一步的物理意义是:模型在评估"如果我真的按照刚才练习题(Dtr\mathcal{D}{tr}Dtr)的思路去更新了我的大脑(变成了 ψ′\psi'ψ′),那么我在面对这套全新的试卷(Dte\mathcal{D}{te}Dte)时,到底能考多少分(损失是多少)?"

(3)真正的参数是什么时候更新的?(双层优化的闭环)

真正的参数更新,发生在 Algorithm 1 的第 15 步。此时,模型手握两个损失:

- 刚才在真实参数上算出的练习题损失:Lmeta_train(ψ,θ)\mathcal{L}_{meta\_train}(\psi, \theta)Lmeta_train(ψ,θ)

- 刚才在影子参数上算出的新试卷损失:Lmeta_test(ψ′,θ′)\mathcal{L}_{meta\_test}(\psi', \theta')Lmeta_test(ψ′,θ′)

按照论文公式 (4),模型要最小化这两个损失的和 :

argminψ,θLmeta_train(Dtr;ψ,θ)+Lmeta_test(Dte;ψ′,θ′)\arg\min_{\psi, \theta} \mathcal{L}{meta\train}(\mathcal{D}{tr}; \psi, \theta) + \mathcal{L}{meta\test}(\mathcal{D}{te}; \psi', \theta')argminψ,θLmeta_train(Dtr;ψ,θ)+Lmeta_test(Dte;ψ′,θ′)

链式法则应用:

当框架对真实的参数 ψ\psiψ 求导时,第一项很简单。但第二项是关于 ψ′\psi'ψ′ 的函数,要对最初的 ψ\psiψ 求导,就必须使用高数中的链式法则(Chain Rule):

∇ψLmeta_test(ψ′)=∇ψ′Lmeta_test×∇ψ(ψ′)\nabla_{\psi} \mathcal{L}{meta\test}(\psi') = \nabla{\psi'} \mathcal{L}{meta\test} \times \nabla{\psi} (\psi')∇ψLmeta_test(ψ′)=∇ψ′Lmeta_test×∇ψ(ψ′)

因为 ψ′\psi'ψ′ 本身就包含了 ψ\psiψ 的一次梯度信息(公式 5),所以对 ψ′\psi'ψ′ 再求导一次 ψ\psiψ,就会产生二阶导数(Hessian矩阵或其向量乘积)。

在这一刻,框架把一阶的练习题经验,加上二阶的新试卷教训,融合在一起形成一个极其深谋远虑的"超级梯度"。只有到了这一步,模型才会拿着这个超级梯度,去真正地覆盖并更新显存里的原始参数 ψ\psiψ 和 θ\thetaθ。

我用AI绘制了一个示意图

3. 局部提示 (Local Prompt) 与个性化领域适配器

如果说全局提示负责共性,那么局部提示向量 plocalkp_{local}^kplocalk 则负责捕捉"设备个性"。这在推理阶段解决 DG 痛点时发挥了核心作用。传统的 DG 方法在面对完全未知的目标医院时,往往是对所有源域特征进行简单的宏观平均。但新医院的一张具体切片,可能在风格上 80% 类似 A 医院,20% 类似 B 医院。GLP 引入了一个轻量级的个性化领域适配器 (Individualized Domain Adapter)。

在 promptseg.py 的 prompt_forward 函数中,这段代码极其优雅地实现了"量身定制的动态 Prompt":

def prompt_forward(self, encoder_out, prompt_bank, ...):

hint = encoder_out.detach() # 获取图像特征

# 1. 适配器输出该图像与 K 个源域的相似度

all_bias = self.adapter(hint, ...)

# 2. Softmax 归一化,得到不同风格的占比权重 (如 [0.8, 0.2, 0.0])

all_bias = F.softmax(all_bias, dim=-1)

# 3. 核心:通过矩阵乘法 (@),按权重动态融合源域提示库

prompt_bank = prompt_bank.view(self.domain_nums, -1)

domain_prompts = (all_bias @ prompt_bank).view(...)

return domain_prompts, all_bias这种从"宏观领域平均"到"微观样本定制 (Sample-to-domain)"的细粒度迁移,是实现高精度跨域分割的关键。

二、 榨干无标签数据:半监督场景下的解剖学先验

在半监督领域泛化(Semi DG)设定下,标注数据极度稀缺。为了挖掘样本自身的内在价值,GLP 提出了一项极其聪明的无需外部标签的正则化设计:解剖学先验约束 (Lana\mathcal{L}_{ana}Lana)。

在眼底图像或前列腺 MRI 等标准化影像中,目标器官具有相对固定的空间分布(通常位于画面中心区域)。基于此,作者在解码器引入了变分自编码器(VAE)的机制,强迫模型生成的掩码特征隐分布逼近标准二维高斯分布 N(0,1)\mathcal{N}(0,1)N(0,1)。

在 losses.py 中,标准的 KL 散度被实现:

def KL_divergence(logvar, mu):

# 计算隐变量分布与标准高斯分布 N(0,1) 的 KL 散度

kld = -0.5 * torch.sum(1 + logvar - mu.pow(2) - logvar.exp(), dim=-1)

return kld.mean()在 main.py 的训练主逻辑中调用:

mask, recons, feature, mu, logvar = self.decoder(...)

# 约束隐空间的均值(mu)和方差(logvar)逼近正态分布

kl_loss1 = KL_divergence(logvar[:, :8], mu[:, :8])

prior_loss = kl_loss1 * config['prior_reg']从数学直觉上看,这相当于给网络提供了一条**"解剖学捷径"**:在面对极其模糊、充满未知伪影的新医院图像时,模型会受到高斯分布的数学牵引,本能地聚焦于图像的合理中心区域,极大抑制了画面边缘的假阳性误判。

三、 评判性分析

在涵盖 MRI 和眼底图像等五个异构医学数据集上,GLP 在全监督和半监督场景下均展现了显著的性能优势。特别是在仅有 2% 标注数据的极端场景中,其泛化性能依然坚挺。然而,这里我带着找茬的眼光去挑刺:

1. 高斯解剖学先验的脆弱性

强制掩码特征逼近标准高斯分布的假设,在视网膜血管等结构固定的场景下非常有效。但在真实的肿瘤病理场景中(如巨大的肝细胞癌),占位性病变往往会严重挤压、扭曲正常解剖结构。在这种极端变异下,强制施加中心先验可能会导致模型将不规则病灶"强行圆润化"。

2. 适配器的"闭源词典"陷阱

专属局部提示是由现有源域提示的线性组合得到的(矩阵相乘 @ 操作)。这本质上假设:未知目标域的风格,一定能被现有已知源域风格所表出。如果目标医院采用了一种物理成像机制完全不同的新型扫描序列,适配器只能在现有的错误字典里"拼凑",无法生成真正契合新设备的特征。未来引入基于大型视觉语言模型(VLM)的开放词汇语义先验,或许是破解之道。

小结

这是一篇兼具严谨数学推导与极客工程精神的优秀工作。它深刻揭示了:在复杂的医疗泛化场景下,大模型的**"提示(Prompt)"不应仅仅是一串生硬的文本,而应是一把能够同时兼顾"跨域共性"与"实例个性",并能通过底层双层优化动态演化。** 这一框架为预训练大模型在真实临床场景的缝落地,提供了一个极具潜力的研发范本。