前天的时候,智谱突然给我发了一条短信,在 Coding Plan 里悄悄上线了 GLM-5.1,我的账号首先获得了内测资格。

我很开心,为什么呢?因为我正好有个搁了很久的个人项目:我一直想做一个内容付费的个人博客网站,带完整的前后端和数据库,支持文章发布、内容加密、付费解锁、作者后台管理等。

其实,这个项目说大不大,说小不小,但环节多、链路长,属于那种"每一步都不算难,但串起来很烦"的典型全栈工程活。正常一个人撸,怎么也得两三周的时间。

我看了一下 GLM-5.1 的相关介绍,GLM-5.1 这次主打的就是"长程任务"能力:更强的目标拆解和规划,复杂任务拆成可执行步骤之后能一路推进不跑偏;多工具之间的协同更稳,代码、API、数据库这些环节能连贯地衔接,从"会做一步"变成"能跑完整条链路";还有就是上下文记忆更扎实了,长时间工作也能记住前面做过什么、当前到哪一步、接下来该干什么。

这不就是为我这个项目量身定做的吗?环节多、链路长、前后依赖重,正好拿来测一测 GLM-5.1 到底能不能扛住真实的长任务。

好,废话不多说了,实测开始。

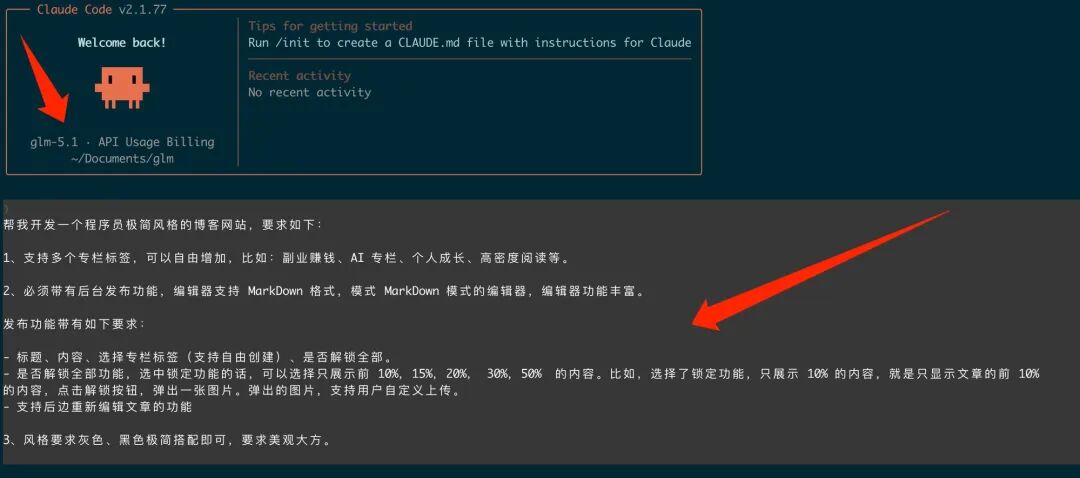

我没有写很详细的技术文档,就用自然语言描述了一下我想要的东西,如下:

go

帮我开发一个程序员极简风格的博客网站,要求如下:

1、支持多个专栏标签,可以自由增加,比如:副业赚钱、AI 专栏、个人成长、高密度阅读等。

2、必须带有后台发布功能,编辑器支持 MarkDown 格式,模式 MarkDown 模式的编辑器,编辑器功能丰富。

发布功能带有如下要求:

- 标题、内容、选择专栏标签(支持自由创建)、是否解锁全部。

- 是否解锁全部功能,选中锁定功能的话,可以选择只展示前 10%,15%,20%, 30%,50% 的内容。比如,选择了锁定功能,只展示 10% 的内容,就是只显示文章的前 10% 的内容,点击解锁按钮,弹出一张图片。弹出的图片,支持用户自定义上传。

- 支持后边重新编辑文章的功能

3、风格要求灰色、黑色极简搭配即可,要求美观大方。

其实,你看都是大白话,只要描述出自己想要的东西就行。然后我就坐在旁边看它干活。

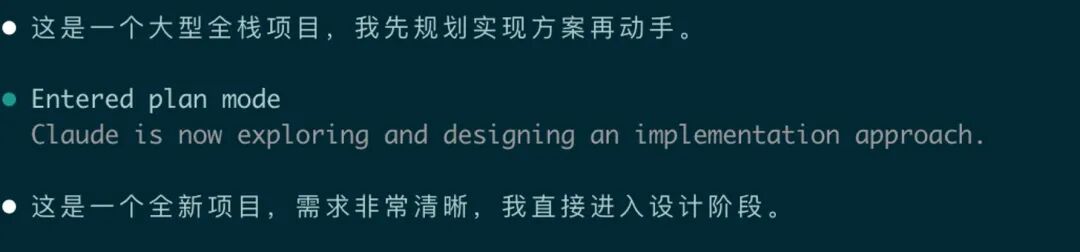

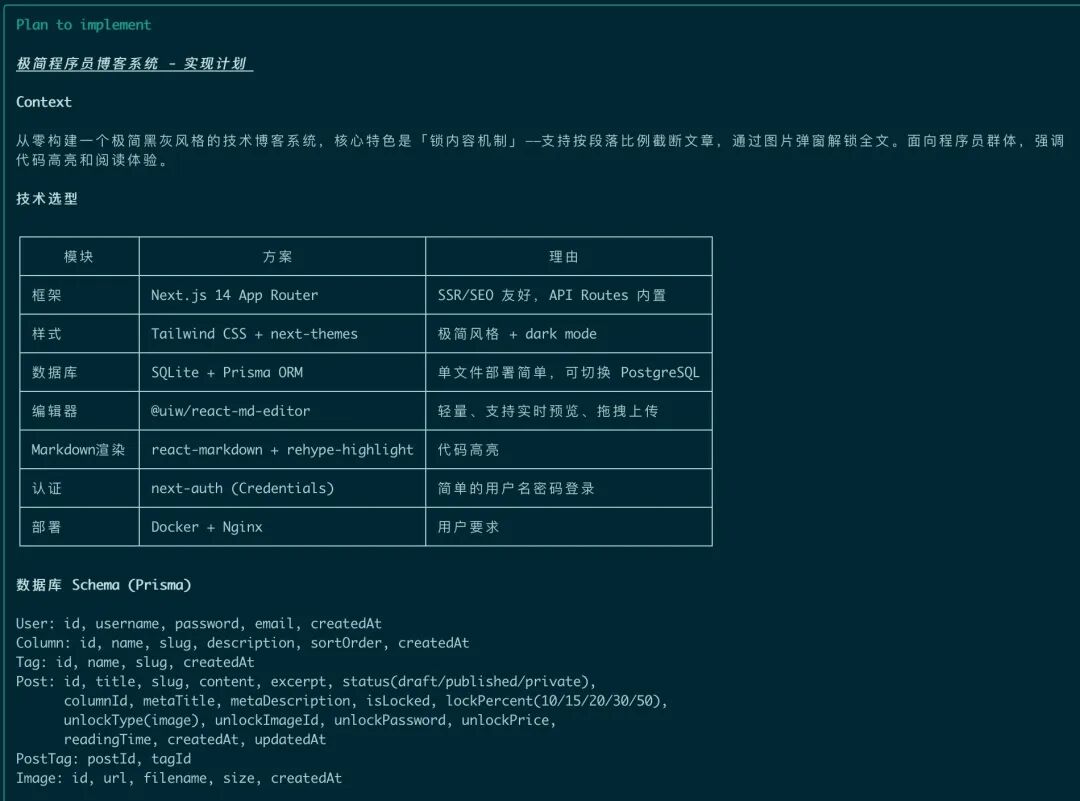

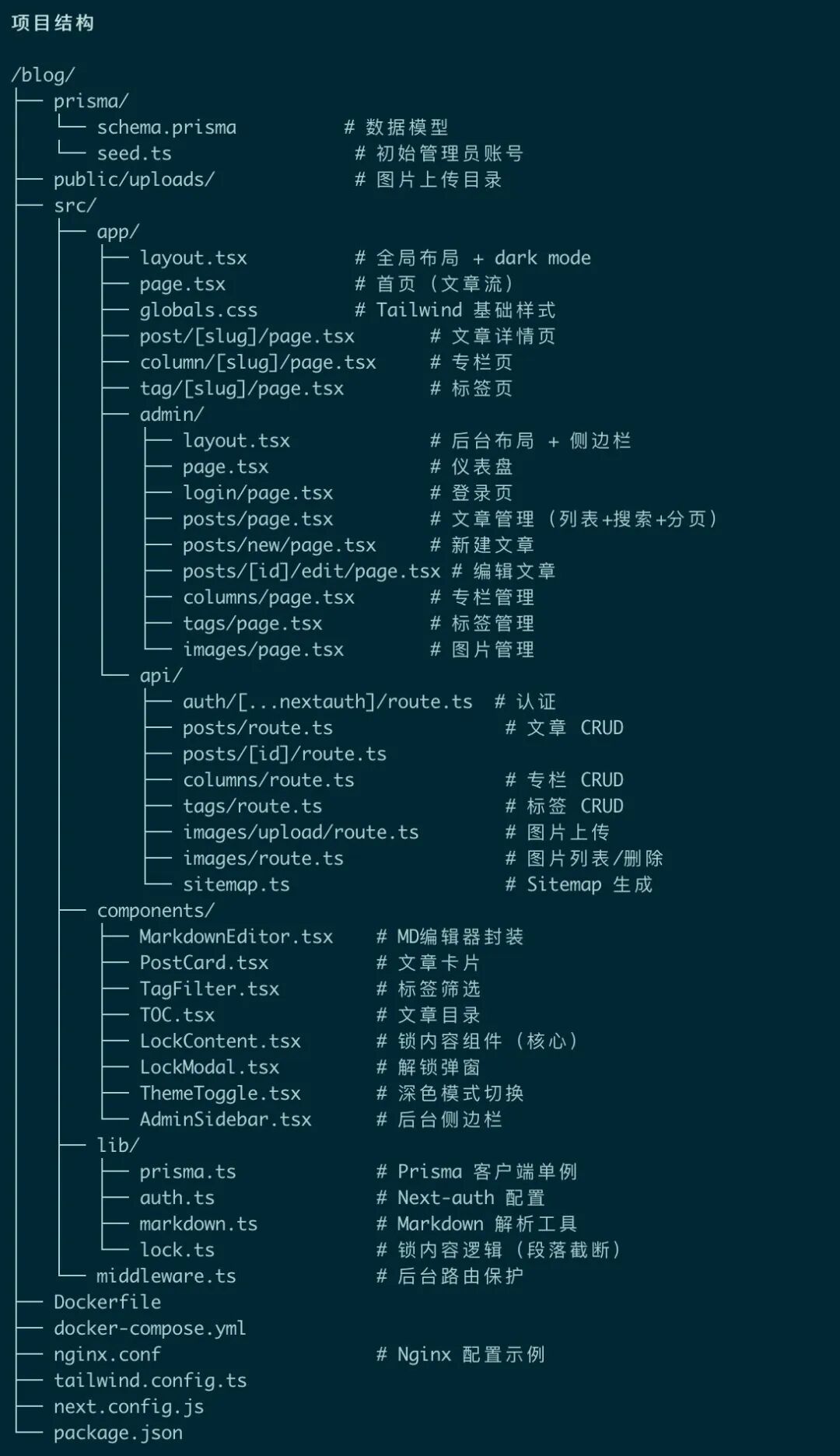

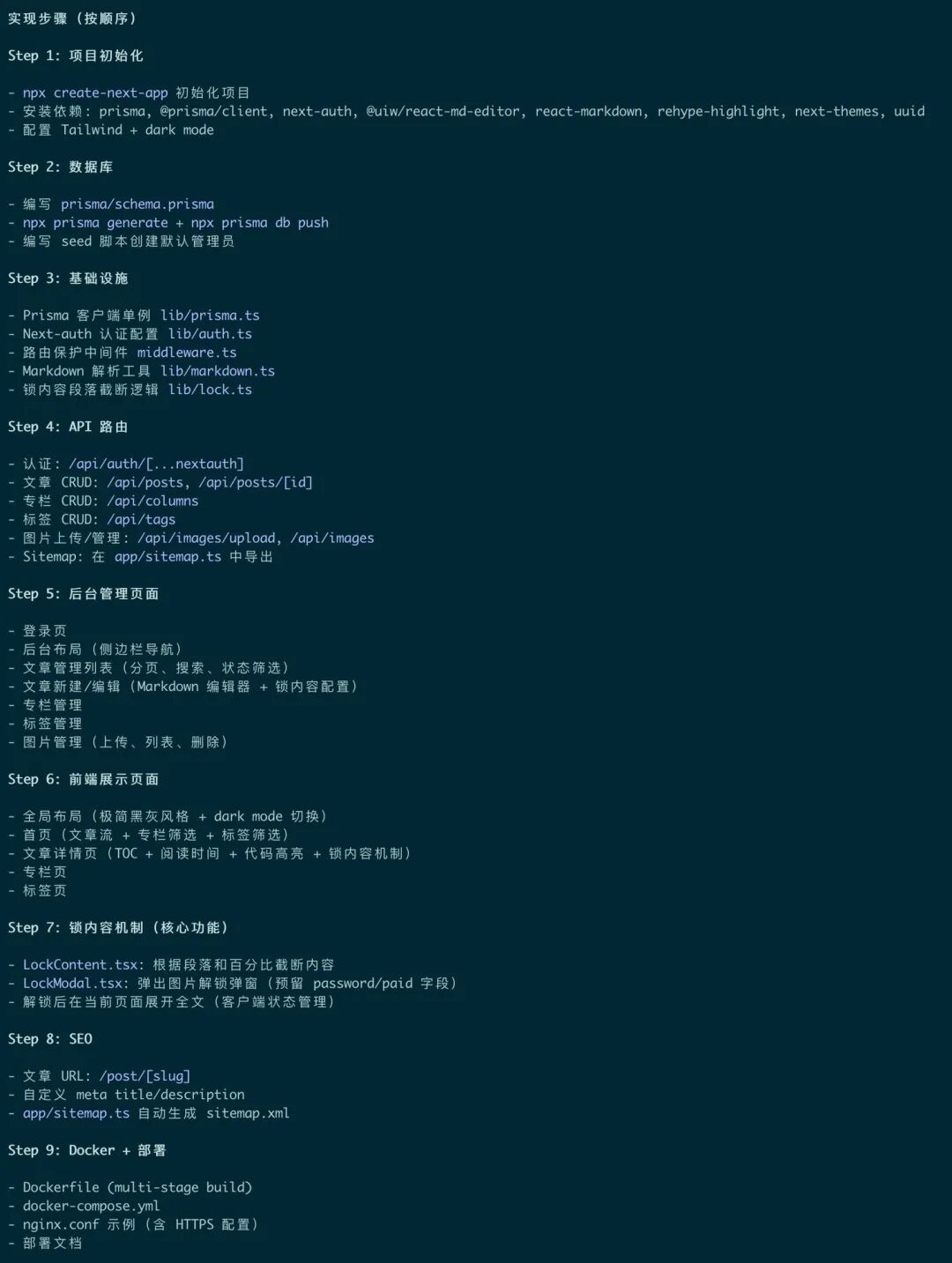

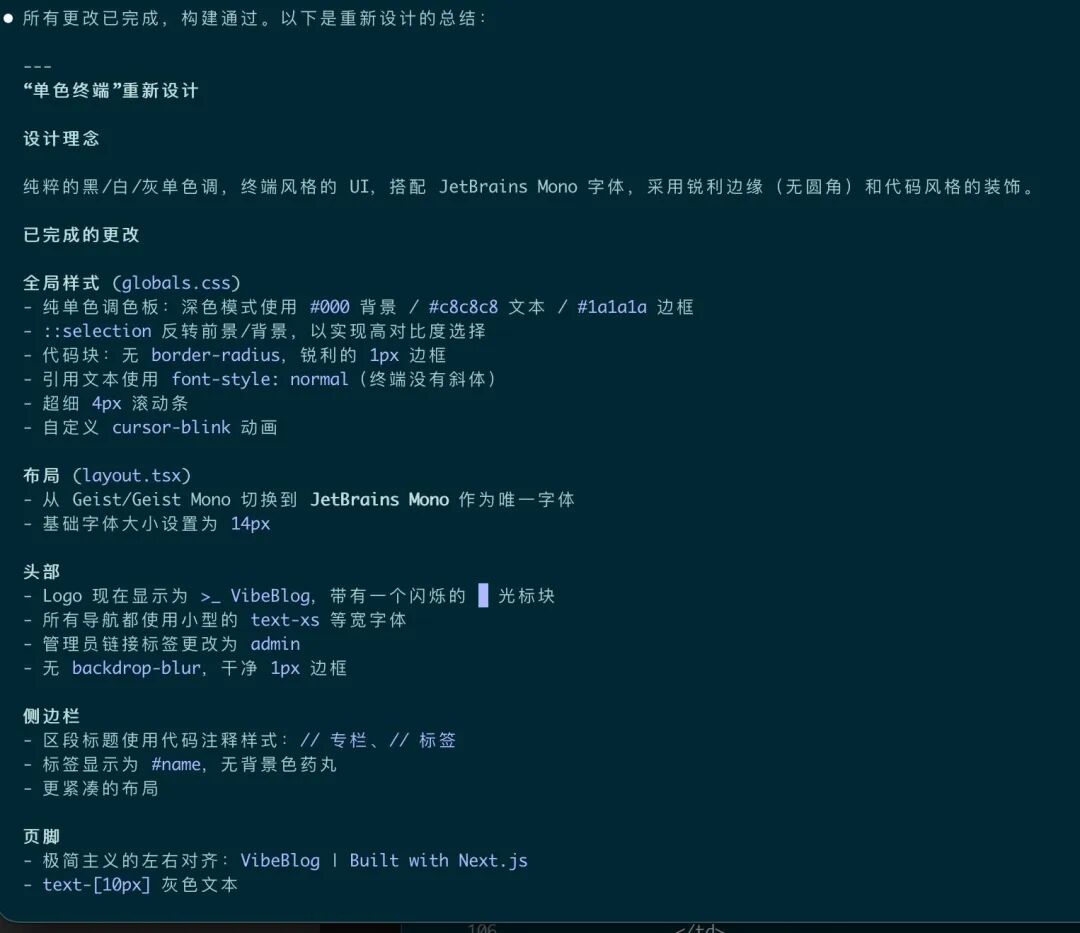

GLM-5.1 的第一个反应让我有点意外。它没有上来就写代码,而是说这是一个大型全栈项目,然后先花了大概两分钟输出了一份完整的技术方案:前端用 Next.js,后端用 Node.js ,数据库选 SQLite 等。

同时给出了项目结构和实施步骤。

说实话,这个起手式就和之前用的模型不一样。以前用其他模型,需求扔进去基本就开始"啪啪啪"写代码了,写到一半发现架构不对再推翻重来,来回折腾好几轮。GLM-5.1 是先想清楚再动手,像一个有经验的工程师接到需求后的第一反应:先理解,再规划,最后才动键盘。

等我确认之后,它就开始按照自己的规划和实施步骤开始工作了,整个过程非常顺利,我睡完午觉,活就干完了,我看了看,整个过程用时不到半小时,28 分钟左右。

让我本地启动,我们一起看看一次性完成的效果如何,到底怎么样?

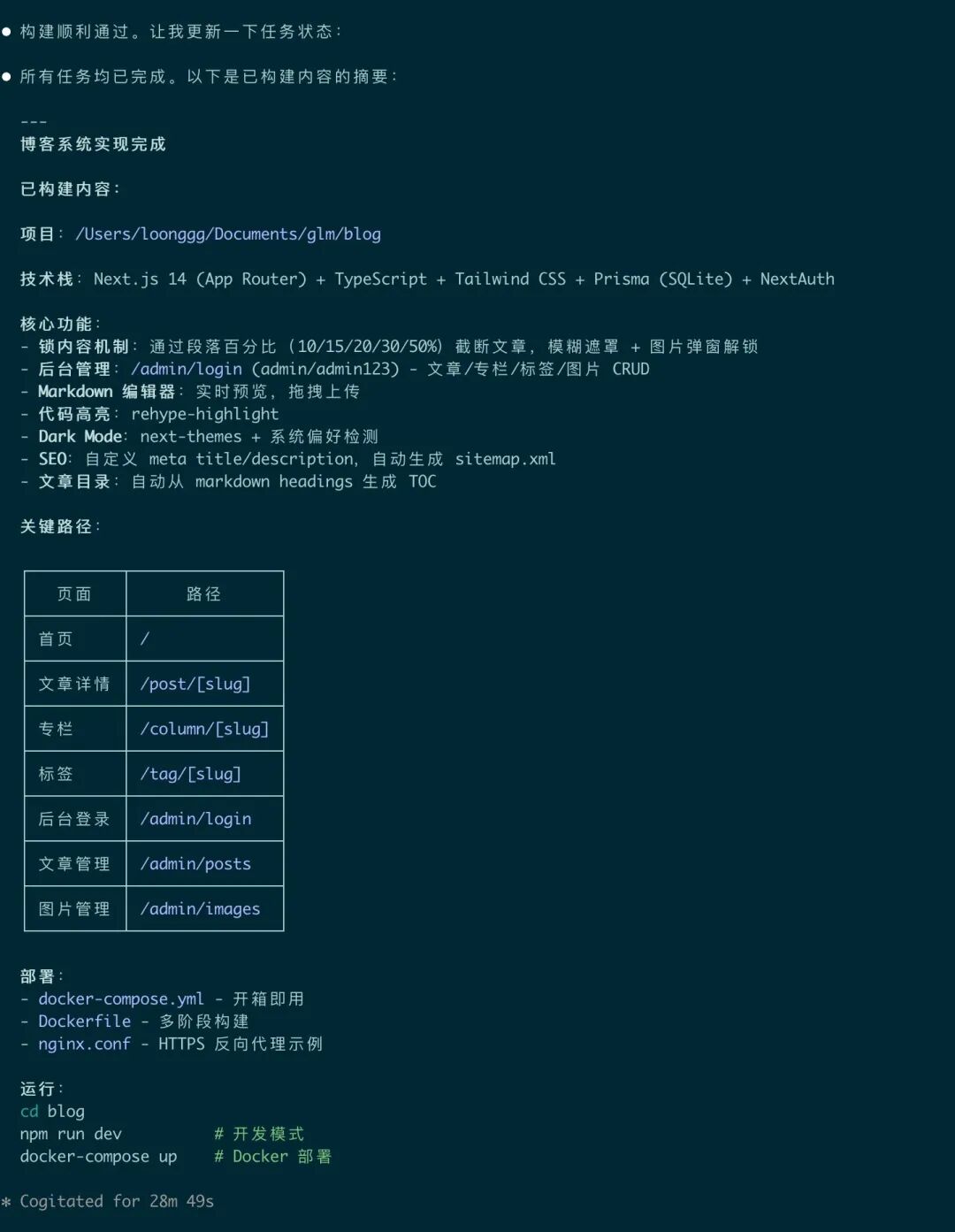

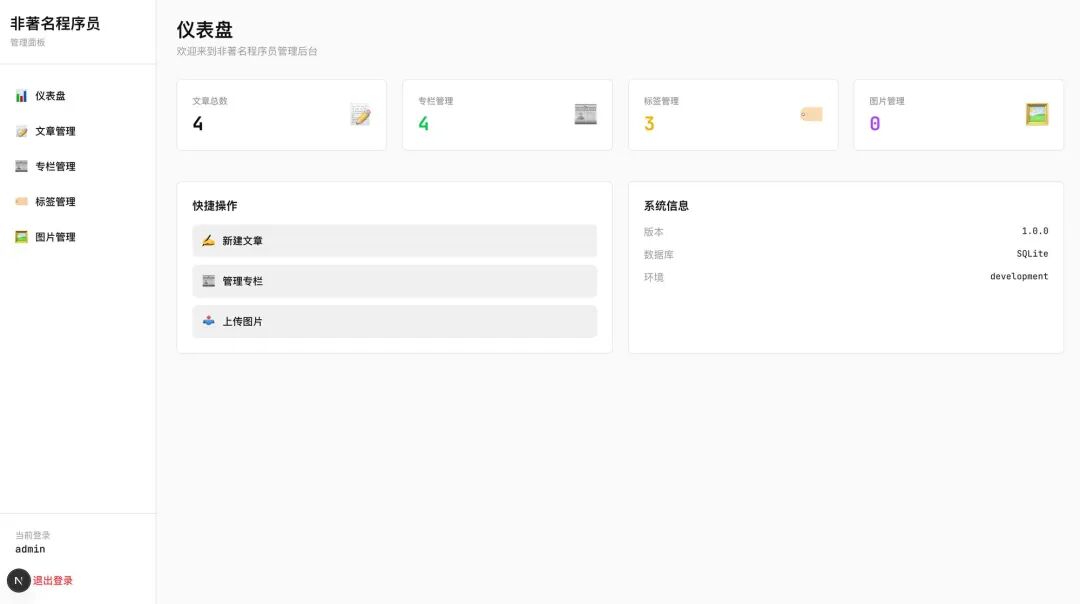

后端界面:

前端博客界面:

前端部分是我最担心的,因为涉及的页面多:首页文章列表、文章详情页、作者后台管理页、发布页等等,这些页面之间还有复杂的状态流转和路由跳转,我把整个发布流程测试了一下,还可以,几乎没有什么 bug ,唯一的不满意的地方就是界面太极简了。虽然我要的是程序员极简风,但是,感觉不是很高端,所以,我使用 GLM-5.1 调用了 front-design skill ,重新设计了整个界面风格。

跑完代码之后,真的是让我非常满意,非常有程序员特色,还是黑白灰极简风格。大家可以看看。为了方便,这里给大家放个动图,在博客名字上采用了最近非常火的 CLI 风格,一个光标一闪一闪的,就像是在终端里展示博客一样。

夜间模式界面:

文章详情页(需要解锁):

后端管理系统:

说实话,我非常满意,太漂亮了, 就是我想要的那种极简风格,同时又很极客,看到这个风格,我就决定要买一个服务器了,把这套系统部署到线上。

当然了,当我深度体验之后,也并不是没有任何 Bug ,其中还是有一个 Bug 的,就是发布文章的时候,可以选择锁定和不锁定,我发现当我选择不锁定,发布了一个长文之后,点击文章详情页,文章只显示了一半。所以,我又提出问题了,说:

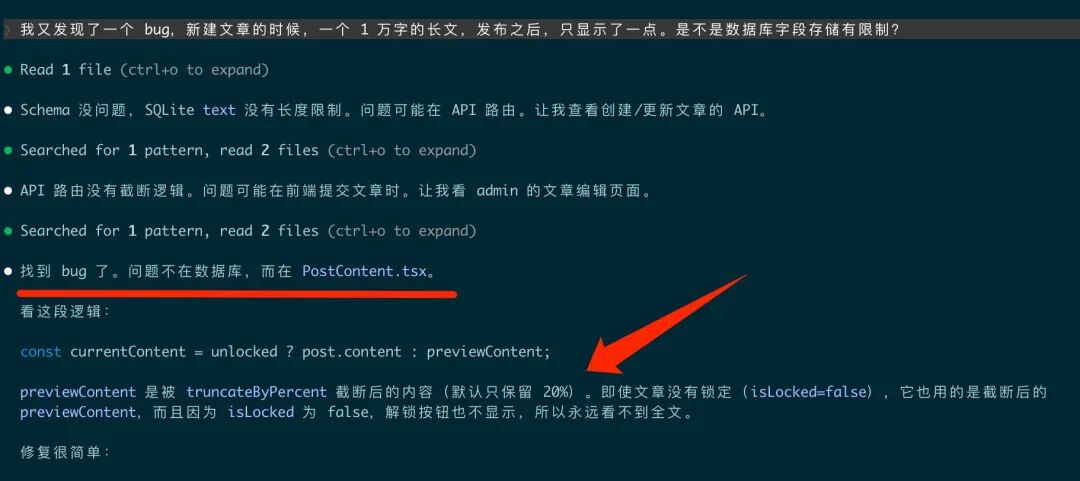

我又发现了一个 bug,新建文章的时候,一个 1 万字的长文,发布之后,只显示了一点。是不是数据库字段存储有限制?

我以为数据库设计的时候,字段有限制的,所以没显示全。

看看 GLM-5.1 是怎么做的?它先是按照我的猜测去检查问题去了,但是,它发现数据库设计的时候字段并没有限制,它就开始自查了,查了路由跳转的时候是不是截断了,发现也不是,最后它发现是文章付费解锁的逻辑导致的。它会自己把所有的情况都查一遍。

从我发现问题,提出问题之后,到修复完成,大概 5 分钟。全程没问我。

这个过程让我真正理解了什么叫"长程任务能力"。它不只是能写代码,它能在一个复杂系统里定位问题、分析原因、制定修复方案、验证结果,整个排查链路和一个有经验的后端工程师没什么区别。

整个过程 GLM-5.1 自主规划,自我执行,持续工作了大约1 个多小时,烧掉了大概 4500 万 tokens。最终交付了一个前后端完整、数据库设计合理、付费解锁流程跑通的内容付费博客系统。

这个工作量如果让我自己从零开始撸,保守估计两到三周。如果算上中间查文档、调 bug,可能更久。

1 个小时 vs 两三周。这个效率差距已经不是"提效"能概括的了。

说完 GLM-5.1 的表现,聊聊和其他模型的对比。同样的需求,我之前分别用 Opus 4.6 和 K2.5 跑过类似复杂度的项目。

先说 K2.5**。** 单步代码质量没问题,写出来的每一段代码都挺规范的。但到了十几步左右,问题开始出现:数据库表结构在后端实际写的和前面设计阶段定义的对不上,字段名变了,类型也变了,需要我手动纠正。到联调阶段,接口字段名前后不一致的问题出了三次。最后交付的东西能跑,但我手动修了五六个地方才算完整。

K2.5 的问题很典型:它在短链路上表现不错,但一旦任务拉长到几十个步骤,上下文记忆就开始衰减,前面定好的规则后面就忘了。像一个很聪明的应届生,每一步都不差,但你得盯着。

再说 Opus 4.6**。** 全程表现很稳,长链路记忆和自主纠错能力都很强,交付质量高。体感上和 GLM-5.1 非常接近,两个模型在长任务场景下的表现基本在同一个水平线上。

最后说 GLM-5.1**。** 综合能力和 Opus 4.6 持平,长任务稳定性明显优于 K2.5。但关键区别在价格:Opus 4.6 的 API 调用费用,跑完这个项目大概要花几十美元。GLM-5.1 通过 Coding Plan 使用,成本低了一个数量级。当然了,我们也知道像智谱这类的国内大模型公司被国外卡脖子,算力可能不够用,导致高峰期的时候,大家使用会有一些波动。

同样的活,同样的质量,十分之一的价格。这笔账很好算。

说实话,用完 GLM-5.1 之后,我坐在电脑前想了很久。

以前用 AI 写代码,体感像在带一个实习生。你得告诉它做什么,盯着它做,做错了帮它改,做完一步再告诉它下一步。你是项目经理,它是执行者。

GLM-5.1 给我的感觉变了。你给它一个目标,它自己拆解、自己规划、自己执行、中间出了问题自己修、最后给你一个完整的交付物。你是甲方,它是那个能独立交付的资深工程师。

业界称这个为 Long Horizon,长程任务能力。我觉得这个词很准确。以前的模型能力上限是"帮你做好一步",现在的上限是"替你做完一整件事"。

这个变化意味着什么,每个人可以自己想想。

Coding Plan 用户现在就能用 GLM-5.1,记得在配置里手动切换模型。还没开通的,建议尽快试试。这一波,国内 Coding 模型的天花板确实又被拉到了一个新的高度。

当然了,现在算力紧张,Coding Plan 套餐基本处于"开抢即售罄"的状态。我写这篇文章的时候犹豫了很久,因为每多一个人看到,我下次抢到的概率就又低了一点。哈哈哈哈......