一、ollama私有大模型本地部署

1.智聊机器人概述

① 知道什么是聊天机器人

能够听懂人话,并且说出人话的程序。

1)基本定义:一个用来模拟人类对话或聊天的程序。

2)主要应用:客服支持、智能助手、社交互动、教育学习等。

3)关键问题:机器如何判断一条输入句子的合理性?机器的回复是否是人类可以理解或者是人类习惯在日常生活中习惯表达的?

4)解决方法:利用自然语言处理、机器学习等技术。当前最热:大模型技术

② 了解聊天机器人的特点

1)自然语言理解(NLP):能够理解用户输入自然语言,并从中提取意图和关键信息。

2)对话管理:通过对话引擎维持对话的连贯性,根据上下文生成合适的回答。

3)个性化交互:可以根据用户的历史记录和偏好提供定制化回答。

4)多功能性:除了聊天,还可以执行任务,如查询信息、预订服务、提供帮助等。

图灵测试:同一个问题,机器和人回答,另外一些猜,哪些话是机器回答,哪些是人回答的

③ 了解聊天机器人的应用场景

1)客户服务:在电商、、金融等领域,自动解答用户问题,提供24*7的客户支持。

2)娱乐:一些聊天机器人可以与用户进行趣味对话,提供娱乐体验。

3)教育:用于语言学习、知识问答等教育场景。

4)智能家居:控制家电设备,如灯光、空调等。

5)医疗健康:提供健康咨询、预约挂号等服务。

...

④ 常见聊天机器人

|----------|------------------------------------------------|

| DeepSeek | 由杭州深度求索人工智能基础技术研究有限公司研发,其核心优势在于性能卓越、低成本开发和开源策略 |

| Kimi智能助手 | 由月之暗面科技有限公司开发,支持超长上下文(最高200万汉字),适合长文本处理和复杂对话。 |

| 通义千问 | 阿里云推出的人工智能助手,适合办公场景。提供高效的信息处理能力。 |

| 讯飞星火 | 科大讯飞出品,支持语言输入和语音朗读回复,适合语言交互场景。 |

| 豆包 | 字节跳动推出,支持抖音和今日头条的内容信息获取,适合内容创作和信息检索。 |

什么是聊天机器人?

聊天机器人是一种基于人工智能的自然语言处理技术开发的软件程序,能够通过文本或语音与用户进行交互,模拟人类对话。它可以根据用户输入的问题或指令,生成相应的回答或执行特定的操作。

⑤ 熟悉智聊机器人项目效果

2.前端和后端的技术栈

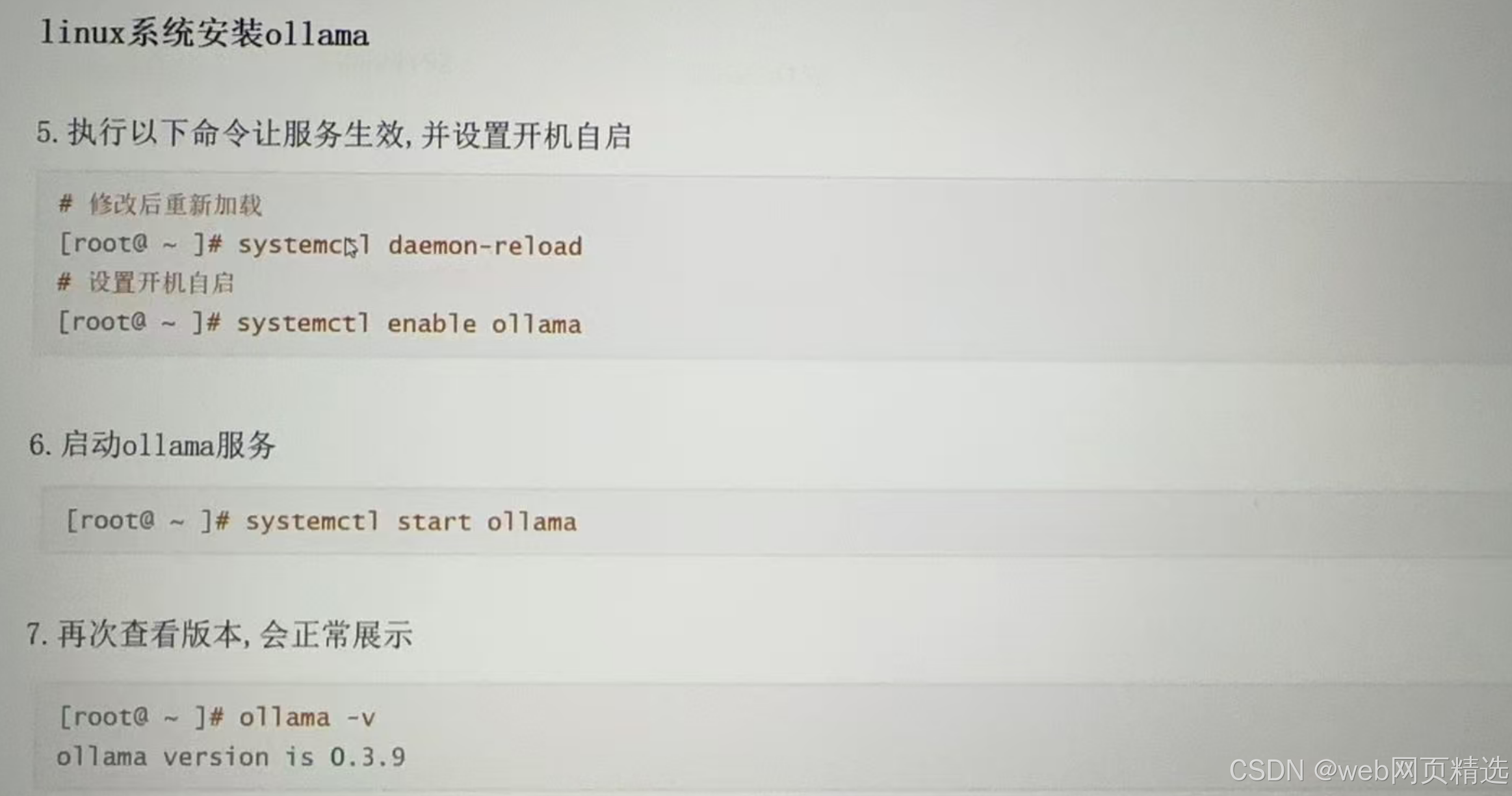

3.ollama安装

4.ollama命令

5.ollama私有大模型安装

二、智聊机器人

1.智聊机器人项目需求

该项目旨在构建一个基于大模型的智能聊天机器人,利用其强大的自然语言处理和生成能力,为用户提供高效、精准、个性化的对话服务。

该聊天机器人将集成先进的大规模预训练语言模型(如Deepseek、Qwen等),具备自然语言理解、多轮对话、情感分析、智能问答等核心功能,并可根据具体应用场景进行定制化拓展,如客服咨询、教育辅导、娱乐互动等。

(一)核心对话功能需求

1.自然语言处理

2.实时对话交互

(二)用户界面功能需求

1.简洁明了的布局

2.交互式体验

根据上述功能需求,项目采用模块化设计,前端通过Streamlit等框架实现简洁易用的交互界面,后端基于ollma等平台进行模型部署和管理,确保系统的高效性和可拓展性。

2.如何搭建聊天机器人

常见的搭建聊天机器人方式有三种:

分别是:

1.使用无代码平台搭建

无代码平台允许用户通过可视化界面快速创建聊天机器人,无需编程基础。例如,扣子(Coze) 是一个由字节跳动开发的智能体应用开发平台,支持集成多种大语言模型(如DeepSeek),并可以快速接入微信公众号。

搭建步骤:

1.注册并登录平台:访问扣子官网,使用抖音或飞书扫码登录。

2.创建应用:填写智能体名称、功能介绍和图标。

3.配置机器人:

选择模型(如 DeepSeek或其他大模型)

添加插件(如联网、绘画等)

编写开场白并测试对话效果

4.接入平台:将机器人接入微信公众号或其他平台,配置必要的参数(如AppID)

2.使用开源框架开发

如果你有一定的编程基础,可以使用开源框架(如ChatterBot)和Web 框架(如Flask)来开发聊天机器人其中,ChatterBot 是一个开源的Python库,用于创建聊天机器人。它通过机器学习技术来生成对话内容,能够根据用户输入自动学习和生成回答。

ChatterBot库对话生成能力有限,生成文本可能不够自然,大模型出来之前使用较多

搭建步骤:

1.安装必要的库:安装Flask 和 ChatterBot。

2.编写代码:创建一个Flask应用,集成ChatterBot 并训练模型。

3.创建前端界面:使用HTML和JavaScript 创建一个简单的聊天界面

4.部署应用:将应用部署到服务器,如Heroku或本地服务器。

3.基于大语言模型的集成

如果你希望使用更强大语言模型(如DeepSeek或QWen),可以通过本地部署或云服务快速搭建聊天机器人。

适合有一定技术能力的企业,需要高度定制化功能的聊天机器人。

适合大模型出来后有更好对话效果场景,目前企业纷纷采用方式。

搭建步骤:

1.部署模型:使用 01lama部署QWen或DeepSeek。

2.配置机器人:通过01lama的API配置聊天机器人,设置模型、对话历史等参数。

3.接入微信或其他平台:使用Gewechat 框架将机器人接入微信。

3.搭建聊天机器人3种方式区别

如果需求简单且希望快速上线,优先选择无代码平台。coze、dify

如果需求复杂,需要高度定制化功能,建议选择开源框架。

如果需要高质量的对话体验且预算充足,可以选择基于大语言模型的集成。

当前项目我们选择基于开源框架和基于大语言模型集成的综合方式来开发聊天机器人,不仅能保障适合数据隐私和安全性要求,还可以实现高质量对话体验。

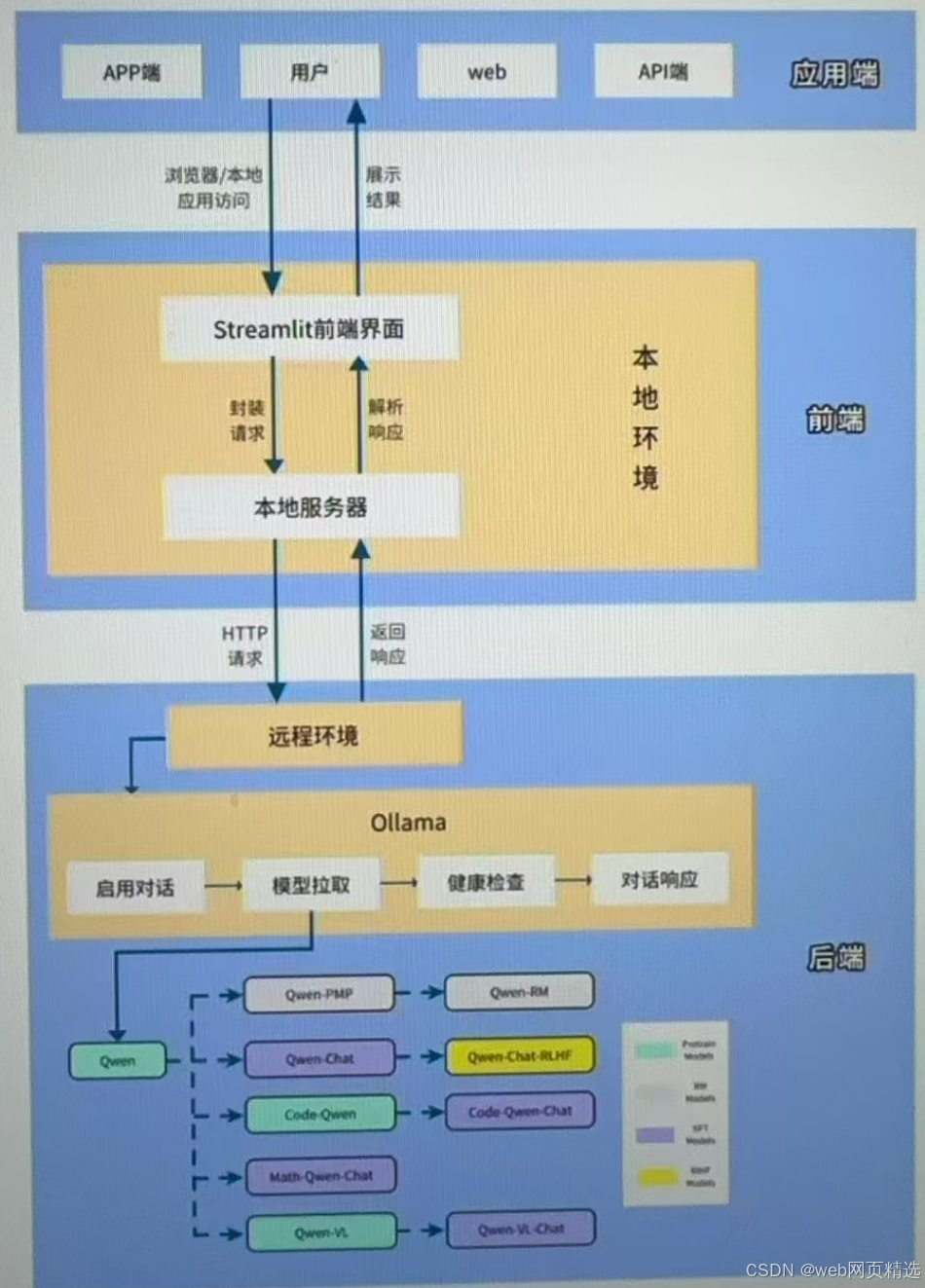

4.智聊机器人项目架构

前端界面:Streamlit 框架

特点:使用Streamlit框架搭建用户界面,提供简洁、交互式的Web应用。

技术细节:

Streamlit 是一个基于Python的开源框架,适合快速开发数据科学和机器学习相关的Web应用。

你通过Streamlit创建了一个用户界面,包括输入框、发送按钮和对话展示区域。

用户可以通过网页与聊天机器人进行实时对话。

后端模型:01lama平台的 Qwen/DeepSeek 模型特点:基于ollama平台部署 Qwen,DeepSeek模型作为后端核心,提供自然语言处理和对话生成能力。

技术细节:

ollama是一个开源的AI模型部署平台,支持多种大语言模型(LLM)。

Qwen是一个高性能的语言模型,能够处理和生成自然语言文本。

通过后端服务调用Qwen模型,将用户输入传递给模型,并获取模型的回复。

**- 前端界面:**采用Streamlit框架搭建用户界面,Streamlit是一个简单易用的Python库,能够快速创建美观、交互式的 Web应用,使用户能够通过网页与聊天机器人进行实时对话。**- 对话交互:**用户可以通过 Streamlit 界面输入文本,聊天机器人基于 Qwen模型对输入内容进行理解和处理,生成相应的回复并展示在界面上,实现流畅的对话交互。

**- 后端模型:**利用ollama平台的Qwen模型,该模型具备出色的自然语言处理能力,能够理解和生成自然语言文本,为聊天机器人提供核心的对话处理功能。

**- 模型调用:**后端服务负责将用户输入传递给Qwen模型,并获取模型生成的回复,然后将回复内容返回给前端界面进行展示,确保对话的实时性和准确性。

5.大模型分类

大模型的分类方式多样,涵盖了从架构、应用场景到训练目标等多个维度。

选择合适的大模型需要综合考虑任务需求、数据规模、计算资源等因素。

modelscope魔搭社区:https://www.modelscope.cn/models

coze扣子:https://www.coze.cn/

DeepSeek

tongyiqwen

...

常见的有:

自然语言处理模型

计算机视觉(CV)模型

语音模型

多模态模型

页面可以直接免费使用,为什么要本地部署大模型或者充值使用官网的apikey?一个是通用的,主要适合聊天的。

目的是为了定制化给企业干活的。

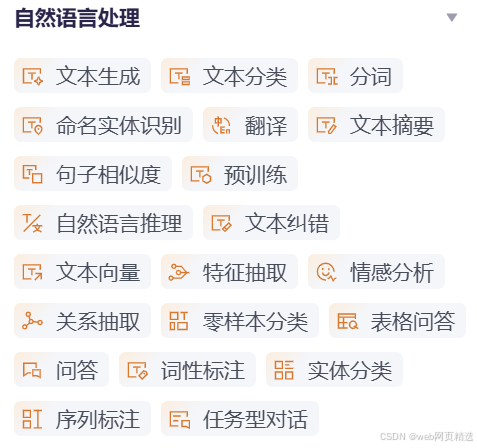

① 自然语言处理模型

自然语言大模型(Large Language Models,LLMs)是基于深度学习的模型,旨在理解和生成人类语言。它们通过大规模文本数据训练,能够执行多种自然语言处理(NLP)任务,如专注于文本生成、理解、翻译等任务.

举例:GPT系列(OpenAI)、BERT (Google)、T5 (Google)

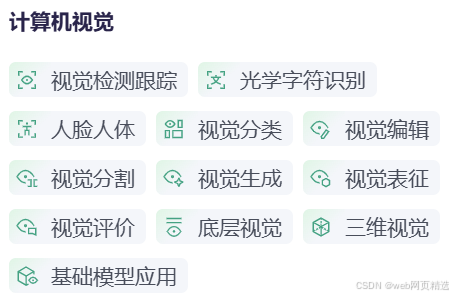

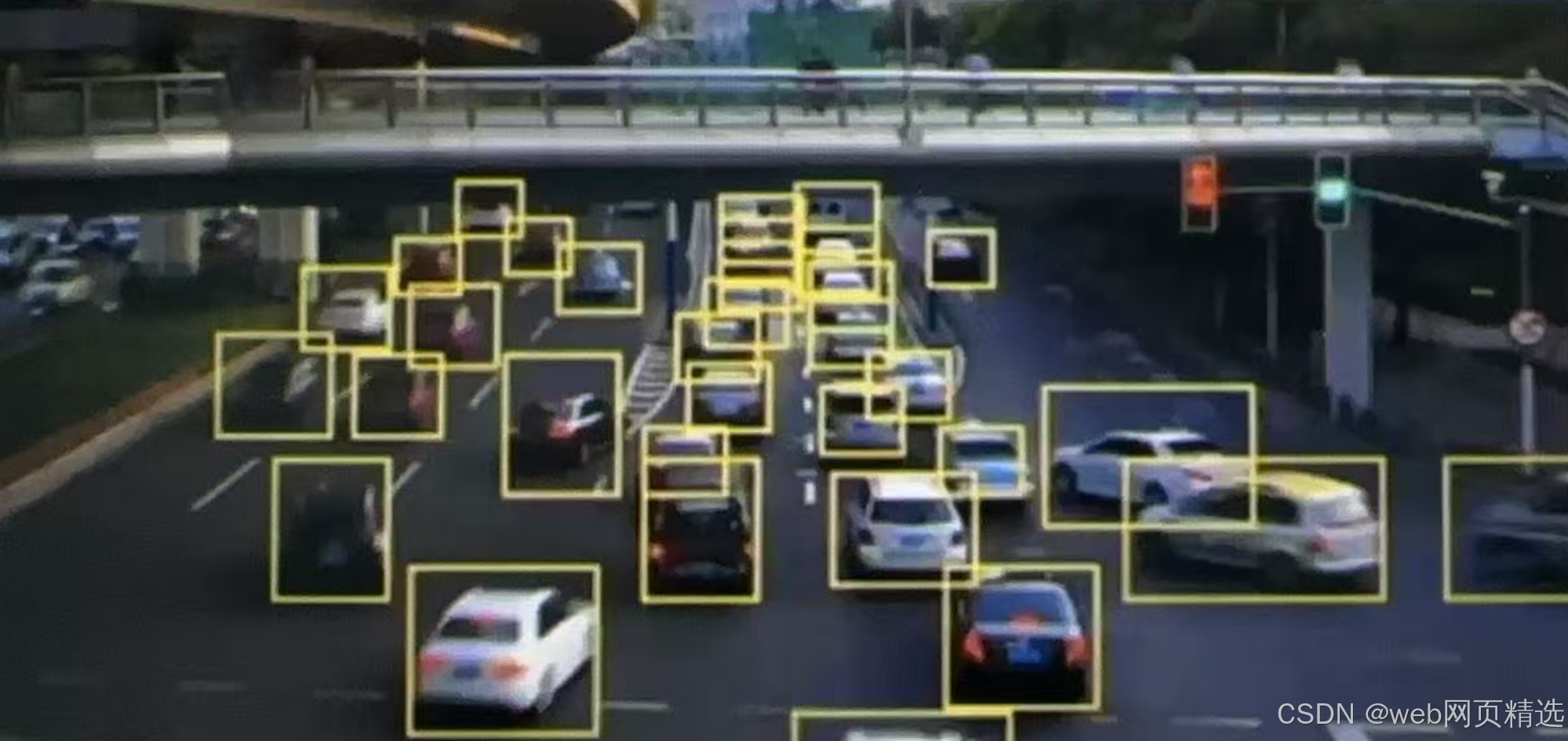

② 计算机视觉(CV)模型

视觉大模型(Large Visual Models)核心是通过大规模数据和复杂模型架构,实现对图像和视频的深度理解和生成。与传统计算机视觉模型相比,视觉大模型具有更强的泛化能力和多任务适应性,能够处理复杂的视觉任务,如图像分类、目标检测、语义分割、图像生成等。

举例: Stable Diffusion, Vision Transformers (ViT), DALL . E (OpenAI) CLIP (OpenAI)

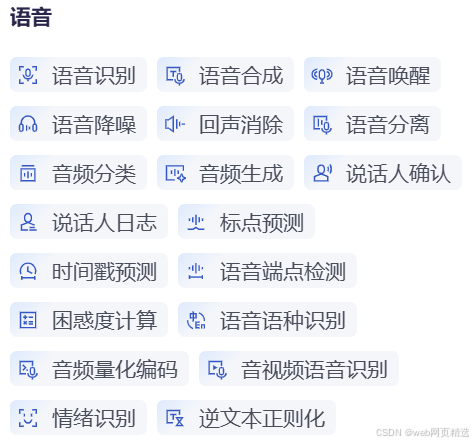

③ 语音大模型

语音大模型是基于深度学习技术构建的人工智能模型,主要用于处理语音相关的任务,如语音识别(ASR)、语音合成(TTS)、语音翻译等。近年来,随着深度学习和大规模数据训练的发展,语音大模型在性能和功能上取得了显著进展,能够支持多语言、多场景的复杂任务。举例:Whisper(OpenA[)、WaveNet(DeepMind)、讯飞星火。

总结:

大模型有那些应用场景?

机器翻译、文本生成、对话系统、聊天机器人等应用

常用的热门大模型有哪些?

讯飞星火认知大模型

阿里通义大模型

深度求索DeepSeek

...

三.智聊机器人私有大模型方案

1.为什么要私有大模型

**定制化与自主控制:**允许高度定制和完全自主控制,灵活性更高,且不依赖外部网络,适合特定场景需求。

**数据隐私与安全:**确保敏感数据不离开内部网络,避免云服务可能带来的数据泄露风险,尤其适合有严格合规要求的行业。

**性能与延迟:**减少数据传输时间,提供低延迟和稳定性能,适合需要实时响应的应用场景。

**成本控制:**长期来看,本地部署可能比持续支付云服务费用更经济且允许根据需求灵活调整硬件资源。

① 私有大模型解决方案

随着AI的发展,越来越多的开发者投入到大模型开发中,他们期望能自身笔记本上运行大模型,以便开发。越来越多的企业积极改造自身产品,融入AI技术,他们期望能私有化大模型以保证数据安全。这些诉求直接推动社区出现了两个这方面的产品ollama和LMstudio。

|------|-------------------------------------------------|-----------------------------------------------------------|

| | Ollama | LM Studio |

| 产品定位 | 开源的大型语言模型本地运行框架 | 闭源的本地大型语言模型工作站,集模型训练、部署、调试于一体 |

| 技术特点 | 高度智能化,自主学习和适应能力强-便捷性高,操作简单易懂-安全性强,数据传输和存储严格保护 | 高性能,采用先进计算架构和算法优化-可定制化,支持用户定制模型结构和训练策略易用性,友好的用户界面和丰富的文档支持 |

| 功能 | 提供预训练模型访问和微调功能-支持多种模型架构和定制模型-用户友好界面,简化模型实验和部署过程 | 丰富的训练数据和算法库-可视化训练监控界面-强大的调试工具,支持模型性能优化 |

| 资源要求 | 需要一定的内存或显存资源来运行大型模型-支持跨平台(macOS、Linux,Windows) | 构建和训练复杂模型可能需要大量计算资源和专业技能 |

| 社区生态 | 社区生态活跃,开发者主流本地运行时-快速适配新发布的模型 | 未知(未提及具体社区生态活跃度) |

② 智聊项目私有大模型方案

ollma作为一个开源的轻量级工具,适合熟悉命令行界面的开发人员和高级用户进行模型实验和微调。

它提供了广泛的预训练模型和灵活的定制选项,同时保持了高度的便捷性和安全性。最重要它是开源的,同时还提供API,对于开发有先天优势,备受欢迎和使用!

因此智聊机器人项目选择基于ollama在本地部署DeepSeek,Qwen等大模型。

③ ollama 介绍

ollama:是一款旨在简化大型语言模型本地部署和运行过程的开源软件。

ollama提供了一个轻量级、易于扩展的框架,让开发者能够在本地机器上轻松构建和管理LLMs(大型语言模型)通过o1lama,开发者可以导入和定制自己的模型,无需关注复杂的底层实现细节。

④ ollama下载

ollama:是一款旨在简化大型语言模型本地部署和运行过程的开源软件。

ollama共支持三种平台:

Window: https://ollama. com/download/01lamaSetup. exe

Mac: https://ollama. com/download/01lama-darwin. zip

Linux: https://ollama. com/download/ollama-linux-amd64

⑤ ollama 特点

**1.简单易用:**提供命令行工具和 API,支持快速本地部署主流大语言模型(如Llama 2、Mistral等),适合开发者和研究人员快速上手。

**2.高效轻量:**占用资源少,支持GPU 加速和量化技术,能够在本地高效运行,降低对计算资源的依赖。

**3.灵活管理:**支持通过 Modelfile 自定义模型参数,允许热加载和切换模型,并可从Hugging Face 等平台导入自定义模型。

**4.隐私安全:**本地化部署确保数据不上传云端,适合对隐私和安全性要求高的场景,如医疗、金融等领域。

总结:1.ollama是什么?

是一款旨在简化大型语言模型本地部署和运行过程的开源软件。

2.如何查看ollama支持的模型?

通过ollama 官方模型库:https://ollama.com/library

deepseek-r1, qwen, llava等

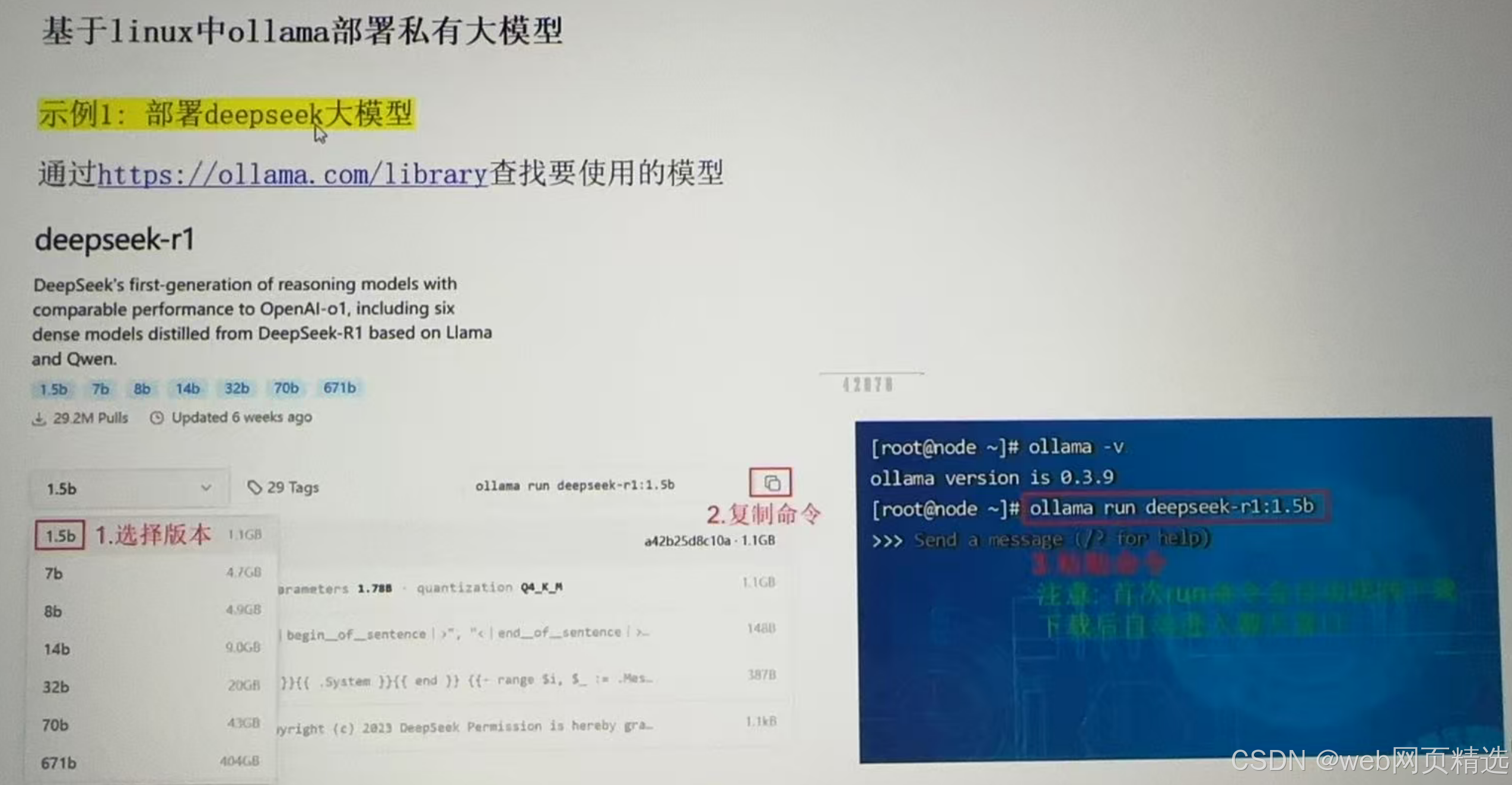

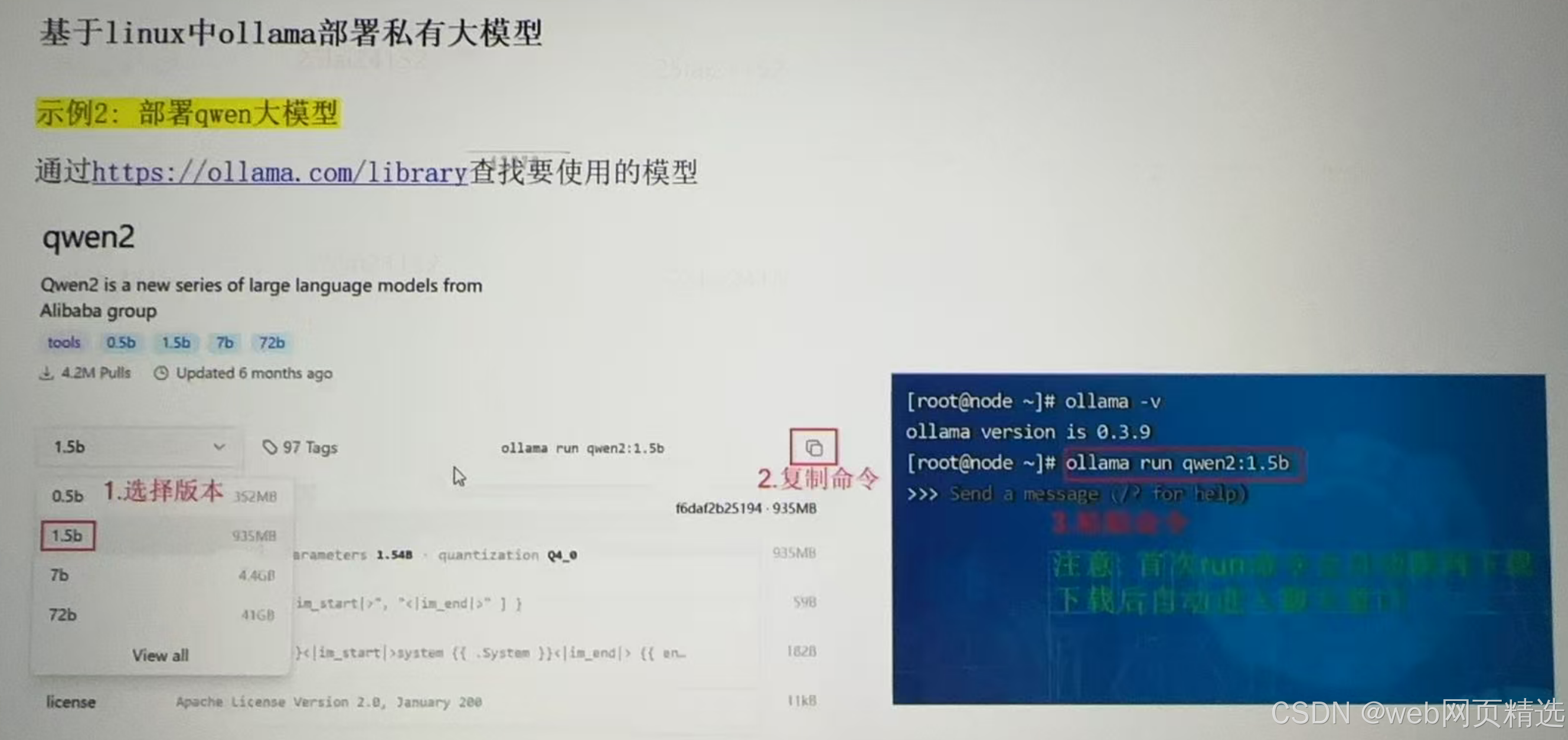

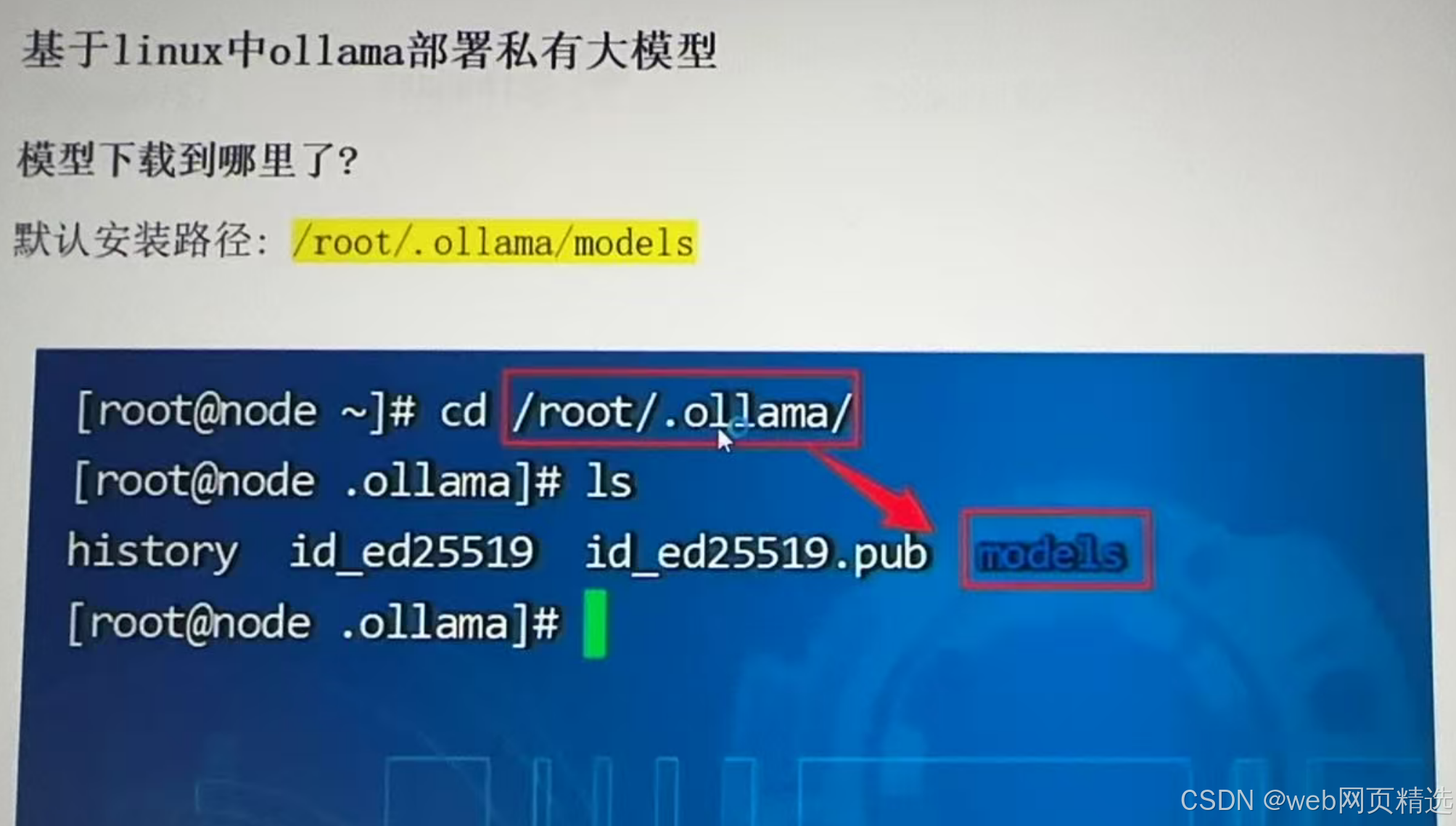

④ ollama安装与使用

- 基于window中ollama部署私有大模型

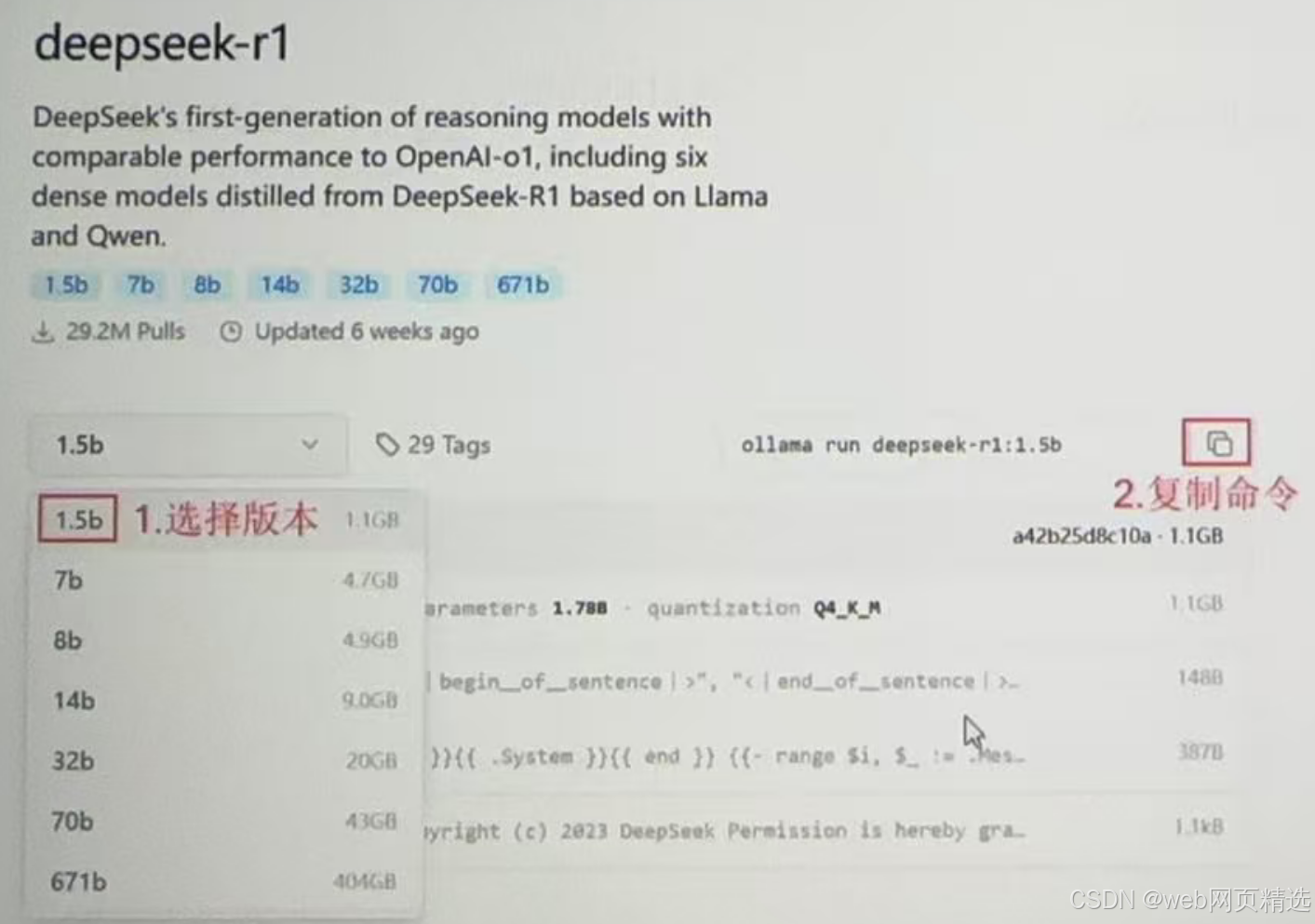

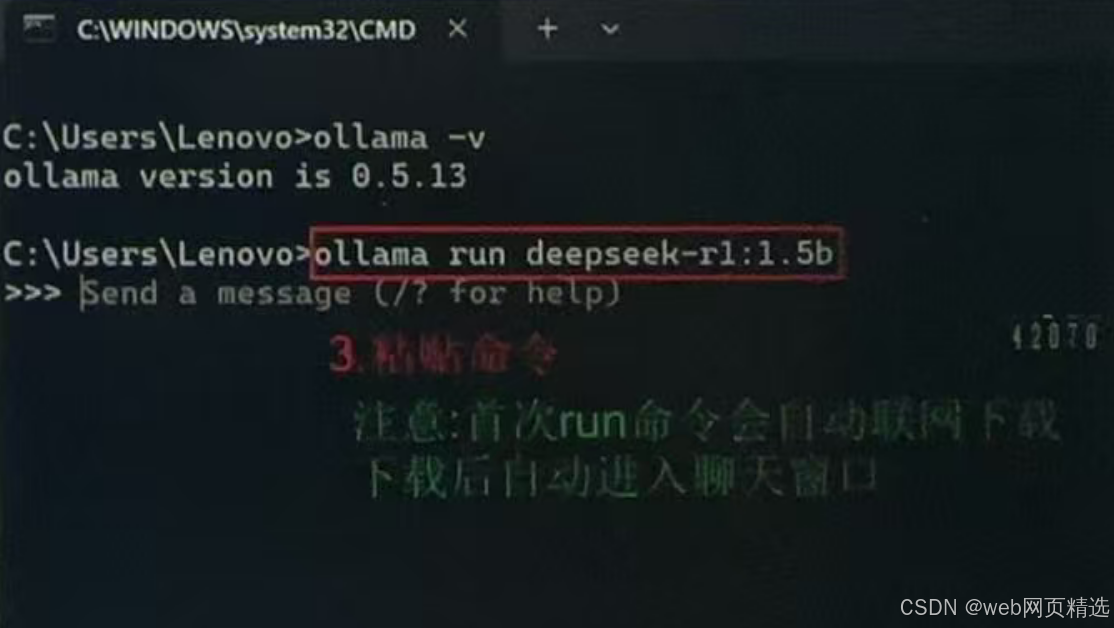

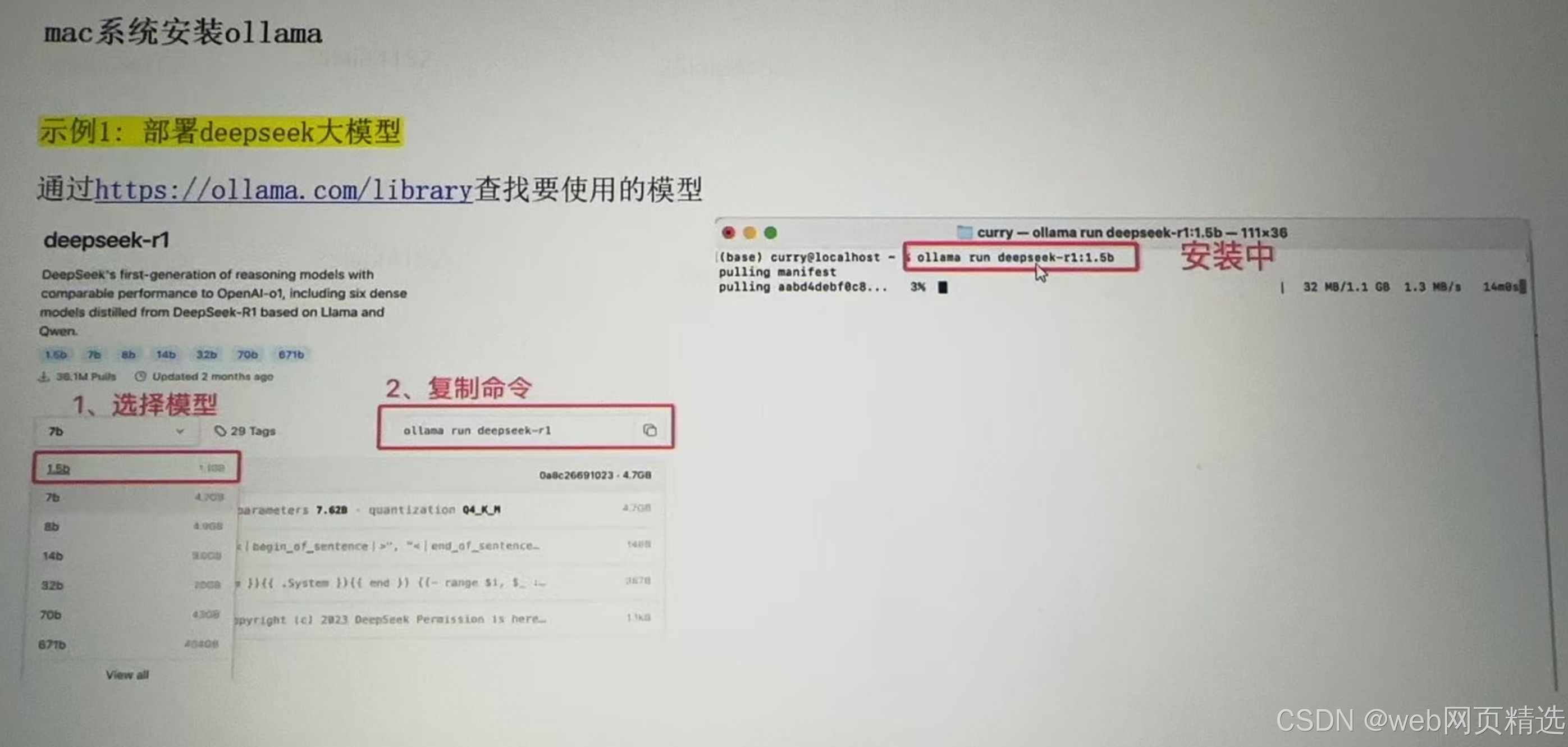

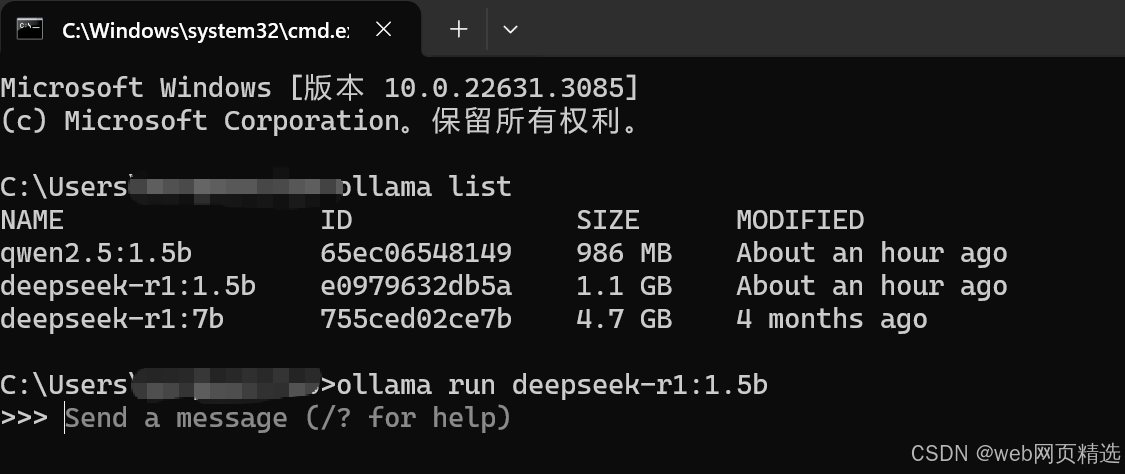

示例1:部署deepseek大模型

通过https://ollama.com/library查找要使用的模型

命令:ollama run deepseek-r1:1.5b

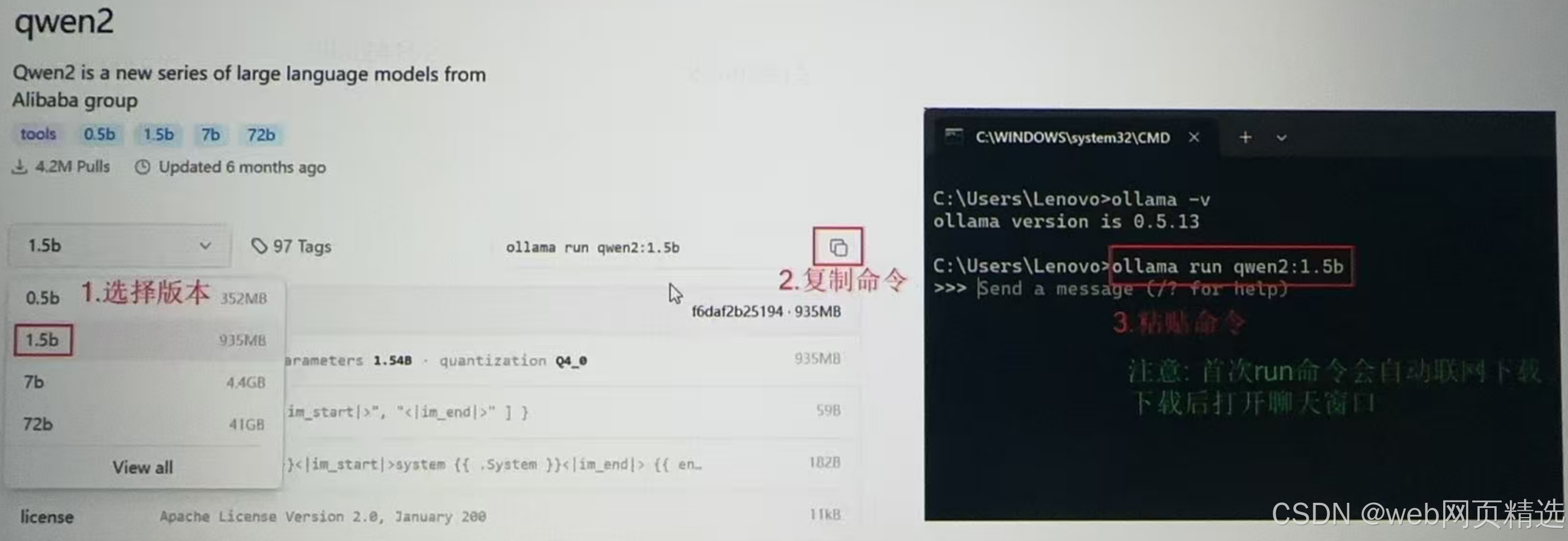

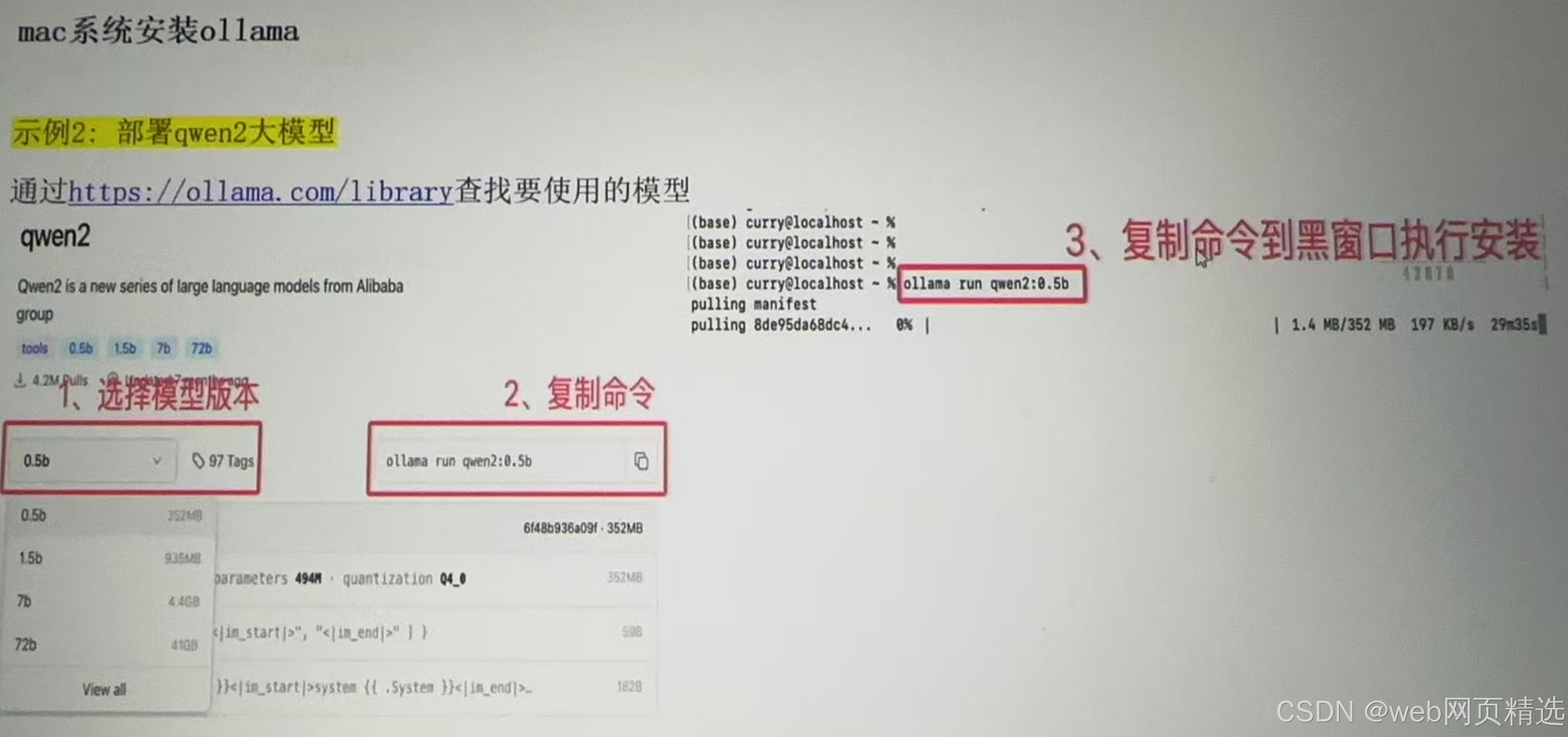

示例2:部署qwen大模型

通过https://ollama.com/library查找要使用的模型

命令:ollama run qwen2:1.5b

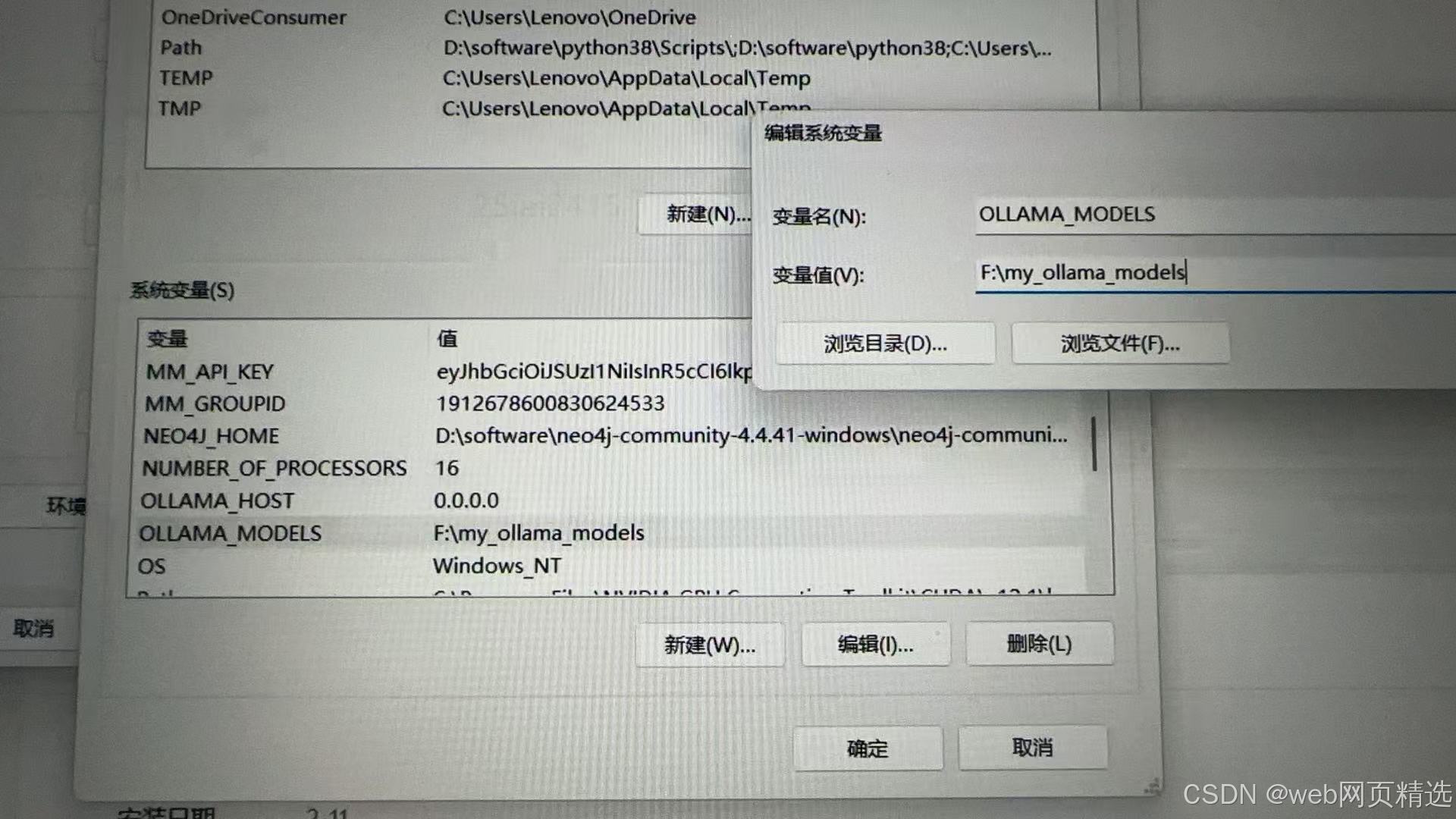

修改ollama路径

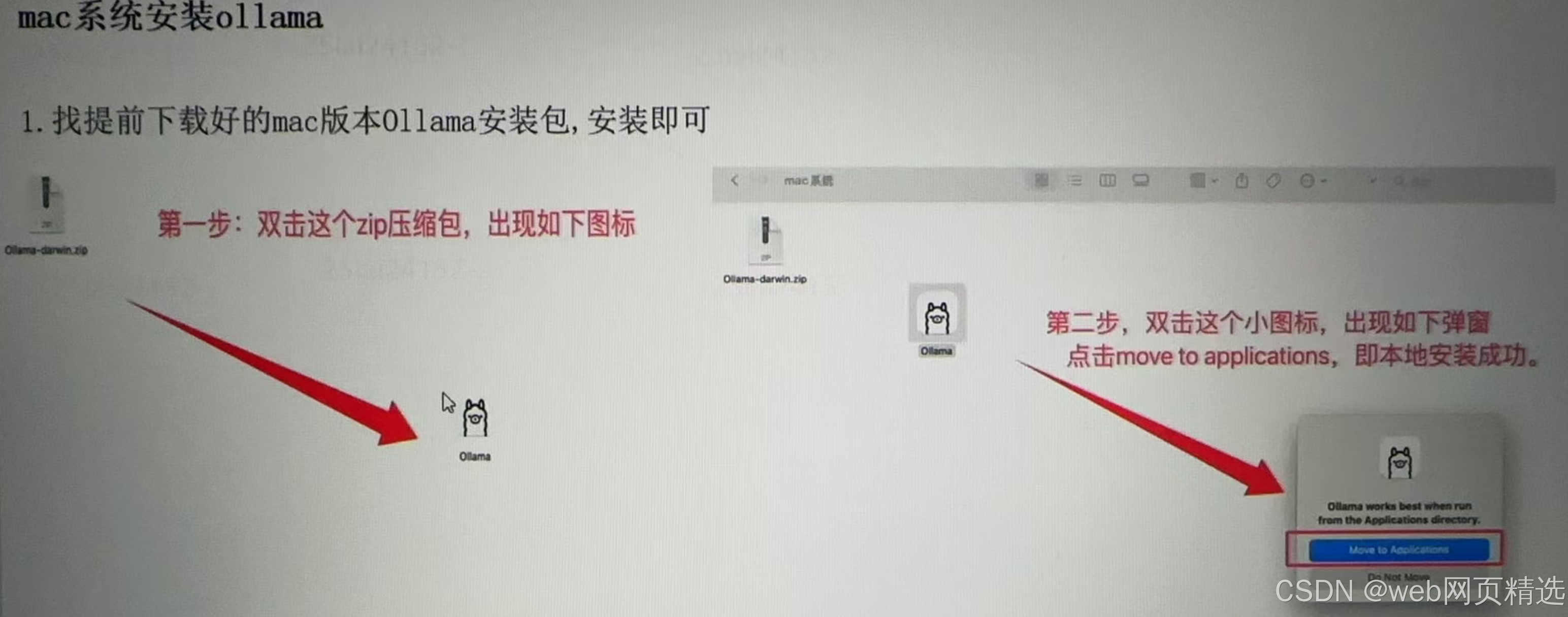

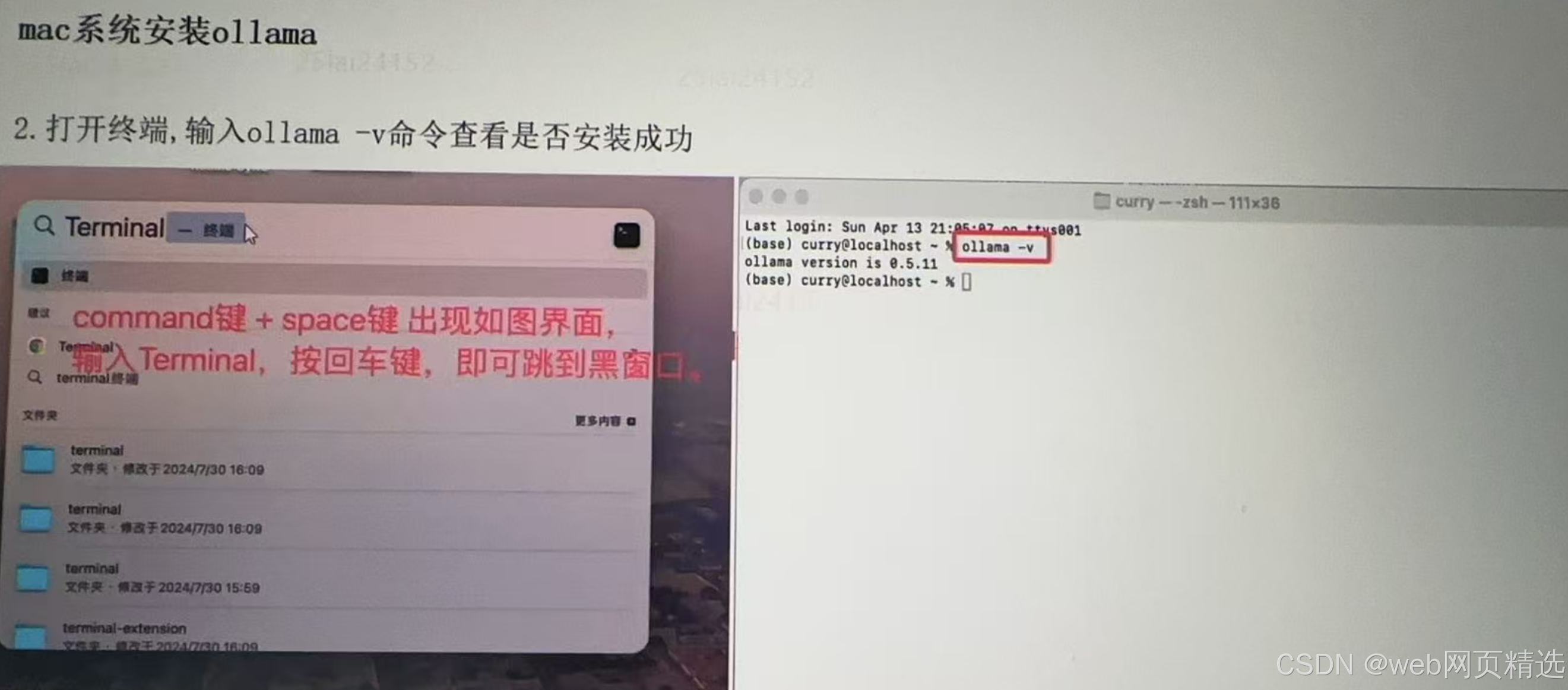

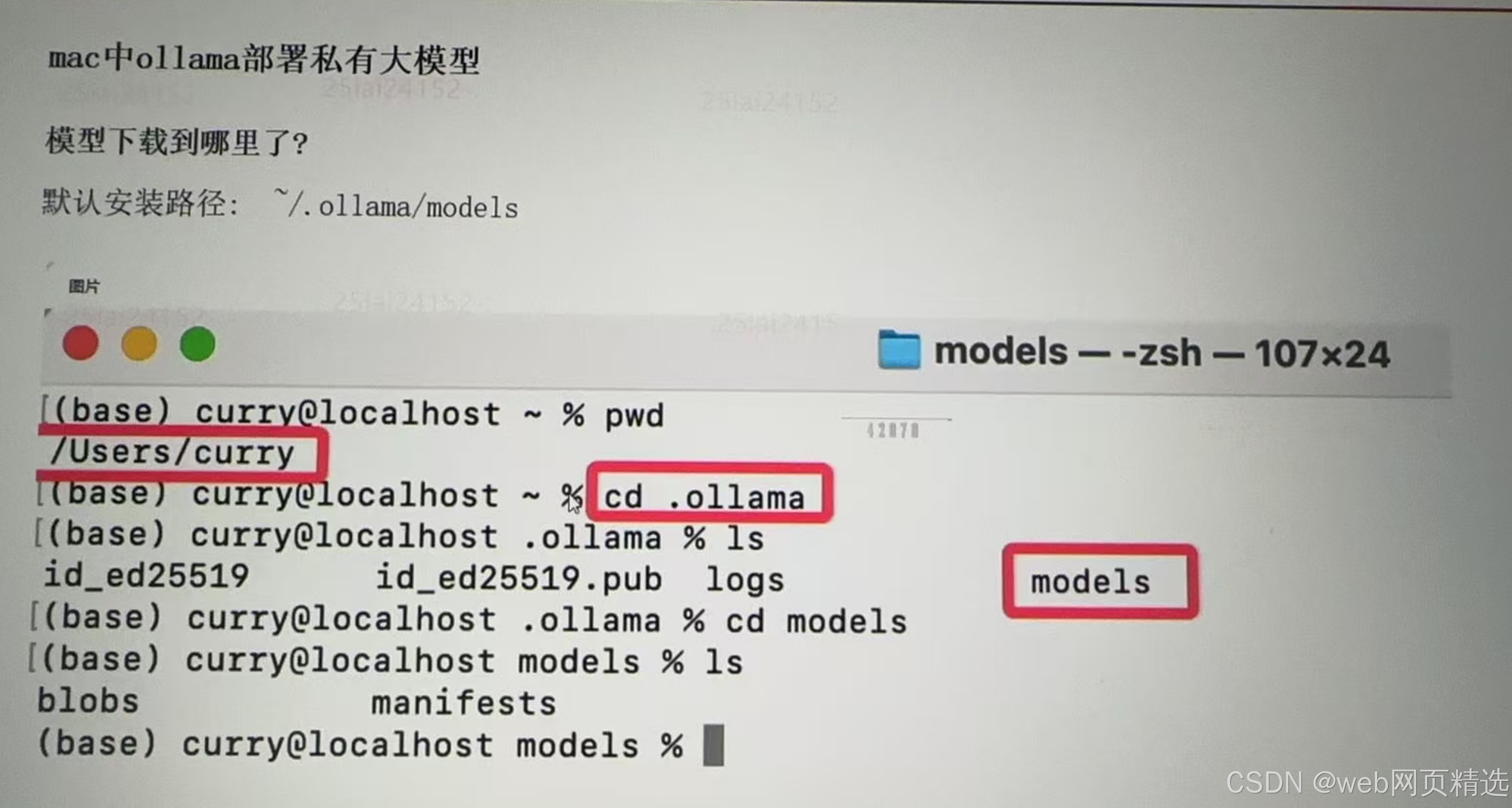

- 基于mac中ollama部署私有大模型

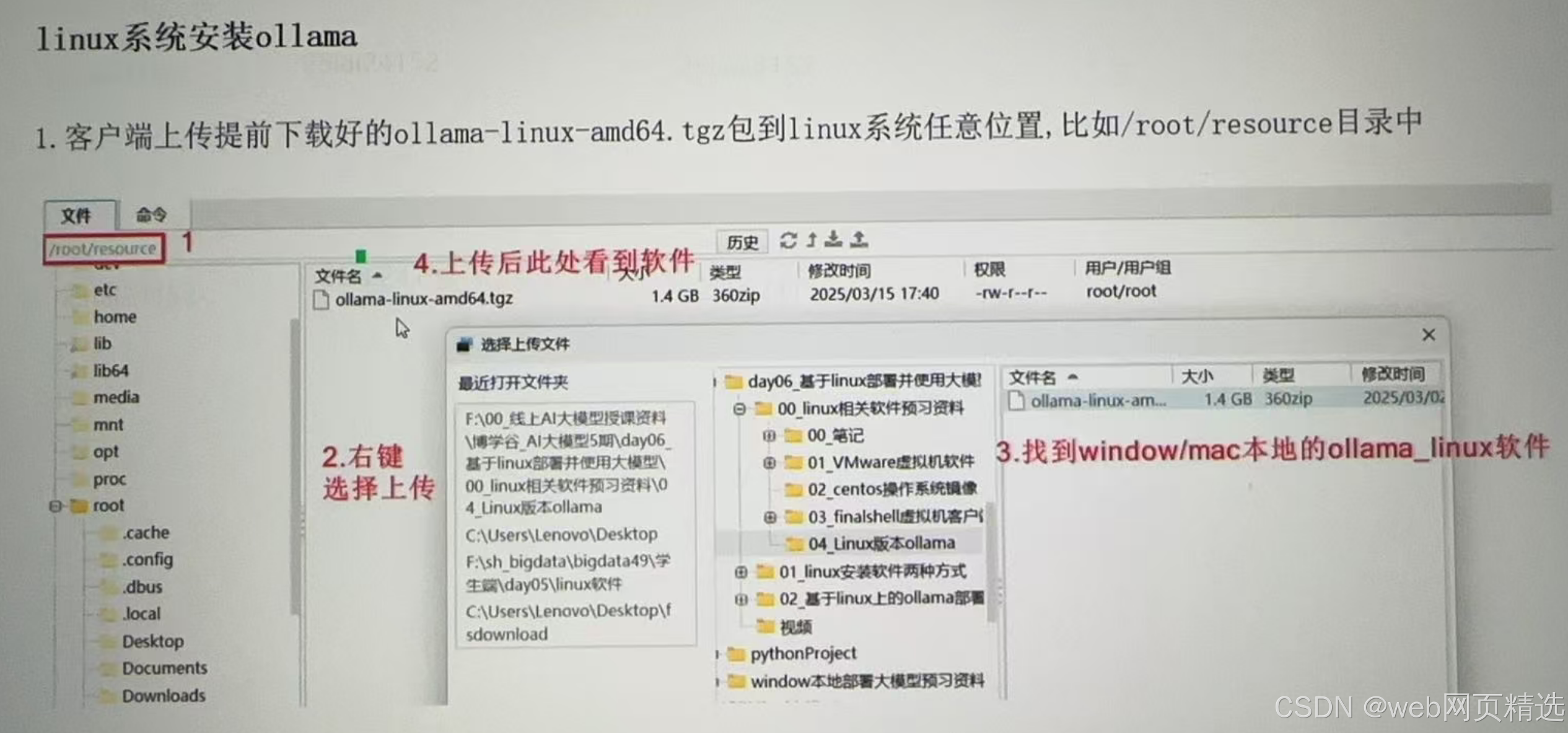

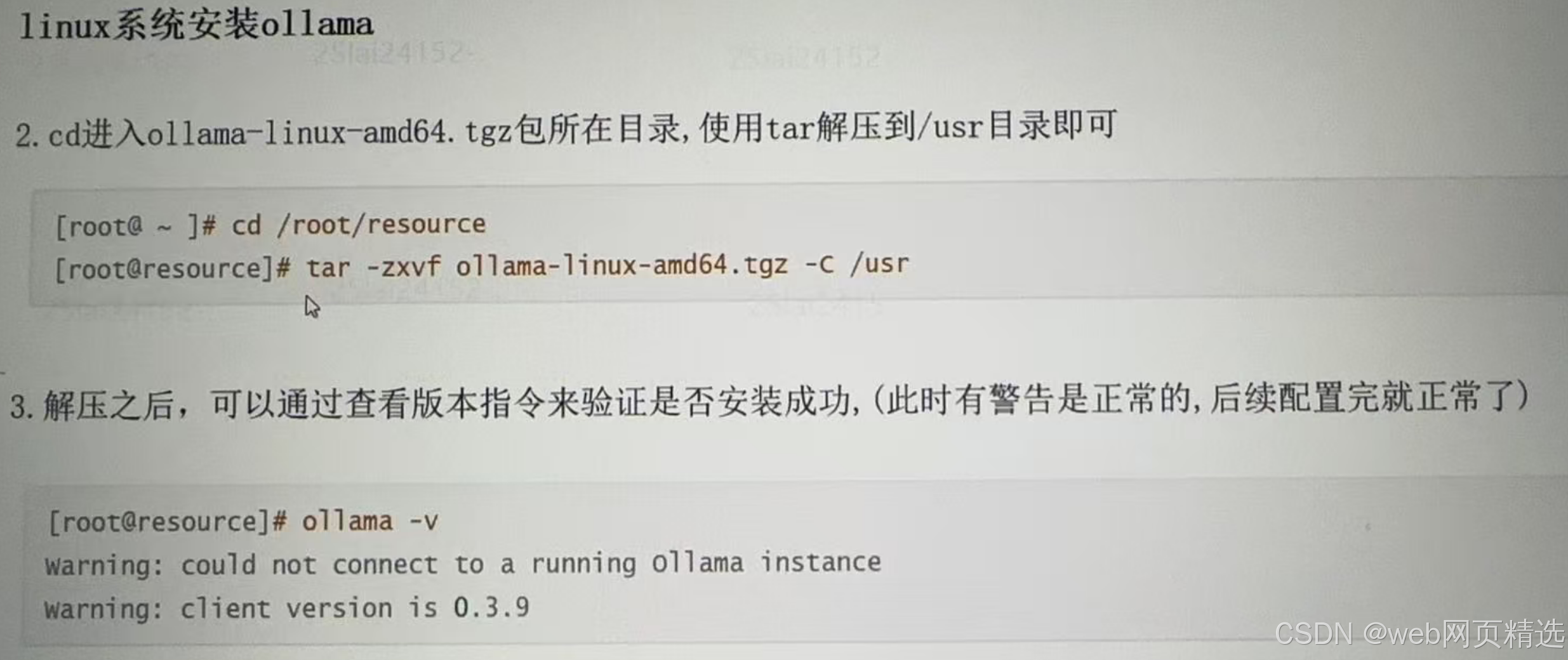

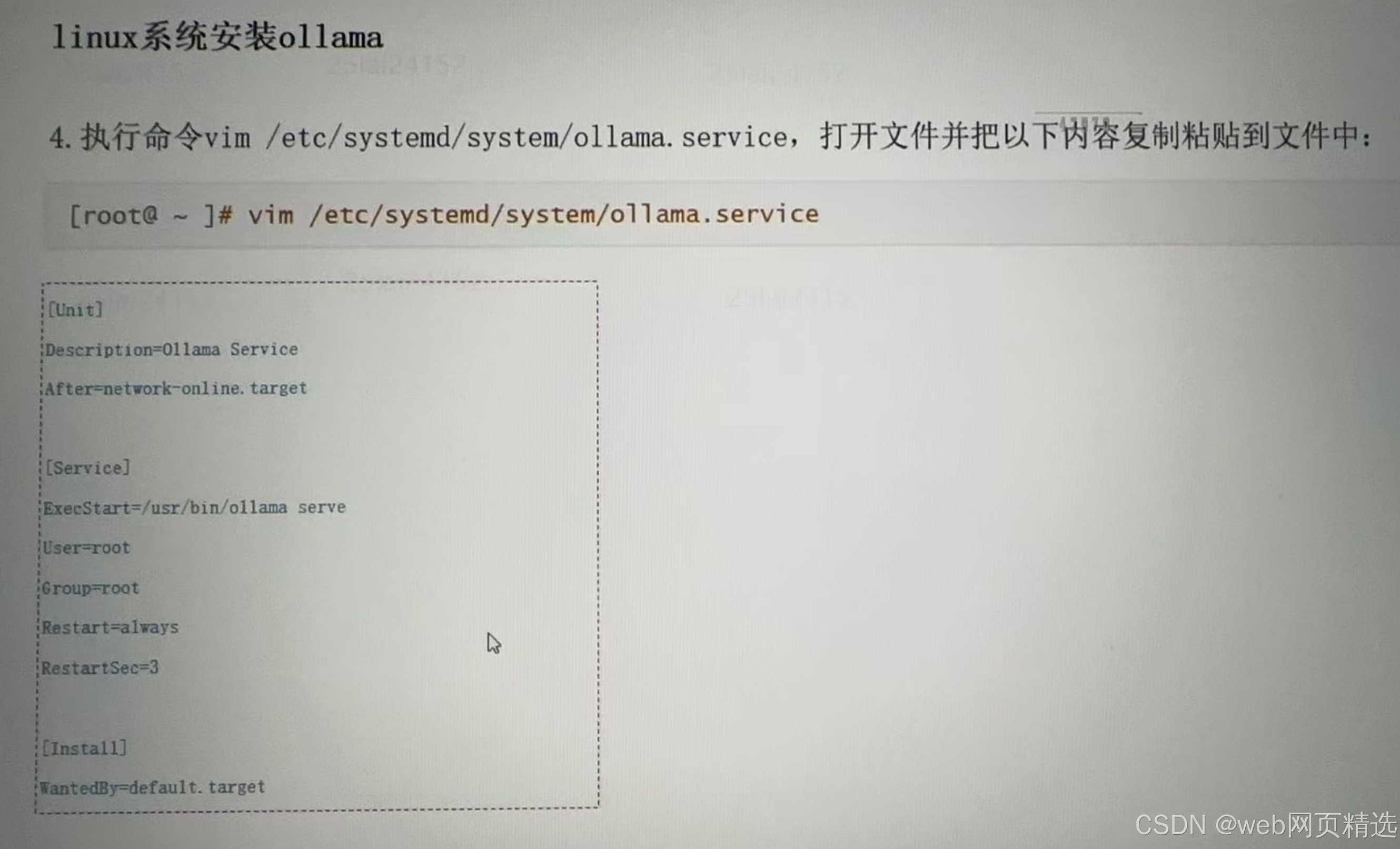

- 基于Linux中ollama部署私有大模型

⑤ allama指令详解

ollama客户端指令:

run 运行模型

show 显示模型信息

pull 下载模型

list 查看本地模型

ps 查看运行的模型

cp 复制模型

rm 删除模型

⑥ allama对话指令说明

基本指令

/? 查看支持的指令

/bye 推出对话模型

/show 显示模型信息

/? shortcuts 查看快捷键

""""多行输入指令

对话调整指令

/set 设置对话参数

/clear 清理上下文

模型调整指令

/load 动态切换模型

/save 储存模型

四.基于工具调用本地模型实现聊天效果

1.Apifox工具调用本地大模型

① 了解ollama的api聊天效果

Apiox工具介绍

Apifox是一款集API设计、开发、测试于一体的协作平台,旨在提升开发团队的API开发效率。它结合了Postman、Swagger、Mock.js等工具的功能,提供一体化的解决方案,适用于前端、后端和测试人员。

Apifox是一款功能强大且易于使用的API工具,适合开发、测试和产品团队使用。

快速入门

下载安装: 访问 Apifox官网 下载客户端。

创建项目: 登录后创建一个新项目,选择项目类型(如 RESTful API)。

设计 API: 在项目中添加API接口,定义请求方法、路径、参数等。

**调试与测试:**使用调试功能发送请求,验证接口返回结果。

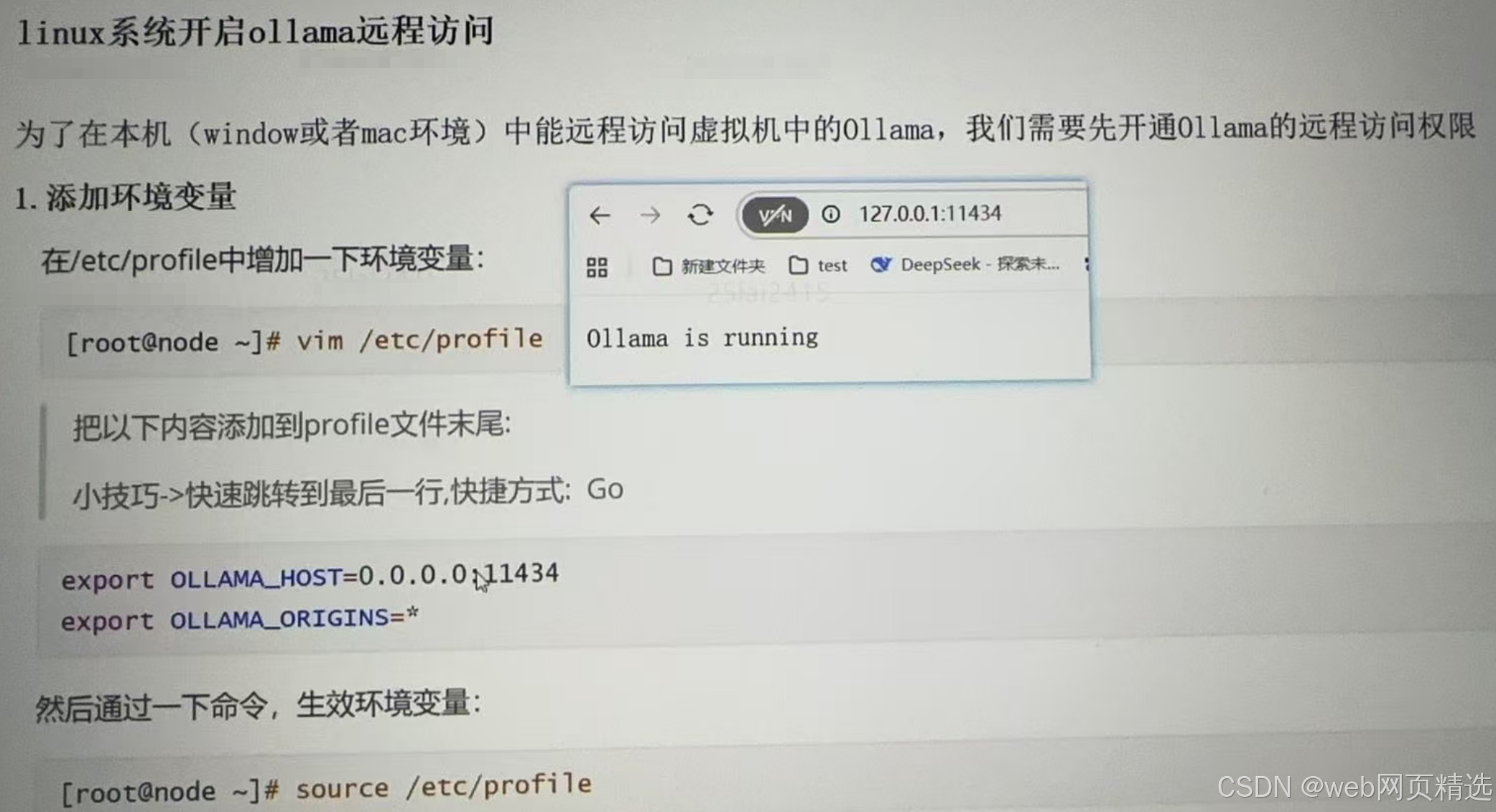

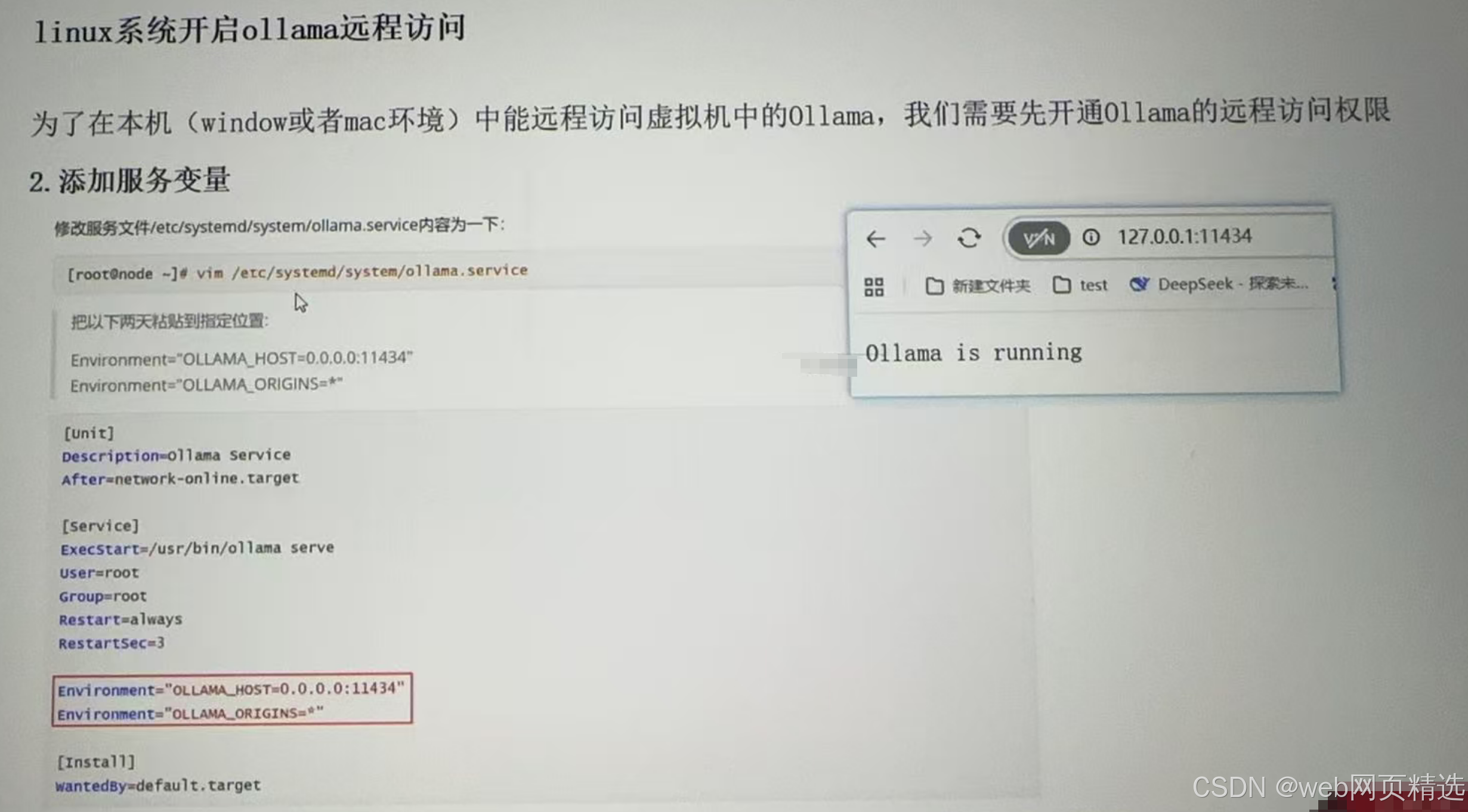

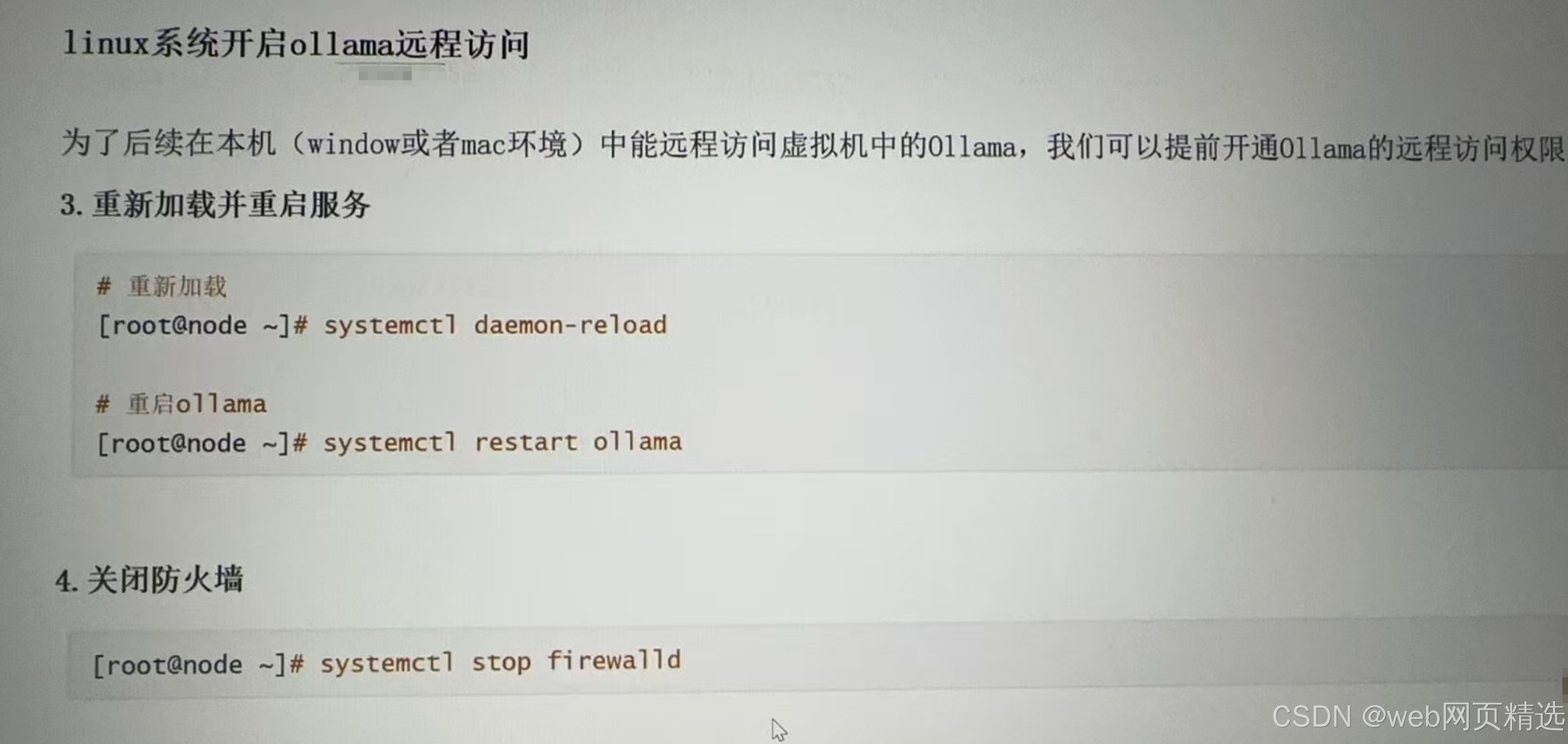

② Apifox工具导入ollamaAPI

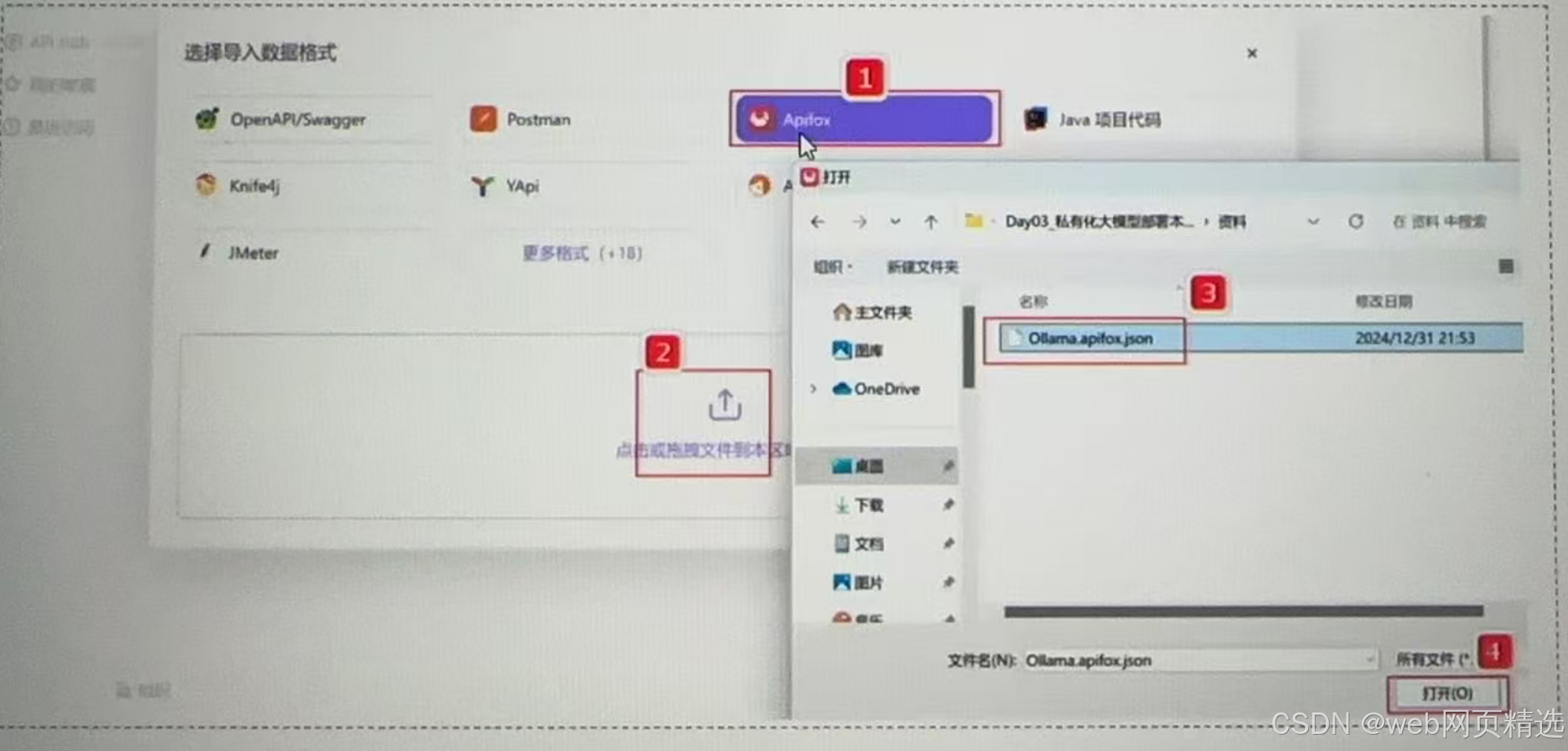

为了方便后续使用程序接入011ama中的大模型,在此可以先通过Apifox进行Api的快速体验与学习。在资料文件夹中 01lama.apifox.json文件提供了供Apifox软件导入的json内容,再此我们先导入到Apifox软件中,快速体验一下API相关功能。

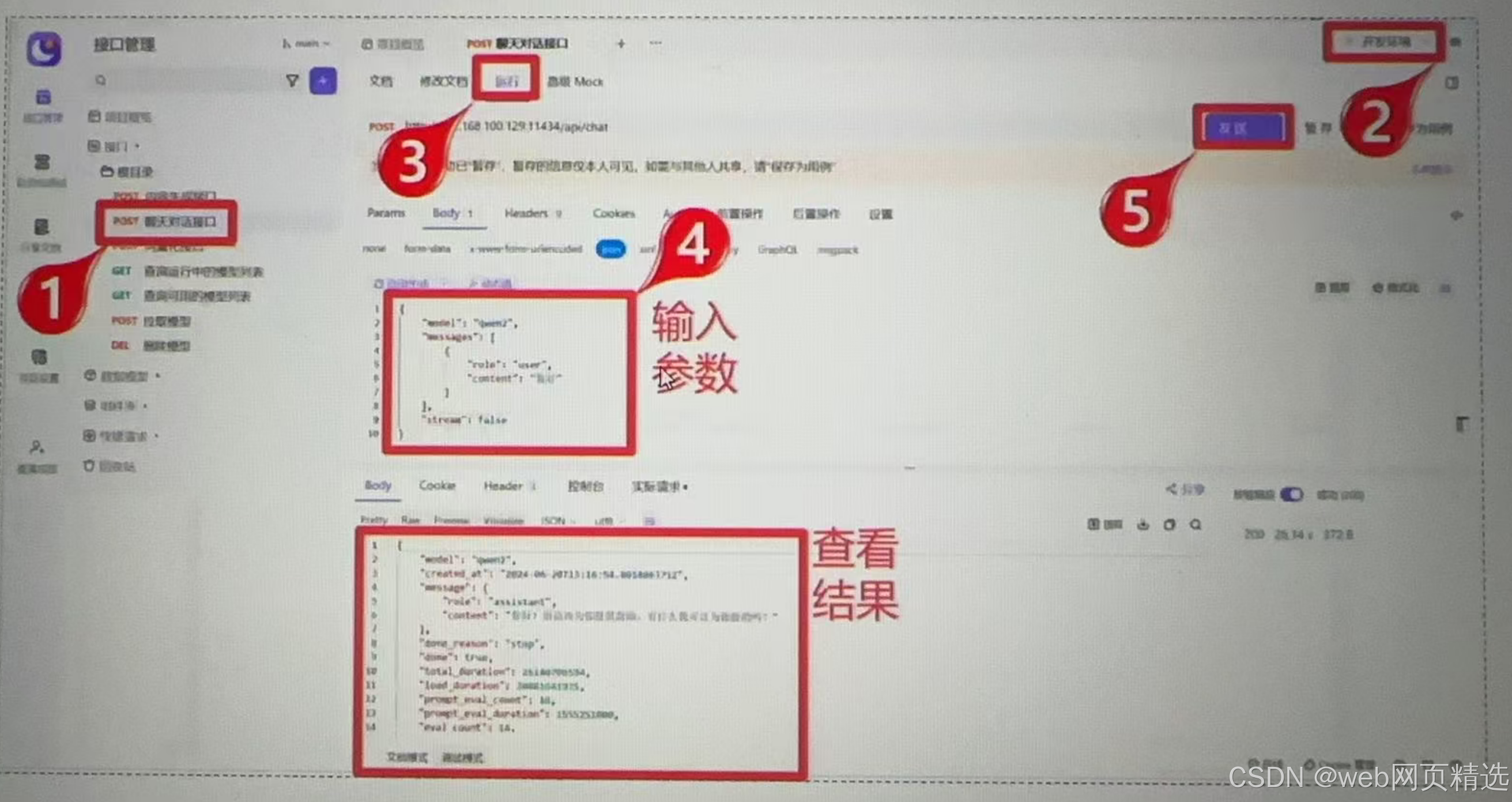

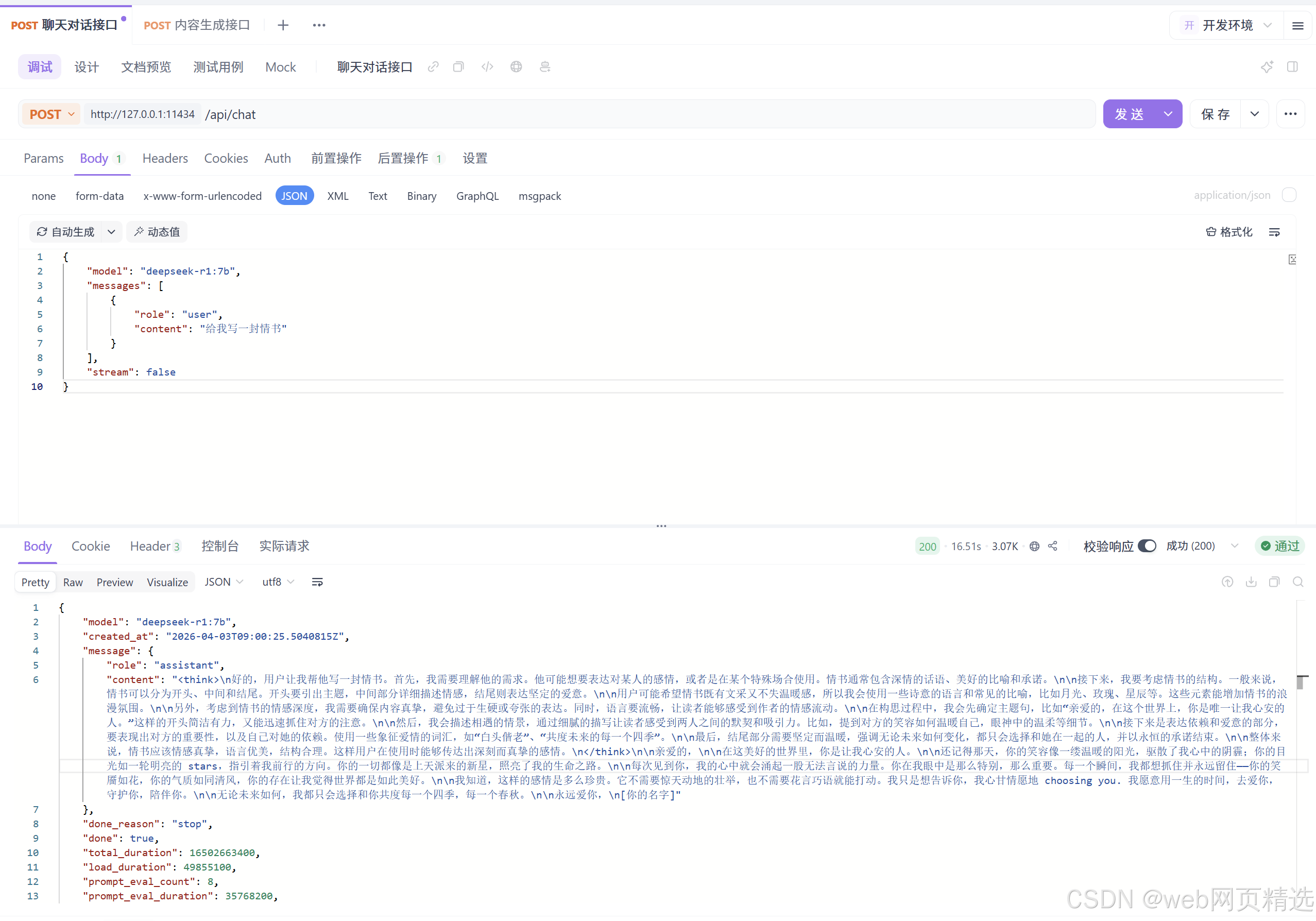

③ Apifox工具调用私有大模型

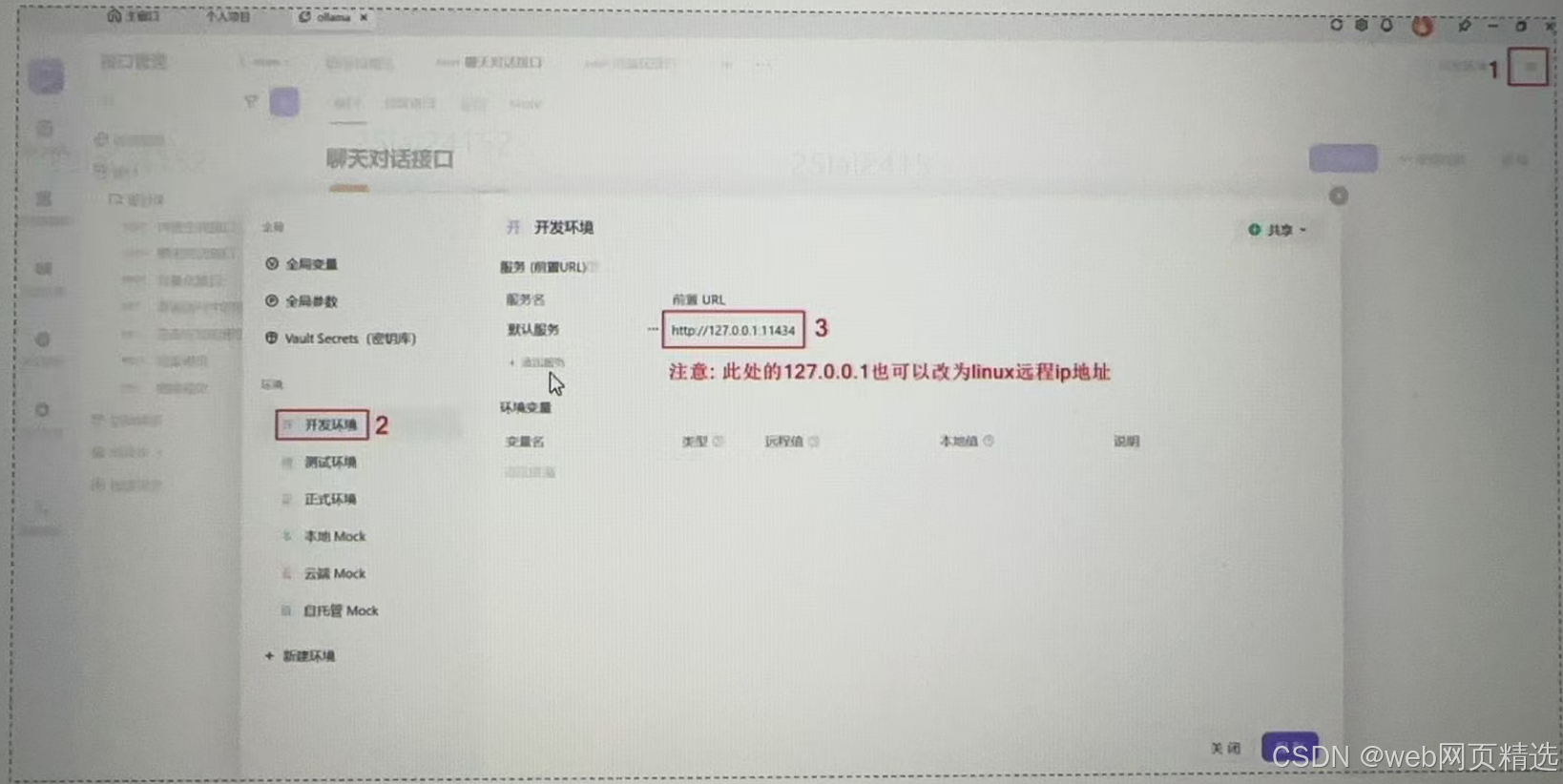

1)配置ollama大模型服务器地址

2)输入请求问题,点击发送,获取响应结果

2.ChatBox工具调用本地大模型实现聊天

体验一下页面调用本地模型聊天效果

① Chatbox工具介绍

Chatbox是一款功能强大、易于使用的开源AI 工具,适合开发者、学生、办公人员等多种用户群体。

1.下载安装

访问Chatbox官网,下载并安装适合您操作系统的安装包(Windows、macOS 或Linux)。

2.配置API

打开 Chatbox,进入设置菜单。

选择ollama中本地部署的模型,并保存配置。

3.开始对话

主界面,创建对话窗口,在输入框中输入问题或指令。

4.保存和退出

聊天记录会自动保存到本地。

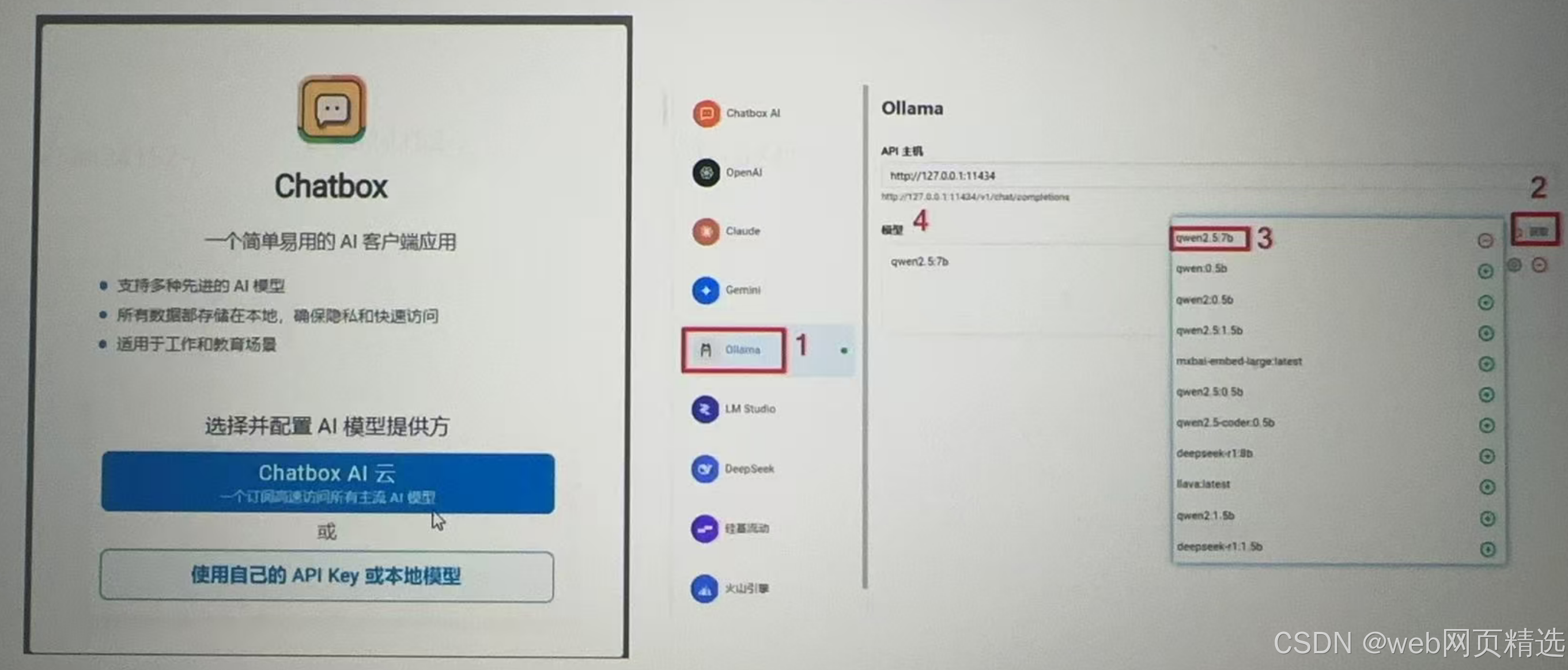

② Chatbox工具设置本地大模型

打开chatbox软件,选择ollama本地服务器中大模型(注意:以下获取的时本地ollama安装的模型)

五.智聊机器人项目

Streamlit+ollama+本地私有大模型(deepseek和qwen等)

1.前端:使用streamlit快速构建页面

安装streamlit:pip install streamlit