飞腾 S5000C 服务器环境搭建实战:PyTorch + CUDA + RTX 4090D 安装与验证

一、前言

最近在飞腾 S5000C 服务器上搭建深度学习运行环境,本文记录一下从硬件信息确认、GPU 驱动检查,到 PyTorch 安装和 CUDA 验证的完整过程。

如果你手里也是类似的 ARM 服务器,或者正在做飞腾平台 + NVIDIA GPU 的环境部署,希望这篇文章能帮你少走一些弯路。

本文环境关键词如下:

- 飞腾 S5000C

- FTC862

- NVIDIA GeForce RTX 4090 D

- CUDA

- PyTorch

- Linux aarch64 / ARM64

二、环境信息

本次测试环境如下:

- 服务器平台:飞腾 S5000C

- CPU 型号:FTC862

- GPU 数量:8 张 NVIDIA GeForce RTX 4090 D

- NVIDIA 驱动版本:580.126.09

- 驱动支持的 CUDA 版本:13.0

- Python 版本:3.10

- 系统架构:Linux aarch64 / ARM64

- Conda 环境 :

aq_py310 - ubuntu 版本 :

Ubuntu 24.04.4 LTS \n \l

三、查看 CPU 型号

先确认当前服务器的 CPU 型号,执行:

bash

lscpu | grep "Model name"输出如下:

log

(aq_py310) root@ubuntu-Rack-Server:~# lscpu | grep "Model name"

Model name: FTC862

BIOS Model name: S5000C/64 Not Specified CPU @ 2.1GHz可以看到,这台服务器的 CPU 型号为 FTC862 ,平台信息为 S5000C/64。

这一步的主要作用是确认当前硬件平台,方便后续排查兼容性问题。

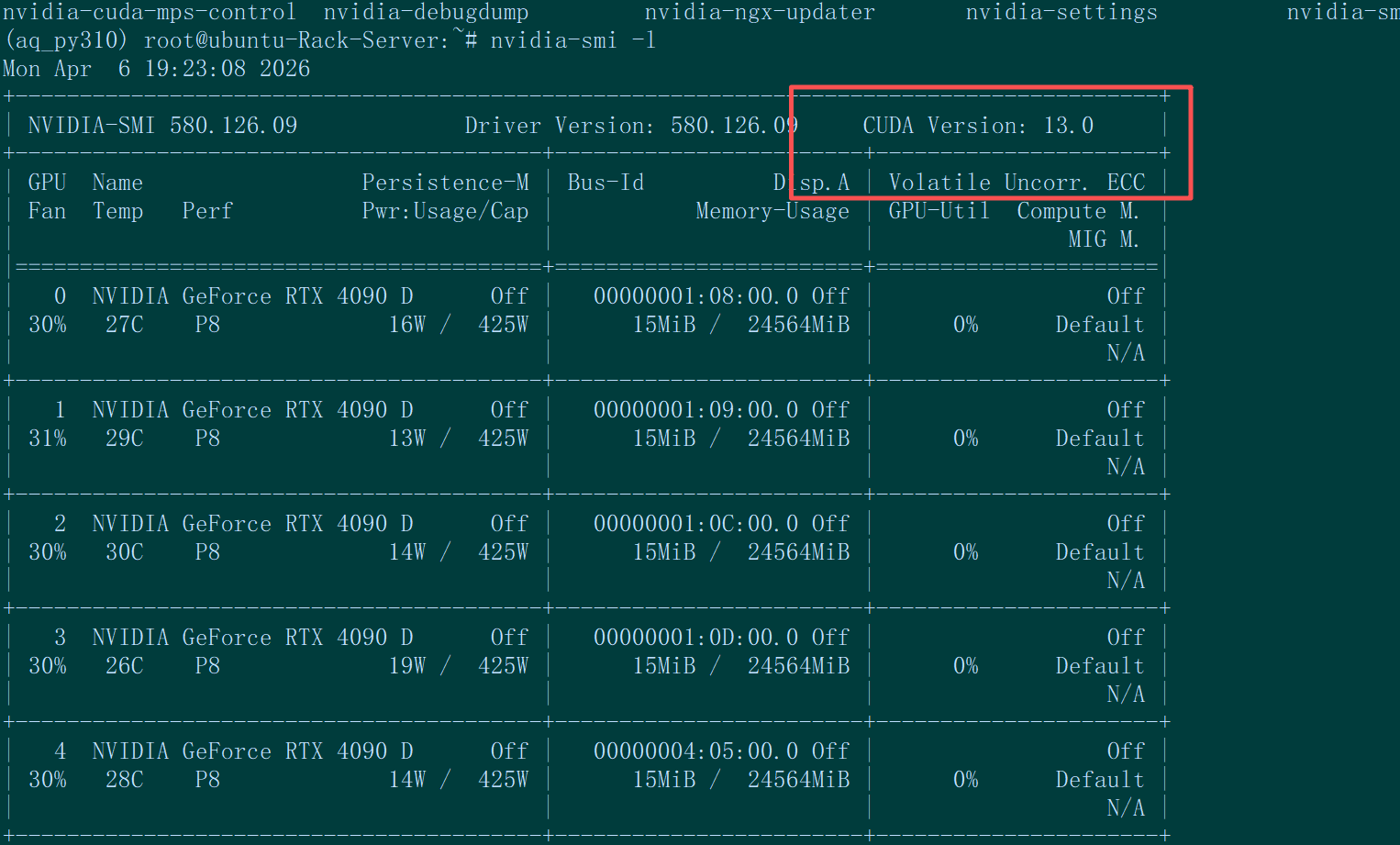

四、查看 GPU、驱动和 CUDA 信息

接着查看 GPU 是否被系统正确识别,以及当前 NVIDIA 驱动和 CUDA 支持情况。

执行命令:

bash

nvidia-smi -l输出如下:

log

(aq_py310) root@ubuntu-Rack-Server:~# nvidia-smi -l

Mon Apr 6 19:23:08 2026

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 580.126.09 Driver Version: 580.126.09 CUDA Version: 13.0 |

+-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA GeForce RTX 4090 D Off | 00000001:08:00.0 Off | Off |

| 30% 27C P8 16W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 1 NVIDIA GeForce RTX 4090 D Off | 00000001:09:00.0 Off | Off |

| 31% 29C P8 13W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 2 NVIDIA GeForce RTX 4090 D Off | 00000001:0C:00.0 Off | Off |

| 30% 30C P8 14W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 3 NVIDIA GeForce RTX 4090 D Off | 00000001:0D:00.0 Off | Off |

| 30% 26C P8 19W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 4 NVIDIA GeForce RTX 4090 D Off | 00000004:05:00.0 Off | Off |

| 30% 28C P8 14W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 5 NVIDIA GeForce RTX 4090 D Off | 00000004:08:00.0 Off | Off |

| 30% 28C P8 16W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 6 NVIDIA GeForce RTX 4090 D Off | 00000004:09:00.0 Off | Off |

| 31% 28C P8 27W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

| 7 NVIDIA GeForce RTX 4090 D Off | 00000004:0C:00.0 Off | Off |

| 31% 28C P8 20W / 425W | 15MiB / 24564MiB | 0% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+从上面的信息可以确认:

- 当前 NVIDIA 驱动版本 为:

580.126.09 - 驱动支持的 CUDA 版本 为:

13.0 - 当前机器共识别到 8 张 RTX 4090 D

- 每张显卡显存约 24GB

- 当前所有显卡状态正常

这里补充说明一下:

nvidia-smi里显示的CUDA Version是驱动支持的最高 CUDA 版本,不代表你安装的 PyTorch 必须和它完全一致。只要驱动版本足够新,通常可以向下兼容较低版本的 CUDA 运行时。

比如本文中,驱动支持 CUDA 13.0,但实际安装的是 PyTorch 对应 CUDA 12.4,同样可以正常使用。

GPU 信息截图

五、安装 PyTorch

由于当前环境是:

- Python 3.10

- Linux aarch64 / ARM64

- 需要使用 CUDA 12.4 对应版本

这里采用 直接安装官方 wheel 包 的方式,这种方式比直接 pip install torch 更明确,也更适合 ARM 平台。

执行命令:

bash

python -m pip install https://download.pytorch.org/whl/cu124/torch-2.5.1-cp310-cp310-linux_aarch64.whl这条命令的含义如下:

torch-2.5.1:安装 PyTorch 2.5.1cp310-cp310:对应 Python 3.10linux_aarch64:对应 Linux ARM64 架构cu124:对应 CUDA 12.4

这种安装方式的优点是:

- 版本更明确

- 不容易装错架构

- 更适合飞腾等 ARM 服务器环境

- 避免

pip自动解析时选到不匹配版本

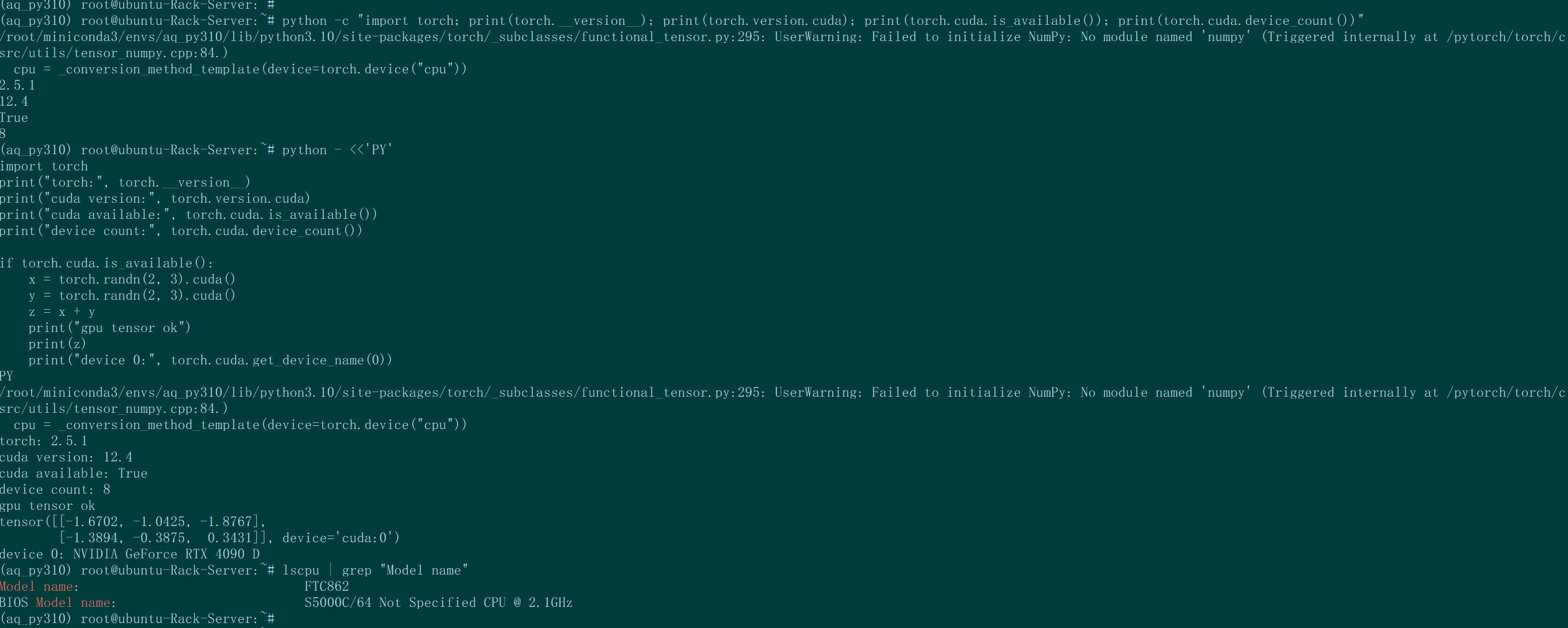

六、验证 PyTorch 是否安装成功

安装完成后,先执行一个简单的验证命令:

bash

python -c "import torch; print(torch.__version__); print(torch.version.cuda); print(torch.cuda.is_available()); print(torch.cuda.device_count())"输出如下:

log

/root/miniconda3/envs/aq_py310/lib/python3.10/site-packages/torch/_subclasses/functional_tensor.py:295: UserWarning: Failed to initialize NumPy: No module named 'numpy' (Triggered internally at /pytorch/torch/csrc/utils/tensor_numpy.cpp:84.)

cpu = _conversion_method_template(device=torch.device("cpu"))

2.5.1

12.4

True

8从结果可以看到:

2.5.1:PyTorch 安装成功12.4:当前 PyTorch 对应的 CUDA 版本True:说明 CUDA 可以正常使用8:说明成功识别到 8 张 GPU

七、关于 NumPy 警告说明

在验证输出中,可以看到这样一条警告:

log

UserWarning: Failed to initialize NumPy: No module named 'numpy'这个问题并不是 PyTorch 安装失败,也不是 CUDA 有问题,而是当前 Python 环境中还没有安装 numpy。

建议顺手安装一下:

bash

python -m pip install numpy安装完成后,再执行验证命令,这条警告通常就不会再出现了。

八、进一步验证:测试 GPU 张量计算

仅仅看到 torch.cuda.is_available() 为 True 还不够,最好再做一次真实的 GPU 运算测试。

执行下面脚本:

bash

python - <<'PY'

import torch

print("torch:", torch.__version__)

print("cuda version:", torch.version.cuda)

print("cuda available:", torch.cuda.is_available())

print("device count:", torch.cuda.device_count())

if torch.cuda.is_available():

x = torch.randn(2, 3).cuda()

y = torch.randn(2, 3).cuda()

z = x + y

print("gpu tensor ok")

print(z)

print("device 0:", torch.cuda.get_device_name(0))

PY输出如下:

log

/root/miniconda3/envs/aq_py310/lib/python3.10/site-packages/torch/_subclasses/functional_tensor.py:295: UserWarning: Failed to initialize NumPy: No module named 'numpy' (Triggered internally at /pytorch/torch/csrc/utils/tensor_numpy.cpp:84.)

cpu = _conversion_method_template(device=torch.device("cpu"))

torch: 2.5.1

cuda version: 12.4

cuda available: True

device count: 8

gpu tensor ok

tensor([[-1.6702, -1.0425, -1.8767],

[-1.3894, -0.3875, 0.3431]], device='cuda:0')

device 0: NVIDIA GeForce RTX 4090 D从这段结果可以确认:

- PyTorch 可以正常调用 CUDA

- 张量已经成功放到 GPU 上计算

- 实际运算设备是

cuda:0 - 第 0 张显卡名称识别正常:

NVIDIA GeForce RTX 4090 D

这一步通过后,说明整个 PyTorch + CUDA 环境已经搭建成功,可以进入后续模型训练或推理阶段。

验证截图

九、结论

本次在 飞腾 S5000C 服务器上的环境搭建和验证结果如下:

- CPU 平台识别正常

- 8 张 RTX 4090 D 显卡识别正常

- NVIDIA 驱动工作正常

- PyTorch 2.5.1 安装成功

- CUDA 12.4 运行正常

- PyTorch 可以正确调用 GPU 执行张量计算

整体来看,这套环境已经具备深度学习训练、模型推理、多卡任务调度等基础运行条件。

十一、常见说明

1)驱动版本高于 PyTorch 对应 CUDA 版本,是正常现象

很多人看到:

nvidia-smi里是 CUDA 13.0torch.version.cuda里是 12.4

会担心是不是版本不一致导致有问题。

实际上这通常是正常的。因为驱动支持更高版本 CUDA 时,往往也能兼容较低版本的运行时。

2)出现 NumPy 警告,不影响基础 CUDA 验证

如果看到:

log

No module named 'numpy'说明只是当前环境没装 numpy,补装即可:

bash

python -m pip install numpy3)建议一定要做一次真实 GPU 运算测试

只看 torch.cuda.is_available() 还不够,最好像本文一样:

- 创建 CUDA 张量

- 做一次加法运算

- 查看输出设备信息

这样更能说明环境确实可用。

十二、命令汇总

1. 查看 CPU 型号

bash

lscpu | grep "Model name"2. 查看 GPU 和驱动信息

bash

nvidia-smi -l3. 安装 PyTorch

bash

python -m pip install https://download.pytorch.org/whl/cu124/torch-2.5.1-cp310-cp310-linux_aarch64.whl4. 安装 NumPy

bash

python -m pip install numpy5. 验证 PyTorch 和 CUDA

bash

python -c "import torch; print(torch.__version__); print(torch.version.cuda); print(torch.cuda.is_available()); print(torch.cuda.device_count())"6. 测试 GPU 张量运算

bash

python - <<'PY'

import torch

print("torch:", torch.__version__)

print("cuda version:", torch.version.cuda)

print("cuda available:", torch.cuda.is_available())

print("device count:", torch.cuda.device_count())

if torch.cuda.is_available():

x = torch.randn(2, 3).cuda()

y = torch.randn(2, 3).cuda()

z = x + y

print("gpu tensor ok")

print(z)

print("device 0:", torch.cuda.get_device_name(0))

PY十三、参考说明

本文主要记录的是实际部署过程中的验证结果,适合作为飞腾 ARM 服务器安装 PyTorch GPU 环境的参考。

如果你后续还需要继续配置:

torchvisiontorchaudio- 多卡训练环境

- NCCL / 分布式训练

- Docker 容器环境

- Transformers / 大模型推理环境

也可以在这套基础环境上继续扩展。

如果这篇文章对你有帮助,欢迎点赞、收藏、交流。