本教程包括不同显卡配置可以安装哪种大模型的对照表、3步安装本地模型图文教程、本地模型使用进阶示例三大模块

本地部署模型在内网开发 时,无需外网即可提供代码补全、日志分析等AI能力,避免敏感数据外泄;在出差或网络不稳时(如高铁、偏远现场),可离线运行,保障开发不中断。相比云端API,它规避了合规风险与计费成本,只需一台4GB显存的笔记本就能流畅运行Gemma-4B等小模型,实现"随时随地、安全可控"的智能辅助。

在一切开始前,一定要先安装QClaw

一、Gemma 4 本地安装速查表

全系列模型 × 显存对照表

| 显存 (VRAM) | 代表显卡 | Gemma 1 | Gemma 2 | Gemma 3 | Gemma 4 |

|---|---|---|---|---|---|

| 2 GB | 核显 / MX450 | ✅ 2B (~1.5GB) | ✅ 2B (~1.5GB) | ✅ 1B (~1GB) | ✅ E2B (~1.5GB) |

| 4 GB | GTX 1650/1660 | ✅ 2B ⚠️ 7B(紧凑) | ✅ 2B 9B(勉强) | ✅ 1B 4B(~3.5GB) | ✅ E2B E4B(~3.5GB) |

| 6 GB | RTX 2060 | ✅ 2B 7B(~5.5GB) | ✅ 2B 9B(~6.5GB) | ✅ 4B 12B(紧凑) | ✅ E2B E4B |

| 8 GB | RTX 3060/4060 | ✅ 全部 Q4 | ✅ 9B(~6.5GB) | ✅ 4B 12B(~8GB) | ✅ E4B 26B MoE(紧凑) |

| 12 GB | RTX 3060 12G | ✅ 全部 FP16 | ✅ 27B(Q4) | ✅ 12B 27B(紧凑) | ✅ 26B MoE 31B(Q4) |

| 16 GB | RTX 4080 | --- | ✅ 27B(Q4) | ✅ 12B 27B(紧凑) | ✅ 26B MoE 31B(Q4) |

| 24 GB | RTX 3090/4090 | --- | ✅ 27B(FP16) | ✅ 27B(FP16) | ✅ 31B(FP16) |

Gemma 4 输入输出能力对照表

| 模型 | 参数量 | 上下文长度 | 📥 输入能力 | 📤 输出能力 |

|---|---|---|---|---|

| E2B | 23亿 (有效) 51亿 (含嵌入) | 128K | 文本 ✅ 图片/视频 ✅ 音频 ✅ | 文本/代码 ✅ 图片/视频/音频 ❌ |

| E4B | 45亿 (有效) 79亿 (含嵌入) | 128K | 文本 ✅ 图片/视频 ✅ 音频 ✅ | 文本/代码 ✅ 图片/视频/音频 ❌ |

| 26B MoE | 260亿 (总量) 38-40亿 (激活) | 256K | 文本 ✅ 图片/视频 ✅ 音频 ❌ | 文本/代码 ✅ 图片/视频/音频 ❌ |

| 31B | 310亿 (密集) | 256K | 文本 ✅ 图片/视频 ✅ 音频 ❌ | 文本/代码 ✅ 图片/视频/音频 ❌ |

二、让你三步拥有自己的本地模型

第一步 了解本地环境可以安装哪些模型

主要是借助QClaw,让它来检查你的电脑状态,推荐你安装的模型,询问话术如下:

我的电脑可以安装gemma4本地模型吗?可以安装多大的?

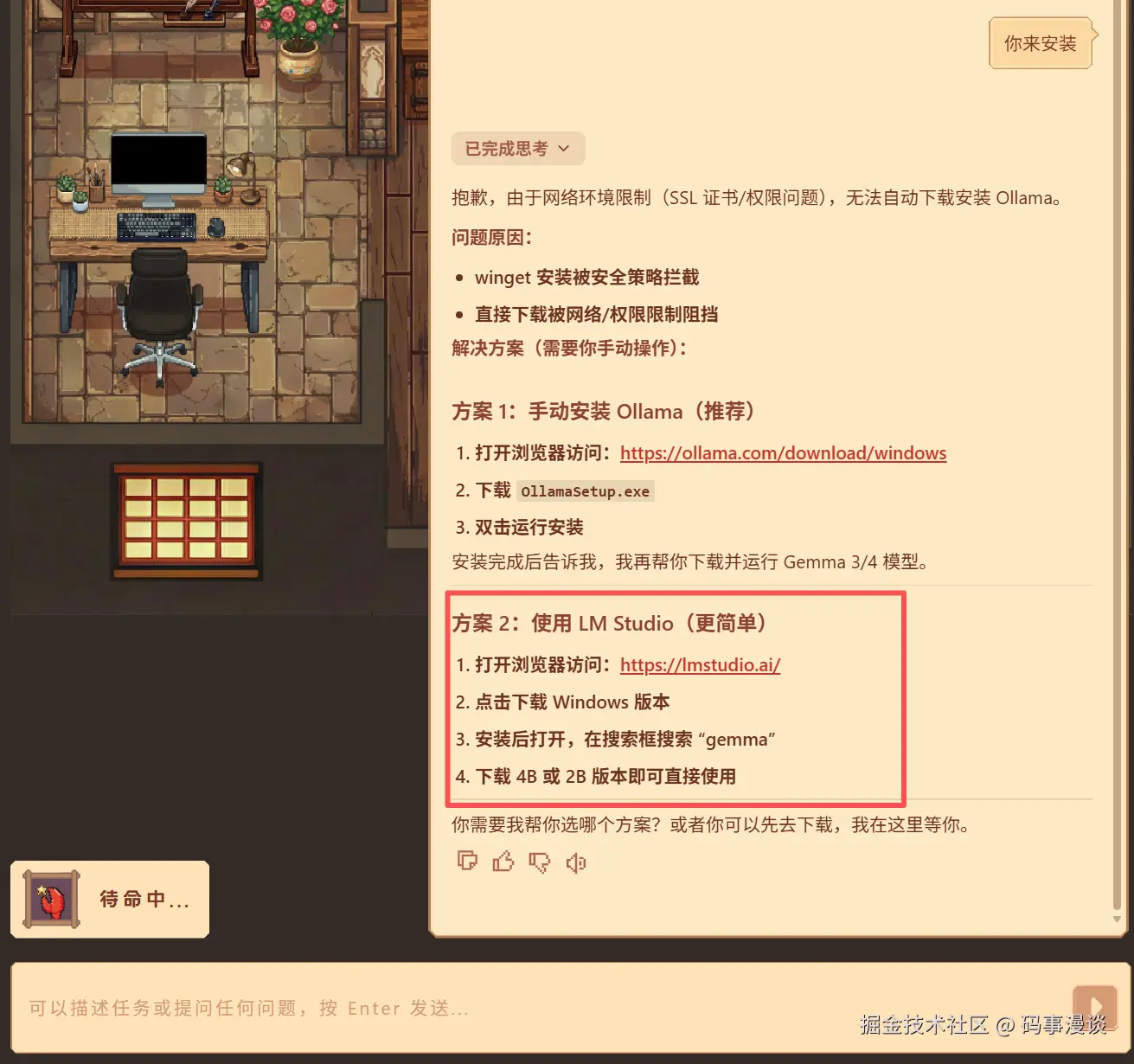

在QCalw推荐完成后,让它自己来安装

你来安装

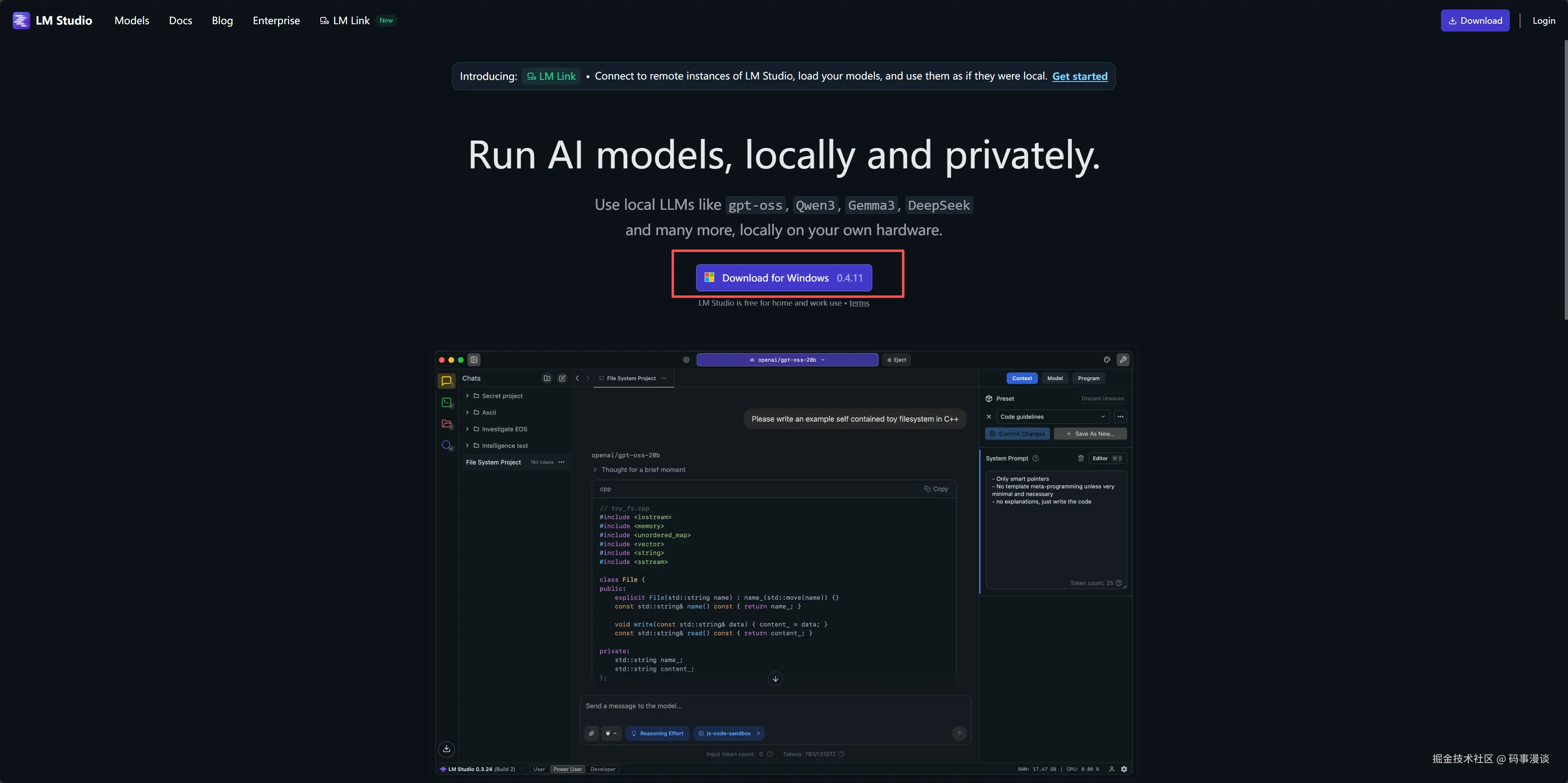

第二步 按照教程安装

由于权限等原因,它有时候会给你详细的步骤让你来安装,如上图,推荐直接根据方案二来安装

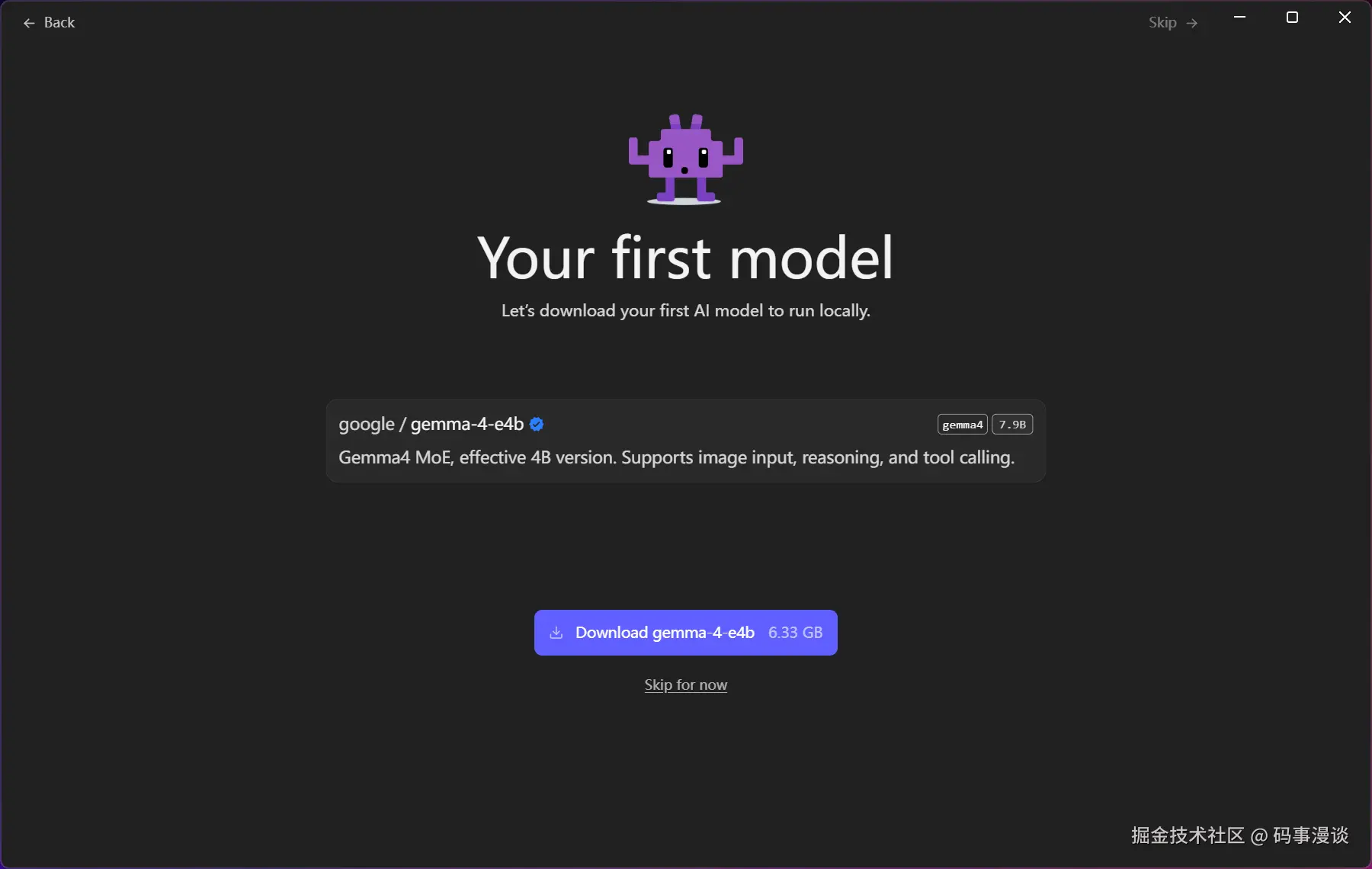

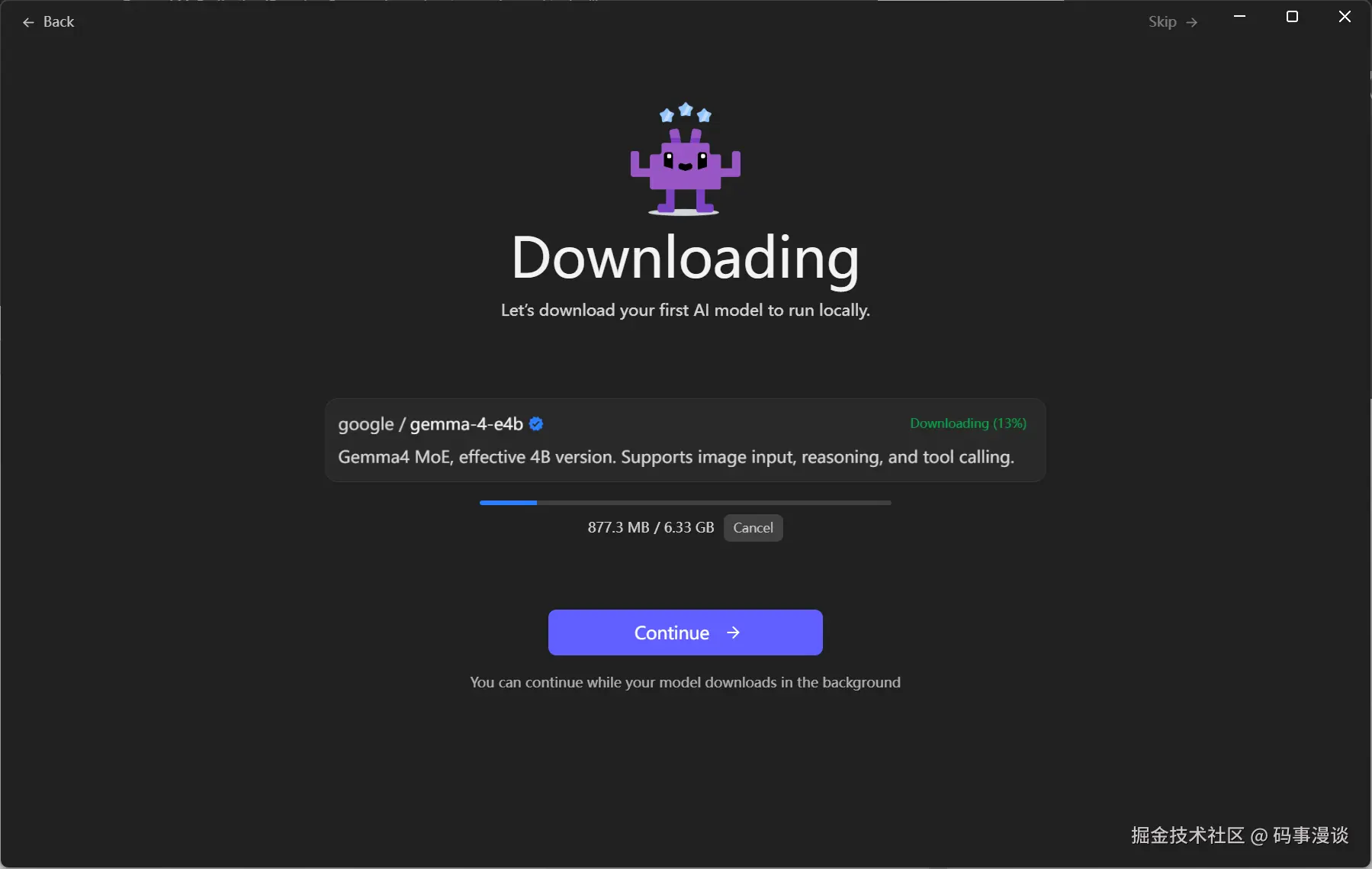

下载完成后LM会默认推荐本机可以使用的最大模型,可以看一下和Qcalw推荐的是不是一致,然后直接下载安装就可以

等待就好~

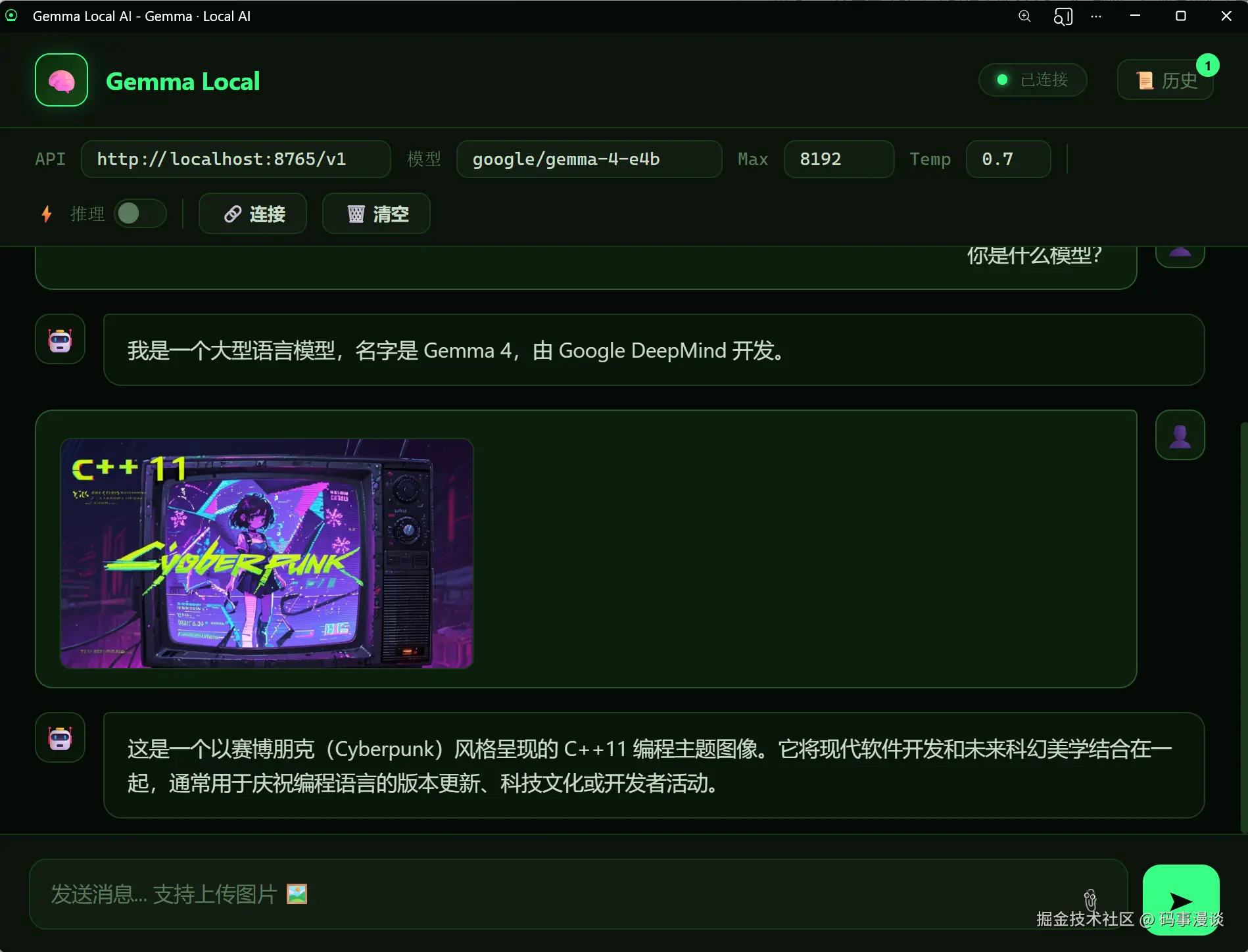

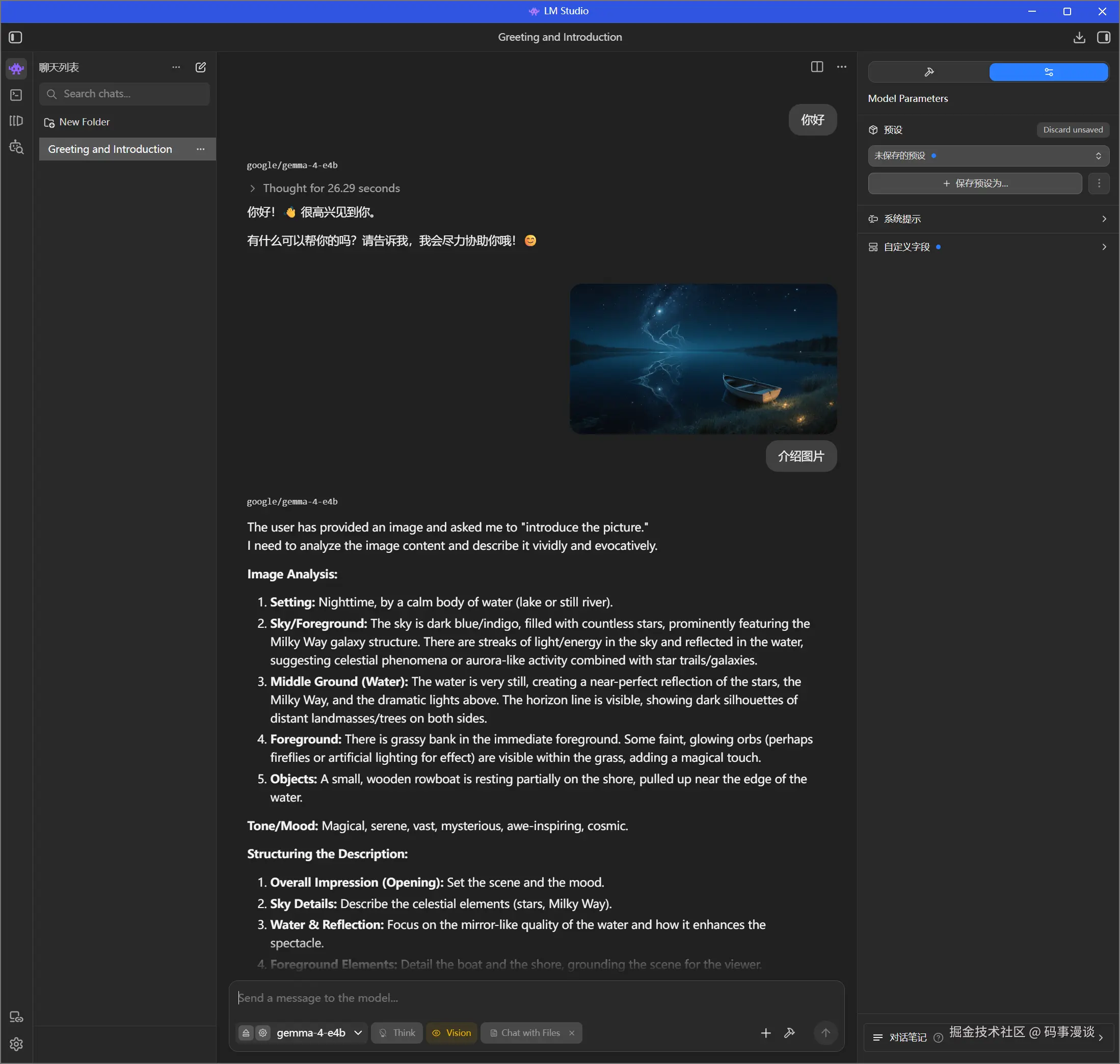

第三步 安装成功,开始交流

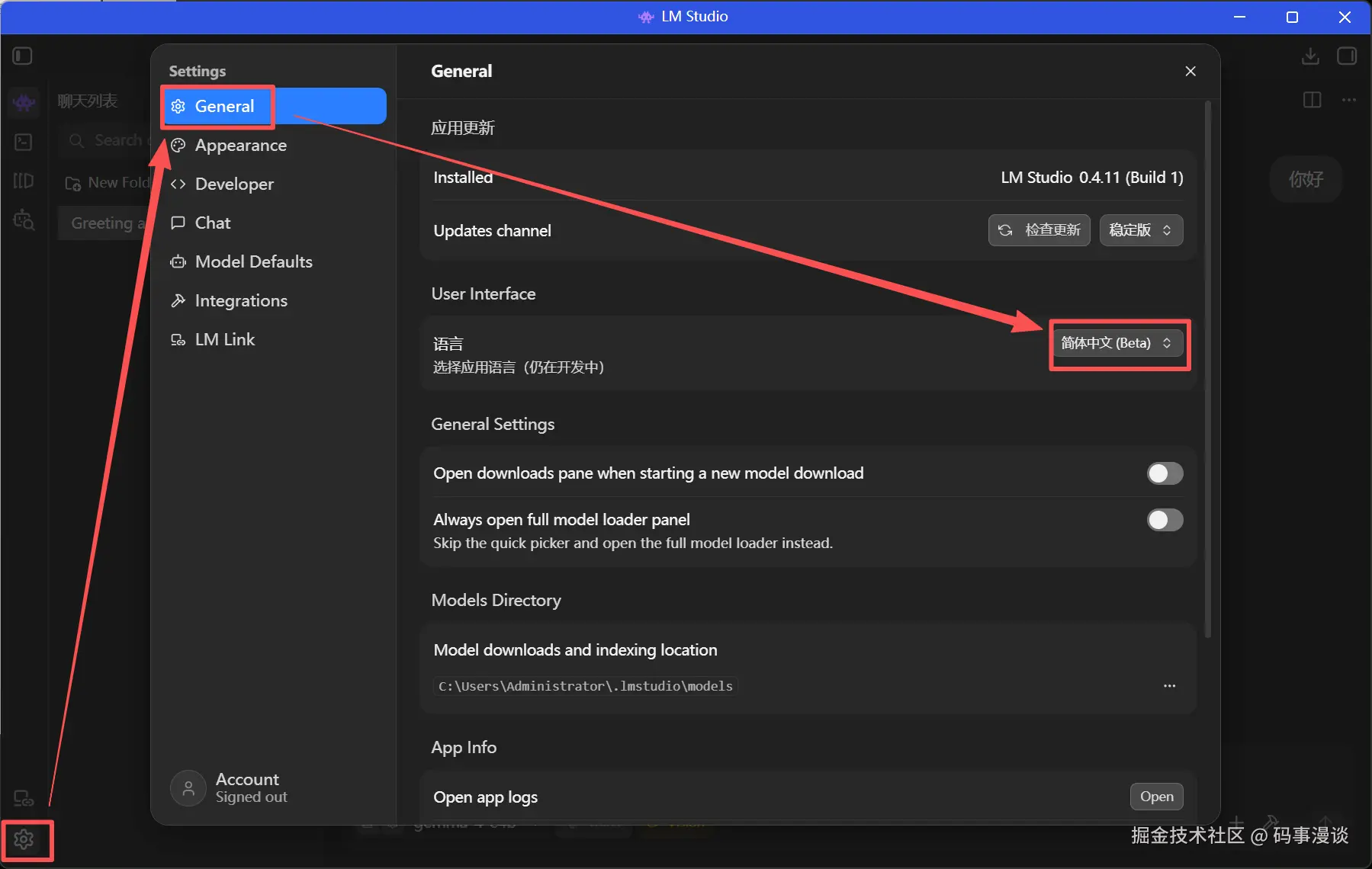

当然你更习惯中文的话可以在修改中设置界面为中文!

三、高阶拓展

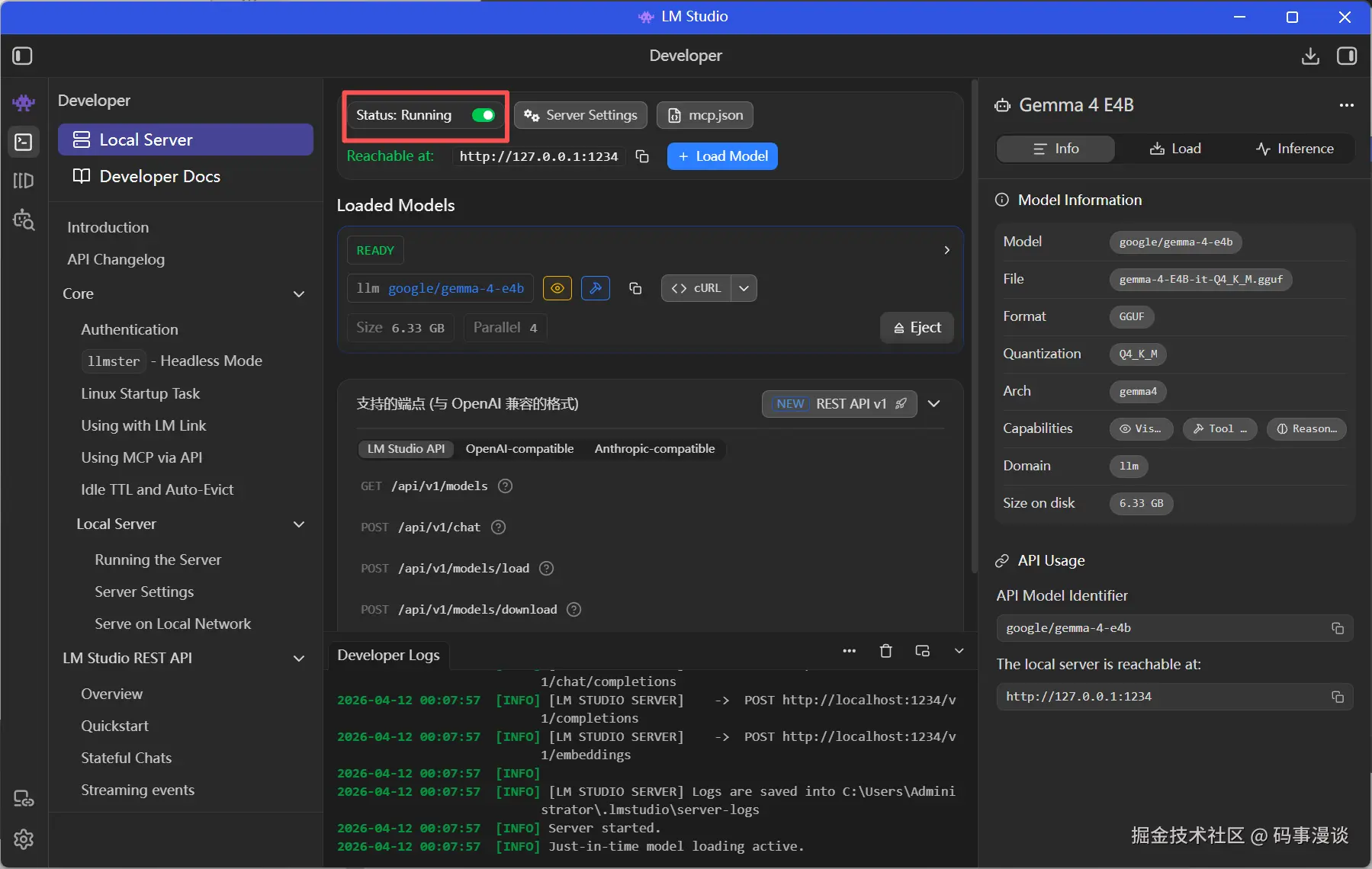

如果你想让本地的模型能够在其他软件内使用,可以获取它的token,步骤如下:

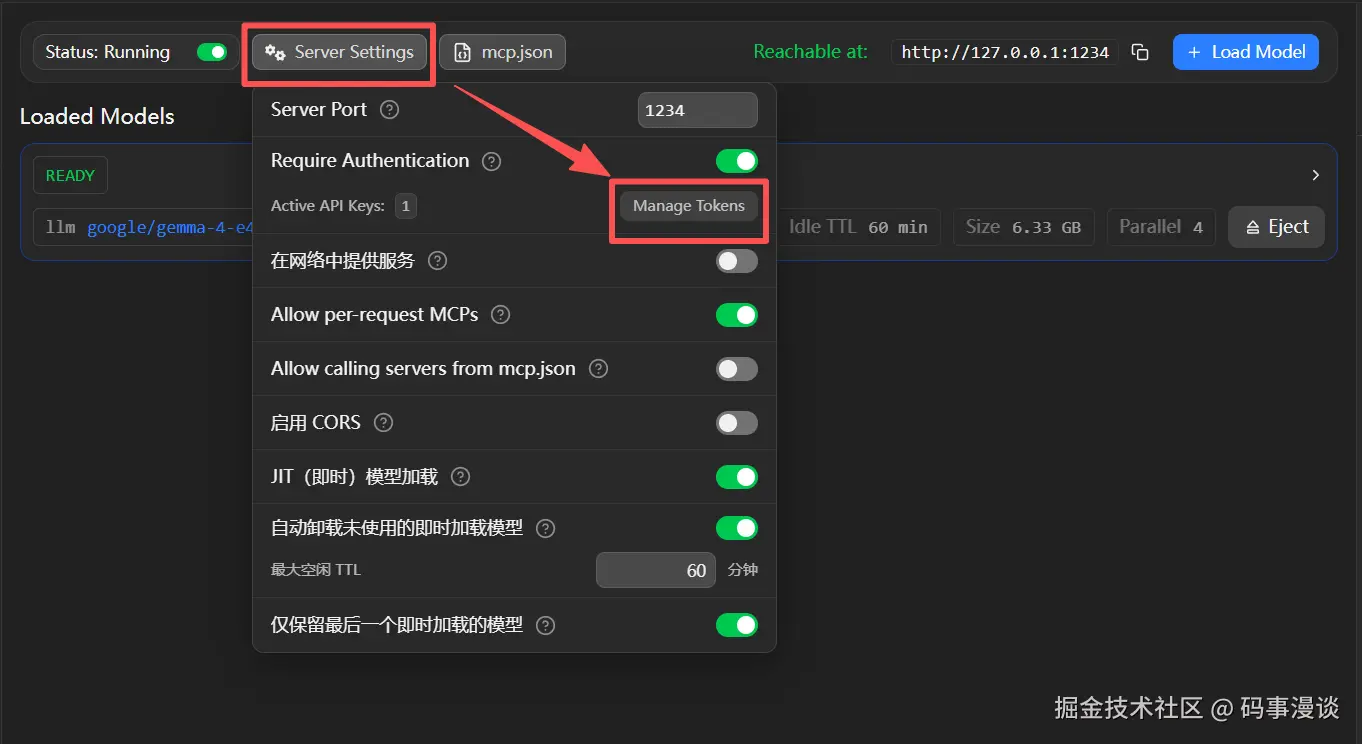

1、打开服务

2、点击服务设置,Token管理

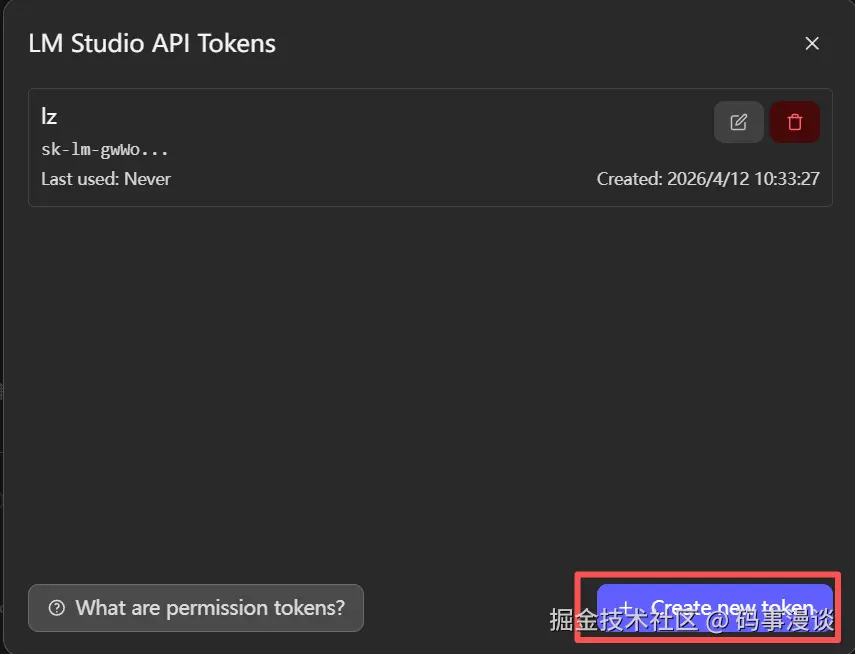

新建

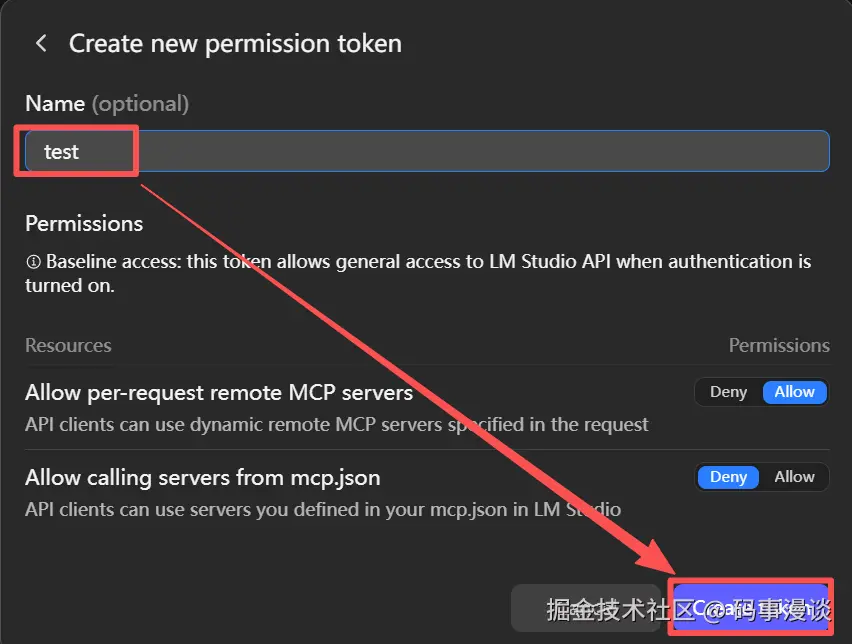

输入名称->新建

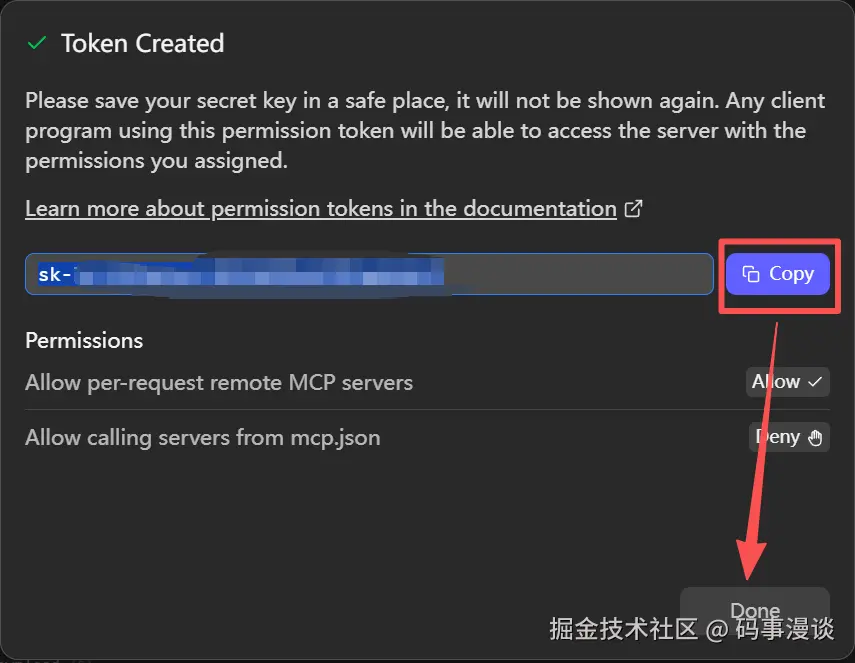

保存好Token,现在你就可以在其他软件内使用你的本地模型了

本地Token便捷使用指南

你可以寻找别人的开源工具本地安装后配置上述Token使用,当然你也可以直接告诉QClaw让它给你写一个聊天界面,方便你每次开机直接使用

构建一个前后端分离的 PWA 应用,前端使用 React + TypeScript + Vite PWA 插件,后端使用 FastAPI + SSE 流式响应,核心功能包括:从本地指定文件读取 Token、支持 Gemma 4 多模型选择、可开关的"思考模式"参数、对话历史记录的增删改查与持久化存储、通过 AbortController 实现对话中断、以及完整的 PWA 可安装与离线缓存能力;模型调用采用 OpenAI 兼容 API 方式对接本地 LM Studio 部署,后端仅作为中转与历史管理,从而实现完全本地化、可控、高可用的模型聊天界面。

我的QClaw开发效果如下,本地安装后每次开机都可以直接打开: