一、什么是 Ollama

Ollama 是一个本地运行大语言模型的工具,支持 macOS / Linux / Windows。它把模型下载、运行、API 服务全部封装好,一条命令就能跑起来。

二、安装 Ollama

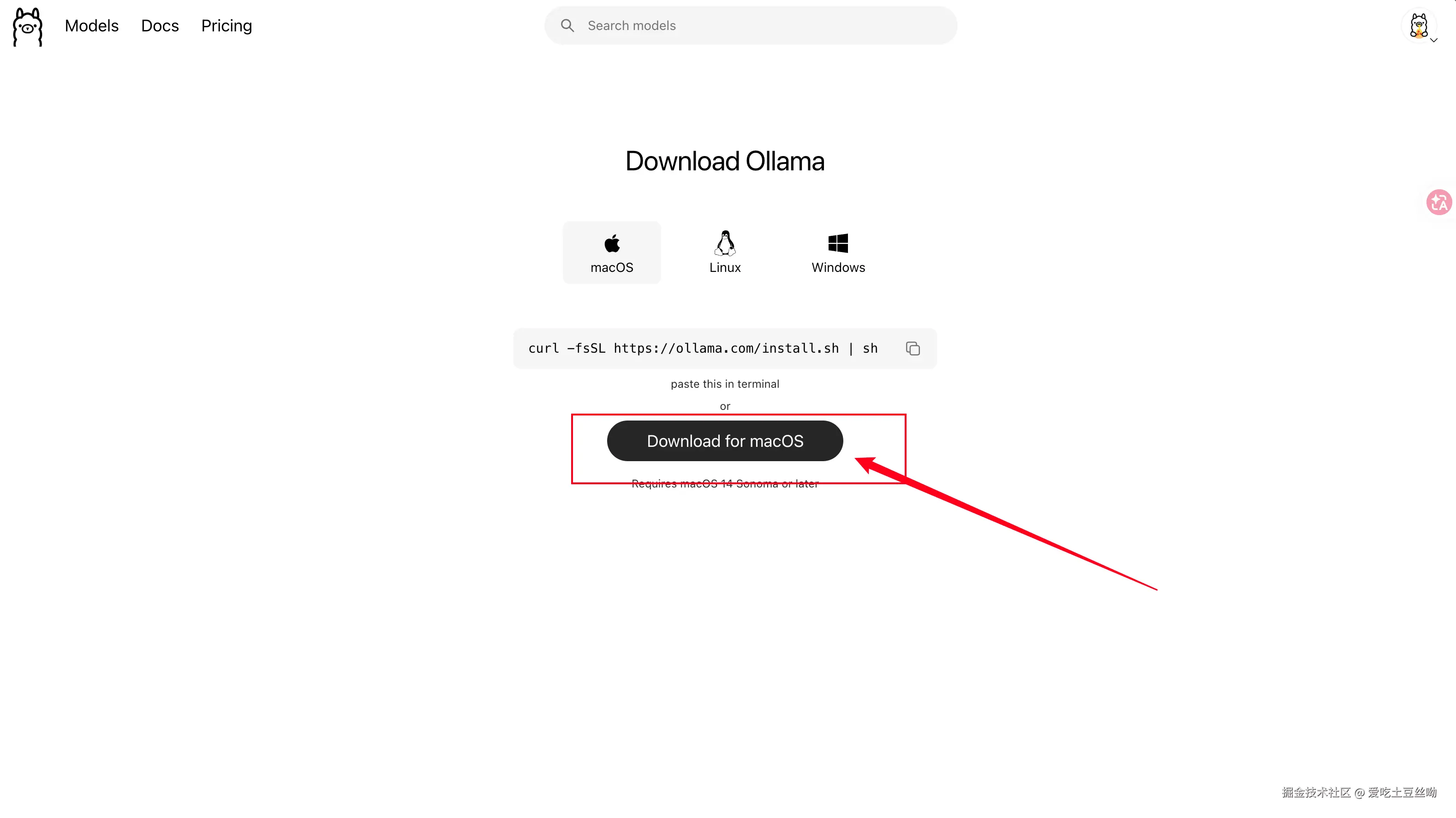

方式一:官网下载(推荐)

- 打开 ollama.com/download

- 点击 Download for macOS

- 下载后解压,将

Ollama.app拖入「应用程序」文件夹 - 双击打开,菜单栏会出现 Ollama 图标,表示服务已启动

方式二:Homebrew 安装

bash

brew install ollama安装完成后启动服务:

bash

ollama serve验证安装

bash

ollama --version看到版本号即安装成功。

三、下载并运行 Gemma 4 模型

一条命令下载并运行

bash

ollama run gemma4首次运行会自动下载模型(约 5GB),下载完成后直接进入对话。之后再运行则跳过下载,直接启动。

输入问题即可聊天,输入 /bye 退出。

查看已下载的模型

bash

ollama list四、Ollama 常用命令

| 命令 | 说明 |

|---|---|

ollama serve |

启动 Ollama 服务(桌面版自动启动) |

ollama pull <模型名> |

下载模型 |

ollama run <模型名> |

运行模型并进入对话 |

ollama list |

查看已下载的模型列表 |

ollama rm <模型名> |

删除模型 |

ollama show <模型名> |

查看模型详细信息 |

ollama ps |

查看当前运行中的模型 |

五、通过 API 调用

Ollama 启动后会在 localhost:11434 提供 HTTP API。

健康检查

bash

curl http://localhost:11434返回 Ollama is running 表示正常。

非流式对话

bash

curl -X POST http://localhost:11434/api/chat \

-H "Content-Type: application/json" \

-d '{

"model": "gemma4",

"messages": [{"role": "user", "content": "你好"}],

"stream": false

}'流式对话

bash

curl -X POST http://localhost:11434/api/chat \

-H "Content-Type: application/json" \

-d '{

"model": "gemma4",

"messages": [{"role": "user", "content": "介绍一下你自己"}],

"stream": true

}'查看可用模型

bash

curl http://localhost:11434/api/tags六、运行状态

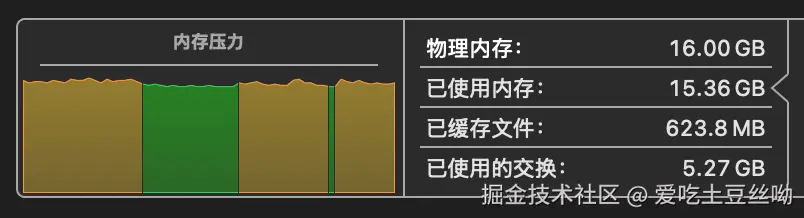

模型非常吃内存,目前一开始回复就会将我的mac内存吃满,我的是16g的macmini