💎【行业认证·权威头衔】

✔ 华为云天团核心成员:特约编辑/云享专家/开发者专家/产品云测专家

✔ 开发者社区全满贯:CSDN博客&商业化双料专家/阿里云签约作者/腾讯云内容共创官/掘金&亚马逊&51CTO顶级博主

✔ 技术生态共建先锋:横跨鸿蒙、云计算、AI等前沿领域的技术布道者

🏆【荣誉殿堂】

🎖 连续三年蝉联"华为云十佳博主"(2022-2024)

🎖 双冠加冕CSDN"年度博客之星TOP2"(2022&2023)

🎖 十余个技术社区年度杰出贡献奖得主

📚【知识宝库】

覆盖全栈技术矩阵:

◾ 编程语言:.NET/Java/Python/Go/Node...

◾ 移动生态:HarmonyOS/iOS/Android/小程序

◾ 前沿领域:物联网/网络安全/大数据/AI/元宇宙

◾ 游戏开发:Unity3D引擎深度解析

文章目录

🚀前言

AI生成视频技术正以前所未有的速度重塑内容创作生态,其核心是通过深度学习模型 将文本、图像或视频输入转化为动态视频内容。本章将介绍即梦的AI视频生成功能。

🚀一、图生视频案例:从静态图片到动态叙事的三种实战方法

除了输入文字描述,我们还可以借助AI技术,将静态图片转化为动态视频。即梦AI的图生视频功能,可以从单张图片中推断出合理的运动轨迹和场景变化,生成连贯的短视频内容。例如,用户上传一张老照片,即梦AI可生成人物微笑、风吹动发丝等动态效果,使画面"活"起来。下面通过三个完整案例,分别介绍基础图生视频、多镜头叙事生成以及首尾帧控制的高级技巧。

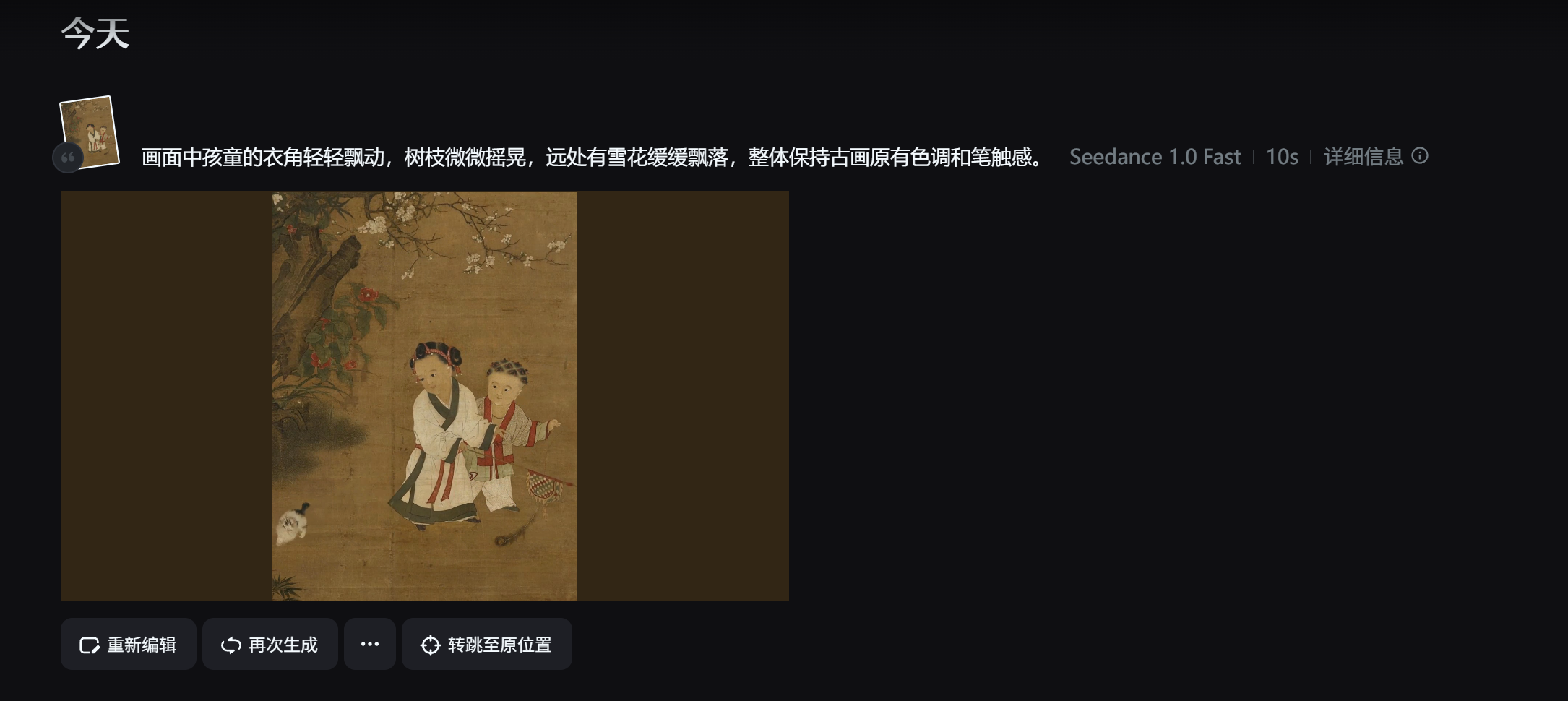

🔎1.基础操作案例:动起来的《冬日婴戏图》

下面通过一个让古代名画《冬日婴戏图》(见图)动起来的小案例,介绍图生视频的基础操作方法。

步骤01 进入"视频生成"页面后,在编辑区中单击"图片生视频"按钮,切换出"上传图片"输入框,如图所示。

步骤02 导入一幅古代名画《冬日婴戏图》,输入几句话,简单地描述一下如何让画面动起来。然后选择"视频3.0"模型,生成时长设置为10s,如图所示。

提示词模板(示例):

画面中孩童的衣角轻轻飘动,树枝微微摇晃,远处有雪花缓缓飘落,整体保持古画原有色调和笔触感。

步骤03 单击"生成视频"按钮后,就得到一段新的视频。如果对视频效果不满意,还可以选择再次生成,每一次得到的视频都有所不同。经过多次重新生成后,最终得到了一段效果不错的视频,如图所示。

🔎2.多个镜头叙事案例:一条指令生成带情节的视频

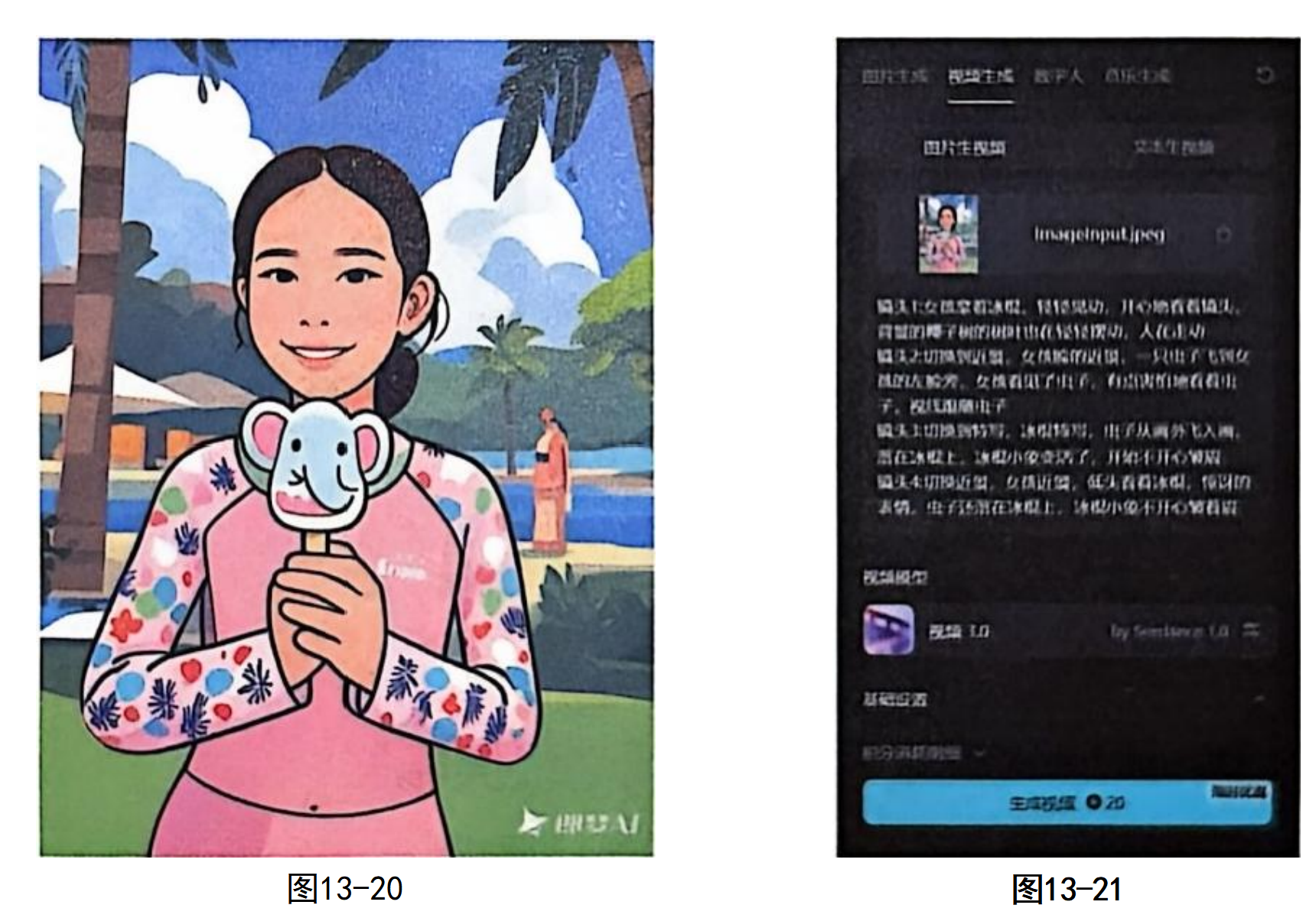

最新的视频模型不仅可以生成运镜复杂的单个镜头,甚至还可以通过一条描述词,一次性生成连续的、成组的多个镜头。下面的案例是根据一张图(见图13-20),生成一段有情节的视频:一个女孩开心地拿着冰棍,此时一只虫子落到了冰棍上,女孩惊讶极了。这段视频由4个分切镜头组成,是通过一段描述词直接生成的。具体的操作步骤如下。

步骤01 进入"视频生成"页面后,在编辑区中单击"图片生视频"按钮,切换出"上传图片"输入框。

步骤02 导入图13-20作为参考图,在描述词输入框中,详细描述需要生成的镜头。比如,镜头数量、每个镜头的景别、运镜方式和具体内容。细节描述得越丰富,生成的视频就越符合我们原本的创意。具体的描述词如图13-21所示。

提示词模板(分镜拆分参考):

镜头序号+景别+运镜方式(转场方式)+内容

完整提示词示例:

镜头1:中景,固定镜头,女孩开心地拿着冰棍,脸上洋溢着笑容。

镜头2:近景,快速推镜,一只虫子飞入画面。

镜头3:特写,微距镜头,虫子落在冰棍表面,翅膀微微扇动。

镜头4:近景,轻微后拉,女孩低头看到虫子后露出惊讶表情,嘴巴微张。

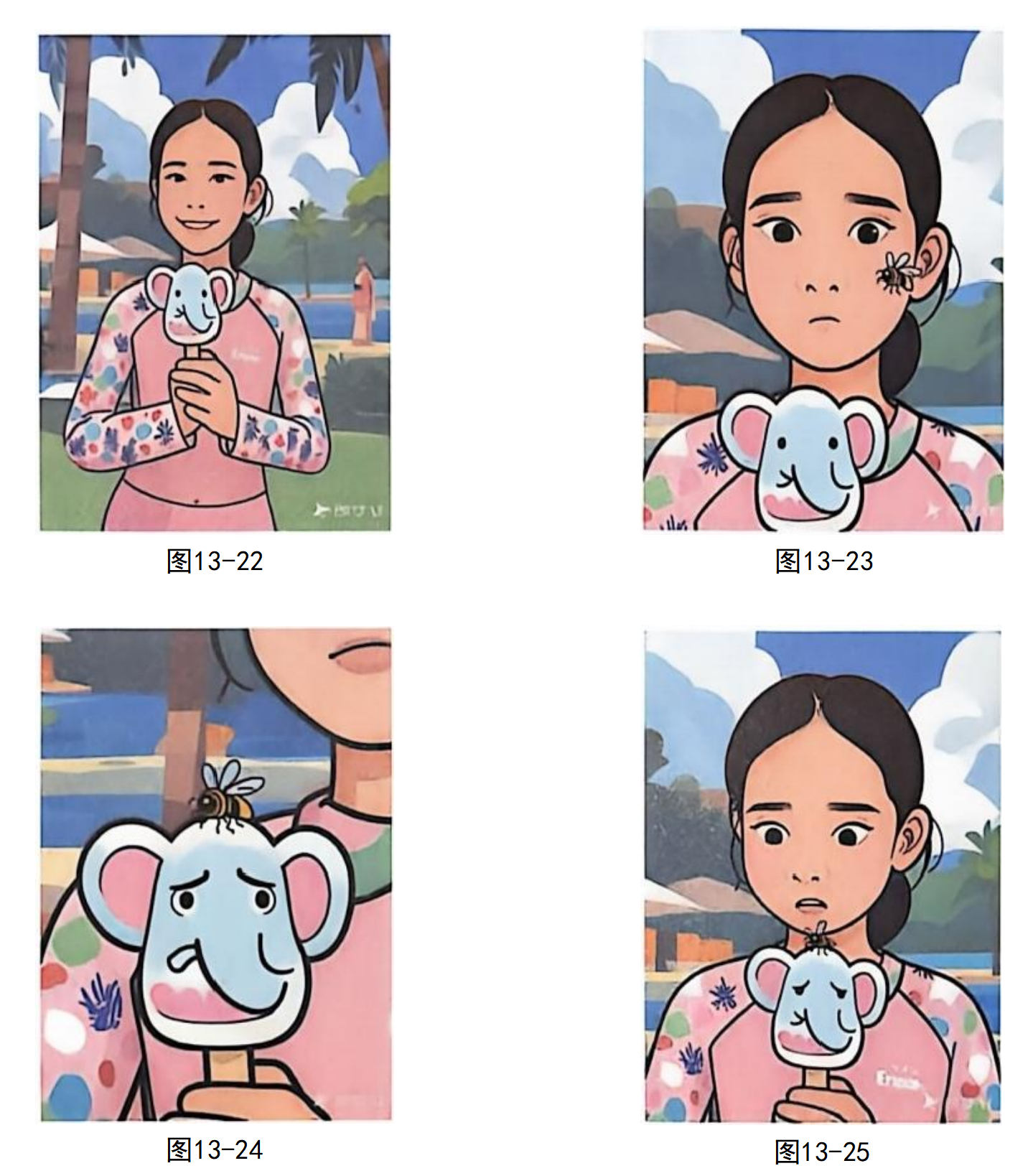

步骤03 选择"视频3.0"模型,生成时长设置为10s,单击"生成视频"按钮后,经过多次重新生成,最终得到了一段比较满意的视频。该视频的第一个镜头是中景,女孩拿着冰棍开心地笑着,如图13-22所示。第二个镜头是近景,一只虫子飞到画面中,如图13-23所示。第三个镜头是特写,虫子落到了冰棍上面,如图13-24所示。第四个镜头是近景,女孩惊讶地看着冰棍上的虫子,如图13-25所示。

🔎3.首尾帧+剪映案例:复刻经典电影镜头

首尾帧技术是通过上传首帧图片(视频起始画面)和尾帧图片(视频结束画面),结合文字描述过渡效果,由AI自动生成中间过渡帧,最终形成流畅的动态视频。这项功能可以精准控制视频内容的起始与结束状态,同时提升创作效率与画面连贯性。

下面案例的灵感来源于经典电影《阿甘正传》的片头,一片羽毛从高空缓缓飘落,镜头也随之移动到不同的场景。具体的操作步骤如下。

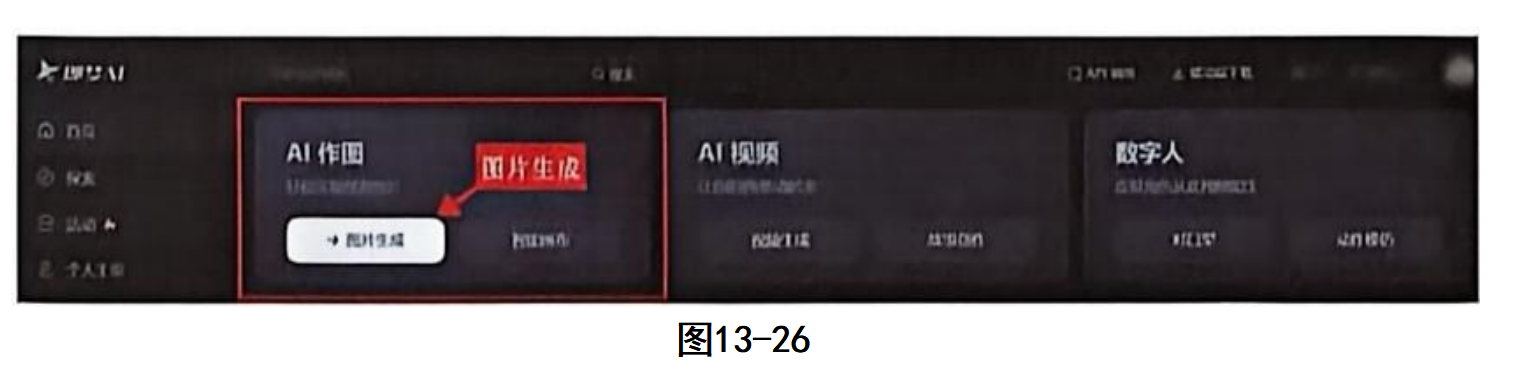

步骤01 进入即梦AI主页后,单击"AI作图"区域中的"图片生成"按钮,如图13-26所示。

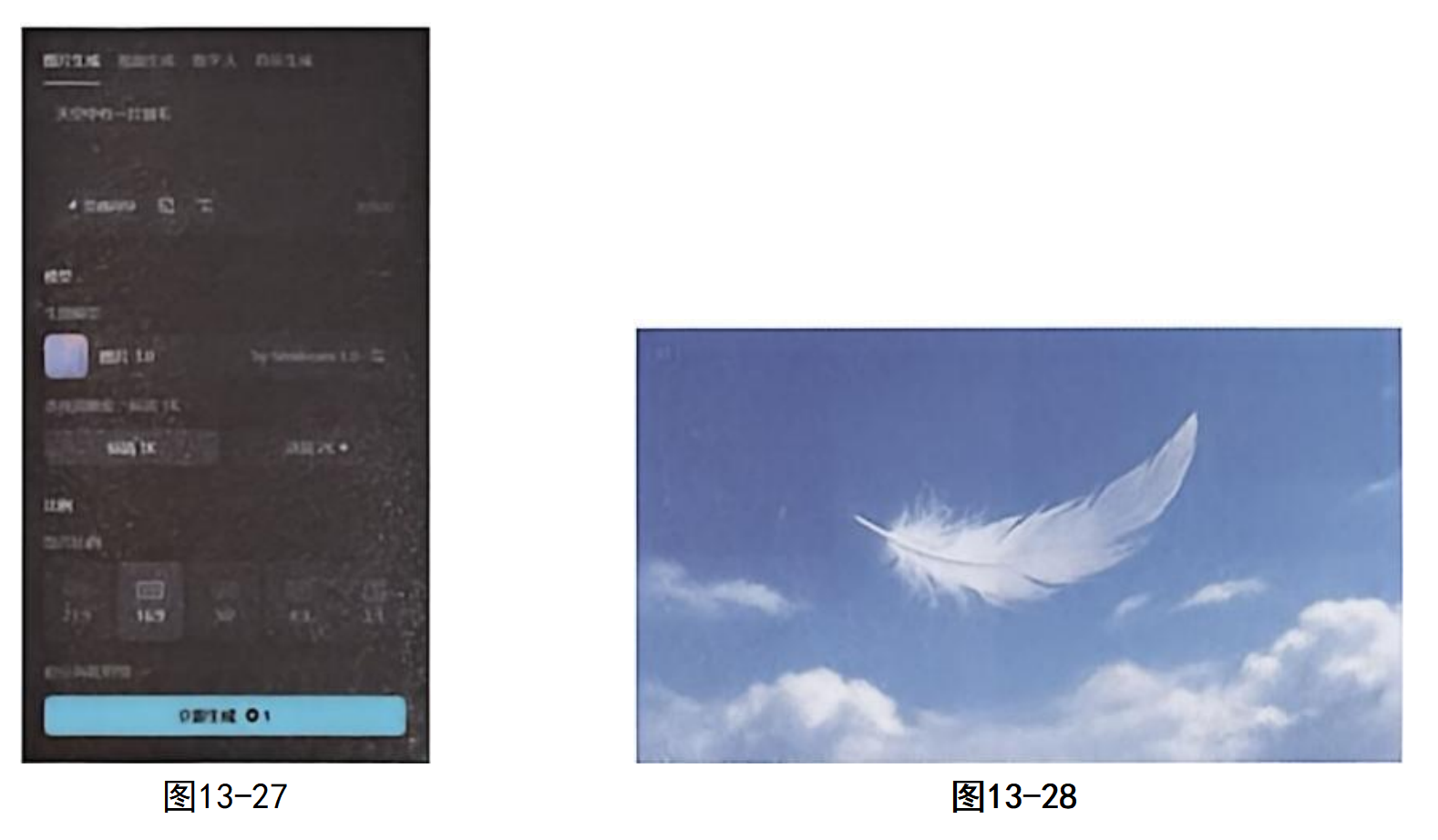

步骤02 进入"图片生成"页面后,在描述词输入框中输入文字,描述想要生成的图片,选择"图片3.0"模型,16:9比例,单击"立即生成"按钮,如图13-27所示。随即得到如图13-28所示的羽毛图片。

提示词模板(生成首帧图片):

一片白色的羽毛,轻盈地漂浮在湛蓝的天空中,阳光从右上角洒下,羽毛边缘有柔光,电影质感,高清,16:9。

步骤03 回到"图片生成"页面,在描述词输入框中,单击"导入参考图"按钮,导入刚才生成的羽毛图片作为参考。在描述词输入框中输入文字,强调新图中要生成原图的羽毛,同时描述新图的环境细节,如图13-29所示。单击"立即生成"按钮后,得到如图13-30所示的新图。

提示词模板(生成中间帧图片------城市上空):

参考图中相同的白色羽毛,飘在城市高楼大厦的上空,黄昏时分,城市灯火初上,羽毛保持相同形状和光线方向。

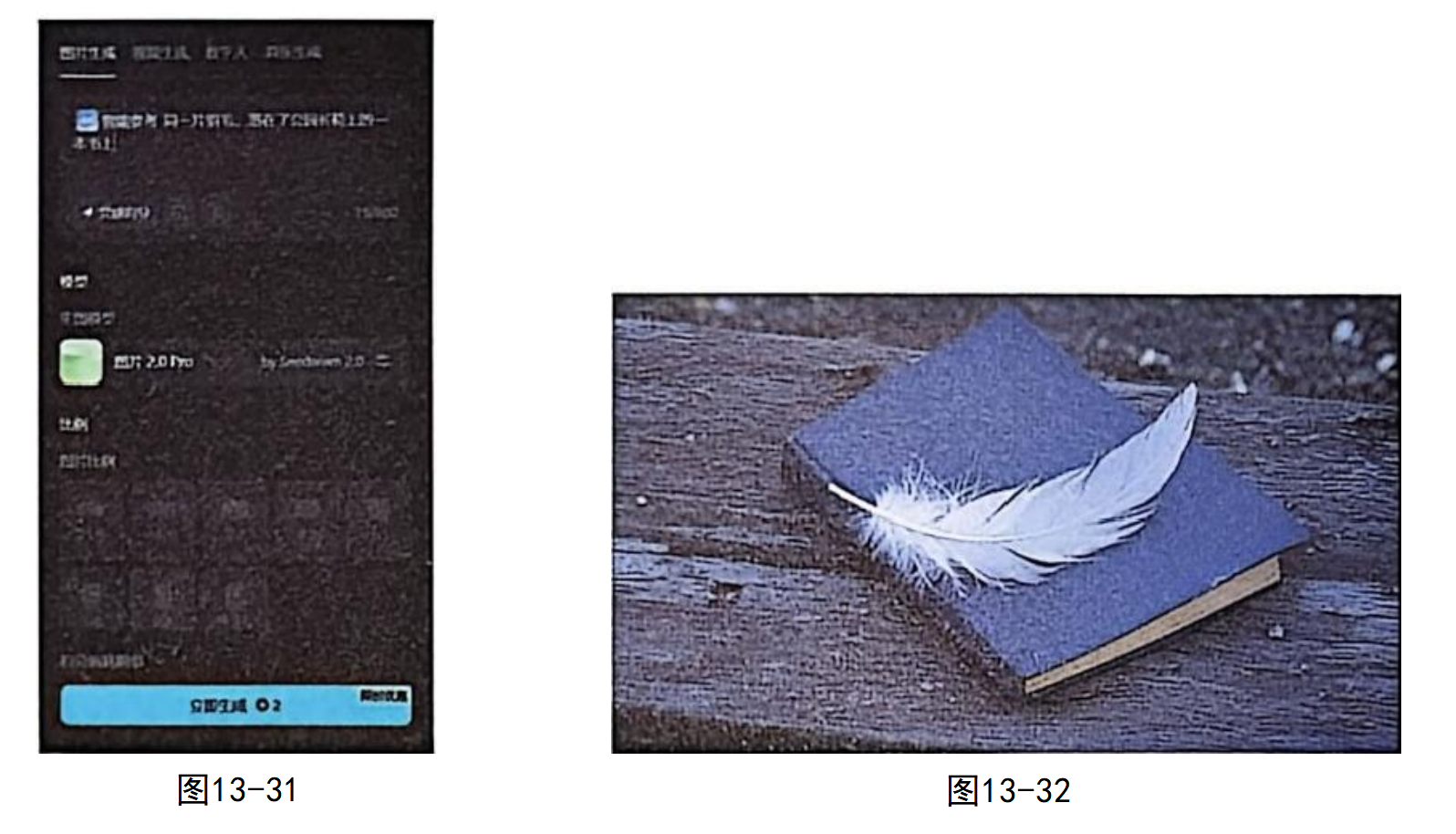

步骤04 继续返回"图片生成"页面,在描述词输入框中,单击"导入参考图"按钮,依然导入生成的第一张羽毛图片(见图13-28)作为参考。在描述词输入框中输入文字,强调新图中要生成原图的羽毛,同时描述新图的环境细节,如图13-31所示。单击"立即生成"按钮后,得到如图13-32所示的新图。

提示词模板(生成尾帧图片------书本上):

参考图中相同的白色羽毛,轻轻落在一本打开的书本上,书页泛黄,桌面有木质纹理,柔和的侧光,羽毛投下淡淡阴影。

步骤05 利用生成的图片生成视频。返回即梦AI主页,进入"视频生成"页面,单击"图片生视频"按钮,选择"视频1.2"模型(该模型支持首尾帧)。首帧图片导入图13-28,尾帧图片导入图13-30,添加描述词,以生成羽毛从天空飘落到城市上空的镜头,如图13-33所示。

提示词模板(第一段视频过渡描述):

羽毛从高空缓缓飘落,镜头跟随羽毛下降,背景从蓝天白云过渡到城市天际线,运动平稳,8秒。

步骤06 生成第二段视频。同样在"视频生成"页面中,单击"图片生视频"按钮,选择"视频1.2"模型。首帧图片导入图13-30,尾帧图片导入图13-32,添加描述词,以生成羽毛从城市上空飘落到书本上的镜头,如图13-34所示。

提示词模板(第二段视频过渡描述):

羽毛从城市高空继续向下飘落,穿过街道和窗户,最终轻轻落在书桌上的一本打开的书本上,镜头缓慢跟拍,自然光变化。

步骤07 生成第三段视频。同样在"视频生成"页面的"图片生视频"模式下,导入图13-32,添加描述词,以生成一只手入画拿走书的镜头,如图13-35所示。

提示词模板(第三段视频描述):

一只年轻的手从画面右侧入画,轻轻拿起书本,羽毛从书页上滑落,停留在桌面,镜头固定,手部动作自然。

步骤08 将得到的三段视频导入剪映,将它们拼接在一起,并根据需要添加文字、音乐和适当的效果。至此,一段完整的视频就制作好了,如图13-36所示。

步骤09 这段AI视频完全依靠文本生图片、图片生视频的方式制作完成。由于每个镜头的首帧是上一个镜头的尾帧,因此能够很连贯地组接下来。镜头开端是一片飘在天空中的羽毛,随后镜头跟随羽毛缓缓下落,经过城市高空,最终落在一本书上。随后一只手入画,拿走了书,羽毛缓缓飘落,停留在原地。最终效果如图13-37至图13-42所示。

🔎4.补充总结:图生视频三种模式的适用场景

| 模式 | 核心功能 | 适用场景 |

|---|---|---|

| 基础图片生视频 | 单图生成动态效果 | 让名画、老照片、静态插图动起来 |

| 多镜头叙事生成 | 一条提示词生成连续多个分镜 | 短剧、广告、情节类短视频 |

| 首尾帧+剪映 | 精确控制起始和结束画面 | 电影感长镜头、转场过渡、系列化创作 |

通过掌握以上三种图生视频方法,创作者可以大幅提升视频素材的制作效率,实现从静态图片到动态叙事的无缝转换。