听说 Mythos 太危险被封印?有人反手就给他 "重建" 并开源了。

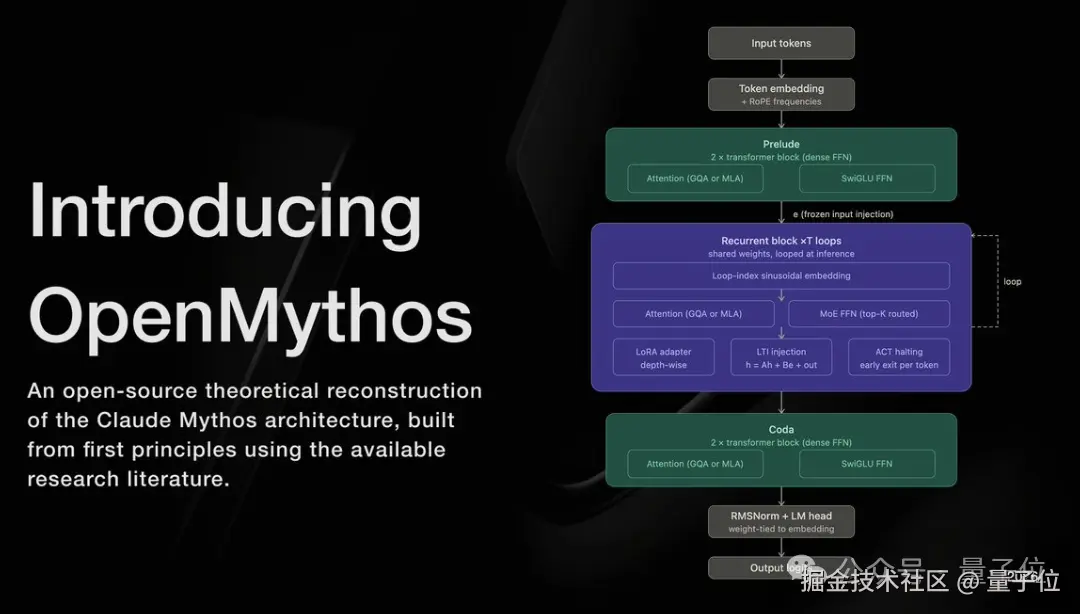

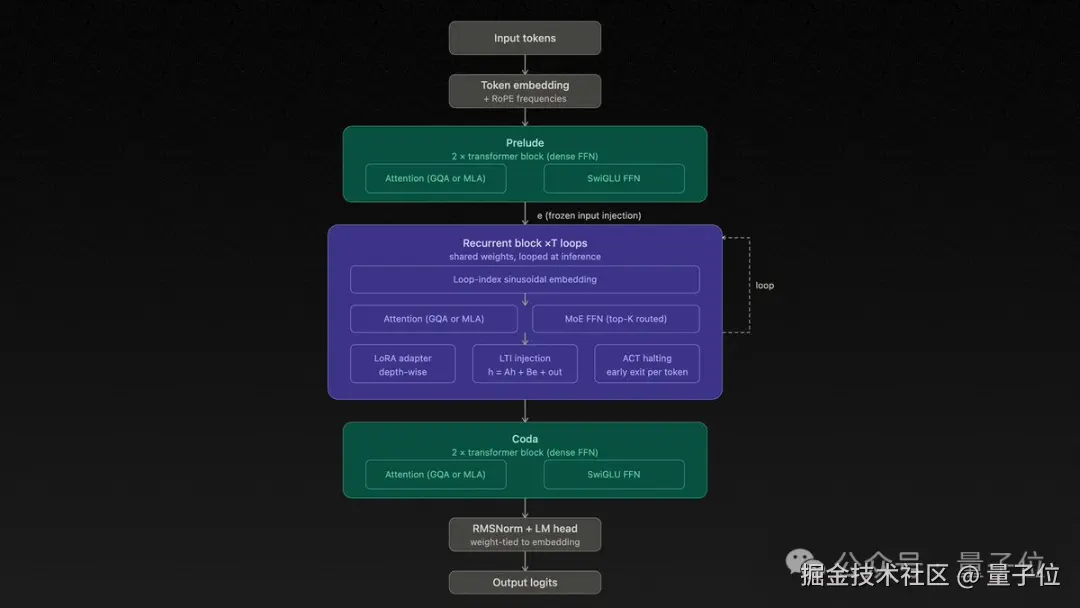

OpenMythos,整合了公开研究和目前对 Claude Mythos 架构的主流推测。

OpenMythos 实现了一个带有 MoE 路由机制的循环深度 Transformer(Recurrent-Depth Transformer ,RDT),通过跨专家的权重共享和条件计算来实现迭代深度。

已有研究证实,这种架构仅用 1 半参数,就能获得与传统模型同等的效果。

不堆参数,堆循环

把这些碎片拼在一起的人叫 Kye Gomez,22 岁,Swarms 智能体框架创始人。

他设计的 RDT 架构有三个核心点:

-

让同一组权重最多反复跑 16 遍

-

每次走不同的专家路径

-

推理全程在潜在空间完成。

三者合力,让一个问题 "想更多遍" 比堆参数更高效。

过去两年,AI 行业的标准打法是堆叠上百层不同的 Transformer 层,每层学到不同的东西,参数量直接爆炸。

RDT 不用上百层,只用几层,最多反复循环跑 16 遍,每一遍都基于前一轮的结果继续计算。

同一个东西跑 16 遍,那不是浪费算力吗?

RDT 的回答是不会重复,因为每次循环激活的是不同的 "专家"。

循环块内部用了混合专家层,MoE 路由器在每次循环中激活不同的专家子集。

MoE 的设计上借鉴了 DeepSeekMoE:大量细粒度路由专家,加少量始终在线的共享专家。

Gomez 把这套设计总结成一句话:

MoE 提供领域知识的广度,循环提供推理的深度。

广度和深度都有了,还需要一套稳定性机制保证循环不会跑飞。

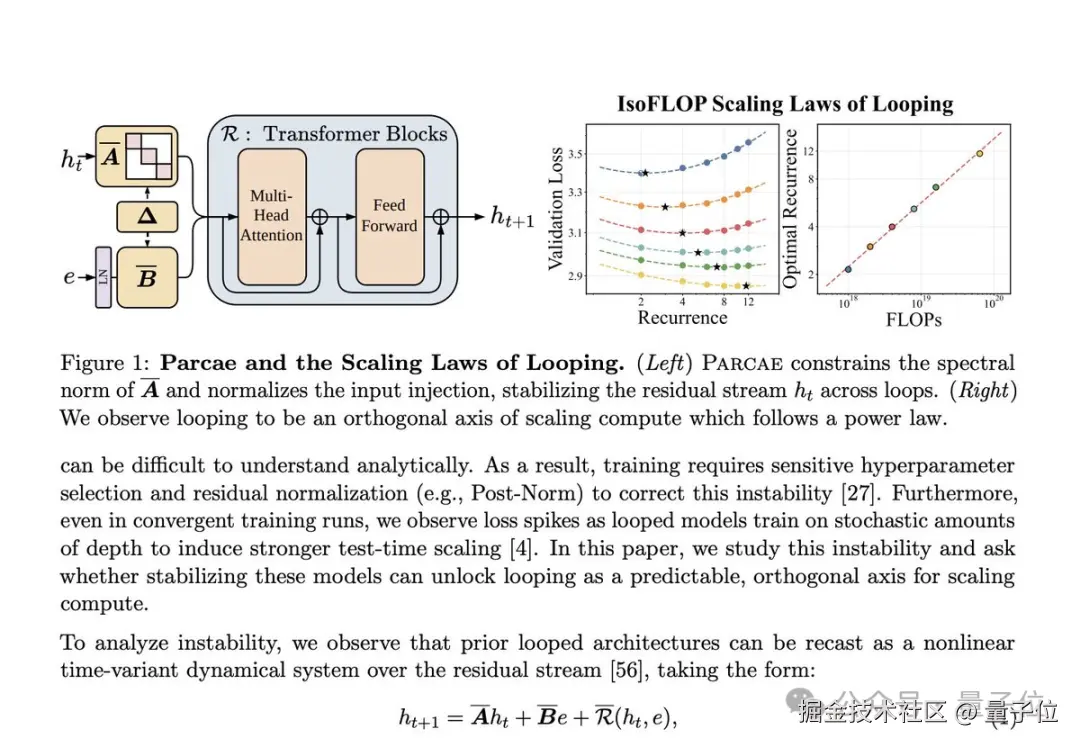

来自 UCSD 和 Together AI 的新论文 Parcae: Scaling Laws For Stable Looped Language Models 提出 LTI 稳定循环注入让每轮不发散。

实验中用 770M 参数的 RDT 追平了 1.3B 参数的标准 Transformer。

参数量少了近一半,效果一样。

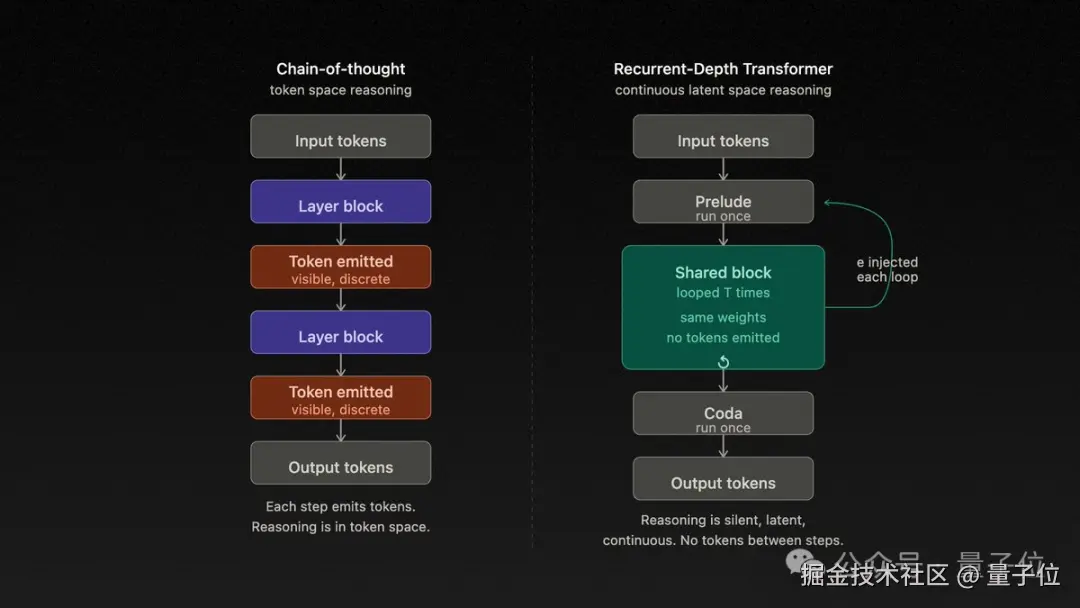

最后一块拼图是连续潜在空间推理。16 轮推理全部在 hidden state 向量中完成,不生成任何中间 token。直到最后一轮循环结束,才输出答案。

这和 Chain-of-Thought 完全不同。CoT 是 "想一步,写一步,再想一步,再写一步",中间 token 全部暴露给人类阅读。

RDT 是 "想完 16 遍才说一句话",推理过程完全内化。

Kye 还引用了俄亥俄州立大学的一篇论文,对循环 Transformer 架构做了两个关键实验。

第一个:系统性泛化。

训练时从没见过的知识组合,推理时循环 Transformer 照样能答对,标准 Transformer 直接失败。

这证明循环不是重复计算,是真正的" 更深层思考"。

第二个:深度外推。

训练时只教了 20 跳推理链,测试时直接给 30 跳。

循环 Transformer 的应对方式就是在推理时多加几轮循环,标准 Transformer 直接崩溃。

这些结果说明当前大模型在预训练中已经记住了大量事实,瓶颈在于知识组合。

它们无法将已知事实串联起来回答新颖问题。循环似乎免费解锁了这种组合能力。

如果这些结论成立,Scaling 的主流将从" 训练更大的模型" 转向 "让现有模型在推理时多想几遍"。

有了这些研究结果,Anthropic 的 Mythos 是否真的用了这套架构,似乎已经不重要了。

对循环 Transformer 的猜想已经吸引了来自学术界的大量目光。

更多理论和实验验证正在路上。

GitHub:

github.com/kyegomez/Op...

参考链接:

欢迎在评论区留下你的想法!

--- 完 ---