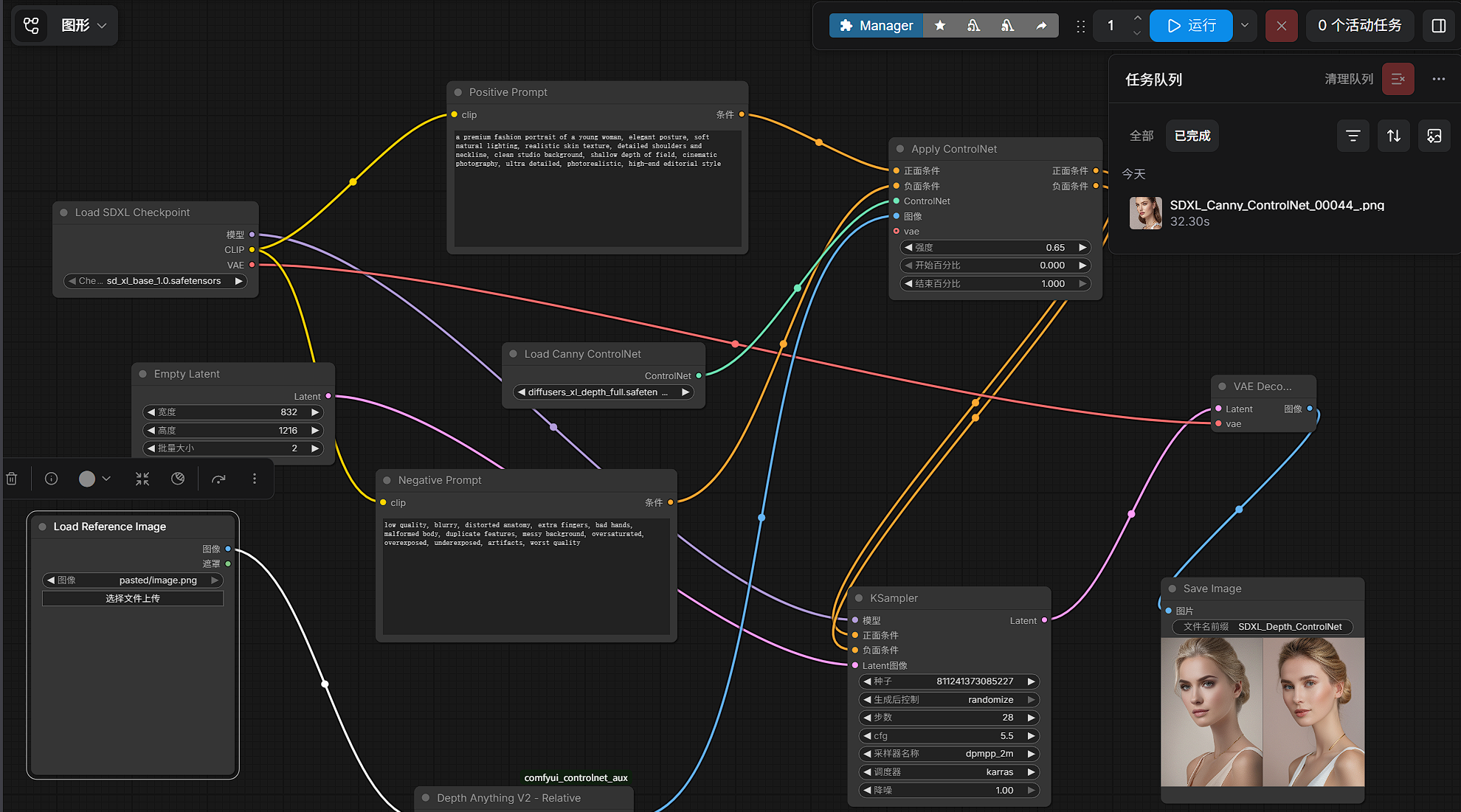

ComfyUI 实战:使用 Depth Anything V2 + ControlNet 实现高一致性人像生成

摘要

在 ComfyUI 的控制类工作流中,Depth ControlNet 是非常实用的一种方案。相比 Canny 这类偏边缘约束的方法,Depth 更擅长保留人物的空间结构、姿态轮廓和前后层次,尤其适合半身人像、摄影棚人像、时尚肖像等场景。本文结合一套实际可运行的 ComfyUI 工作流,详细记录 DepthAnythingV2Preprocessor 的安装、模型放置路径、节点连接方式、参数设置思路以及与 Canny 的差异,帮助大家快速搭建一套稳定可复现的 depth 控制流程。

工作流截图

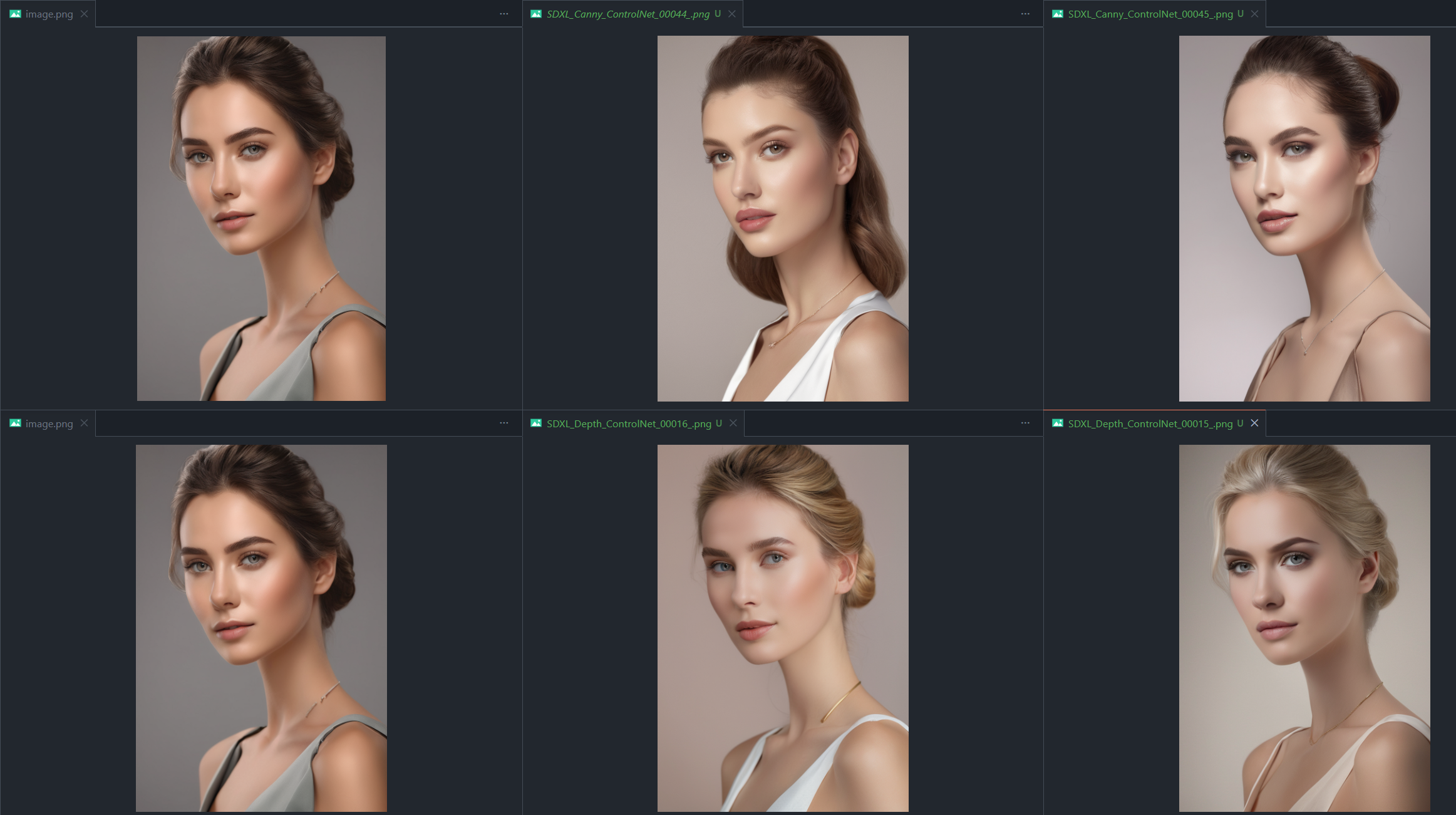

测试结果对比:上面为canny,下边为depth

一、前言

最近在用 ComfyUI 做参考图控制时,我重点测试了几种常见的 ControlNet 预处理方案,包括 Canny、Depth 等。实际体验下来,如果目标是:

- 保留原图的大致姿态和构图

- 保住人物肩颈、侧脸、半身轮廓的空间关系

- 允许服装、发型、材质、光影风格发生变化

那么 Depth ControlNet 往往比 Canny 更稳,也更自然。

因为 Canny 更偏向提取"边缘线条",而 Depth 更偏向表达"前后空间层次和体块关系"。对于写真人像来说,后者往往更重要。

本文就基于一套 ComfyUI 实战流程,完整整理一下 Depth Anything V2 在 ComfyUI 中的使用方法和调参经验。

二、本文目标

本文主要解决以下几个问题:

- ComfyUI 中如何使用

DepthAnythingV2Preprocessor depth_anything_v2_vitl.pth模型应该放在哪- Depth ControlNet 节点应该怎么接

- 为什么在人像任务里 Depth 往往比 Canny 更适合

- 参数如

strength、预处理分辨率该如何设置 - 常见报错和排查思路有哪些

三、运行环境说明

从当前目录结构来看,环境核心包括:

ComfyUIcomfyui_controlnet_auxDepth-Anything-V2

本地目录示例如下:

bash

/work/animateDiff/ComfyUI/custom_nodes/其中可以看到:

bash

ComfyUI-AnimateDiff-Evolved/

comfyui_controlnet_aux/

ComfyUI_IPAdapter_plus/

ComfyUI-Manager/

ComfyUI-VideoHelperSuite/

Depth-Anything-V2/而 Depth Anything V2 的权重文件已经放到了:

bash

/work/animateDiff/ComfyUI/custom_nodes/comfyui_controlnet_aux/ckpts/depth-anything/Depth-Anything-V2-Large/目录中模型文件为:

bash

depth_anything_v2_vitl.pth这一步非常关键。

很多人以为安装了节点仓库就能直接跑,实际上:

- 安装节点代码 ≠ 安装模型权重

- 能看到节点 ≠ 能正常推理

- 大多数报错都和模型路径或文件名有关

所以第一步一定是确认 .pth 权重已经放到预处理器能识别的位置。

四、为什么选择 Depth,而不是 Canny

在正式讲工作流之前,先说结论:

1)Canny 适合控制边缘

Canny 的核心作用是提取轮廓线和边缘信息。

它比较适合:

- 线条明显的图

- 建筑、物体、设计稿

- 希望严格跟随轮廓边界的任务

但它也有一个问题:

它更像是在控制"线",而不是控制"体积"。

2)Depth 更适合控制空间结构

Depth 预处理器会根据图像估计深度信息,也就是:

- 哪些区域更靠前

- 哪些区域更靠后

- 身体、头发、肩颈之间的空间层次如何分布

所以它在控制以下内容时会更自然:

- 人物姿态

- 肩膀和颈部转折

- 胸线与身体前后关系

- 人物与背景的分离感

对于写实人像,这些信息往往比边缘更重要。

3)Depth 对风格迁移更友好

如果你的目标是:

- 保留原始构图和姿态

- 重新生成不同服装、发型、肤感、摄影风格

那么 Depth 通常比 Canny 更合适。

因为 Canny 很容易把原图服装的边线也锁得太紧,导致"新衣服出不来";而 Depth 只保留空间关系,不会过度干扰服装样式重建。

五、ComfyUI 工作流思路

这套流程的核心结构其实非常清晰,可以概括为:

text

参考图

→ DepthAnythingV2Preprocessor

→ 生成深度图

→ ControlNetApplyAdvanced

→ 与正负提示词结合

→ KSampler 采样

→ VAE Decode

→ Save Image在这类流程中:

- Prompt 负责定义风格、光影、材质、摄影氛围

- Depth ControlNet 负责定义空间结构、轮廓姿态、前后关系

两者并不是冲突关系,而是互补关系。

六、工作流中的关键配置

从工作流配置可以看出,正向提示词使用的是偏时尚摄影、写实人像方向的描述,例如:

a premium fashion portrait of a young woman, elegant posture, soft natural lighting, realistic skin texture, detailed shoulders and neckline, clean studio background, shallow depth of field, cinematic photography, ultra detailed, photorealistic, high-end editorial style

同时,负向提示词主要用于压制常见问题,例如低质量、模糊、畸形手部、错误身体结构、背景脏乱、过曝欠曝等 。

另外,ControlNet 模型加载部分显示,使用的是深度控制模型:

text

diffusers_xl_depth_full.safetensors该模型由 ControlNetLoader 加载 。

这说明整体工作流属于比较标准的 SDXL + Depth ControlNet 结构。

七、Depth Anything V2 的接入方式

1)加载参考图

首先使用 LoadImage 节点加载参考图 。

这一步很简单,但有两个经验:

- 尽量选择主体清晰、构图明确的图片

- 背景不要过于复杂,否则深度估计可能会引入杂信息

2)使用 DepthAnythingV2Preprocessor

然后将图片送入 DepthAnythingV2Preprocessor,模型选择:

text

depth_anything_v2_vitl.pth分辨率建议先用:

text

768这个分辨率比较平衡:

- 细节比 512 更稳定

- 显存和速度又不会像 1024 那么吃资源

如果显存紧张,可以退到 512;

如果追求更高细节,可以尝试 1024。

3)将深度图接入 ControlNet

深度图输出后,接入 ControlNetApplyAdvanced,再与正负提示词一起进入采样流程。

常见推荐参数:

strength = 0.55 ~ 0.7start_percent = 0end_percent = 1

你当前使用的 0.65 就属于非常典型、也非常实用的平衡值:

- 不会太弱,导致姿态跑偏

- 也不会太强,导致图像死板

如果你的任务偏向"高一致性重绘",可以把强度提高到 0.75 左右;

如果偏向"借姿态做风格迁移",可以降到 0.45 ~ 0.55。

八、推荐参数组合

下面给几个比较实用的参数模板。

方案一:高一致性重绘

适合想尽量贴近原图姿态和结构的场景。

建议参数:

- 预处理分辨率:

768或1024 - ControlNet 强度:

0.7 ~ 0.85 - start:

0 - end:

1

特点:

- 结构最稳

- 构图保持度高

- 创造性相对较弱

方案二:结构与风格平衡

适合大多数人像生成任务。

建议参数:

- 预处理分辨率:

768 - ControlNet 强度:

0.55 ~ 0.7 - start:

0 - end:

1或0.8

特点:

- 姿态稳定

- 风格迁移空间较大

- 适合时尚肖像、摄影棚风格生成

这也是我最推荐的实战方案。

方案三:弱控制,保留参考姿态灵感

适合希望结果更自由、更有变化的场景。

建议参数:

- 预处理分辨率:

512 - ControlNet 强度:

0.35 ~ 0.5 - start:

0 - end:

0.6 ~ 0.8

特点:

- 自由度更高

- 更容易生成新风格

- 但也更容易偏离原参考图

九、为什么这套提示词和 Depth 很搭

这套正向提示词本身就是典型的高质量写真人像描述,包括:

premium fashion portraitelegant posturesoft natural lightingrealistic skin texturedetailed shoulders and necklineclean studio backgroundcinematic photographyphotorealistichigh-end editorial style

这类关键词的作用可以拆开理解:

1)姿态相关词

例如:

elegant posturedetailed shoulders and neckline

这些词会加强模型对人物体态和肩颈区域的关注,而这些正好也是 Depth 最擅长保结构的区域 。

2)摄影质感词

例如:

soft natural lightingclean studio backgroundshallow depth of fieldcinematic photography

这些词帮助模型提升整体摄影感,使结果更接近商业人像成片 。

3)写实增强词

例如:

realistic skin textureultra detailedphotorealistic

这些词帮助模型把结构控制转化为更真实、更完整的视觉结果 。

所以在 Depth 工作流里,Prompt 不要只写"一个人像",而是要明确描述:

- 姿态

- 光线

- 皮肤质感

- 摄影棚环境

- 成片风格

这样效果会明显更好。

十、模型文件路径与部署细节

这一部分是最容易踩坑的,我单独拎出来讲。

当前模型放置路径

你现在的权重路径是:

bash

/work/animateDiff/ComfyUI/custom_nodes/comfyui_controlnet_aux/ckpts/depth-anything/Depth-Anything-V2-Large/文件名:

bash

depth_anything_v2_vitl.pth这里有几个注意点。

1)文件名必须对应节点读取名称

如果节点配置里读取的是:

text

depth_anything_v2_vitl.pth那你本地文件名就不能乱改,否则节点可能直接找不到。

2)仓库目录和权重目录不是一回事

你虽然还有一个:

bash

/work/animateDiff/ComfyUI/custom_nodes/Depth-Anything-V2/但这个目录大概率只是代码仓库。

真正让节点运行的是 .pth 权重文件,而不是仓库目录本身。

所以不要把"clone 了仓库"误以为"已经配置完成"。

3)最常见的问题是路径不对

如果出现以下情况:

- 节点存在,但一运行就报错

- 界面能选模型,但推理失败

- 启动没问题,执行时报找不到文件

优先排查:

- 模型是否真的放在

comfyui_controlnet_aux的ckpts下 - 文件名是否一致

- 目录层级是否符合节点扫描规则

十一、实际使用体验总结

在这类半身人像任务中,Depth 的优势主要体现在以下几点:

1)人物朝向更稳定

不容易出现头肩关系错乱、身体角度漂移的问题。

2)肩颈轮廓更自然

尤其是在侧身、半侧身、锁骨区域,Depth 对体块的保持明显比 Canny 更自然。

3)服装变化空间更大

保住结构的同时,服装细节不会被原图边线锁死,更适合做重设计和风格替换。

4)成图更像"重拍"而不是"描边重绘"

这是我觉得最明显的一点。

Depth 生成出来的图,通常更像是在相同空间结构下重新拍了一张,而不是沿着边缘描一遍。

十二、常见问题排查

问题 1:节点能显示,但运行时报模型不存在

排查方向:

- 检查

.pth文件是否真的放到了正确目录 - 检查文件名是否完全一致

- 检查是否重启了 ComfyUI

问题 2:推理速度太慢

解决思路:

- 把预处理分辨率从

768降到512 - 减少同时运行的高分辨率节点

- 检查 GPU 显存是否被其他任务占用

问题 3:结果太死板

解决思路:

- 将

strength从0.65降到0.5 - 或将

end_percent从1调到0.8 - 同时增强 prompt 的风格描述,让模型有更多发挥空间

问题 4:结果偏离原始构图

解决思路:

- 提高

strength - 使用更高分辨率的 depth 预处理

- 减少 prompt 中过于强势、容易改构图的描述词

十三、适合使用 Depth ControlNet 的典型场景

我个人认为,以下场景特别适合优先尝试 Depth:

- 半身写真人像

- 摄影棚人像

- 时尚肖像

- 产品人物广告图

- 需要保姿态但换服装的任务

- 需要保留空间层次和镜头感的生成任务

如果你的目标是:

- 更稳的姿态控制

- 更自然的体块关系

- 更强的空间一致性

那么 Depth 基本都值得先试一轮。

十四、总结

本文基于 ComfyUI 的一套实际工作流,整理了 Depth Anything V2 + ControlNet 的接入方法和使用经验。整体来看,这套方案最大的价值在于:

- 结构控制强

- 人像适配度高

- 比 Canny 更重空间层次

- 适合高质量写实生成

- 适合风格迁移与高一致性重绘并存的场景

从工作流配置来看,这套方案采用了高质量写实风格的正向提示词 ,并通过深度控制模型 diffusers_xl_depth_full.safetensors 实现结构约束 。实际应用中,只要把 Depth Anything V2 的权重路径配置正确,再搭配合适的 ControlNet 强度,就能获得非常稳定的结果。

一句话总结就是:

如果你想让 ComfyUI 生成结果既保姿态、又保空间感,同时还保留足够的风格变化空间,那么 Depth ControlNet 是非常值得长期使用的一类控制方案。

参考配置摘录

正向提示词示例

text

a premium fashion portrait of a young woman, elegant posture, soft natural lighting, realistic skin texture, detailed shoulders and neckline, clean studio background, shallow depth of field, cinematic photography, ultra detailed, photorealistic, high-end editorial style负向提示词示例

text

low quality, blurry, distorted anatomy, extra fingers, bad hands, malformed body, duplicate features, messy background, oversaturated, overexposed, underexposed, artifacts, worst qualityControlNet 模型

text

diffusers_xl_depth_full.safetensors