1. 背景

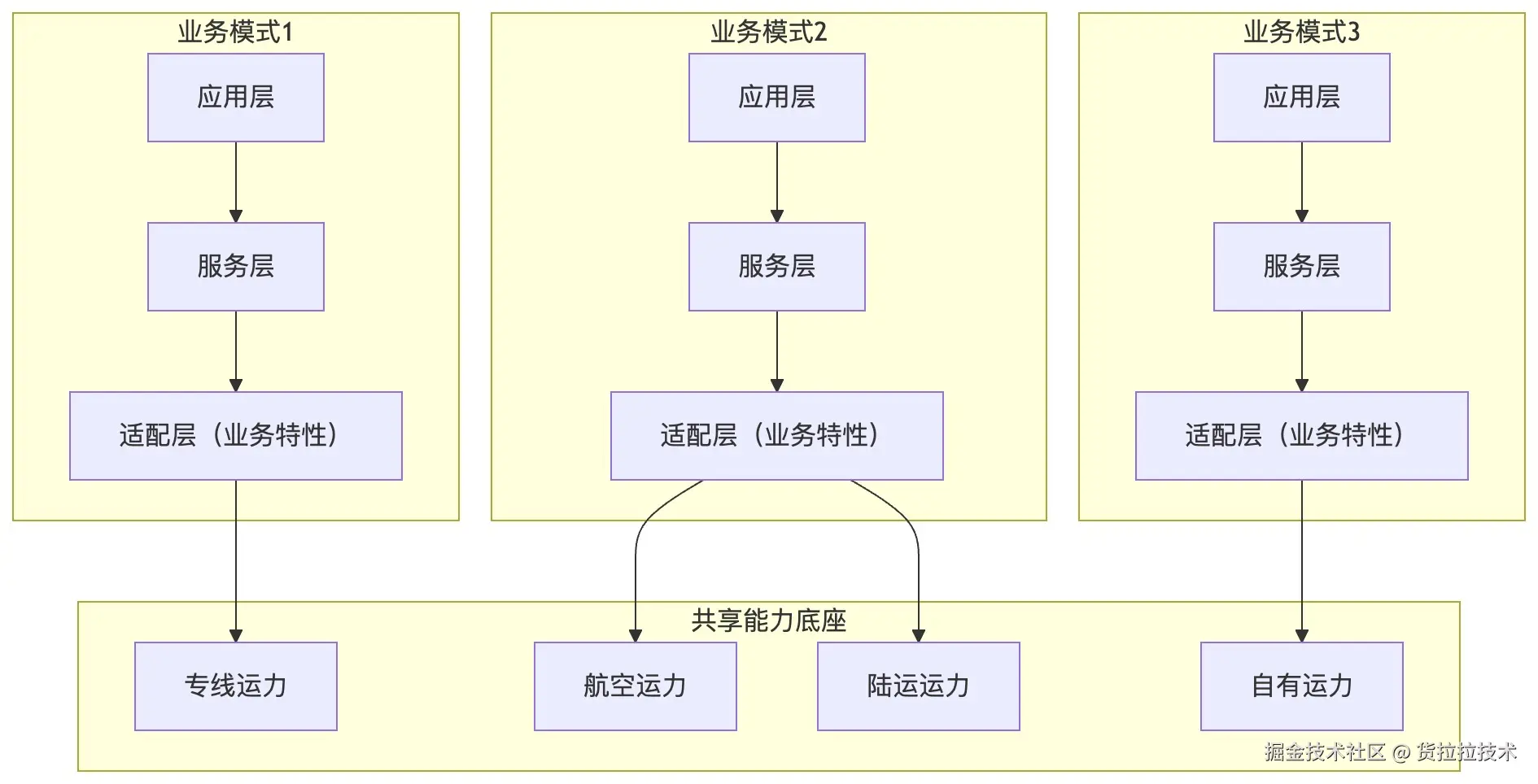

随着企业物流服务能力不断拓展,客户运输需求日益多样化,为了服务不同类型客户,系统往往会不断新增业务模式。早期为了快速支撑业务探索,新增一个模式就复制一套系统并定制,系统采用"烟囱式"设计,随着业务模式持续增长,这种模式迭代就会出现"开发慢、维护重、风险高"等问题。

1.1 现状

为了在不影响存量业务的前提下快速上线新模式,常见做法是"复制一套再定制一套",短期交付快,但长期会形成多个相互独立、重复建设的业务烟囱。

1.2 问题

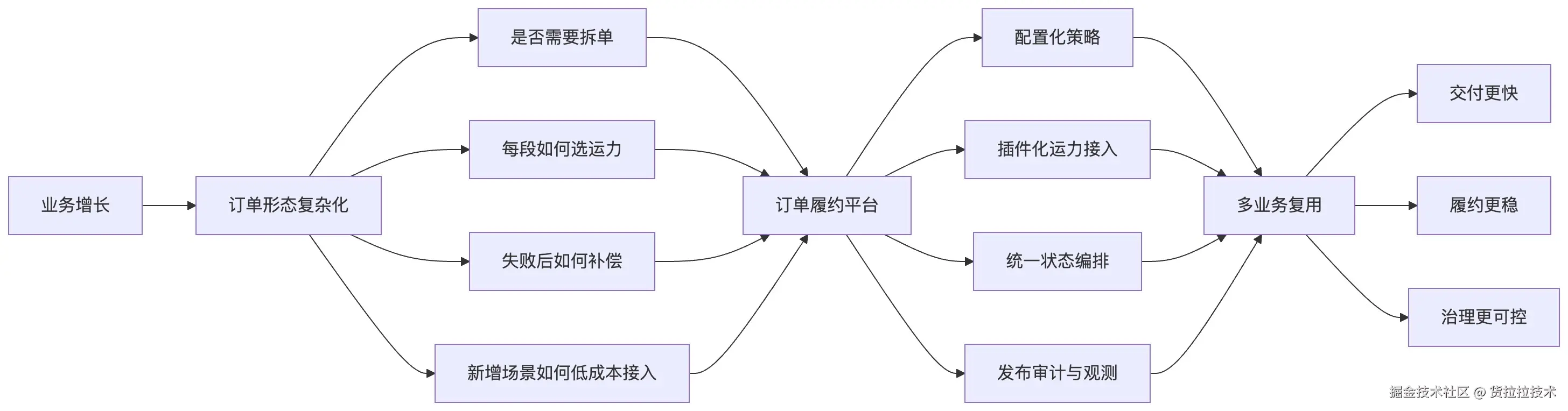

烟囱式模式会带来三个直接后果:功能复用率低、跨模式协同困难、变更成本持续上升。实践中,新增一个业务模式的交付周期往往超过 20 天,难以满足"业务即需即用"的目标。

烟囱式架构的三大痛点:

-

系统膨胀:同类能力在不同模式重复实现

-

迭代效率低:新需求上线需要跨多个烟囱改造

-

维护成本高:问题定位链路长,改动影响面难评估

因此,系统面临的关键问题已经不是"把单派给谁",而是如何在复杂场景下稳定完成订单拆分、运力选择与过程编排。

平台化改造目标:

-

一套从业务问题到技术落地的演进框架,可复用于复杂履约或编排系统建设

-

一组可直接迁移的核心能力拆分方式:拆分、路由、编排、补偿、治理

-

一套控制高频变更风险的方法:插件隔离 + 状态机编排 + 发布治理闭环

2. 整体架构

形成以上问题的根因不是缺少功能,而是缺失统一模型和清晰的边界,业务增长速度与系统抽象能力之间的落差,使得每次新增模式都变成一次"从复制到定制"的重复劳动。破局的关键在于平台化:用统一的模型和分层架构,将"一业务一系统"的烟囱模式,转变为"多业务共平台"的复用模式。

本节将从三个维度展开:首先明确平台需要提供哪些核心能力,其次说明如何通过架构升级实现能力的独立演进与灵活组合,最后呈现这些能力在系统中的分层落地形态。

2.1 平台能力

核心能力:解决"从订单到完成"的全链路组织

2.2 架构升级

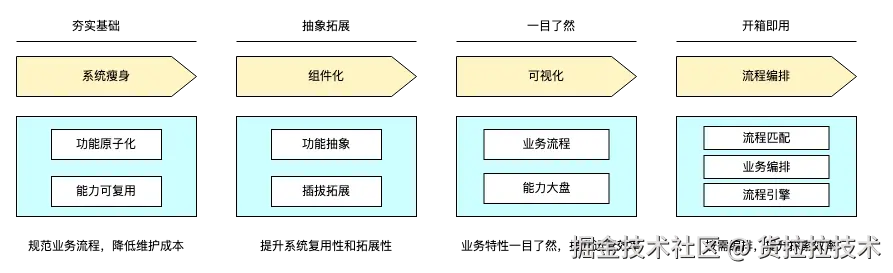

从平台能力到可落地的系统,关键在于让每个能力既能独立演进,又能灵活组合。架构升级遵循"能力原子化 + 扩展可插拔 + 运行可观测"的核心思路:

-

能力原子化:将拆分、路由、编排、补偿拆成可独立演进的能力。各能力通过标准接口对外暴露,业务层可按需组合,避免烟囱式重复建设。

-

可插拔扩展:新增运力通过插件接入,不侵入主链路。

-

可视化建设:让策略配置、业务流程、能力图谱等逻辑清晰明了。通过配置化替代硬编码,策略调整可实时生效,无需重启服务。

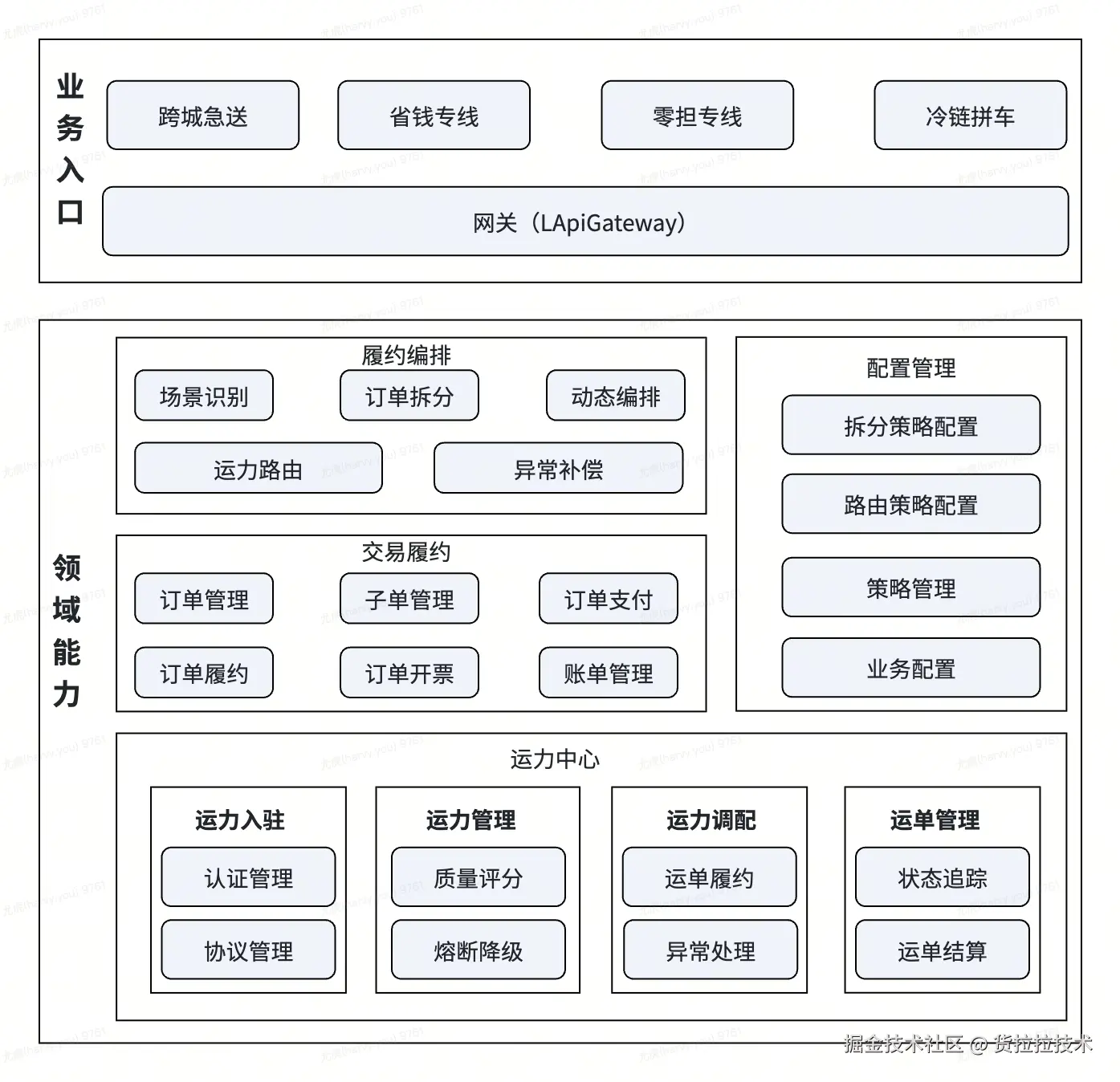

2.3 系统架构

基于上述能力定义与架构升级策略,系统架构的分层设计遵循"向上适配差异、向下屏蔽变化、向内沉淀核心"的原则,形成清晰的边界与职责划分。具体而言:

-

向上承接多业务入口的差异化履约诉求

-

向下屏蔽多种运力的协议与能力差异

-

向内沉淀交易履约核心能力和通用能力

在明确了平台的整体架构与定位后,下面我们将从设计原则、核心模型到具体流程,逐一展开详细设计的讨论。

3. 详细设计

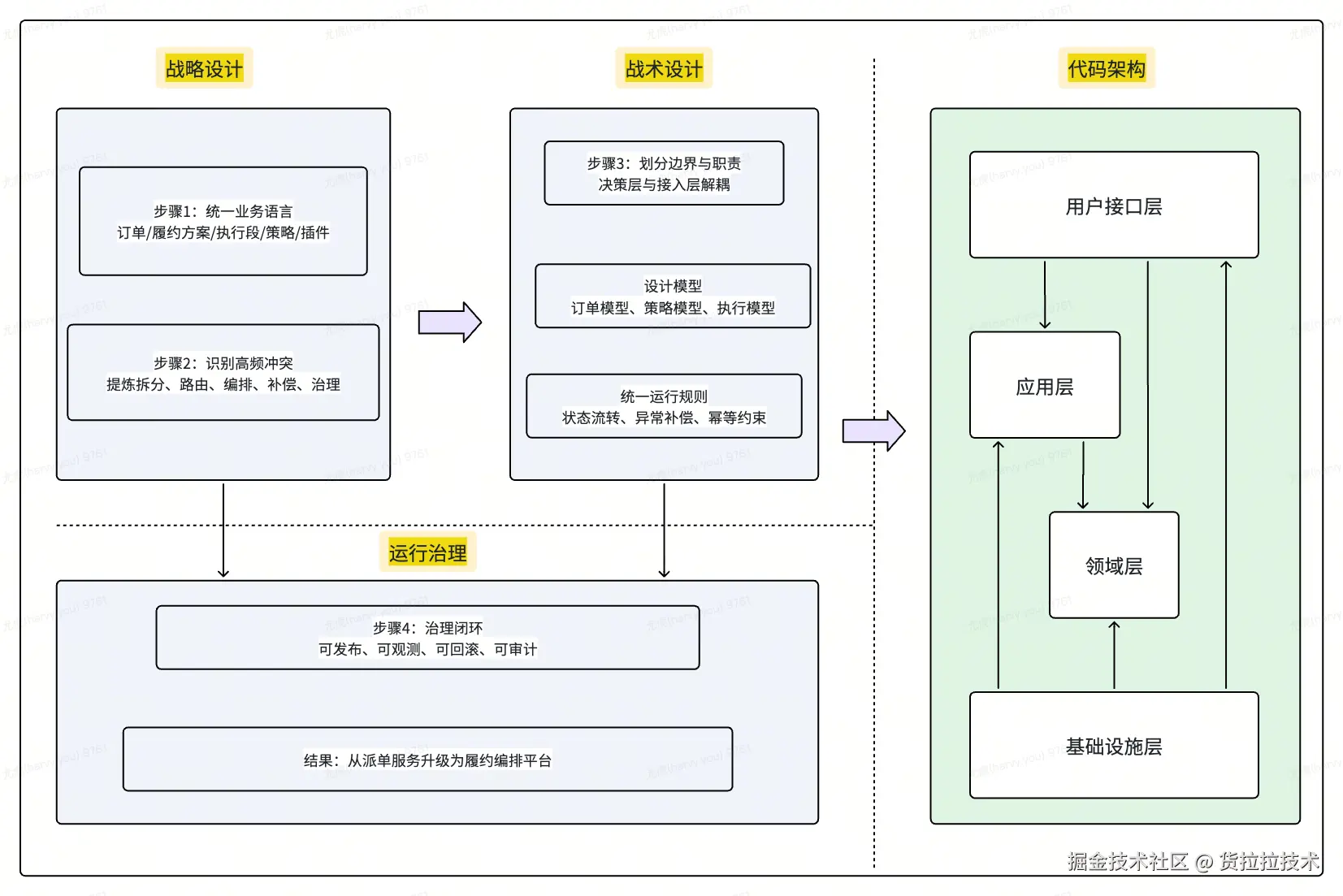

从业务认知到技术落地,详细设计遵循四层递进的方法论:

-

战略设计:先统一业务语言,识别领域边界与核心概念,明确"平台要管哪些事、各事之间的协作关系"

-

战术设计:将战略层的领域抽象落地为可配置、可组合的模型,明确"每件事怎么做决策、模型之间如何协作"

-

稳定性:通过状态编排、配置分离、发布治理保障运行态的稳定可控,明确"变更怎么不出问题"

-

代码架构:将上述设计落地为可插拔的代码契约与接入机制,明确"怎么接、怎么隔离、怎么扩展"

3.1 领域模型设计

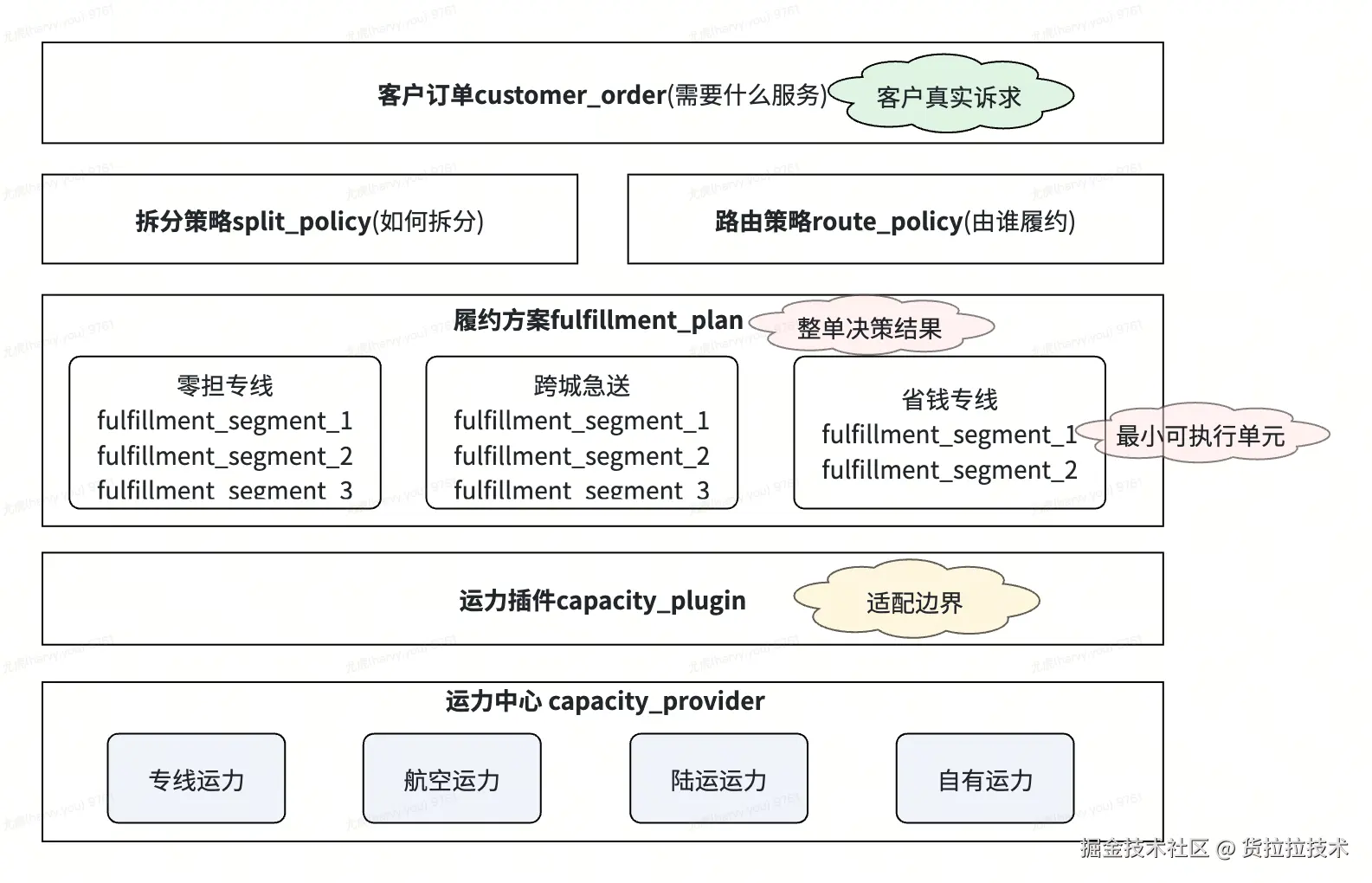

3.1.1 领域抽象

领域抽象的核心是将业务语言转化为可落地的技术模型,平台将履约过程抽象为五大核心实体:

-

客户订单(Customer Order)作为业务入口,承载客户的原始运输需求;

-

履约方案(Fulfillment Plan)作为编排单元,描述整单的拆分策略与执行路径;

-

履约段(Fulfillment Segment)作为执行单元,代表一段独立的运输任务;

-

运力供应方(Capacity Provider)和运力插件(Capacity Plugin)作为执行载体,屏蔽下游运力的协议差异。

此外,拆分策略(Split Policy)和路由策略(Route Policy)作为决策规则,驱动方案的生成与运力的选择。

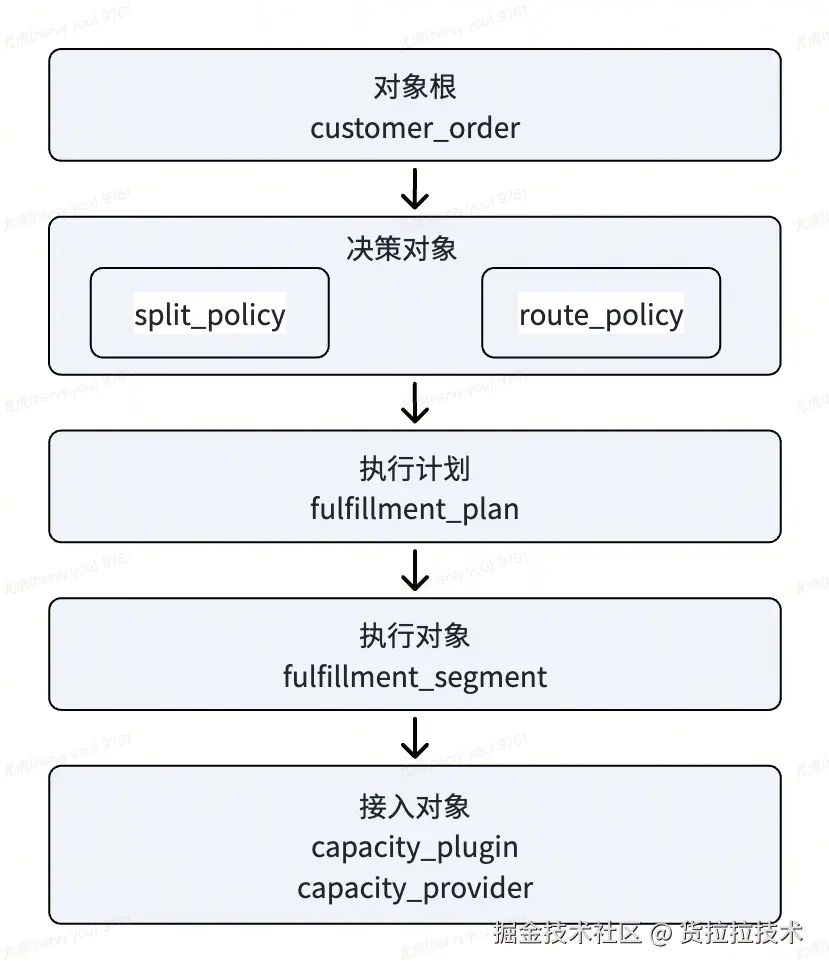

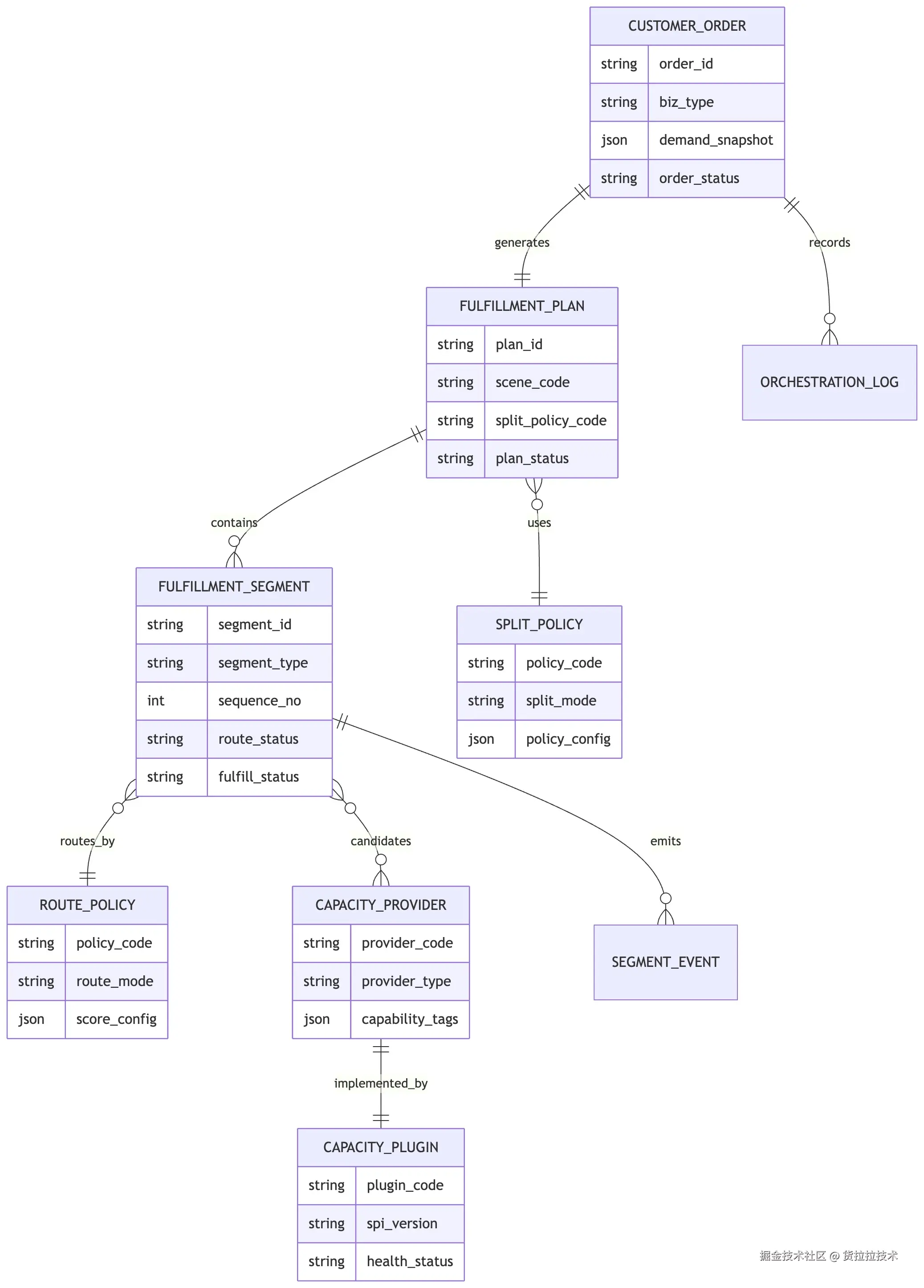

3.1.2 领域关系

领域关系定义了各对象之间的协作模式与数据流向:一个客户订单触发生成一个履约方案,方案包含多个履约段,段与段之间通过依赖关系形成顺序或并行的执行拓扑。

每个履约段通过路由策略匹配候选运力,最终由选定的运力插件完成实际执行;履约过程中产生的事件被记录为编排日志,形成可追溯的审计链。

这套关系模型确保了"拆分决策、路由选择、状态推进"三个核心环节的解耦------策略变更不影响模型结构,模型结构不限制执行方式,保证了业务复杂度的可控与扩展的灵活性。

3.1.3 领域模型关系

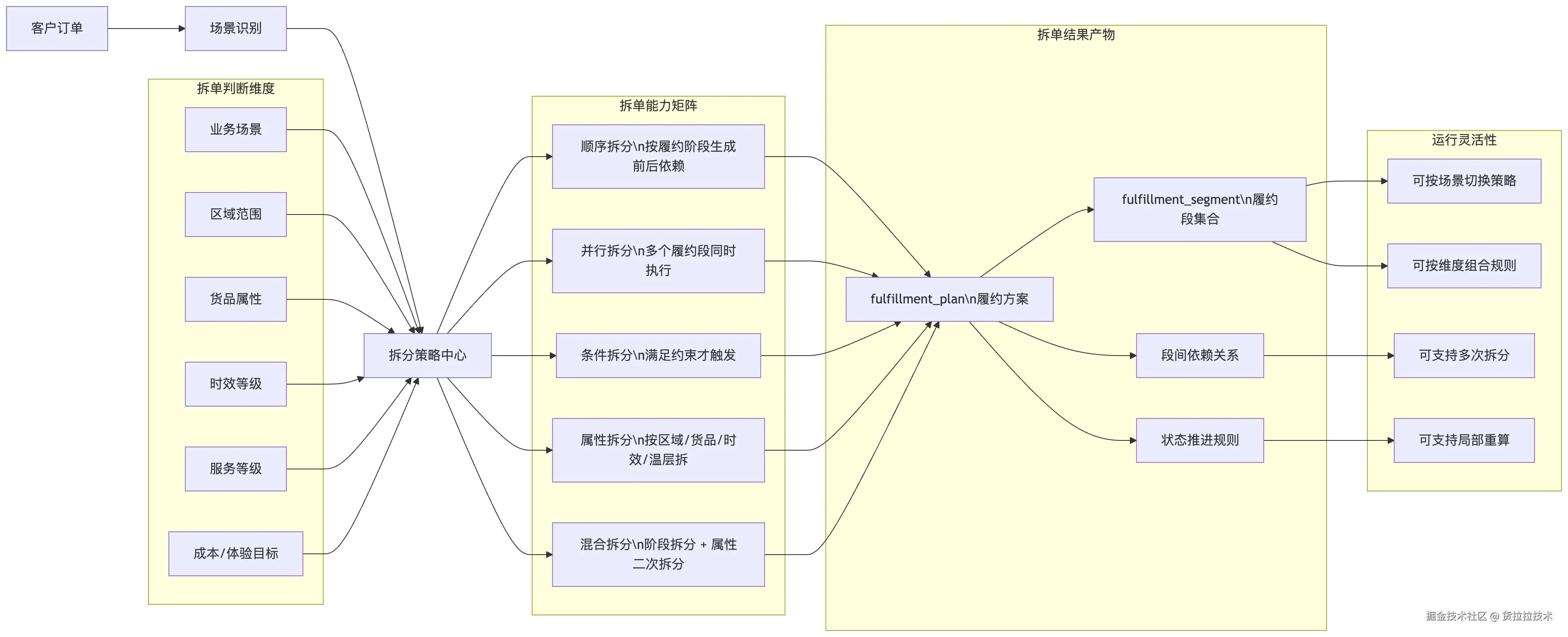

3.2 拆分策略设计

拆分不是一次切分动作,而是一套可组合、可重算、可治理的策略系统。

具体执行步骤:

-

策略识别:识别业务场景并按多维规则完成策略求值。

-

方案编排:生成整单方案、执行段与段间依赖,并按依赖推进执行。

-

异常重算:局部失败时仅重算受影响执行段,避免整单重算。

基于上述拆分策略矩阵,以下通过一段简化的伪代码,展示混合拆分策略的核心实现思路:

示例:混合拆分执行伪代码

scss

// 1) 初始化"整单履约方案",后续所有拆分结果都会挂在这个 plan 上

Plan plan = planFactory.newPlan(order);

// 2) 先按"阶段"做第一层拆分(例如:揽收 -> 干线 -> 末端)

List<Segment> stageSegments = splitByStages(order, policy.stages());

// 3) 对每个阶段段,再按属性规则做第二层拆分(混合拆分的核心)

for (Segment stage : stageSegments) {

// 属性规则示例:按服务等级、区域类型继续细分

List<Segment> attrSegments = splitByAttributes(stage, policy.attributeRules());

// 如果属性规则未命中,就保留原阶段段;命中则写入细分后的子段

plan.addAll(attrSegments.isEmpty() ? List.of(stage) : attrSegments);

}

// 4) 根据兜底模式构建段间依赖关系(顺序/并行),用于后续编排执行

plan.buildDependencies(policy.fallbackMode());

// 5) 返回可执行的履约方案(含 segment 列表 + 依赖关系)3.3 核心流程设计

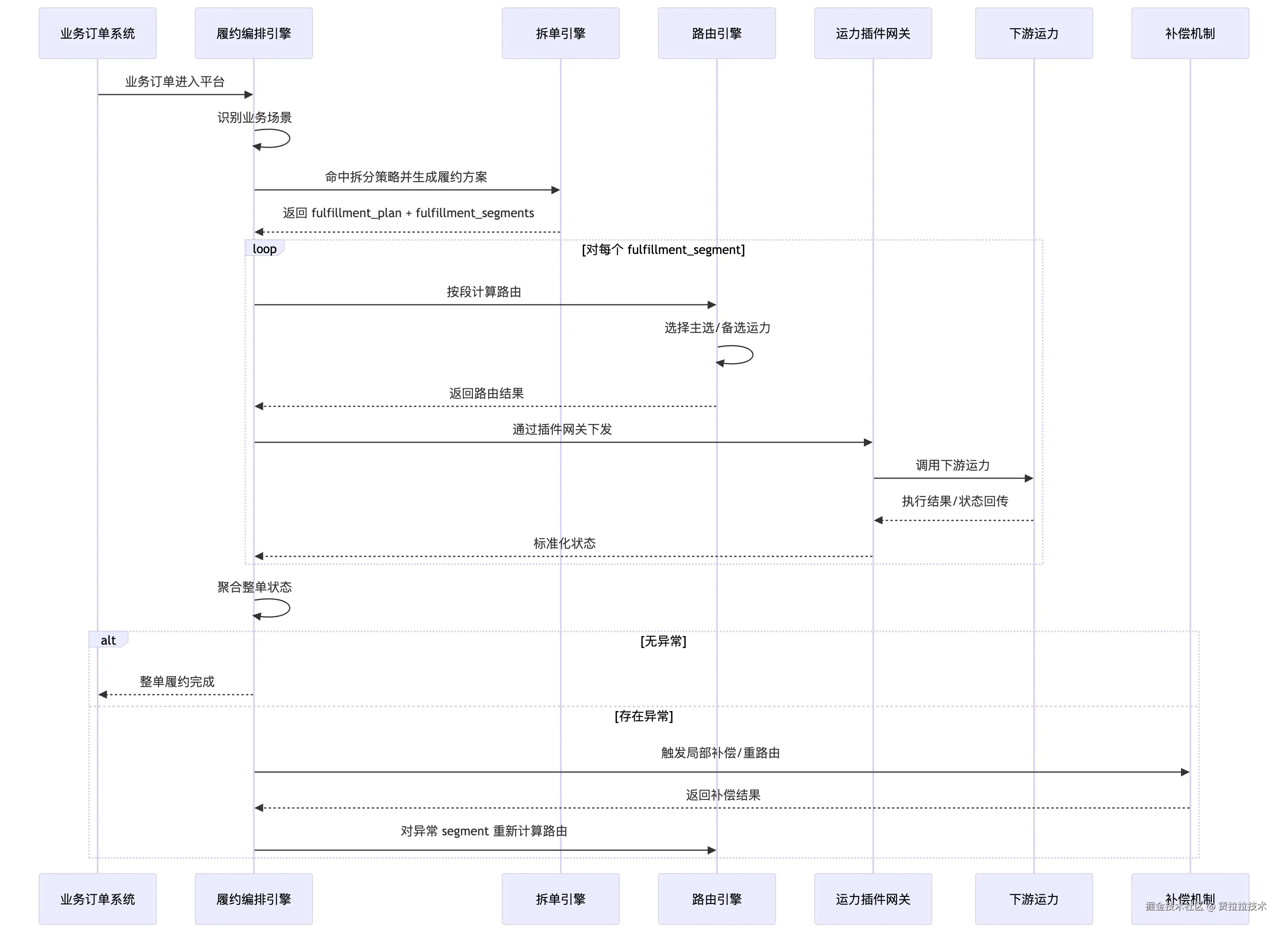

3.3.1 业务主流程全景

-

流程定义:接收订单并固化需求快照,完成订单拆分并为每段选择主备运力。

-

分段执行:按段下发任务到外部运力,并标准化执行状态。

-

状态收口:汇总分段进度生成整单状态,对异常段执行重试、改派或终止。

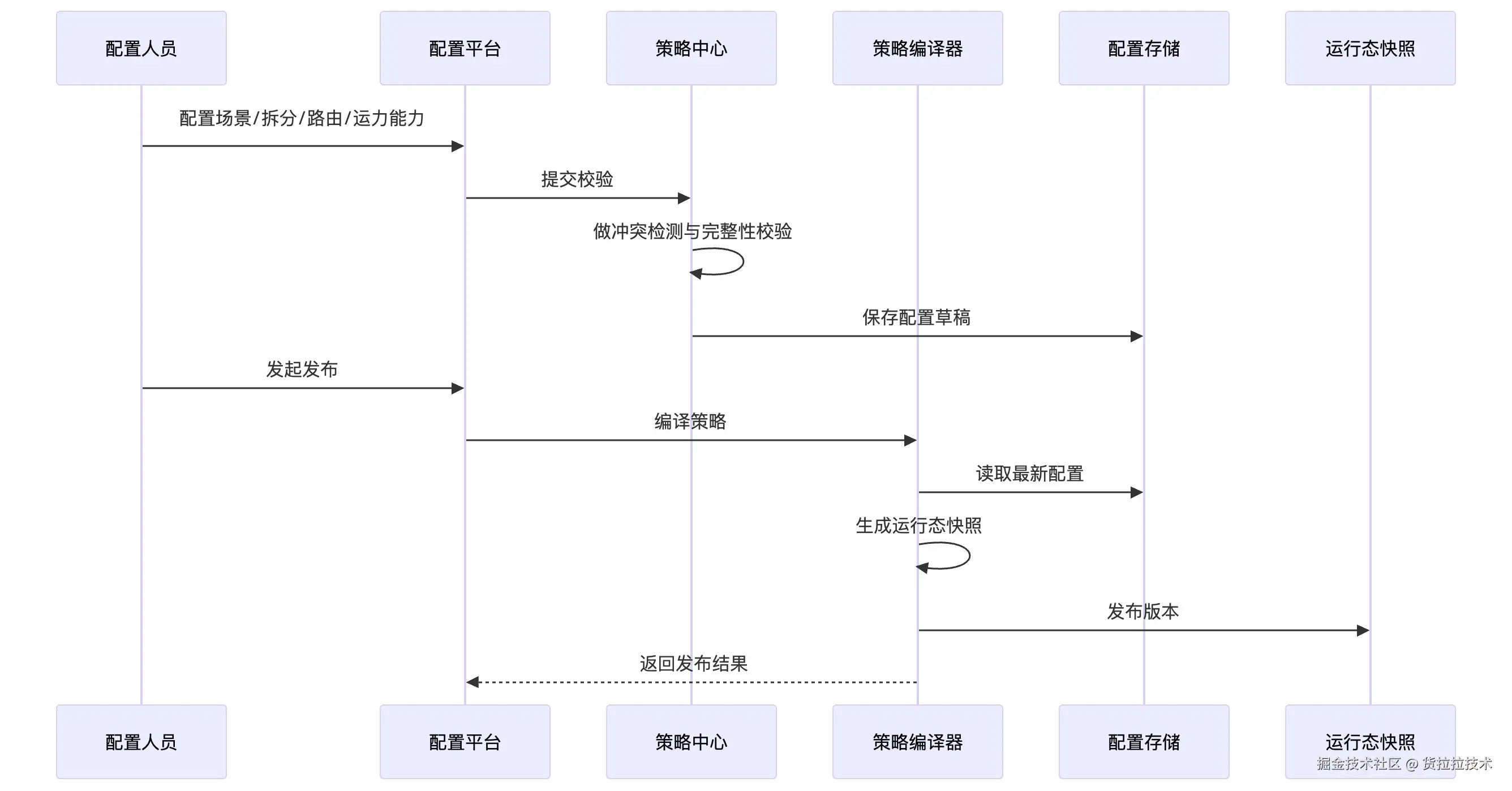

3.3.2 配置管理流程

将'人维护的保存态配置'与'系统执行的运行态快照'进行分离。

-

人维护的是保存态配置。

-

系统执行的是编译后的运行态快照。

-

发布阶段必须做冲突检测和完整性校验。

-

运行快照具备版本化能力,便于回滚和审计。

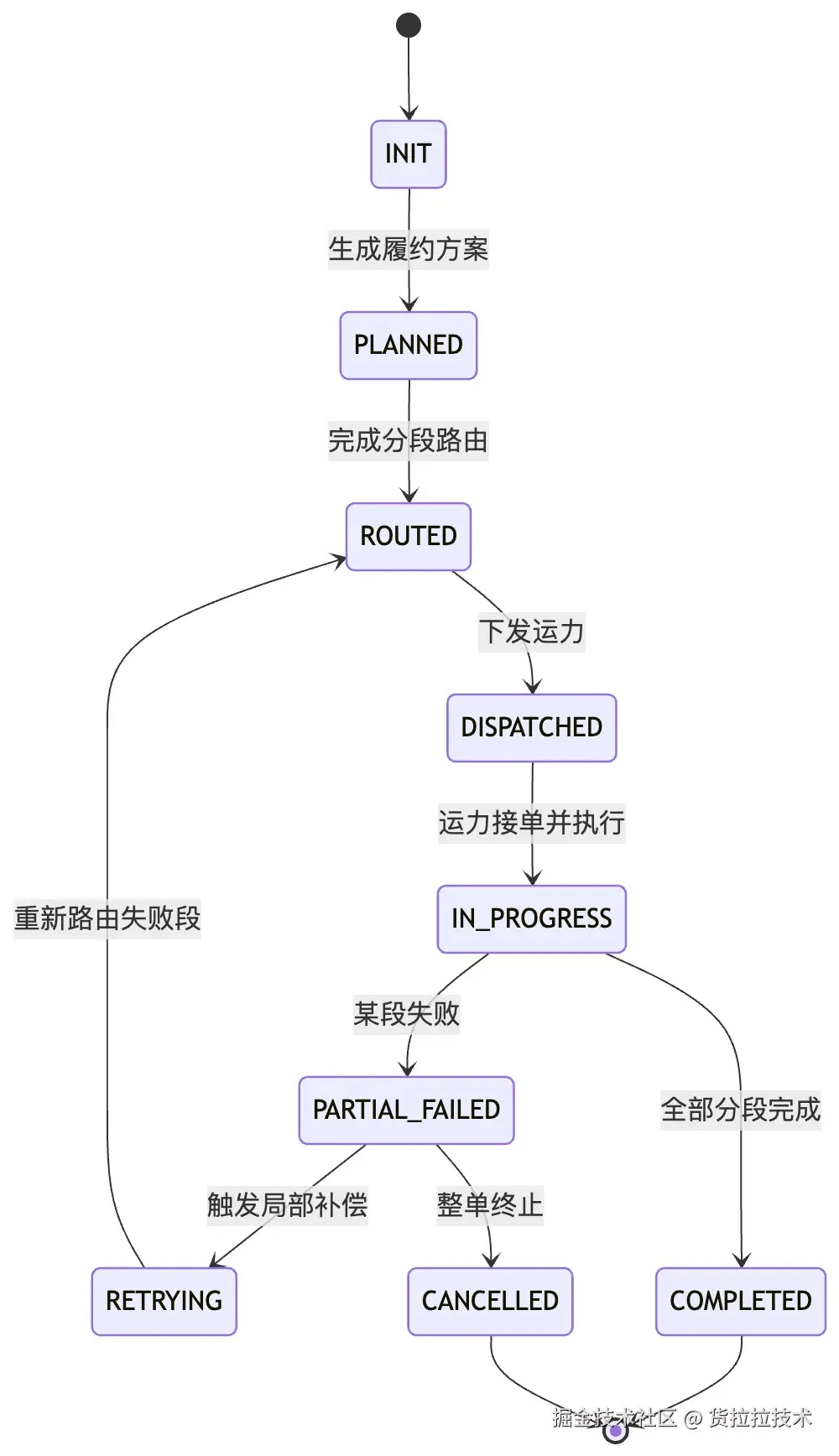

3.3.3 状态编排流程

状态机的价值不在"状态数量",而在"失败处理与聚合规则"。

状态设计两个关键原则:

-

失败优先局部补偿,而不是默认整单回滚。

-

父订单状态由子段聚合,不由单点事件直接改写。

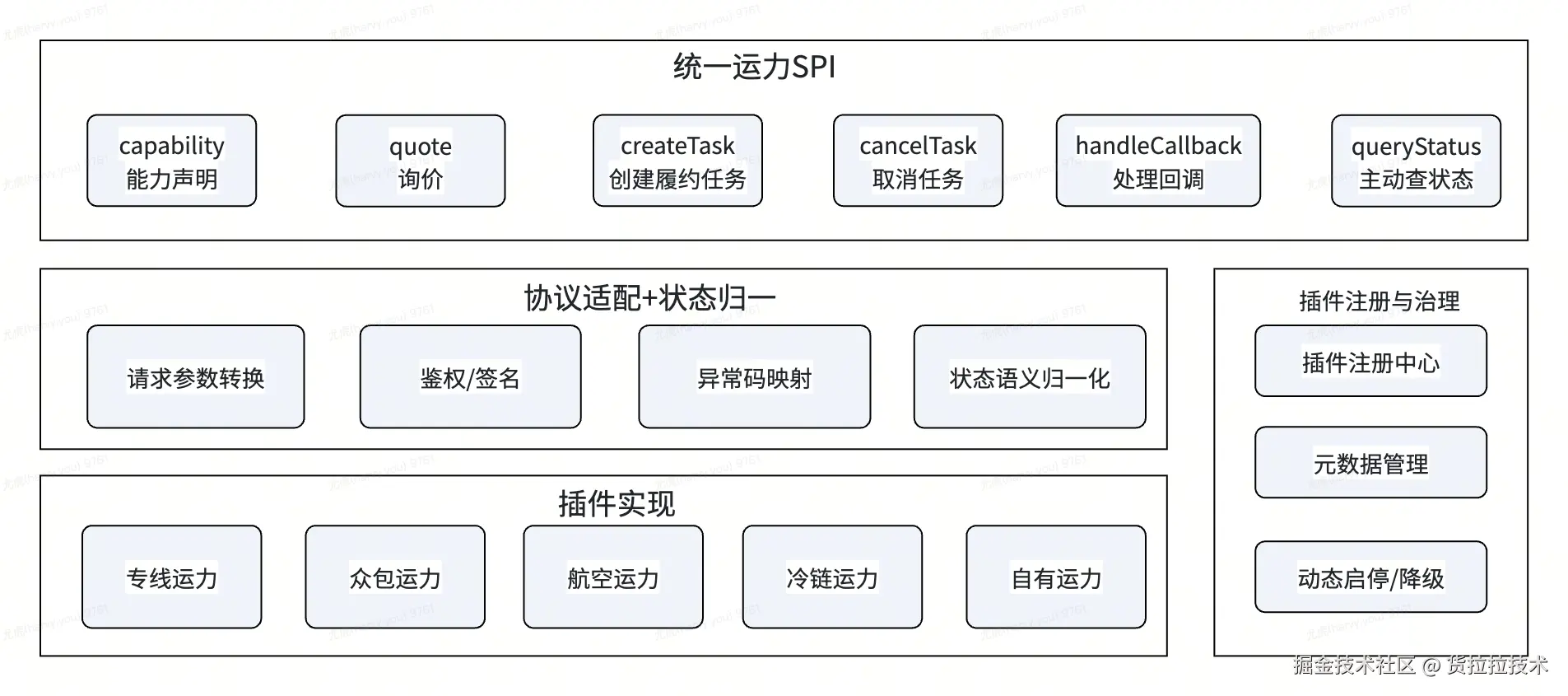

3.4 插拔式运力设计

插件化的核心价值是"隔离变化",实现新增运力不改核心流程。

插件化落地步骤:

-

统一契约:平台定义统一 SPI 和标准返回语义,编排层只依赖标准接口。

-

插件治理:注册中心统一管理插件版本、健康状态、灰度放量与启停。

-

边界隔离:各运力插件负责协议转换与状态归一,新增或替换运力仅变更插件层。

示例:统一 SPI(简化接口)

scss

public interface CapacityPlugin {

// 查询某运力是否支持当前履约请求(能力校验)

CapabilityResult capability(CapabilityRequest request);

// 获取报价或成本预估,供路由策略做打分排序

QuoteResult quote(QuoteRequest request);

// 在下游运力系统创建执行任务(真实下发动作)

CreateTaskResult createTask(CreateTaskRequest request);

// 取消已创建任务(超时、改派、用户取消等场景)

CancelTaskResult cancelTask(CancelTaskRequest request);

// 主动查询任务最新状态(回调丢失或补偿回查时使用)

QueryStatusResult queryStatus(QueryStatusRequest request);

// 处理下游异步回调并返回 ACK(要求幂等,允许重复回调)

CallbackAck handleCallback(ProviderCallback callback);

}以上从领域模型、拆分策略、核心流程到插拔式运力四个维度,完成了平台详细设计的展开。模型定义了"是什么",策略定义了"怎么拆",流程定义了"怎么跑",插件定义了"怎么接",四者共同构成了"拆分-路由-编排-补偿"的完整执行链。下面通过三个典型业务场景,验证这套设计在不同业务形态下的通用性。

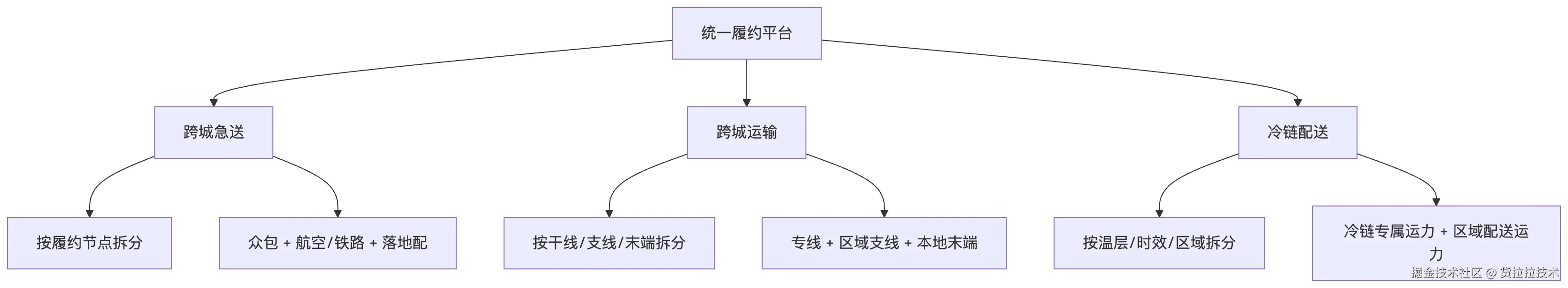

4. 场景验证与效果

不同业务看起来差异很大,但核心都可映射到"拆分 -> 路由 -> 编排"的统一流程。

三个典型场景从不同维度验证了平台设计的通用性:跨城急送验证了顺序拆分+时效路由的能力,跨城运输验证了混合拆分+成本路由的多目标平衡能力,冷链配送验证了属性拆分+合规路由的约束满足能力,以下从量化指标角度,进一步衡量平台化的实际收益。

-

订单拆分从代码逻辑升级为平台策略,业务上线效率提升。

-

多运力接入从改主流程升级为插件,核心稳定性提升。

-

多业务复用同一能力底座,研发与维护成本下降。

指标

改造前

改造后

变化

新场景接入周期

30-40 人天

10-20 人天

缩短约 50%

新增运力对核心流程改动次数

5-8 处/次

0-1 处/次

降低约 80%

异常链路平均恢复时长(MTTR)

30-45 分钟

10-15 分钟

缩短约 65%

路由命中可解释率

<60%

>90%

提升约 30%

5. 未来规划

-

智能化策略推荐:基于历史数据自动学习最优拆分与路由策略,降低人工配置成本

-

更细粒度的资源调度:支持按车辆类型、司机评分、实时位置等维度的动态调度

-

跨业务线能力复用:将平台能力抽象为可插拔的微服务组件,支持其他业务线快速接入

总结 :从烟囱式架构到平台化设计的演进,不仅是技术架构的升级,更是研发协作模式和业务响应能力的重塑。通过统一抽象、配置化策略、插件化接入、状态编排的组合,我们构建了一套可持续演进的技术底座,为复杂多变的履约场景提供了稳定、灵活、可解释的解决方案。