1. 抓眼球👀

哈哈哈😄,我承认是在抓眼球。只有两个模型的测试,没有测试其他尺寸的模型了。

2. 前言

最近出了新的量化方法,APEX,看着似乎小了许多,并且据说性能不错。我很想知道性能有多好。

2.1 测试环境,结果可复现

测试环境:2026年4月20日 左右 的 llama-cpp 主线版本,自己编译

CUDA 13.1

incus Debian 系统容器

RTX 3090 + RTX 4070 ti super

驱动版本:595.58.03

3. 快速

没想一测,就 发现 UD_XL 量化的问题,发现一个任务能力明显受到损害。APEX 能力保留更好。

并且 APEX 速度更快,110 token/s

UD-Q6_K_XL 速度大约为 98 token/s

APEX 相对还更小,大小为 23.9G

UD-Q6_K_XL 大小为 29.7G

对于没有出问题的 第一题和第二题,两个模型都答得很好。思考的长度也比较接近,但是 似乎 APEX 的回答要稍微长一点点。

4. 测试方法

测试方法比较简单,我让 DeepSeek 专家模式 出3道题,专门用来测试量化模型的回答,然后再让 DeepSeek 分析答案,看看有没有问题。

4.1 测试题目

题目1

甲、乙、丙、丁四人在讨论一本书的归属。

甲说:这本书要么是乙的,要么是丁的。

乙说:这本书不是我的,也不是丙的。

丙说:这本书只能是甲的。

丁说:甲和丙都在说谎。

已知只有一个人说了真话,且书属于四人中的某一个。

请问书是谁的?请一步步写出推理过程。测试目标

考察重点:

逻辑链长度:需要保持4个条件同时激活并进行真值表推演。

抗干扰能力:量化模型容易在(A xor B)这类复合逻辑中因置信度下降而选错分支。

自洽性:观察最后结论是否与前面的推理条件矛盾(量化模型有时会出现"推着推着忘了前提"的情况)。题目2

一个边长为1的正方形,以它的四个顶点为圆心,以1为半径画四个四分之一圆,这些圆弧在正方形内部围成一个封闭的区域(类似镜片形状)。

请计算这个封闭区域的精确面积,结果用带根号和π的表达式表示(例如 aπ - b√c 的形式),不要使用近似小数。测试目标

考察重点:

数值表示精度:量化模型(尤其是INT4)在处理√3、π这类符号与具体算术运算时,容易因激活值范围压缩产生微小扰动,可能导致最后系数出错。

中间量保留:此题需要计算两个弓形面积并利用对称性,中间涉及π/3和√3/4,量化后的KV Cache或注意力分数若丢失细节,常表现为漏掉√3项。题目3

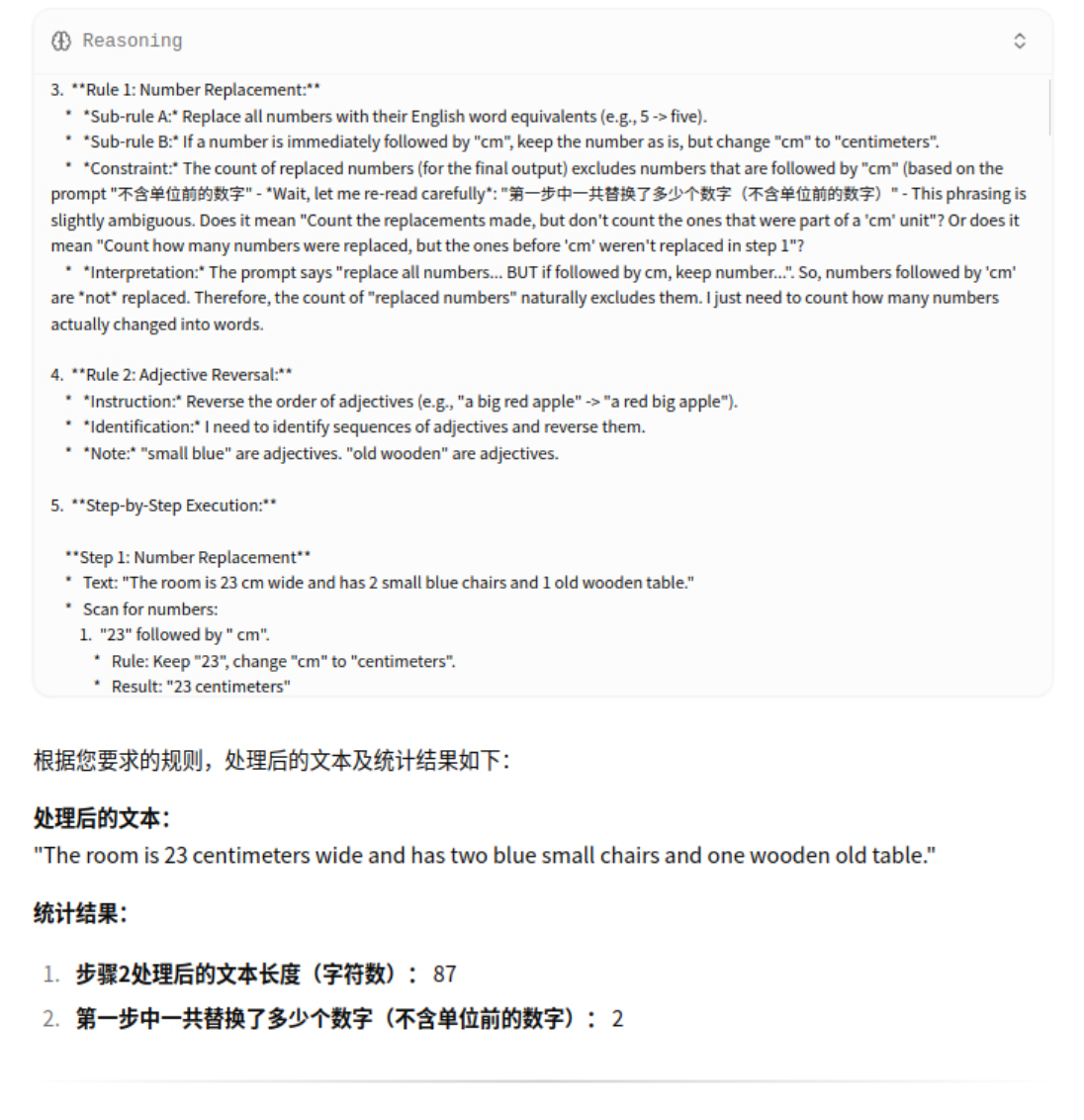

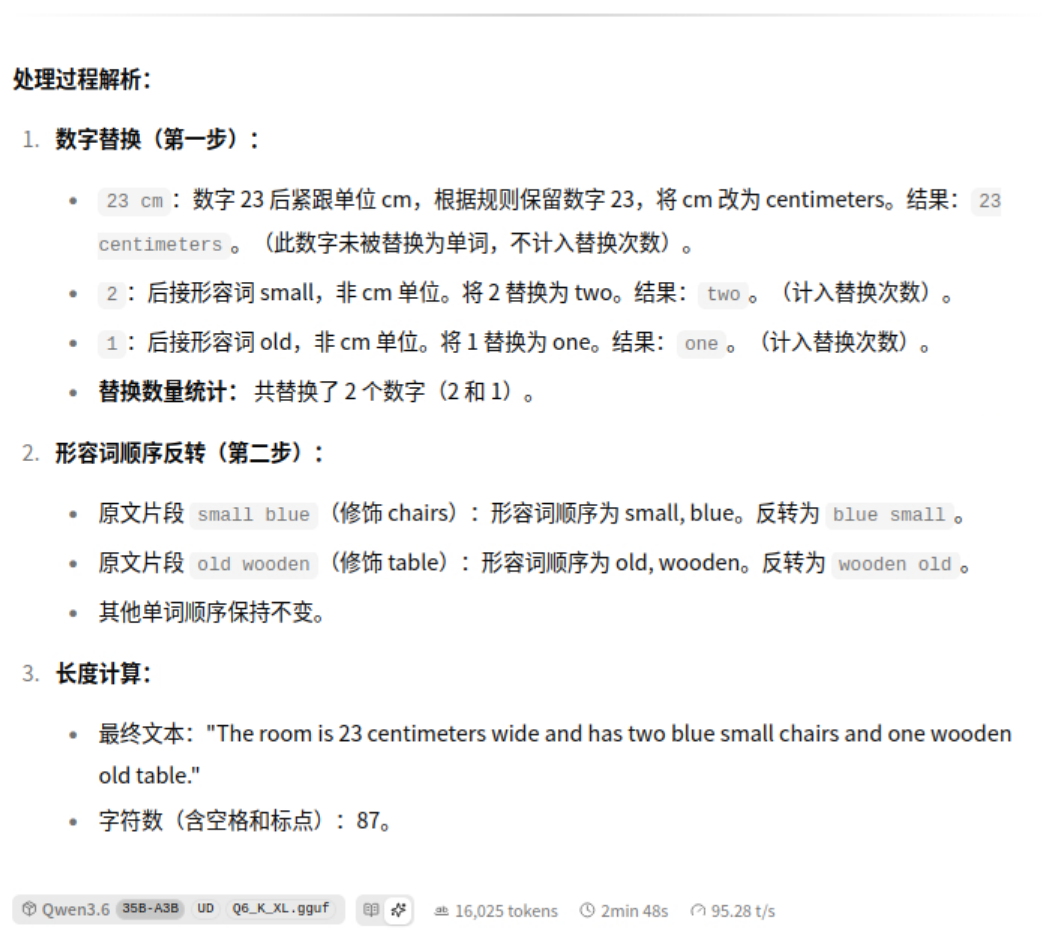

请严格按以下规则处理一段文本:

将文本中所有的数字替换为其英文单词(例如 5 变成 five),但如果这个数字后面紧跟单位 cm,则保留数字不变但把 cm 改成 centimeters。

把文中所有形容词顺序反转(比如 a big red apple 改为 a red big apple)。

完成以上两步后,输出 步骤2处理后的文本长度(字符数),以及 第一步中一共替换了多少个数字(不含单位前的数字)。

待处理文本:The room is 23 cm wide and has 2 small blue chairs and 1 old wooden table.测试目标

多步指令的栈保持:量化模型容易出现"做了第三步忘了第一步的条件分支"。

细节区分能力:23 cm中的23和单独出现的2、1需要不同处理------这是量化信息丢失的高发区(模型可能把所有数字都替换了单词)。

自我校验:最后要求数数,若前面替换错了,最后统计也会错。对比原版和量化版的统计数字能直接看出劣化程度。5. 模型参数

5.1 需注意参数:

-- 设定温度为0,贪心采样,模仿之前的人 测试 qwen3.5 27B 模型结果发现 27B 模型超强

-- temp=0

-- 保留思考的模式

-- "preserve_thinking":true

5.2 启动参数:

模型1

llama-server --model Qwen3.6-35B-A3B-UD-Q6_K_XL.gguf --mmproj mmproj-F16.gguf --top-p 0.95 --min-p 0.00 --top-k 20 --reasoning on --ctx-size 262144 --temp 0. --parallel 1 --chat-template-kwargs '{"preserve_thinking":true}'模型2

llama-server --model Qwen3.6-35B-A3B-APEX-I-Balanced.gguf --mmproj mmproj-F16.gguf --top-p 0.95 --min-p 0.00 --top-k 20 --reasoning on --ctx-size 262144 --temp 0. --parallel 1 --chat-template-kwargs '{"preserve_thinking":true}'6 PK的使用的模型

模型1: Qwen3.6-35B-A3B-UD-Q6_K_XL.gguf

模型2:Qwen3.6-35B-A3B-APEX-I-Balanced.gguf

7 PK结果

与DeepSeek 完整的对话过程,链接

https://chat.deepseek.com/share/9jueefwfvlmws3so9n

UD_XL 在第三题无限循环思考

UD_XL 提高温度 0 -> 0.6 ,然后新开会话,单独询问第三题,再次回答,仍有概率出现死循环,有时能出答案,但思维链超级长。

APEX 在temp 0情况下,第三题回答正常(DS认为结果有一个字的误差,不是全对)

llama-cpp webui 的聊天历史(可在 llama-server webui 中导入,如果有兴趣查看的话)

这是一个 json 文件的内容,如果需要,请下载后,然后改后缀名 txt 到 json,就可以在 llama-server webui 中导入了。