大家好,我是一名正在学习 AI 应用开发的后端学生,最近为了系统掌握 AI Agent 的核心技术,从零到一搭建了一套基于 SpringAI 的动态可配置 AI Agent 工作流系统。市面上很多 AI Agent 项目要么结构复杂,要么只是简单的 Demo,所以我希望通过这个项目,把动态工作流编排、SSE 流式对话、MCP 工具链集成、数据库查询这些主流技术落地到实际代码中,同时也踩了不少坑,整理成这篇文章和大家分享。

一、项目整体架构与技术选型

1. 技术栈概览

表格

| 模块 | 技术选型 |

|---|---|

| 核心框架 | SpringBoot 3.x + SpringAI |

| 并发与动态装配 | CompletableFuture + Spring BeanFactory |

| 流式对话 | SSE (Server-Sent Events) |

| 会话管理 | Redis 滑动窗口截断 |

| 工具链扩展 | MCP 协议 + 百度查询 |

2. 整体架构设计

项目采用模块化、可扩展的设计,核心流程如下:用户请求 → SSE流式输出 → 动态工作流编排 → MCP工具链 → 模型响应

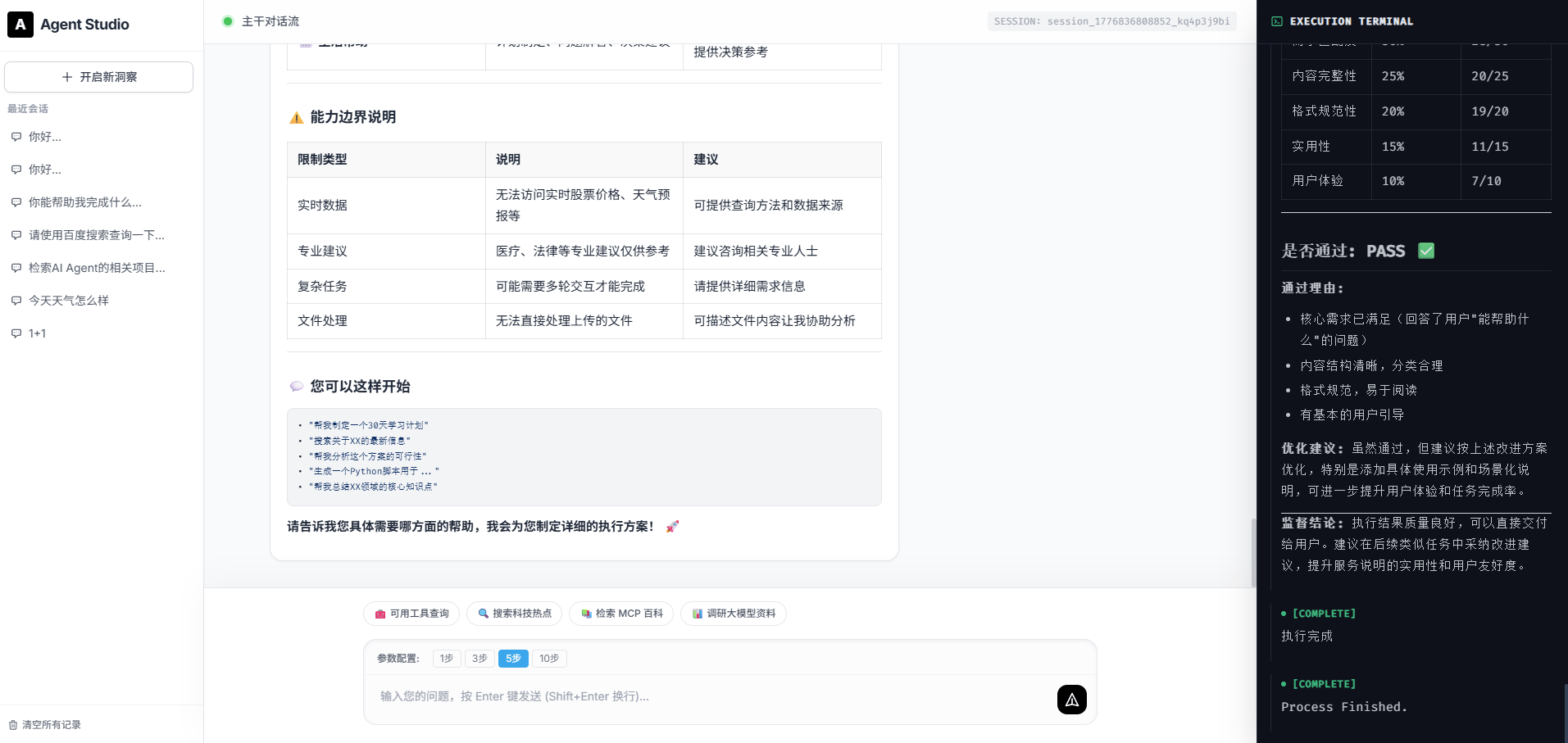

3. 前端页面

二、核心模块实现详解

模块 1:动态装配与工作流热插拔

为了让 Agent 的工作流具备极强的扩展性,我对核心组件进行了解耦,并基于 Spring 底层机制实现了动态装配。

核心实现逻辑:

- 将 Agent 的核心步骤(如意图识别、工具调用、结果生成)拆解为独立组件

- 利用

CompletableFuture实现组件的并发装配,提升初始化效率 - 基于

Spring BeanFactory的底层机制,实现运行时 Bean 的动态注册与热插拔,新增工具或流程无需修改核心代码

关键代码片段:

java

运行

// 动态装配核心逻辑示例

public class AgentComponentFactory {

private final BeanFactory beanFactory;

public AgentComponentFactory(BeanFactory beanFactory) {

this.beanFactory = beanFactory;

}

public void registerComponent(String beanName, Object component) {

((DefaultListableBeanFactory) beanFactory).registerSingleton(beanName, component);

}

public Object getComponent(String beanName) {

return beanFactory.getBean(beanName);

}

}模块 2:SSE 流式对话与 CoT 分离

为了优化用户体验,项目基于 SSE 协议实现了模型生成的流式输出,并在流中完成大模型推理思考过程(CoT)与最终答案的动态分离。

核心实现逻辑:

- 通过 SSE 协议,将模型生成的思考过程和最终答案实时推送给前端

- 在服务端对模型输出流进行解析,识别思考过程标记,实现前后端的动态分离

- 前端可分别渲染思考过程和最终答案,提升交互体验

关键代码片段:

java

运行

@RestController

@RequestMapping("/api/agent")

public class AgentController {

private final ChatClient chatClient;

@GetMapping(value = "/chat", produces = MediaType.TEXT_EVENT_STREAM_VALUE)

public Flux<ServerSentEvent<String>> chat(String message) {

return chatClient.prompt(message)

.stream()

.content()

.map(content -> ServerSentEvent.builder(content).build());

}

}模块 3:多轮会话上下文管理

结合 Redis 实现了多轮会话的滑动窗口截断,有效控制上下文长度,避免模型 "失忆" 或响应过慢。

核心实现逻辑:

- 每次对话前,从 Redis 中读取会话历史,并按配置的窗口大小进行截断

- 对话结束后,将新的对话记录写入 Redis,实现会话上下文的持久化

三、开发踩坑实录与优化心得

-

坑 1:动态装配时 Bean 重复注册异常

- 现象:新增组件时,Spring 容器报 Bean 已存在异常

- 原因:未判断 Bean 是否已存在,直接调用 registerSingleton

- 解决:注册前先检查 Bean 是否存在,避免重复注册

-

坑 2:SSE 流输出中断,客户端接收不全

- 现象:大模型生成较长内容时,SSE 流会意外断开

- 原因:服务端未处理异常,导致流提前关闭

- 解决:在流处理逻辑中增加异常捕获,确保流正常关闭

-

坑 3:多轮会话上下文过长,模型响应变慢

- 现象:对话轮次多了之后,模型响应时间明显增加

- 原因:上下文未截断,导致模型输入 Token 数过多

- 解决:实现滑动窗口截断,控制上下文长度

四、项目总结与后续展望

目前项目已实现动态工作流、SSE 流式对话、多轮会话管理、MCP 工具链集成等核心功能,完全可以作为学习 AI Agent 开发的实战参考。

后续我会继续优化以下方向:

- 接入更多外部工具,扩展 Agent 的能力边界

- 探索 RAG 向量知识库的集成方案,进一步提升 Agent 的知识增强能力

- 优化前端界面,增加更多交互效果,提升用户体验

如果你也在学习 AI Agent 开发,欢迎一起交流讨论!觉得文章有帮助的话,点个赞吧~

附上Github链接: