欢迎关注 【AIGC论文精读】原创作品

【DeepSeek论文精读】1. 从 DeepSeek LLM 到 DeepSeek R1

【DeepSeek论文精读】13. DeepSeek-Coder-V2: 突破闭源模型在代码智能领域的障碍

【DeepSeek论文精读】18. DeepSeek-V4:迈入百万上下文的普惠智能

【DeepSeek论文精读】18. DeepSeek-V4: 迈入百万上下文的普惠智能]

-

- [0. 论文简介](#0. 论文简介)

-

- [0.1 论文背景](#0.1 论文背景)

- [0.2 总结速览](#0.2 总结速览)

- [0.3 摘要](#0.3 摘要)

- [1. 引言](#1. 引言)

- [2. 架构](#2. 架构)

-

- [2.1 从 DeepSeek-V3 继承的设计](#2.1 从 DeepSeek-V3 继承的设计)

- [2.2 流形约束超连接(mHC)](#2.2 流形约束超连接(mHC))

- [2.3 基于 CSA 与 HCA 的混合注意力机制](#2.3 基于 CSA 与 HCA 的混合注意力机制)

- [2.4 Muon 优化器](#2.4 Muon 优化器)

- [3. 整体基础设施](#3. 整体基础设施)

-

- [3.1 专家并行中的细粒度通信‑计算重叠](#3.1 专家并行中的细粒度通信‑计算重叠)

- [3.2 基于 TileLang 的灵活高效算子开发](#3.2 基于 TileLang 的灵活高效算子开发)

- [3.3 高性能批不变与确定性算子库](#3.3 高性能批不变与确定性算子库)

- [3.4 FP4 量化感知训练](#3.4 FP4 量化感知训练)

- [3.5 训练框架](#3.5 训练框架)

- [3.6 推理框架](#3.6 推理框架)

- [4. 预训练](#4. 预训练)

-

- [4.1 数据构建](#4.1 数据构建)

- [4.2 预训练设置](#4.2 预训练设置)

- [4.3 评估](#4.3 评估)

- [5. 后训练](#5. 后训练)

-

- [5.1 后训练流程](#5.1 后训练流程)

- [5.2 强化学习与蒸馏基础设施](#5.2 强化学习与蒸馏基础设施)

- [5.3 标准基准评估](#5.3 标准基准评估)

- [5.4 真实场景任务表现](#5.4 真实场景任务表现)

- [6. 结论、局限性与未来方向](#6. 结论、局限性与未来方向)

迈入百万上下文的普惠智能])

0. 论文简介

0.1 论文背景

2026年 4月24日,DeepSeek 全新系列模型 DeepSeek-V4 的预览版本正式上线并同步开源。DeepSeek-V4 拥有百万字超长上下文,在 Agent 能力、世界知识和推理性能上均实现国内与开源领域的领先。

DeepSeek‑V4 是面向百万 token 高效长上下文的 MoE 模型系列,包含两个版本:

- DeepSeek‑V4‑Pro

- 总参数:1.6T

- 激活参数:49B

- 层数:61

- 隐层维度:7168

- DeepSeek‑V4‑Flash

- 总参数:284B

- 激活参数:13B

- 层数:43

- 隐层维度:4096

- 统一能力:原生支持100 万 token 上下文

同时,DeepSeek 公布了技术报告 "DeepSeek-V4:迈入百万上下文普惠时代(Towards Highly Efficient Million-Token Context Intelligence)"。

DeepSeek-V4 模型的开源权重和技术报告下载地址如下:

Huggingface: DeepSeek-v4

Modelscope: DeepSeek-V4

DeepSeek-V4 技术报告

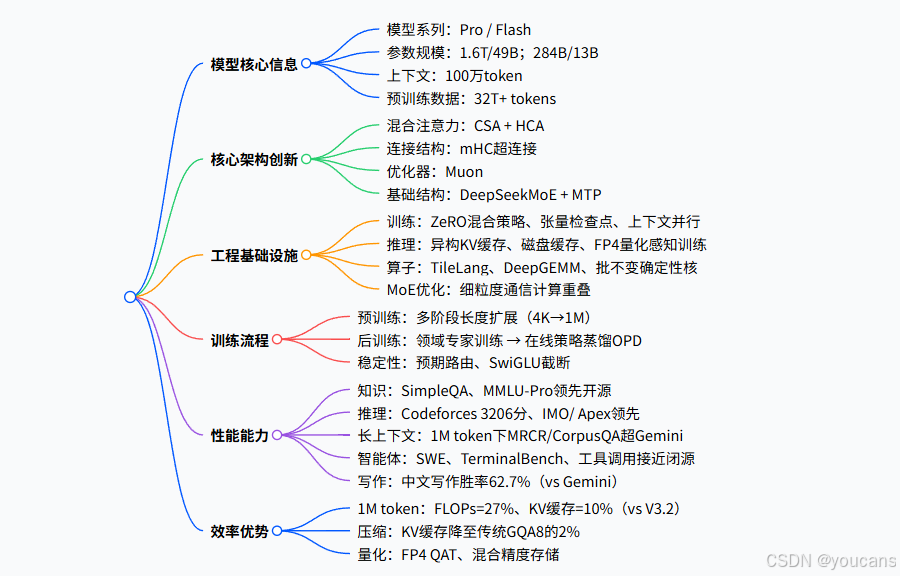

0.2 总结速览

- 要解决的问题

核心架构创新

- 混合注意力机制(CSA+HCA)

- CSA(压缩稀疏注意力):每 4token 压缩,结合稀疏检索,兼顾精度与效率

- HCA(重度压缩注意力):每 128token 压缩,极致压缩长序列

- 搭配滑动窗口注意力,保留局部依赖

- 流形约束超连接(mHC)

- 强化残差传播,将映射约束于双随机矩阵流形

- 提升深度训练稳定性,模型表达更强

- Muon 优化器

- 替代传统 AdamW,收敛更快、训练更稳

- 混合牛顿‑舒尔茨迭代,保证梯度正交

- 继承组件

- DeepSeekMoE:共享专家 + 路由专家,无辅助损失负载均衡

- 多 token 预测 MTP:提升生成效率

0.3 摘要

本文发布 DeepSeek-V4 系列的预览版本,包含两款强大的混合专家(MoE)语言模型------参数总量1.6万亿(激活参数490亿)的DeepSeek-V4-Pro和参数总量2840亿(激活参数130亿)的DeepSeek-V4-Flash------两者均支持百万令牌的上下文长度。

DeepSeek-V4系列在架构与优化方面实现了多项关键升级:

- 融合压缩稀疏注意力(CSA)与高度压缩注意力(HCA)的混合注意力架构,显著提升长上下文处理效率;

- 流形约束超连接(mHC)技术,增强传统残差连接;

- 采用Muon优化器,实现更快收敛与更高训练稳定性。

我们在超过32万亿多样化且高质量的令牌上对两款模型进行预训练,随后通过完整的后训练流程解锁并进一步增强其能力。其中,DeepSeek-V4-Pro采用最大推理算力配置的DeepSeek-V4-Pro-Max版本,重新定义了开放模型的最先进水平,在核心任务上全面超越前代模型。

与此同时,DeepSeek-V4系列在长上下文场景中表现卓越。在百万令牌上下文设置下,相较于DeepSeek-V3.2,DeepSeek-V4-Pro的单令牌推理FLOPs仅需27%,KV缓存仅需10%。这使我们能够常规化支持百万令牌上下文,从而让长周期任务及后续的测试时扩展更具可行性。

模型检查点可通过以下链接获取:https://huggingface.co/collections/deepseek-ai/deepseek-v4】

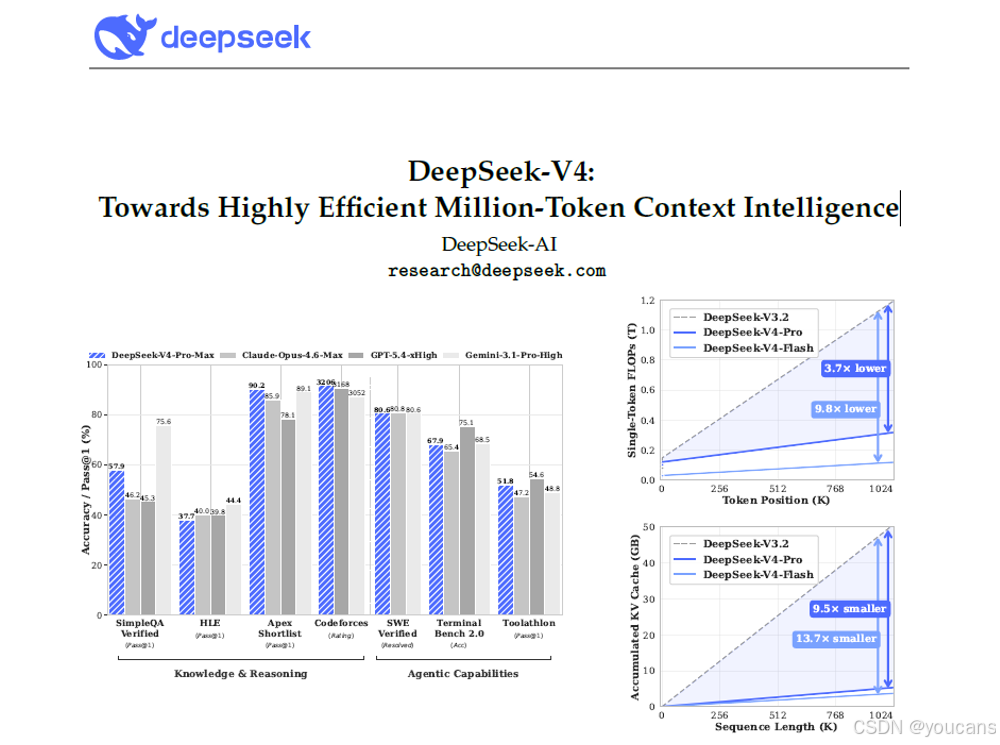

图 1:左侧:DeepSeek-V4-Pro-Max 与对标模型的基准测试性能对比。右侧:DeepSeek-V4 系列与 DeepSeek-V3.2 的推理计算量(FLOPs)和 KV 缓存大小对比。

1. 引言

推理模型(DeepSeek-AI, 2025; OpenAI, 2024c)的出现确立了一种新的测试时扩展范式,推动大型语言模型(LLM)取得了显著的性能提升。然而,这种扩展范式从根本上受到普通注意力机制(Vaswani et al., 2017)的二次计算复杂度的限制,这为超长上下文和推理过程造成了难以逾越的瓶颈。与此同时,长时程场景和任务的出现------从复杂的智能体工作流到大规模的跨文档分析------也使得对超长上下文的高效支持成为未来进展的关键。尽管最近的开源努力(Bai et al., 2025a; DeepSeek-AI, 2024; MiniMax, 2025; Qwen, 2025)已经在通用能力上取得了进展,但在处理超长序列方面的这一核心架构低效问题仍然是一个关键障碍,限制了测试时扩展的进一步收益,也阻碍了对长时程场景和任务的更深层次探索。

为了打破超长上下文中的效率壁垒,我们开发了 DeepSeek-V4 系列,包括 DeepSeek-V4-Pro 预览版(1.6T 参数,49B 激活)和 DeepSeek-V4-Flash 预览版(284B 参数,13B 激活)。通过架构创新,DeepSeek-V4 系列在处理超长序列的计算效率方面实现了巨大飞跃。这一突破使得高效支持一百万 token 的上下文长度成为可能,为下一代 LLM 开创了百万长度上下文的新时代。我们相信,高效处理超长序列的能力释放了测试时扩展的下一个前沿,为更深入研究长时程任务铺平了道路,并为探索在线学习等未来范式奠定了必要的基础。

与 DeepSeek-V3 架构(DeepSeek-AI, 2024)相比,DeepSeek-V4 系列保留了 DeepSeekMoE 框架(Dai et al., 2024)和多 token 预测(MTP)策略,同时在架构和优化方面引入了若干关键创新。为了提升长上下文效率,我们设计了一种结合压缩稀疏注意力(CSA)和重度压缩注意力(HCA)的混合注意力机制。CSA 沿序列维度压缩 KV 缓存,然后执行 DeepSeek 稀疏注意力(DSA)(DeepSeek-AI, 2025),而 HCA 对 KV 缓存进行更激进的压缩,但保持稠密注意力。为了增强建模能力,我们引入了流形约束超连接(mHC)(Xie et al., 2026),对传统的残差连接进行了升级。此外,我们在 DeepSeek-V4 系列的训练中引入了 Muon(Jordan et al., 2024; Liu et al., 2025)优化器,实现了更快的收敛速度和更高的训练稳定性。

为了实现 DeepSeek-V4 系列的高效训练和推理以及高效开发,我们引入了若干基础设施优化。首先,我们为 MoE 模块设计并实现了一个单一融合内核,能够完全重叠计算、通信和内存访问。其次,我们采用 TileLang(Wang et al., 2026),这是一种领域特定语言(DSL),用于平衡开发生产力和运行时效率。第三,我们提供了高效的批处理不变性和确定性内核库,确保训练和推理之间的逐比特可重现性。第四,我们对 MoE 专家权重和索引器 QK 路径加入了 FP4 量化感知训练,以减少内存和计算。第五,对于训练框架,我们扩展了自动微分框架,加入了张量级检查点以实现细粒度的重计算控制;并且通过 Muon 优化器的混合 ZeRO 策略、通过重计算和融合内核实现的具有成本效益的 mHC 实现、以及用于管理压缩注意力的两阶段上下文并行,提升了训练效率。最后,对于推理框架,我们设计了一种异构 KV 缓存结构和磁盘存储策略,以实现高效的共享前缀复用。

通过采用混合 CSA 和 HCA,以及对计算和存储的精度优化,与 DeepSeek-V3.2 相比,DeepSeek-V4 系列实现了显著更低的推理 FLOPs 和大幅减少的 KV 缓存大小,尤其是在长上下文设置下。图 1 的右侧部分展示了 DeepSeek-V3.2 和 DeepSeek-V4 系列的估计单 token 推理 FLOPs 和累积 KV 缓存大小。在 1M token 上下文的场景中,即使是激活参数数量更多的 DeepSeek-V4-Pro,相较于 DeepSeek-V3.2,也仅需 27% 的单 token FLOPs(以等效 FP8 FLOPs 衡量)和 10% 的 KV 缓存大小。此外,激活参数数量更少的 DeepSeek-V4-Flash 将效率进一步提升:在 1M token 上下文设置下,与 DeepSeek-V3.2 相比,它仅需 10% 的单 token FLOPs 和 7% 的 KV 缓存大小。另外,对于 DeepSeek-V4 系列,路由专家参数采用 FP4 精度。虽然目前 FP4 × FP8 操作的峰值 FLOPs 在现有硬件上与 FP8 × FP8 相同,但在未来硬件上理论上可以实现 1/3 的效率提升,这将进一步增强 DeepSeek-V4 系列的效率。

在预训练期间,我们分别在 32T token 上训练 DeepSeek-V4-Flash,在 33T token 上训练 DeepSeek-V4-Pro。预训练之后,这两个模型能够原生且高效地支持 1M 长度的上下文。在我们的内部评估中,DeepSeek-V4-Flash-Base 凭借其更高参数效率的设计,已经在大多数基准测试中超越了 DeepSeek-V3.2-Base。DeepSeek-V4-Pro-Base 进一步扩展了这一优势,在 DeepSeek 基础模型中树立了新的性能标准,在推理、编码、长上下文和世界知识任务上实现了全面优势。

DeepSeek-V4 系列的后训练管道采用两阶段范式:先独立培养领域特定专家,然后通过 on-policy distillation(Lu and Lab, 2025)进行统一模型整合。最初,对于每个目标领域------例如数学、编码、智能体和指令跟随------分别独立训练一个专家模型。基础模型首先在高质量、领域特定的数据上进行监督微调(SFT),以建立基础能力。随后,使用 Group Relative Policy Optimization(GRPO)(DeepSeek-AI, 2025)应用强化学习(RL),通过针对特定成功标准定制的奖励模型引导,进一步优化模型以使其行为与领域对齐。这一阶段产生了一组多样化的专业专家,每个专家都在各自领域表现出色。最后,为了整合这些不同的专长,通过 on-policy distillation 训练一个统一的模型,其中统一模型充当学生,学习优化与教师模型的反向 KL 散度损失。

核心评估结果

-

知识:

在广泛世界知识的评估中,DeepSeek-V4-Pro-Max(DeepSeek-V4-Pro 的最大推理努力模式)在 SimpleQA(OpenAI, 2024d)和 Chinese-SimpleQA(He et al., 2024)基准测试上显著优于领先的开源模型。关于教育知识------通过 MMLU-Pro(Wang et al., 2024b)、HLE(Phan et al., 2025)和 GPQA(Rein et al., 2023)评估------DeepSeek-V4-Pro-Max 相比其开源对手表现出微弱领先。DeepSeek-V4-Pro-Max 已显著缩小了与领先专有模型 Gemini-3.1-Pro 的差距,尽管在这些基于知识的评估中仍落后于它。

-

推理:

通过扩展推理 token,DeepSeek-V4-Pro-Max 在标准推理基准上展现出相对于 GPT-5.2 和 Gemini-3.0-Pro 的优越性能。然而,其表现略逊于 GPT-5.4 和 Gemini-3.1-Pro,这表明其发展轨迹落后于最先进的前沿模型大约 3 到 6 个月。此外,DeepSeek-V4-Flash-Max 实现了与 GPT-5.2 和 Gemini-3.0-Pro 相当的性能,将自身确立为处理复杂推理任务的一种高性价比架构。

-

智能体:

在公共基准测试上,DeepSeek-V4-Pro-Max 与领先的开源模型(如 Kimi-K2.6 和 GLM-5.1)持平,但略逊于前沿闭源模型。在我们的内部评估中,DeepSeek-V4-Pro-Max 优于 Claude Sonnet 4.5,并接近 Opus 4.5 的水平。

-

长上下文:

DeepSeek-V4-Pro-Max 在具有 1 百万 token 上下文窗口的合成和真实使用案例上均取得了强劲的结果,甚至在学术基准上超越了 Gemini-3.1-Pro。

-

DeepSeek-V4-Pro 与 DeepSeek-V4-Flash 的比较:

DeepSeek-V4-Flash-Max 由于其较小的参数规模,在知识评估中表现较低。然而,当分配更大的思考预算时,它在推理任务上取得了可比的结果。在智能体评估中,虽然 DeepSeek-V4-Flash-Max 在几个基准上与 DeepSeek-V4-Pro-Max 的表现相匹配,但在更复杂、高难度的任务上仍落后于其更大的对应模型。

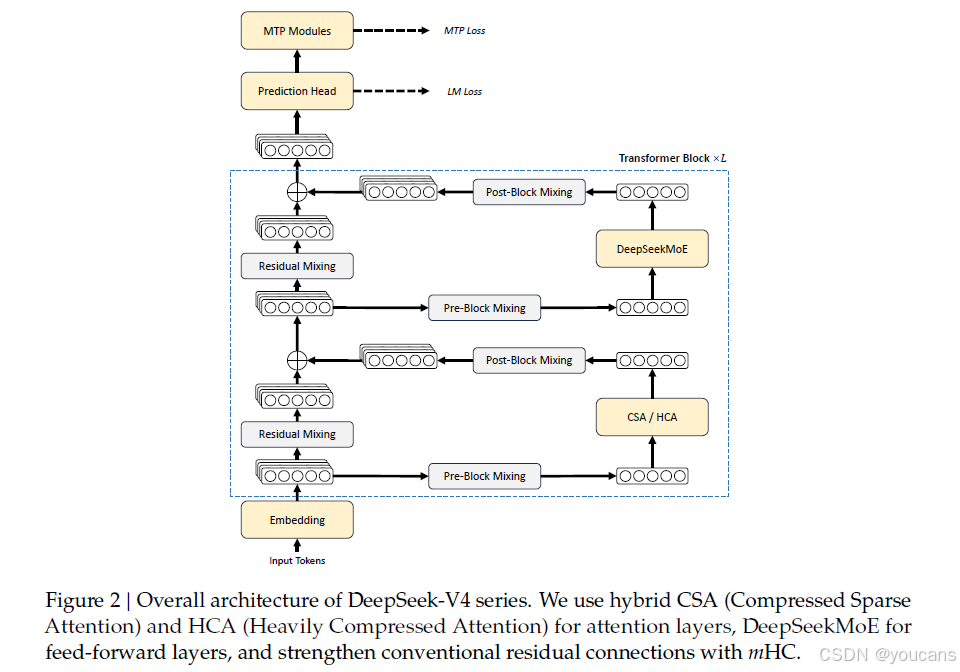

图 2:DeepSeek-V4 系列整体架构我们在注意力层采用CSA(压缩稀疏注意力)与HCA(重度压缩注意力)混合结构,前馈层使用DeepSeekMoE,并通过 mHC(流形约束超连接) 增强传统残差连接。

2. 架构

总体而言,DeepSeek-V4 系列保留了 Transformer (Vaswani et al., 2017) 架构和多 token 预测(MTP)模块 (DeepSeek-AI, 2024; Gloeckle et al., 2024),同时在 DeepSeek-V3 的基础上引入了若干关键升级:(1) 首先,我们引入了流形约束超连接(mHC)(Xie et al., 2026) 来加强传统的残差连接;(2) 其次,我们设计了一种混合注意力架构,通过压缩稀疏注意力和重度压缩注意力大幅提升了长上下文效率。(3) 第三,我们采用 Muon (Jordan et al., 2024; Liu et al., 2025) 作为优化器。对于混合专家(MoE)组件,我们仍然采用 DeepSeekMoE (Dai et al., 2024) 架构,仅对 DeepSeek-V3 进行了微调。多 token 预测(MTP)(DeepSeek-AI, 2024; Gloeckle et al., 2024; Li et al., 2024; Qi et al., 2020) 配置与 DeepSeek-V3 保持相同。所有其他未指定的细节均遵循 DeepSeek-V3 (DeepSeek-AI, 2024) 中建立的设置。图 2 展示了 DeepSeek-V4 的整体架构,具体细节如下所述。

2.1 从 DeepSeek-V3 继承的设计

-

混合专家。

与之前的 DeepSeek 系列模型 (DeepSeek-AI, 2024; DeepSeek-AI, 2024) 一样,DeepSeek-V4 系列也采用 DeepSeekMoE 范式 (Dai et al., 2024) 用于前馈网络(FFN),该范式设置了细粒度的路由专家和共享专家。与 DeepSeek-V3 不同的是,我们将计算亲和度分数的激活函数从 Sigmoid(·) 改为 Sqrt(Softplus(·))。对于负载均衡,我们同样采用了无辅助损失策略 (DeepSeek-AI, 2024; Wang et al., 2024a),并辅以轻微的序列级平衡损失,以防止单个序列内出现极端不平衡。对于 DeepSeek-V4,我们移除了对路由目标节点数量的限制,并重新精心设计了并行策略以保持训练效率。此外,与 DeepSeek-V3 相比,我们将初始几个 Transformer 块中的稠密 FFN 层替换为采用哈希路由 (Roller et al., 2021) 的 MoE 层。哈希路由策略根据关于输入 token ID 的预定义哈希函数来确定每个 token 的目标专家。

-

多 token 预测。

与 DeepSeek-V3 一样,DeepSeek-V4 系列也设置了 MTP 模块和目标。鉴于 MTP 策略已在 DeepSeek-V3 中得到验证,我们为 DeepSeek-V4 系列采用相同的策略,不做修改。

2.2 流形约束超连接(mHC)

如图 2 所示,DeepSeek-V4 系列融入了流形约束超连接(mHC)(Xie et al., 2026),以加强相邻 Transformer 块之间的传统残差连接。与普通超连接相比,mHC 的核心思想是将残差映射约束在特定的流形上,从而在保留模型表达能力的同时,提升跨层信号传播的稳定性。本节简要介绍标准超连接,并说明我们如何设计 mHC 以实现稳定训练。

标准超连接

标准超连接会将残差流的宽度扩大一定倍数,将残差流的维度进行扩展,但不会影响内部层的设计。超连接将残差宽度与实际隐层维度解耦,以极小的计算开销提供了一条额外的缩放维度。不过我们发现,在堆叠多层时,训练经常会出现数值不稳定问题,阻碍了超连接的进一步扩展。

流形约束残差映射

mHC 的核心创新是将残差映射矩阵约束在双随机矩阵流形上,以此增强跨层信号传播的数值稳定性。这种约束确保了映射矩阵的谱范数被限制在 1 以内,使残差变换呈现非扩张特性,从而在前向传播与反向传播过程中都提升数值稳定性。同时,该集合在乘法运算下具有封闭性,保证了深度堆叠 mHC 时的稳定性。此外,输入变换与输出变换也通过 Sigmoid 函数被约束为非负且有界,避免信号抵消的风险。

动态参数化

三个线性映射的参数是动态生成的,被分解为 ** 动态(与输入相关)分量与静态(与输入无关)** 分量。输入会先被展平并归一化,之后按照标准超连接的方式生成未约束的原始参数。

参数约束施加

在得到未约束的原始参数后,我们对其施加前面提到的约束以增强数值稳定性。具体来说,对于输入与输出映射,我们使用 Sigmoid 函数保证其非负性与有界性。对于残差映射,我们通过 Sinkhorn-Knopp 算法将其投影到双随机矩阵流形上,先对矩阵做指数运算确保非负,再迭代进行行归一化与列归一化,最终收敛到满足约束的矩阵。

2.3 基于 CSA 与 HCA 的混合注意力机制

当上下文长度达到极大规模时,注意力机制会成为模型中占主导的计算瓶颈。为此,DeepSeek‑V4 设计了两种高效注意力架构 ------压缩稀疏注意力(CSA)与重度压缩注意力(HCA),并采用二者交替的混合配置,显著降低了长文本场景下注意力的计算开销。

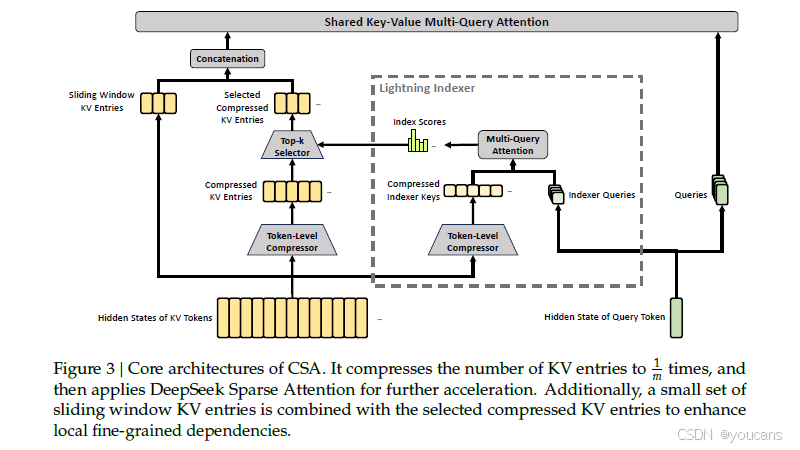

- CSA 同时融合了压缩与稀疏注意力策略:它先将每 m 个 token 的键值(KV)缓存压缩为一个条目,再应用 DeepSeek 稀疏注意力(DSA),使每个查询 token 仅关注 k 个压缩后的 KV 条目。

- HCA 则追求极致压缩,将每 m′(远大于 m) 个 token 的 KV 缓存合并为单个条目。

CSA 与 HCA 组成的混合架构显著提升了 DeepSeek‑V4 系列的长上下文效率,让百万 token 上下文在工程上真正可行。本节介绍混合注意力的核心技术,我们同时提供开源实现以明确完整细节。

2.3.1 压缩稀疏注意力(CSA)

CSA (Compressed Sparse Attention) 的核心架构如图 3 所示。它先将每 m 个 token 的 KV 缓存压缩为一个条目,再应用 DeepSeek 稀疏注意力实现进一步加速。

压缩键值条目

设输入隐状态序列为 H ∈ R n × d H ∈ R^{n×d} H∈Rn×d,其中 n n n 为序列长度, d d d 为隐层维度。CSA 首先计算两组 KV 条目 C a , C b ∈ R n × c C^a, C^b ∈ R^{n×c} Ca,Cb∈Rn×c 以及对应的压缩权重 Z a , Z b ∈ R n × c Z^a, Z^b ∈ R^{n×c} Za,Zb∈Rn×c,其中 c c c 为头维度。接着,按照压缩权重与可学习位置偏置,将每 m 个 KV 条目压缩为一个条目,得到 C C o m p ∈ R ( n / m ) × c C^{Comp} ∈ R^{(n/m)×c} CComp∈R(n/m)×c。通过该操作,CSA 将序列长度压缩至原来的 1 / m 1/m 1/m。

用于稀疏选择的 Lightning 索引器

得到压缩后的 KV 条目后,CSA 采用 DSA 策略选出 t o p ‑ k top‑k top‑k 个压缩 KV 条目用于核心注意力计算。首先,对查询 token 生成索引器查询向量,计算与压缩后索引键的匹配分数;然后通过 top‑k 选择,只保留最相关的压缩 KV 条目。

共享键值多头查询注意力(MQA)

选出稀疏 KV 条目后,CSA 以 ** 共享 KV 的多头查询注意力(MQA)** 方式执行核心注意力,每个压缩 KV 条目同时作为键与值。

分组输出投影

为降低计算开销,CSA 将多个注意力头输出分成 g 组,先降维再映射回最终隐状态,显著减少参数量与计算量。

图3:CSA 核心架构。

它将 KV 条目数量压缩为原来的 1/m,随后应用 DeepSeek 稀疏注意力(DeepSeek Sparse Attention)进一步加速。此外,一小部分滑动窗口 KV 条目会与选中的压缩 KV 条目结合,以增强局部细粒度依赖建模。

2.3.2 重度压缩注意力(HCA)

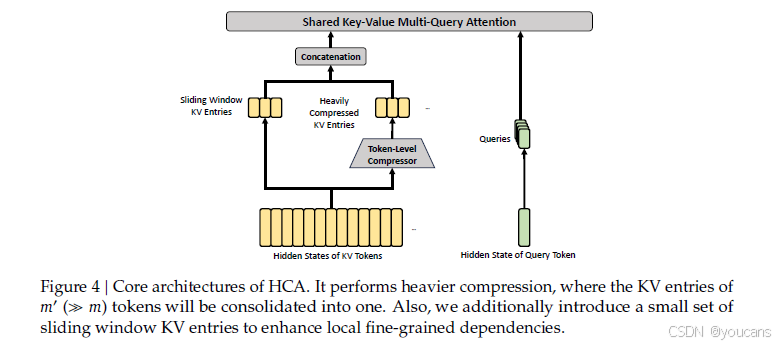

HCA(Heavily Compressed Attention)的核心架构如图 4 所示。它采用更激进的压缩策略,但不使用稀疏注意力。

重度压缩键值条目

HCA 的压缩方式与 CSA 类似,但采用大得多的压缩率 m′(m′ ≫ m),且不使用重叠压缩。每 m′ 个 token 的 KV 被压缩为一个条目,使序列长度降至 1/m′。

共享键值 MQA 与分组输出投影

HCA 同样采用共享 KV 的 MQA以及分组输出投影策略,与 CSA 保持一致。

图 4:HCA 核心架构

它执行更重度的压缩,将 m′(远大于 m) 个令牌的 KV 条目合并为一个。同时,我们额外引入一小部分滑动窗口 KV 条目,以增强局部细粒度依赖建模

2.3.3 其他实现细节

除上述核心架构外,混合注意力还包含以下关键技术:

- 查询与键值归一化

在核心注意力之前对查询与压缩 KV 条目进行 RMSNorm,防止注意力分数爆炸,提升训练稳定性。 - 部分旋转位置编码(RoPE)

仅对查询、KV 条目的最后 64 维施加 RoPE,在保留相对位置信息的同时降低计算量。 - 滑动窗口注意力分支

为保证局部细粒度依赖建模,每个查询额外关注最近 n_win 个未压缩的 KV 条目,弥补压缩带来的局部信息损失。 - 注意力 Sink(Attention Sink)

引入可学习的 sink 偏置,使每个注意力头可以动态调整总注意力权重,进一步提升长上下文稳定性。

2.3.4 效率分析

得益于 CSA + HCA 混合注意力以及低精度计算与存储优化,DeepSeek‑V4 的注意力模块在长上下文场景下实现了革命性的效率提升:

- 混合精度 KV 存储

RoPE 维度用 BF16,其余维度用 FP8,使 KV 缓存大小几乎减半。 - FP4 索引器计算

Lightning 索引器的注意力计算全程以 FP4 执行,进一步加速超长上下文推理。 - 更小的注意力 top‑k

相比 V3.2,V4 使用更小的稀疏选取数量,提升短 / 中序列效率。 - 压缩与稀疏的组合效应

在百万 token 场景下,V4 系列的 KV 缓存可降至传统 GQA8 基线的约 2%。

与 DeepSeek‑V3.2 相比:

- V4‑Pro:FLOPs 仅 27%,KV 缓存仅 10%

- V4‑Flash:FLOPs 仅 10%,KV 缓存仅 7%

这使得百万 token 上下文从 "难以部署" 变为 "可日常使用"。

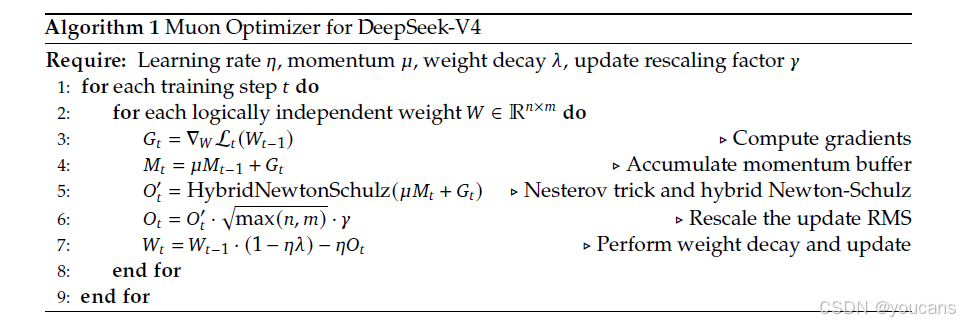

2.4 Muon 优化器

Muon (Jordan et al., 2024; Liu et al., 2025) 优化器具有更快的收敛速度和更高的训练稳定性,我们在 DeepSeek-V4 系列的大多数模块中采用了它。我们对 Muon 优化的完整算法如算法 1 所示。

基础配置

我们对嵌入模块、预测头模块、mHC 模块的静态偏置与门控因子,以及所有 RMSNorm 模块的权重,继续沿用 AdamW 优化器。其余所有模块均使用 Muon 优化器进行更新。

我们对 Muon 参数施加权重衰减,采用 Nesterov 技巧,并对更新矩阵的均方根进行重缩放,以便复用已有的 AdamW 超参数。与此前工作不同的是,我们使用混合牛顿‑舒尔茨迭代实现正交化。

混合牛顿‑舒尔茨迭代

混合牛顿‑舒尔茨迭代用于对矩阵做近似正交化,让矩阵的奇异值稳定趋近于 1。我们将迭代分为两个阶段执行:

前若干步使用一组系数,让奇异值快速收敛到接近 1;

最后几步切换到另一组系数,让奇异值精确稳定在 1。

避免注意力分数爆炸

DeepSeek‑V4 的注意力架构支持在查询与 KV 条目上直接施加 RMSNorm,能有效避免注意力分数出现爆炸。因此,我们在 Muon 优化器中不再需要使用 QK‑Clip 技巧。

3. 整体基础设施

为支撑 DeepSeek‑V4 系列的高效训练与推理,并提升研发效率,我们引入了多项基础设施层面的优化。这些优化覆盖了专家并行、算子开发、训练框架、推理框架、低精度量化等关键环节,为百万令牌长度的稳定训练与高效部署提供了全栈保障。

3.1 专家并行中的细粒度通信‑计算重叠

混合专家(MoE)结构可通过专家并行(EP)进行加速,但专家并行依赖复杂的节点间通信,对互联带宽与延迟提出很高要求。为缓解专家并行的通信瓶颈,并在更低互联带宽下实现更高端到端性能,我们提出一种细粒度专家并行方案,将通信与计算融合到单个流水化核函数中,实现通信‑计算完全重叠。

该方案的核心思路是:MoE 层的通信总耗时小于计算耗时,因此可将通信延迟完全隐藏在计算之下。我们将专家切分为若干 "波次",每一波专家完成通信后立即开始计算,无需等待全部专家。在稳态下,当前波次的计算、下一波次的令牌传输、已完成波次的结果回传可同时进行,形成连续的细粒度流水线。

这一设计在通用推理任务上可实现明显加速,在强化学习推演、高速智能体服务等延迟敏感场景下加速比更高。我们已将基于 CUDA 的融合核函数开源,作为 DeepGEMM 的一部分。同时,我们也从硬件设计角度给出了关于计算通信比、功耗预算、通信原语与激活函数的优化建议。

3.2 基于 TileLang 的灵活高效算子开发

复杂的模型架构会产生大量细粒度算子,我们采用领域专用语言 TileLang 开发一套融合核函数,替换绝大部分原生算子,在极小开发代价下获得最优性能。它兼顾开发效率与运行时性能,支持注意力变体等算子的快速原型验证,在模型架构研发、大规模训练与推理部署中都发挥关键作用。

为降低 CPU 调度开销,我们通过主机代码生成(Host Codegen)将大部分主机侧逻辑移入生成代码,把单次调用的验证开销降至微秒级以下。同时,我们将 Z3 SMT 求解器集成到 TileLang 的代数系统中,为张量程序中的复杂整数运算提供更强的形式化分析能力,解锁更多高级优化。

在数值精度与一致性方面,TileLang 默认关闭快速数学优化,保证 IEEE‑754 语义正确性,并支持按位可复现,确保训练与推理的结果对齐。

3.3 高性能批不变与确定性算子库

为实现高效训练与推理,我们开发了一套完备的高性能计算核函数库。除基础功能与硬件利用率最大化外,另一核心设计目标是保证训练可复现性,以及预训练、后训练与推理三条管线之间的按位对齐。为此,我们以极小性能开销实现了端到端、按位一致的批不变与确定性核函数。

-

批不变性:

无论令牌在批次中处于什么位置,输出都保持按位一致。我们提出双核函数策略,在保证批不变的同时缓解波函数量化问题,提升 GPU 利用率。矩阵乘法则完全使用 DeepGEMM 替换,并放弃会破坏批不变性的 split‑k 方法,同时通过其他优化弥补性能。

-

确定性:

训练的确定性有利于调试硬件与软件问题。我们通过为每个流多处理器分配独立累加缓冲区、令牌顺序预处理、跨设备写入隔离等方式,消除由原子加与乱序写入带来的非确定性,使稀疏注意力、MoE 反向传播、mHC 矩阵乘法均实现完全确定。

3.4 FP4 量化感知训练

为实现推理加速与内存节省,我们在后训练阶段引入量化感知训练(QAT),让模型提前适应量化带来的精度损失。我们对两部分组件采用 FP4(MXFP4)量化:

- MoE 专家权重(占用大量显存)

- CSA 索引器中的查询‑键(QK)路径

在推理与强化学习推演阶段,我们直接使用真实 FP4 量化权重,而非模拟量化,确保采样行为与线上部署完全一致,同时真正降低内存占用并获得加速。

3.5 训练框架

我们的训练框架基于 DeepSeek‑V3 的高效基础设施构建,并针对 Muon 优化器、mHC 结构与混合注意力机制进行关键创新,在保持高效与稳定的同时适配新架构。

3.5.1 Muon 的高效实现

Muon 优化器需要完整梯度矩阵才能更新参数,与传统面向元素级优化器的 ZeRO 策略存在冲突。我们为此设计ZeRO 桶分配混合策略:

- 对稠密参数,限制 ZeRO 并行最大规模,用背包算法均衡负载;

- 对 MoE 参数,独立优化每个专家,均匀分布到各设备;

- 连续同形状参数自动合并,批量执行牛顿‑舒尔茨迭代,提升硬件利用率。

同时,我们将 MoE 梯度量化到 BF16 进行同步,减半通信量,并通过两阶段集合通信保证数值稳健性。

3.5.2 mHC 的低成本与低内存实现

mHC 相比传统残差连接会增加激活内存与通信量。我们通过三项优化缓解开销:

- 为训练与推理精心设计 mHC 融合核函数

- 引入重计算策略,选择性检查中间张量,平衡内存与计算开销

- 调整 DualPipe 重叠方案,容纳增加的流水线通信

最终,mHC 带来的端到端耗时开销被控制在很低水平。

3.5.3 面向长上下文注意力的上下文并行

传统上下文并行(CP)按序列维度切分,但压缩注意力(CSA/HCA)需要连续令牌才能压缩,容易跨设备边界。我们设计两阶段通信方案:先让设备互传末尾未压缩令牌,再完成本地压缩与全局聚合,使压缩后的 KV 长度规整,支持稀疏选取与可见范围预计算。

3.5.4 支持灵活激活检查点的扩展自动微分

传统激活检查点以模块为粒度,难以在重计算开销与内存占用间取得最优平衡。我们实现张量级激活检查点机制,支持自动微分,开发者只需实现前向传播并选择性标注张量,框架即可自动追踪计算图,识别最小重计算子图并插入反向传播逻辑。

该设计无额外训练开销,直接复用已释放的显存空间,自动避免重复重计算,让开发者无需关心底层内存细节。

3.6 推理框架

推理框架整体继承自 DeepSeek‑V3,但在 KV 缓存管理上做了针对性改进。

3.6.1 KV 缓存结构与管理

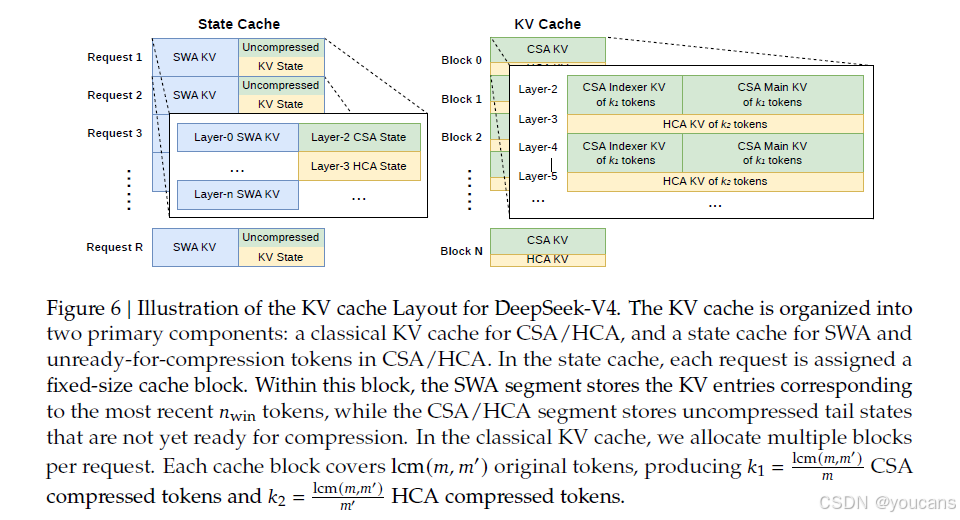

为了高效管理 DeepSeek-V4 中混合注意力机制产生的异构 KV 缓存,我们设计了一种定制化的 KV 缓存布局。该布局如图 6 所示,我们将在下文中对其进行详细阐述。

CSA/HCA 压缩、滑动窗口、稀疏索引等机制使不同层的缓存大小与更新规则各不相同,传统 PagedAttention 难以统一管理。

我们将缓存分为两部分:

- 经典 KV 缓存:存放 CSA/HCA 压缩后的条目

- 状态缓存:存放滑动窗口与暂未压缩的尾部令牌

同时,通过稀疏注意力核函数协同设计,让不同层可支持可变每块令牌数而不损失性能,保证对齐与缓存线利用率。

3.6.2 磁盘 KV 缓存存储

为避免共享前缀请求的重复预填充,我们使用磁盘 KV 缓存机制。对 CSA/HCA 压缩条目直接存盘,命中时直接复用;对滑动窗口(SWA)条目,我们提供三种存储策略:

- 全量缓存(零冗余,但写入量大)

- 周期性 checkpoint(存储与计算折中)

- 不缓存(完全重计算,省空间)

可根据部署场景灵活选择,在存储开销与计算冗余之间做 trade‑off。

4. 预训练

4.1 数据构建

在 DeepSeek-V3 预训练数据的基础上,我们进一步构建了更多样、更高质量、有效上下文更长的训练语料。我们持续优化数据处理流程:对网页来源数据实施过滤策略,剔除批量自动生成与模板化内容,降低模型崩溃风险。数学与代码语料仍是训练数据的核心组成部分,我们在训练中期引入智能体形态数据,进一步增强模型的代码能力。

在多语言数据方面,我们为 DeepSeek-V4 构建了更大规模的语料,提升模型对不同文化、长尾知识的捕捉能力。我们格外重视长文档数据的构建,优先选取学术论文、技术报告等具备独特学术价值的内容。整体预训练语料总量超过 32T tokens,涵盖数学、代码、网页、长文档等高质类别。

预训练数据的处理流程基本沿用 DeepSeek-V3 的方案。分词方面,在 V3 分词器基础上新增少量特殊符号用于上下文构建,词表规模保持 128K。我们同样继承了 V3 的切分策略与中间填充策略。受相关工作启发,我们将不同来源的文档打包为合适长度的序列,最大限度减少样本截断。与 V3 不同的是,预训练阶段我们采用样本级注意力掩码。

4.2 预训练设置

4.2.1 模型设置

DeepSeek-V4-FlashTransformer 层数、隐层维度均采用轻量化配置。前两层使用纯滑动窗口注意力,后续层以交错方式使用 CSA 与 HCA。所有层均使用 MoE 结构,其中前三层采用哈希路由。每个 MoE 层包含 1 个共享专家与大量路由专家,每个 token 会激活固定数量的专家。多令牌预测深度设为 1。mHC 扩张因子与迭代次数按稳定配置设定。最终模型总参数量 284B,每 token 激活参数量 13B。

DeepSeek-V4-Pro采用更深、更宽的架构配置。前两层使用 HCA,后续层交错使用 CSA 与 HCA。MoE 结构、专家数量、激活规则均采用更大规模设置,以支撑更强的建模能力。最终模型总参数量 1.6T,每 token 激活参数量 49B。

4.2.2 训练设置

DeepSeek-V4-Flash大部分模块使用 Muon 优化器,嵌入层、预测头、Norm 层等模块沿用 AdamW。训练数据量为 32T tokens,采用批次调度策略,从较小批次逐步提升并稳定在高位。学习率采用线性预热,中期保持恒定,末期以余弦方式衰减。

序列长度分阶段逐步扩展:从 4K 开始,依次提升至 16K、64K,最终扩展到 1M。训练初期使用稠密注意力进行预热,达到 64K 后引入稀疏注意力并持续至训练结束。稀疏注意力引入后先对索引器进行预热,再进入完整稀疏训练。

负载均衡采用无辅助损失策略,搭配轻量的序列级均衡损失以避免极端不均衡。多令牌预测损失权重在训练中期保持固定,末期学习率衰减时调低。

DeepSeek-V4-Pro训练流程整体与 Flash 一致,仅超参数数值不同。同样使用 Muon 与 AdamW 混合优化器,训练数据量为 33T tokens,最大批次略高于 Flash。学习率峰值与终值按比例调整。序列长度扩展策略相同,但稠密注意力预热阶段更长。其余均衡损失、稀疏注意力切换、多令牌预测损失权重等设置与 Flash 保持一致。

4.2.3 缓解训练不稳定性

训练万亿参数 MoE 模型面临显著的稳定性挑战,DeepSeek-V4 系列也不例外。训练中出现过明显的不稳定现象,简单回滚虽能暂时恢复状态,但无法从根本抑制损失突增。

实验发现,突变与 MoE 层的异常值高度相关,路由机制会进一步放大异常。因此我们从两个角度解决问题:打破由路由带来的恶性循环、直接抑制异常数值。我们最终确定了两项实用技术,可有效维持训练稳定,尽管其完整理论机理仍有待探索。

预期路由(Anticipatory Routing)将主干网络与路由网络的更新异步解耦,显著提升训练稳定性。具体做法是,当前步骤使用当前参数计算特征,但路由索引使用历史参数计算。工程上通过提前获取数据、预计算并缓存路由索引实现,额外耗时可控。同时配备自动检测机制,仅在出现损失突增时开启,运行一段时间后自动切回标准训练,以近乎可忽略的开销避免训练崩溃。

SwiGLU 截断在训练中对 SwiGLU 的线性部分进行数值范围限制,对门部分设置上界,可有效消除异常值,显著帮助稳定训练,且不会影响模型最终性能。

4.3 评估

4.3.1 评估基准

基座模型评估覆盖四大核心维度:世界知识、语言理解与推理、代码与数学、长上下文处理。

世界知识:包含通用知识、多语言知识、事实性问答等基准。

语言与推理:包含常识、逻辑推理、文本理解等任务。

代码与数学:包含代码生成、数学解题、竞赛数学等任务。

长上下文:使用长文本理解与检索评测集。

4.3.2 评估结果

在统一评估框架与一致设置下,对比 DeepSeek-V3.2、V4-Flash、V4-Pro 基座模型:

DeepSeek-V4-Flash-Base尽管总参与激活参数量更小,但在大多数评测任务上超过 V3.2,尤其在世界知识与长上下文场景优势明显,证明架构改进、数据质量与训练优化带来了更高效的性能提升。

DeepSeek-V4-Pro-Base实现全面、显著的能力跃升,在几乎所有任务上显著领先 V3.2 与 Flash。在知识类任务提升巨大,长上下文理解大幅进步,推理与代码任务同样超越前代,成为 DeepSeek 系列中综合能力最强的基座模型。

5. 后训练

在预训练完成后,我们通过一整套后训练流程得到 DeepSeek-V4 系列的最终模型。尽管整体训练流程很大程度上沿用了 DeepSeek-V3.2 的管线,但我们做了一个关键的方法替换:把混合强化学习阶段完全替换为在线策略蒸馏(OPD)。

5.1 后训练流程

5.1.1 领域专家训练

我们沿用 DeepSeek-V3.2 的训练流程来构建各领域专家模型。具体来说,每个模型依次经过两个阶段优化:先进行高质量领域数据的有监督微调,再使用面向领域的奖励信号与强化学习方法进一步提升。强化学习阶段我们采用分组相对策略优化(GRPO)算法,超参数设置与之前的研究保持接近。

推理强度模式

模型在推理任务上的表现,基本由计算投入的算力预算决定。因此我们为 DeepSeek-V4-Pro 和 Flash 分别训练了三种不同推理强度的专家模型,对应三种推理模式:

- 不思考(Non-think):快速、直觉式回答

- 深度思考(Think High):有意识的逻辑分析,更准确

- 极限思考(Think Max):算力拉满,彻底推理

不同模式使用不同的生成长度惩罚与上下文窗口,最终输出的推理 token 长度也不同。我们用标签把推理过程和最终答案分开,在极限思考模式下还会加入特殊指令引导模型彻底分解问题。

生成式奖励模型

简单可验证的任务可以用规则校验器或测试用例优化,但难验证的复杂任务通常需要人工标注的奖励模型。在 V4 系列的后训练中,我们不再使用传统的标量奖励模型,而是改用 ** 生成式奖励模型(GRM)** 来评估模型生成轨迹。我们直接对生成式奖励模型进行强化学习优化,让模型同时具备 "生成" 与 "评判" 两种能力,让内部推理过程更鲁棒,只需要少量多样化人工标注就能达到很强的泛化效果。

工具调用格式

我们继续使用标签来记录推理过程,并在 V4 中引入了新的、更稳定的 XML 格式工具调用协议,减少转义错误与工具调用失败率。

交错式推理记忆在多轮智能体交互中,DeepSeek-V3.2 会在用户新消息到来时清空推理历史,造成重复计算与上下文浪费。V4 系列利用 1M 上下文窗口,优化了推理历史管理策略:

- 工具调用场景:全程保留所有推理内容,跨轮次不清除,让模型保持连贯思考链;

- 普通对话场景:遇到新用户消息时仍丢弃推理历史,保持简洁。

快速指令为了避免重复预填充带来的延迟,我们在输入序列末尾加入一组专用特殊令牌,让模型直接复用 KV 缓存并行执行意图识别、搜索触发、标题生成、权威度判断、领域分类等辅助任务,大幅降低首 token 延迟,省去维护小模型的工程成本。

5.1.2 在线策略蒸馏

在通过有监督微调与强化学习训练出多个领域专家后,我们使用 ** 多教师在线策略蒸馏(OPD)** 作为合并专家能力的核心方法,把多个专家的能力整合到一个统一模型中。简单来说,让学生模型从教师模型的输出分布中学习,对齐多个专家的能力而不出现性能下降。

我们使用完整词表的对数几率蒸馏,而非简化版本,这样梯度更稳定,知识迁移更忠实。整个阶段用超过十个领域专家模型来蒸馏一个统一学生模型。

5.2 强化学习与蒸馏基础设施

后训练基础设施基于 DeepSeek-V3.2 的分布式框架构建,并做了几项关键增强,支持百万 token 上下文的高效强化学习与蒸馏。

5.2.1 FP4 量化集成

我们对推演、教师模型、参考模型的推理前向过程使用 FP4 量化,降低内存占用与采样延迟。训练阶段则无损转回 FP8,不影响反向传播逻辑。

5.2.2 全词表 OPD 的高效教师调度

系统支持任意数量教师模型的全词表蒸馏,教师参数以分片形式按需加载,避免显存爆炸。我们只缓存教师最后一层隐状态,训练时再重建对数几率,大幅节省存储。同一时间只加载一个教师头,进一步降低显存占用。

5.2.3 可抢占、容错的推演服务

为了最大化 GPU 利用率,我们的集群支持任务抢占与容错重启。系统为每一个生成请求维护细粒度预写日志,生成一个 token 就持久化一个。抢占发生时保存 KV 缓存与进度;恢复时直接从断点继续,避免从头生成带来的长度偏差,保证结果正确。

5.2.4 面向百万 token 上下文的可扩展强化学习框架

我们对数据格式做轻量化拆分,只加载必要元数据做全局洗牌,大批量现场加载,大幅降低 CPU/GPU 内存压力,支持百万 token 长序列训练。

5.2.5 智能体 AI 沙箱基础设施

为满足后训练与评估中的各类执行需求,我们搭建了生产级沙箱平台 DSec,支持函数调用、标准容器、微虚拟机、全虚拟机四种环境,统一 Python 接口。平台使用分层存储实现镜像快速加载,支持超高并发密度,并能在抢占后安全恢复,记录每一步命令与结果,支持确定性回放。

5.3 标准基准评估

5.3.1 评估设置

知识与推理、代码、数学、长上下文、智能体能力均使用行业主流与内部权威基准测试。不同推理模式使用不同温度与上下文窗口:8K、128K、384K。数学与推理任务要求模型分步解答并严格验证。智能体类任务最大交互步数设为 500,上下文长度最高支持到 512K。

5.3.2 评估结果

- 知识能力:V4-Pro-Max 在开源模型中达到全新 SOTA,显著超越前代,与闭源模型差距大幅缩小。

- 推理能力:在各类推理、奥数、竞赛数学、代码竞赛上大幅领先开源模型,接近闭源顶尖模型。

- 长上下文(1M token):在百万 token 检索与理解任务上超过 Gemini 3.1 Pro。

- 智能体能力:在代码智能体、搜索、工具使用、多步骤任务上达到开源顶尖,接近闭源模型水平。

不同推理模式对比显示:Think Max 模式在高难度任务上显著优于 High 模式,算力投入直接带来性能提升。

5.4 真实场景任务表现

5.4.1 中文写作

在中文实用文写作与创意写作中,DeepSeek-V4-Pro 对比 Gemini-3.1-Pro 胜率达到 62.7%,在指令遵循、文风贴合、格式规范、长文本生成上优势明显。

5.4.2 搜索

在检索增强问答与智能体搜索中,V4-Pro 显著优于 V3.2,在精准信息查找、计划策略、多源总结上提升最大。智能体搜索比传统 RAG 效果更强,成本仅小幅上升。

5.4.3 白领办公任务

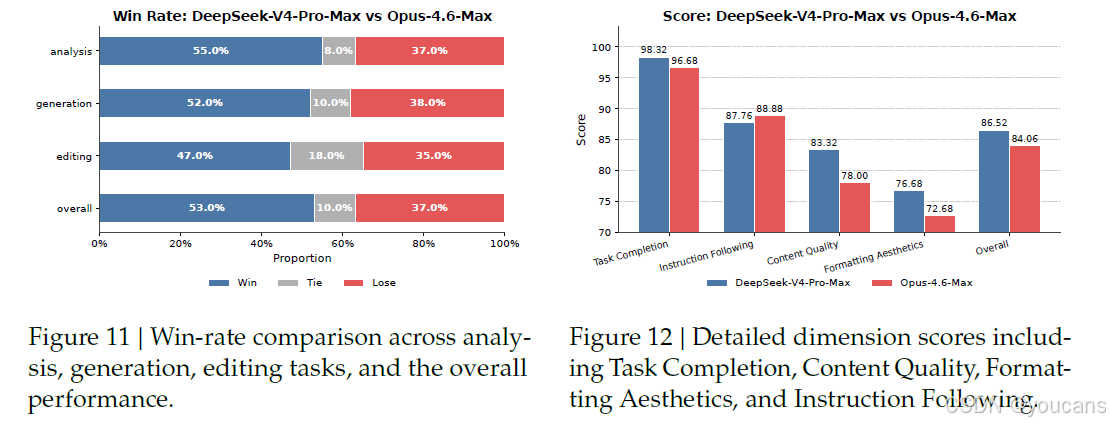

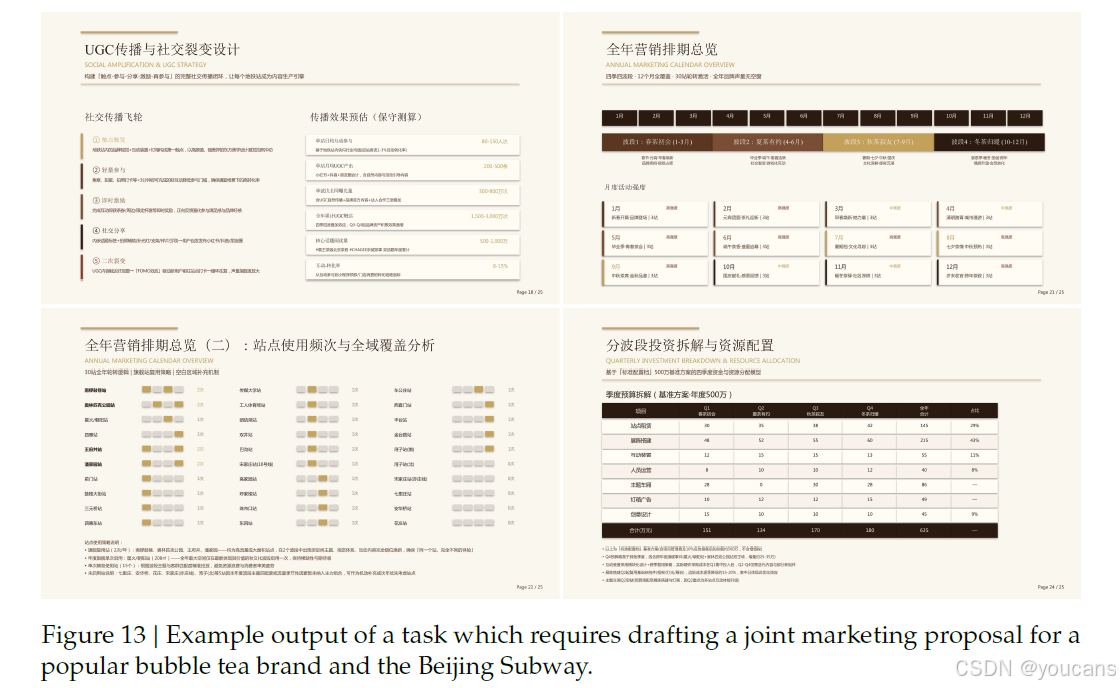

在 30 项高级中文专业任务中,DeepSeek-V4-Pro-Max 对比 Claude Opus 4.6 Max 不低于 63%,在任务完成度、内容质量、分析深度、文档生成上全面占优。

5.4.4 代码智能体

在真实研发场景的代码任务集上,V4-Pro 通过率显著超越 Claude Sonnet 4.5,接近 Opus 4.5 水平。内部开发者调研显示,超过 90% 的开发者愿意将其作为默认主力代码模型。

6. 结论、局限性与未来方向

结论

本文提出了 DeepSeek‑V4 系列模型预览版,旨在打造突破超长上下文效率瓶颈的下一代大语言模型。通过融合 CSA + HCA 混合注意力架构,DeepSeek‑V4 在长序列处理效率上实现了大幅跃升。配合一系列基础设施优化,模型得以原生、高效地支持 100 万 token 上下文,为测试时扩容、长视野任务以及在线学习等新范式奠定了基础。

评测结果表明:

- DeepSeek‑V4‑Pro‑Max 重新定义了开源模型的最优水平,在知识类基准上大幅超越过往开源模型,推理性能接近头部闭源模型,智能体能力达到主流水准。

- DeepSeek‑V4‑Flash‑Max 以轻量化架构实现了与领先闭源模型相当的推理表现,同时保持极高的成本效率。

我们相信,DeepSeek‑V4 系列为开源模型开启了百万上下文长度的新时代,为更高效、更大规模、更智能的模型发展铺平道路。

局限性

为了实现极致的长上下文效率,DeepSeek‑V4 采用了较为创新的架构设计。为控制风险,我们保留了大量经过初步验证的组件与工程技巧,这些方法虽然有效,但也使得整体架构相对复杂。

此外,尽管预期路由与 SwiGLU 截断被证明能有效缓解训练不稳定问题,但其内在原理仍缺乏充分的理论解释。

未来方向

未来,我们将从以下方向持续迭代:

- 架构精简与理论化:

对现有架构进行更系统、更本质的梳理,在不损失性能的前提下,提炼核心设计,让架构更简洁优雅。 - 训练稳定性的理论研究:

深入研究大规模训练稳定性的基础问题,完善监测与理论解释,形成更具预测性的稳定训练方案。 - 更高效率的稀疏化探索:

在 MoE 和稀疏注意力之外,探索新的稀疏维度(如更稀疏的嵌入模块),在不降低能力的前提下提升计算与内存效率。 - 更低延迟的架构与系统优化:

持续研究低延迟架构与系统技术,让超长上下文的部署与交互更加流畅、响应更快。 - 强化长视野、多轮智能体能力:

长期投入多轮、长流程、复杂目标的智能体任务研究,持续迭代升级。 - 多模态能力:

将多模态能力融入模型体系,拓展模型的感知与理解范围。 - 数据与合成策略升级:

持续优化数据构建与合成策略,不断提升模型的智能水平、鲁棒性与广泛场景的实用性。

版权声明:

本文由 youcans@xidian 对技术报告 "DeepSeek-V4:迈入百万上下文普惠时代(Towards Highly Efficient Million-Token Context Intelligence)" 进行摘编和翻译,只供研究学习使用。

youcans@xidian 作品 ,转载必须标注原文链接:

【DeepSeek论文精读】18. DeepSeek-V4:迈入百万上下文的普惠智能 (https://blog.csdn.net/youcans/article/details/160478185)

Copyright 2026 youcans@Xidian

Created:2026-04