文章目录

- 一、前言

- 二、FLUX.1架构

-

- [2.3 Transformer](#2.3 Transformer)

- [2.3 Transformer](#2.3 Transformer)

-

- [2.3.1 每次迭代预处理](#2.3.1 每次迭代预处理)

- [**图7解释:Flux Transformer:每迭代输入预处理**](#图7解释:Flux Transformer:每迭代输入预处理)

-

- [**第一部分:指导嵌入(Guiding embeds - `temb`)的构建 (红色虚线框)**](#第一部分:指导嵌入(Guiding embeds -

temb)的构建 (红色虚线框)) - [**第二部分:位置嵌入(Pos embeds)的构建 (紫色虚线框)**](#第二部分:位置嵌入(Pos embeds)的构建 (紫色虚线框))

- [**第三部分:主 Transformer 块的输入统一化**](#第三部分:主 Transformer 块的输入统一化)

- [**第一部分:指导嵌入(Guiding embeds - `temb`)的构建 (红色虚线框)**](#第一部分:指导嵌入(Guiding embeds -

- [**为什么 `timesteps` 和 `guidance_scale` 要先经过正弦投影再线性投影?**](#为什么

timesteps和guidance_scale要先经过正弦投影再线性投影?) - **梳理所有维度变化(以图7为核心,并结合相关上下文)**

-

- [**1. `timesteps` (int.) 的维度变化:**](#1.

timesteps(int.) 的维度变化:) - [**2. `guidance_scale` (Int.) 的维度变化:**](#2.

guidance_scale(Int.) 的维度变化:) - [**3. `Pooled projection` (来自 CLIP) 的维度变化:**](#3.

Pooled projection(来自 CLIP) 的维度变化:) - [**4. `Guiding embeds (temb)` 的构建 (红色虚线框的最终输出):**](#4.

Guiding embeds (temb)的构建 (红色虚线框的最终输出):) - [**5. `Text_ids` (Zeros(n,3)) 的维度变化:**](#5.

Text_ids(Zeros(n,3)) 的维度变化:) - [**6. `img_ids` ((hxw),3) 的维度变化:**](#6.

img_ids((hxw),3) 的维度变化:) - [**7. `Pos embeds` 的构建 (紫色虚线框的最终输出):**](#7.

Pos embeds的构建 (紫色虚线框的最终输出):) - [**8. `Hidden states` (图像潜在表示) 的维度变化:**](#8.

Hidden states(图像潜在表示) 的维度变化:) - [**9. `Encoder hidden states` (T5 文本嵌入) 的维度变化:**](#9.

Encoder hidden states(T5 文本嵌入) 的维度变化:)

- [**1. `timesteps` (int.) 的维度变化:**](#1.

- [Text_ids和img_ids这是什么意思?3D索引又是什么意思?为什么之后要拼接起来?Flux positional embedder在做什么?为什么说它在不同采样步中是恒定不变的?](#Text_ids和img_ids这是什么意思?3D索引又是什么意思?为什么之后要拼接起来?Flux positional embedder在做什么?为什么说它在不同采样步中是恒定不变的?)

- [**1. `Text_ids` 和 `img_ids` 是什么意思?**](#1.

Text_ids和img_ids是什么意思?) - [**2. 3D 索引又是什么意思?**](#2. 3D 索引又是什么意思?)

- [**3. 为什么之后要拼接起来?**](#3. 为什么之后要拼接起来?)

- [**4. `Flux positional embedder` 在做什么?**](#4.

Flux positional embedder在做什么?) - [**5. 为什么说它在不同采样步中是恒定不变的?**](#5. 为什么说它在不同采样步中是恒定不变的?)

- 问题

-

- [1. 文本和图像的编码与表示](#1. 文本和图像的编码与表示)

- [2. 噪声图像在文本约束下预测速度](#2. 噪声图像在文本约束下预测速度)

- [3. 文字位置编码为什么被统一设为0?模型如何区分不同文本token之间的顺序和相对位置?](#3. 文字位置编码为什么被统一设为0?模型如何区分不同文本token之间的顺序和相对位置?)

- [4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?](#4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?)

- [1. 文本和图像的编码与表示](#1. 文本和图像的编码与表示)

- [2. 噪声图像在文本约束下预测速度](#2. 噪声图像在文本约束下预测速度)

- [3. 文字位置编码为什么被统一设为0?模型如何区分不同文本 token 之间的顺序和相对位置?它后面怎么起到约束作用?](#3. 文字位置编码为什么被统一设为0?模型如何区分不同文本 token 之间的顺序和相对位置?它后面怎么起到约束作用?)

- [4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?](#4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?)

一、前言

仅供参考,未经实验验证。参考资料:

Demystifying Flux Architecture

论文地址:https://arxiv.org/pdf/2507.09595

二、FLUX.1架构

2.3 Transformer

在第 2.3 节中,我们探讨了 v θ v_θ vθ的架构。经过迭代优化后,最终干净的潜在变量 z 1 z_1 z1通过预训练的VAE模型解码,得到最终图像 x 1 x_1 x1。

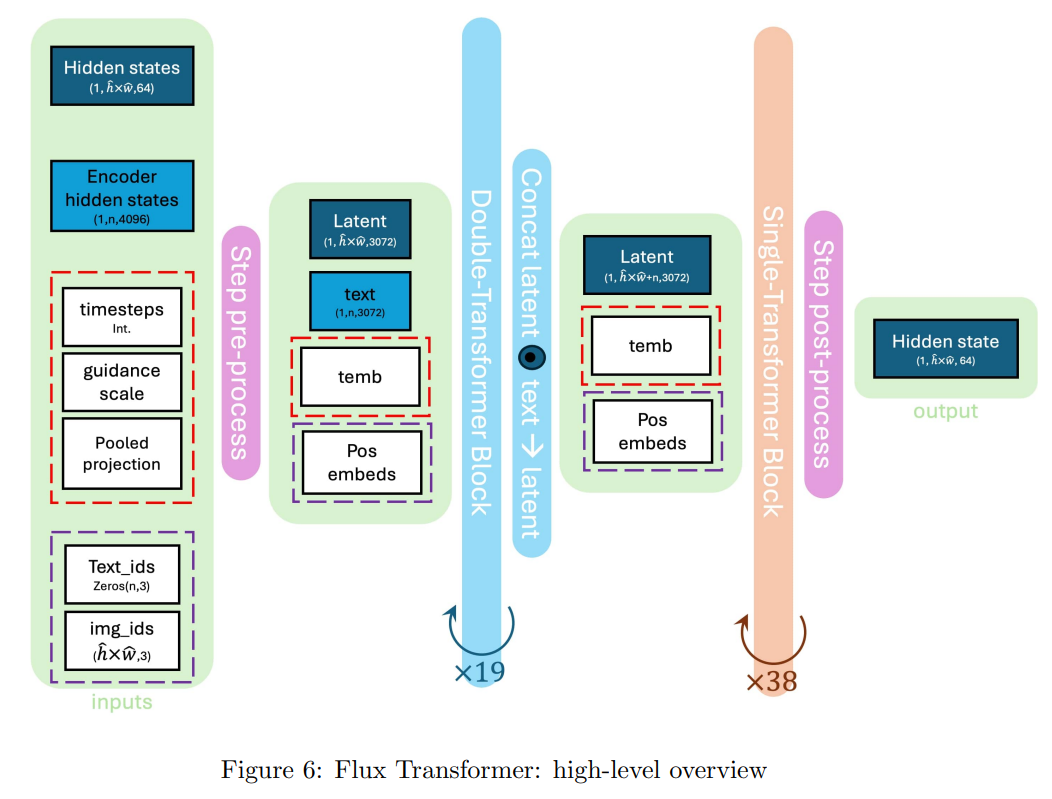

图 6:Flux Transformer:高级概述

图 6:Flux Transformer:高级概述

2.3 Transformer

FLUX.1的合成管线中的核心组件是速度预测器 v θ v_θ vθ,它被优化用于估计采样轨迹上的速度矢量(参见第1.4节)。与SD3 [8]类似,FLUX.1用全Transformer设计取代了传统的U-Net架构。

图 6 使用 diffusers [19] 的官方实现中定义的符号,对 Transformer 在每个采样步骤的操作进行了高级概述。在每次迭代中,输入会经过预处理,然后被送入一系列 Transformer 块。

Transformer 块有两种类型:(1) 双流(见 2.3.2 节)和 (2) 单流(见 2.3.3 节)。这两个块都采用多模态注意力:联合自注意力机制来处理连接的文本和图像 token,在一个统一的注意力操作中,实现双向交互,捕捉文本和图像模态之间的自信息和跨模态信息。下面我们提供一个关于迭代预处理(2.3.1 节)、双流(2.3.2 节)和单流(2.3.3 节)注意力块的逐步指南。

2.3.1 每次迭代预处理

在采样轨迹中,Transformer 被调用多次,在每次采样迭代时调用一次。在每次调用中,它都会接收到一组更新后的参数:

• 引导参数时间步长从预先计算的值列表中在1和0之间迭代。

• z t z_t zt(在 diffusers 官方实现中指代隐状态 [19])是从高斯噪声中(迭代地)细化为清晰图像的潜在表示。它在采样轨迹中被更新。

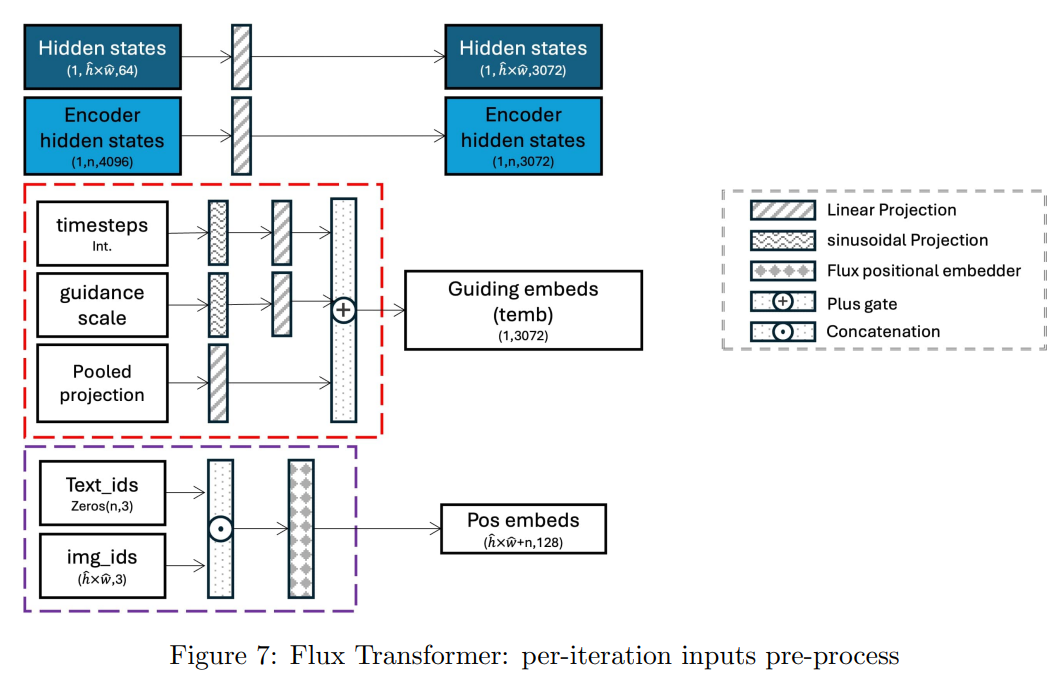

这些参数与在管道预处理阶段(第 2.2.1 节)预先计算的"恒定"输入(在不同迭代中保持不变)相结合。Transformer 按照图 7 中的描述在内部预处理其输入。形式上,执行以下步骤:

• 使用每个域的线性层将潜在嵌入和密集提示嵌入(T5)映射到每个 token 共享的 3072 特征维度。

• 引导嵌入的构建。与仅在这一阶段编码"时间"信息(即时间步)的扩散模型不同,FLUX.1 同时使用时间步和池化后的提示嵌入(来自CLIP)作为引导嵌入,但保留了传统表示 temb。它使用正弦投影(如[4]所示)来嵌入时间步和引导的整数值,然后对每个分量应用专用的线性投影层,将其映射到 3072 个特征的共享维度。最后,将 3 个投影后的嵌入相加,创建最终的 temb(在图 7 的红色块中标记)。

• 图像ID和文本ID(参见第2.2节)被连接起来,然后用于提取每个token的位置嵌入。为了从3D token索引(t,h,w)中提取位置嵌入,首先使用轴特定的正弦频率将每个轴转换为连续嵌入,并由常数 θ θ θ 进行缩放。计算所得频率-位置乘积的余弦和正弦,并将它们交错排列以形成实值向量。然后将所有轴的向量连接起来,生成最终的位置嵌入,作为一对张量(余弦和正弦),可用于旋转位置编码(该过程在图7的紫色块中完成)。请注意,此过程不受时间步长或隐藏状态的影响,因此位置嵌入在不同的采样步骤中是恒定的。

pos_embeds和temb参数用于支持沿步骤(step)的注意力机制,同时隐藏状态和编码器隐藏状态沿步骤被处理和细化。

图 7:Flux Transformer:每次迭代的输入预处理

图 7:Flux Transformer:每次迭代的输入预处理

图7解释:Flux Transformer:每迭代输入预处理

总体目的:

这张图(图7)详细展示了 FLUX.1 模型在每次迭代(即采样步)之前,如何对各种输入数据进行预处理,以准备它们被主 Transformer 块使用。这个预处理阶段的目的是将不同类型、不同维度的输入(如时间步、引导尺度、文本嵌入和位置信息)转化为统一且具有丰富语义的表示形式,供 Transformer 进行图像潜在空间的迭代细化。

核心思想:

不同于传统扩散模型仅编码时间信息,FLUX.1 在此阶段会同时处理时间信息、引导信息和位置信息 ,并将它们与文本嵌入一起,转化为 Transformer 能够理解和利用的"指导嵌入"(temb)和"位置嵌入"(pos_embeds)。这使得模型能够更精细地控制生成过程,实现高质量的文本到图像合成。

分步拆解与关键模块解释:

整个预处理流程可以分为两个主要部分:指导嵌入(Guiding embeds)的构建 (红色虚线框)和位置嵌入(Pos embeds)的构建 (紫色虚线框),以及主 Transformer 块输入的统一化。

第一部分:指导嵌入(Guiding embeds - temb)的构建 (红色虚线框)

这个模块的目的是生成一个名为 temb 的指导嵌入,它综合了时间步、引导尺度和 CLIP 的全局文本信息。

-

输入源:

timesteps(int.): 当前采样步的时间步,是一个整数值。guidance_scale(Int.): 控制文本条件强度(即模型对文本提示的遵循程度)的整数值。Pooled projection: 来自 CLIP 文本编码器的池化嵌入,它代表了整个文本提示的全局语义信息。

-

处理流程:

timesteps和guidance_scale的处理:- 这两个整数值首先通过正弦投影 (sinusoidal Projection) 进行编码。正弦投影是一种将离散或连续数值(如时间步)映射到高维向量的常用方法,它能捕捉数值的相对和绝对位置信息。

- 正弦投影的输出再经过一个专用线性投影 (Linear Projection) ,将它们转换到与最终

temb相同的特征维度(3072维)。

Pooled projection的处理:Pooled projection(来自 CLIP 的全局文本嵌入)也通过一个线性投影 (Linear Projection),将其维度调整到3072维。

- 求和 (Plus gate):

- 这三组经过投影的嵌入(来自

timesteps、guidance_scale和Pooled projection)被逐元素相加 (Plus gate)。 - 设计原理: 将三者相加是为了将时间信息、引导强度信息和全局文本语义信息融合 到一个单一的指导向量中。这意味着

temb不仅告诉 Transformer 当前是哪个时间步,还告诉它应该以多大的强度遵循文本提示,以及文本提示的整体含义是什么。这种融合使得 Transformer 块能够根据这些关键控制信号动态地调整其行为。

- 这三组经过投影的嵌入(来自

-

输出:

Guiding embeds (temb)(1, 3072): 最终生成的指导嵌入,维度为(1, 3072),它包含了所有用于指导当前迭代的信息。

第二部分:位置嵌入(Pos embeds)的构建 (紫色虚线框)

这个模块的目的是生成图像和文本标记的逐标记位置嵌入。

-

输入源:

Text_ids(Zeros(n,3)): 文本标记的3D索引(t, h, w),但对于文本标记,t, h, w 都设为0。n是 T5 编码器处理的最大标记数(通常为512)。img_ids(hxw,3): 图像标记的3D索引 (t, h, w),其中h和w代表图像潜在空间的二维位置,t是时间步(但在此处也用于位置编码)。

-

处理流程:

- 拼接 (Concatenation):

Text_ids和img_ids首先被拼接 (Concatenation) 起来。这创建了一个统一的标记索引序列,包含了所有文本和图像标记的位置信息。

- Flux positional embedder:

- 拼接后的索引序列通过一个Flux positional embedder 进行处理。

- 设计原理: 这个模块将每个3D索引 (t, h, w) 转换为连续嵌入。它通过对每个轴使用特定的正弦频率进行缩放,然后计算余弦和正弦值,并交错排列以形成实值向量。最终,这些向量在所有轴上拼接起来,形成最终的位置嵌入。

- 关键信息: 论文提到,这个过程不受

timestep或hidden_states的影响,这意味着**pos_embeds在不同的采样步中是恒定不变的**。这与传统的 Transformer 位置编码(通常随序列长度固定)一致,但在扩散模型中,它为图像和文本标记提供了一个稳定的空间上下文。

- 拼接 (Concatenation):

-

输出:

Pos embeds(hxw+n, 128): 最终生成的逐标记位置嵌入,维度为(hxw+n, 128),其中hxw是图像潜在空间中的标记数量,n是文本标记数量。

第三部分:主 Transformer 块的输入统一化

除了上述指导嵌入和位置嵌入的构建,图的顶部还显示了 Hidden states 和 Encoder hidden states 的预处理。

-

Hidden states(1, hxw, 64) -> (1, hxw, 3072):- 这是当前迭代中图像潜在空间的表示。它通过一个线性投影 (Linear Projection) 转换为与

Encoder hidden states和temb相同的特征维度(3072维)。

- 这是当前迭代中图像潜在空间的表示。它通过一个线性投影 (Linear Projection) 转换为与

-

Encoder hidden states(1, n, 4096) -> (1, n, 3072):- 这是来自 T5 文本编码器的逐标记文本嵌入。它也通过一个线性投影 (Linear Projection) 转换为3072维。

- 设计原理: 这种维度统一化是必要的,因为它允许 Transformer 块在统一的特征空间中处理图像和文本信息,从而实现多模态的交互。

协作关系与如何实现论文目标:

- 多模态对齐: 通过将图像潜在状态 (

Hidden states)、详细的文本嵌入 (Encoder hidden states)、全局指导信息 (temb) 和精确的位置信息 (pos_embeds) 全部转化为统一的特征表示,FLUX.1 确保了 Transformer 块在每次迭代时都能获得最全面、最细致的上下文信息。 - 精细控制:

temb的引入(融合了时间步、引导尺度和 CLIP 全局嵌入)是 FLUX.1 的一个关键创新。它使得模型能够同时感知 当前去噪进度、用户对提示的期望强度以及文本提示的整体意图,从而在生成过程中实现更精细、更鲁棒的控制。 - 空间感知:

pos_embeds为图像和文本标记提供了明确的空间和序列位置信息,这对于 Transformer 理解图像结构、文本顺序以及它们之间的空间关系至关重要,尤其是在处理复杂场景和长文本提示时。 - Transformer 友好: 整个预处理过程将异构输入转化为 Transformer 能够高效处理的标准化的、高维的向量序列,为后续的 Double-Stream 和 Single-Stream Transformer 块进行复杂的自注意力(Self-Attention)和交叉注意力(Cross-Attention)计算奠定了基础,最终实现高质量、高文本对齐度的图像生成。

这个精心设计的预处理阶段是 FLUX.1 能够超越传统扩散模型,在图像质量、文本对齐和多样性方面达到 SoTA 性能的重要基石。

问题1:为什么timesteps和guidance_scale要先经过正弦投影再线性投影,梳理一下所有维度变化

好的,这是一个关于FLUX.1模型预处理阶段中,timesteps 和 guidance_scale 具体处理逻辑的深度问题。我将详细解释为什么它们需要经过正弦投影再线性投影,并梳理整个维度变化过程。

为什么 timesteps 和 guidance_scale 要先经过正弦投影再线性投影?

这个设计是为了有效地将离散/连续的标量信息(时间步、引导尺度)编码成Transformer 能够理解和利用的高维、有语义的向量表示。

-

正弦投影 (Sinusoidal Projection) 的作用:

- 捕捉位置信息(Positional Information): Transformer 模型本身是位置无关 的。这意味着如果仅仅将

timesteps(例如 0 到 1000 的整数) 或guidance_scale(例如 0 到 15 的浮点数) 直接输入到线性层,模型将无法区分相邻数值之间的相对顺序和距离 。正弦投影(通常基于sin和cos函数)可以将一个标量值映射成一个高维向量,这个向量的每个维度都携带了关于原始标量值的频率和相位信息。 - 连续性和可泛化性: 正弦函数是连续的,这意味着即使

timesteps或guidance_scale的值发生微小变化,其投影后的向量也会平滑变化。这有助于模型学习到这些参数的连续性影响 ,并且能够泛化到训练中未曾见过的中间值。 - 区分相似值: 对于相近的

timesteps或guidance_scale,正弦投影会生成略有不同的向量,使得模型能够区分它们。而对于相距较远的值,向量之间的差异会更大,从而更好地表示它们之间的距离。 - 避免数值大小偏见: 如果直接将

timesteps(例如 1000) 输入线性层,其数值大小可能会导致权重偏向处理大数值,而正弦投影将数值映射到固定范围(-1到1)的周期函数中,消除了这种数值大小带来的潜在偏见。

- 捕捉位置信息(Positional Information): Transformer 模型本身是位置无关 的。这意味着如果仅仅将

-

线性投影 (Linear Projection) 的作用:

- 维度对齐与特征提取: 正弦投影生成的向量维度通常是预设的(例如,可以生成一个128维的向量)。然而,为了与其他嵌入(如

Pooled projection)进行融合(相加) ,这些向量必须具有相同的目标特征维度 (在 FLUX.1 中是3072维)。线性投影(一个全连接层)就是用来完成这个维度转换和对齐的任务。 - 学习特定表示: 线性投影不仅仅是维度变换,它也是一个可学习的参数层 。这意味着模型可以通过训练来学习如何从正弦投影生成的通用位置特征中,提取出对当前任务(图像生成)最有用的、特定于

timesteps和guidance_scale的特征。它允许模型根据下游任务的需求对这些信息进行进一步的编码和精炼。

- 维度对齐与特征提取: 正弦投影生成的向量维度通常是预设的(例如,可以生成一个128维的向量)。然而,为了与其他嵌入(如

总结:

正弦投影 负责将标量值转化为具有位置和相对顺序语义的高维、周期性特征 ,使其对 Transformer "可见"且可区分。线性投影 则在此基础上,将这些特征调整到正确的维度 ,并学习任务特定的表示 ,以便与其他模态信息无缝融合。两者结合,使得 timesteps 和 guidance_scale 这类重要的控制信号能够被 Transformer 充分理解和利用,从而指导图像生成过程。

梳理所有维度变化(以图7为核心,并结合相关上下文)

我们以一个假设的输入为例来追踪维度变化:

- 假设图像潜在空间尺寸:

H=256, W=256。 - VAE

scale=8,因此图像潜在维度h = H//VAEscale = 32,w = W//VAEscale = 32。 - 图像标记数量

hxw = 32*32 = 1024。 - T5 文本编码器最大标记数

n = 512。 - 目标指导嵌入维度:3072。

- 目标位置嵌入维度:128。

1. timesteps (int.) 的维度变化:

- 原始输入:

int(例如:500) - 经过正弦投影 (Sinusoidal Projection):

int->(一些中间维度)(例如:128维)- 解释: 将标量

int映射为高维向量,捕捉其位置信息。

- 解释: 将标量

- 经过专用线性投影 (Linear Projection):

(一些中间维度)->(1, 3072)- 解释: 将正弦投影后的向量维度调整到3072维,以匹配

temb的目标维度。

- 解释: 将正弦投影后的向量维度调整到3072维,以匹配

2. guidance_scale (Int.) 的维度变化:

- 原始输入:

int(例如:7.5) - 经过正弦投影 (Sinusoidal Projection):

int->(一些中间维度)(例如:128维)- 解释: 与

timesteps类似,捕捉其标量值的位置和相对强度信息。

- 解释: 与

- 经过专用线性投影 (Linear Projection):

(一些中间维度)->(1, 3072)- 解释: 将维度调整到3072维。

3. Pooled projection (来自 CLIP) 的维度变化:

- 原始输入:

(1, 某个维度)(例如:CLIP 通常输出 768 或 1024 维的池化嵌入,我们假设为(1, 768)) - 经过专用线性投影 (Linear Projection):

(1, 768)->(1, 3072)- 解释: 直接通过线性层将 CLIP 的池化嵌入维度调整到3072维。

4. Guiding embeds (temb) 的构建 (红色虚线框的最终输出):

- 输入:

timesteps线性投影输出:(1, 3072)guidance_scale线性投影输出:(1, 3072)Pooled projection线性投影输出:(1, 3072)

- 经过求和 (Plus gate): 三个

(1, 3072)的向量进行逐元素相加。 - 最终输出:

(1, 3072)(即temb)

5. Text_ids (Zeros(n,3)) 的维度变化:

- 原始输入:

(n, 3)(例如:(512, 3))- 解释:

n是文本标记数,3是 (t, h, w) 索引。

- 解释:

6. img_ids ((hxw),3) 的维度变化:

- 原始输入:

(hxw, 3)(例如:(1024, 3))- 解释:

hxw是图像标记数,3是 (t, h, w) 索引。

- 解释:

7. Pos embeds 的构建 (紫色虚线框的最终输出):

- 输入:

Text_ids:(n, 3)img_ids:(hxw, 3)

- 经过拼接 (Concatenation):

(n, 3)和(hxw, 3)在第一个维度上拼接。 - 中间输出:

(n + hxw, 3)(例如:(512 + 1024, 3) = (1536, 3)) - 经过 Flux positional embedder:

(n + hxw, 3)->(n + hxw, 128)- 解释: 将3D索引映射为128维的位置嵌入。

- 最终输出:

(n + hxw, 128)(即Pos embeds) (例如:(1536, 128))

8. Hidden states (图像潜在表示) 的维度变化:

- 原始输入:

(1, hxw, 64)(例如:(1, 1024, 64))- 解释:

1是 batch size,hxw是图像标记数,64是每个标记的特征维度。

- 解释:

- 经过 Per-domain linear layer (图7左上角的 "Linear Projection"):

(1, hxw, 64)->(1, hxw, 3072)- 解释: 将图像潜在嵌入的维度提升到3072维,与文本嵌入对齐。

9. Encoder hidden states (T5 文本嵌入) 的维度变化:

- 原始输入:

(1, n, 4096)(例如:(1, 512, 4096))- 解释:

1是 batch size,n是文本标记数,4096是 T5 编码器输出的每个标记的特征维度。

- 解释:

- 经过 Per-domain linear layer (图7右上角的 "Linear Projection"):

(1, n, 4096)->(1, n, 3072)- 解释: 将 T5 文本嵌入的维度调整到3072维。

总结表格:

| 输入/输出项 | 原始维度/类型 | 中间处理 | 最终维度/类型 (进入 Transformer 块前) |

|---|---|---|---|

timesteps |

int |

正弦投影 -> 线性投影 | (1, 3072) |

guidance_scale |

int |

正弦投影 -> 线性投影 | (1, 3072) |

Pooled projection (CLIP) |

(1, 768) (示例) |

线性投影 | (1, 3072) |

Guiding embeds (temb) |

(由上述三项相加) | N/A | (1, 3072) |

Text_ids |

(n, 3) |

拼接 | (n + hxw, 3) (拼接后) |

img_ids |

(hxw, 3) |

拼接 | (n + hxw, 3) (拼接后) |

Pos embeds |

(由拼接后的 (n+hxw,3)) |

Flux positional embedder | (n + hxw, 128) |

Hidden states (图像潜在) |

(1, hxw, 64) |

Per-domain linear layer | (1, hxw, 3072) |

Encoder hidden states (T5) |

(1, n, 4096) |

Per-domain linear layer | (1, n, 3072) |

通过这个详尽的维度变化梳理,我们可以清晰地看到 FLUX.1 如何将各种异构输入统一并丰富化,为多模态 Transformer 的迭代细化过程提供全面的指导信息。

Text_ids和img_ids这是什么意思?3D索引又是什么意思?为什么之后要拼接起来?Flux positional embedder在做什么?为什么说它在不同采样步中是恒定不变的?

1. Text_ids 和 img_ids 是什么意思?

在 FLUX.1 的设计中,Text_ids 和 img_ids 并不是直接的文本或图像内容,而是用于编码其空间(或时间-空间)位置的标识符。由于 FLUX.1 采用 Transformer 架构,它需要一种机制来理解输入序列中每个"token"的位置信息,因为 Transformer 的自注意力机制本身是位置无关的。

-

img_ids(Image IDs):- 含义: 它是一组针对图像潜在空间中的每个"token"生成的3D 坐标标识符。

- 结构:

(hxw, 3),其中hxw是图像潜在表示中的 token 数量(例如,如果原始图像是512x512,VAE下采样8倍,则潜在空间是64x64,hxw就是64*64=4096个 token),3表示每个 token 有一个三维坐标。 - 具体组成: 这三个维度通常代表

(t, h, w),即时间步 、高度 和宽度 。在图像 token 的情况下,论文指出t、h、w对应图像 token 在 2D 空间网格上的位置。 - 作用: 它们为每个图像潜在 token 提供了一个独特的空间位置锚点,使得模型能够理解图像内部的结构关系。

-

Text_ids(Text IDs):- 含义: 它是一组针对文本嵌入中的每个"token"生成的3D 坐标标识符。

- 结构:

(n, 3),其中n是文本 token 的数量(例如,T5 编码器处理的最大 token 数是512),3同样表示三维坐标。 - 具体组成: 论文中提到

Text_ids是"使用与img_ids相同的结构初始化,但所有 token 的t=h=w=0"。这意味着文本 token 的3D索引被统一设定为(0, 0, 0)。 - 作用: 虽然它们的坐标被统一设置为

(0,0,0),但它们仍然占据了序列中的特定位置,允许后续的位置编码器为文本 token 生成特定的位置嵌入。这种统一设置可能意味着在文本内部,更依赖于自注意力来捕捉语义关系,而3D索引更多是为了与图像token的结构保持一致,以便进行统一的位置编码处理。

2. 3D 索引又是什么意思?

3D 索引 (t, h, w) 是指将每个图像或文本 token 映射到一个三维坐标空间中的一个点。

t(timestep): 在标准的图像生成任务中,这通常指扩散过程中的时间步 。然而,在img_ids和Text_ids的上下文中,论文提到t、h、w是指 token 在 2D 空间网格上的位置(对于图像 token),并且Text_ids的t=h=w=0。这可能意味着这里的t并不直接是扩散时间步,而是作为位置编码的另一个维度 ,或者在某些多阶段生成任务中(例如视频生成,但本文是图像)可能代表不同的帧。在本文的图像生成语境下,它更可能是一个抽象的、用于位置编码的额外维度。h(height): 代表 token 在垂直方向上的位置。w(width): 代表 token 在水平方向上的位置。

这些3D索引共同为每个 token 提供了一个离散的、多维的位置描述。

3. 为什么之后要拼接起来?

img_ids 和 Text_ids 拼接起来是为了统一处理。

- 背景: FLUX.1 的 Transformer 架构(特别是

Double-Stream Transformer Block和Single-Stream Transformer Block)采用了多模态注意力机制 。这意味着它需要同时处理来自图像模态 和文本模态的 token。 - 目的: 为了让 Transformer 能够同时关注图像和文本 token,它们首先在特征层面 被拼接在一起。相应地,它们的位置信息也需要被统一起来,以便

Flux positional embedder能够为整个拼接序列生成连续且有意义的位置嵌入。 - 优势: 这种拼接操作允许 Transformer 块内部的自注意力机制在图像 token 之间 (捕捉图像内部结构)、文本 token 之间 (捕捉文本语义)以及图像 token 和文本 token 之间 (实现跨模态对齐和条件生成)进行双向交互。通过共享同一个位置编码器,确保了位置编码的一致性,有助于模型理解不同模态 token 之间的相对位置关系。

4. Flux positional embedder 在做什么?

Flux positional embedder 负责将拼接后的3D索引 (n + hxw, 3) 转化为高维的连续位置嵌入 (n + hxw, 128)。

具体步骤如下:

- 轴特定正弦频率转换: 对于每个3D索引

(t, h, w),Flux positional embedder会将每个轴(t、h、w)的整数值转换为一个连续的嵌入 ,使用轴特定的正弦频率进行缩放。这类似于传统的正弦位置编码,但在这里是针对每个坐标轴独立进行的。 - 生成正弦和余弦对: 对于每个轴的连续嵌入,计算其正弦 (sine) 和余弦 (cosine) 值。这些值被交错排列,形成实值向量。

- 跨轴拼接: 将所有轴(

t、h、w)生成的正弦/余弦向量在维度上拼接起来。 - 最终位置嵌入: 拼接后的向量构成每个 token 的最终位置嵌入

(128维)。

功能总结: 它的核心作用是为 Transformer 提供密集的、连续的、有方向感的位置信息 ,使得 Transformer 能够理解序列中每个 token 的绝对和相对位置,从而更好地捕捉空间结构和序列顺序。论文提到其过程是"in rotary positional encoding"(用于旋转位置编码),这意味着这些位置嵌入将用于 RoPE (Rotary Positional Embeddings) 机制,通过旋转 Query 和 Key 向量来注入位置信息,而不是直接加到输入嵌入上。

5. 为什么说它在不同采样步中是恒定不变的?

论文中明确指出:"Note that this process is not influenced neither by timestep nor hidden_states, hence the pos_embeds are constant across different sampling steps."

这背后的原因在于:

- 独立性设计:

Flux positional embedder的输入是img_ids和Text_ids。如前所述,img_ids是由目标分辨率 决定的(例如64x64的网格),而Text_ids是固定的(0,0,0)。这些ID 自身在整个推理采样过程中是不会改变的。 - 与

timesteps的区别: 尽管img_ids和Text_ids中包含一个t维度,但这个t维度并非 外部输入的、不断变化的扩散时间步timestep(迭代参数) 。它更像是一个抽象的、用于构建3D位置坐标的维度。而真正指导扩散过程的迭代参数timestep(在temb中)是独立于pos_embeds计算的。 - 与

hidden_states的区别:hidden_states是模型在每个采样步中迭代更新的图像潜在表示 。Flux positional embedder的输入是token 的位置索引 ,而不是 token 的内容特征 。因此,它的计算与hidden_states的内容变化无关。

核心思想: pos_embeds 旨在提供静态的、基础的空间结构信息 ,它描述的是"这个 token 在图像网格的哪个位置?"或"这个 token 是文本序列中的第几个?"。这些位置信息一旦确定了图像的目标分辨率和文本的长度,就不会在采样迭代中改变。而动态的、与扩散过程相关的条件信息 (如当前扩散时间步 timestep 和引导强度 guidance_scale)则通过 temb 参数注入,与 pos_embeds 分开处理。这种分离确保了位置编码的稳定性和一致性,同时允许其他条件信息灵活地指导生成过程。

问题

我的理解是这样你看对不对,文本引导图像生成的话,文本会被编码成token,这是对应于Encoder hidden states吗?当前噪声图像会被编码成潜在表示的token,这是对应Hidden states,然后噪声图像在文本的约束下预测速度,图像需要位置编码很好理解,但是文字的位置编码为什么被统一设为0呢,模型怎么区分不同文本token之间的顺序和相对位置?它后面怎么起到约束作用?而且文本的位置编码和图像的位置编码拼接在一起了,后面transformer能分的清是谁的位置编码吗

您的理解非常深入且抓住了核心问题!我们来逐一梳理和修正您的理解,并详细解释这些机制。

1. 文本和图像的编码与表示

您的理解基本正确:

- 文本编码为

Encoder hidden states:- 是的,这是正确的。 用户提供的文本提示(

text)会通过两个预训练的文本编码器(CLIP Text Encoder 和 T5 Text Encoder)进行处理。 - T5 编码器 会生成密集的(per-token)嵌入 ,这些就是您提到的

Encoder hidden states(在图7中表示为(1,n,4096))。这些嵌入包含了文本中每个词或子词的语义信息。 - CLIP 编码器 则生成池化嵌入 (

pooled_projection),代表整个文本提示的整体语义。

- 是的,这是正确的。 用户提供的文本提示(

- 当前噪声图像编码为

Hidden states:- 是的,这是正确的。 在 FLUX.1 中,

zt(在官方实现中被称为hidden_state)是当前噪声图像的潜在表示 。它最初是从纯高斯噪声N(0,1)开始的,并在迭代细化过程中逐渐去噪。 - 这个

hidden_state同样被看作是一系列"token",每个 token 对应图像潜在空间中的一个区域。在图7中表示为(1, hxw, 64)。

- 是的,这是正确的。 在 FLUX.1 中,

2. 噪声图像在文本约束下预测速度

- 是的,这是 FLUX.1 的核心任务。 FLUX.1 是一个基于 Rectified Flow 的模型。与传统的扩散模型预测噪声

epsilon不同,Rectified Flow 模型学习预测一个速度向量v。这个速度向量指示了如何从当前噪声状态xt直接指向"干净"数据点x1,沿着一条近似直线路径。 - 文本约束 就是通过将文本编码(

Encoder hidden states和pooled_projection)作为条件信息输入到 Transformer 中来实现的。Transformer 会利用这些文本条件来指导速度向量的预测,确保生成的图像与文本提示相符。

3. 文字位置编码为什么被统一设为0?模型如何区分不同文本token之间的顺序和相对位置?

这是一个非常好的问题!虽然论文中提到 Text_ids 的 t=h=w=0,但我们需要更细致地理解。

- 论文的表述可能存在一定的简化或特指: 论文原文是"

text_idsare initiated using the same structure ofimg_ids, but witht h = w = 0for all tokens. Formally,text_ids n. (0,0,0)wherenis the maximal number of tokens in T5 (= 512)."- 这里的

t=h=w=0很可能指的是text_ids在其自身内部的"空间"维度上被统一设置为0,而不是说它完全没有位置信息。 - 关键点在于 Transformer 架构本身: Transformer 在处理序列时,除了提供外部的位置编码(如

pos_embeds),其内部的自注意力机制 也能够捕捉序列内部的依赖关系。更重要的是,文本编码器(如 T5)在生成Encoder hidden states时,本身就包含了位置信息。- T5 编码器是一个 Transformer 模型,它在编码文本时会使用自身的位置编码机制 (通常是绝对位置编码或相对位置编码)来理解文本序列中词的顺序。因此,

Encoder hidden states((1,n,4096)) 本身就携带了丰富的文本内部顺序和相对位置信息。

- T5 编码器是一个 Transformer 模型,它在编码文本时会使用自身的位置编码机制 (通常是绝对位置编码或相对位置编码)来理解文本序列中词的顺序。因此,

pos_embeds的作用是跨模态对齐: 将Text_ids和img_ids的位置编码拼接在一起,并进行Flux positional embedder处理,主要是为了为整个跨模态序列 提供一个统一的、结构化的位置上下文。即使文本 token 的3D索引被设为(0,0,0),它也表示这些文本 token 共享一个"非空间"或"统一"的位置语义,这与图像 token 的离散空间位置形成对比。- RoPE (Rotary Positional Embeddings) 的作用: 论文提到

Flux positional embedder生成的位置嵌入用于 RoPE。RoPE 的特点是它通过旋转 Query 和 Key 向量 来注入相对位置信息,而不是直接加到嵌入上。这意味着文本 token 之间的相对位置信息可能更多地通过 RoPE 机制来保持和利用,而不是通过text_ids的绝对数值。

- 这里的

总结: 文本 token 之间的顺序和相对位置信息主要通过文本编码器(如 T5)自身的位置编码 以及Transformer 块内部的自注意力机制和 RoPE 机制 来捕捉。text_ids 被统一设为 (0,0,0) 更多是为了在跨模态拼接时提供一个统一的"非空间"占位符,使得文本和图像的位置编码能够被统一处理,而不是说文本失去了所有位置信息。

4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?

- 是的,Transformer 能够区分。

- 不同的输入源: 尽管位置编码被拼接在一起,但原始的潜在表示 (

latentfor image 和textfor text)在进入 Transformer 块之前是分开的。 - Dual-Stream Transformer Block (双流 Transformer 块): 论文在 Section 2.3.2 中明确指出,双流块"employ separate weights for image and text tokens "(对图像和文本 token 使用独立的权重)。这意味着在双流块中,图像 token 和文本 token 甚至在注意力机制之前就被不同的线性层处理,并且它们的查询(Q)、键(K)、值(V)矩阵也是分别计算的。这种设计使得模型能够明确地区分和处理来自不同模态的输入,即使它们共享位置编码。

- Single-Stream Transformer Block (单流 Transformer 块): 尽管单流块使用共享权重 来处理拼接后的张量,但它仍然能够通过自注意力机制 区分不同模态。自注意力机制会计算每个 token 与序列中所有其他 token 的相关性。由于图像 token 和文本 token 在语义内容 上截然不同,即使它们共享权重,注意力机制也会学习到它们之间不同的交互模式。此外,即使位置编码被拼接,但原始的 token 嵌入 (

latent和text)本身是不同的,这为 Transformer 提供了区分的基础。 - 拼接的顺序: 拼接通常是有序的,例如,先是图像 token,然后是文本 token。Transformer 可以通过这种顺序来隐式地理解哪些 token 属于图像,哪些属于文本。

- 不同的输入源: 尽管位置编码被拼接在一起,但原始的潜在表示 (

总结: Transformer 能够区分这些位置编码的原因在于:

- 原始 token 嵌入的语义差异:图像和文本的原始嵌入内容不同。

- 双流架构中的独立权重:在双流块中,模型为不同模态分配了专门的参数。

- 自注意力机制的学习能力:即使在单流块中,自注意力也能学习到不同模态 token 之间的独特交互模式。

- RoPE 机制的精细位置信息处理:RoPE 能够更细致地处理相对位置信息,有助于区分不同模态 token 间的距离和关系。

通过这些机制,FLUX.1 能够在提供统一位置上下文的同时,有效地处理和区分文本与图像模态的信息,并利用文本信息来约束图像生成。您的理解非常到位,抓住了 FLUX.1 架构中的几个关键和巧妙之处!我们来详细梳理一下,并对您的疑问进行精确的解答。

1. 文本和图像的编码与表示

您的理解完全正确:

- 文本编码为

Encoder hidden states:- 是的。 用户提供的文本提示 (

text) 会经过两个预训练的文本编码器处理:- T5 Text Encoder :生成密集(per-token)的嵌入 ,这些就是

Encoder hidden states(在图7中标记为(1,n,4096))。n代表文本 token 的数量,4096是特征维度。这些嵌入包含了文本中每个词或子词的丰富语义信息。 - CLIP Text Encoder :生成池化嵌入 (

pooled_projection),通常是一个单一向量,代表整个文本提示的全局语义。

- T5 Text Encoder :生成密集(per-token)的嵌入 ,这些就是

- 是的。 用户提供的文本提示 (

- 当前噪声图像编码为

Hidden states:- 是的。

zt(在官方实现中被称为hidden_state)是当前噪声图像在潜在空间中的表示。它最初是纯高斯噪声,在迭代过程中逐步去噪。 - 这个

hidden_state被视为一系列"图像 token",每个 token 对应潜在图像中的一个空间区域。在图7中标记为(1, hxw, 64),其中hxw是潜在图像的空间维度(高度乘以宽度),64是特征维度。

- 是的。

2. 噪声图像在文本约束下预测速度

- 是的,这是 FLUX.1 的核心机制。 FLUX.1 是基于 Rectified Flow (RF) 训练范式的。与传统的扩散模型预测噪声 (

epsilon) 不同,RF 模型学习预测一个速度向量v。这个速度向量指示了如何从当前的噪声状态xt沿着一条近似直线的路径,直接"流向"最终的干净数据点x1。 - 文本约束 是通过将文本编码(

Encoder hidden states和pooled_projection)作为条件信息输入到 Transformer 网络中实现的。Transformer 会利用这些文本条件来指导速度向量的预测,确保生成的图像在语义上与文本提示高度对齐。

3. 文字位置编码为什么被统一设为0?模型如何区分不同文本 token 之间的顺序和相对位置?它后面怎么起到约束作用?

这是一个非常关键且有深度的疑问,论文中的描述需要仔细解读。

- "统一设为0"的解读: 论文提到

text_ids是"Zeros(n,3)",并且"img_ids和text_ids被连接起来,然后用于提取 per-token 位置嵌入...text_ids被初始化为img_ids相同的结构,但所有 token 的t h = w = 0。正式地,text_ids n. (0,0,0)"。- 这里的

t=h=w=0并非指文本完全没有位置信息,而是指在FLUX.1 内部用于构建pos_embeds的3D空间坐标体系中,文本 token 被赋予了一个"非空间"或"统一原点"的位置 。这与图像 token 明确的(t, h, w)空间坐标形成对比。 - 模型区分顺序和相对位置的关键:

- 文本编码器自身的编码: T5 Text Encoder 本身就是一个 Transformer 模型,它在生成

Encoder hidden states((1,n,4096)) 时,已经通过其内部的位置编码机制(例如,绝对位置编码或相对位置编码)捕捉了文本 token 的顺序和相对位置信息。 这些语义丰富的Encoder hidden states已经包含了这些信息。 - Transformer 块的自注意力机制: 在 FLUX.1 的 Transformer 块(无论是双流还是单流)中,自注意力机制能够学习序列中所有 token 之间的依赖关系。即使

text_ids在pos_embeds中被设为(0,0,0),文本 token 原始的语义嵌入(Encoder hidden states)的差异以及它们在序列中的位置(通过 T5 编码器获得)会指导注意力机制去理解它们的顺序和相对关系。 - RoPE (Rotary Positional Embeddings) 的作用: 论文明确指出

Flux positional embedder提取的位置嵌入(pos_embeds)用于 RoPE 。RoPE 是一种通过旋转 Query 和 Key 向量 来注入相对位置信息的方法。它不直接加到嵌入上,而是通过复平面上的旋转来编码相对距离。这意味着,即使文本 token 的3D索引在pos_embeds中是(0,0,0),RoPE 仍然可以利用序列中 token 的相对位置(由原始文本编码器的输出决定)来增强注意力机制对顺序的理解。

- 文本编码器自身的编码: T5 Text Encoder 本身就是一个 Transformer 模型,它在生成

- 这里的

- 如何起到约束作用: 文本的

Encoder hidden states和pooled_projection作为条件输入 ,被整合到 Transformer 的注意力机制中。- 在 Cross-Attention 机制中,图像 token 的 Query 会与文本 token 的 Key 和 Value 进行交互,从而让图像生成过程受到文本语义的指导。

- 在 Adaptive Layer Normalization (AdaLN) 中,

temb(包含timestep和pooled_projection)用于动态调制 Transformer 层的激活,从而在每一步迭代中将文本的全局语义和时间步信息注入到图像的处理流程中。

4. 文本的位置编码和图像的位置编码拼接在一起了,后面 Transformer 能分得清是谁的位置编码吗?

- 是的,Transformer 能够清楚地分辨。 这是通过 FLUX.1 精心设计的多模态 Transformer 架构 实现的:

- 原始语义嵌入的差异: 图像的潜在表示 (

latent) 和文本的密集嵌入 (text) 在进入 Transformer 块之前,其内容和特征维度 本身就不同(例如,latent是(1, hxw, 3072),text是(1,n,3072))。这是最根本的区分。 - 双流 (Double-Stream) Transformer 块:

- 论文明确指出:"这些块对图像和文本 token 使用独立的权重"("employ separate weights for image and text tokens")。

- 这意味着在双流块中,图像 token 和文本 token 在进入注意力机制之前,会通过不同的线性投影层生成各自的 Query (Q)、Key (K) 和 Value (V) 矩阵。

- 多模态是通过将这些独立的 K 和 Q 矩阵拼接 起来进行联合自注意力计算实现的(见图8b),但其内部处理是区分的。这种设计使得模型能够明确地区分和处理来自不同模态的输入。

- 单流 (Single-Stream) Transformer 块:

- 在双流块之后,处理后的图像和文本嵌入被拼接在一起,然后送入单流块。

- 单流块使用共享权重 来处理这个拼接后的张量。但是,即使权重共享,Transformer 仍然能够区分:

- 位置信息: 拼接后的

pos_embeds虽然是统一的,但其内部的结构(图像 token 对应(t,h,w)坐标,文本 token 对应(0,0,0)坐标)仍然保留了模态信息。RoPE 会利用这些信息。 - 自注意力机制的强大能力: 由于图像 token 和文本 token 的原始语义嵌入截然不同,自注意力机制会学习到它们之间不同的交互模式。例如,图像 token 之间的注意力可能更关注空间相邻性,而图像 token 与文本 token 之间的注意力则更侧重语义对齐。

- 位置信息: 拼接后的

- 拼接顺序: 通常,拼接是有序的(例如,图像 token 序列在前,文本 token 序列在后)。Transformer 可以通过这种隐式顺序进一步理解哪些 token 属于哪个模态。

- 原始语义嵌入的差异: 图像的潜在表示 (

总结: FLUX.1 通过异构的原始语义嵌入、双流 Transformer 块的独立权重设计、以及单流 Transformer 块中自注意力机制的学习能力和 RoPE 对位置信息的精细处理,确保了模型能够清晰地区分文本和图像的 token,并有效地利用它们各自的位置信息,最终实现强大的文本引导图像生成。