这两天放假,老茶壶带着一家老小自驾10多个小时,给我累的不行了,不过在酒店没事的时候我发现开源社区一款新的AI自动短视频工具"Pixelle-Video"。

今天,我来深度拆解这款在 GitHub 上刚开源就引起关注的神器------Pixelle-Video。

你只需要输入一个 Idea,剩下的写脚本、画分镜、配音、加音乐、剪辑,全都由 AI 帮你在后台"一键搞定"你敢信吗?来吧一起看看!!

🚀 什么是 Pixelle-Video?

Pixelle-Video 是由 AIDC-AI 团队开发的一个 AI 全自动短视频生成引擎。

简单来说,它就像是一个"短视频工厂的经理"。它把最强大的 LLM(大语言模型)、ComfyUI(图像/视频生成引擎)和 TTS(语音合成)组合在了一起。

它的核心逻辑是高效:

你给它一个命题 → 它写出脚本 → 它在 ComfyUI 里画出图 → 它合成语音并对齐画面 → 产出完整视频。

部署实操:

一、windows环境部署:

一键整合包,无需安装 Python环境,开箱即用!

下载 Windows 整合包

-

下载最新的 Windows 一键整合包并解压

-

双击运行

start.bat启动 Web 界面 -

浏览器会自动打开 http://localhost:8501

-

在「⚙️ 系统配置」中配置 LLM API 和图像生成服务

-

开始生成视频!

提示: 整合包已包含所有依赖,无需手动安装任何环境。首次使用只需配置 API 密钥即可。

二、源码部署

适用于Mac/Linux环境部署操作:

1、Mac先安装FFmpeg、uv管理

2、根据git命令去Clone项目放在自己的本地

3、进入项目目录下,使用uv run streamlit run web 启动 app.py文件

操作如下:

bash

# 1. 安装依赖

brew install ffmpeg

# Ubuntu: sudo apt install ffmpeg

# 2. 安装 uv(这里是安装UV的详细说明)

https://docs.astral.sh/uv/getting-started/installation/

# 3. 下载并启动

git clone https://github.com/AIDC-AI/Pixelle-Video.git

cd Pixelle-Video

# 4. 启动项目

uv run streamlit run web/app.py

三、配置模型与ComfyUI

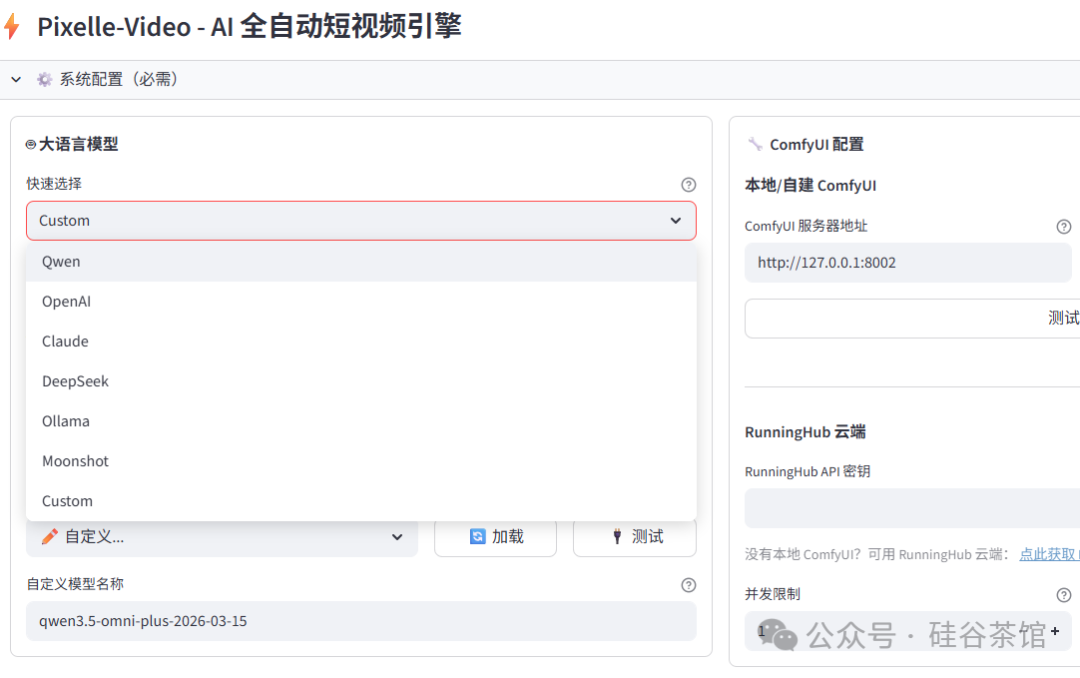

1、打开项目先进行系统配置,选择适合自己的模型,如果本地有Ollama也可以用自己的。

2、部署ComfyUI

去https://comfy.org/download官网下载,然后安装即可,这里就不说了

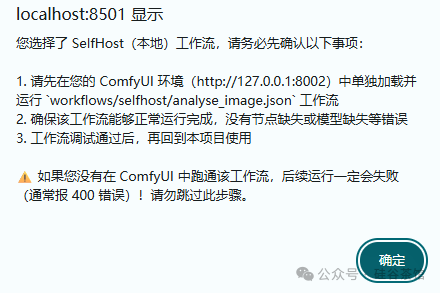

3、先在ComfyUI中运行Pixelle-Video-v0.1.15-win64\Pixelle-Video\workflows\selfhost目录下的"analyse_image.json"工作流,不然会报错的,因为有节点会缺失。如下:

4、全搞定之后就可以开始你的创作了

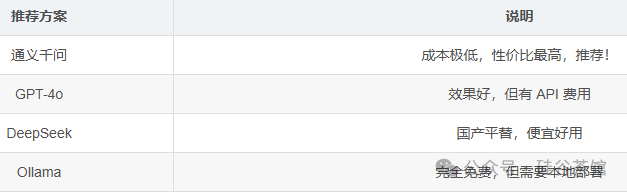

注:项目完全支持免费运行!硬件不足也可以使用云Gui运行,方案如下:

- :

LLM 使用 Ollama(本地运行)+ ComfyUI 本地部署 = 0 元 - :

LLM 使用通义千问(成本极低,性价比高)+ ComfyUI 本地部署 - :

LLM 使用 OpenAI + 图像使用 RunningHub(费用较高但无需本地环境)

🛠️ 核心硬核能力:

ComfyUI 玩家的福音,为什么它是 ComfyUI 玩家的福音?

市面上有很多"一键成片"的工具,但 Pixelle-Video 最大的不同在于它深度集成了 ComfyUI,完全可以调用你本地的 ComfyUI能力。

1. 极致的自定义:拒绝"AI 塑料感"

很多 AI 视频工具生成的画风千篇一律。但 Pixelle-Video 允许你直接调用自己的 ComfyUI 工作流 。 你可以用最新的 Flux 架构追求写实极致,也可以用 SDXL 配合特定的 LoRA 产出二次元动漫风格。它不是在给你一个死板的模板,而是给了你一个可以无限扩展的"渲染底座"。

2. 全自动化工作流:从文字到 MP4

-

AI 脚本家:输入"为什么喝咖啡后反而更累?",它会自动帮你拆解成:现状描述、科学原理分析、结尾总结。

-

多模态融合:它支持接入主流的 TTS 接口,声音生动自然;同时可以自定义背景音乐。

-

布局模板化:视频内置了多种布局样式(Static, Image, Video),无论是做抖音竖屏还是 B 站横屏,都能一键切换。

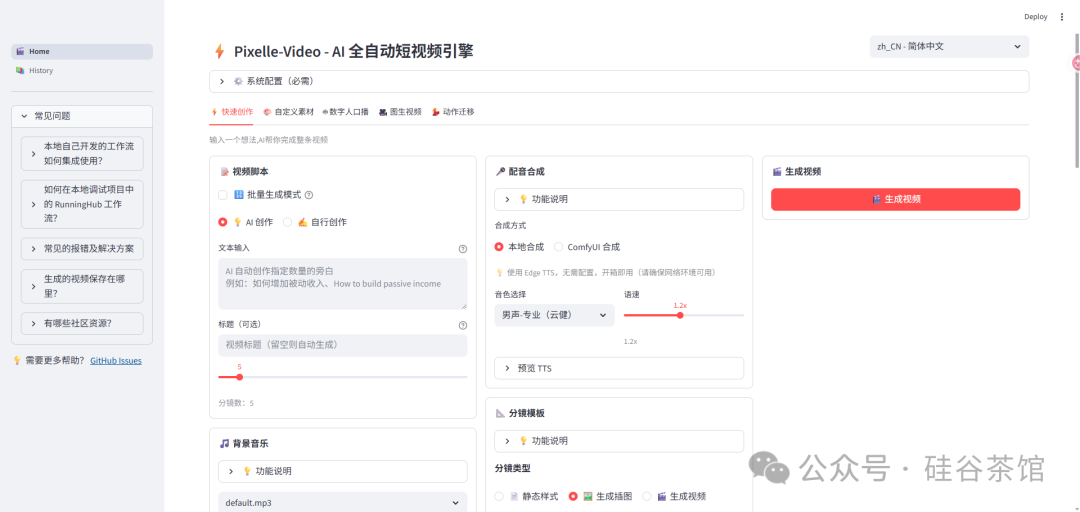

👨💻 动手实操:如何制作你的第一部 AI 大片?

操作 Pixelle-Video 的过程非常符合直觉,即使你不是代码大神也能快速上手:

第一步:输入你的视频想法,在它的Web UI 的 Text Input 框里写下你的创意。比如:"做一个关于未来城市交通的科普视频"。

第二步:选择你需要的语言风格和视频风格

-

Voiceover:选择你喜欢的语音模型,调节语速。

-

Image Generation :在下拉菜单里选择你本地配置好的 ComfyUI

.json工作流文件。这是决定视频质感的关键。

第三步:选择模板 它是走极简文字风,还是走精美插画风?在 Storyboard Template 里挑选一个最契合你主题的样式。

第四步:见证奇迹 点击 Generate Video。你可以看到后台 ComfyUI 的节点开始飞速闪动。不到几分钟,一个带字幕、带配音、画风统一的视频就躺在你的下载文件夹里了。

💡 个人使用心得与建议

在深度测试 Pixelle-Video 后,我有几个"避坑"小技巧分享给大家:

-

关于显存 :由于底层跑的是 ComfyUI,建议显存至少在 12GB 以上(尤其是你想用 Flux 工作流时)。

-

脚本微调:虽然 AI 生成脚本很强,但在渲染前,建议手动微调一下分镜描述(Prompt),这样出来的画面会更精准。

-

本地化部署:目前该项目已经在 GitHub 开源,支持 Windows/Linux 环境。主打免费,开源

🌟 总结:短视频创作进入"无人值守"时代

Pixelle-Video 的出现,标志着内容创作的门槛再次被大幅拉低。它不再是简单的"拼接",而是一种有逻辑、可定制的工业化产出。

开源地址:[https://github.com/AIDC-AI/Pixelle-Video]

目前我把它的配音转成了批量文本转语音工具,方便独立使用,项目分离在我本地,如果需要的请评论区留言我打包之后分享给你也可以。

欢迎 点赞、转发、"硅谷茶馆"分享&踩坑免费实用的AI工具