写在前面

目前市面上较多的ai都是收费的,特别是使用图片生成功能的,有很多还是很贵的,但是这些其实本质就是调用它们远程的显卡算力服务与你,今天这篇文章教会大家如何使用自己本地的电脑配置处理ai生成图片的能力

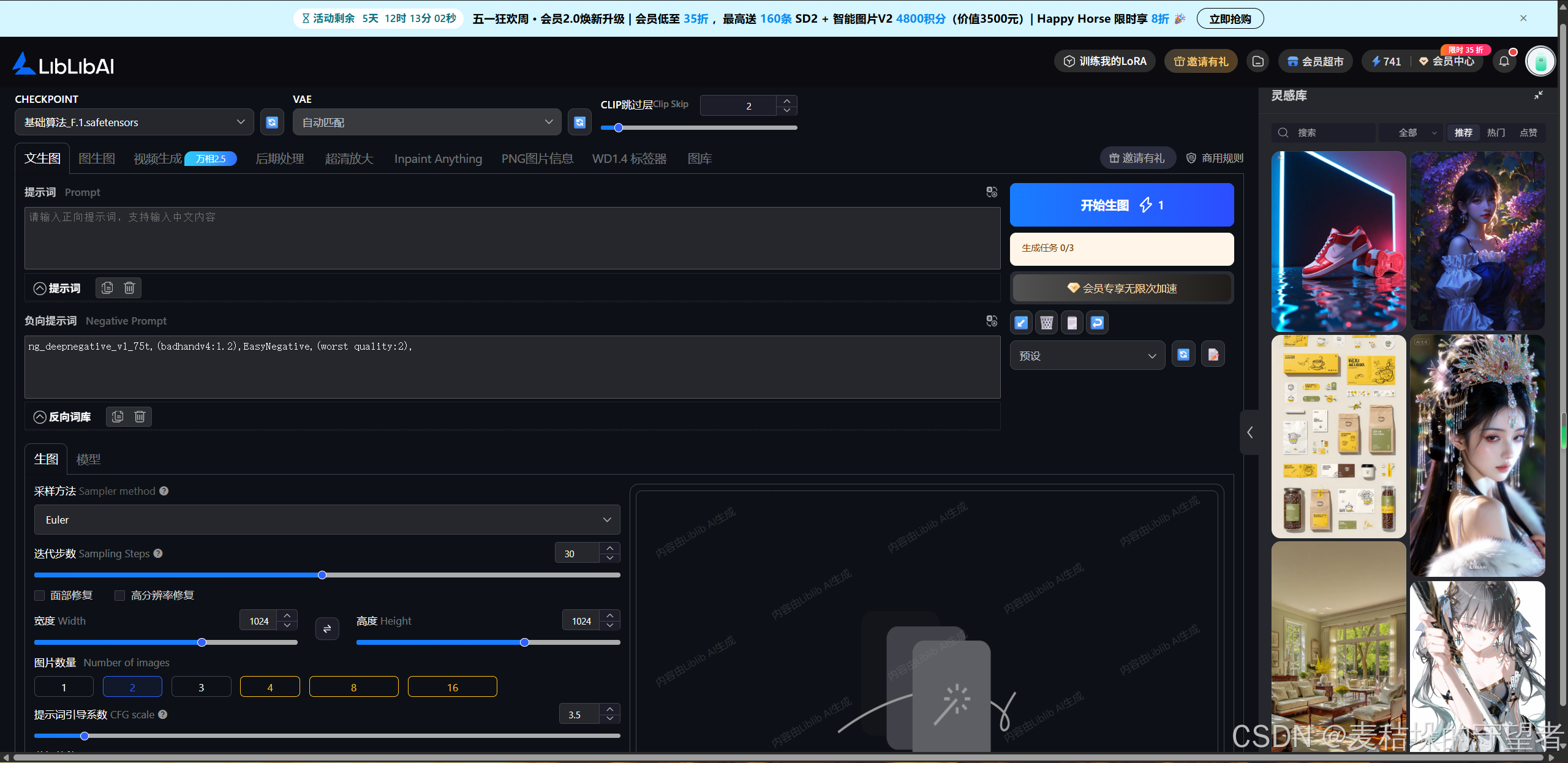

常见的作图平台

等等这些都是要收费的,而且很多都是按秒收费的,一般人钱包根本扛不住,所以今天我们的目的就是将这套东西搬到本地来,使用你电脑自身的算力来处理这些图片生成。

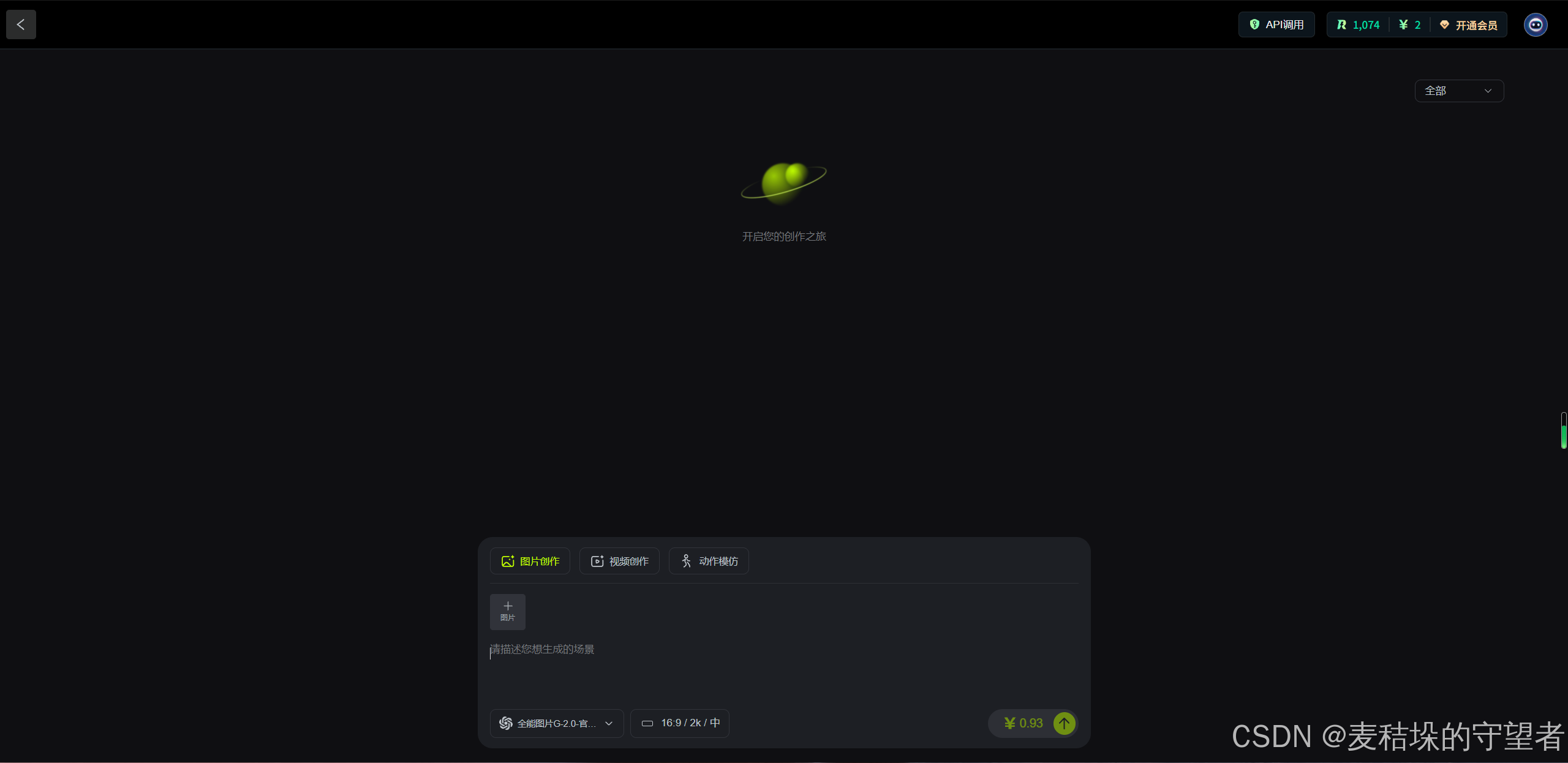

成果展示(最终我们要实现的效果如图)

部署到我们本地,使用本地的算力加上公开免费的大模型进行图片的处理。

准备工作

- 硬件:一台可以联网的PC(最好是有独显的,算力依靠显卡)

- 软件:LiblibAI(哩布哩布)、吐司 TusiArt、魔搭社区 (ModelScope) 这些都可以,今天我们使用的是LiblibAI作为演示

- 模型下载: Civitai 、Hugging Face

软件下载

软件安装

这里直接无脑安装就行,不过要记得你的安装路径

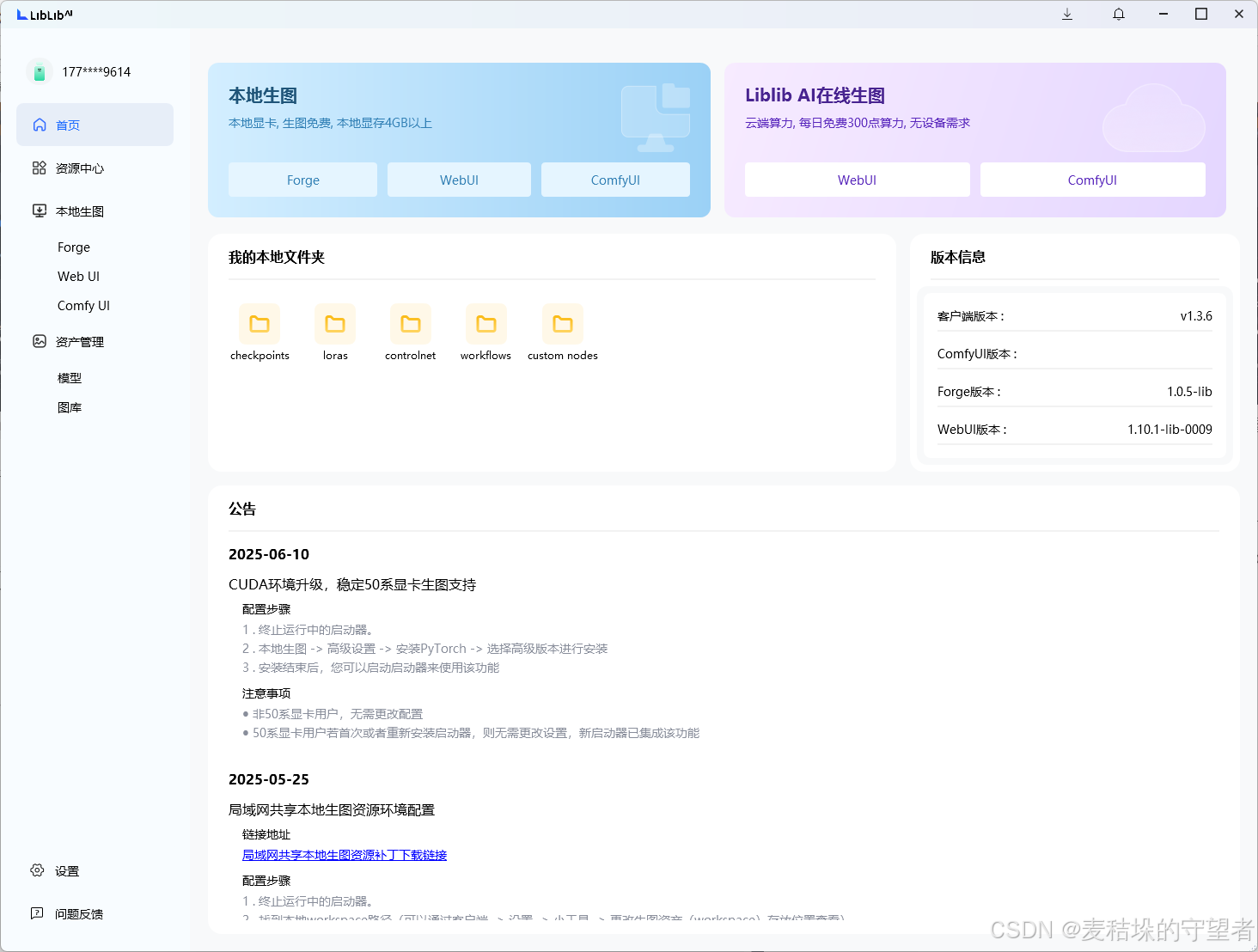

软件界面

打开软件左侧的本地生图

- Forge

- WebUI

- Comfy UI

这里我们使用第二个,前面两个都可以,个人建议使用第二个,是最有友好的,

模型安装

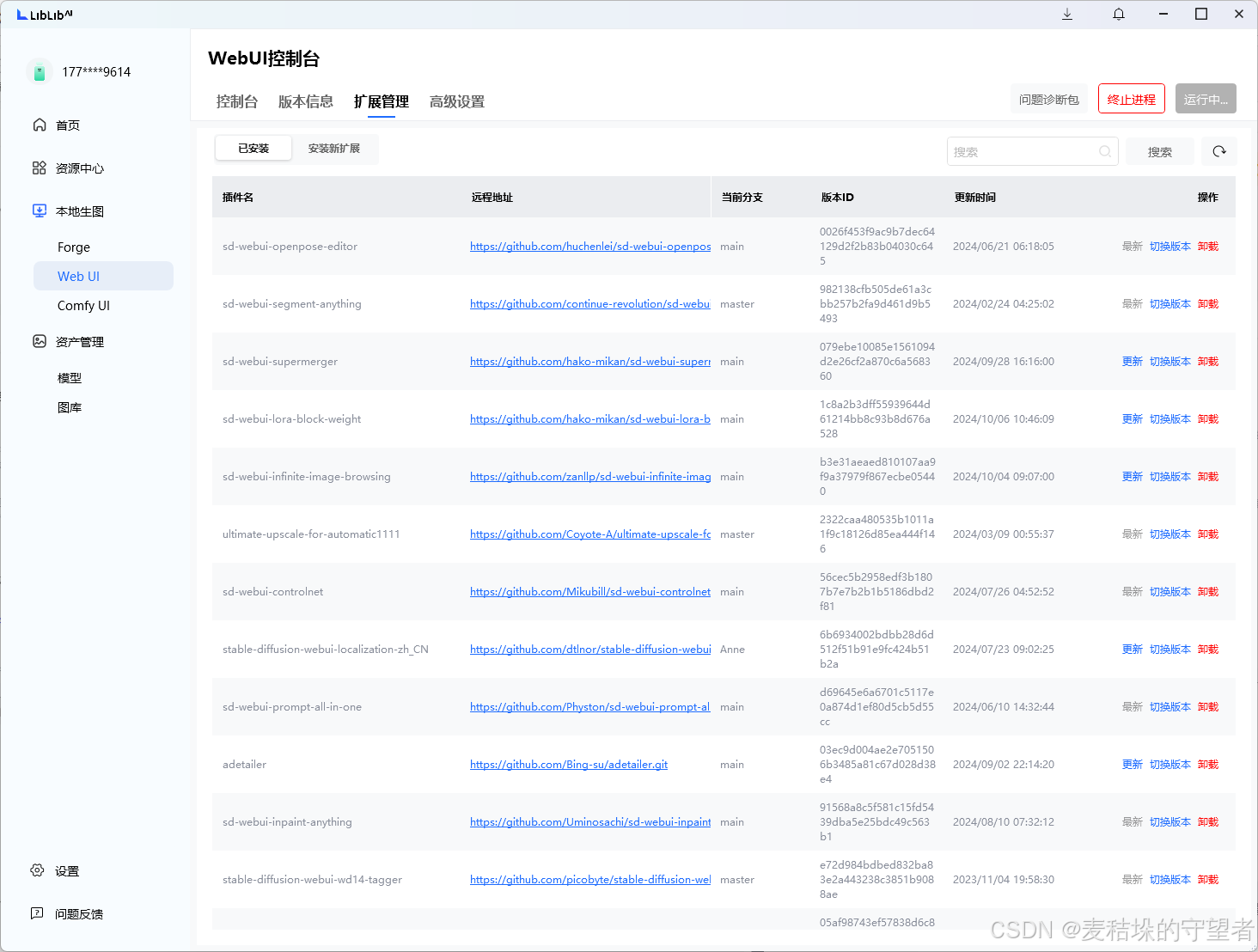

打开之后他会提示你要不要安装一些模型,这里你可以选择不安装,也可以选择安装,因为后面还可以根据自己的喜好和用途选择自己需要的模型,如果全部安装,我怕你的硬盘遭不住,所以你可以先不安装,之后打开扩展管理

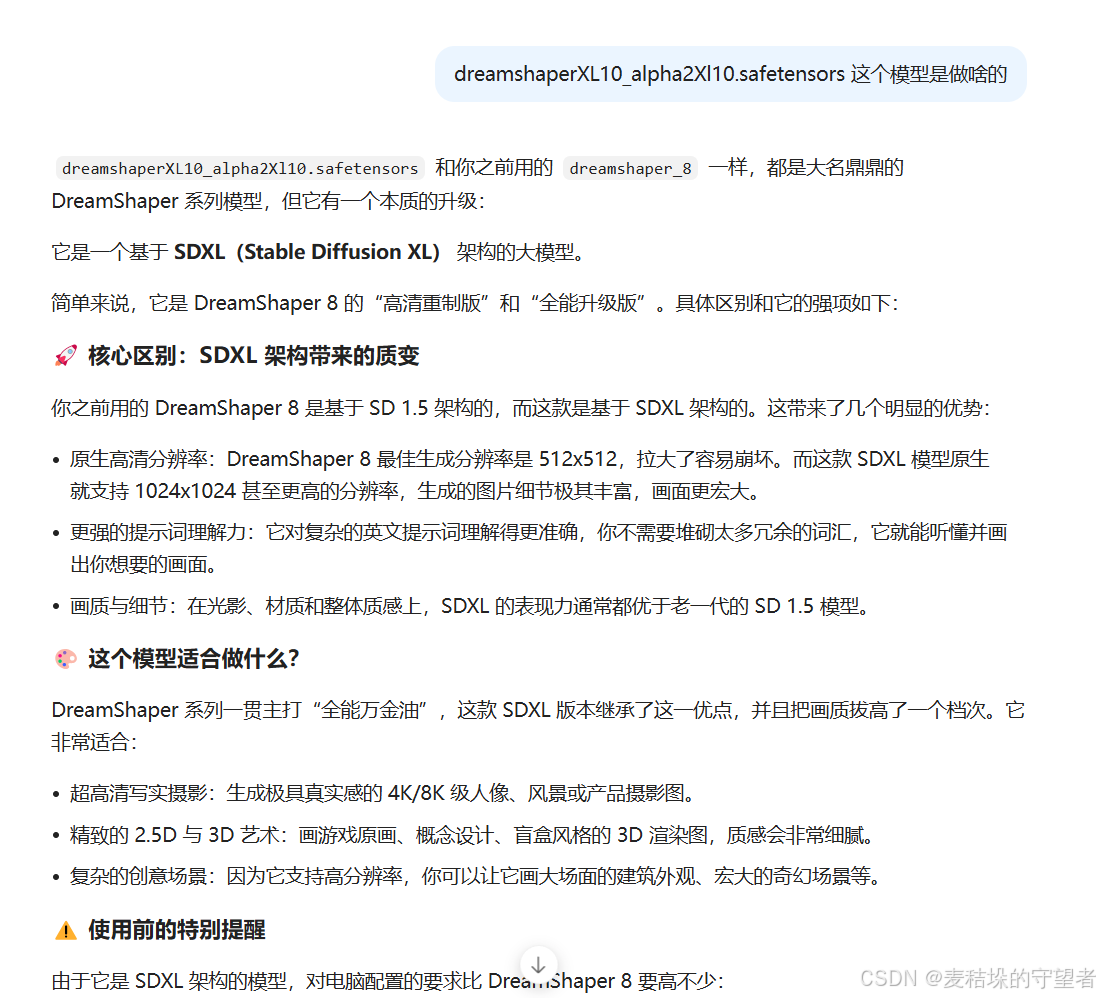

这里都是可以安装到你本地的模型,你可以按需安装,如果你不知道你需要什么模型,那么你可以直接打开ai助手,将模型的名字复制给他,问他这个模型主要是用来做什么的,比如我问的这个

如何知道自己需要什么模型和该模型是做什么的

你大概之后模型的作用之后,就可以判断你要不要下载到本地了,如果你发现这里没有你需要的模型咋办呢?你可以去网上找一下,比如我举个例子:

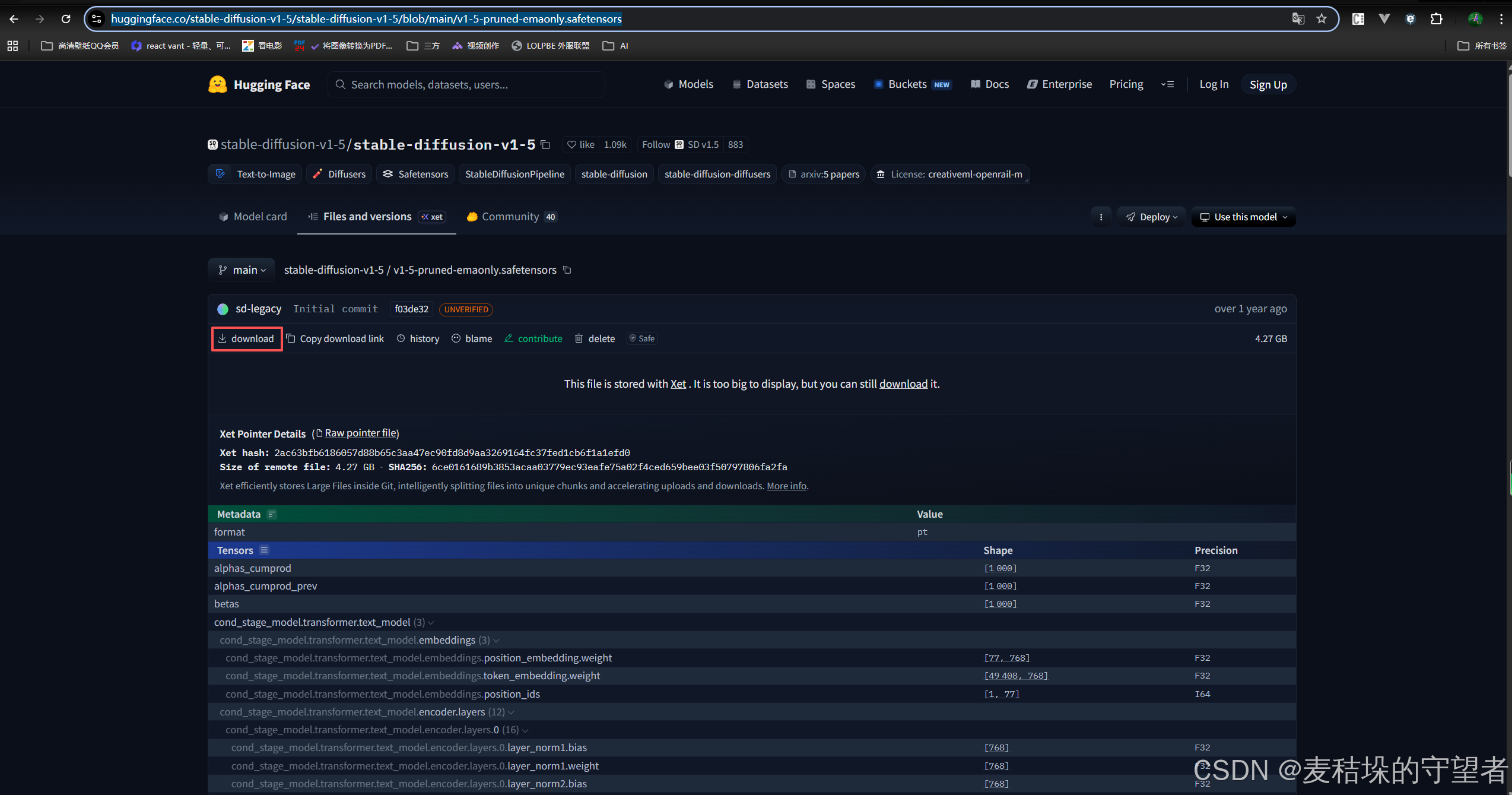

网上找模型资源

这个就是网上的模型,那么下载好之后,你怎么放到本地呢?

如何将网上下载下来的模型放到本地?

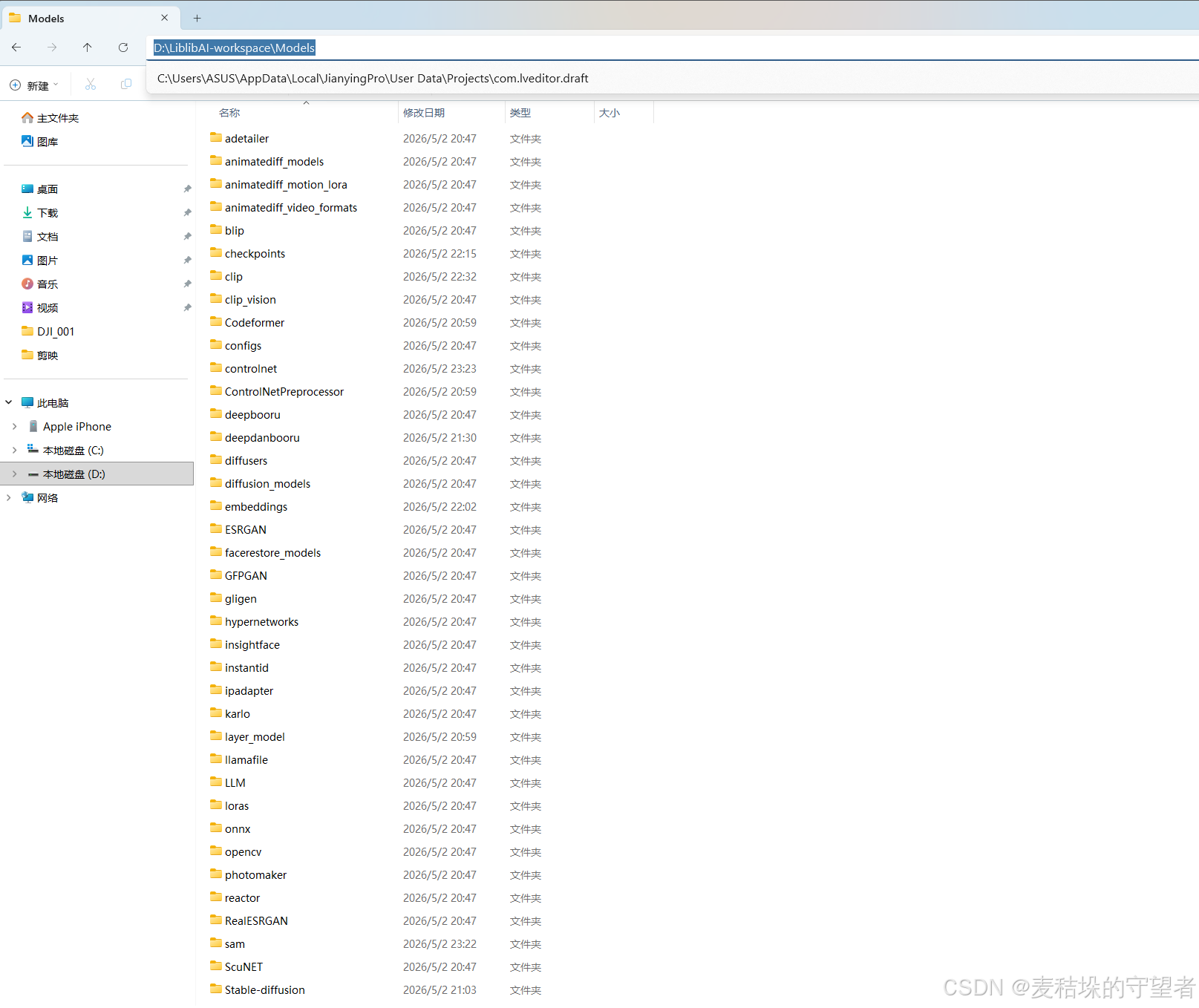

首先你要知道你的模型属于哪一个品类的,然后找到你安装的目录,将该模型按照品类放进去即可,比如:找到你的空间-models,下面都是分类

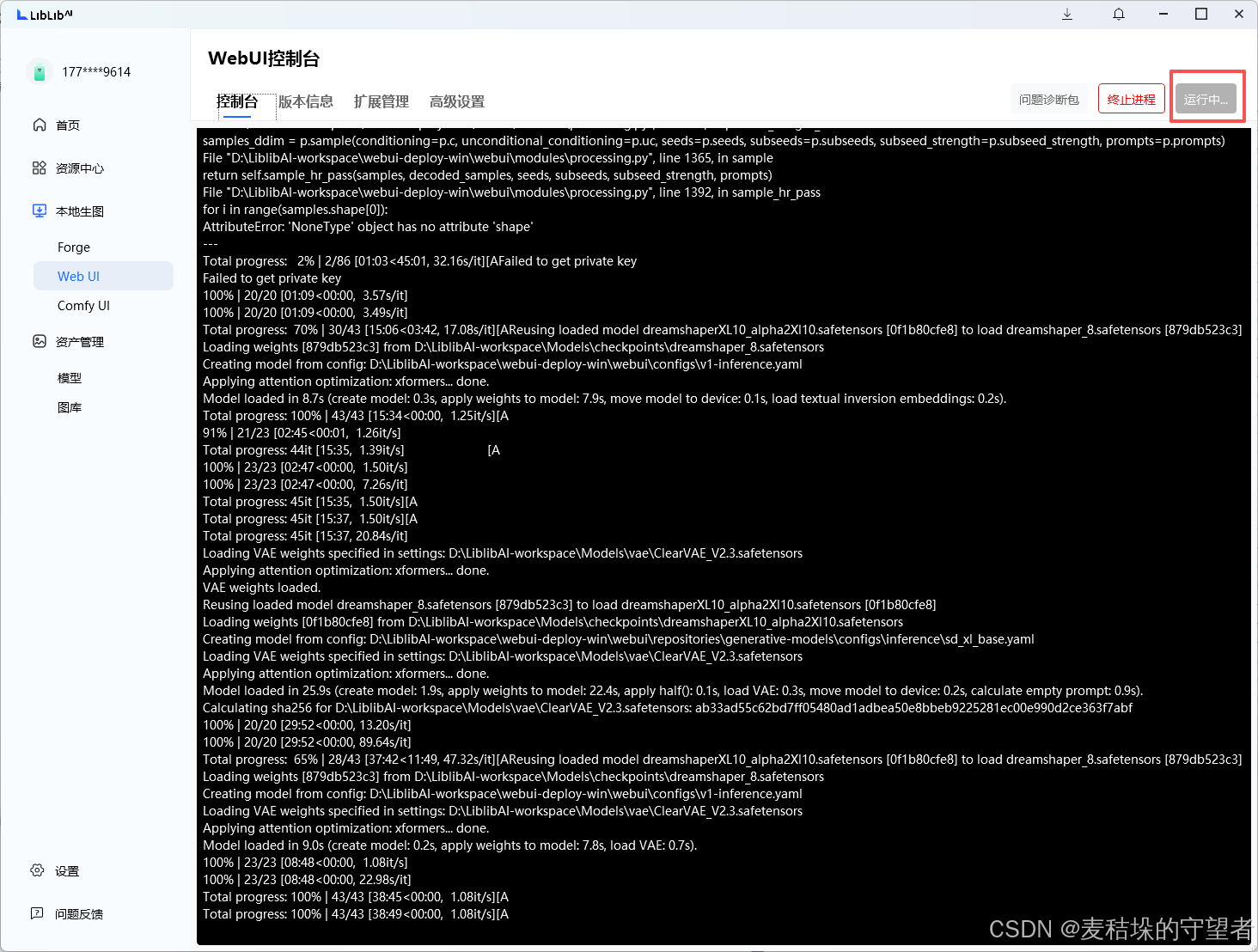

如何启动本地的算力呢?

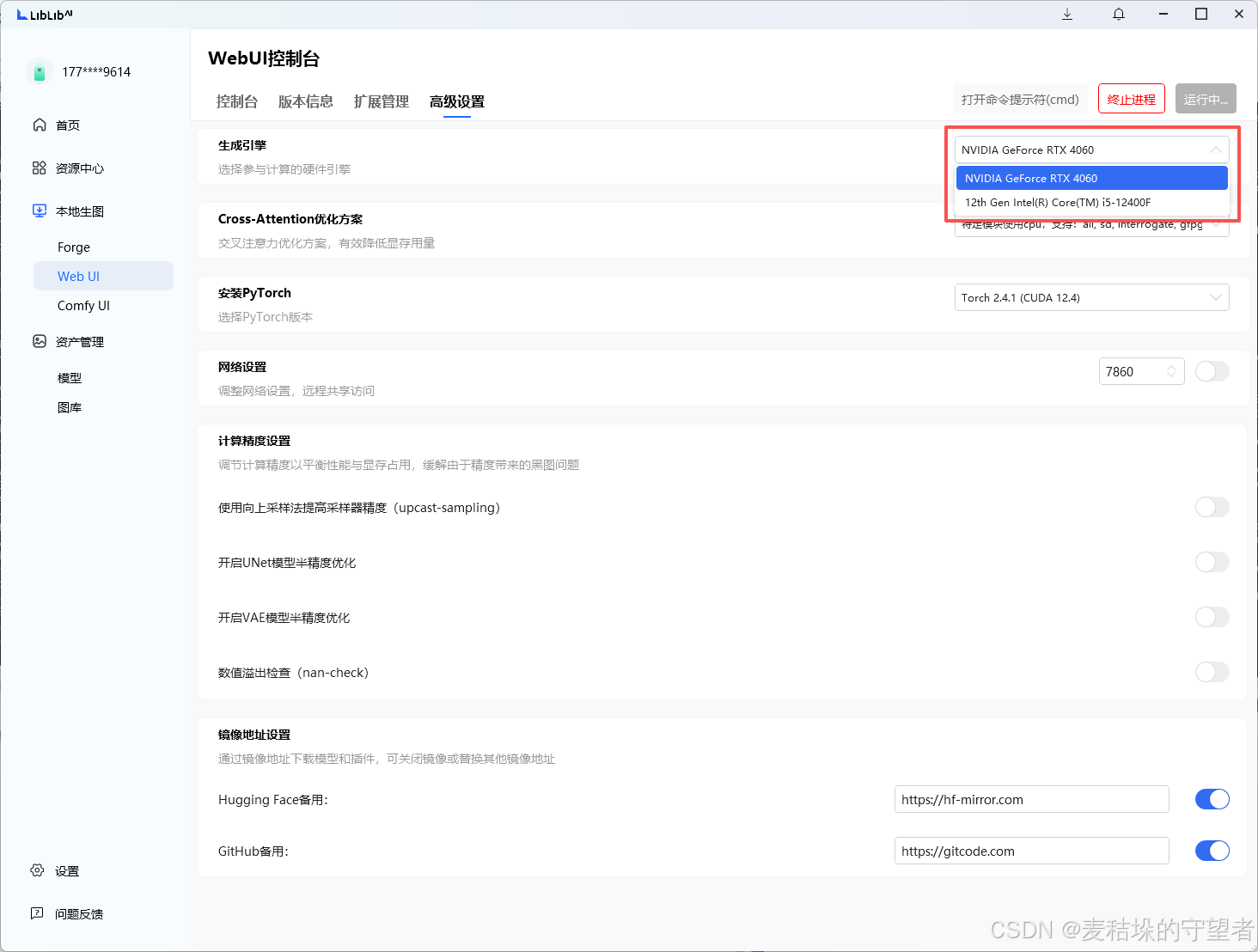

这里点击启动之后,等待几分钟,他会自动加载你的本地显卡和基础的配置信息,比如我的是RTX4060的卡,他就会自动调用我的显卡,自动打开一个本地的UI界面,如果你外接了很多张卡,这里可以进行选择

如何选择显卡

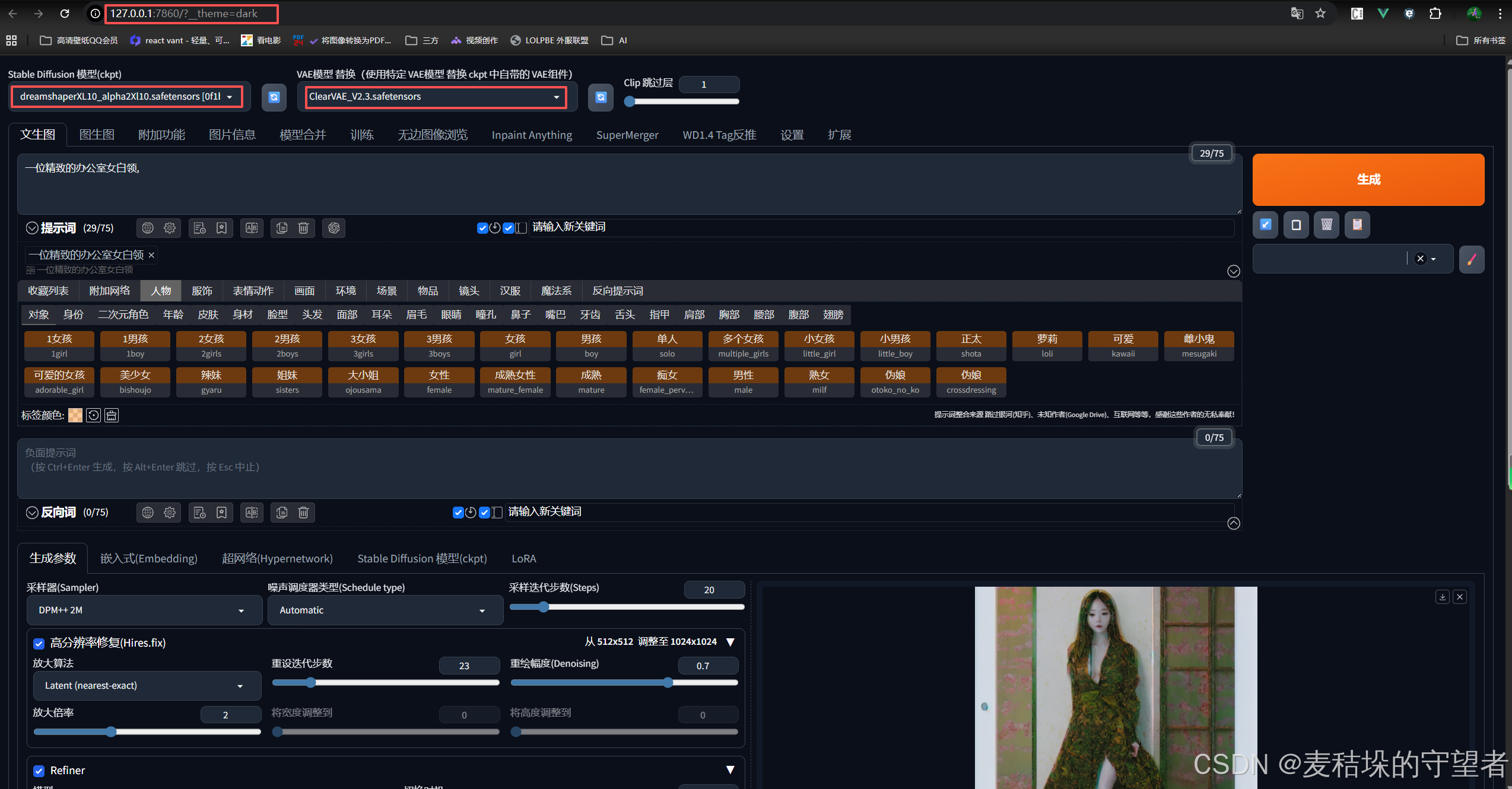

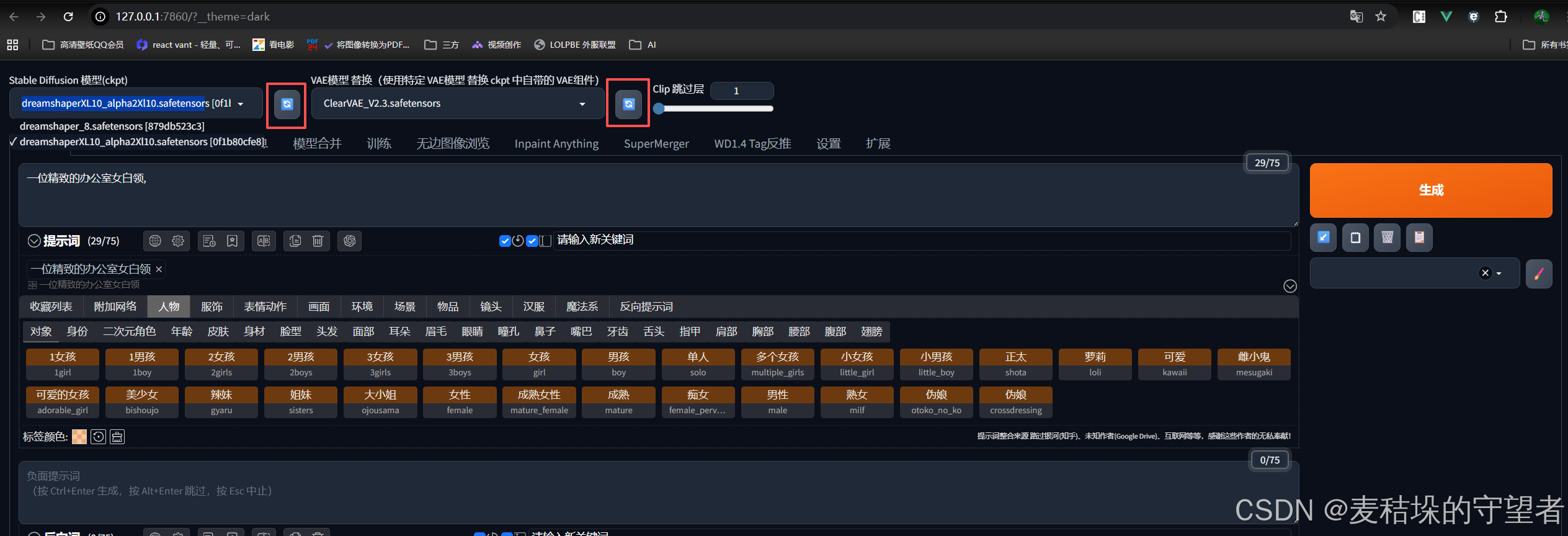

如何在本地加载模型使用

如果这里刷新没有用,那就重新将webUI关闭,终止进程,之后重新运行即可。

Stable Diffusion 模型(ckpt) 和 VAE模型 替换(使用特定 VAE模型 替换 ckpt 中自带的 VAE组件)

为啥要用两个模型呢?因为前面的决定怎么生成,后面的决定生成的质量咋样,所以你们自己按需处理就行了。

视频能做吗?

目前的还不能做,后续有可以做的,我会及时更新。