Trae 自定义模型接入指南:把 DeepSeek、GLM、Qwen 装进你的 AI 编程助手

📌 导读:Trae 默认用豆包模型,但你可能更想用 DeepSeek 的推理能力,或者 GLM 的长文本理解。好消息:Trae 支持自定义模型接入,而且操作比你想象的简单。今天手把手教你,5 分钟换上你想要的模型。

为什么要换模型?

Trae 默认内置了豆包系列模型,日常用够了。但有些场景,你可能需要更合适的选择:

- 复杂逻辑推理:DeepSeek 的数学和逻辑能力公认强

- 长文本理解:GLM 支持超长上下文,读大项目代码不吃力

- 通用对话:Qwen(通义千问)在中文对话和创意写作方面表现好

- 省钱:你自己有某些模型的 API Key,想直接用上

类比:Trae 就像一台手机,出厂自带了默认输入法。但你可以随时换成搜狗、百度、或者你最喜欢的输入法------换模型也是一样的道理,找一个最适合你的就行。

换模型前,先搞清楚两件事

1. 你的 Trae 版本够新吗?

自定义模型功能需要 Trae V3.3.51 以上版本。

查看方法:打开 Trae → 设置 → 关于 → 查看版本号。如果版本太旧,去 trae.cn 下载最新版。

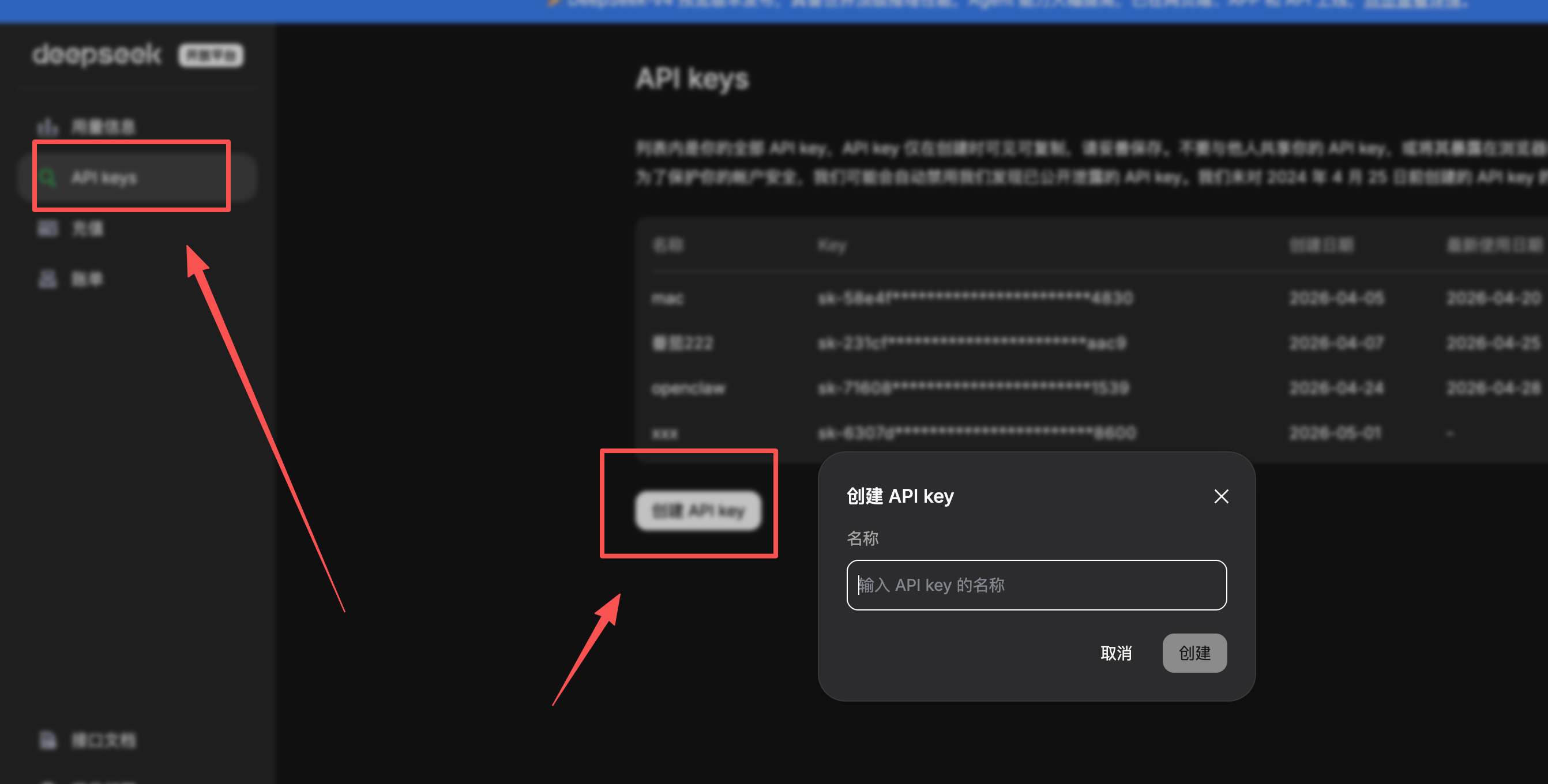

2. 你有目标模型的 API Key 吗?

你需要从模型服务商那里拿到两个东西:

- API Key :一串

sk-xxx格式的密钥 - API URL:模型服务的接口地址

常见模型的获取方式:

| 模型 | 去哪申请 | 免费额度 |

|---|---|---|

| DeepSeek | platform.deepseek.com | 注册送额度 |

| GLM(智谱) | open.bigmodel.cn | 注册送额度 |

| Qwen(通义) | dashscope.console.aliyun.com | 有免费模型 |

| 豆包(火山) | console.volcengine.com | 部分免费 |

💡 不确定选哪个?先试 DeepSeek,注册就有免费额度,推理能力也强。

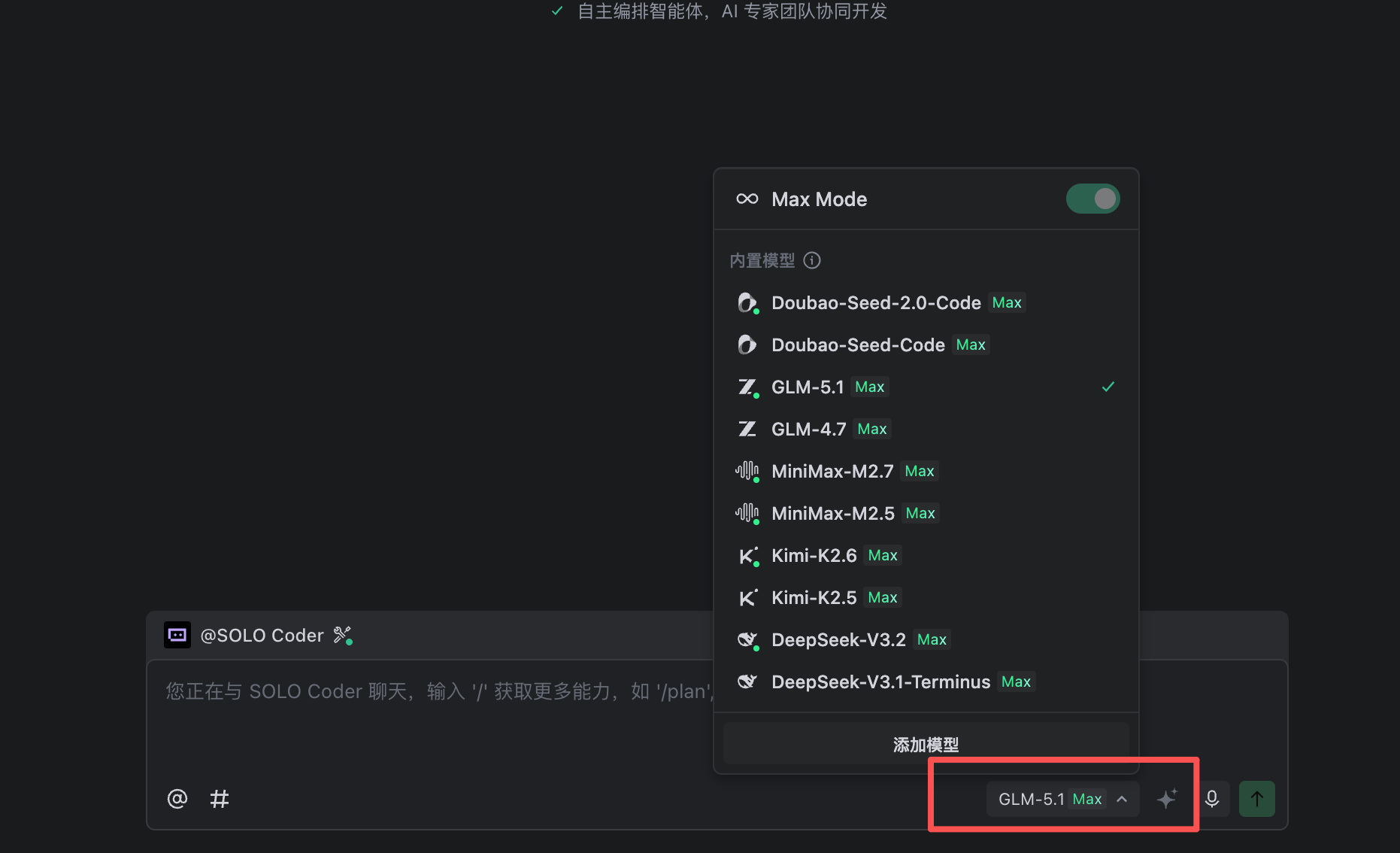

方法一:在 Trae 里直接切换(最简单)

如果你只是想在不同模型之间切换,Trae 本身就支持:

- 打开 Trae,在聊天窗口 顶部找到模型选择按钮

- 点击展开模型列表

- 选择你想用的模型(豆包、DeepSeek、GLM 等内置模型)

- 直接开始对话

内置模型不需要额外配置,Trae 已经帮你搞定了。

💡 这是最简单的方式。如果你只是想试试不同模型,先用这个方法。

方法二:添加自定义模型(进阶)

如果内置模型列表里没有你想要的(比如某个第三方模型),可以手动添加。

Step 1:进入模型设置

打开 Trae → 顶部菜单栏找到 模型管理(或设置 → 模型面板)。

Step 2:添加自定义模型

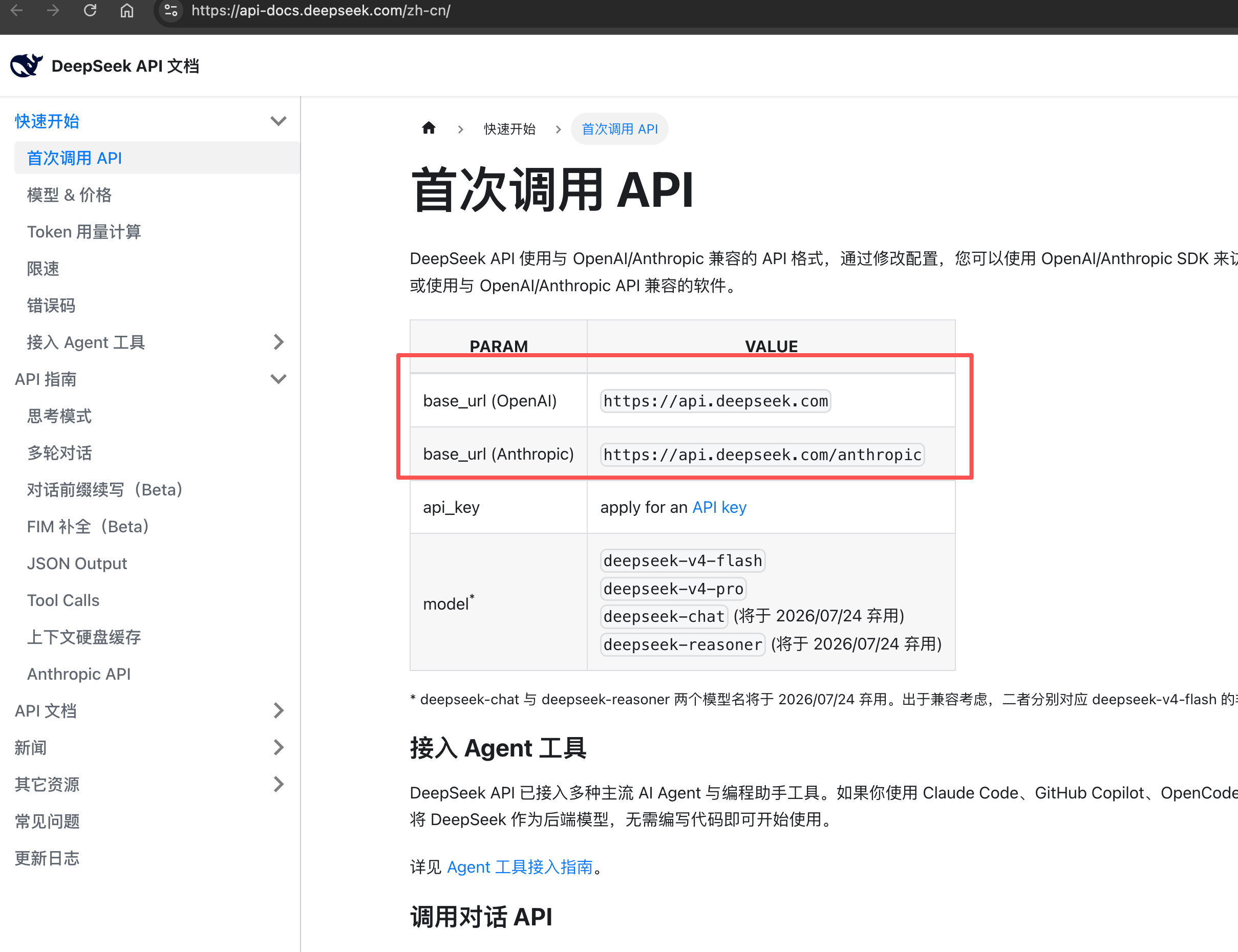

点击「添加模型」→ 选择「自定义」,然后填写以下信息:

| 参数 | 填什么 | 示例 |

|---|---|---|

| 模型名称 | 随便取一个好记的名字 | DeepSeek-V3 |

| API URL | 模型服务的完整接口地址 | https://api.deepseek.com/v1/chat/completions |

| API Key | 从服务商拿到的密钥 | sk-xxxxxxxxxxxx |

Step 3:保存并测试

填写完点保存,然后点「测试」按钮,输入一句话看看模型是否能正常回复。

如果返回了正常的回复,说明配置成功。

Step 4:开始使用

配置完成后,在聊天面板顶部的模型下拉菜单里选择你刚添加的模型即可开始对话。

Trae 的模型记忆机制:Trae 会自动记住你上次选择的模型,下次打开新对话时默认沿用。所以你只需要选一次,之后每次都会自动使用你选过的模型,不用每次手动切换。

⚠️ 注意:Trae 目前没有专门的「设置默认模型」按钮。它的行为是记住你上次的模型选择。如果你想换回其他模型,随时在顶部下拉菜单切换即可。

💡 API URL 注意事项 :必须填完整的接口路径,不能只填域名。错误:

https://api.deepseek.com,正确:https://api.deepseek.com/v1/chat/completions

常见模型的配置参数

直接抄就行:

DeepSeek

API URL: https://api.deepseek.com/v1/chat/completions

API Key: 在 platform.deepseek.com 获取

模型名: deepseek-chat 或 deepseek-reasonerGLM(智谱)

API URL: https://open.bigmodel.cn/api/paas/v4/chat/completions

API Key: 在 open.bigmodel.cn 获取

模型名: glm-4-flash(免费)或 glm-4-plus(付费)Qwen(通义千问)

API URL: https://dashscope.aliyuncs.com/compatible-mode/v1/chat/completions

API Key: 在 dashscope.console.aliyun.com 获取

模型名: qwen-turbo(免费)或 qwen-plus豆包(火山引擎)

API URL: 在火山引擎控制台获取

API Key: 在 console.volcengine.com 获取

模型名: doubao-pro 或 doubao-lite例如:

常见问题

1. 报错「Invalid BaseURL」

原因:API URL 格式不对。

解决 :确保 URL 包含完整路径 /v1/chat/completions,不能只填域名。

2. 模型响应很慢或超时

原因:网络问题或模型服务端负载高。

解决 :

-

在高级设置里配置代理地址

-

或者换个时间段再试(高峰期可能慢)

3. 切换模型后代码补全变差了

原因:不是所有模型都专门针对代码补全优化过。

解决 :

-

代码补全用豆包(默认),对话用 DeepSeek/GLM

-

Trae 支持补全模型和对话模型分开设置

4. 想切回豆包怎么办?

在模型面板里把默认模型切回豆包就行,一键切换,没有副作用。

进阶技巧

1. 多模型按场景切换

你可以同时添加多个模型,根据场景随时切换:

- 日常对话:用豆包(免费、中文好)

- 复杂推理:切 DeepSeek(逻辑强)

- 读大项目:切 GLM(长上下文)

- 创意写作:切 Qwen(中文创意好)

在 Trae 顶部点击模型名就能秒切,不用重启。切换后 Trae 会自动记住,下次新对话继续使用该模型。

2. 接入本地模型

如果你在本地跑了大模型(比如通过 Ollama、vLLM 等),也可以接入 Trae:

- 本地模型启动后,会暴露一个 API 地址(比如

http://localhost:8000/v1/chat/completions) - 在 Trae 里添加自定义模型,API URL 填本地地址

- API Key 随便填(本地模型通常不需要验证)

这样你就能在 Trae 里用自己跑的模型了,完全免费,数据也不出本机。

3. 用中转服务降低成本

如果官方 API 太贵,可以用中转服务(API 代理),价格通常比官方便宜不少。使用方法一样,只是把 API URL 和 Key 换成中转服务的就行。

⚠️ 中转服务的稳定性和数据安全性需要自行评估,建议选择口碑好的服务商。

写在最后

Trae 的自定义模型功能,让「换模型」从一件麻烦事变成了一个点击操作。

就像手机换输入法------默认的能用,但你永远可以换成更顺手的那一个。DeepSeek 推理强、GLM 上下文长、Qwen 中文好,选哪个取决于你的需求。

💡 一句话建议:不确定选什么,就先试 DeepSeek。免费额度够用,推理能力也强。

💬 你在 Trae 里用的是哪个模型?评论区分享一下你的选择和理由。

关于我

国内某互联网公司高级研发工程师、研发组长,致力于 AI 方面的研究和学习分享。关注我,一起学习成长。《MC AI技术开发》