献给那些在符号的迷宫中寻找出口,却在亚符号向量空间中发现新大陆的探路者。

亚符号:人机互助中被忽视的根基

------一种认知哲学分析

邹晓辉 0000-0002-5577-8245

摘要 : 符号表征传统上被认为是思维与智能的专属标志。从亚里士多德《解释篇》到弗雷格的逻辑主义,再到福多的"思维语言",符号操纵一直是心智哲学的核心范式。然而当代人工智能------尤其是深度学习、嵌入表示与大型语言模型的成功,并非源于符号推理,而是基于一个长期被哲学忽视的层次:亚符号表征。本文旨在系统阐明亚符号的本质:它不是尚未命名的低级信号,而是一种具有连续性、分布式、非逻辑性加工特征的自主表征层次。通过对比亚符号与符号、直觉与概念、knowing-how与knowing-that,本文论证:进入人机互助新时代我们不仅必须理解符号层,更必须从哲学上严肃对待亚符号层。忽视亚符号会导致对AI系统的拟人化误解(如Searle"中文房间"论题的误用)与过度简化工具化错误(如Dreyfus早期对AI的批评)。理解亚符号,则能为意向性、非概念内容、符号接地、框架问题等经典哲学问题提供新的解决路径。本文提出并辩护一种双重表征一元论立场,认为人类与人工智能协作中的认知图景由符号与亚符号的共生构成。最后,本文给出面向新时代的"亚符号素养"五原则,并展望哲学与计算科学的交叉前景。

关键词: 亚符号表征;符号接地问题;非概念内容;人工智能哲学;人机互助;双重表征

引言:智能的表层与深层

当一个三岁儿童说出"猫"这个词时我们自然地认为她指涉了世界中的猫科动物,并拥有关于猫的信念("猫会喵喵叫")。符号------语言中的词、逻辑中的谓词、心智中的概念------长久以来被视为智能的显性标志甚至是智能的唯一形式。笛卡尔的"我思"以语言为第一人称证据;弗雷格将思想奠基于命题;图灵测试也依赖符号对话。传统人工智能(所谓的"好的老式AI",Newell & Simon, 1976)正是建立在这一预设之上:智能可以通过物理符号系统的操纵来实现。

然而,过去十五年间席卷全球的深度学习革命显示,当代最强大的AI系统------从AlphaGo到GPT-4------几乎不依赖显式符号推理。它们依靠的是一种晦暗的、无法直接言说的表征层次:亚符号(subsymbols)。神经网络学习到的权重、卷积滤波器、嵌入向量------这些才是它们真正的"思维"素材。一个典型的大型语言模型拥有数千亿个参数,但是没有任何一个参数对应"猫"这个概念。猫的"意义"散布在成千上万个浮点数之间,以一种纠缠的、统计的、非命题的方式存在。

这给哲学带来了紧迫的追问:亚符号究竟是什么?它与符号的关系如何?如果一个系统只在亚符号层运作,它是否具有真正的"理解"?人类在与这类系统协作时,应如何调整自身的认知框架?本文旨在系统地回答这些问题,并通过历史回顾、概念分析、实证研究引用与哲学论证,指出一个核心命题:人机互助的新时代要求我们同时理解符号与亚符号,而不能望文生义地将AI类比为人(拟人论谬误),也不能简单地将AI降格为机械统计器(机械论谬误)。 两者都是对同一认知图景的片面截取。

一、符号表征及其历史局限

1.1 从柏拉图到福多:符号的霸权

符号表征的哲学史几乎就是西方心智哲学的全史。柏拉图在《克拉底鲁篇》中探讨语词与实在的约定关系;亚里士多德在《解释篇》中写下了经典论断:"口头语言是心灵经验的符号,书面语言是口头语言的符号。"中世纪奥卡姆的剃刀为概念符号扫清了共相争论的空间;近代莱布尼茨梦想一种普遍字符(characteristica universalis),将一切推理化为计算。弗雷格彻底地区分了符号的涵义(Sinn)与指称(Bedeutung),为分析哲学奠基。在当代,福多(Fodor, 1975, 2008)提出了最激进的"思维语言假说":心智中有一个内在的、类似逻辑的符号系统------思想的语言(Mentalese),所有认知过程都是对这一符号系统的计算操作。

符号系统具有几个被广为接受的特征:(1)任意性------符号与其所指之间并无必然物理联系;(2)离散性------符号是类别分明的基本单元(如字母、词元),类似或渐变不被许可;(3)组合性------有限符号可按递归规则生成无限表达式(弗雷格的函项原则);(4)语义指向------符号承载着关于世界的内容,具有意向性。

1.2 符号系统的两座高山:接地问题与框架问题

尽管符号系统在逻辑与语言学中取得了辉煌成功,但当人们试图用它们构建完整的智能体时,遇到了两个经典困境。

(1)符号接地问题 (Symbol Grounding Problem):由哈纳德(Harnad, 1990)明确提出。如果符号的意义仅仅由其他符号定义(词典中的循环定义),那么整个符号系统就悬浮在空中无法与真实世界连接。要打破循环,必须至少有一部分符号通过非符号的方式(如感知、行动)直接"接地"到世界。换言之,纯粹的符号操纵无法产生语义内容。哈纳德的解决方案指向亚符号表征即符号必须被"接地"到一种非符号的、类比式的表征中,这正是本文的核心关切。

(2)框架问题 (Frame Problem):由麦卡锡与海耶斯(McCarthy & Hayes, 1969)在人工智能背景下提出但其哲学根源可追溯至休谟对因果推理的怀疑。在逻辑推理系统中当一个事件发生后绝大多数事实保持不变。然而,显式列出所有不变的事实是不可能的(爆炸式增长)。如何让一个符号推理机有效地忽略无关信息?这一问题在纯符号框架内被证明极其棘手。丹尼特(Dennett, 1987)将其称为"人工智能的核心难题"。后来的研究表明,亚符号系统天然地规避了框架问题:因为神经网络通过分布式表征,将"无关"信息编码为连续空间中的小梯度变化,而非显式的逻辑保持(McClelland, 2013)。

这两个困境暗示:纯粹的符号层必须依赖某种更底层的、非符号的支撑。在哲学史上一些思想家早已瞥见这一方向。威廉·詹姆斯(James, 1890)区分了"知道什么"(knowing-what)与"知道如何"(knowing-how);赖尔(Ryle, 1949)将前者归于智力,后者归于"智力行动中的倾向性",但是缺乏计算化的形式。吉尔伯特·赖尔之后,波兰尼(Polanyi, 1966)提出"默会知识"(tacit knowledge)即:"我们能够知道的远比我们能够言说的多。"亚符号正是默会知识的计算化身。

二、亚符号表征的本质与运作

2.1 什么是亚符号?------一种操作性与本体论的双重定义

亚符号不是"原始数据"(如未处理的像素或声波振幅),而是通过自动学习从数据中提取的、连续的、分布式的、非语义的数值表征。它可以被形式化地描述为高维向量空间中的点(嵌入)。亚符号没有固定的名称,也不直接指涉外部对象。其"意义"完全由它在向量空间中的几何关系决定:两个亚符号向量之间的余弦相似度(或欧氏距离)捕获了其所对应输入在某一任务度量下的相似性。

一个实例:2012年AlexNet在ImageNet挑战赛中将分类错误率从26%降至15%(Krizhevsky et al., 2012)。该网络的倒数第二层输出一个4096维的向量。当输入一张猫的图片时,该向量是形如0.23, −0.67, 0.91, ... , 0.45的一组浮点数。没有任何一个维度与"猫"具有一一对应的语义关系。猫的信息"纠缠"在所有维度中。只有通过最后一层的线性映射与softmax,该向量才被转化为离散标签"猫"的概率98%。那个4096维的向量------就是亚符号表征。

在自然语言处理中,相似的原理通过词嵌入(word embeddings)进入哲学视野。Mikolov等人(2013)的Word2Vec模型将词语映射为300维实数向量,著名的公式 king − man + woman ≈ queen 展示了亚符号空间如何编码类比关系。这里没有显式规则"国王是男性君主,女王是女性君主",只有向量空间中隐式的几何结构。

2.2 亚符号的四个决定性特征 (表 1 )

|--------------|---------------|---------------------|

| 特征 | 符号层 | 亚符号层 |

| 连续性 | 离散:非此即彼(猫/非猫) | 连续:向量值,微小变化对应平滑语义漂移 |

| 可命名性 | 每个符号可被语言标签指称 | 维度无名称;只能通过投影或聚类间接解释 |

| 知识表征 | 外显的命题或规则 | 隐式的权值分布,无显式规则对应 |

| 加工逻辑 | 演绎推理、逻辑组合 | 非线性变换、相似度计算、统计推断 |

(1)连续性。 符号世界中,一张图片要么被归类为"猫",要么为"狗",没有中间状态。而在亚符号空间中,表征是连续的。随着一张猫的图片逐渐添加噪声,其亚符号向量在空间中连续移动,直到越过某个决策边界变为"狗"的区域。这种连续性使得亚符号系统对微小扰动具有鲁棒性,但也导致对抗样本攻击(Goodfellow et al., 2015)------微小的、人眼不可察的输入变化,可以沿着连续空间将表征推过决策边界,造成符号层上的灾难性错误。

(2)无名称性/分布性。 亚符号每个维度没有语言学标签。正如丘奇兰德(Churchland, 1989)所言,"大脑是一个向量转换器,而不是命题数据库"。他提出的"状态空间语义学"(statespace semantics)将表征看作高维空间中的点,语义内容是点的位置以及点之间的转换函数。这种分布式表征使得单个维度的损坏不会致命(容错性),但代价是解释性的丧失,我们无法像读一本推理小说那样读懂一个神经网络。

(3)统计性。 亚符号的生成与加工,基于大规模数据的统计规律,而非形式公理。一个经过训练的神经网络的权重本质上是对训练数据分布的一种压缩编码。这与符号系统的"先验真理"形成鲜明对比:在亚符号世界中"猫"不是通过定义,而是通过成千上万张猫的图片与网络权重的交互涌现而出。休谟的归纳问题在这里以计算形态复活:亚符号系统永远无法保证分布外样本的正确推理,这是其根本性局限。

(4)非逻辑性。 亚符号计算包括卷积、池化、整流线性单元、门控循环等操作。它们不服从弗雷格组合原则(Frege's compositionality):即整体的意义是部分意义与组合规则的函数。例如,符号系统可以轻松地由"红色的马"推导出"红色的动物"。亚符号系统在训练数据中,没有见过"红色的马"这一组合的情况下,可能无法正确泛化即这一现象被称为组合泛化缺陷(Lake & Baroni, 2018)。这提醒我们:亚符号不是符号的简单替代,而是一种本质不同的表征范式。

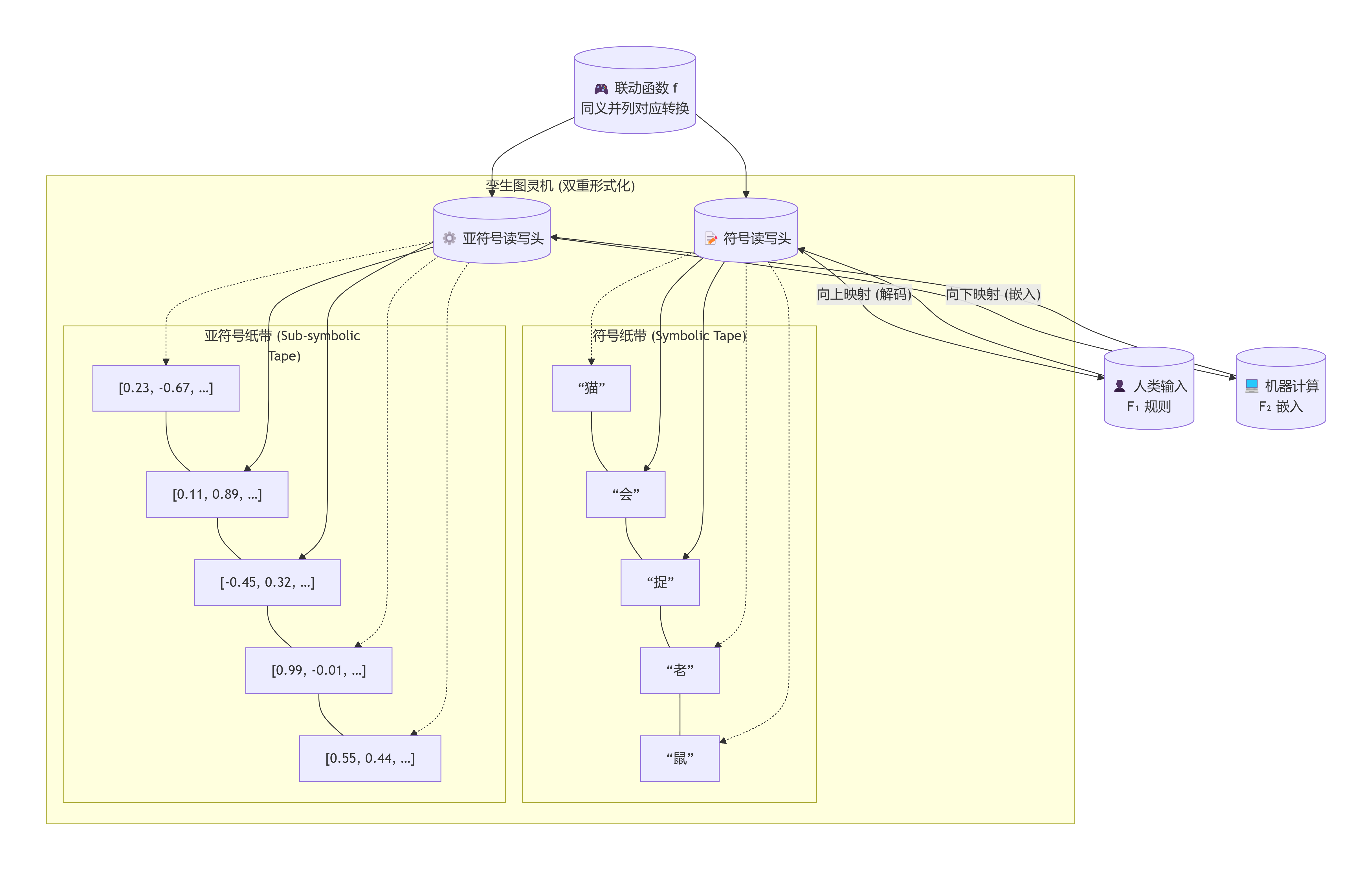

2.3 亚符号与符号的双向映射:嵌入与解码

符号与亚符号之间并非彼此隔绝,而是通过两个映射相互转化:

向上映射(抽象归纳) :从亚符号到符号。通常由一个分类头(softmax),或一个解码器(如语言模型的输出层)完成。这是一个离散化与降维 的过程,伴随着不可逆的信息损失。同样的亚符号向量可能抽象出了"猫"的标签,但丢失了毛色、姿态等细节。

向下映射(具象映射/接地) :从符号到亚符号。将离散符号(如词、概念),通过嵌入矩阵映射为连续向量。Nelson等人(2020)实验表明,即使是完全相同的符号,在不同上下文中可以映射到向量空间中相距甚远的点(一词多义的几何解释)。这一过程本质上是投影 ,将离散语义投射到一个具有丰富几何结构的连续流形上。

这两种映射的不完全可逆性,正是AI系统时而聪明、时而愚蠢的根本原因。符号接地问题在亚符号框架下被重新表述为:如何确保向下映射(符号→亚符号)后的向量,在经过亚符号层的加工后,向上映射返回的符号与输入符号足够一致或语义相关?Harnad(1990)的"类符号表征"(iconic representations)------即知觉模拟------正是亚符号层的雏形。

2.4 主要图示

图1:符号层与亚符号层的双向耦合架构

符号层 (可命名、离散、逻辑)

▲ ▲

│ (抽象归纳) │ (落地映射)

│ softmax, 解码器 │ 嵌入, 编码器

│ │

亚符号层 (连续、向量、统计)

图2:一个简单的亚符号到符号映射示例("猫"分类)

输入图片 (像素) → 亚符号向量 (4096维) → softmax层 → 猫:0.98, 狗:0.015, 鸟:0.005

↑

无名数值特征

三、亚符号的哲学意涵:重访意向性、非概念内容与默会知识

3.1 非概念内容的计算实现

哲学中关于非概念内容(nonconceptual content)的讨论至少可追溯到埃文斯(Evans, 1982)。他曾以知觉经验为例:你能精确地区分两种极接近的红色,即使你没有任何概念可捕捉这种差异。你的知觉状态具有比你的概念装备,更精细的内容,这就是非概念内容的一种形式。Peacocke(1992, 1998)进一步发展了"场景内容"(scenario content)理论,认为知觉经验以"位置及其属性的方式"表征世界,而不必诉诸以概念为构件的内容。

亚符号表征正好为这一理论提供了计算化模型。一个卷积网络在处理图像时,其早期层的特征图包含边缘、纹理方向的精细信息,而这些信息从未被命名为"45度边缘"之类的符号。这正是计算机化的非概念内容。Heck(2000)在《哲学评论》上提出的著名论证------"非概念内容属于理由空间之外",在亚符号语境下获得新解:亚符号向量确实不在理由空间(逻辑论证的空间)中运作,而是在"相似性空间"(similarity space)中运作。这并不意味着非概念内容是非理性的,而是,说明存在一种不同的理性形态------统计理性。

3.2 亚符号系统有意向性吗?------中文房间论题的拓展

塞尔(Searle, 1980)的"中文房间"思想实验试图证明: 纯符号操作(如电脑程序)不可能产生真正的意向性(内在的指向性、语义内容)。塞尔认为,房间里的人不懂中文,只是按照规则,操纵中文字符,因此,没有理解。然而,这个论证预设了智能只能是符号层次的。如果系统的主要加工,发生在亚符号层,情况是否不同?

丘奇兰德(Churchland & Churchland, 1990)反驳道:中文房间中的人如果不仅操纵符号,而且还拥有与中文感知相关的亚符号状态(例如,通过大规模神经网络学习得到的向量空间)那么"理解"就可能涌现。从本文的视角来看,亚符号向量空间中的几何结构------即相似的语义倾向于聚集------可被视作一种准意向性(quasi-intentionality)。它不具备内在的关于性(aboutness),因为,它仍依赖于外部解释者的解读。但是它为意向性提供了载体条件:没有亚符号的接地,符号意向性就是空洞的;没有符号的范畴化,亚符号就是无意义的波动。

因此,我们的立场是谨慎的:纯粹的亚符号系统(无符号接口)没有意向性;但符号-亚符号双系统可以通过亚符号层的接地而获得某种派生意向性。这与丹尼特(Dennett, 1987)的意向立场(intentional stance)兼容:当我们对一个系统采取意向立场时,我们将其行为预测为理性主体行为;亚符号系统支持这种预测,是因为其内部表征空间的几何结构恰好符合人类语义的分类。

3.3 重新激活默会知识:波兰尼与赖尔的延续

波兰尼(Polanyi, 1966)的"默会知识"概念------我们知道的远比我们能够言说的多------在亚符号时代获得了前所未有的清晰形式。一个训练有素的放射科医生能够识别出X光片中的早期肿瘤,但是他无法用语言完整表达他的判断依据("就是这个感觉")。这正是人脑亚符号层次的工作。同样,一个深度神经网络在肺结节检测中达到了超越人类专家的精度(Esteva et al., 2017),但它的决策依据是无法用检验规则描述的亚符号权重。

赖尔(Ryle, 1949)区分的"知道那个"(knowing-that)与"知道如何"(knowing-how)本质上是符号知识与亚符号知识的另一种表达。知道那个(巴黎是法国的首都)可以组织为命题网络;知道如何(骑自行车)则是隐含在感觉运动协调中的亚符号程序。Ryle强调智力行为并不总是需要先行理论(理论先行论是理智主义神话),亚符号理论为这一论点提供了计算神经科学的基础。由此,可以构建一个二元知识理论(表2 ):

|-----------------------------|---------------------|----------------|--------------|

| 知识类型 | 表征形式 | 可否言语报告 | 典型范例 |

| 符号 知识(knowing-that) | 命题、规则 | 可以 | "地球绕太阳转" |

| 亚符号 知识(knowing-how) | 权值、向量 、调谐曲线 | 不可以(或只能近似) | 骑自行车、人脸识别 |

这一区分对于人机互助至关重要:当我们要求AI解释其决策时,实质上是要求它将亚符号知识翻译为符号知识。这种翻译本身就是一种创造性的、有损的过程。优秀的解释系统(可解释AI,XAI),实质上是在亚符号空间与符号空间之间建立更忠实的映射。

四、人机互助中的亚符号理解:必要性及实践原则

4.1 两种对称性谬误:拟人论与机械论

在与当代AI系统的日常协作中------从大语言模型(如GPT-4)到自动驾驶,从医疗影像诊断到金融风控------缺乏对亚符号的系统理解会导致两类对称的错误。

(1)拟人论谬误 (Anthropomorphism Fallacy)

认为AI"真的相信"、"感到沮丧"或"有自己的意图"。例如,当用户对ChatGPT说"你错了",它回复"对不起,我错了,谢谢指正",用户可能认为它真的承认错误并感到懊悔。事实上,语言模型的输出,只是亚符号向量空间,向离散序列投影的结果,通过类似性的统计预测,并没有任何信念、情绪或元认知。这种拟人化可能导致过度信任("AI不会骗人")或过度敌意("它在操纵我")。Tversky与Kahneman(1974)的"代表性启发式"在这里起到作用:因为,AI的语言与人类无异,认知系统,自动将其归为人类心智。

(2)机械论谬误 (Mechanomorphism Fallacy)

认为AI只是简单的统计查表或已知模式的重复,毫无创造性。例如,批评者会说"大语言模型只不过是一个巨大的键盘输入-输出映射"。这种看法忽略了亚符号系统的泛化能力------神经网络可以在训练时未见过的示例上做出合理推断,甚至可以产生全新的组合、风格融合甚至"洞见"(例如,AlphaGo的"第37手"震惊人类棋手)。亚符号空间的连续性与非线性赋予了系统超越训练标签的行为。机械论谬误会使人低估AI的能力,从而错失可靠的人机协作机会。

人机互助的健康基础,是同时避免这两种谬误。这需要我们在认知上承认:亚符号是一种自主的、有能力的表征层次,同时,清醒地认识到:它与人类意识之间的鸿沟。

4.2 必须理解的五个亚符号事实("亚符号素养")

基于前述分析,提出面向所有人机参与者的五项核心事实,姑且称之为"亚符号素养五原则":

表 3

|----------------------|----------------------------------------------------|-----------------------------------------------------------|

| 原则 | 内容 | 举例说明 |

| 1. 几何信念原则 | AI"信念"本质上是向量空间中的区域,而非命题。一个决策错误意味着输入向量落在错误类别的聚类区域。 | 对抗攻击通过微小扰动将图像"推"过决策边界,从"猫"变成"长臂猿"。 |

| 2. 符号指令无效原则 | 不能通过符号指令直接修正亚符号内部表征。对AI说"不要那样做"不起作用;纠正需要重新嵌入或微调模型。 | 提示工程(prompt engineering)通过改变输入语境,引导AI进入向量空间的不同区域,而非修改其内存。 |

| 3. 校准≠正确原则 | Softmax概率(置信度)是经过校准的统计量,但在分布外输入上可能过度自信或过于不确定。 | GPT4对明显荒谬问题的答案有时给出99%置信度,因为它在训练数据分布中未见过类似输入。 |

| 4. 相似度≠因果性原则 | 亚符号说两个事件相似(距离近),但这不意味着因果联系。统计相关性是亚符号的核心,而非因果模型。 | 词嵌入中"医生"与"护士"距离近但不能推出性别因果关系,反而可能编码社会偏见。 |

| 5. 无显式否定原则 | 亚符号系统没有内建否定表示。"不是猫",只能通过远离"猫"区域来近似表现,无法显式地表示否定命题。 | 语言模型回答"不是什么"时容易被误导,因为它没有存储"不"的逻辑算子。 |

这五项原则应当成为计算时代人文素养的一部分 ,如同统计学中理解相关与因果的区别,或逻辑学中理解充分必要条件。

4.3 双向透明与责任归属:哲学与法律的交汇

真正可靠的人机互助要求双向透明(bidirectional transparency):一方面,AI系统应该通过可解释性技术(saliency map、LIME、SHAP、概念激活向量等)将其亚符号决策过程映射为人类可以理解的符号形式;另一方面,人类(工程师、用户、决策者)必须理解这些解释是近似性的、有损耗的,且在数学上不完备。Rudin(2019)在《自然机器智能》上警告:对于高风险领域(医疗、司法),不应该依赖事后解释的"黑箱",而应该构建自解释的模型------这本质上是在模型设计阶段,就将亚符号空间与高层概念进行显式对齐。

责任归属 :如果一套自动驾驶汽车发生事故,谁应负责?亚符号系统缺乏意向性和自由意志,故不能将其视为道德主体。最终责任落在系统的设计者、操作者或所有者身上------即使具体决策是由亚符号网络的非线性动力学"自动"产生。这一立场与Floridi(2018)的"分布式道德责任"模型相容:将责任分配给人机系统中的各个层面,但主要责任仍归属于人类,因为只有人类具备道德能动性。

五、跨学科证据:认知科学、神经科学与AI的融合

5.1 认知神经科学中的亚符号对应物

如果亚符号表征是人工智能的工作基础,那么在人脑中是否也存在类似的亚符号层次?大批神经科学证据表明,答案是肯定的。群体编码(population coding)理论(Georgopoulos et al., 1986)指出运动皮层中单个神经元的调谐曲线很宽,但神经元群体的活动向量能够精确编码运动方向;这种向量表征就是亚符号的。分布式表征在知觉、记忆、语言中无处不在:例如,人脑中"祖母细胞"极少见,更常见的是联合编码。丘奇兰德(Churchland, 1989)在《神经哲学》中主张,应当抛弃命题式的"信念/欲望"解释,转向状态空间语义学即将信念状态视为神经活动状态空间中的一个区域。这正是亚符号哲学的源头活水。

表 4 人脑与人工神经网络中亚符号表征的对应

|------------|---------------|-------------------|---------------|

| 层次 | 人脑 | 人工神经网络 | 亚符号特性 |

| 原始输入 | 视网膜光感受器,耳蜗毛细胞 | 像素值,声谱图 | 连续、无名称 |

| 初级特征 | V1简单细胞(边缘、朝向) | 卷积层滤波器 | 统计、可调谐 |

| 高级特征 | IT皮层(形状、物体部分) | 全连接层/Transformer层 | 分布式、纠缠 |

| 可报告内容 | 语言皮层将活动转化为命题 | softmax层输出标签 | 符号化映射 |

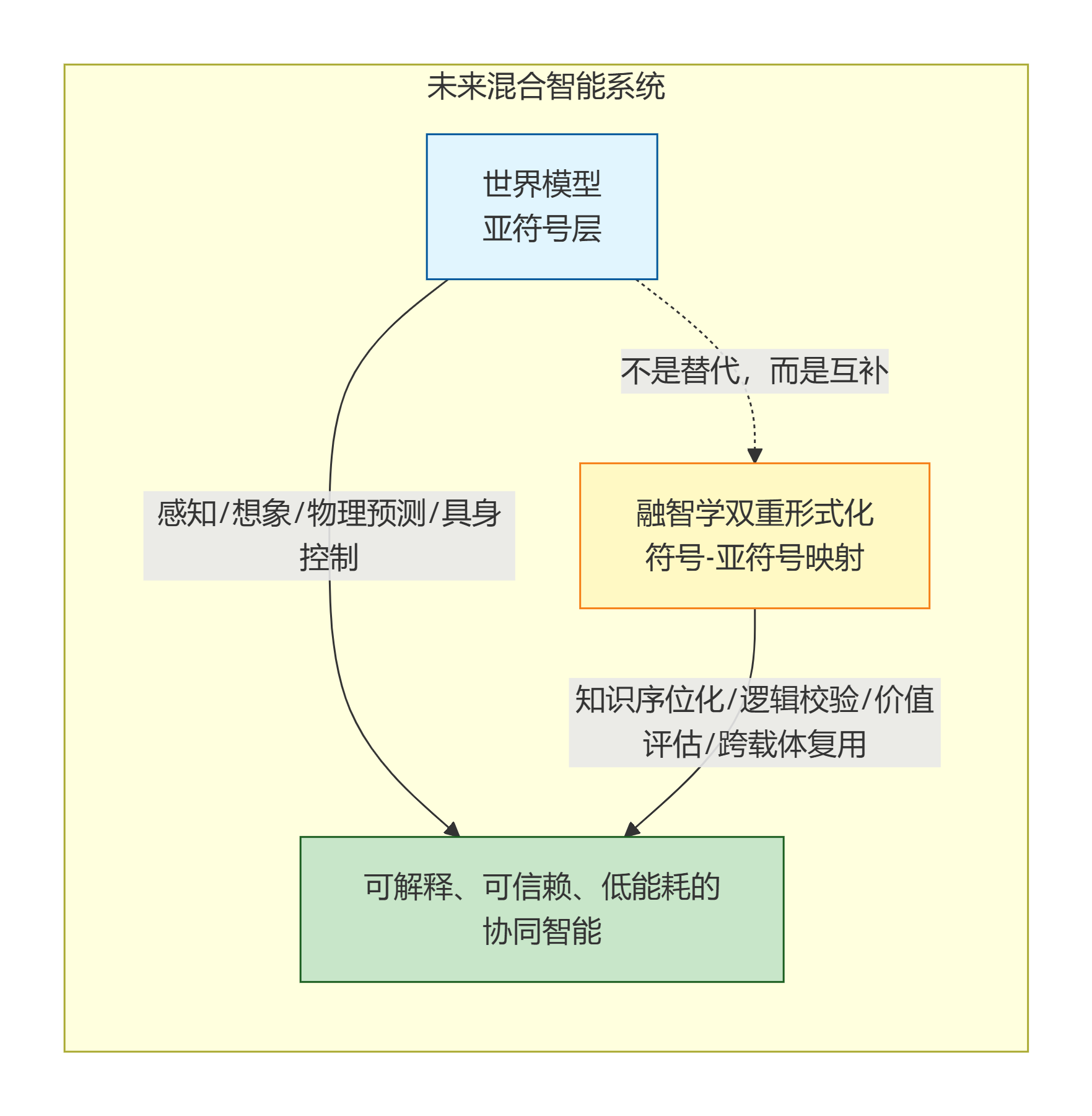

5.2 连接主义与符号主义的世纪之争

20世纪80-90年代,以鲁梅尔哈特、麦克莱兰为代表的连接主义(connectionism),与以福多、平克为代表的符号主义(symbolicism)之间爆发了著名的"认知科学范式之争"。鲁梅尔哈特等(1986)的《并行分布式处理》展示了神经网络如何在亚符号层次完成看似需要符号推理的任务(如动词过去式学习)。福多(Fodor & Pylyshyn, 1988)在《认知》上发表重磅批评,认为连接主义无法解释系统性、组合性等符号系统的核心特征。这场争论并未一方压倒另一方,而是催生了今天的混合模型(如神经符号系统,NeuralSymbolic Systems;参见Garcez et al., 2019)。本文提倡的双重表征一元论,可以说是这场争论的哲学升华:符号与亚符号如同硬币的两面,在认知中不可分割。

5.3 大型语言模型的验证:BERT、GPT与亚符号涌现

2018年,谷歌的BERT模型(Devlin et al., 2019)通过对海量文本的掩码语言模型任务,学习了精细的亚符号表征。后续研究表明(Tenney et al., 2019; Ethayarajh, 2019),BERT的不同层次,捕捉了从浅层形态特征到深层语义角色的信息。GPT系列(Brown et al., 2020)进一步展示了亚符号表征,在生成任务中的涌现能力包括上下文学习、思维链推理(Wei et al., 2022)等。值得注意的是,思维链推理可以被解释为:让模型将亚符号计算逐步"翻译"为符号串,从而提高了输出的可解释性与准确性。这是亚符号与符号协作的典型案例。

最近,OpenAI的GPT-4/-5、Google的PaLM等模型甚至能够在某些标准化测试中达到人类水平。但不能因此得出结论说它们已经拥有了人类心智。它们的所有"回答"都是亚符号向量空间计算的投影。它们的成功证明了亚符号表征的强大,也反过来揭示了人类大脑中之前未被充分认识的亚符号深度。

六、结论:走向双重表征一元论

本文论证了亚符号是一种真实的、不可还原的表征层次,具有连续性、分布式、统计性与非逻辑性等本质特征。它与符号层构成一个相互依赖的整体:没有符号,亚符号就是毫无意义的数据噪声;没有亚符号,符号就是无根的逻辑空转。提出双重表征一元论(DualRepresentation Monism),作为我们统一立场:在认识论和方法论上区分符号与亚符号两个层次,在本体论上承认它们都是智能系统的必要组成部分,存在不可分割的协同共生关系,不存在谁更"基本"的优先性------正如希尔伯特空间中的波粒二象性,某些问题以粒子(符号)视角更清晰,另一些问题以波动(亚符号)视角更精确。

对于人机互助新时代,教育与实践应当培养"亚符号素养"。这意味着:既要像传统哲学家那样,善于使用符号推理(逻辑、概念分析、论证),也要像计算科学家那样,理解向量空间、相似度度量、非线性映射与统计泛化。只有同时驾驭两种表征,人类才能真正与机器形成互补互信的协作关系,避免被技术决定的狂热或恐惧所左右。

亚符号不是通向符号的阶梯,而是智能的另一半天空。当我们的学生日后学习哲学时,他们不仅应当阅读柏拉图的洞穴比喻,也应当亲身体验训练一个神经网络,观察从随机权重到语义聚类的涌现过程。洞外的阳光与洞内的影子,现在都在向量空间中闪烁。

参考文献

Brown, T., Mann, B., Ryder, N., et al. (2020). Language models are few-shot learners. Advances in Neural Information Processing Systems, 33, 1877-1901.

Churchland, P. M. (1989). A Neurocomputational Perspective: The Nature of Mind and the Structure of Science. MIT Press.

Churchland, P. S., & Churchland, P. M. (1990). Could a machine think? Scientific American, 262(1), 32-37.

Dennett, D. C. (1987). The Intentional Stance. MIT Press.

Devlin, J., Chang, M.-W., Lee, K., & Toutanova, K. (2019). BERT: Pre-training of deep bidirectional transformers for language understanding. Proceedings of NAACL-HLT, 4171-4186.

Dreyfus, H. L. (1979). What Computers Still Can't Do. MIT Press.

Esteva, A., Kuprel, B., Novoa, R. A., et al. (2017). Dermatologist-level classification of skin cancer with deep neural networks. Nature, 542(7639), 115-118

Ethayarajh, K. (2019). How contextual are contextualized word representations? Comparing the geometry of BERT, ELMo, and GPT-2 embeddings. Proceedings of EMNLP, 55-65.

Evans, G. (1982). The Varieties of Reference. Oxford University Press.

Floridi, L. (2018). Soft ethics and the governance of the digital. Philosophy & Technology, 31(1), 1-8.

Fodor, J. A. (1975). The Language of Thought. Harvard University Press.

Fodor, J. A. (2008). LOT 2: The Language of Thought Revisited. Oxford University Press.

Fodor, J. A., & Pylyshyn, Z. W. (1988). Connectionism and cognitive architecture: A critical analysis. Cognition, 28(1-2), 3-71.

Garcez, A. d., Gori, M., Lamb, L. C., et al. (2019). Neural-symbolic computing: An effective methodology for principled integration of machine learning and reasoning. Journal of Applied Logics, 6(4), 611-658.

Georgopoulos, A. P., Schwartz, A. B., & Kettner, R. E. (1986). Neuronal population coding of movement direction. Science, 233(4771), 1416-1419.

Goodfellow, I. J., Shlens, J., & Szegedy, C. (2015). Explaining and harnessing adversarial examples. ICLR.

Harnad, S. (1990). The symbol grounding problem. Physica D, 42(1-3), 335-346.

Heck, R. G. (2000). Nonconceptual content and the "space of reasons". The Philosophical Review, 109(4), 483-523.

James, W. (1890). The Principles of Psychology. Henry Holt.

Krizhevsky, A., Sutskever, I., & Hinton, G. E. (2012). ImageNet classification with deep convolutional neural networks. Advances in Neural Information Processing Systems, 25, 1097-1105.

Lake, B. M., & Baroni, M. (2018). Generalization without systematicity: On the compositional skills of sequence-to-sequence recurrent networks. Proceedings of ICML, 2873-2882.

McCarthy, J., & Hayes, P. J. (1969). Some philosophical problems from the standpoint of artificial intelligence. Machine Intelligence, 4, 463-502.

McClelland, J. L. (2013). The neural basis of consciousness and the frame problem. In A. Cleeremans (Ed.), The Oxford Companion to Consciousness, 280-283.

Mikolov, T., Chen, K., Corrado, G., & Dean, J. (2013). Efficient estimation of word representations in vector space. arXiv:1301.3781.

Newell, A., & Simon, H. A. (1976). Computer science as empirical inquiry: Symbols and search. Communications of the ACM, 19(3), 113-126.

Peacocke, C. (1992). A Study of Concepts. MIT Press.

Peacocke, C. (1998). Nonconceptual content defended. Philosophy and Phenomenological Research, 58(2), 381-388.

Polanyi, M. (1966). The Tacit Dimension. Doubleday.

Rumelhart, D. E., McClelland, J. L., & PDP Research Group. (1986). Parallel Distributed Processing (Vols. 1 & 2). MIT Press.

Rudin, C. (2019). Stop explaining black box machine learning models for high stakes decisions and use interpretable models instead. Nature Machine Intelligence, 1(5), 206-215.

Ryle, G. (1949). The Concept of Mind. Hutchinson.

Searle, J. R. (1980). Minds, brains, and programs. Behavioral and Brain Sciences, 3(3), 417-424.

Tenney, I., Das, D., & Pavlick, E. (2019). BERT rediscovers the classical NLP pipeline. Proceedings of ACL, 4593-4601.

Tversky, A., & Kahneman, D. (1974). Judgment under uncertainty: Heuristics and biases. Science, 185(4157), 1124-1131.

Wei, J., Wang, X., Schuurmans, D., et al. (2022). Chain-of-thought prompting elicits reasoning in large language models. Advances in Neural Information Processing Systems, 35, 24824-24837.

表5 术语对照

|------------|----------------------------|----------------------------------|

| 中文 | 英文 | 首次出现 章 节 |

| 亚符号 | subsymbolic representation | 引言 |

| 符号接地问题 | symbol grounding problem | 1.2 |

| 非概念内容 | nonconceptual content | 3.1 |

| 分布式表征 | distributed representation | 2.2 |

| 嵌入式向量 | embedding vector | 2.1 |

| 状态空间语义学 | statespace semantics | 2.2 |

| 默会知识 | tacit knowledge | 3.3 |

| 双重表征一元论 | dualrepresentation monism | 结论 |