AI本地部署快速步骤

- 搭建AI知识库都需要哪些工具

- 第一部分:搭建本地模型的运行环境

- 第二部分:搭建AI知识库管理工具

-

- [步骤1:下载并安装Anything LLM](#步骤1:下载并安装Anything LLM)

- [步骤2:配置Anything LLM](#步骤2:配置Anything LLM)

- 步骤3:上传文档,搭建专属知识库

- 步骤4:对话查询,使用知识库

搭建AI知识库都需要哪些工具

搭建AI本地知识库,核心需要两类工具:一是本地模型运行环境(负责运行大语言模型和嵌入模型),二是知识库管理工具(负责连接模型与文档,实现文档上传、解析和对话查询)。下面将分两部分,详细讲解具体搭建步骤,全程新手友好,跟着操作就能完成。

第一部分:搭建本地模型的运行环境

本地模型运行环境是基础,负责承载大语言模型(用于对话生成)和嵌入模型(用于将文档转化为可检索的向量)。目前有很多工具可实现本地部署,比如Ollama、LM Studio、NVIDIA NIM等,其中Ollama操作最简单、适配性最强,新手首选,本次就选用Ollama进行模型部署。

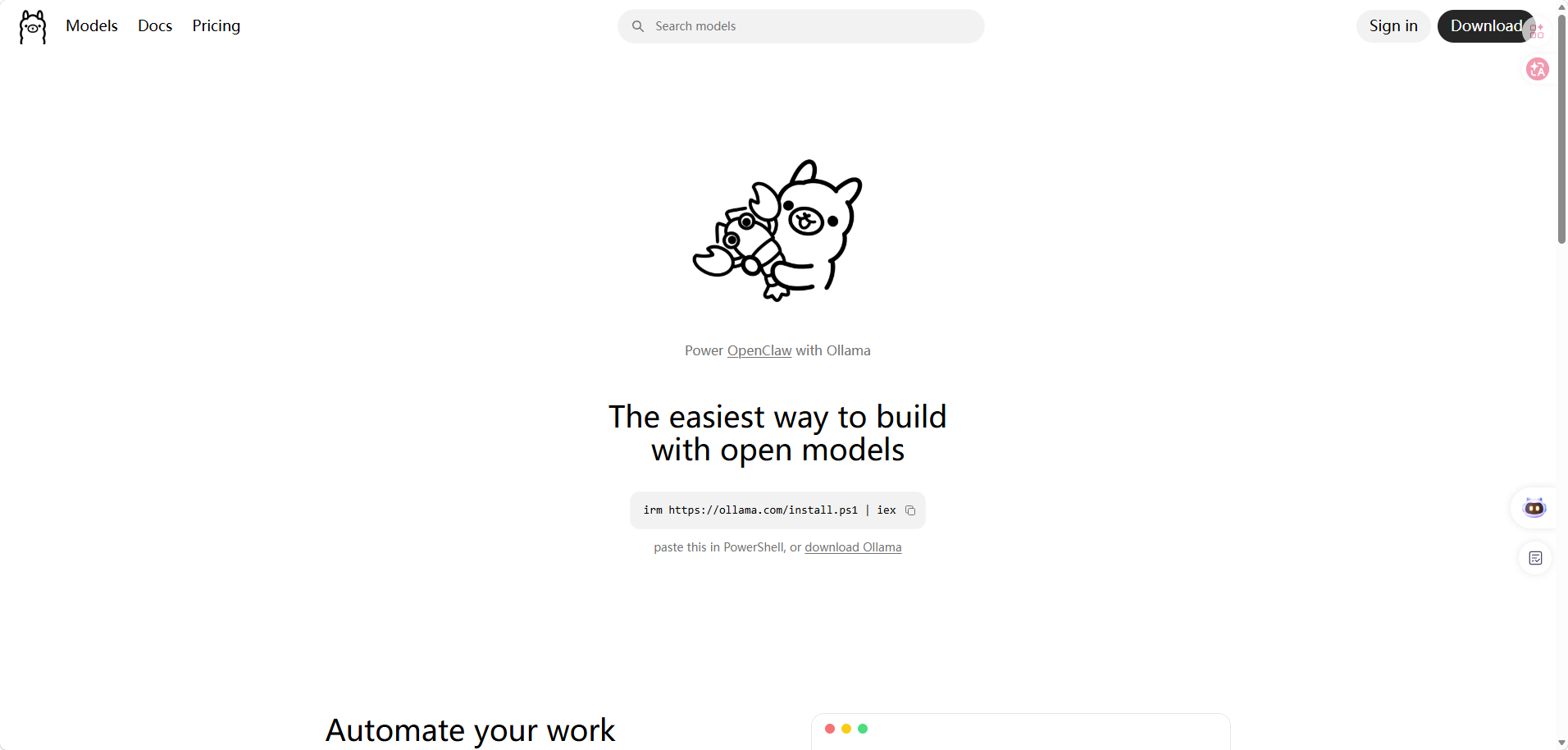

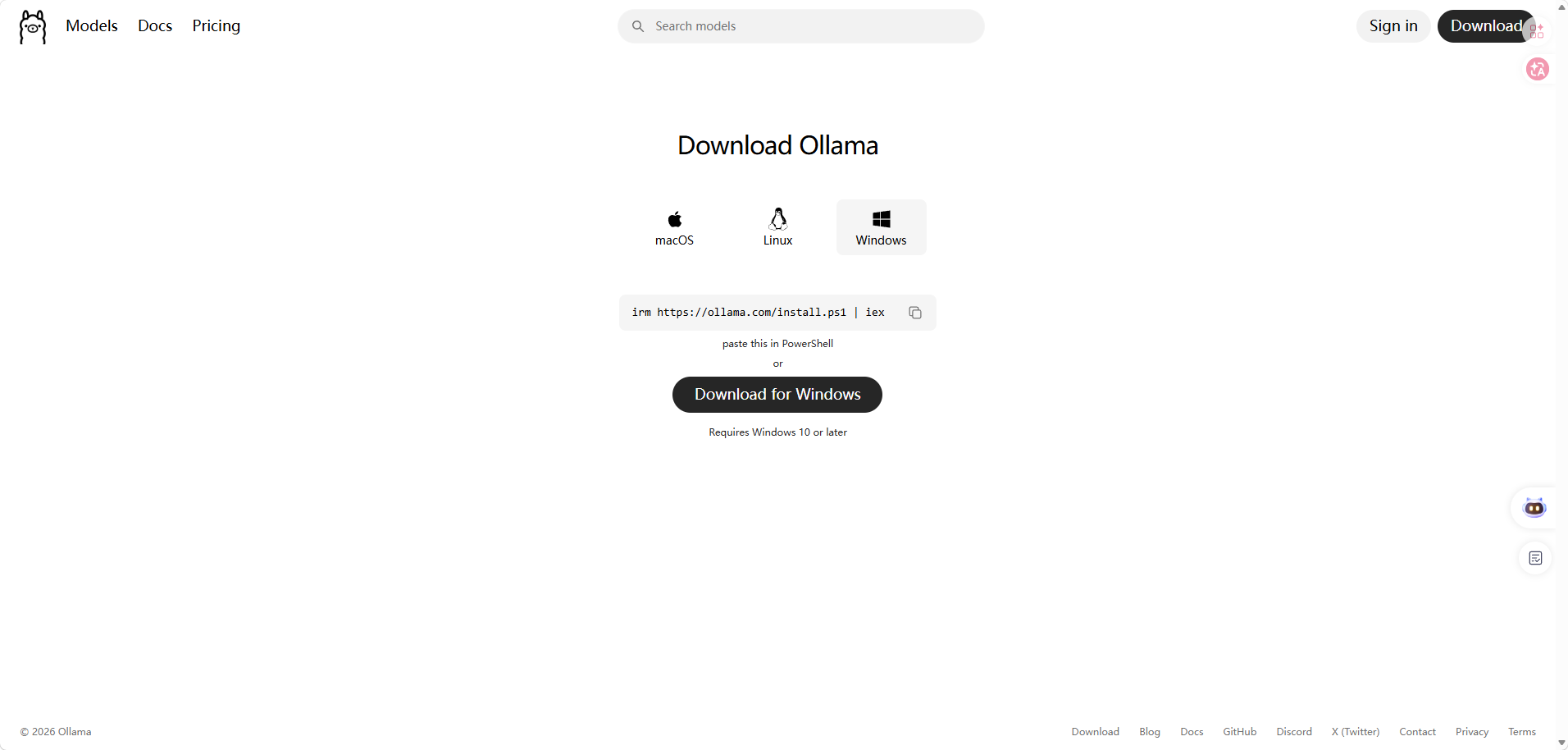

步骤1:下载并安装Ollama

直接访问Ollama官网下载,官网地址:Ollama(Windows版),支持Windows 10及以上系统,其他系统(macOS、Linux)可在官网切换对应版本下载。

下载方式有两种,任选其一即可:

- 方式1:** 复制命令

irm https://ollama.com/install.ps1 | iex,粘贴到PowerShell中,回车即可自动下载安装; - 方式2:在官网点击"Download for Windows",下载安装包后,按照提示"下一步、下一步"傻瓜式安装,无需额外配置。

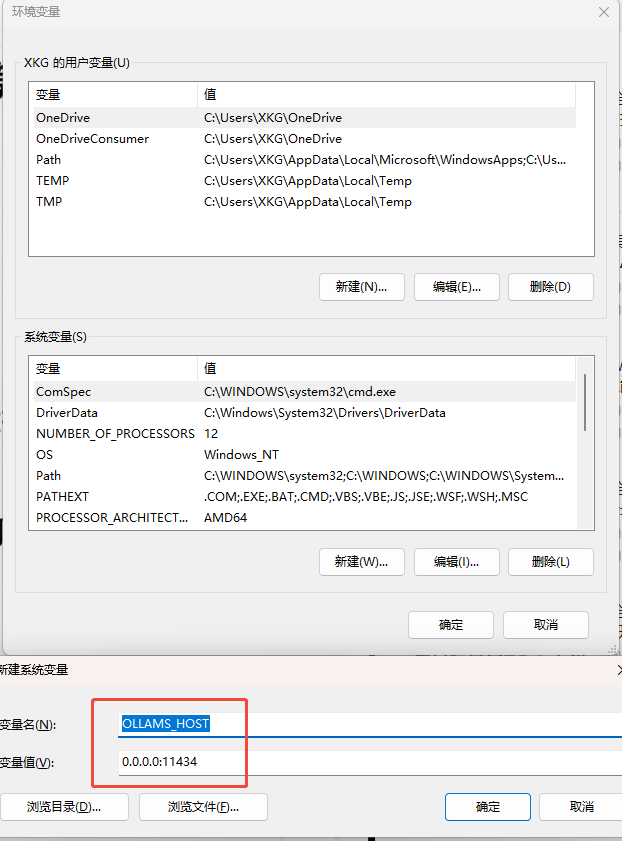

步骤2:配置Ollama环境变量(可选,建议配置)

环境变量配置主要解决两个问题:一是让虚拟机(若有)能访问本机的Ollama模型,二是修改模型默认下载路径(避免C盘空间不足)。具体配置步骤如下:

- 按下

Win+R,输入sysdm.cpl,打开"系统属性",切换到"高级"选项卡,点击"环境变量"; - 新建系统变量:在"系统变量"栏点击"新建",根据需求添加以下变量(无需全部添加,按需选择):

- 变量名:

OLLAMA_HOST - 变量值:

0.0.0.0:11434(核心配置,让虚拟机或其他设备能访问本机 Ollama) - 变量名:

OLLAMA_MODELS(可选) - 变量值: 自定义路径(如

D:\Ollama\Models,用于修改模型下载目录)

- 变量名:

- 配置完成后,务必重启电脑,确保环境变量生效。

环境变量操作截图参考:

重点提醒:环境变量中变量名需准确,OLLAMA_HOST的变量值固定为0.0.0.0:11434。

步骤3:下载大语言模型和嵌入模型

Ollama安装并配置完成后,需要下载两个核心模型:大语言模型(用于对话)和嵌入模型(用于文档向量转换),步骤如下:

- 下载大语言模型

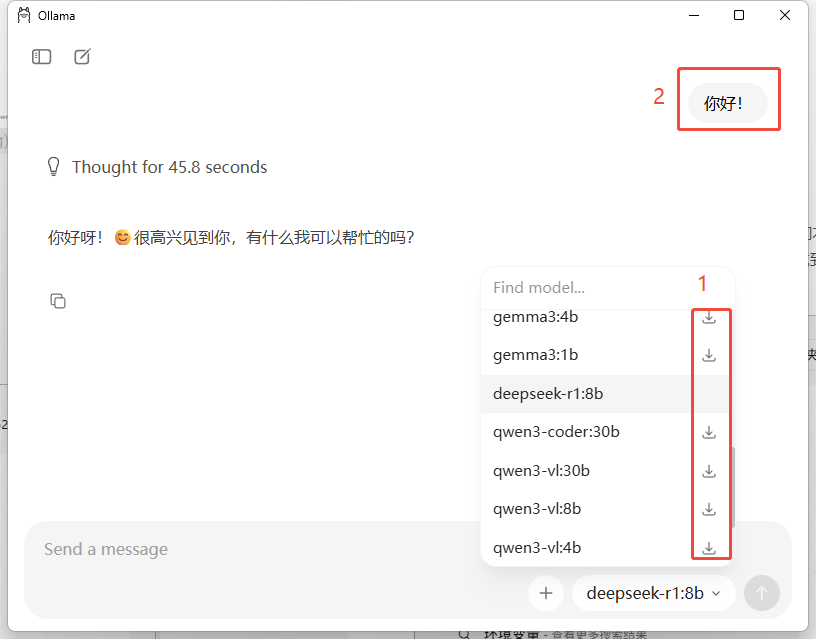

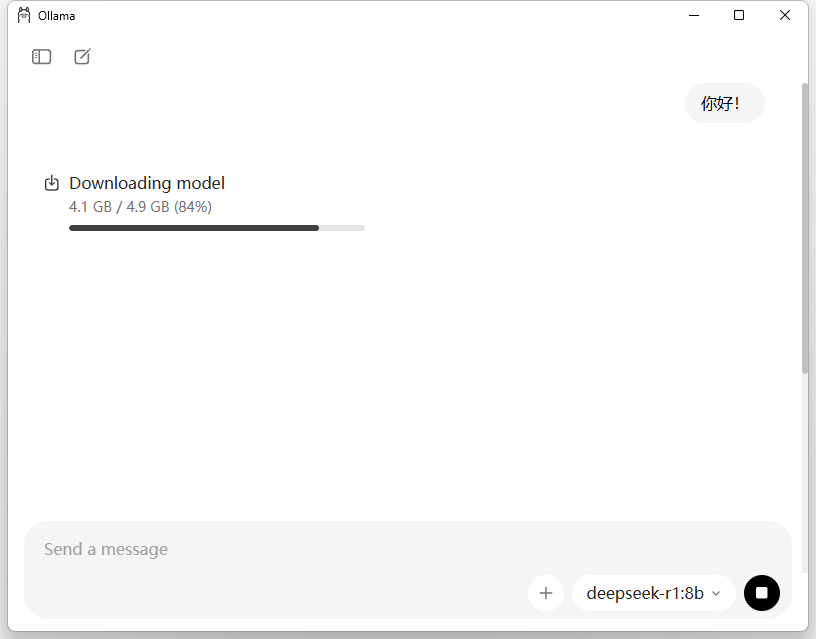

打开Ollama客户端,左侧会显示可下载的模型列表(带有下载图标),选择与自己电脑CPU、内存、显卡匹配的模型(新手推荐deepseek-r1:8b,性能均衡,对硬件要求不高)。

下载完成后,在对话框输入"你好!",若能收到模型的回复,说明大语言模型部署成功。

操作截图参考:

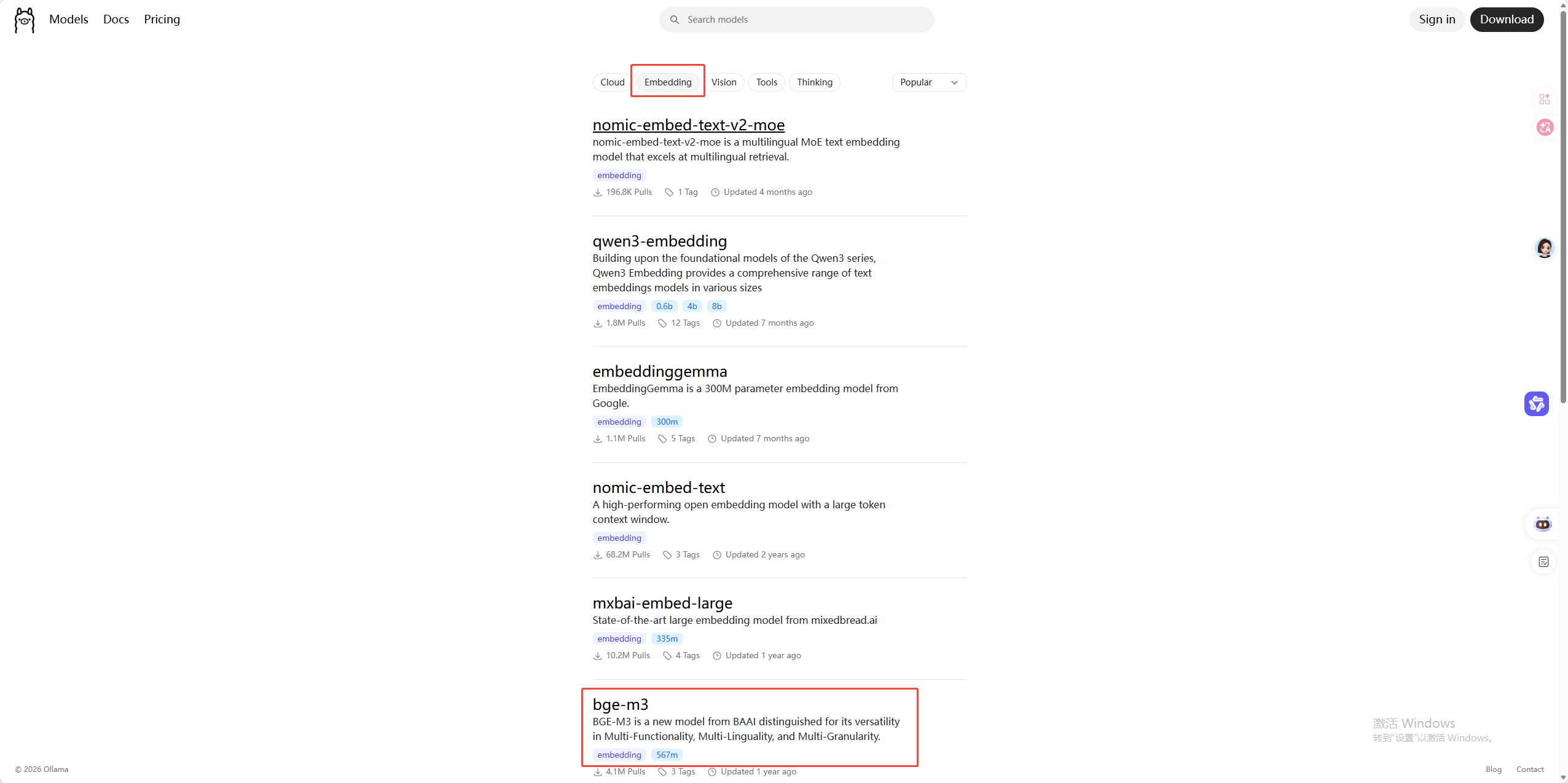

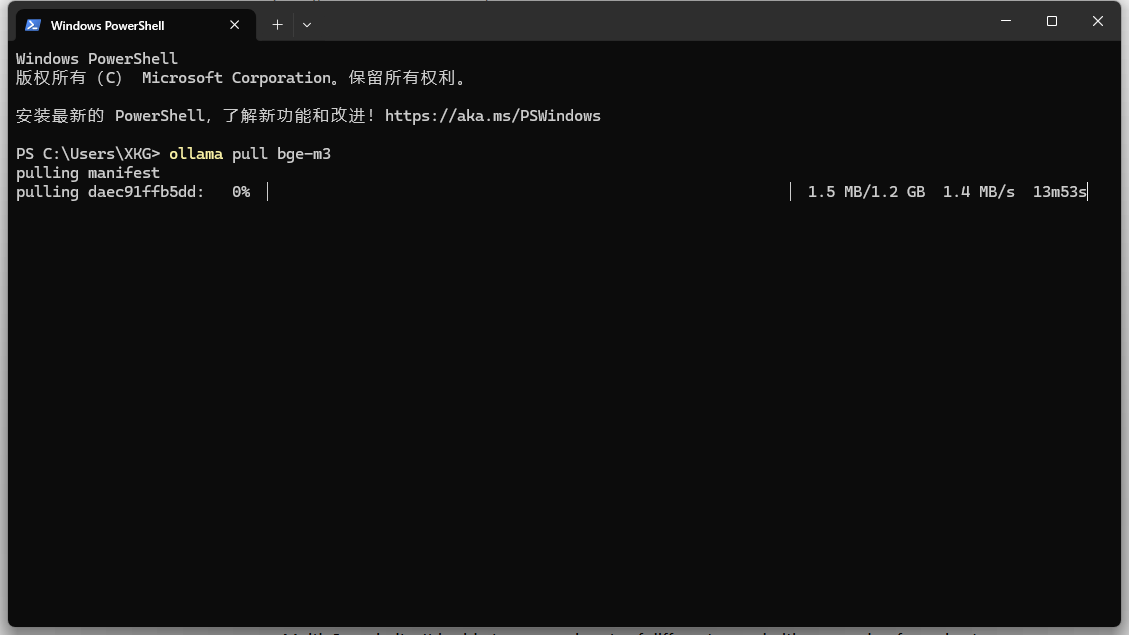

- 下载嵌入模型

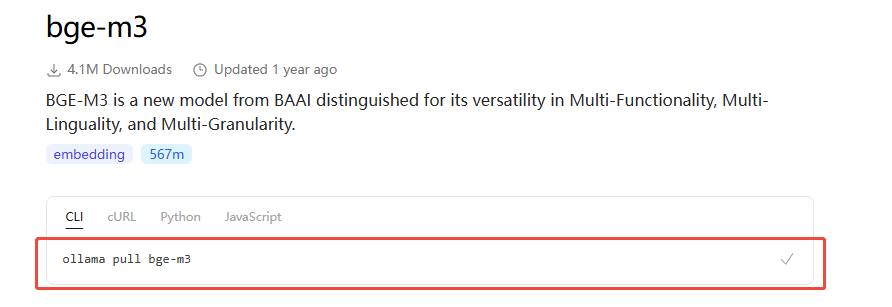

嵌入模型的作用是将文档文本转化为数字向量,供知识库检索使用,本次选择常用且性能优秀的bge-m3模型,下载步骤如下: - 访问Ollama官网,点击上方导航栏的"Models",在搜索框输入"bge-m3",找到对应模型;

- 复制模型下载命令"

ollama pull bge-m3"; - 打开PowerShell(Win+R输入powershell),粘贴命令并回车,等待模型下载完成(下载速度取决于网络,耐心等待即可)。

操作截图参考:

至此,本地模型运行环境搭建完成,接下来搭建AI知识库管理工具。

第二部分:搭建AI知识库管理工具

知识库管理工具是连接文档和本地模型的"桥梁",负责将上传的文档解析、分割、转化为向量,再对接Ollama的模型,实现"提问-检索文档-生成答案"的完整流程。目前可选工具较多,比如Anything LLM、Cherry Studio等,其中Anything LLM操作简单、隐私性强(本地存储,无需账号)、功能全面,本次选用Anything LLM。

步骤1:下载并安装Anything LLM

访问Anything LLM官网下载,官网地址:Anything LLM(桌面版),支持Windows、macOS、Linux全系统,下载对应系统版本后,双击安装包,按照提示完成安装即可。

安装过程截图参考:

步骤2:配置Anything LLM

安装完成后,打开Anything LLM,需要进行一系列配置,确保其能对接我们之前部署的Ollama模型,步骤如下:

-

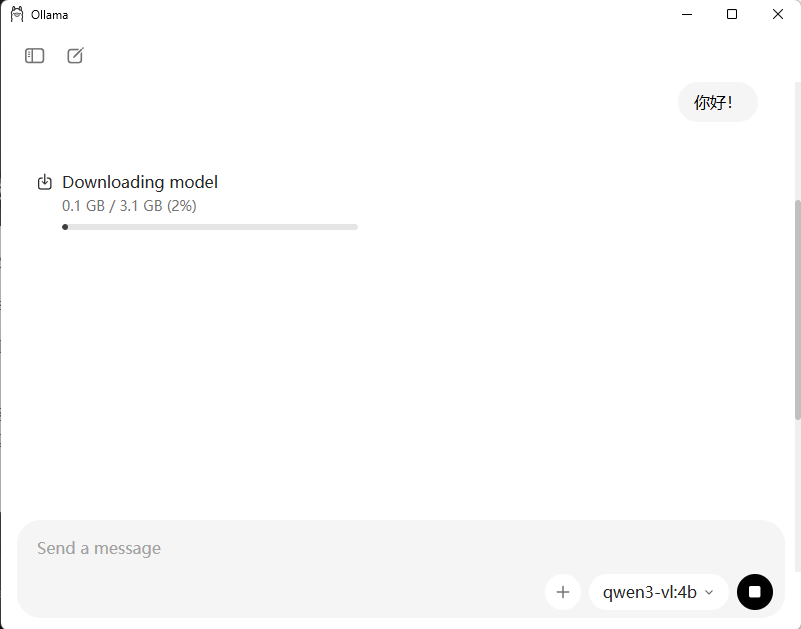

选择LLM提供商(对接Ollama)

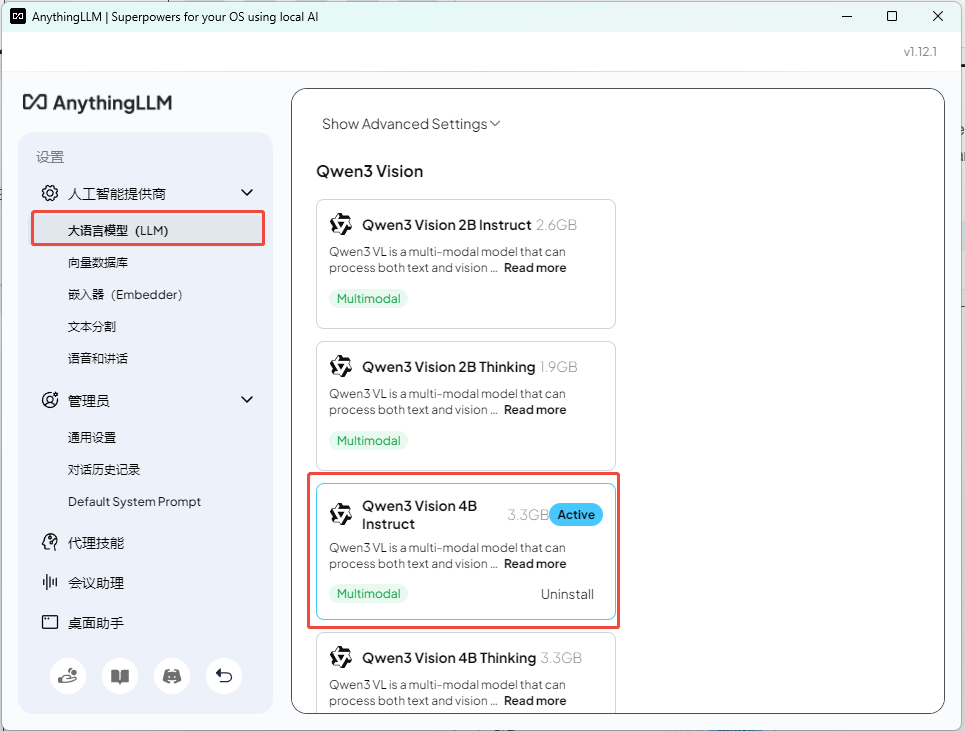

首次打开软件,会自动匹配你当前硬件与大模型最佳的型号,此时Anything LLM也会自动下载。这是我没想到的,我重在Ollama选择了qwen3-vl:4b模型。

操作截图参考:

-

选择大语言模型

在设置选项中选择大语言模型,他已经自动选择了第一次启动时匹配的模型;嵌入器选项选择Ollama和大模型

操作截图参考:

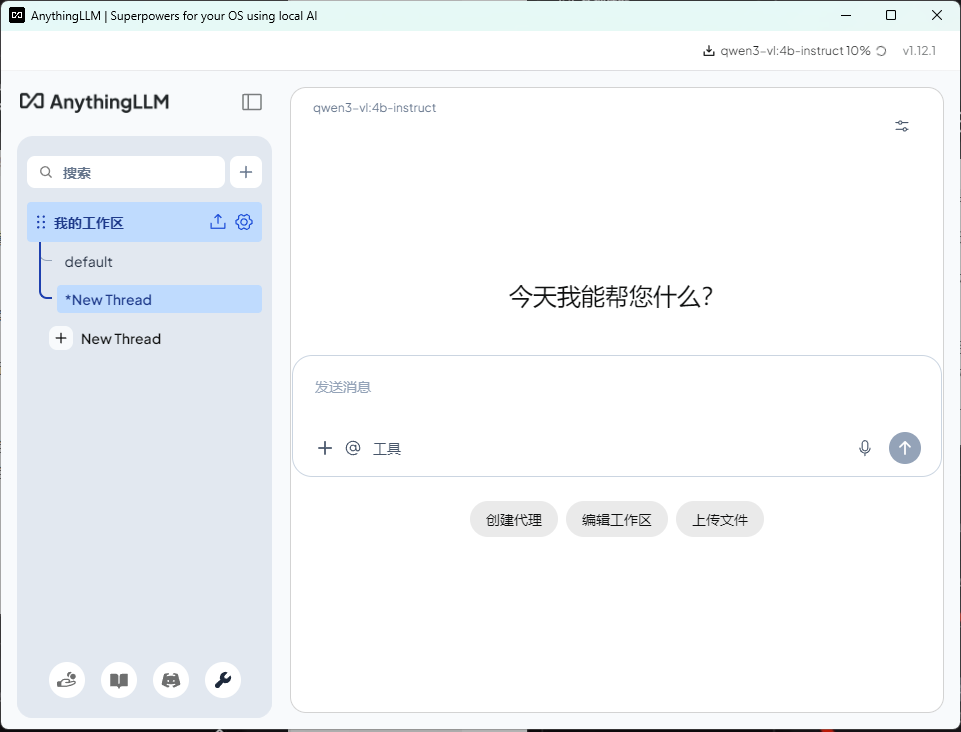

-

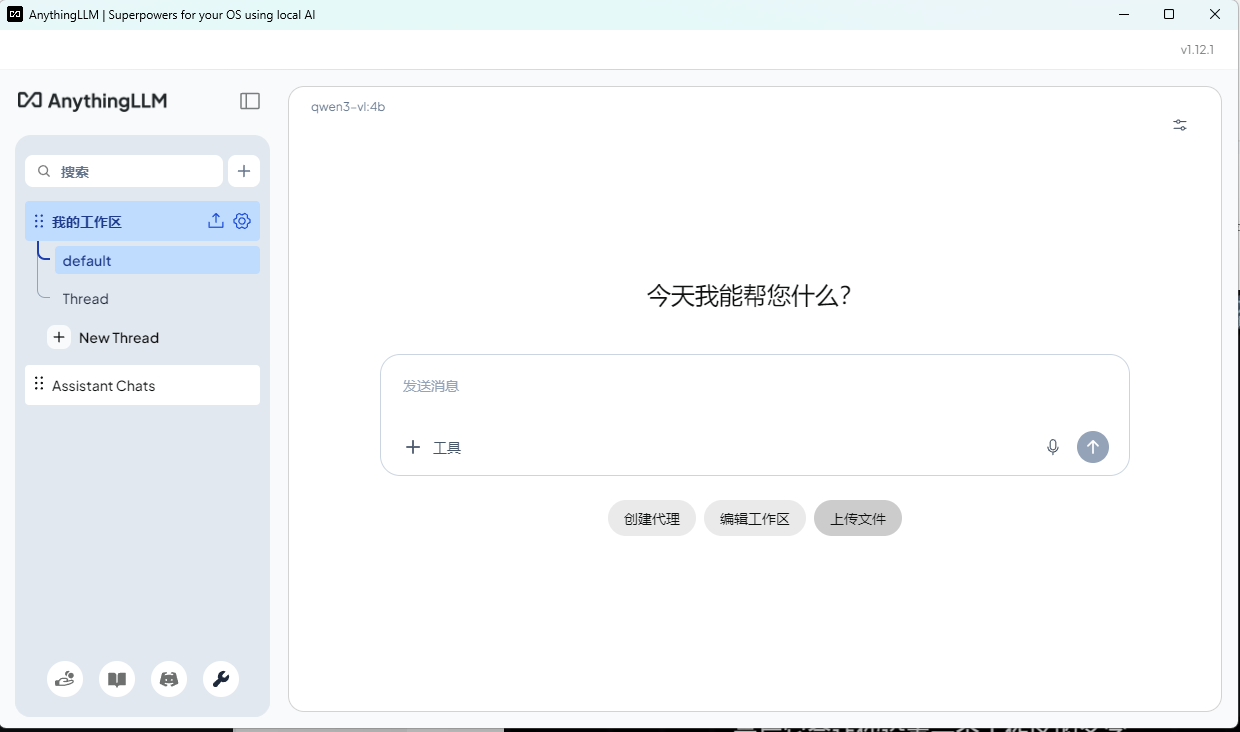

创建工作区(知识库)

配置完模型后,需要创建一个工作区,工作区相当于一个独立的知识库,用于存储上传的文档、对话记录等。按照提示输入工作区名称。

操作截图参考:

-

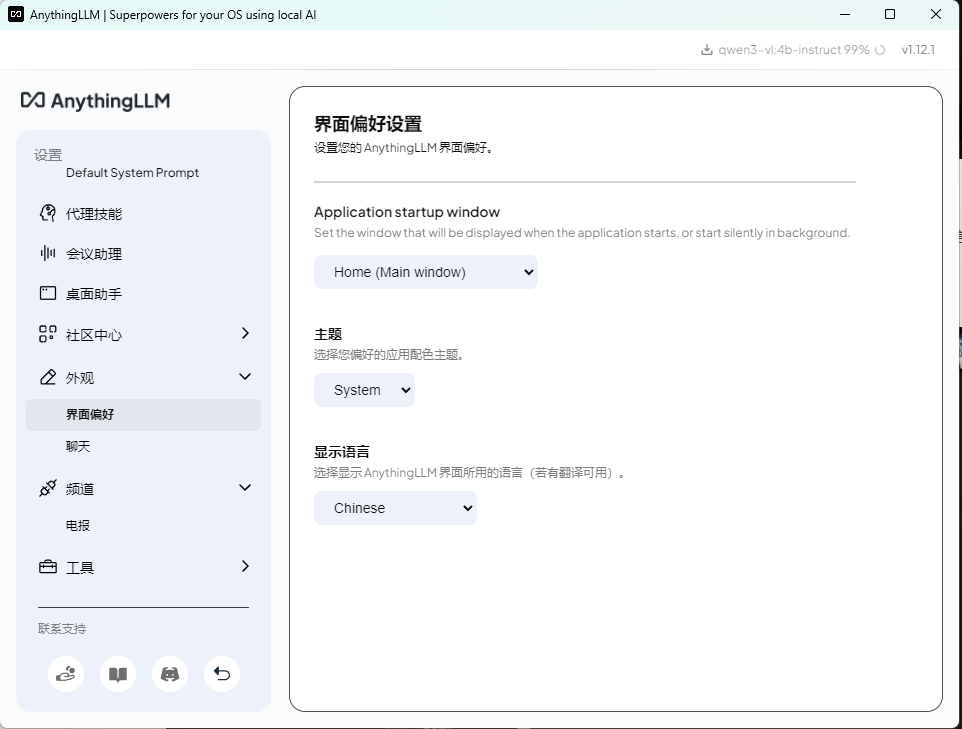

配置显示语言(可选,更易操作)

Anything LLM默认显示为英文,若不习惯英文界面,可修改为中文:点击软件左下角的"设置"按钮,找到"显示语言"(Display Language),从下拉列表中选择"Chinese",保存后界面会自动切换为中文,操作更便捷。

操作截图参考:

-

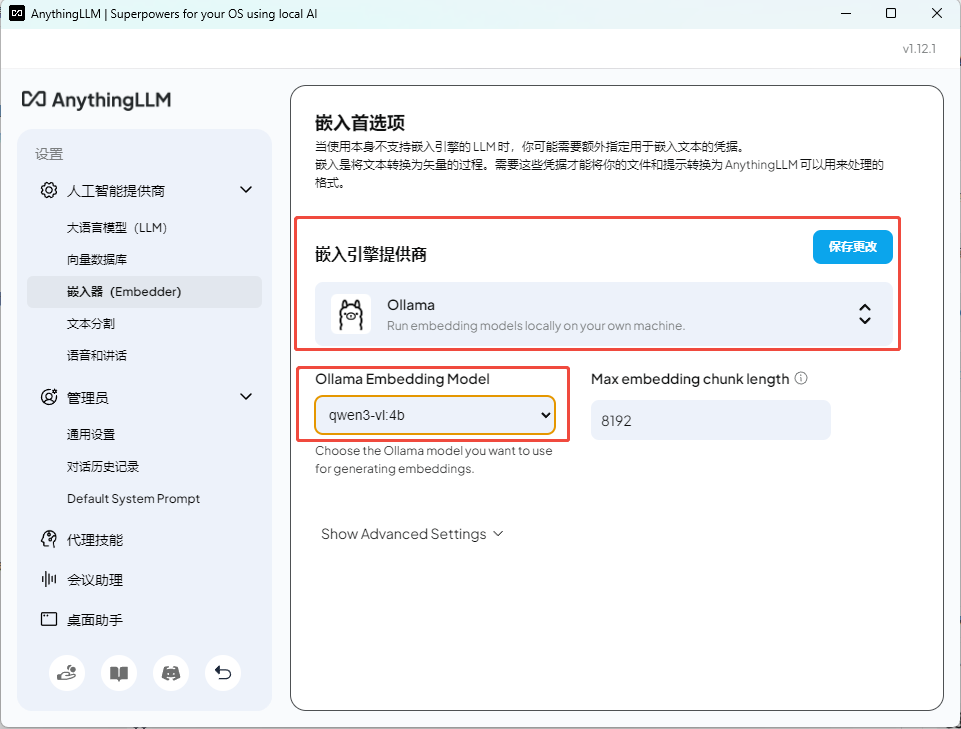

配置嵌入模型(关键,对接bge-m3)

在设置界面,切换到"嵌入器(Embedder)"选项卡,引擎提供商选择"Ollama",模型列表中选择我们之前下载的"bge-m3"模型,点击右上角的"保存"按钮,完成嵌入模型配置(嵌入模型负责文档向量转换,必须配置正确)。

步骤3:上传文档,搭建专属知识库

配置完成后,即可上传自己的文档(如电子书、PDF、Word等),搭建专属知识库,步骤如下:

-

新建聊天窗口:点击软件左侧的"New Thread",创建一个新的对话窗口;

-

上传文档:在输入框上方会提示"先上传文档",点击上传按钮,选择需要上传的文档(支持多种格式,如PDF、TXT、Word等);

-

文档导入知识库:选中上传完成的文档,点击下方的"移动到工作区",将文档添加到我们创建的知识库中;

-

文档解析与嵌入:点击"保存和嵌入",软件会自动拆分文档、将文档转化为数字向量,并存储到本地数据库中(解析时间取决于文档大小和数量,耐心等待即可)。

步骤4:对话查询,使用知识库

文档嵌入完成后,即可在对话窗口中,询问与文档相关的任何问题,AI会检索文档内容,生成精准的答案,无需联网,全程本地运行,保护隐私。

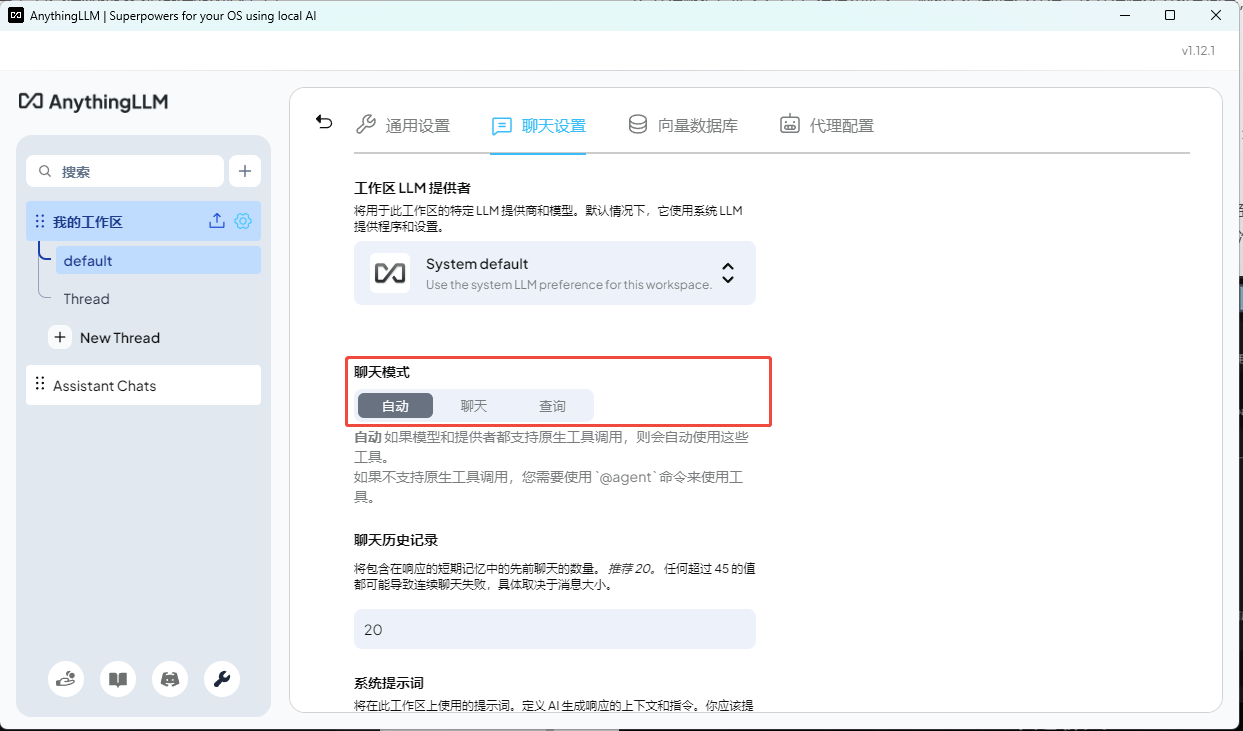

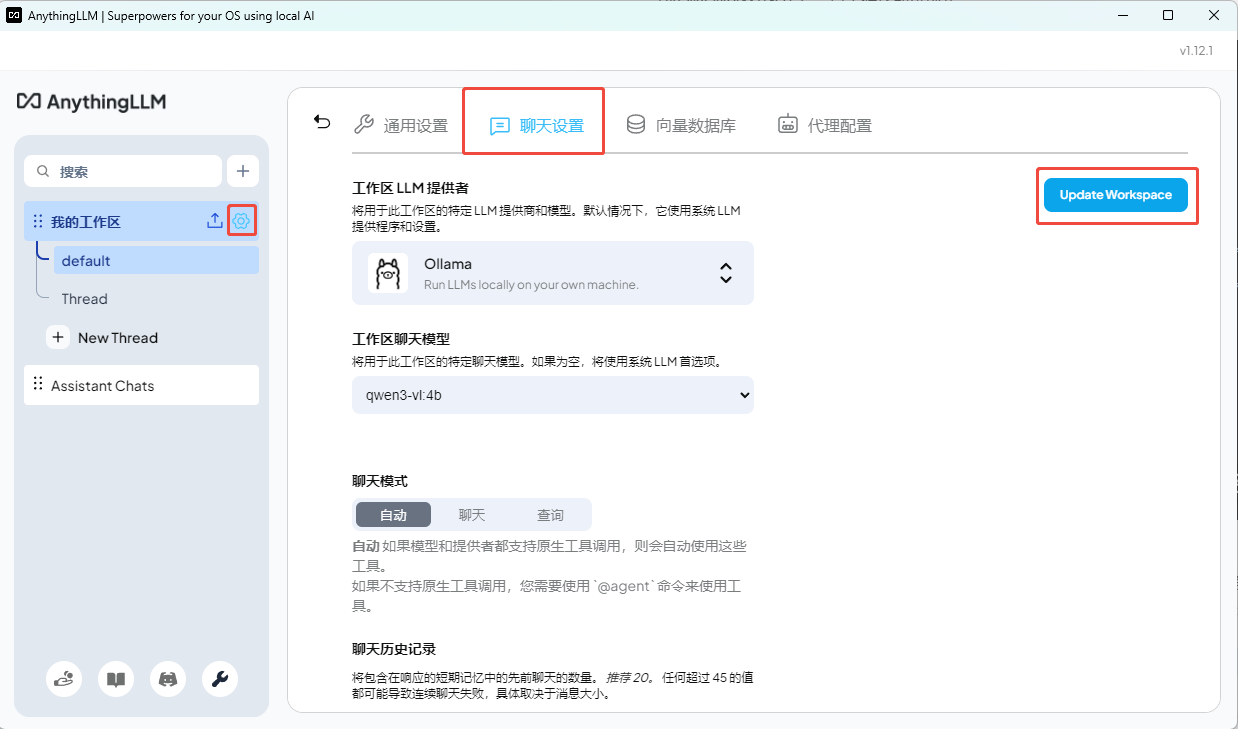

关键设置:优化检索准确率

为了提升文档检索的准确率,建议修改聊天模式:点击知识库名称右侧的"设置"按钮,找到"聊天设置",将"聊天模式"切换为"查询"模式(默认是"聊天"模式)。查询模式会仅在找到文档相关上下文时生成答案,大幅提升检索的精准度,避免AI凭空生成内容。

操作截图参考: