DeepSeek V4 还是挺顶的。

100 万 token 上下文、思维链推理、价格打到骨折,模型本身的实力没得说。

你用网页版聊天,V4 的编程能力根本发挥不出来。

你不能让它直接改文件、跑命令、Git 管理,只能复制粘贴来回复制粘贴,效率很低。

没有类似 Claude Code 的体验。

所以有人用 Rust 从零写了一个终端原生的编程 Agent,专门对接 DeepSeek V4。

你可以理解为 DeepSeek 原生的终端 Coding Agent。

01、开源项目简介

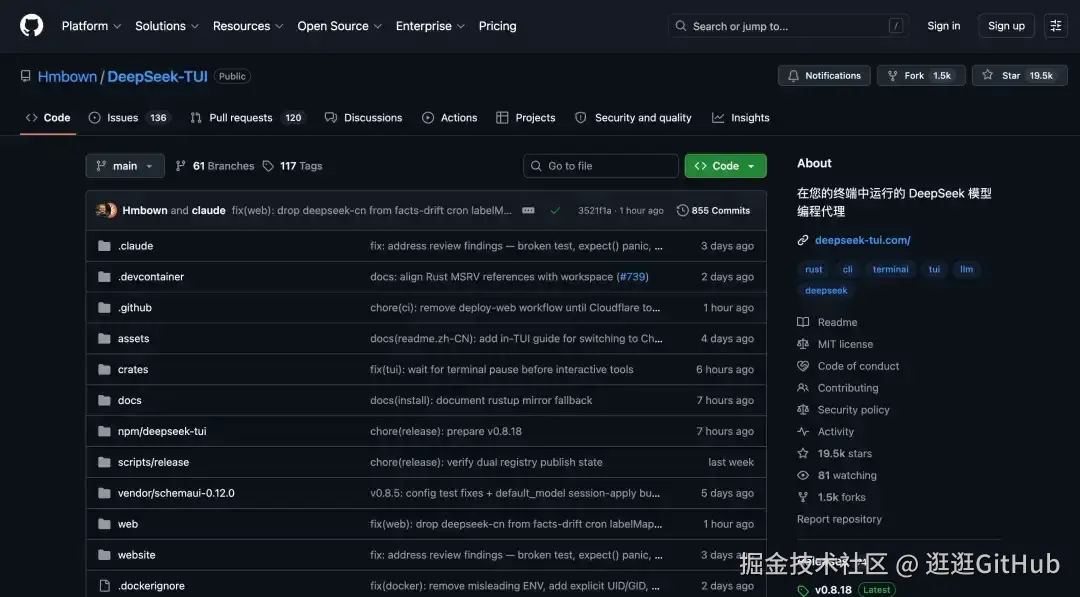

DeepSeek-TUI 是一个跑在终端里的 AI 编程 Agent,用 Rust 写的,专门对接 DeepSeek V4 模型。

说白了就是 DeepSeek 版的 Claude Code。

它能直接在你的终端里读写文件、执行 Shell 命令、搜索网页、管理 Git、甚至编排子 Agent 并行干活。

arduino

地址:https://github.com/Hmbown/DeepSeek-TUI100 万 token 上下文 + 思维链实时可见

DeepSeek V4 最大卖点就是 100 万 token 的上下文窗口,DeepSeek-TUI 直接吃满了这个能力。

更关键的是它支持 Thinking-mode 流式输出,模型的推理过程你是能实时看到的。

它在想什么、为什么这么改,一步步摆在面前,不是黑盒给你个结果就完了。

100 万 token 大概相当于 75 万字,换算成代码差不多能把一个中型项目的全部源码一次性塞进去。

你不需要手动挑选哪些文件喂给 AI,整个项目结构、模块间的调用关系、配置文件、依赖声明,它一次性全看到。

改一个函数的时候它知道这个改动会波及到哪些地方,而不是只盯着你贴进来的那几行代码瞎猜。

另外一个很实际的场景是长对话不会失忆。

用 128K 上下文的工具,聊个十几轮就开始遗忘前面的约定和决策,越到后面输出质量越差。

100 万 token 意味着你可以在一个会话里从需求讨论、架构设计一路干到写测试、修 bug,中间不用重新建立上下文,模型的判断力从第一轮到第五十轮基本是一致的。

而且上下文快满的时候会自动压缩,不会聊着聊着就失忆。

三种模式,干活风格随便切

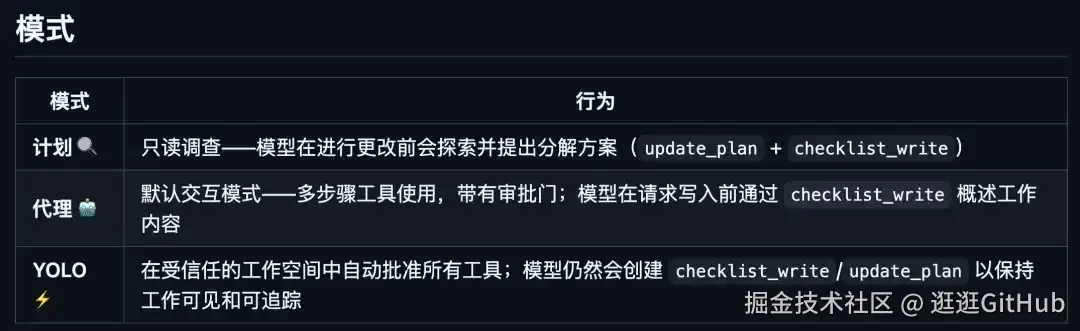

DeepSeek-TUI 有三种工作模式:

Plan 模式是只读的, AI 先帮你探索代码库、规划方案,不动任何文件。适合你还不确定要怎么改的时候先用它摸个底。

Agent 模式是交互式的, AI 会执行操作但每一步需要你审批。适合日常开发,既高效又安全。

YOLO 模式就是全自动, 所有操作直接执行不需要确认。适合你信任当前环境、想快速出活的时候用。

三种模式可以随时切,键盘一按就换。

完整的工具链 + MCP 协议

这个项目的工具链做得相当完整:文件读写、Shell 执行、Git 操作、网页搜索、补丁应用、子 Agent 编排,该有的都有。

而且原生支持 MCP 协议, 可以接各种外部工具服务扩展能力。

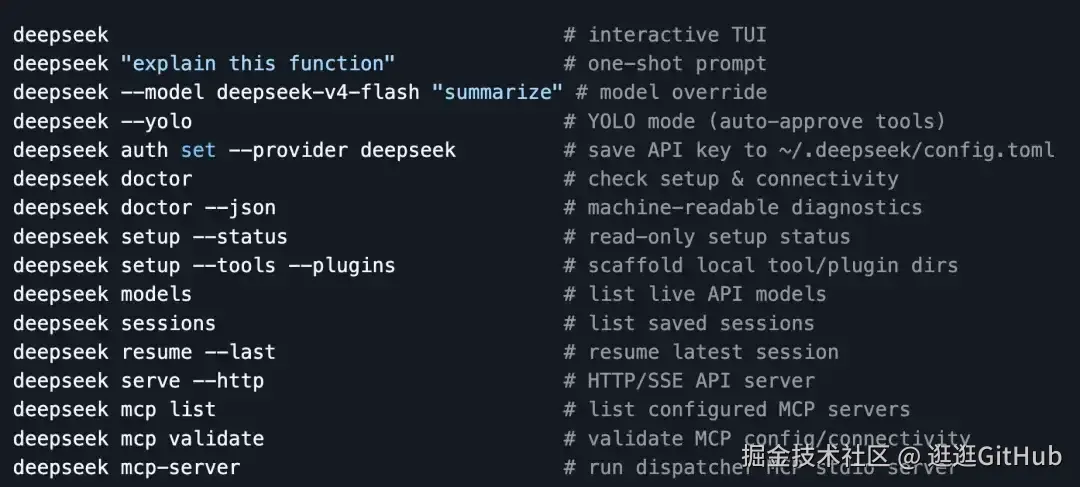

它还有一个 HTTP/SSE API 服务模式,跑个 deepseek serve --http 就能把它当无头 Agent 用,嵌入到你自己的工作流里。

费用也是实时追踪的,每轮对话花了多少 token、多少钱,界面上一目了然。

V4 Flash 的价格是输入 0.14/百万token,输出0.28/百万 token。对比一下 Claude Sonnet 输入 3/百万token、输出15/百万 token,输入差了二十多倍,输出直接差了五十多倍。

02、如何使用

安装很简单,一行命令:

css

npm i -g deepseek-tui如果你是 Rust 用户也可以用 Cargo 装:

css

cargo install deepseek-tui-cli --locked国内用户如果 npm 和 GitHub 下载慢,可以配清华 TUNA 镜像,README 里有详细步骤。

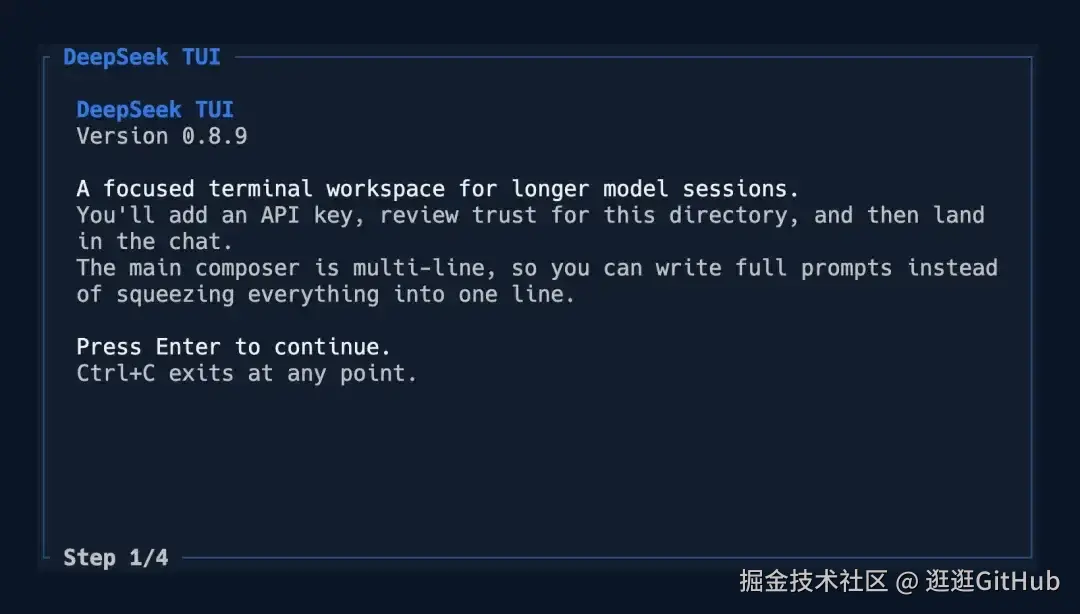

装好之后第一次启动会让你输入 DeepSeek API Key,去 platform.deepseek.com 申请一个就行。

然后直接在终端输入 deepseek 就能用了。

想切模式按 Tab,想调推理深度按 Shift+Tab,想看帮助按 F1。