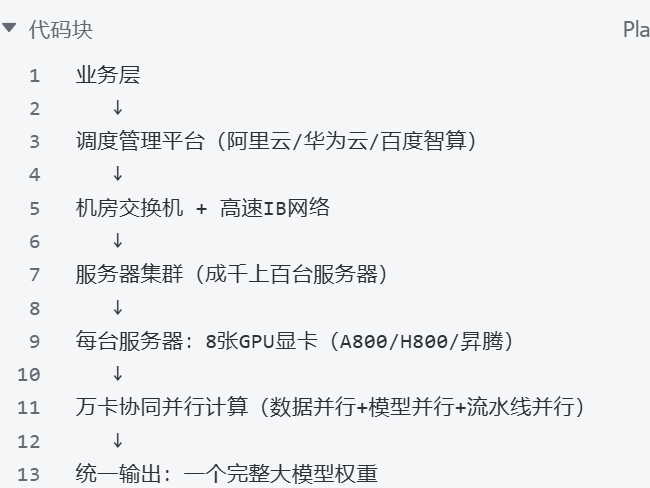

大模型万卡训练集群架构简图(文字版,一眼看懂)

从上到下完整链路:用户 / 企业 → 云端管理平台 → 机房服务器集群 → 多张 GPU 显卡 → 高速互联网络 → 三种并行调度 → 共同训练一个大模型

一、整体层级结构(从上到下)

二、每层详细解释

1. 业务层(你 / 公司)

-

自己没有显卡,只提交:训练数据、模型代码、训练任务

-

如果租算力:必须把训练数据上传到对方机房存储

-

如果自建机房:数据内网流转,不用外传

2. 调度管理平台

作用:

-

帮你分配空闲服务器、空闲 GPU

-

给任务排队、监控每张卡负载、报错重启

-

做权限隔离:你的卡别人用不了,物理隔离

3. 高速网络核心(最关键)

万卡能协同,全靠 InfiniBand(IB)高速网络

-

普通网线:传输慢,万卡根本同步不了

-

IB 网络:每秒几十 GB 速度,显卡之间实时传梯度、传特征

-

所有服务器、所有 GPU 全部连在同一个高速交换网络里

比喻: 普通网线是乡村小路 ; IB 高速网络是全国高铁网,上万 GPU 实时通话、同步计算。

4. 单台服务器内部结构

一台标准 AI 服务器:

-

主板 + 内存 + 硬盘

-

标配:8 张 GPU 显卡 插在同一台机器

-

每台服务器都是一个「计算节点」

几十台、几百台这样的服务器 → 凑成 几千 / 上万张 GPU

三、上万张卡怎么 "合起来训练一个模型"

三种并行同时工作,我用大白话结构图给你画:

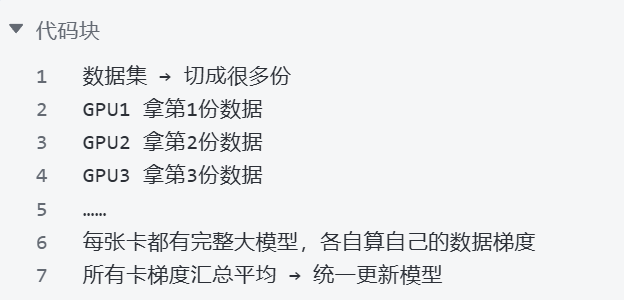

1. 数据并行(所有卡都有完整模型)

作用:数据太多,分给多卡同时跑,提速

2. 模型并行(模型太大,一张卡装不下)

数据依次流过每一张卡,接力计算 作用:模型参数太大,单卡显存装不下,拆开分到多卡

3. 流水线并行(不让显卡闲着)

把模型分成多个「工段」 源源不断送多批数据,像工厂流水线:

-

第一批数据在第 2 工段

-

第二批数据在第 1 工段 所有 GPU 一直忙,不空闲 把万卡利用率拉满

四、两种模式:自建 vs 租用 结构图对比

模式 1:大厂自建(百度 / 阿里 / 华为 / 字节)

自己数据 → 自己机房 → 自己服务器+自己GPU → 自己高速网络 → 训练大模型

特点:

-

数据不上外网、不外泄

-

显卡全是自己的,一次性重金投入

模式 2:中小公司租用算力

你的电脑 → 上传数据到算力商云端存储 → 算力商机房(别人的服务器+别人的万卡) → 帮你跑完训练 → 只把模型权重发回给你

特点:

-

显卡不是你的,是租的

-

技术上必须上传数据进对方服务器才能跑

-

正规平台:加密、隔离、用完自动删数据

五、总结

-

不是每家公司都有自己显卡,大厂自建万卡集群,小公司全靠租;

-

租算力必须上传数据到对方服务器,不然显卡拿不到数据没法计算;

-

上万张卡能一起训练,靠高速 IB 网络 + 数据并行 + 模型并行 + 流水线并行,把数据和模型拆开分工算。