grafana()的安装

查询、可视化和理解数据,并获取数据警报,无论数据存储在何处。在 Grafana,您可以通过美观、灵活的数据面板创建、探索和共享所有数据。

1. 网络下载安装

shell

[itwise@node2 ]$ cd /opt/software/ #进入下载目录

#下载wegt安装命令

[itwise@node2 software]$ sudo yum -y install wget

# 下载安装包

[itwise@node2 software]$ wget https://dl.grafana.com/oss/release/grafana-7.4.3-1.x86_64.rpm2.使用 rpm 安装 Grafana

shell

ps:需要依赖包

[itwise@node2 software]$ sudo rpm -ivh grafana-7.4.3-1.x86_64.rpm

警告:grafana-7.4.3-1.x86_64.rpm: 头V4 RSA/SHA256 Signature, 密钥 ID 24098cb6: NOKEY

错误:依赖检测失败:

fontconfig 被 grafana-7.4.3-1.x86_64 需要

urw-fonts 被 grafana-7.4.3-1.x86_64 需要

#安装插件

[itwise@node2 software]$ sudo yum -y install fontconfig

[itwise@node2 software]$ sudo yum -y install urw-fonts

#安装

[itwise@node2 software]$ sudo rpm -ivh grafana-7.4.3-1.x86_64.rpm3.启动 Grafana

shell

[itwise@node2 software]$ sudo systemctl start grafana-server4.访问 Grafana 页面

访问地址为:http://node2:3000/

首次登录用户名和密码均为 admin

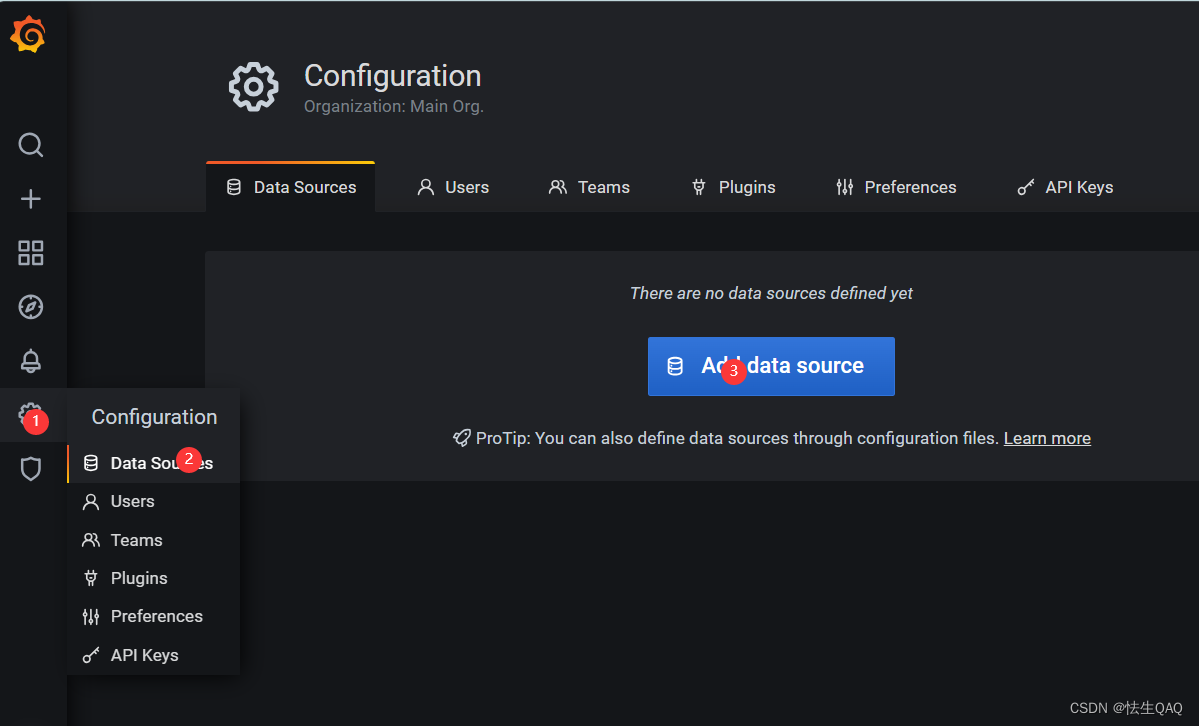

5.集成Zabbix

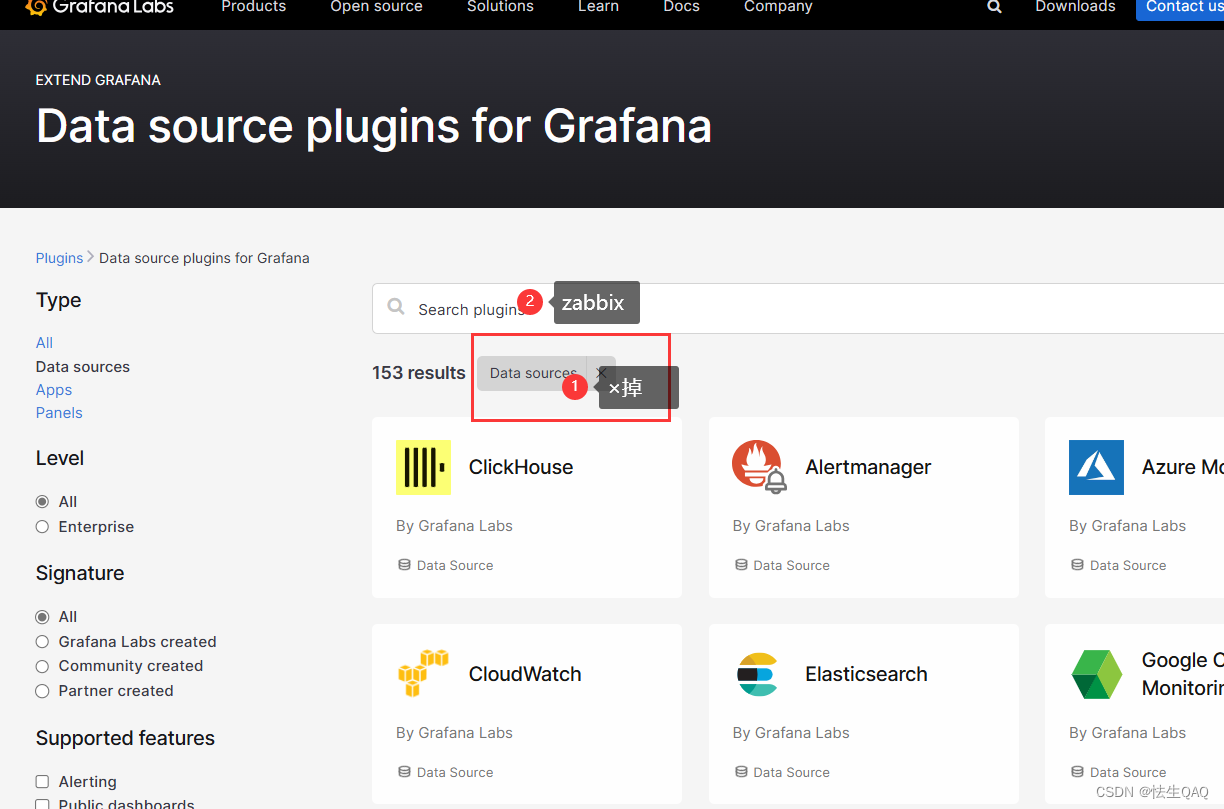

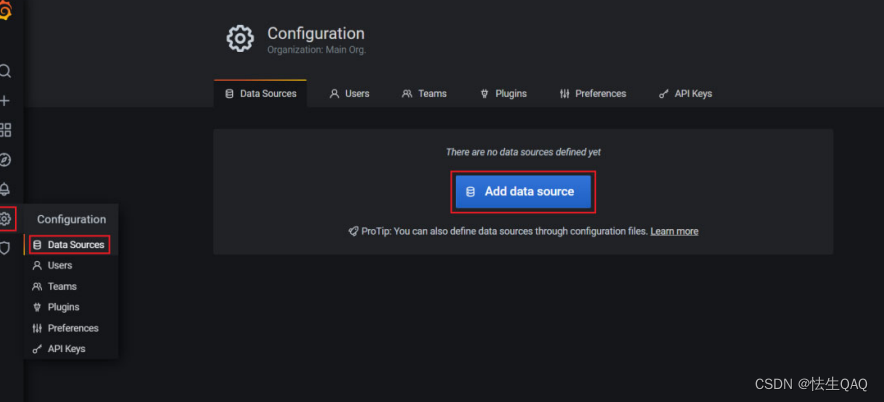

5.1配置数据源使用 Grafana 与其他系统集成时,需要配置对应的 DataSource

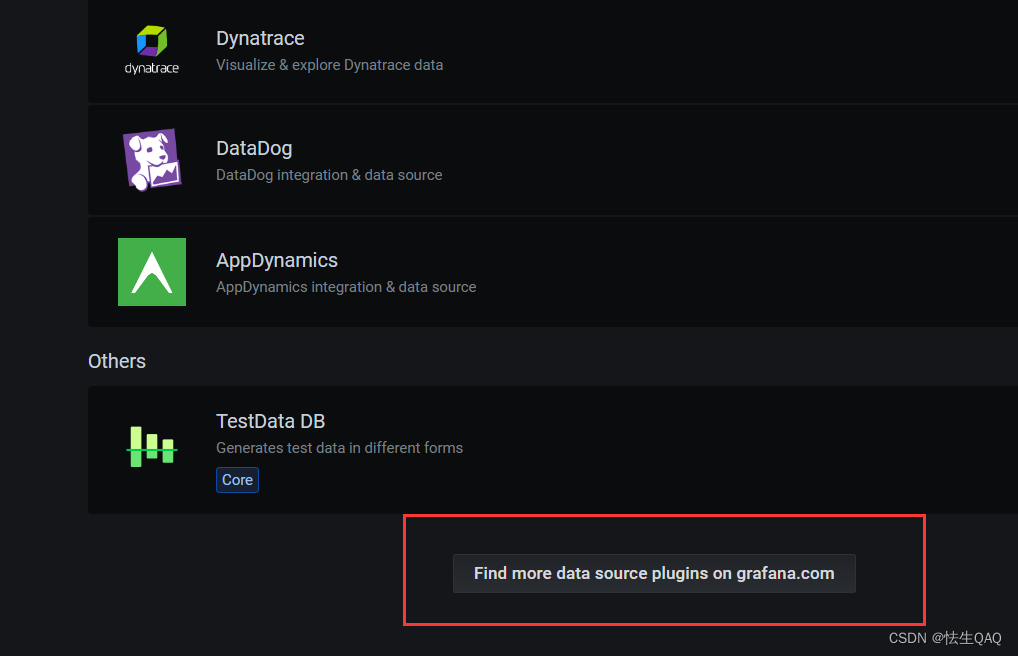

下拉底部

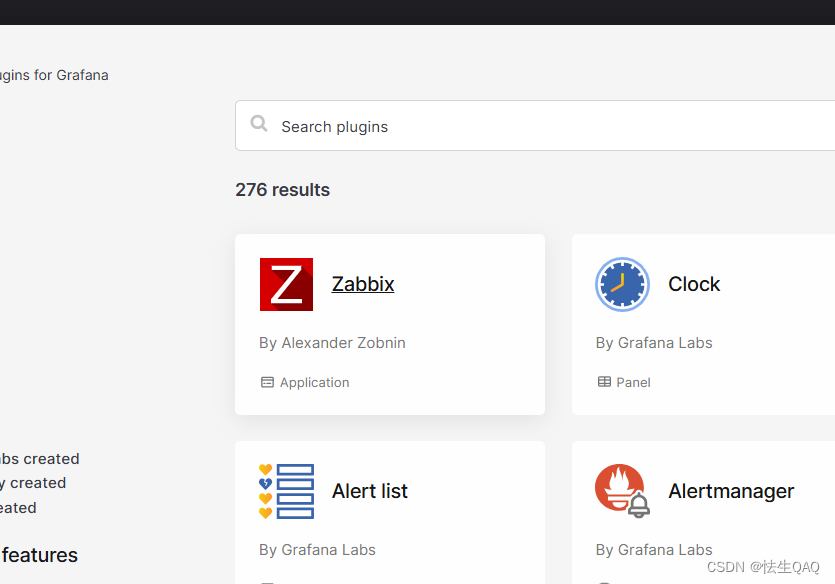

转跳后界面

外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传

shell

wget https://github.com/alexanderzobnin/grafana-zabbix/releases/download/v4.1.4/alexanderzobnin-zabbix-app-4.1.4.zip

[itwise@node2 software]$ sudo yum -y install unzip

unzip alexanderzobnin-zabbix-app-4.1.4.zip -d /var/lib/grafana/plugins/

[itwise@node2 software]$ sudo systemctl restart grafana-servergrafana无法正常下载zabbix时直接采取去官网下载的方法,把插件的压缩包下载下来然后解压到grafana这样就可以再grafana中找到zabbix插件,注意版本的匹配

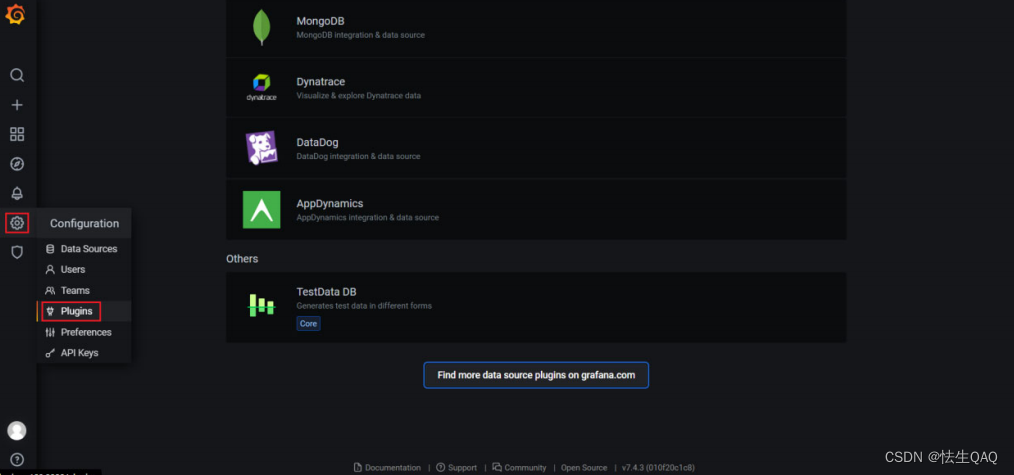

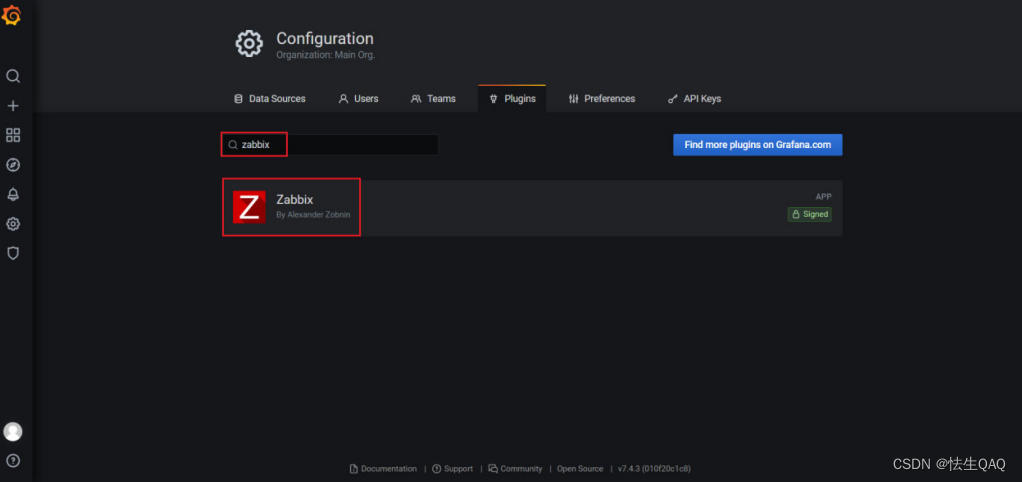

3)启用插件

(1)点击设置/插件

(2)搜索 zabbix,并点击搜索结果

(3)启用 Zabbix 插件

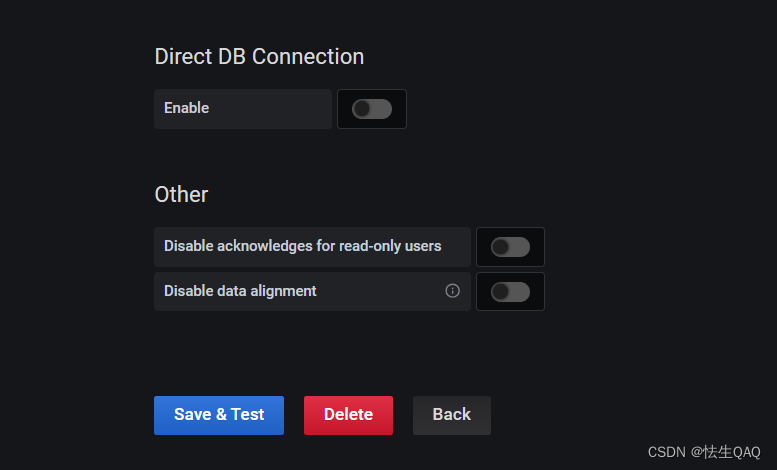

7.配置 zabbix 数据源

1)新增数据源

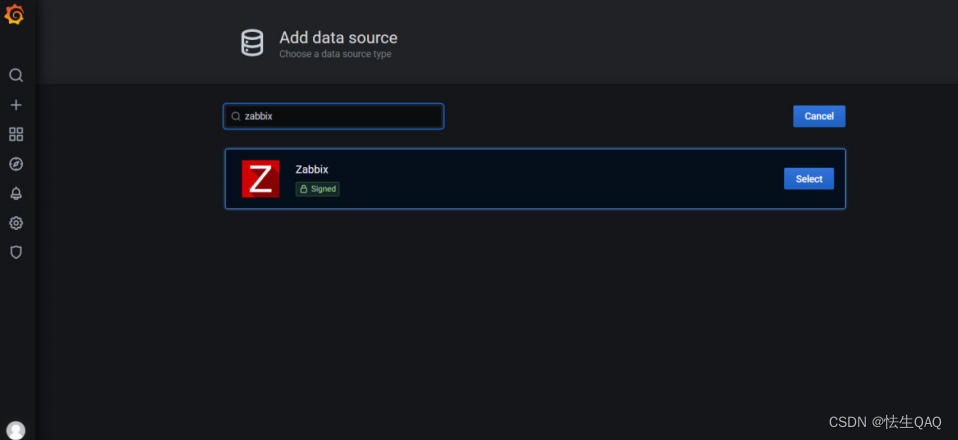

2)搜索 zabbix,并点击搜索结果

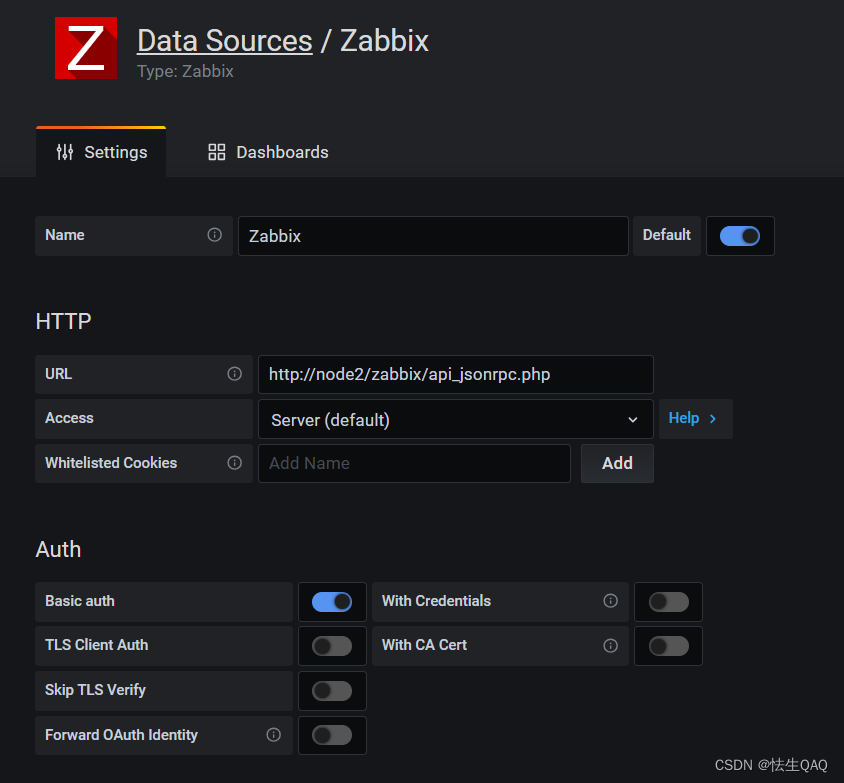

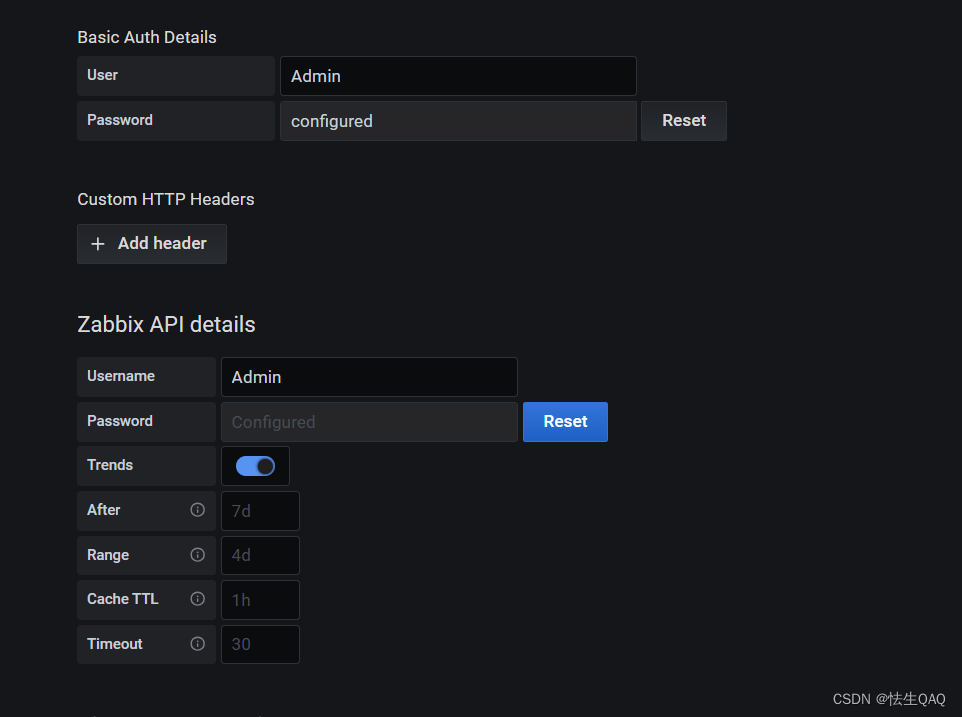

3)配置数据源

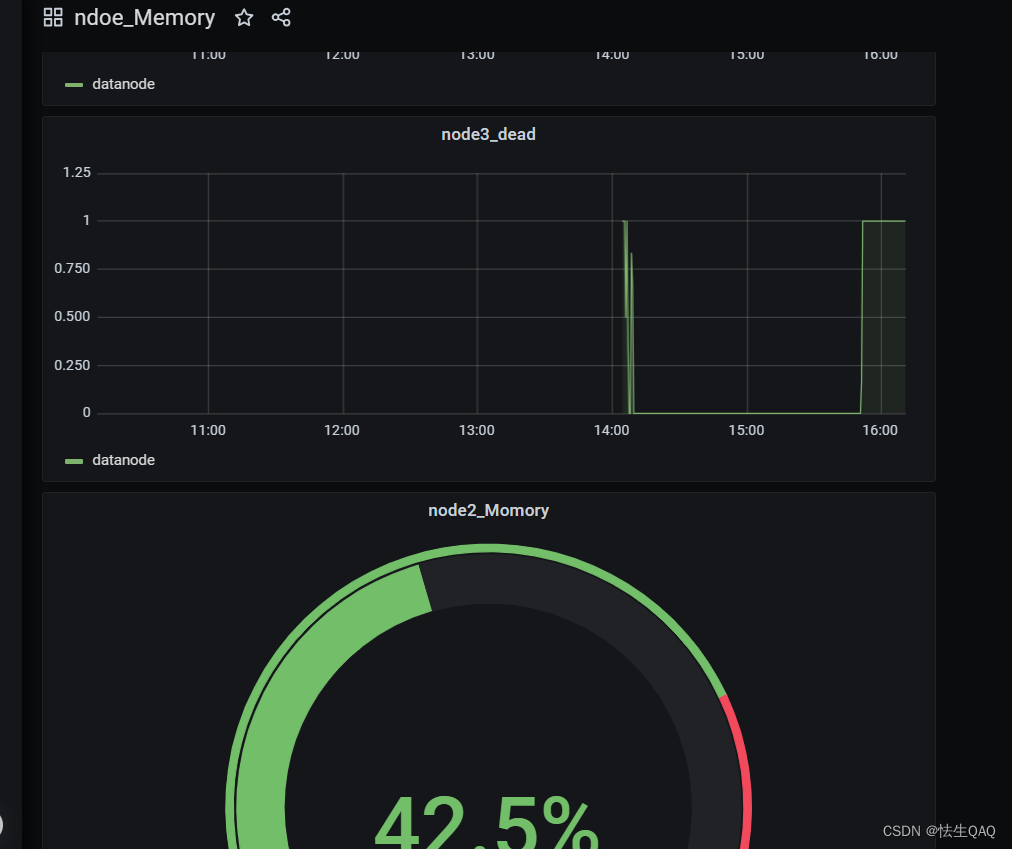

4.3.2 集成案例

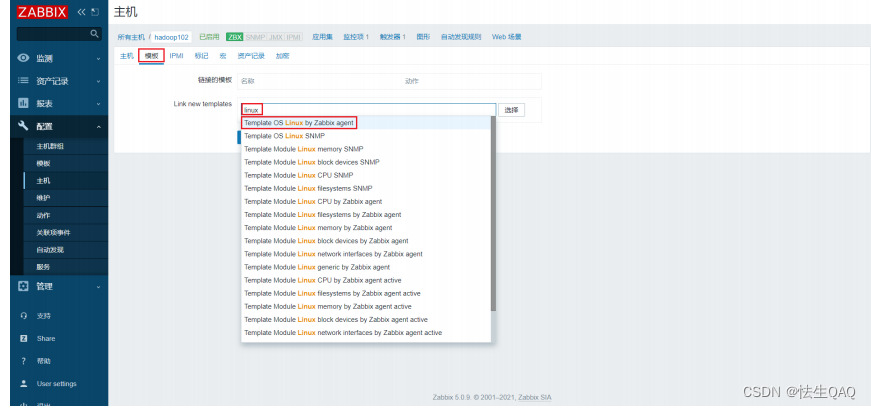

1.为方便展示效果,在 Zabbix 中为 node2 主机应用一个 Zabbix 内置的 Linux 系统监控模板。

1)找到 node2 主机

点击模板,搜索 linux,并选择 Template OS Linux by Zabbix agent

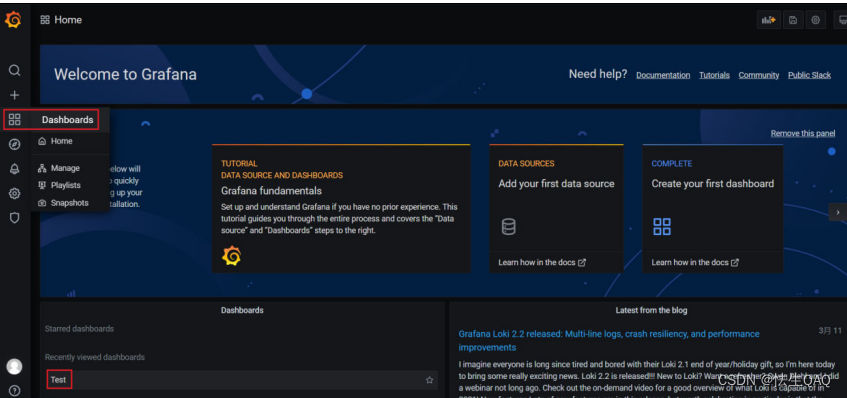

2.集成 Grafana,展示模板中的系统监控项

1)点击 Dashboards,找到前边创建的 Test 看板

2)新建 panel(如上)

Dashboards,找到前边创建的 Test 看板

2)新建 pan