人眼激发了相机机制的发展,该机制改善了机器人对周围世界的观察和反应方式。

该摄像头系统由马里兰大学(UMD)计算机科学家领导的团队开发,模仿人眼用于保持清晰稳定的视力的不自主运动。

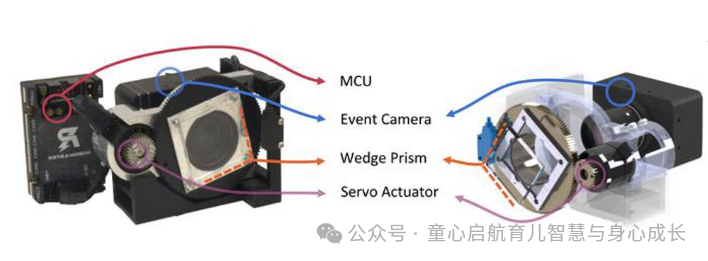

该团队对相机的原型设计和测试称为人工微扫视增强事件相机(AMI-EV),详见Science Robotics。

"事件相机是一种相对较新的技术,比传统相机更能跟踪移动物体,但今天的事件相机在涉及大量运动时很难捕捉到清晰,无模糊的图像,"该论文的主要作者,计算机科学博士生Botao He说。"这是一个大问题,因为机器人和许多其他技术(例如自动驾驶汽车)依赖于准确和及时的图像来对不断变化的环境做出正确反应。因此,我们问自己:人类和动物如何确保他们的视觉始终集中在移动的物体上?

答案是微眼跳,这是一种小而快速的眼球运动,当一个人试图聚焦他们的视线时,会不由自主地发生。通过这些微小而连续的运动,人眼可以随着时间的推移准确地将焦点集中在物体及其视觉纹理上,例如颜色、深度和阴影。

UMD 计算机科学家 Botao He、Yiannis Aloimonos、Cornelia Fermuller、Jinxi Chen 和 Chahat Deep Singh 开发的新型相机系统图

根据UMD的说法,该团队通过在AMI-EV内部插入旋转棱镜来重定向镜头捕获的光束,从而复制了微扫视。棱镜的连续旋转运动模拟了人眼内自然发生的运动,使相机能够像人类一样稳定记录物体的纹理。然后,该团队开发了软件来补偿AMI-EV内棱镜的运动,以整合来自移动灯光的稳定图像。

"我们的眼睛拍摄我们周围的世界的照片,这些照片被发送到我们的大脑,在那里对图像进行分析。感知是通过这个过程发生的,这就是我们理解世界的方式,"该研究的合著者、马里兰大学高级计算机研究所(UMIACS)计算机视觉实验室主任Yiannis Aloimonos教授说。"当你使用机器人时,用相机代替眼睛,用计算机代替大脑。更好的相机意味着机器人有更好的感知和反应。

在早期测试中,AMI-EV能够在各种情况下准确捕捉和显示运动,包括人体脉搏检测和快速移动的形状识别。

研究人员还发现,AMI-EV可以以每秒数万帧的速度捕捉运动,优于大多数典型的商用相机,后者平均每秒捕获30至1000帧。

该团队认为,这种更流畅、更逼真的运动描述可能在各种应用中发挥关键作用,从创建更身临其境的增强现实体验和更好的安全监控到改善天文学家在太空中捕捉图像的方式。