小罗碎碎念

本期推文主题:人工智能在病理组学领域的最新进展

这一期推文和往期不太一样------往期几乎都是顶刊,而这一期选了一些分数不那么高的文章。这样做有两个原因:

- 验证一下在IF较低的期刊中能否找到灵感

- 对比一下,期刊之间的差距在哪,什么量级的数据,什么样的方案/模型才能发顶刊

重点关注与病理AI相关的两篇我认为还不错的文章:

- 第四篇:这篇文献发表于

《Am J Cancer Res》,目前IF=3.6,三区,与淋巴结转移相关。推荐的原因在于文章的某些观点与我类似------使用在未标记数据上训练的医学基础模型来自动提取图像特征,并整合多模态数据以提高模型的准确性和鲁棒性; - 第五篇:这篇文献发表于

《Med Image Anal》,目前IF=10.7,一区,与免疫组化相关,且涉及到跨域匹配;文章由上海交大出品,提出的模型是可以进行HE和IHC图像预处理的基础模型,我还没有来得及测试效果,感兴趣的可以先试试,链接已附在对应位置。

一、CT图像特征与直方图参数在ⅠA期肺腺癌微乳头状或实体成分预测中的应用

一作&通讯

| 角色 | 姓名 | 单位名称(中文) |

|---|---|---|

| 第一作者 | Qin Chen | 莆田市第一医院放射科 |

| 通讯作者 | Jiajun Lin | 莆田市第一医院放射科 |

文献概述

这篇文章是关于使用计算机断层扫描(CT)图像特征和直方图参数来预测ⅠA期肺腺癌(LUAC)中微乳头状或实体(MIP/SOL)成分的研究。

研究目的是构建基于CT表现、直方图和形态特征的预测模型,并评估这些模型的性能。

方法:

- 回顾性临床研究,包括376名基于术后病理诊断为ⅠA期LUAC的患者,这些患者于2019年1月至2023年6月期间在莆田市第一医院接受治疗。

- 根据术后病理中MIP/SOL成分的存在与否,患者被分为MIP/SOL+和MIP/SOL-两组。

- 包括肿瘤直径≤3cm和≤2cm的病例,并分别进行分析。

- 使用7:3的比例将患者随机分为训练集和测试集。

- 训练集用于构建预测模型,测试集用于内部验证。

结果:

- 对于直径≤3cm的肿瘤,磨玻璃影(GGO)、熵、平均CT值和峰度是ⅠA期LUAC MIP/SOL成分的独立预测因子。

- 预测模型的ROC曲线下面积(AUC)在训练集为0.816,在测试集为0.789。

- 对于直径≤2cm的肿瘤,峰度不再是独立预测因子,预测模型的AUC在训练集为0.811,在测试集为0.833。

结论:

- 对于直径≤3cm和≤2cm的肿瘤,GGO、平均CT值和熵是预测ⅠA期LUAC MIP/SOL成分的相同独立影响因素。

- 诺模图预测模型具有潜在的诊断价值,可以用于识别早期LUAC的MIP/SOL成分。

重点关注

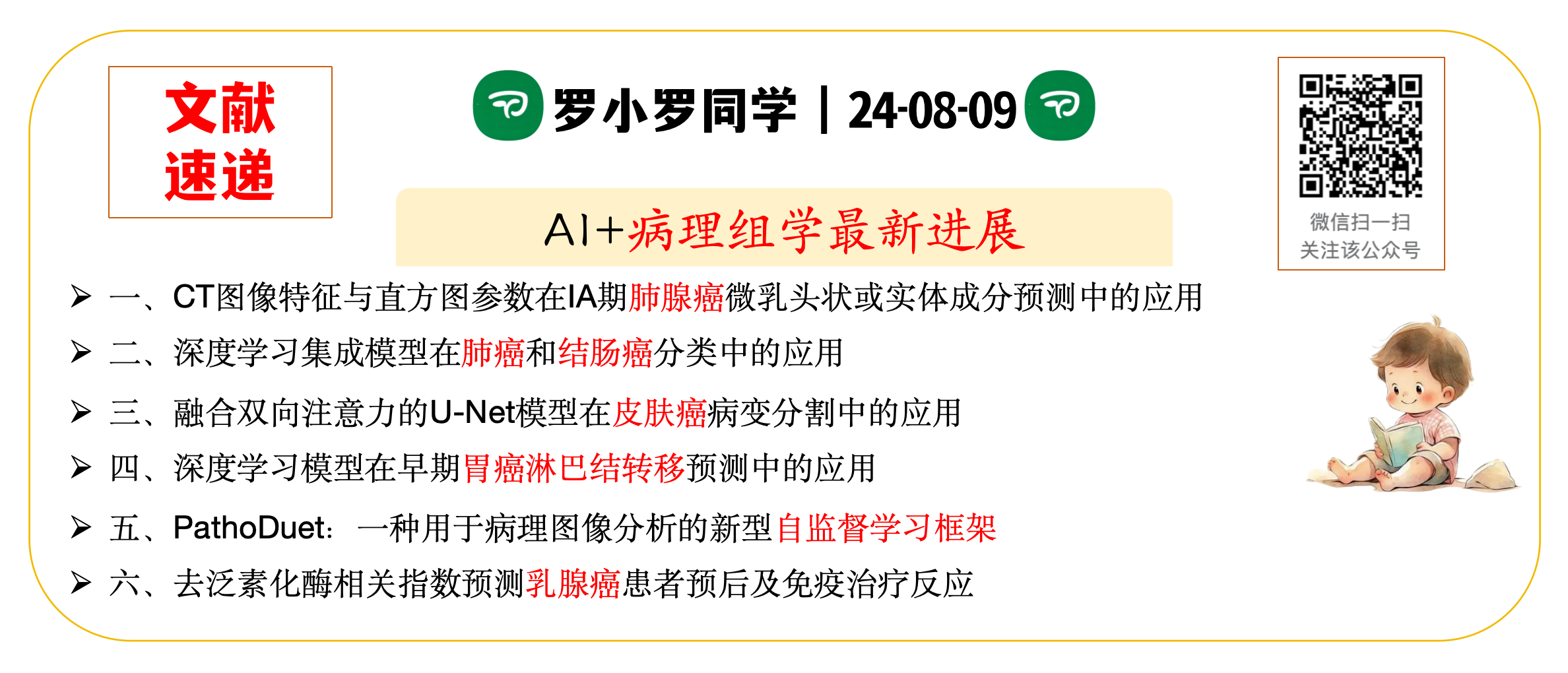

FIGURE 2 展示了两个不同病例的CT图像和病理学特征:

-

Case 1 (A, B):

- 患者:56岁男性

- 组别:MIP/SOL+组(存在微乳头状或实体成分)

- 肿瘤位置:右肺中叶

- 肿瘤特征:不规则实体结节,最大直径约18毫米,边缘呈分叶状和毛刺状,结节内有空泡征

- 病理诊断(HE × 10):浸润性肺腺癌,其中微乳头状占大约50%,腺泡型占大约50%

-

Case 2 (C, D):

- 患者:63岁男性

- 组别:MIP/SOL-组(不存在微乳头状或实体成分)

- 肿瘤位置:左肺上叶

- 肿瘤特征:混合磨玻璃结节,最大直径约15毫米,边缘呈分叶状,邻近胸膜凹陷

- 病理诊断(HE × 10):浸润性肺腺癌,其中大约40%为贴壁型结构,60%为腺泡型

从这些描述中可以分析得出,Case 1的肿瘤具有更典型的侵袭性特征 ,如不规则形状、分叶和毛刺边缘,以及空泡征,这些特征在CT图像上通常与肿瘤的侵袭性和恶性程度相关。而Case 2虽然也有分叶边缘,但肿瘤呈现为混合磨玻璃结节,这通常与较慢的肿瘤生长速度和较低的恶性程度相关。

病理结果也显示Case 1有一半是侵袭性较强的微乳头状成分,而Case 2则主要由贴壁型和腺泡型成分组成,这些成分的侵袭性相对较低。

二、深度学习集成模型在肺癌和结肠癌分类中的应用

一作&通讯

| 角色 | 姓名 | 单位(英文) | 单位(中文) |

|---|---|---|---|

| 第一作者 | K. Vanitha | Department of Computer Science and Engineering, Faculty of Engineering, Karpagam Academy of Higher Education (Deemed to Be University), Coimbatore, India | 印度哥印拜陀市Karpagam高等教育学院(被视为大学)工程学院计算机科学与工程系 |

| 通讯作者 | Suresh Guluwadi | Adama Science and Technology University, Adama 302120, Ethiopia | 埃塞俄比亚亚当玛科技大学 |

文献概述

这篇文章是关于一种深度学习集成方法的研究,该方法结合了可解释的人工智能技术,用于肺癌和结肠癌的分类。

研究使用了先进的超参数调整技术,通过结合Xception和MobileNet架构,旨在提高特征提取能力、增强模型的鲁棒性,并减少过拟合现象。

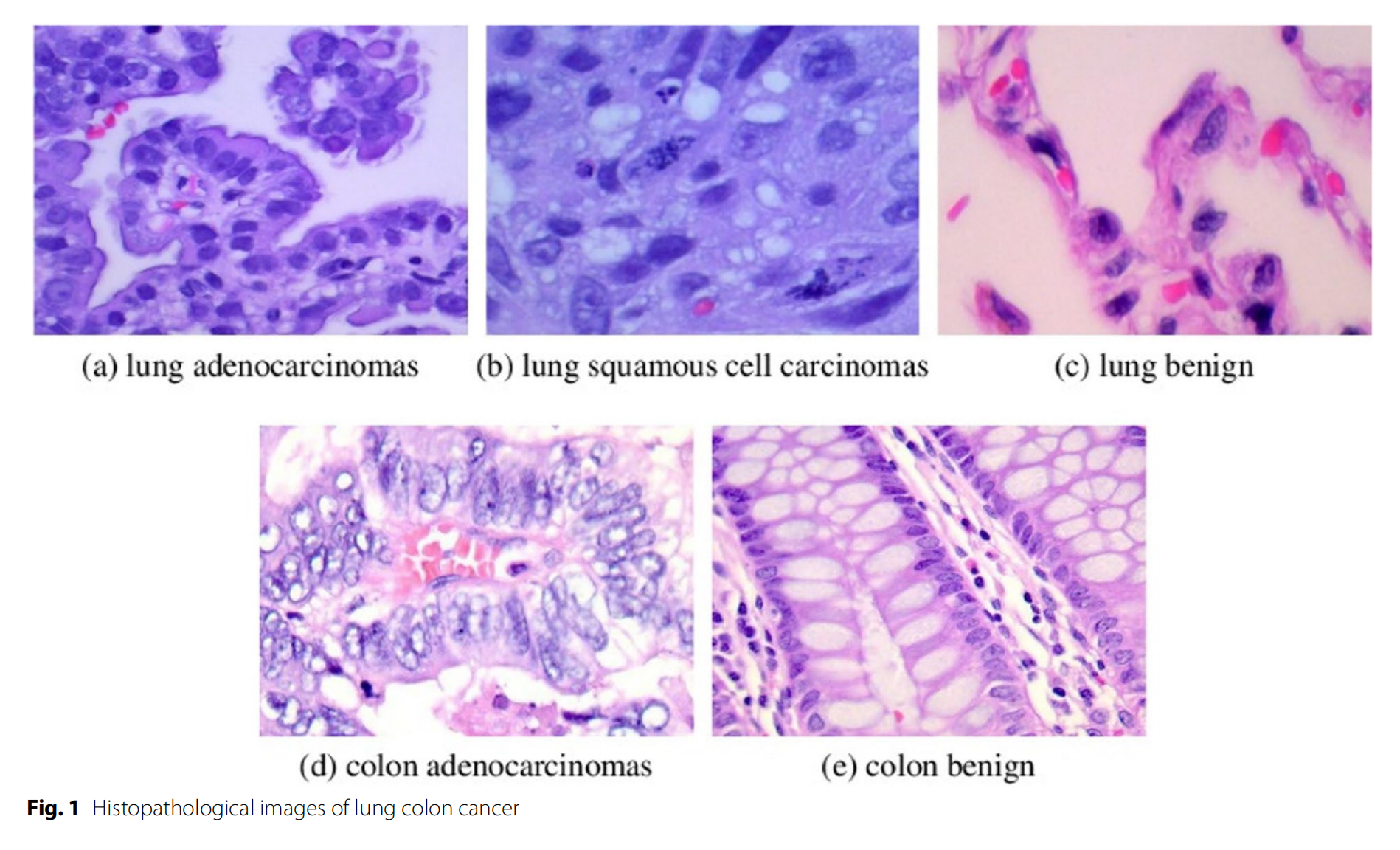

研究使用了包含25000张高质量、去标识化、符合HIPAA规定的组织病理学图像的数据集,这些图像被分为五个类别:结肠腺癌、良性结肠组织、肺腺癌、肺鳞状细胞癌和良性肺组织。

研究的主要贡献包括:

- 将Xception和MobileNet的输出进行连接,并输入到密集层,最终通过分类层区分癌组织和非癌组织,提高诊断准确性。

- 使用梯度加权类激活映射(Grad-CAM)生成热图,为模型的决策提供可视化解释,这对于临床接受度至关重要。

- 通过提供一个可扩展的解决方案,适用于各种癌症和复杂的医学成像任务,推动医学诊断的进步。

研究结果表明,该集成模型在分类准确性上取得了显著的成果,达到了99.44%的准确率,并且在识别某些癌组织和非癌组织方面具有完美的精确度和召回率。此外,通过Grad-CAM增强的可解释性,为临床医生提供了模型诊断推理过程的可视化,这对于临床接受度和实现更个性化、准确的治疗计划至关重要。

文章还讨论了相关工作,并对深度学习在癌症诊断中的应用进行了文献综述。最后,文章总结了研究结果,讨论了未来的研究方向,以及如何将这些技术扩展到其他类型的癌症诊断中。

重点关注

Fig. 1 展示了肺癌和结肠癌的组织病理学图像。

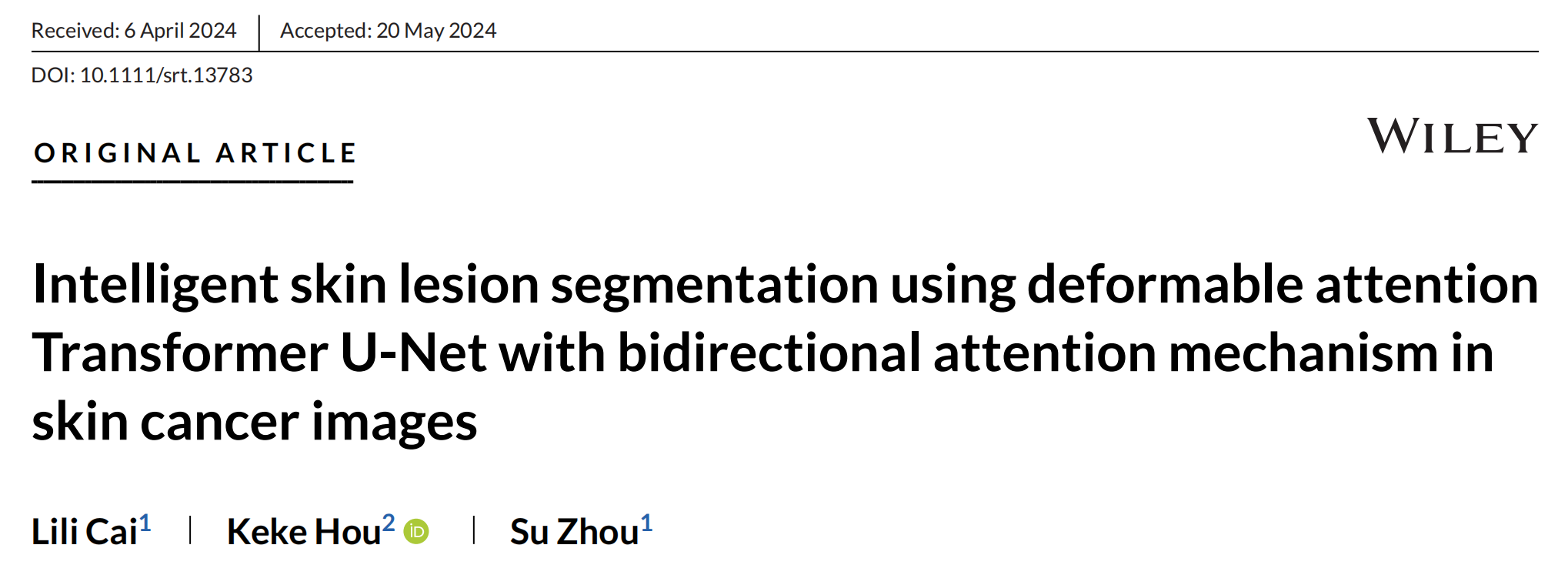

三、融合双向注意力的U-Net模型在皮肤癌病变分割中的应用

一作&通讯

| 角色 | 姓名 | 单位(英文) | 单位(中文) |

|---|---|---|---|

| 第一作者 | Lili Cai | School of Biomedical Engineering, Guangzhou Xinhua University, Guangzhou, China | 广州新华学院生物医学工程学院,广州,中国 |

| 通讯作者 | Keke Hou | School of Health Sciences, Guangzhou Xinhua University, Guangzhou, China | 广州新华学院健康科学学院,广州,中国 |

文献概述

这篇文章是关于一种新型的智能皮肤病变分割方法,该方法使用了变形注意力Transformer U-Net和双向注意力机制来提高皮肤癌图像中病变区域的分割精度。

- 背景:皮肤癌,尤其是恶性黑色素瘤的发病率上升,对公共卫生构成重大威胁。自动化的精确皮肤病变分割技术对减轻医疗专业人员的负担具有巨大潜力,并对早期识别和干预皮肤癌具有重要的临床意义。然而,由于皮肤病变的形状不规则、颜色不均匀和噪声干扰,精确分割面临挑战。

- 方法 :文章提出了一种基于Transformer U-Net的精确驱动分割模型,称为BiADATU-Net。该模型整合了变形注意力Transformer和双向注意力块到U-Net中。编码器部分使用变形注意力Transformer和双注意力块,以自适应方式学习全局和局部特征。解码器部分在跳跃连接层中加入了特定的scSE注意力模块,以捕获图像特定的上下文信息,实现强大的特征融合。此外,还结合了两种不同的注意力块中的变形卷积,以学习不规则病变特征,实现高精度预测。

- 结果:在四个皮肤癌图像数据集(ISIC2016, ISIC2017, ISIC2018和PH2)上进行了一系列实验。结果显示,所提出的模型展现出令人满意的分割性能,所有数据集的准确率都超过了96%。

- 结论:实验结果验证了BiADATU-Net与其他一些最先进方法相比具有竞争力的性能优势,并且在皮肤病变分割领域具有潜力和价值。

文章还讨论了传统图像分割方法、基于Transformer的方法和注意力机制在医学图像分割中的应用,并详细介绍了所提出的BiADATU-Net模型的结构和实验设置。

重点关注

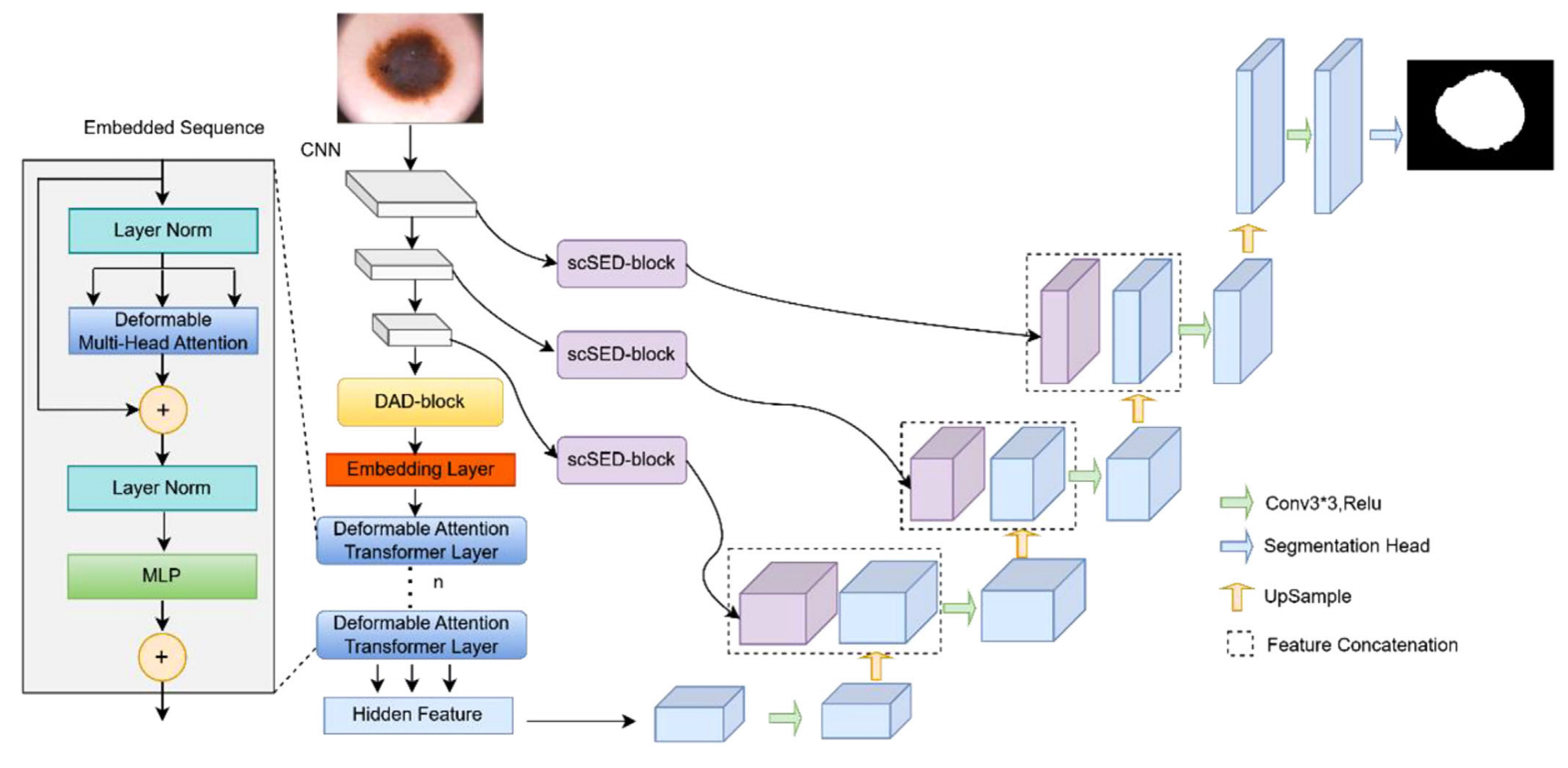

FIGURE 1 展示了 BiADATU-Net 的整体结构图

-

编码器部分(Encoder):

- 包含 CNN 块、DAD 块、嵌入层(Embedding Layer)和 DAT(Deformable Attention Transformer)层。

- CNN 块用于特征提取,每经过一个阶段,特征图尺寸减半,通道数翻倍。

- DAD 块(Dual Attention with Deformable Convolution Block)位于 DAT 层之前,用于提取图像的空间和通道信息。

- 嵌入层将 CNN 块的输出转换为适合 DAT 层的格式。

-

变形注意力机制(Deformable Attention Module):

- 通过动态确定的采样位置对输入特征图进行采样,以捕获图像的全局上下文信息。

-

跳跃连接层(Skip Connection Layers):

- 包含 scSED 块(Spatial and Channel Enhanced Dual Attention Block),用于在编码器和解码器之间传递和融合特征。

-

解码器部分(Decoder):

- 接收编码器的输出,并通过一系列上采样操作逐步重建特征图。

- 每次上采样后,特征图尺寸翻倍,然后与跳跃连接层的输出合并,进一步通过卷积层处理。

-

分割头(Segmentation Head):

- 最终产生图像目标区域的分割结果。

-

双向混合注意力模块(Bidirectional Mixed Attention Modules):

- DAD 块和 scSED 块共同构成,帮助模型保留更多有价值的特征,提高特征提取的效率。

-

特征融合(Feature Fusion):

- 通过 scSED 块在跳跃连接层中实现,有助于提取更有价值的特征,提高特征图重建的精度。

整体来看,BiADATU-Net 的设计将 Transformer 的全局特征捕获能力和 U-Net 的局部特征提取能力相结合,并通过引入双向注意力机制,增强了模型对复杂皮肤病变特征的学习和分割能力。这种结构设计旨在实现高精度的皮肤病变分割,以便于临床治疗和皮肤癌的早期诊断。

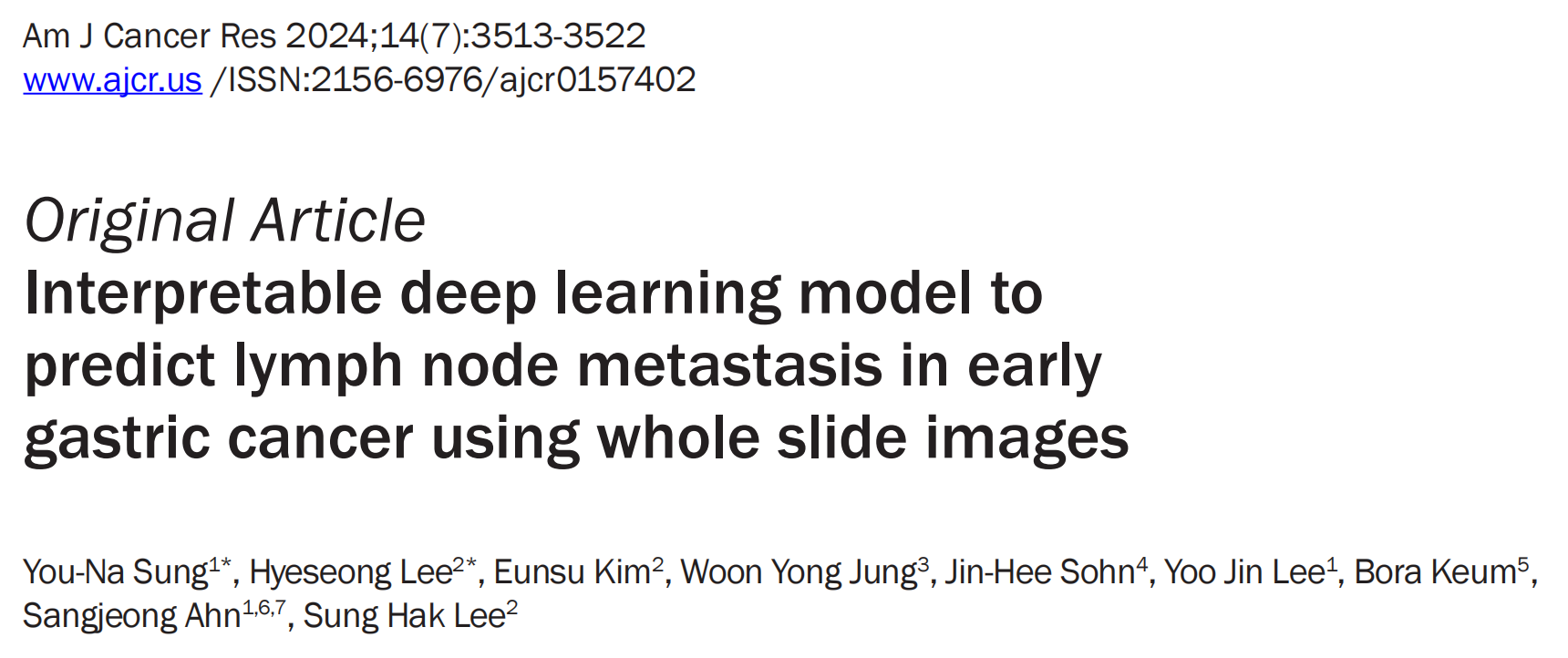

四、深度学习模型在早期胃癌淋巴结转移预测中的应用

一作&通讯

| 角色 | 姓名 | 单位名称(中文) | 单位名称(英文) |

|---|---|---|---|

| 第一作者 | You-Na Sung | 韩国大学安南医院病理科 | Department of Pathology, Korea University Anam Hospital |

| 第一作者 | Hyeseong Lee | 首尔圣母医院病理科(天主教大学医学院) | Department of Hospital Pathology, Seoul St. Mary's Hospital, College of Medicine, The Catholic University |

| 通讯作者 | Sangjeong Ahn | 韩国大学安南医院病理科 | Department of Pathology, Korea University Anam Hospital |

| 通讯作者 | Sung Hak Lee | 首尔圣母医院病理科(天主教大学医学院) | Department of Hospital Pathology, Seoul St. Mary's Hospital, College of Medicine, The Catholic University |

文献概述

这篇文章是关于一种可解释的深度学习模型的研究,该模型用于预测早期胃癌(EGC)中的淋巴结转移(LNM)。

研究的主要目的是开发一种机器学习算法,利用苏木精-伊红(H&E)染色的全切片图像(WSIs)来预测LNM状态,以辅助决定治疗方案。

研究团队使用了来自五个不同机构的1237个全切片图像数据集 ,通过三步主要流程:肿瘤分割、肿瘤形态学特征提取和淋巴结转移分类。

他们训练了一个分割网络(DeepLabV3+)来区分不同的组织亚型,并使用XGBoost算法和从训练有素的特征提取器中推断出的70个形态学特征来训练风险分类器。

分割网络在内部和外部数据集上均表现出色,像素准确度分别达到了0.9348和0.8939。风险分类器在预测LNM状态时,整体AUC(Area Under the Curve,曲线下面积)达到了0.75,其中一个数据集甚至达到了0.92的AUC。

这项研究是首次多机构合作研究,开发了一种使用H&E染色组织病理学图像预测EGC患者LNM状态的机器学习算法。研究结果有潜力改善需要手术的EGC患者的选择,特别是那些展现出高风险组织学特征的患者。

研究还讨论了模型的局限性,包括不同队列之间预测LNM的AUC差异,以及数据标注过程中的劳动密集性和对预定义目标的依赖性。研究者提出,为了克服这些限制,应该尝试使用在未标记数据上训练的医学基础模型来自动提取图像特征,并整合多模态数据以提高模型的准确性和鲁棒性。

最后,研究得出结论,开发的预测模型能够基于原发性胃癌的数字H&E切片识别可能发展为LNM的高风险EGC患者。该模型不受内部或观察者间变异的影响,可以在不同的机构中应用,最终可能有助于减少不需要手术的EGC患者的过度治疗,同时确保需要手术的患者得到适当的治疗。

重点关注

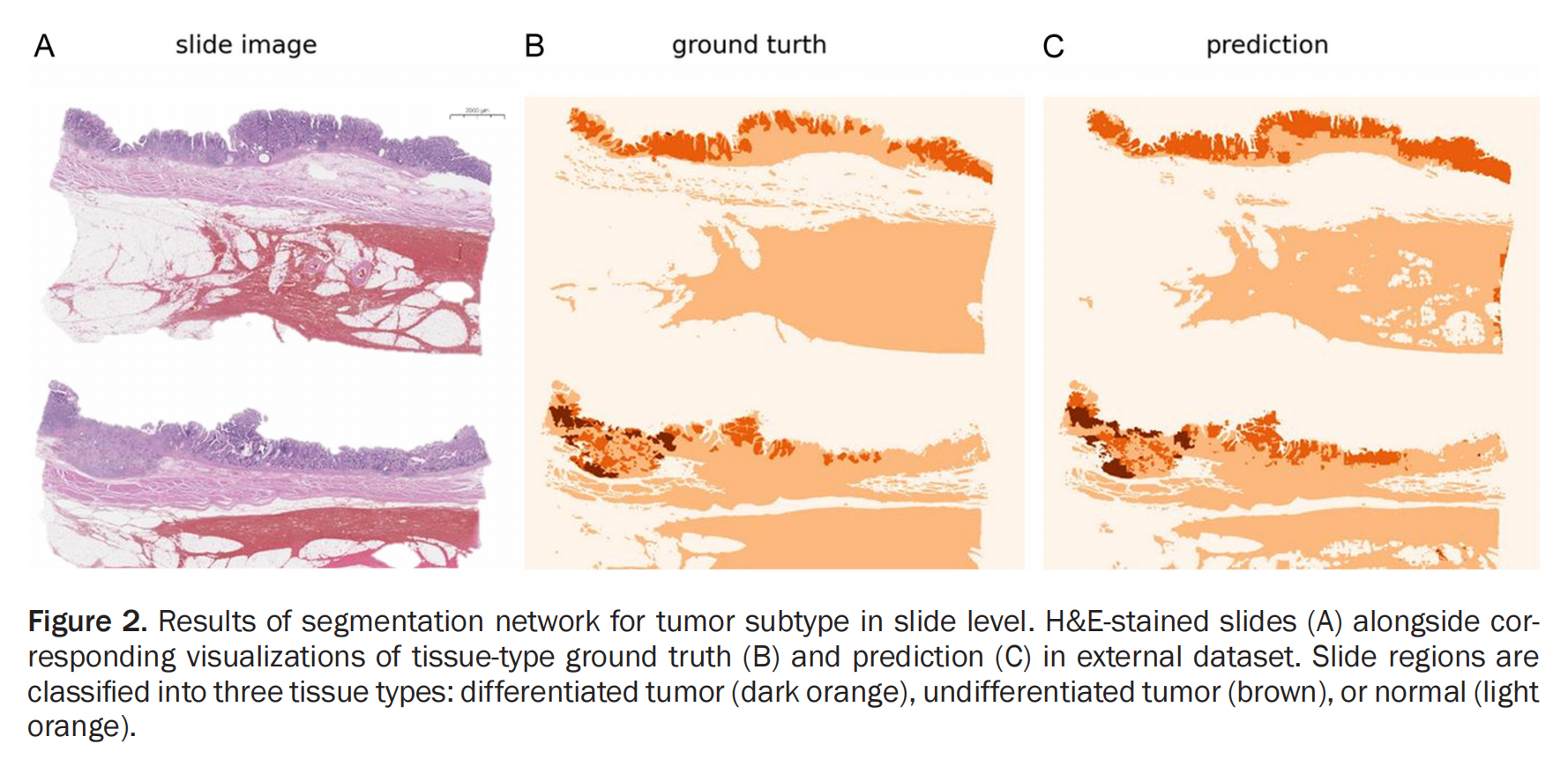

Figure 2 展示了在外部数据集上,用于肿瘤亚型分割的深度学习网络的结果。

这个网络能够区分三种不同类型的组织区域:分化型肿瘤(暗橙色)、未分化型肿瘤(棕色)以及正常组织(浅橙色)。

具体来说,这个图包含了以下部分:

- H&E染色的切片图像(A):这是原始的病理学图像,经过苏木精-伊红染色,可以观察到肿瘤组织和正常组织的结构差异。

- 组织类型真实标签的可视化(B):这一部分展示了真实标注的组织类型,其中不同的颜色代表不同的组织区域。这可以作为模型训练和评估的基准。

- 预测结果的可视化(C):这一部分展示了深度学习模型对于肿瘤亚型的预测结果。模型尝试根据图像特征将每个区域分类为三种类型之一。

分析这个图,我们可以了解模型在实际应用中的表现,包括它在区分不同类型的肿瘤组织以及正常组织方面的能力。通过比较(B)和(C),可以评估模型的准确性,观察模型是否能够正确地识别和分类肿瘤亚型。如果预测结果与真实标签高度一致,说明模型具有较好的泛化能力和准确性。反之,如果存在较大差异,则可能表明模型在某些方面需要进一步优化。

五、PathoDuet:一种用于病理图像分析的新型自监督学习框架

开源代码

https://github.com/openmedlab/PathoDuet

一作&通讯

| 角色 | 姓名 | 单位名称 | 单位英文名称 |

|---|---|---|---|

| 第一作者 | Shengyi Hua | 上海交通大学清源研究院 | Qing Yuan Research Institute, Shanghai Jiao Tong University |

| 通讯作者 | Xiaofan Zhang | 上海交通大学清源研究院 | Qing Yuan Research Institute, Shanghai Jiao Tong University |

| 上海人工智能实验室 | Shanghai Artificial Intelligence Laboratory |

文献概述

这篇文章是关于一种新的用于病理图像分析的预训练模型------PathoDuet的研究。

它通过自监督学习方法在大量数字化的组织病理学数据上预训练,以开发病理学基础模型。

PathoDuet模型专注于处理Hematoxylin和Eosin(H&E)染色以及免疫组化(IHC)染色的病理切片图像。

- 提出了一个新的自监督学习框架,包括一个新引入的预文本标记(pretext token)和任务提升器(task raiser),以明确利用图像之间的某些关系,例如不同的放大倍数和不同的染色。

- 设计了两种预文本任务:跨尺度定位(cross-scale positioning)和跨染色传递(cross-stain transferring),分别用于在H&E图像上预训练模型和将模型传递到IHC图像。

- 在多种下游任务上验证了模型的有效性,包括H&E领域的补丁级结直肠癌亚型分类、整个切片图像(WSI)分类,以及IHC领域的表达水平预测、肿瘤识别和切片级定性分析。

- 实验结果表明,PathoDuet模型在大多数任务上都优于其他模型,并且提出的预文本任务是有效的。

此外,文章还讨论了与自监督学习相关的工作,包括在计算机视觉和数字病理学中的研究进展。作者提供了代码和模型的访问链接,以促进未来的使用和可重复的实验。

重点关注

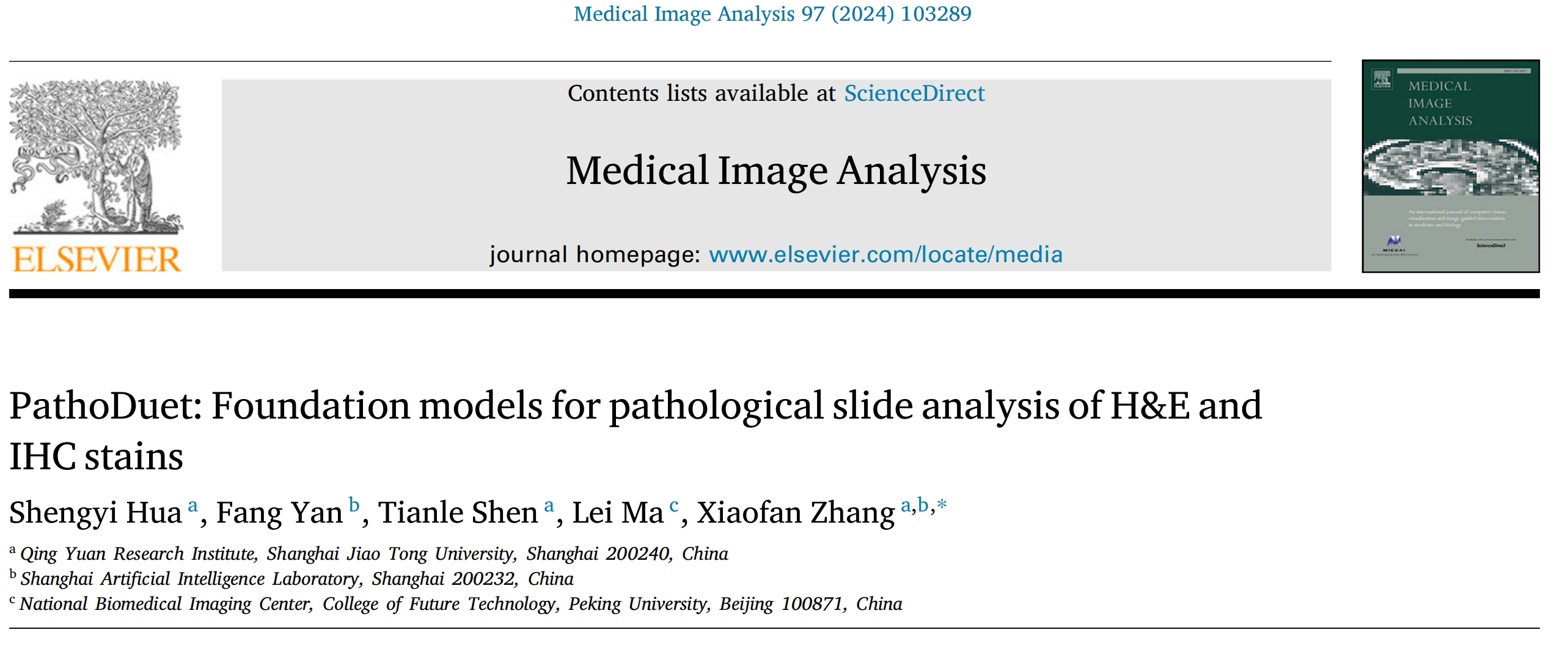

Fig. 1 提供了 PathoDuet 框架的概览,该框架包含两个主要部分:

-

左侧(设计用于开发H&E和IHC模型的两个预文本任务):

-

跨尺度定位(Cross-scale positioning):这个任务旨在开发针对H&E染色图像的病理基础模型。它利用大规模公共H&E数据集,通过模拟病理学家放大和缩小观察切片的操作,来加强模型对不同尺度下图像的理解。具体来说,模型需要学习从全局视角理解低倍放大下的WSI,以及从局部视角精细理解高倍放大下的关键区域。

-

跨染色传递(Cross-stain transferring):这个任务设计用来将从H&E图像学到的知识迁移到IHC图像上。IHC图像提供了关于疾病亚型等的额外诊断信息。通过使用自适应实例归一化(AdaIN)技术,模型能够将H&E图像的结构信息与IHC图像的特定分子信息相结合,从而提高对不同染色方式的病理图像的理解。

-

-

右侧(一系列下游任务,用于评估模型在实际应用中的性能):

- 图的右侧展示了使用PathoDuet模型的多种下游任务,这些任务覆盖了H&E和IHC图像。这些任务包括但不限于:

- 补丁级别的结直肠癌亚型分类。

- 整个切片图像(WSI)级别的分类。

- IHC标记的表达水平预测。

- IHC图像中的肿瘤识别。

- IHC图像的切片级定性分析。

这些下游任务用于评估PathoDuet模型在实际应用场景中的有效性和泛化能力。通过这些任务,研究者可以了解模型在不同类型的病理分析中的性能表现。

- 图的右侧展示了使用PathoDuet模型的多种下游任务,这些任务覆盖了H&E和IHC图像。这些任务包括但不限于:

六、去泛素化酶相关指数预测乳腺癌患者预后及免疫治疗反应

一作&通讯

| 角色 | 姓名 | 单位名称(英文) | 单位名称(中文) |

|---|---|---|---|

| 第一作者 | Youyuan Deng | Department of General Surgery, Xiangtan Central Hospital, Xiangtan 410000, Hunan, P.R. China | 湖南省湘潭市中心医院普通外科,湘潭 410000,中国 |

| 通讯作者1 | Jianguo Wang | Department of Oncology, The First Affiliated Hospital of Chengdu Medical College, Chengdu 610500, Sichuan, P.R. China | 四川省成都医学院第一附属医院肿瘤科,成都 610500,中国 |

| 通讯作者2 | Ke Xu | Clinical Medical College, Chengdu Medical College, Chengdu 610500, Sichuan, P.R. China | 四川省成都医学院临床医学系,成都 610500,中国 |

文献概述

这篇文章通过构建去泛素化酶相关指数(DUBRI),为乳腺癌患者的预后评估和免疫治疗反应提供了新的生物标志物。

背景:乳腺癌是一种常见的恶性肿瘤,具有高度的异质性和药物抗性,导致晚期患者死亡率高。因此,发现个性化的生物标志物和定制的治疗方案对于改善患者预后至关重要。

研究方法:研究者使用机器学习技术,基于与去泛素化酶相关的基因,创建了一个新的指标------去泛素化酶相关指数(DUBRI)。通过DUBRI,系统分析了患者的预后、临床特征、肿瘤免疫微环境、化疗反应和免疫治疗反应。此外,还探索了OTUB2在乳腺癌细胞中的功能。

主要发现:

- DUBRI由五个去泛素化酶基因(OTUB2, USP41, MINDY2, YOD1, 和 PSMD7)组成,是乳腺癌患者生存的可靠预测因子。

- 高DUBRI组患者表现出更高水平的免疫细胞浸润。

- 分子对接预测了去泛素化酶中核心靶蛋白,体外实验验证了OTUB2的敲低能够抑制乳腺癌细胞的增殖和迁移。

结论:DUBRI可能有效地评估乳腺癌患者的预后,并识别出能够从免疫治疗中获益的患者群体,为未来乳腺癌患者的靶向治疗提供了重要信息。

研究细节:

- 研究使用了来自TCGA数据库的转录组数据和临床数据,以及GEO数据库的验证队列。

- 通过GSEA分析、CIBERSORT方法、ssGSEA技术等工具,研究了肿瘤微环境和免疫细胞的相关性。

- 使用了GDSC数据库来评估化疗药物的有效性,并使用TIDE算法来推断免疫治疗的有效性。

- 分子对接模拟了OTUB2与小分子药物的结合姿态。

- 通过体外实验,包括CCK8实验、细胞克隆形成、Transwell实验和细胞周期检测,评估了OTUB2在细胞功能上的作用。

文章强调了去泛素化酶在癌症治疗中的潜力,并提出了DUBRI作为一个新的预后和治疗反应预测工具。研究结果为乳腺癌的个性化治疗提供了有价值的见解。

重点关注

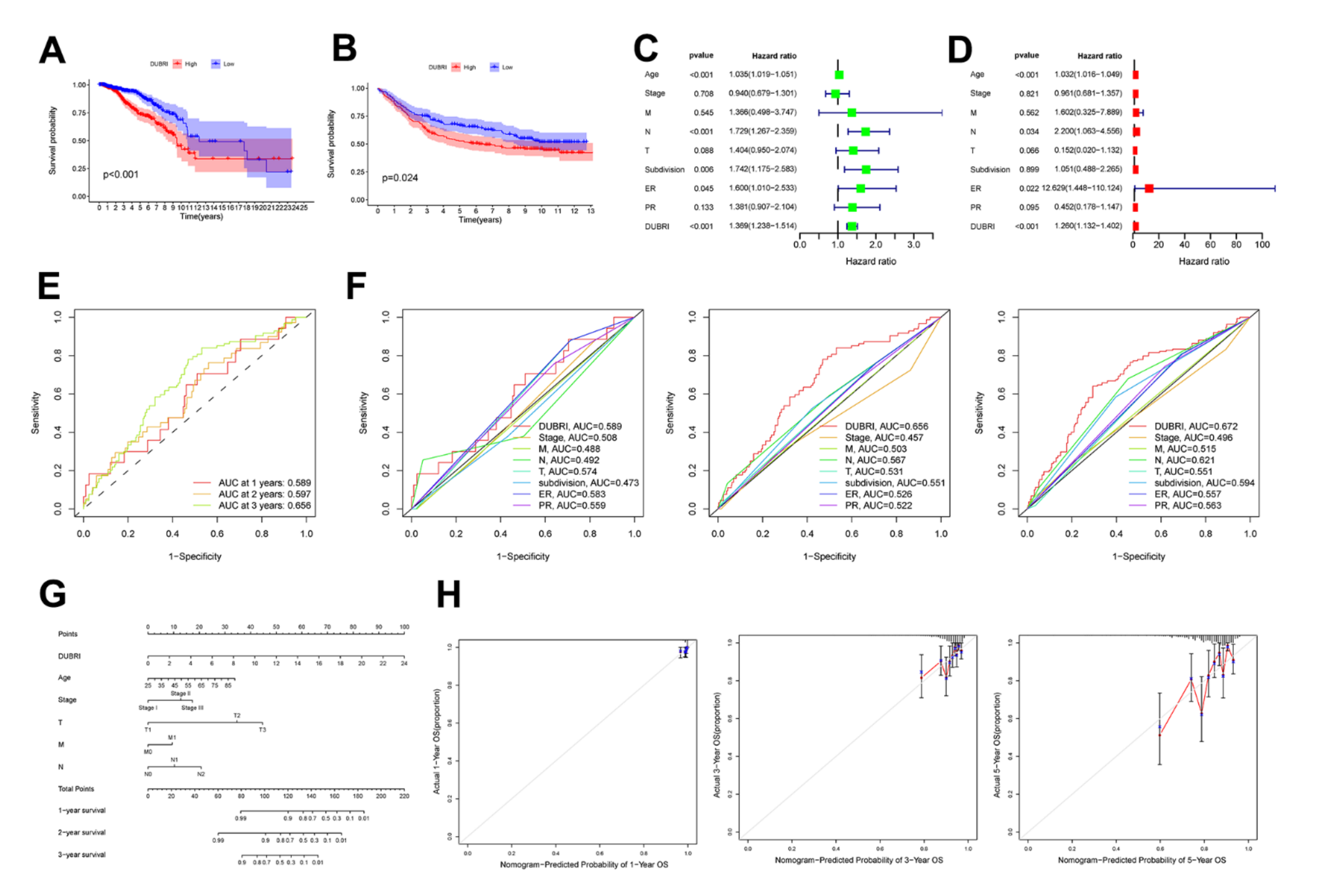

Figure 1 展示了去泛素化酶相关指数(DUBRI)与乳腺癌患者预后和临床相关性的研究结果。

(A) Kaplan-Meier 生存曲线(TCGA 数据集):这部分通过生存曲线比较了高DUBRI组和低DUBRI组在TCGA数据集中的总体生存率。曲线的分离程度可以反映DUBRI对生存率的影响。

(B) Kaplan-Meier 生存曲线(GEO 数据集):与(A)类似,这部分使用GEO外部数据集进一步验证了DUBRI分组对生存率的影响。

© 单变量Cox回归分析:这种分析方法用来评估DUBRI单独作为预后因素与乳腺癌患者生存率之间的关系。

(D) 多变量Cox回归分析:在控制了其他临床特征的条件下,这部分分析了DUBRI与患者生存率的关联,以确定其作为一个独立预后因素的价值。

(E) ROC曲线(1, 3, 和 5 年):接收者操作特征(ROC)曲线用于评估DUBRI作为预测1年、3年和5年生存率的生物标志物的性能。

(F) ROC曲线比较:这部分将DUBRI与其他临床特征的预测性能进行比较,以评估其在预测1年、3年和5年生存率方面的相对优势。

(G) 预后列线图:列线图是一种图形工具,用于根据多个预后因素(包括DUBRI)预测乳腺癌患者的个体化生存概率。

(H) 校准曲线:这些曲线提供了TCGA队列中1年、3年和5年总体生存率的预测准确性评估,反映了预测生存率与实际观察到的生存率之间的一致性。

总体而言,Figure 1 通过多种统计方法和图形工具,全面评估了DUBRI作为乳腺癌预后生物标志物的潜力和准确性。