今天,我要向大家介绍一个名为Verbi的语音助手项目。这是一个结合了多种先进技术的模块化语音助手应用程序,能够实现语音到文本、文本生成和文本到语音的全流程处理。通过这个项目,我们可以体验到尖端科技如何改变我们的日常生活。

Verbi的诞生

Verbi的设计理念是模块化和灵活性。它支持各种API提供商,包括OpenAI、Groq、Eleven Labs、Caresia和Deepgram等。用户可以根据自己的需求选择不同的模型,从而获得最佳的响应速度和准确性。

功能展示

Verbi的核心功能包括:

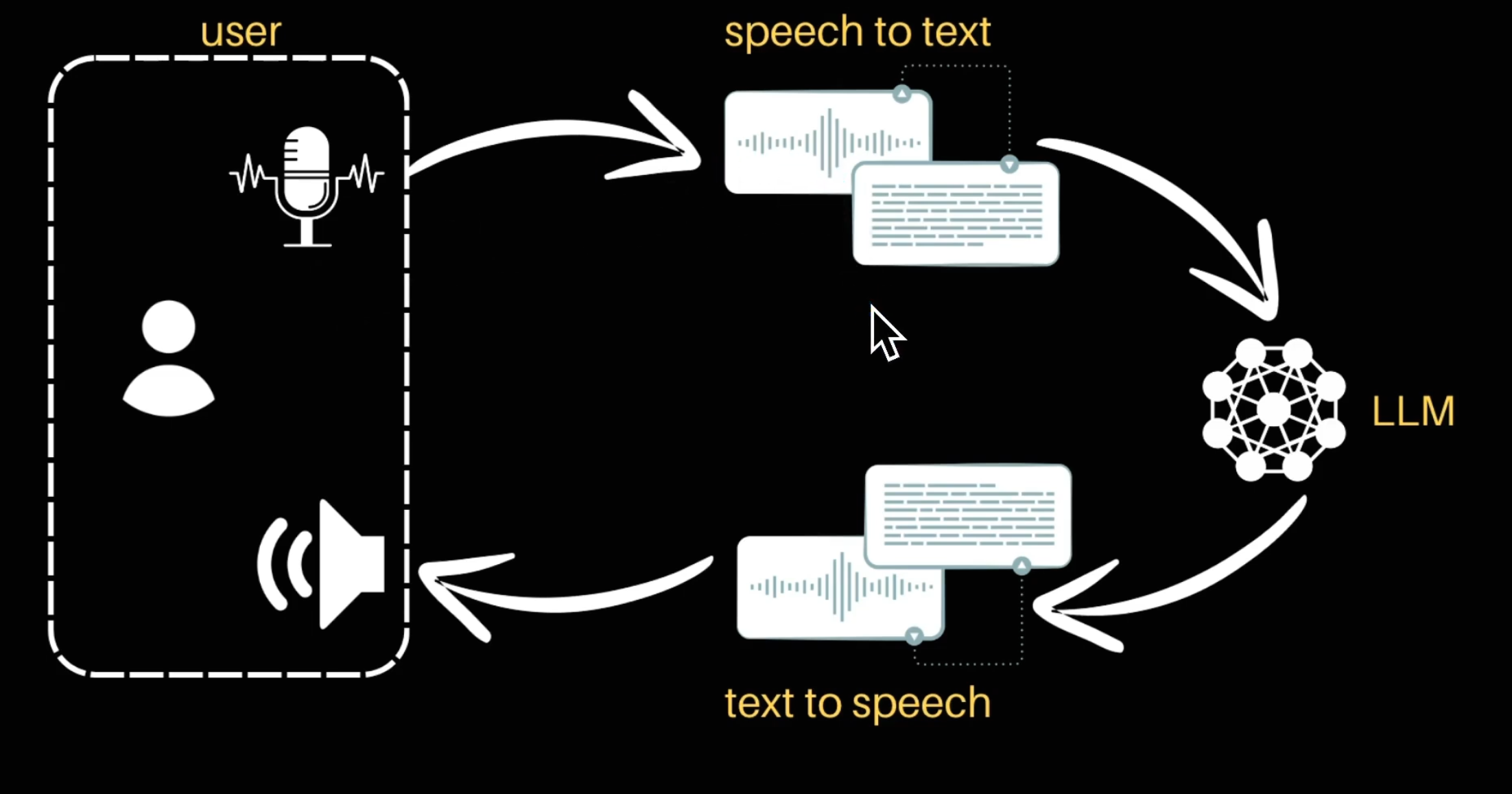

- 用户输入和输出:用户通过语音输入,系统将语音转换为文本,然后使用大语言模型(LLM)生成响应文本,最后将文本转换为语音并播放给用户。

- 记忆功能:系统可以记住之前的对话内容,提高连续对话的流畅性。

- 模块化设计:用户可以轻松切换不同的模型来实现语音转文本、文本生成和文本到语音的功能。

- 多API支持:支持多个API提供商,并计划增加更多的支持。

- 本地模型:支持运行本地模型,但需要较强的计算资源。

实验与优化

在实验过程中,我发现由Groq托管的语音转文本模型在延迟方面表现最佳。对于文本生成,大语言模型(LLM)也是Groq的托管模型表现出色。而在文本到语音的转换方面,Caresia AI和Deepgram的系统拥有最低的延迟。

尽管这些模型的性能优异,但你也可以使用开源的本地模型。不过,本地模型需要强大的计算资源才能在可接受的时间内生成响应。

Verbi的安装与配置

要开始使用Verbi,首先需要克隆项目的代码库并创建虚拟环境。然后,安装所需的依赖包并提供不同API的密钥。接下来,更新配置文件以选择你要使用的模型。以下是详细的步骤:

- 克隆代码库:

git clone https://github.com/PromtEngineer/Verbi.git - 创建虚拟环境:

conda create -n Verbi python=3.10 - 激活虚拟环境:

conda activate Verbi - 安装依赖包:

pip install -r requirements.txt - 配置模型:在配置文件

config.py中设置转录模型、响应生成模型和文本到语音模型。

模型选择与测试

Verbi允许用户灵活选择不同的模型。例如,你可以选择Grok的语音转文本模型,Grok的LLM模型,以及Caresia的文本到语音模型。然后,你可以通过运行

python run_voice_assistant.py来启动系统。

实际应用

在实际应用中,Verbi表现出了极高的响应速度和准确性。例如,当用户询问关于去上海旅行的建议时,Verbi可以快速生成并播放相应的语音回答。这种高效的互动体验证明了Verbi在技术上的优越性。

结语

Verbi不仅是一个技术项目,更是科技如何改变生活的一个生动例子。通过模块化设计和多API支持,Verbi展示了未来语音助手的无限可能。如果你对科技充满兴趣,那么Verbi绝对是一个值得探索的项目。

关注我,每天带你开发一个AI应用,每周二四六直播,欢迎多多交流。