英伟达的 DGX SuperPOD 是一台完整的数据中心级 AI 超级计算机,采用模块化的设计,支持不同规模大小的设计。每台超级计算机都在出厂前完成了搭建、布线和测试,从而大大加快了在用户数据中心的部署速度 。

**** ** **NVIDIA DGX SuperPOD是下一代数据中心人工智能(AI)架构,旨在提供AI模型训练、推理、高性能计算(HPC)和混合应用中的高级计算挑战所需的计算性能水平,以提高预测性能和解决方案的时间。下面一起学习英伟达H100→GH200→GB200三代产品的GPU互连架构方案。

NVIDIA DGX SuperPOD采用模块化的设计,支持不同规模大小的设计。一个标准的SuperPOD由140台DGX A100 GPU服务器、HDR InfiniBand 200G网卡和NVIDIA Quantum QM8790交换机构建而成。每个DGX GB200系统搭载36个NVIDIA GB200超级芯片,共包含36个NVIDIA V100 Tensor Core GPU,可提供高达9.7 petaflops的AI性能和240TB的快速显存,且可通过增加机架来扩展性能。

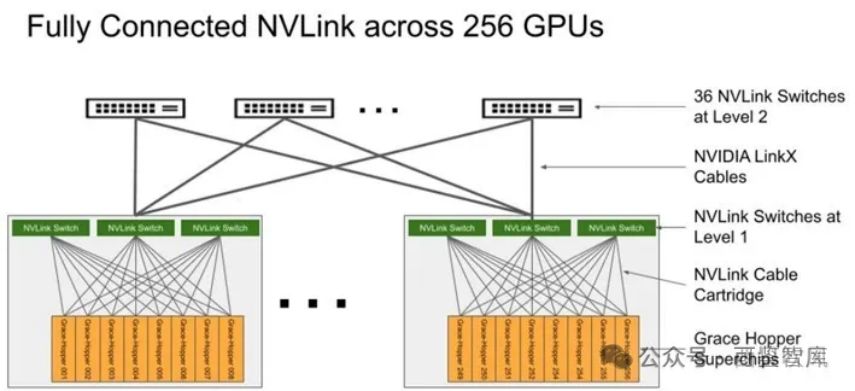

1、基于H100搭建256 GPU的SuperPod

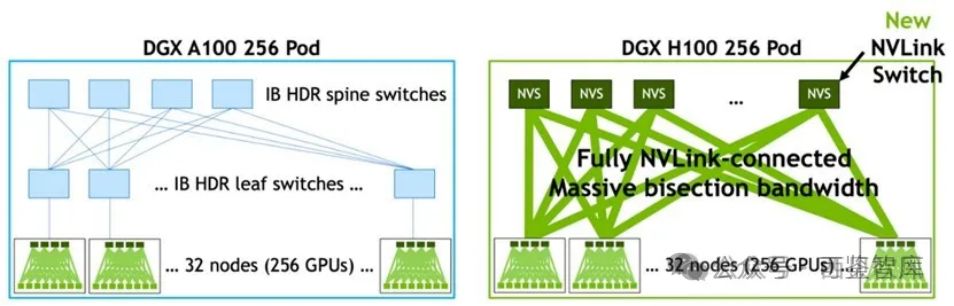

在DGX A100情况下,每个节点上8张GPU通过NVLink和NVSwitch互联,机间(不同服务器)直接用200Gbps IB HDR网络互联(注:机间网络可以用IB网络,也可以用RoCE网络)。而在DGX H100的情况下,英伟达把机内的NVLink扩展到机间,增加了NVLink-network Switch,由NVSwitch负责机内的交换,NVLink-network Switch则是负责机间交换的交换机,基于NVSwitch和NVLink-network Switch可以搭建256个H100 GPU组成的SuperPod(即一个超级计算系统 ),256个GPU卡Reduce带宽仍然可以打到450 GB/s,和单机内部8个GPU卡的Reduce带宽完全一致。

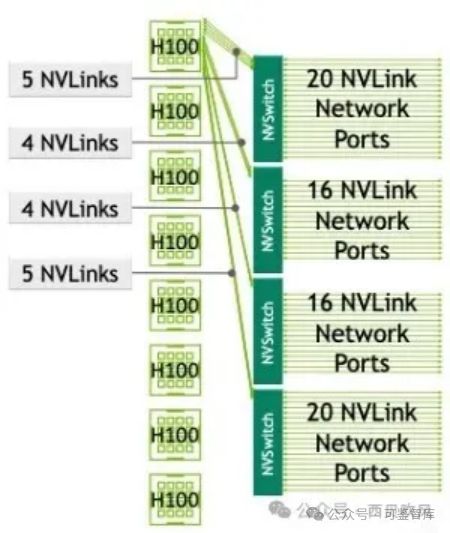

但是DGX H100的SuperPod也存在一定的问题,跨DGX H100节点的连接只有72个NVLink连接,SuperPod系统里并不是无收敛的网络。如下图,在DGX H100系统里,四个NVSwitch留出了72个NVLink连接用于通过NVLink-network Switch连接到其他DGX H100系统,72个NVLink连接的总双向带宽是3.6TB/s,而8个H100的总双向带宽是7.2TB/s,因此,在SuperPod系统里在NVSwitch处存在收敛。

图:基于H100搭建256 GPU的SuperPod

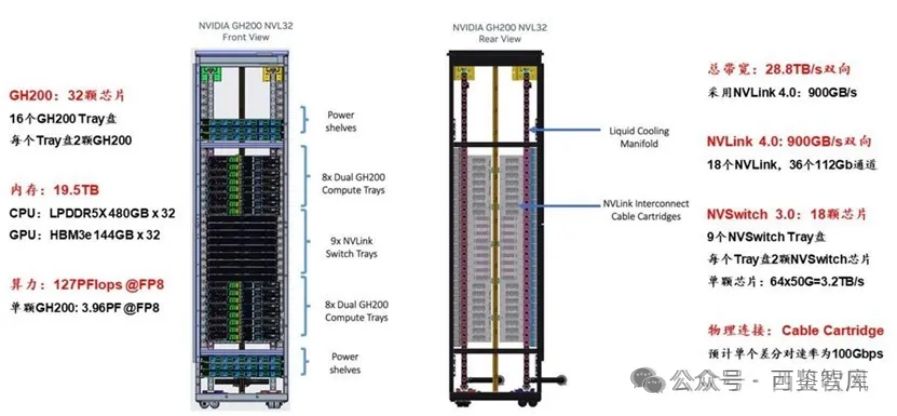

2、基于GH200和GH200 NVL32搭建256 GPU的SuperPod

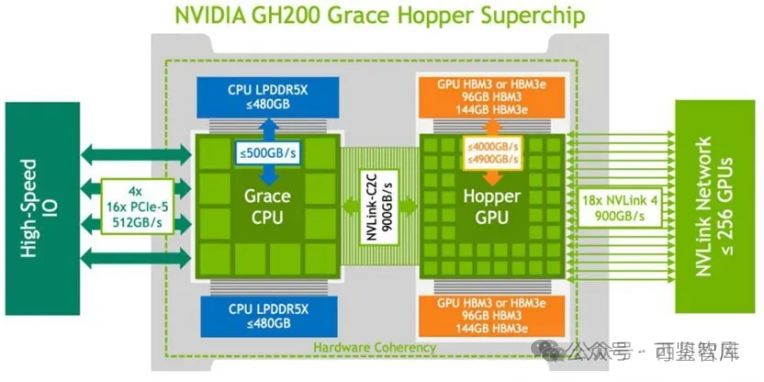

2023年,英伟达隆重推出DGX GH200生成式AI引擎,这款硬件产品实现了H200 GPU与Grace CPU的完美融合。每个Grace CPU都配备了一个对应的H200 GPU,为用户提供卓越的性能和内存带宽。此外,为了进一步提升效率,GH200的GPU与CPU之间也采用了NVLink4.0高速连接技术,助力AI应用在各领域的突破性发展。

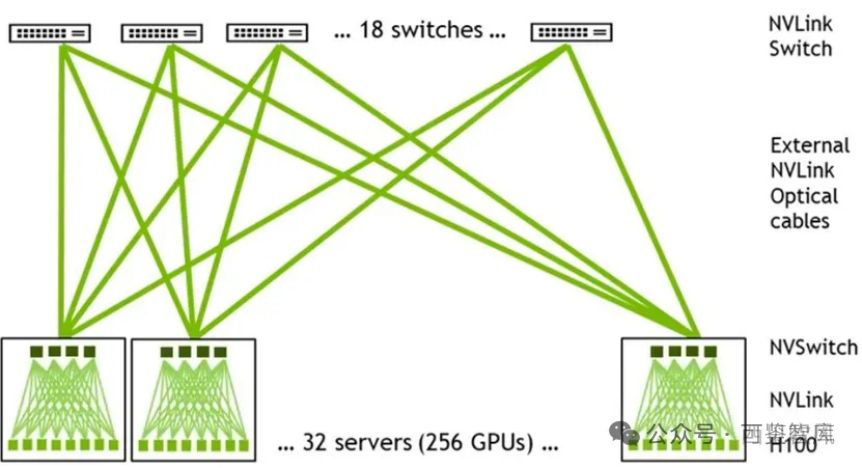

GH200通过NVLink 4.0的900GB/s超大网络带宽能力来提升算力,服务器内部可能采用铜线方案,但服务器之间可能采用光纤连接。对于单个256 GH200芯片的集群,计算侧1个GH200对应9个800Gbps(每个800Gbps对应100GB/s,2条NVLink 4.0链路)光模块。GH200 SuperPod与DGX H100 SuperPod的区别在于在单节点内部和节点之间互联时都是用NVLink-network Switch互联。

DGX GH200采用二级Fat-tree结构,由8个GH200和3个一级NVLink-network Switch(每个NVSwitch Tray包含2个NVSwitch芯片,有128个Port)组成单机,32个单机经由36个二级NVLink-network Switch全互联,形成了256个GH200的SuperPod(注意是36个二级NVLink-network Switch,这样才能保证无收敛)。图:基于GH200搭建256 GPU的SuperPod

GH200 NVL32是一款机架级集群,每个节点拥有32个GH200 GPU和9个NVSwitch Tray(18个NVSwitch3.0芯片)。如果要组成256个GPU的超级节点,需要再配置一级机间的36个NVLink-network Switch。这款产品具有高性能、高可靠性和高扩展性,适用于大规模数据中心和云计算环境。

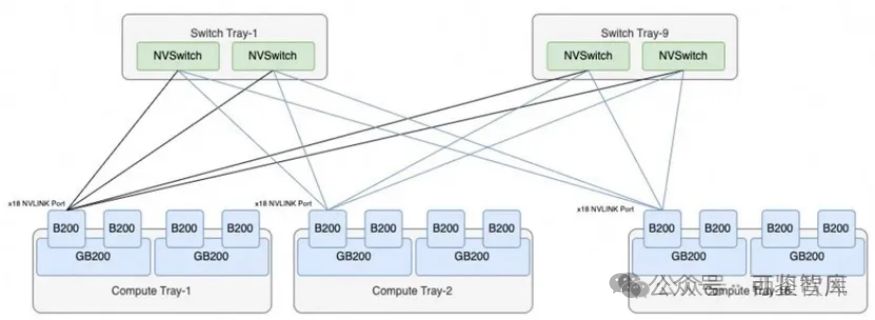

3、基于GB200 NVL72搭建576 GPU的SuperPod

和GH200不同,一个GB200由1个Grace CPU和2个Blackwell GPU组成(注:单个GPU算力不完全等价B200)。GB200 Compute Tray是基于英伟达MGX设计的,一个Compute Tray包含2个GB200,也就是2个Grace CPU、4个GPU。

一个GB200 NVL72节点包含18个GB200 Compute Tray,即36个Grace CPU,72个GPU,此外还包含9个NVLink-network Switch Tray(每个Blackwell GPU有18个NVLink,而每个第4代NVLink-network Switch Tray包含144个NVLink Port,所以需要72*18/144=9个NVLink-network Switch Tray实现全互联)。

图:GB200 NVL72内部拓扑架构

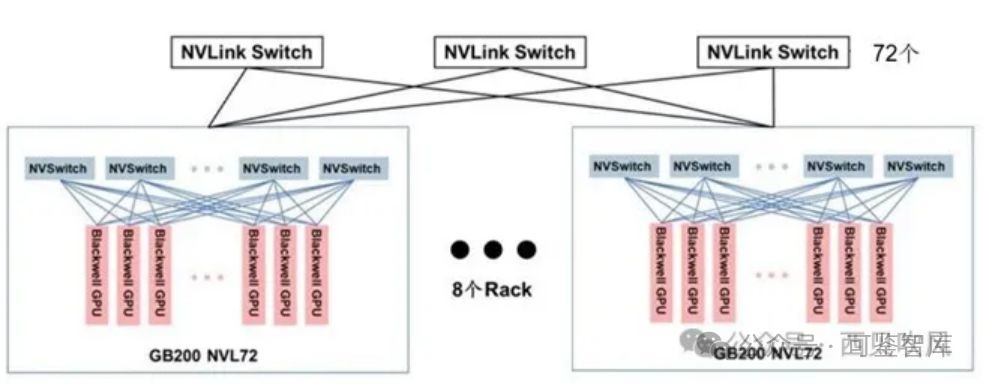

在英伟达的官方宣传中,8个GB200 NVL72组成一个SuperPod,从而组成一个由576个GPU组成的超级节点。但是,我们通过分析可以看出GB200 NVL72机柜中的9个NVLink-network Switch Tray已经全部用于连接72个GB200了,已经没有额外的NVLink接口用于扩展构成更大规模的两层交换集群了,576个GPU的SuperPod从英伟达官方的图片来看,更多的是通过Scale-Out RDMA网络互联的,而并不是通过Scale-Up的NVLink网络互联的。

如果需要通过NVLink互联来支持576个GPU的SuperPod,则需要每72个GB200配置18个NVSwitch,这样单机柜就放不下了。另外,英伟达官方说NVL72有单机柜版本,也有双机柜的版本,并且双机柜每个Compute Tray只有一个GB200子系统,这样有可能是通过双机柜的版本来实现通过NVLink互联来支持576个GPU的SuperPod,这样这个双机柜版本的每个双机柜有72个GB200和18个NVLink-network Switch Tray,从而可以满足两层集群的部署需要。

如下图所示:图:基于GB200搭建576GPU的SuperPod

和上一代256个H200全互联类似结构类似,只是第一级及第二级所有的设备台数有所不同,需要两级NVLink-network Switch互联:第一级的一半Port连接576个Blackwell GPU,所以需要576*18/(144/2) =144个NVLink-network Switch,每个NVL72有18个NVLink-network Switch Tray。第二级Port全部与第一级的NVLink-network Switch Port连接,所以需要144*72/144=72 个NVSwitch。

-对此,您有什么看法见解?-

-欢迎在评论区留言探讨和分享。-