coppelia sim[V-REP]仿真实现 机器人于3D相机手眼标定与实时视觉追踪

- [一 标定板的制作](#一 标定板的制作)

- [二 仿真场景设置](#二 仿真场景设置)

-

- 加载机器人

- [加载的控制dummy ](#加载的控制dummy

)

) - 加载3D相机

Coppelia Sim (v-REP)仿真 机器人3D相机手眼标定与实时视觉追踪 (二)

一 标定板的制作

生成标定的PDF文件

在这个地址可以生成需要用的标定板的文件,设置标定板的大小,棋盘格的大小,等相关的参数,之后可以保存PDF文件。该文件可以可以直接打印。

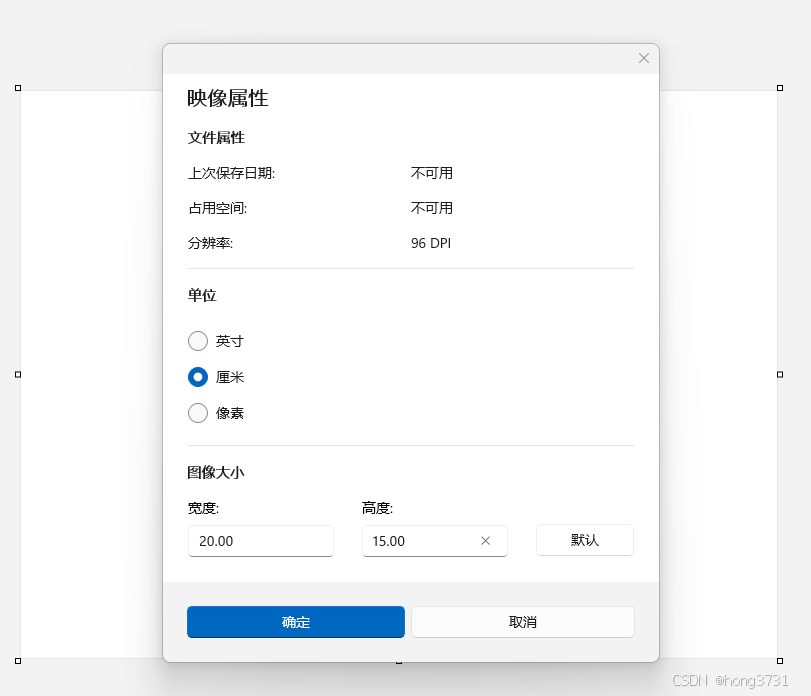

PDF转为图像格式

由于需要导入到仿真场景中PDF文件不能直接导入,所以需要生成图下文件,使用windows自带的画图工具,生成以厘米为单位的图像格式,大小和标定板的设置大小一直

然后直接屏幕截图把PDF的图像放大图像中,这样就有了标定板的图了,作为仿真,应该够用了。

图像加载到仿真中

新建一个plane

设置plane的大小

设置材质,选择之前的图像文件

仿真场景的标定板

二 仿真场景设置

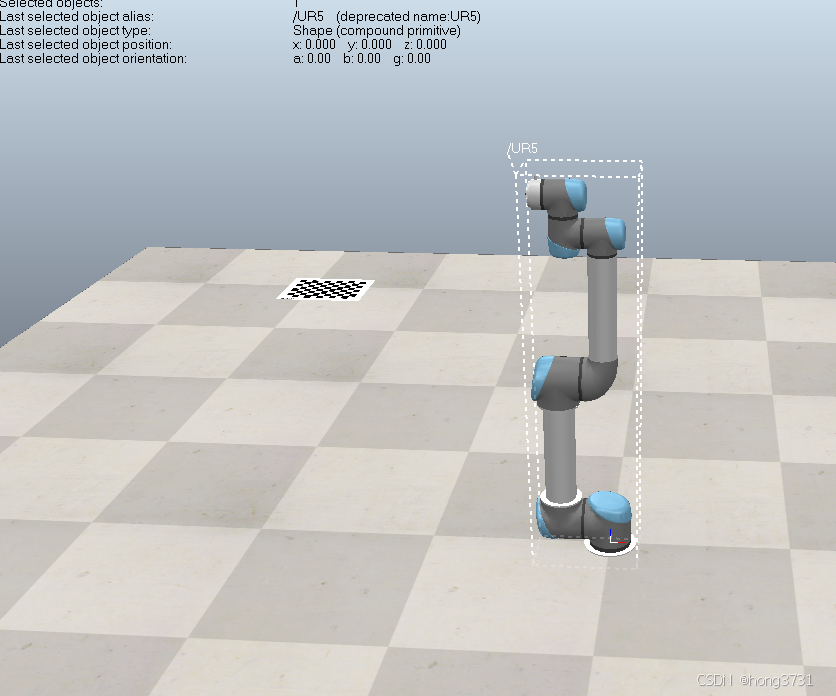

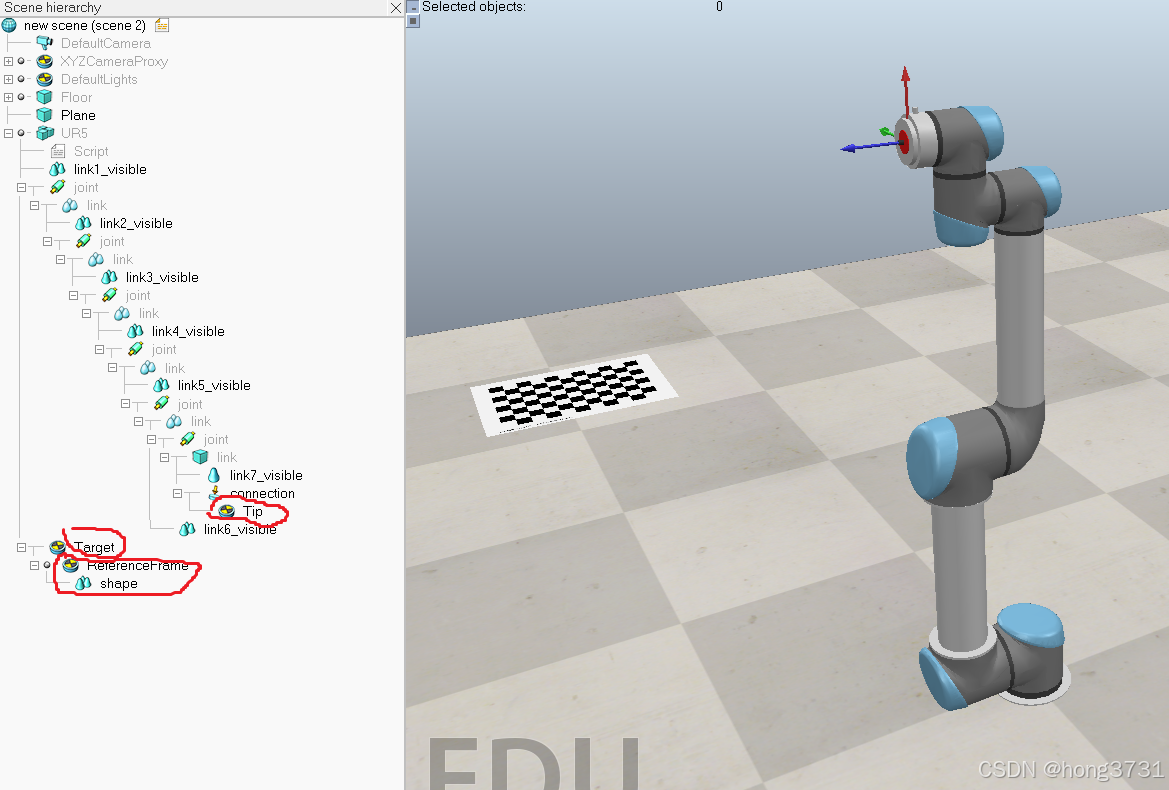

加载机器人

拖放机器人到场景中

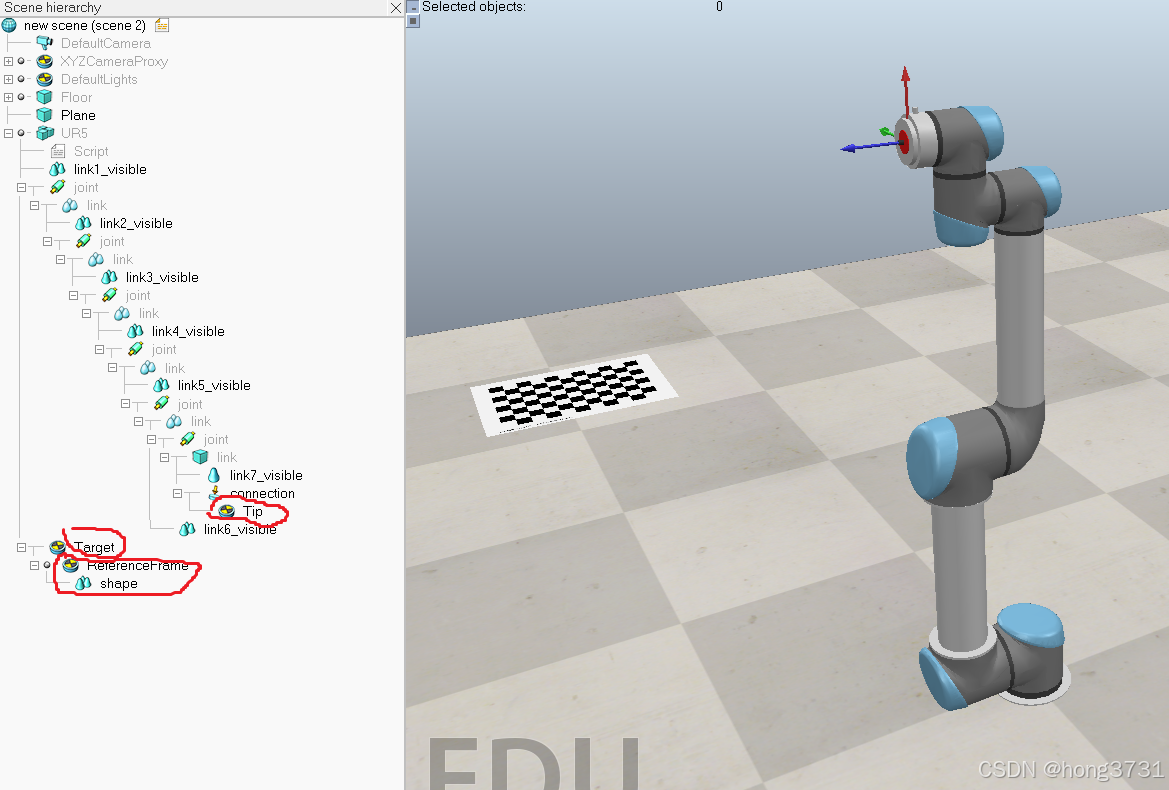

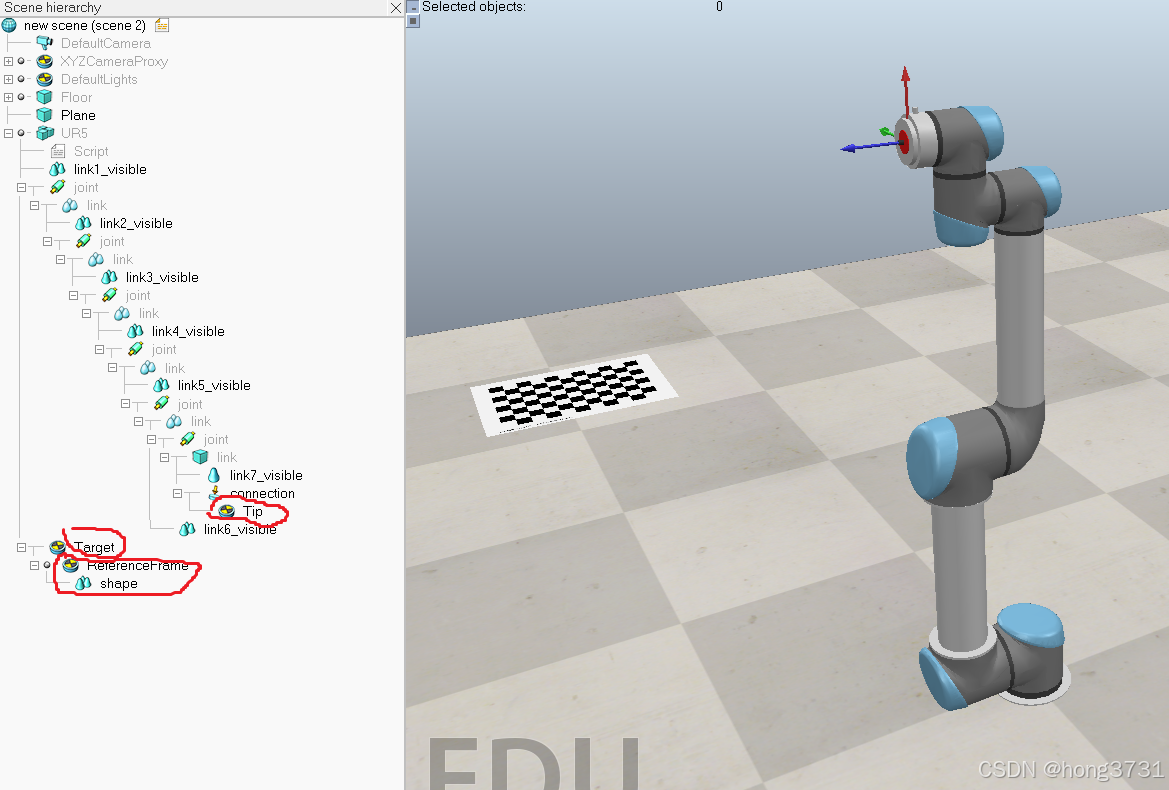

加载的控制dummy

加载3D相机

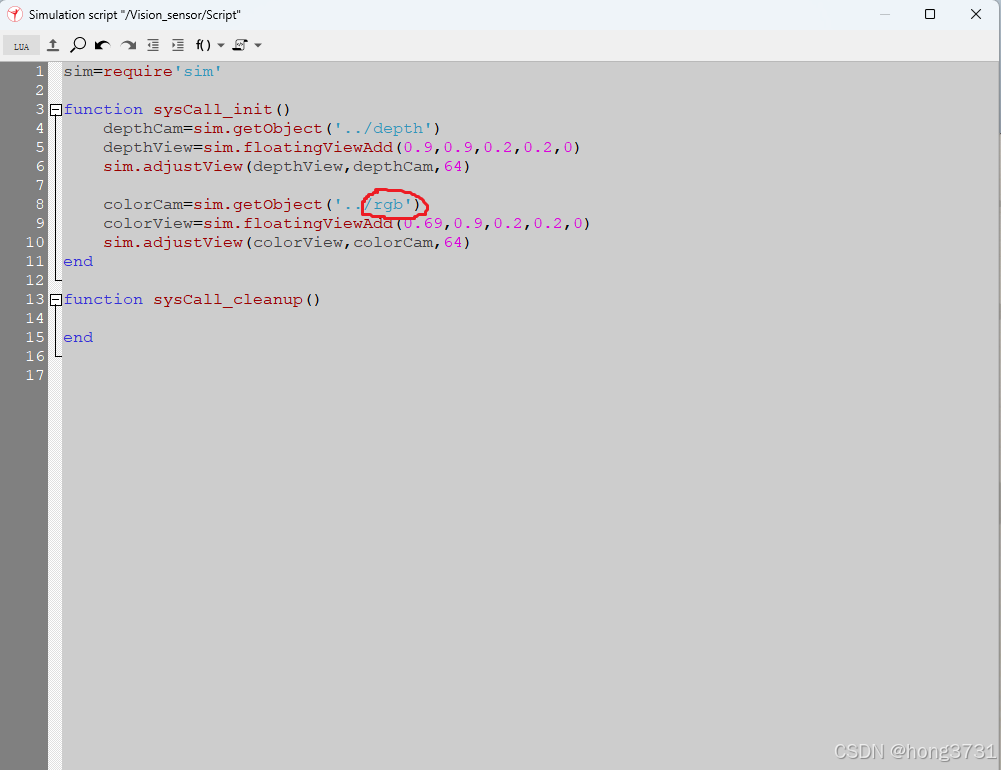

感觉用kinect的模型不是很好,比较大,而且坐标显示不是很好,所有用vision sensor加上detp相机

先把这连个都添加到场景中,然后把kinect的depth相机拖到vision sensor中,把kinect的script也拖到vision sensor中,同时要注意修改深度相机的坐标,及修改script,删掉/rgb部分

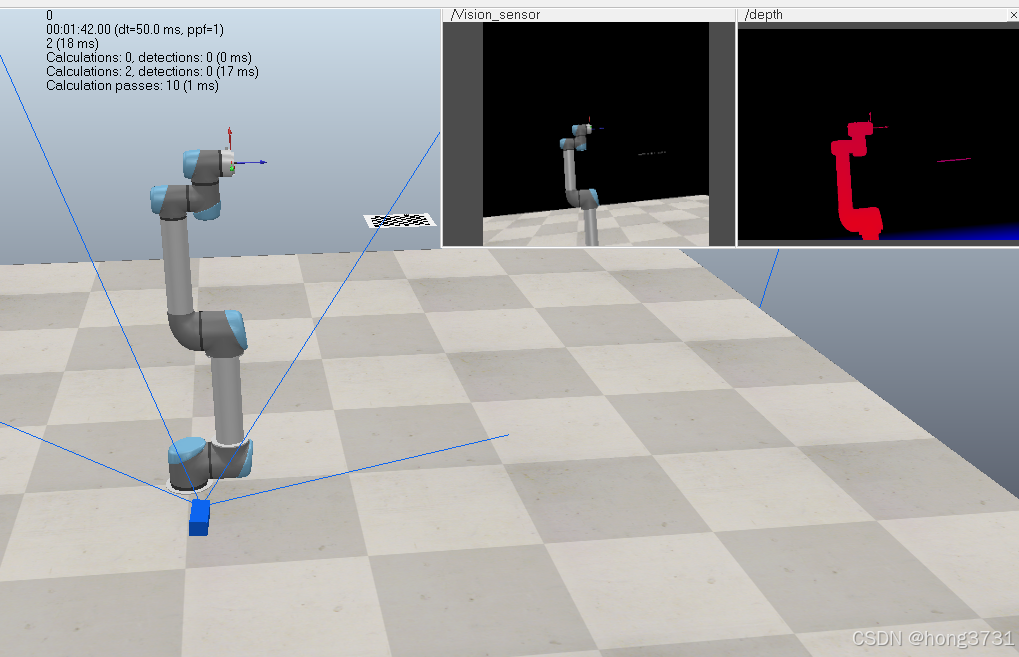

运行仿真,应该可以显示出来相机的实时图像

把相机安装到机器人末端,调整好标定板的位置,最终的仿真场景

仿真的文件

接下来需要通过zmq API来获取rgb和深度相机的凸显,用API来控制机器人