在Stable Diffusion中安装完Ebsynth Utility后,就可以开始试用了。

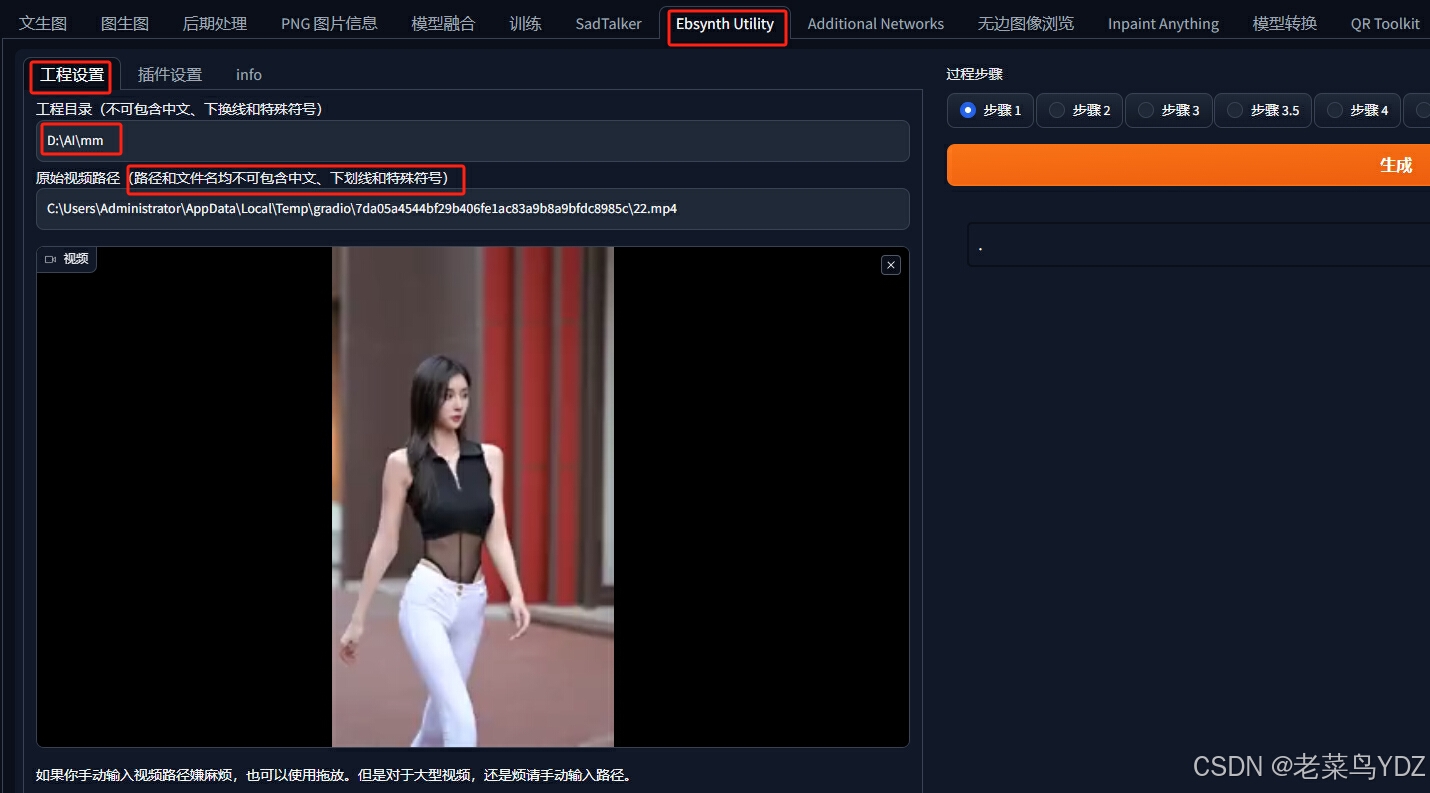

启动Stable Diffusion后,出面画面:

1、步骤1:视频分帧及生成蒙板帧

填入工程目录,选择上传所用的视频文件:注意对目录命名的要求-不能有中文等

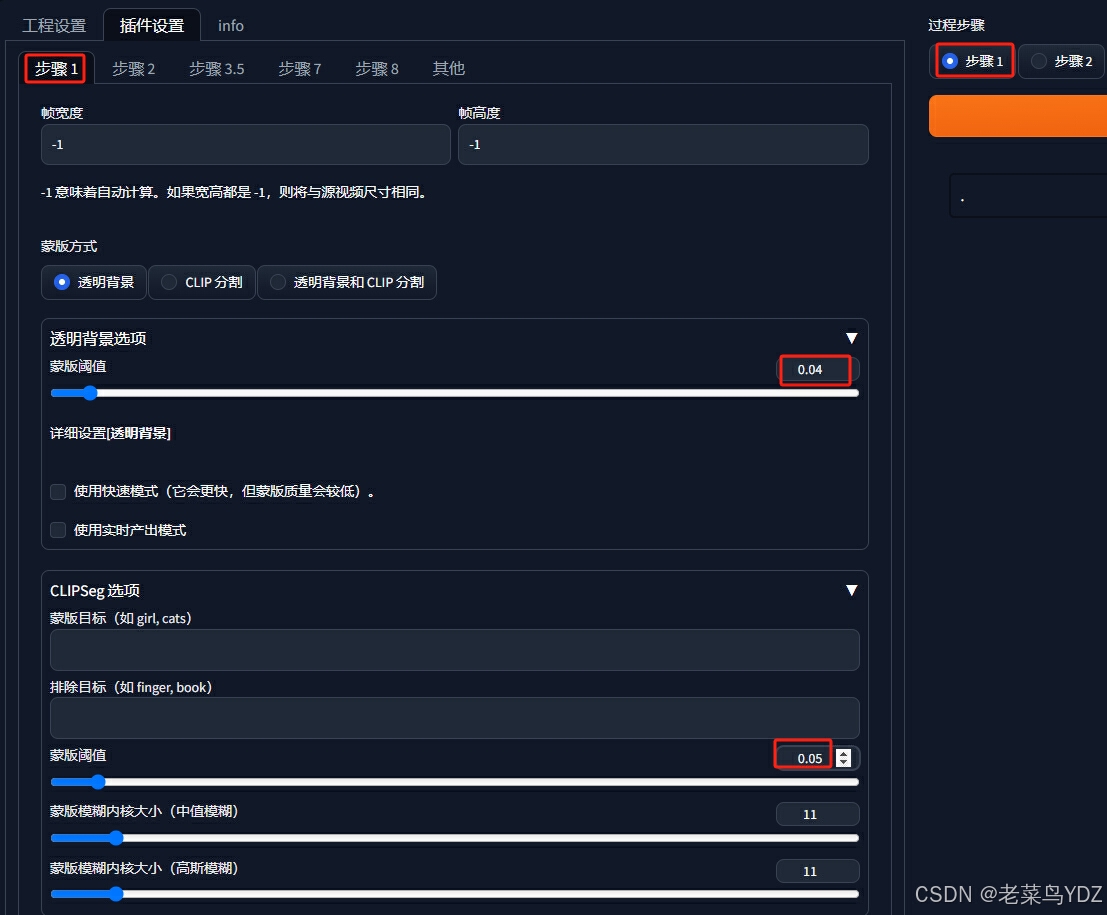

设置步骤1的参数:主要修改了0.04和0.05,其他参数默认就可以了。蒙版方式主要用于处理背景闪烁的问题,如果视频闪烁比较厉害,可以把透明背景选项的值调高一些,一般在 0.1 以下,大家多试几次就行。

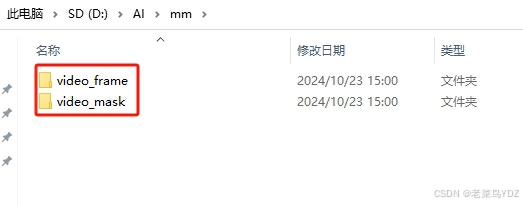

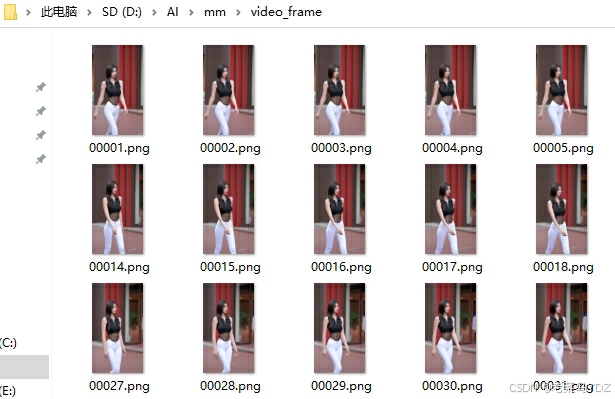

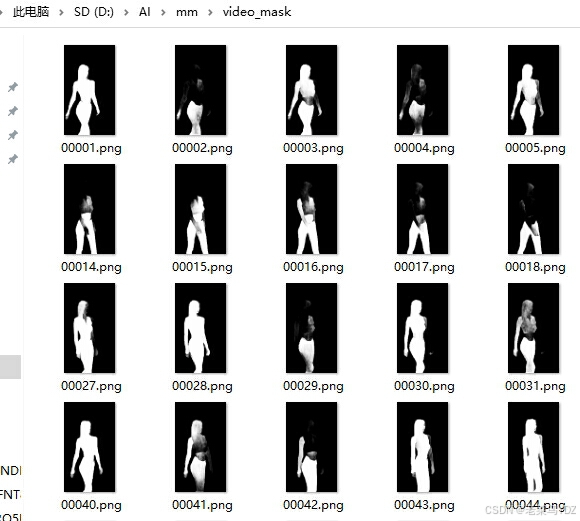

选中步骤1,点生成,就会在工程目录下会自动增加两个文件夹,其中video_framek 中是分解出来的所有帧,video_mask中是蒙板帧。

2、步骤2:抽取关键帧

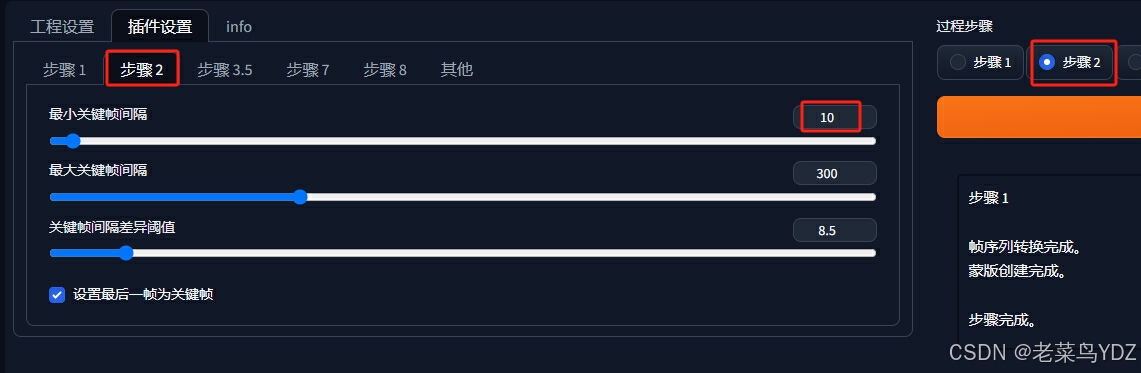

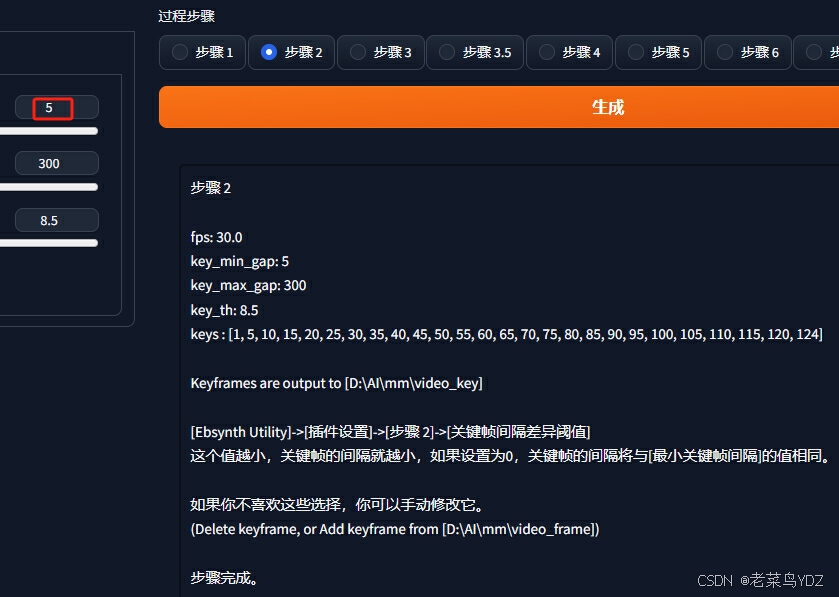

点击"步骤2"标签,设置"最小关键帧间隔",5或10。注意提取出变化较大的图片作为关键帧,可以通过设置关键帧的间隔来控制。间隔越小,关键帧越多,视频越流畅,但是渲染时间更长。如果有关键帧不合适,还可以从 video_frame 文件夹里选择关键帧进行替换。

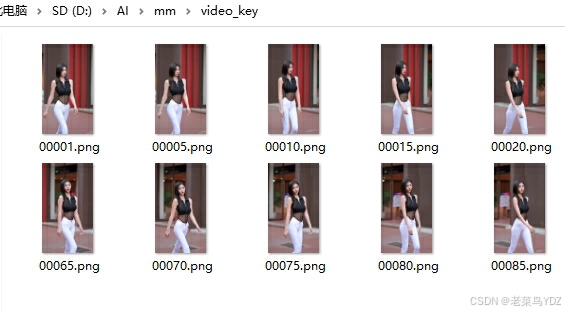

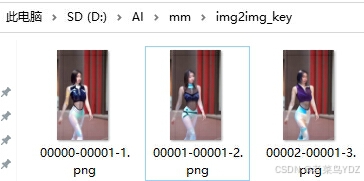

勾选右边的步骤2,点生成,产生的关键帧自动放在video_key文件夹中:

注意关键帧间隔

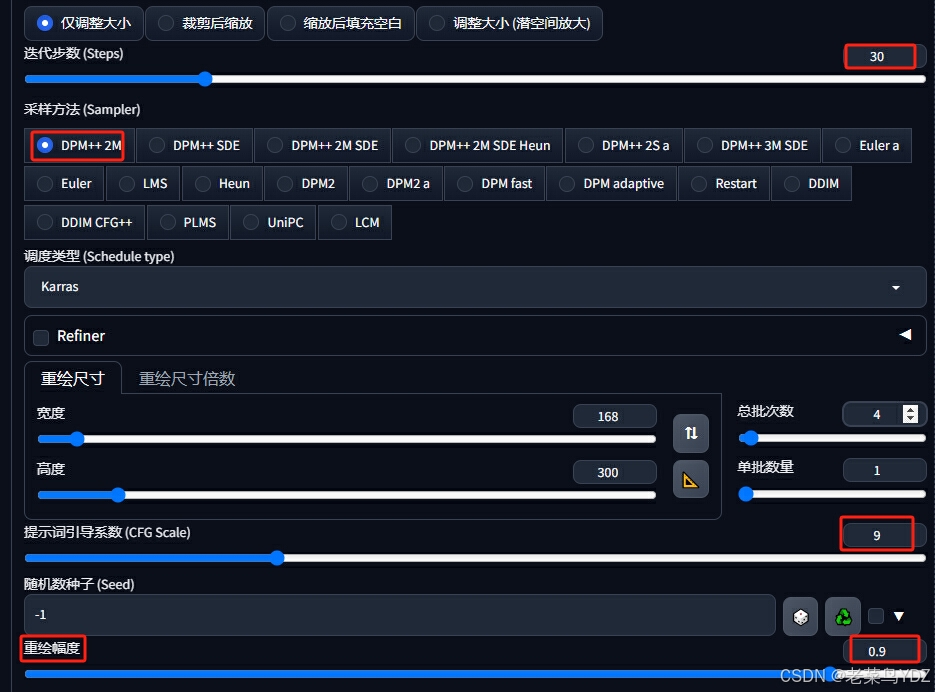

3、步骤3:关键帧重绘

进入图生图界面,导入一张关键帧,写入你所需要的提示词,调整大模型、采样方法等参数。注意点击黄色三角匹配图像大小;重绘幅度0.9才能与原作有区别;总批次可多些,根据效果选定某一张的Seed填入随机数种子处,确保各帧画面人物的一致性。

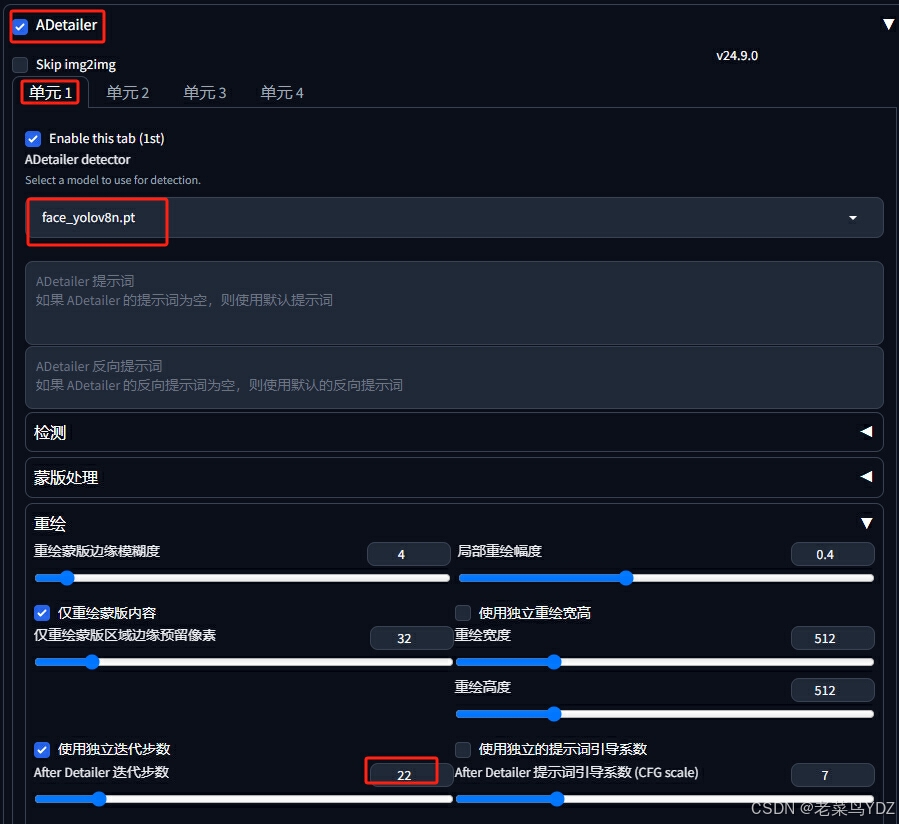

启用ADetiler:

设置controlNet参数:控制类型可能要根据你的视频来确定。

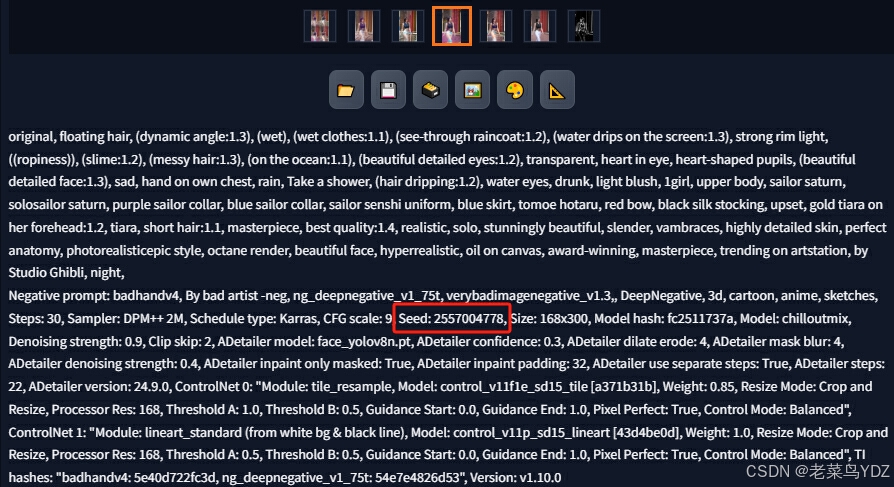

选择出图效果较好的那张,找到其Seed(如我这次是2557004778)填入随机数种子处,并点击后面绿色按钮来固定随机数种子。

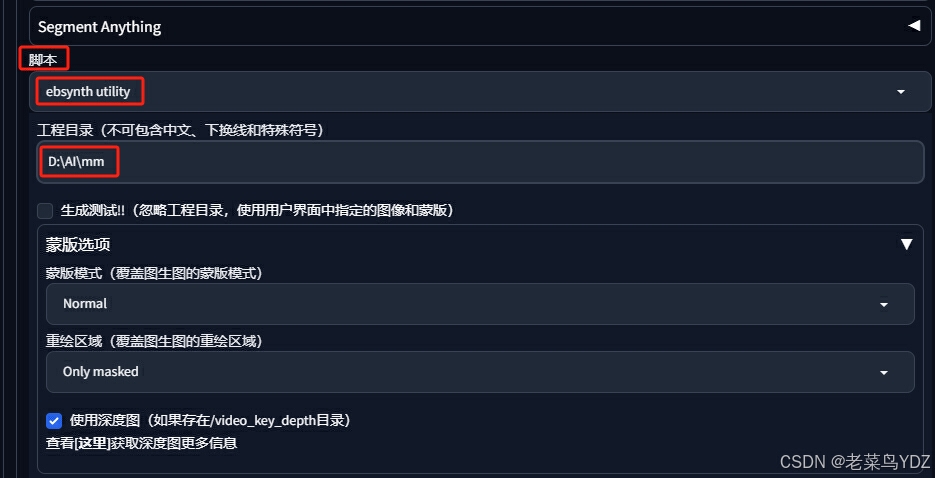

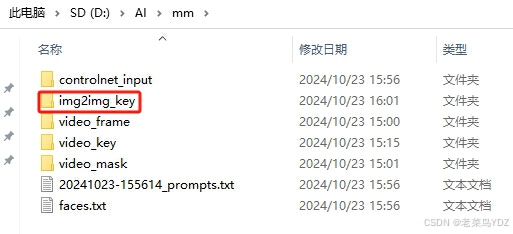

确定好大模型、提示词、各参数,尤其是Seed数后,选择"批量处理",输入目录选择关键帧目录vodeo_key,输出目录选择D:\AI\mm\img2img_key,其他保留默认就好。注意奖总批次改回1.

回到面板底部,在脚本选择框中选择ebsynth utility(选择脚本后,应不能选批量处理,否则会重复重绘,导致最后出错。),并填入工程目录D:\AI\mm(和以前填的一样),点生成按钮。注意蒙板选项的处理。如需要重绘背景,可选择关掉蒙板选项。激活两个contrlNet,其权重可能要选0.5为宜。

程序自动在工程目录中生成img2img_key目录及其中的重绘图像。这是最费时的一步,重绘时间视你电脑配置而定。

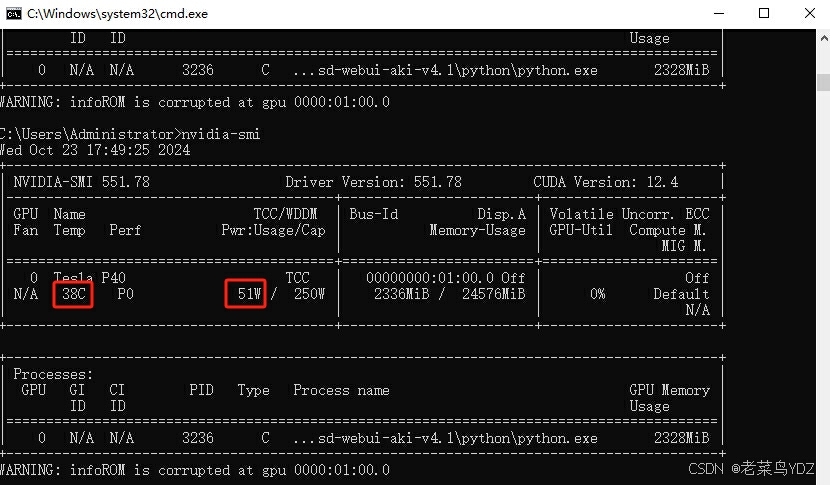

虽然此时电脑需要运行很长时间,但好像并未全速工作,显存才用了十分之一,显卡功率不大,温度也不高。不用像开两个LORA那样要开暴力风扇。

步骤 3.5 主要是对图生图的结果进行颜色校正,一般不需要,我们可以直接跳过。

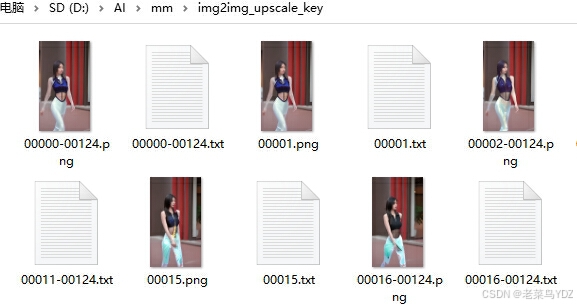

4、步骤4:图像放大(是否要同步放大蒙板文件?)

如原视频像素太低,可对关键帧目录中的图像批量进行放大处理,增加生成视频前图片的像素;如不需改变视频像素大小,只想初步变得更清晰或改变视频画面风格,也可进入到"后期处理"当中,对刚才生成的图片进行批量处理。填入输入目录(D:\AI\mm\img2img_key)和输出目录(D:\AI\mm\img2img_upscale_key),放大倍数,放大算法(如可选对应二次元的)。

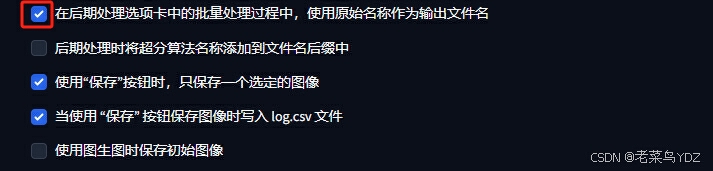

注意图像保存设置是否有问题。点击"设置"选项,进入"图像保存",勾选"在后期处理选项卡中的批量处理过程中,使用原始名称作为输出文件名"。

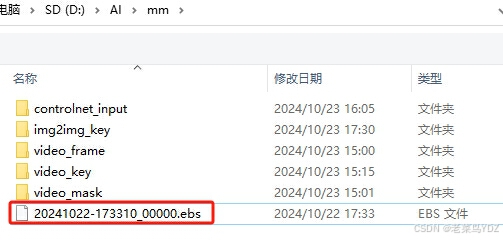

5、步骤5:生成 .ebs 文件(Ebsynth 工程文件)

工程目录下就会生成关于关键帧的ebs文件,这个文件数量是根据视频的长短来定的,短的可能只有一个,长的可能有N多个。

需要注意的是:如果你跳过了步骤4,步骤5应该会提示出错。因为步骤5只会去img2img_upscale_key中找图像文件,而这个文件夹是经过步骤4才产生的。因此,当你跳过步骤4时,应将img2img_key改名为img2img_upscale_key,以骗过程序。

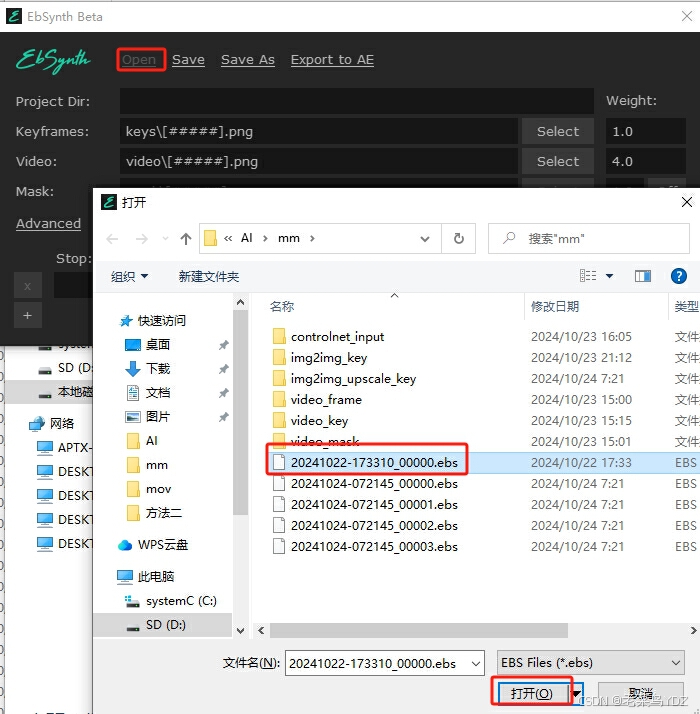

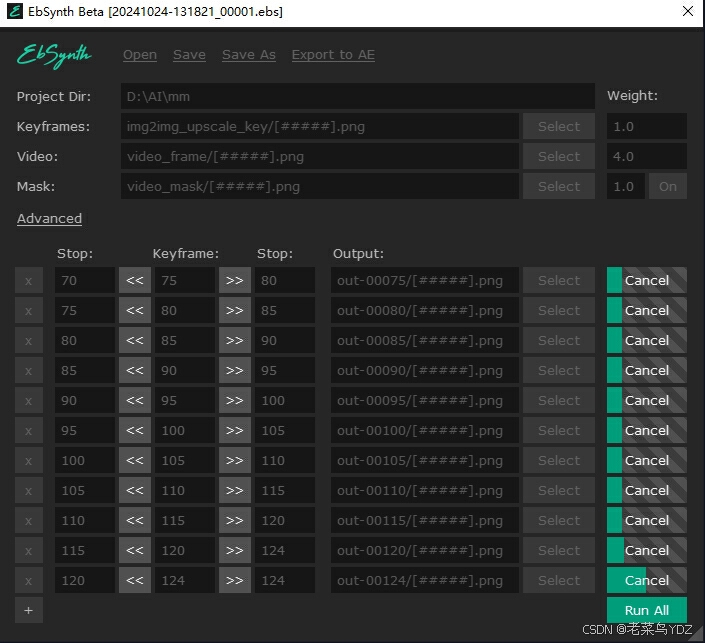

6、步骤6:绘制过渡帧(补帧)

运行Ebsynth文件,逐一打开工程目录下步骤5生成的ebs文件,然后按 [Run All] 按钮。待全部变绿后,补帧完成。工程目录下会出现很多补帧文件夹。

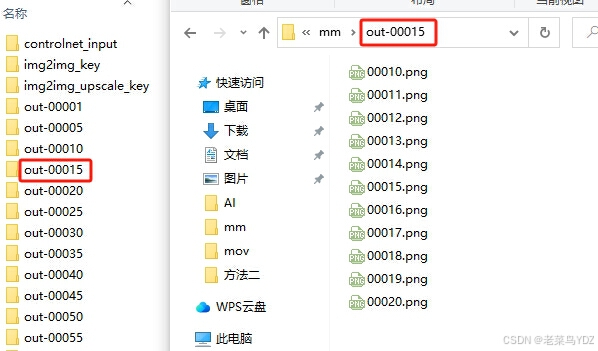

如果out-*目录已经存在于工程目录中,请在执行前手动删除它。如果生成了多个 .ebs 文件,则需要逐个运行。运行完成后文件夹如下图:

其中某个文件夹中的文件包含了从前个文件夹编号开始直到后一个文件夹编号的图像,如15号文件夹中包含了10-20的所有图像文件,在我看来总图像文件会有很多重复。也许设计者如此设计自有原因。

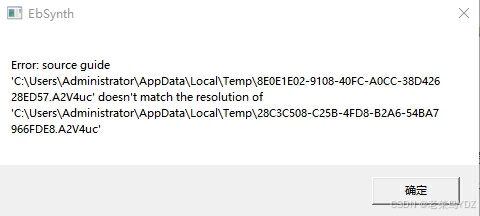

有时会出现错误提示:

翻译过来就是:

错误。来源指南

C: \用户\管理员AppData\LocalTemp\8E0E1E02-9108-40FC-A0CC-38D42628ED57.A2V4uc"与C:用户\管理员AppSata\LocalTemp\28C3C508-C25B-4FD8-B2A6-54BA7966FDE8.A2V4uc的分辨率不匹配"

应是关键帧放大了,而原分帧图像和蒙板文件分辨率没变,程序在读取video_frame和video_key文件夹中文件时,分辨率不匹配从而导致错误。因此,如因原视频分辨率太低,在步骤4经过放大图像了的,应同时将原分帧图像(video_frame中的文件)和蒙板文件(video_key)也同步放大。最好是在第一步分帧及蒙板后就放大处理(注意保持文件夹默认名称video_frame和video_key不变),不然步骤4的放大,图像脸部画面惨不忍睹。

7、勾选步骤7,选择输出格式,点击生成,开始合成视频。

据说原视频如有声音,会分别生成有声音和无声音的两个视频文件。

8、步骤 8 的功能是替换视频背景,有需要的小伙伴可以试试。

极域电子教室座位表程序下载链接:链接:https://pan.baidu.com/s/1X0WUTtXmr1EhFg9CNgoIKA?pwd=odvs

提取码:odvs

考试指令系统下载链接:https://pan.baidu.com/s/11x9fS1gUEPCd6w15KHCxSw?pwd=zvw3

提取码:zvw3

照片插入电子表格程序链接:https://pan.baidu.com/s/1dvW5q9G53prkUDVcO6uffA?pwd=w3jp

提取码:w3jp