改进yolo11-CA-HSFPN等200+全套创新点大全:护目镜佩戴与否检测系统源码&数据集全套

1.图片效果展示

项目来源 人工智能促进会 2024.10.28

注意:由于项目一直在更新迭代,上面"1.图片效果展示"和"2.视频效果展示"展示的系统图片或者视频可能为老版本,新版本在老版本的基础上升级如下:(实际效果以升级的新版本为准)

(1)适配了YOLOV11的"目标检测"模型和"实例分割"模型,通过加载相应的权重(.pt)文件即可自适应加载模型。

(2)支持"图片识别"、"视频识别"、"摄像头实时识别"三种识别模式。

(3)支持"图片识别"、"视频识别"、"摄像头实时识别"三种识别结果保存导出,解决手动导出(容易卡顿出现爆内存)存在的问题,识别完自动保存结果并导出到tempDir中。

(4)支持Web前端系统中的标题、背景图等自定义修改。

另外本项目提供训练的数据集和训练教程,暂不提供权重文件(best.pt),需要您按照教程进行训练后实现图片演示和Web前端界面演示的效果。

2.视频效果展示

3.背景

研究背景与意义

随着工业化进程的加快和科技的不断发展,安全生产问题日益受到重视。特别是在一些高风险行业,如建筑、制造和化学等领域,佩戴护目镜等个人防护装备(PPE)已成为保障工人安全的重要措施。然而,尽管相关法规和标准日益完善,护目镜的佩戴率仍然不尽如人意,导致工伤事故频发。因此,开发一种高效、智能的护目镜佩戴检测系统显得尤为重要。

本研究旨在基于改进的YOLOv11模型,构建一个高效的护目镜佩戴与否检测系统。YOLO(You Only Look Once)系列模型因其高效的实时目标检测能力而广泛应用于各类视觉识别任务。通过对YOLOv11进行改进,我们期望在保持其高速度的同时,提升对护目镜佩戴状态的检测精度。为此,我们将利用一个包含6300张图像的数据集,该数据集分为三类:佩戴护目镜(Goggles)、未佩戴护目镜(NO-Goggles)以及其他类别。这一数据集的构建为模型的训练和验证提供了丰富的样本,有助于提高模型的泛化能力。

通过实现护目镜佩戴状态的自动检测,不仅可以有效降低人工监测的成本和误差,还能实时监控工人的安全状态,及时发出警报,防止潜在的安全隐患。此外,该系统的应用还可以为企业提供数据支持,帮助其制定更为科学的安全管理措施,从而进一步提升整体安全生产水平。综上所述,本研究不仅具有重要的理论意义,也具备广泛的实际应用价值。

4.数据集信息展示

4.1 本项目数据集详细数据(类别数&类别名)

nc: 2

names: ['Goggles', 'NO-Goggles']

该项目为【目标检测】数据集,请在【训练教程和Web端加载模型教程(第三步)】这一步的时候按照【目标检测】部分的教程来训练

4.2 本项目数据集信息介绍

本项目数据集信息介绍

本项目所使用的数据集名为"Eye Protection",旨在为改进YOLOv11的护目镜佩戴与否检测系统提供强有力的支持。该数据集包含两类主要目标,分别为"Goggles"和"NO-Goggles",共计两个类别。通过对这两个类别的精确标注和分类,数据集为模型的训练和评估提供了丰富的样本,使其能够有效识别佩戴护目镜的人员与未佩戴护目镜的人员。

"Eye Protection"数据集的构建过程中,特别注重样本的多样性和代表性,确保数据集能够涵盖不同环境、光照条件以及佩戴者的多样性。这种多样性不仅有助于提高模型的泛化能力,还能增强其在实际应用中的适应性。数据集中包含的图像均经过精心挑选,确保每个类别的样本数量相对均衡,以避免模型在训练过程中出现偏倚。

此外,数据集还包括详细的标注信息,标注不仅涵盖了目标的类别,还包括目标在图像中的位置。这些信息对于YOLOv11模型的训练至关重要,能够帮助模型学习到不同类别目标的特征和空间分布。通过使用"Eye Protection"数据集,研究团队希望能够提升护目镜佩戴检测系统的准确性和效率,从而在实际应用中更好地保障人员的安全。

综上所述,"Eye Protection"数据集为本项目提供了坚实的数据基础,通过对护目镜佩戴与否的精准检测,旨在推动安全防护领域的技术进步,确保在各种工作环境中,工作人员能够得到有效的保护。

5.全套项目环境部署视频教程(零基础手把手教学)

5.1 所需软件PyCharm和Anaconda安装教程(第一步)

5.2 安装Python虚拟环境创建和依赖库安装视频教程(第二步)

6.改进YOLOv11训练教程和Web_UI前端加载模型教程(零基础手把手教学)

6.1 改进YOLOv11训练教程和Web_UI前端加载模型教程(第三步)

按照上面的训练视频教程链接加载项目提供的数据集,运行train.py即可开始训练

Epoch gpu_mem box obj cls labels img_size

1/200 20.8G 0.01576 0.01955 0.007536 22 1280: 100%|██████████| 849/849 [14:42<00:00, 1.04s/it]

Class Images Labels P R mAP@.5 mAP@.5:.95: 100%|██████████| 213/213 [01:14<00:00, 2.87it/s]

all 3395 17314 0.994 0.957 0.0957 0.0843

Epoch gpu_mem box obj cls labels img_size

2/200 20.8G 0.01578 0.01923 0.007006 22 1280: 100%|██████████| 849/849 [14:44<00:00, 1.04s/it]

Class Images Labels P R mAP@.5 mAP@.5:.95: 100%|██████████| 213/213 [01:12<00:00, 2.95it/s]

all 3395 17314 0.996 0.956 0.0957 0.0845

Epoch gpu_mem box obj cls labels img_size

3/200 20.8G 0.01561 0.0191 0.006895 27 1280: 100%|██████████| 849/849 [10:56<00:00, 1.29it/s]

Class Images Labels P R mAP@.5 mAP@.5:.95: 100%|███████ | 187/213 [00:52<00:00, 4.04it/s]

all 3395 17314 0.996 0.957 0.0957 0.0845项目数据集下载链接

7.原始YOLOv11算法讲解

其实到了YOLOV11 基本创新点就不太多了,主要就是大家互相排列组合复用不同的网络模块、损失函数和样本匹配策略,需要注意YOLO V5、V8 V11

都是1个公司的,其余的个人建议看看V8的,剩下的了解就好。

V11支持多种视觉任务:物体检测、实例分割、图像分类、姿态估计和定向物体检测(OBB)。

YOLOv11

基本和YOLOV8同源,甚至git目前都是1个,部分代码注释还是YOLOV8的,所以建议先看我写的YOLOV8相关博客,对比YOLOV8主要涉及到:

*backbone 中的使用C2f模块 变为 c3k2 模块。

*backbone 中的最后一层(sppf层)后增加了C2PSA模块。

*head 解耦头中的分类检测头两个Conv 变为 DWConv。

整体技术而言:

*backbone 使用了C2K2模块+最后SPPF模块级联C2PSA模块;

*neck 使用PAN结构,并且里面也使用C3K2模块;

*head使用了anchor-free + Decoupled-head,其中回归头使用正常的卷积,分类头使用DWConv;

*损失函数使用了分类BCE、回归CIOU + VFL的组合;

*框匹配策略由静态匹配改为了Task-Aligned Assigner匹配方式;

*训练策略没有提及,其中YOLOV8可以参考如下最后 10 个 epoch 关闭 Mosaic 的操作、训练总 epoch 数从 300 提升到了 500。

主要思路

配置文件:ultralytics/ultralytics/cfg/models/11/yolo11.yaml at main ·

ultralytics/ultralytics ·

GitHub

解析函数:ultralytics/ultralytics/nn/tasks.py at main · ultralytics/ultralytics ·

GitHub

具体细节

input

输入要求以及预处理,可选项比较多,可以参考这个配置文件:ultralytics/ultralytics/cfg/default.yaml at main

· ultralytics/ultralytics ·

GitHub 的Hyperparameters 部分。

基础输入仍然为640*640。预处理就是熟悉的letterbox(根据参数配置可以为不同的缩放填充模式,主要用于resize到640)+

转换rgb、chw、int8(0-255)->float(0-1),注意没有归一化操作。需要注意的是作者实现的mosaic和网上看到的不同,对比如下图(左边网上版本,右边是YOLO的实现)。并且作者添加了在最后10轮关闭mosaic增强(YOLOV8开始支持,具体原因个人的经验如我的这篇文章:yolov5

mosaic相关,关闭参数在 Train settings 部分的close_mosaic 选项)

backbone

主干网络以及改进

这里不去特意强调对比YOLOv5、V8等等的改进,因为各个系列都在疯狂演进,个人认为没必要花费时间看差异,着重看看一些比较重要的模块即可。源代码:

大多数模块:ultralytics/ultralytics/nn/modules/block.py at main ·

ultralytics/ultralytics ·

GitHub

head 部分:ultralytics/ultralytics/nn/modules/head.py at main ·

ultralytics/ultralytics ·

GitHub

串联模块构造网络:ultralytics/ultralytics/nn/tasks.py at main ·

ultralytics/ultralytics ·

GitHub

1)CBS 模块(后面叫做Conv)

就是pytorch 自带的conv + BN +SiLU,这里对应上面的配置文件的Conv 的 args 比如[64, 3, 2] 就是 conv2d

的c2=64、k=3、 s =2、c1 自动为上一层参数、p 为自动计算,真实需要计算scales 里面的with 和 max_channels 缩放系数。

这里连续使用两个3*3卷积stride为2的CBS模块直接横竖各降低了4倍分辨率(整体变为原来1/16)。这个还是比较猛的,敢在如此小的感受野下连续两次仅仅用一层卷积就下采样,当然作为代价它的特征图还是比较厚的分别为16、32。

class Conv(nn.Module):

"""Standard convolution with args(ch_in, ch_out, kernel, stride, padding, groups, dilation, activation)."""

default_act = nn.SiLU() # default activation

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, d=1, act=True):

"""Initialize Conv layer with given arguments including activation."""

super().__init__()

self.conv = nn.Conv2d(c1, c2, k, s, autopad(k, p, d), groups=g, dilation=d, bias=False)

self.bn = nn.BatchNorm2d(c2)

self.act = self.default_act if act is True else act if isinstance(act, nn.Module) else nn.Identity()

def forward(self, x):

"""Apply convolution, batch normalization and activation to input tensor."""

return self.act(self.bn(self.conv(x)))

def forward_fuse(self, x):

"""Perform transposed convolution of 2D data."""

return self.act(self.conv(x))2)c3k2 模块

Bottleneck

有两种结构,需要参数shortcut和两个conv的宽度是否相同来控制。

C3 & C3K

都是CSP bottleneck module with 3 convolutions, C3 代表3个卷积层,

K代表其中bottleneck中的卷积核为支持自定义,其实这里c3k作者使用的默认的33卷积核也就等同于使用c3(c3是33卷积核)。

c2f & c3k2

其实也就是仿照YOLOv7 的ELAN

结构,通过更多的分支夸层链接,丰富了模型的梯度流。C3K2模块其实就是C2F模块转变出来的,它代码中有一个设置,就是当c3k这个参数为FALSE的时候,C3K2模块就是C2F模块,也就是说它的Bottleneck是普通的Bottleneck;反之当它为true的时候,将Bottleneck模块替换成C3K模块。模块中存在

Split 等操作对特定硬件部署没有之前那么友好了。需要针对自己的硬件进行测试看对最终推理速度的影响。

可视化关系如下,这里需要注意配置文件中的参数,比如21行[-1, 2, C3k2, [512, False, 0.25]]

512代表宽度、false代表是否使用shortcut、0.25代表c2f的宽度缩放。也就是第一个Conv的输出宽度。

源代码如下:

class Bottleneck(nn.Module):

"""Standard bottleneck."""

def __init__(self, c1, c2, shortcut=True, g=1, k=(3, 3), e=0.5):

"""Initializes a standard bottleneck module with optional shortcut connection and configurable parameters."""

super().__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, k[0], 1)

self.cv2 = Conv(c_, c2, k[1], 1, g=g)

self.add = shortcut and c1 == c2

def forward(self, x):

"""Applies the YOLO FPN to input data."""

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x))

class C3(nn.Module):

"""CSP Bottleneck with 3 convolutions."""

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5):

"""Initialize the CSP Bottleneck with given channels, number, shortcut, groups, and expansion values."""

super().__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

self.cv3 = Conv(2 * c_, c2, 1) # optional act=FReLU(c2)

self.m = nn.Sequential(*(Bottleneck(c_, c_, shortcut, g, k=((1, 1), (3, 3)), e=1.0) for _ in range(n)))

def forward(self, x):

"""Forward pass through the CSP bottleneck with 2 convolutions."""

return self.cv3(torch.cat((self.m(self.cv1(x)), self.cv2(x)), 1))

class C3k(C3):

"""C3k is a CSP bottleneck module with customizable kernel sizes for feature extraction in neural networks."""

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5, k=3):

"""Initializes the C3k module with specified channels, number of layers, and configurations."""

super().__init__(c1, c2, n, shortcut, g, e)

c_ = int(c2 * e) # hidden channels

# self.m = nn.Sequential(*(RepBottleneck(c_, c_, shortcut, g, k=(k, k), e=1.0) for _ in range(n)))

self.m = nn.Sequential(*(Bottleneck(c_, c_, shortcut, g, k=(k, k), e=1.0) for _ in range(n)))

class C2f(nn.Module):

"""Faster Implementation of CSP Bottleneck with 2 convolutions."""

def __init__(self, c1, c2, n=1, shortcut=False, g=1, e=0.5):

"""Initializes a CSP bottleneck with 2 convolutions and n Bottleneck blocks for faster processing."""

super().__init__()

self.c = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, 2 * self.c, 1, 1)

self.cv2 = Conv((2 + n) * self.c, c2, 1) # optional act=FReLU(c2)

self.m = nn.ModuleList(Bottleneck(self.c, self.c, shortcut, g, k=((3, 3), (3, 3)), e=1.0) for _ in range(n))

def forward(self, x):

"""Forward pass through C2f layer."""

y = list(self.cv1(x).chunk(2, 1))

y.extend(m(y[-1]) for m in self.m)

return self.cv2(torch.cat(y, 1))

def forward_split(self, x):

"""Forward pass using split() instead of chunk()."""

y = list(self.cv1(x).split((self.c, self.c), 1))

y.extend(m(y[-1]) for m in self.m)

return self.cv2(torch.cat(y, 1))

class C3k2(C2f):

"""Faster Implementation of CSP Bottleneck with 2 convolutions."""

def __init__(self, c1, c2, n=1, c3k=False, e=0.5, g=1, shortcut=True):

"""Initializes the C3k2 module, a faster CSP Bottleneck with 2 convolutions and optional C3k blocks."""

super().__init__(c1, c2, n, shortcut, g, e)

self.m = nn.ModuleList(

C3k(self.c, self.c, 2, shortcut, g) if c3k else Bottleneck(self.c, self.c, shortcut, g) for _ in range(n)

)3)sppf 模块

对比spp,将简单的并行max pooling 改为串行+并行的方式。对比如下(左边是SPP,右边是SPPF):

class SPPF(nn.Module):

# Spatial Pyramid Pooling - Fast (SPPF) layer for YOLOv5 by Glenn Jocher

def __init__(self, c1, c2, k=5): # equivalent to SPP(k=(5, 9, 13))

super().__init__()

c_ = c1 // 2 # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c_ * 4, c2, 1, 1)

self.m = nn.MaxPool2d(kernel_size=k, stride=1, padding=k // 2)

def forward(self, x):

x = self.cv1(x)

with warnings.catch_warnings():

warnings.simplefilter('ignore') # suppress torch 1.9.0 max_pool2d() warning

y1 = self.m(x)

y2 = self.m(y1)

return self.cv2(torch.cat((x, y1, y2, self.m(y2)), 1))4)C2PSA 模块

C2PSA它结合了PSA(Pointwise Spatial

Attention)块,用于增强特征提取和注意力机制。下面的图建议从左到右看,这样才能更有条理的理解,其实PSA个人感觉就是仿着VIT

的Attention来做的,是把输入C2PSA的特征图的hw 看做VIT 的path数(也可以理解为NLP中token 个数),特征图的channel

数看做VIT特征维度(CNN的宽度,或者理解为NLP中token

编码后的特征维度),然后计算出QKV(这里需要注意第四幅图的QKV是值,不是操作,所以标注成了圆角矩形,这里是为了大家好理解),这里的Attention其实是在h w维度计算空间Attention,个人感觉是强制给了全局感受野,并且并联了一个33的深度可分离卷积的单空间部分,就是仅在每一个特征图上进行3 3卷积,具体实现是通过pytorch

conv2d 的

group参数设置为特征图的通道数。特别的关于Conv的参数分别为:输入通道数、输出通道数、卷积核尺寸、pad尺寸、group数、是否有激活函数(默认silu)。图中的最后一幅省略了一些细节,可以参考源码。

注意区别C2fPSA,C2fPSA才是对 C2f 模块的扩展,通过在标准 C2f 模块中引入 PSA

块,C2fPSA实现了更强大的注意力机制,从而提高了模型对重要特征的捕捉能力。作者实现了该模块但最终没有使用。

涉及的源码:

class Attention(nn.Module):

"""

Attention module that performs self-attention on the input tensor.

Args:

dim (int): The input tensor dimension.

num_heads (int): The number of attention heads.

attn_ratio (float): The ratio of the attention key dimension to the head dimension.

Attributes:

num_heads (int): The number of attention heads.

head_dim (int): The dimension of each attention head.

key_dim (int): The dimension of the attention key.

scale (float): The scaling factor for the attention scores.

qkv (Conv): Convolutional layer for computing the query, key, and value.

proj (Conv): Convolutional layer for projecting the attended values.

pe (Conv): Convolutional layer for positional encoding.

"""

def __init__(self, dim, num_heads=8, attn_ratio=0.5):

"""Initializes multi-head attention module with query, key, and value convolutions and positional encoding."""

super().__init__()

self.num_heads = num_heads

self.head_dim = dim // num_heads

self.key_dim = int(self.head_dim * attn_ratio)

self.scale = self.key_dim**-0.5

nh_kd = self.key_dim * num_heads

h = dim + nh_kd * 2

self.qkv = Conv(dim, h, 1, act=False)

self.proj = Conv(dim, dim, 1, act=False)

self.pe = Conv(dim, dim, 3, 1, g=dim, act=False)

def forward(self, x):

"""

Forward pass of the Attention module.

Args:

x (torch.Tensor): The input tensor.

Returns:

(torch.Tensor): The output tensor after self-attention.

"""

B, C, H, W = x.shape

N = H * W

qkv = self.qkv(x)

q, k, v = qkv.view(B, self.num_heads, self.key_dim * 2 + self.head_dim, N).split(

[self.key_dim, self.key_dim, self.head_dim], dim=2

)

attn = (q.transpose(-2, -1) @ k) * self.scale

attn = attn.softmax(dim=-1)

x = (v @ attn.transpose(-2, -1)).view(B, C, H, W) + self.pe(v.reshape(B, C, H, W))

x = self.proj(x)

return x

class PSABlock(nn.Module):

"""

PSABlock class implementing a Position-Sensitive Attention block for neural networks.

This class encapsulates the functionality for applying multi-head attention and feed-forward neural network layers

with optional shortcut connections.

Attributes:

attn (Attention): Multi-head attention module.

ffn (nn.Sequential): Feed-forward neural network module.

add (bool): Flag indicating whether to add shortcut connections.

Methods:

forward: Performs a forward pass through the PSABlock, applying attention and feed-forward layers.

Examples:

Create a PSABlock and perform a forward pass

>>> psablock = PSABlock(c=128, attn_ratio=0.5, num_heads=4, shortcut=True)

>>> input_tensor = torch.randn(1, 128, 32, 32)

>>> output_tensor = psablock(input_tensor)

"""

def __init__(self, c, attn_ratio=0.5, num_heads=4, shortcut=True) -> None:

"""Initializes the PSABlock with attention and feed-forward layers for enhanced feature extraction."""

super().__init__()

self.attn = Attention(c, attn_ratio=attn_ratio, num_heads=num_heads)

self.ffn = nn.Sequential(Conv(c, c * 2, 1), Conv(c * 2, c, 1, act=False))

self.add = shortcut

def forward(self, x):

"""Executes a forward pass through PSABlock, applying attention and feed-forward layers to the input tensor."""

x = x + self.attn(x) if self.add else self.attn(x)

x = x + self.ffn(x) if self.add else self.ffn(x)

return x

class C2PSA(nn.Module):

"""

C2PSA module with attention mechanism for enhanced feature extraction and processing.

This module implements a convolutional block with attention mechanisms to enhance feature extraction and processing

capabilities. It includes a series of PSABlock modules for self-attention and feed-forward operations.

Attributes:

c (int): Number of hidden channels.

cv1 (Conv): 1x1 convolution layer to reduce the number of input channels to 2*c.

cv2 (Conv): 1x1 convolution layer to reduce the number of output channels to c.

m (nn.Sequential): Sequential container of PSABlock modules for attention and feed-forward operations.

Methods:

forward: Performs a forward pass through the C2PSA module, applying attention and feed-forward operations.

Notes:

This module essentially is the same as PSA module, but refactored to allow stacking more PSABlock modules.

Examples:

>>> c2psa = C2PSA(c1=256, c2=256, n=3, e=0.5)

>>> input_tensor = torch.randn(1, 256, 64, 64)

>>> output_tensor = c2psa(input_tensor)

"""

def __init__(self, c1, c2, n=1, e=0.5):

"""Initializes the C2PSA module with specified input/output channels, number of layers, and expansion ratio."""

super().__init__()

assert c1 == c2

self.c = int(c1 * e)

self.cv1 = Conv(c1, 2 * self.c, 1, 1)

self.cv2 = Conv(2 * self.c, c1, 1)

self.m = nn.Sequential(*(PSABlock(self.c, attn_ratio=0.5, num_heads=self.c // 64) for _ in range(n)))

def forward(self, x):

"""Processes the input tensor 'x' through a series of PSA blocks and returns the transformed tensor."""

a, b = self.cv1(x).split((self.c, self.c), dim=1)

b = self.m(b)

return self.cv2(torch.cat((a, b), 1))3、neck & head

1)检测头

YOLOV11 Head 部分和YOLOV8是近似的,所以简单对比YOLOV5、V8、V11。

如上面图,上边是YOLOV5 的结构,中是YOLOv8 的结构,下面是YOLOV11 结构

Yolov5: 检测和分类共用一个卷积(coupled head)并且是anchor based ,其 卷积输出为(5+N class)*3,其中

5为bbox 四个值(具体代表什么不同版本略有不同,官方git有说明,历史版本见 目标检测算法------YOLOV5 )+ 一个obj 值

(是否有目标,这个是从YOLO V1 传承下来的,个人感觉有点绕和不合理,并且后面取消),N class 为类别数,3为anchor 的数量,默认是3个。

YOLOv8:检测和分类的卷积是解耦的(decoupled),如中图,上面一条卷积支路是回归框,框的特征图channel为4*regmax,关于这个regmax

后面我们详细的解释,并不是anchor;分类的channel 为类别数。

YOLOV11:检测和分类的卷积是解耦的(decoupled),如右图,上面一条卷积支路是回归框,框的特征图channel为4*regmax,关于这个regmax

后面我们详细的解释,并不是anchor;分类的channel 为类别数,分类使用深度可分离卷积替代常规卷积降低计算量。

源码部分如下

class Detect(nn.Module):

"""YOLO Detect head for detection models."""

dynamic = False # force grid reconstruction

export = False # export mode

end2end = False # end2end

max_det = 300 # max_det

shape = None

anchors = torch.empty(0) # init

strides = torch.empty(0) # init

def __init__(self, nc=80, ch=()):

"""Initializes the YOLO detection layer with specified number of classes and channels."""

super().__init__()

self.nc = nc # number of classes

self.nl = len(ch) # number of detection layers

self.reg_max = 16 # DFL channels (ch[0] // 16 to scale 4/8/12/16/20 for n/s/m/l/x)

self.no = nc + self.reg_max * 4 # number of outputs per anchor

self.stride = torch.zeros(self.nl) # strides computed during build

c2, c3 = max((16, ch[0] // 4, self.reg_max * 4)), max(ch[0], min(self.nc, 100)) # channels

self.cv2 = nn.ModuleList(

nn.Sequential(Conv(x, c2, 3), Conv(c2, c2, 3), nn.Conv2d(c2, 4 * self.reg_max, 1)) for x in ch

)

self.cv3 = nn.ModuleList(

nn.Sequential(

nn.Sequential(DWConv(x, x, 3), Conv(x, c3, 1)),

nn.Sequential(DWConv(c3, c3, 3), Conv(c3, c3, 1)),

nn.Conv2d(c3, self.nc, 1),

)

for x in ch

)

self.dfl = DFL(self.reg_max) if self.reg_max > 1 else nn.Identity()

if self.end2end:

self.one2one_cv2 = copy.deepcopy(self.cv2)

self.one2one_cv3 = copy.deepcopy(self.cv3)

def forward(self, x):

"""Concatenates and returns predicted bounding boxes and class probabilities."""

if self.end2end:

return self.forward_end2end(x)

for i in range(self.nl):

x[i] = torch.cat((self.cv2[i](x[i]), self.cv3[i](x[i])), 1)

if self.training: # Training path

return x

y = self._inference(x)

return y if self.export else (y, x)因此主要的变化可以认为有三个:(1)coupled head -> decoupled head ;(2)obj 分支消失;(3)anchor

based------> anchor free ; 4) 深度可分离卷积。

(1)coupled head -> decoupled head

这个解耦操作,看YOLO x 的论文,约有1% 的提升。逻辑和实现都比较直观易懂,不再赘述。

(2)obj 分支消失;

这个其实我自己再看YOLO V1 的时候就有疑问,它存在的意义。后来人们发现,其实obj

的在训练和推理过程中存在逻辑不一致性。具体而言(摘自"https://zhuanlan.zhihu.com/p/147691786")

A。用法不一致。训练的时候,分类和质量估计各自训练自个儿的,但测试的时候却又是乘在一起作为NMS score排序的依据,这个操作显然没有end-to-

end,必然存在一定的gap。(个人认为还好,就是两个监督信号)

B。对象不一致。借助Focal

Loss的力量,分类分支能够使得少量的正样本和大量的负样本一起成功训练,但是质量估计通常就只针对正样本训练。那么,对于one-

stage的检测器而言,在做NMS

score排序的时候,所有的样本都会将分类score和质量预测score相乘用于排序,那么必然会存在一部分分数较低的"负样本"的质量预测是没有在训练过程中有监督信号的,对于大量可能的负样本,他们的质量预测是一个未定义行为。这就很有可能引发这么一个情况:一个分类score相对低的真正的负样本,由于预测了一个不可信的极高的质量score,而导致它可能排到一个真正的正样本(分类score不够高且质量score相对低)的前面。问题一如图所示:

(3)anchor based------> anchor free

这里主要涉及怎么定义回归内容以及如何匹配GT框的问题。也就是如下:

2)匹配策略

A。回归的内容当前版本就是回归的lftp四个值(这四个值是距离匹配到的anchor 点的距离值!不是图片的绝对位置)。后面推理阶段通过

dist2bbox函数转换为需要的格式:

def dist2bbox(distance, anchor_points, xywh=True, dim=-1):

"""Transform distance(ltrb) to box(xywh or xyxy)."""

lt, rb = torch.split(distance, 2, dim)

x1y1 = anchor_points - lt

x2y2 = anchor_points + rb

if xywh:

c_xy = (x1y1 + x2y2) / 2

wh = x2y2 - x1y1

return torch.cat((c_xy, wh), dim) # xywh bbox

return torch.cat((x1y1, x2y2), dim) # xyxy bboxB.匹配策略

YOLOv5 采用静态的匹配策略,V8采用了动态的TaskAlignedAssigner,其余常见的动态匹配还有: YOLOX 的 simOTA、TOOD

的 TaskAlignedAssigner 和 RTMDet 的 DynamicSoftLabelAssigner。

TaskAligned使用分类得分和IoU的高阶组合来衡量Task-Alignment的程度。使用上面公式来对每个实例计算Anchor-level

的对齐程度:s 和 u 分别为分类得分和 IoU 值,α 和 β 为权重超参。t 可以同时控制分类得分和IoU 的优化来实现 Task-

Alignment,可以引导网络动态的关注于高质量的Anchor。采用一种简单的分配规则选择训练样本:对每个实例,选择m个具有最大t值的Anchor作为正样本,选择其余的Anchor作为负样本。然后,通过损失函数(针对分类与定位的对齐而设计的损失函数)进行训练。

默认参数如下(当前版本这些超参没有提供修改的接口,如需修改需要在源码上进行修改):

4、loss function

损失函数设计

Loss 计算包括 2 个分支: 分类和回归分支,没有了之前的 objectness 分支。

分类分支依然采用 BCE Loss。回归分支使用了 Distribution Focal Loss(DFL Reg_max默认为16)+ CIoU

Loss。3 个 Loss

采用一定权重比例加权即可(默认如下:https://github.com/ultralytics/ultralytics/blob/main/ultralytics/yolo/configs/default.yaml#L83)。

这里重点介绍一下DFL损失。目前被广泛使用的bbox表示可以看作是对bbox方框坐标建模了单一的狄拉克分布。但是在复杂场景中,一些检测对象的边界并非十分明确。如下图左面所示,对于滑板左侧被水花模糊,引起对左边界的预测分布是任意而扁平的,对右边界的预测分布是明确而尖锐的。对于这个问题,有学者提出直接回归一个任意分布来建模边界框,使用softmax实现离散的回归,将狄拉克分布的积分形式推导到一般形式的积分形式来表示边界框。

狄拉克分布可以认为在一个点概率密度为无穷大,其他点概率密度为0,这是一种极端地认为离散的标签时绝对正确的。

因为标签是一个离散的点,如果把标签认为是绝对正确的目标,那么学习出的就是狄拉克分布,概率密度是一条尖锐的竖线。然而真实场景,物体边界并非是十分明确的,因此学习一个宽范围的分布更为合理。我们需要获得的分布虽然不再像狄拉克分布那么极端(只存在标签值),但也应该在标签值附近。因此学者提出Distribution

Focal

Loss损失函数,目的让网络快速聚焦到标签附近的数值,是标签处的概率密度尽量大。思想是使用交叉熵函数,来优化标签y附近左右两个位置的概率,是网络分布聚焦到标签值附近。如下公式。Si

是网络的sigmod 输出(因为真是是多分类,所以是softmax),yi 和 yi+1 是上图的区间顺序,y是label

值。

具体而言,针对我们将DFL的超参数Reg_max 设置为16的情况下:

A。训练阶段:我们以回归left为例:目标的label 转换为ltrb后,y = ( left - 匹配到的anchor 中心点 x 坐标)/

当前的下采样倍数,假设求得3.2。那么i 就应该为3,yi = 3 ,yi+1 = 4。

B。推理阶段:因为没有label,直接将16个格子进行积分(离散变量为求和,也就是期望)结果就是最终的坐标偏移量(再乘以下采样倍数+

匹配到的anchor的对应坐标)

DFL的实现方式其实就是一个卷积:ultralytics/ultralytics/nn/modules.py at

cc3c774bde86ffce694d202b7383da6cc1721c1b · ultralytics/ultralytics ·

GitHub

NOTE:作者代码中的超参数Reg_max是写死的------16,并且代码内部做了强制截断到16,如果要修改需要修改源码,如果你的输入是640,最大下采样到2020,那么16是够用的,如果输入没有resize或者超过了640一定要自己设置这个Reg_max参数,否则如果目标尺寸还大,将无法拟合到这个偏移量。

比如1280 1280的图片,目标1280*960,最大下采样32倍,1280/32/2=20 > 16(除以2是因为是一半的偏移量),超过了dfl

滑板右侧那个图的范围。至于为什么叫focal

loss的变体,有兴趣看一下这个https://zhuanlan.zhihu.com/p/357415257和https://zhuanlan.zhihu.com/p/147691786就可以,这里不再赘述是因为,如果先看这些,很容易犯晕,反而抓不住DFL

我认为的重点(离散的分布形式)

class DFL(nn.Module):

# Integral module of Distribution Focal Loss (DFL) proposed in Generalized Focal Loss https://ieeexplore.ieee.org/document/9792391

def __init__(self, c1=16):

super().__init__()

self.conv = nn.Conv2d(c1, 1, 1, bias=False).requires_grad_(False)

x = torch.arange(c1, dtype=torch.float)

self.conv.weight.data[:] = nn.Parameter(x.view(1, c1, 1, 1))

self.c1 = c1

def forward(self, x):

b, c, a = x.shape # batch, channels, anchors

return self.conv(x.view(b, 4, self.c1, a).transpose(2, 1).softmax(1)).view(b, 4, a)

# return self.conv(x.view(b, self.c1, 4, a).softmax(1)).view(b, 4, a)8.200+种全套改进YOLOV11创新点原理讲解

8.1 200+种全套改进YOLOV11创新点原理讲解大全

由于篇幅限制,每个创新点的具体原理讲解就不全部展开,具体见下列网址中的改进模块对应项目的技术原理博客网址【Blog】(创新点均为模块化搭建,原理适配YOLOv5~YOLOv11等各种版本)

8.2 精选部分改进YOLOV11创新点原理讲解

这里节选部分改进创新点展开原理讲解(完整的改进原理见上图和改进模块技术原理博客链接【如果此小节的图加载失败可以通过CSDN或者Github搜索该博客的标题访问原始博客,原始博客图片显示正常】

MS-Block简介

实时目标检测,以YOLO系列为例,已在工业领域中找到重要应用,特别是在边缘设备(如无人机和机器人)中。与之前的目标检测器不同,实时目标检测器旨在在速度和准确性之间追求最佳平衡。为了实现这一目标,提出了大量的工作:从第一代DarkNet到CSPNet,再到最近的扩展ELAN,随着性能的快速增长,实时目标检测器的架构经历了巨大的变化。

尽管性能令人印象深刻,但在不同尺度上识别对象仍然是实时目标检测器面临的基本挑战。这促使作者设计了一个强大的编码器架构,用于学习具有表现力的多尺度特征表示。具体而言,作者从两个新的角度考虑为实时目标检测编码多尺度特征:

从局部视角出发,作者设计了一个具有简单而有效的分层特征融合策略的MS-Block。受到Res2Net的启发,作者在MS-Block中引入了多个分支来进行特征提取,但不同的是,作者使用了一个带有深度卷积的 Inverted Bottleneck Block块,以实现对大Kernel的高效利用。

从全局视角出发,作者提出随着网络加深逐渐增加卷积的Kernel-Size。作者在浅层使用小Kernel卷积来更高效地处理高分辨率特征。另一方面,在深层中,作者采用大Kernel卷积来捕捉广泛的信息。

基于以上设计原则,作者呈现了作者的实时目标检测器,称为YOLO-MS。为了评估作者的YOLO-MS的性能,作者在MS COCO数据集上进行了全面的实验。还提供了与其他最先进方法的定量比较,以展示作者方法的强大性能。如图1所示,YOLO-MS在计算性能平衡方面优于其他近期的实时目标检测器。

具体而言,YOLO-MS-XS在MS COCO上获得了43%+的AP得分,仅具有450万个可学习参数和8.7亿个FLOPs。YOLO-MS-S和YOLO-MS分别获得了46%+和51%+的AP,可学习参数分别为810万和2220万。此外,作者的工作还可以作为其他YOLO模型的即插即用模块。通常情况下,作者的方法可以将YOLOv11的AP从37%+显著提高到40%+,甚至还可以使用更少的参数和FLOPs。

CSP Block是一个基于阶段级梯度路径的网络,平衡了梯度组合和计算成本。它是广泛应用于YOLO系列的基本构建块。已经提出了几种变体,包括YOLOv4和YOLOv11中的原始版本,Scaled YOLOv4中的CSPVoVNet,YOLOv11中的ELAN,以及RTMDet中提出的大Kernel单元。作者在图2(a)和图2(b)中分别展示了原始CSP块和ELAN的结构。

上述实时检测器中被忽视的一个关键方面是如何在基本构建块中编码多尺度特征。其中一个强大的设计原则是Res2Net,它聚合了来自不同层次的特征以增强多尺度表示。然而,这一原则并没有充分探索大Kernel卷积的作用,而大Kernel卷积已经在基于CNN的视觉识别任务模型中证明有效。将大Kernel卷积纳入Res2Net的主要障碍在于它们引入的计算开销,因为构建块采用了标准卷积。在作者的方法中,作者提出用 Inverted Bottleneck Block替代标准的3 × 3卷积,以享受大Kernel卷积的好处。

MS-Block

基于前面的分析,参考该博客提出了一个带有分层特征融合策略的全新Block,称为MS-Block,以增强实时目标检测器在提取多尺度特征时的能力,同时保持快速的推理速度。

MS-Block的具体结构如图2©所示。假设是输入特征。通过1×1卷积的转换后,X的通道维度增加到n*C。然后,作者将X分割成n个不同的组,表示为,其中。为了降低计算成本,作者选择n为3。

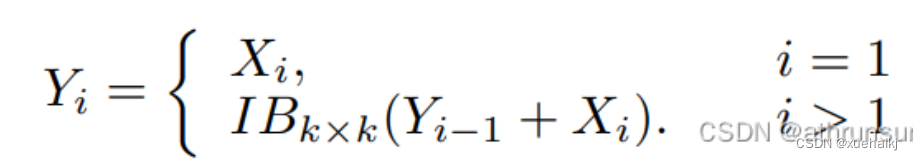

注意,除了之外,每个其他组都经过一个 Inverted Bottleneck Block层,用表示,其中k表示Kernel-Size,以获得。的数学表示如下:

根据这个公式,作者不将 Inverted Bottleneck Block层连接到,使其作为跨阶段连接,并保留来自前面层的信息。最后,作者将所有分割连接在一起,并应用1×1卷积来在所有分割之间进行交互,每个分割都编码不同尺度的特征。当网络加深时,这个1×1卷积也用于调整通道数。

Heterogeneous Kernel Selection Protocol

除了构建块的设计外,作者还从宏观角度探讨了卷积的使用。之前的实时目标检测器在不同的编码器阶段采用了同质卷积(即具有相同Kernel-Size的卷积),但作者认为这不是提取多尺度语义信息的最佳选项。

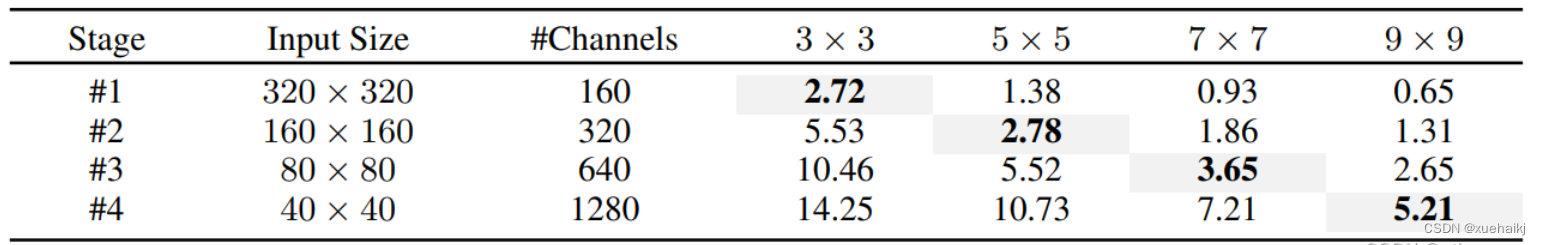

在金字塔结构中,从检测器的浅阶段提取的高分辨率特征通常用于捕捉细粒度语义,将用于检测小目标。相反,来自网络较深阶段的低分辨率特征用于捕捉高级语义,将用于检测大目标。如果作者在所有阶段都采用统一的小Kernel卷积,深阶段的有效感受野(ERF)将受到限制,影响大目标的性能。在每个阶段中引入大Kernel卷积可以帮助解决这个问题。然而,具有大的ERF的大Kernel可以编码更广泛的区域,这增加了在小目标外部包含噪声信息的概率,并且降低了推理速度。

在这项工作中,作者建议在不同阶段中采用异构卷积,以帮助捕获更丰富的多尺度特征。具体来说,在编码器的第一个阶段中,作者采用最小Kernel卷积,而最大Kernel卷积位于最后一个阶段。随后,作者逐步增加中间阶段的Kernel-Size,使其与特征分辨率的增加保持一致。这种策略允许提取细粒度和粗粒度的语义信息,增强了编码器的多尺度特征表示能力。

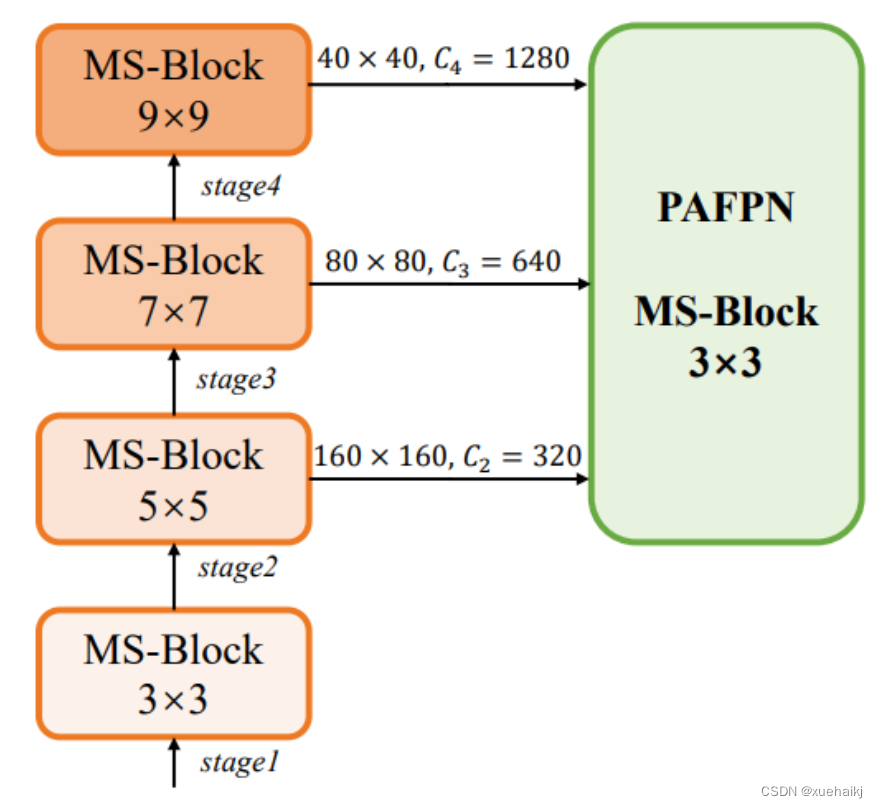

正如图所示,作者将k的值分别分配给编码器中的浅阶段到深阶段,取值为3、5、7和9。作者将其称为异构Kernel选择(HKS)协议。

作者的HKS协议能够在深层中扩大感受野,而不会对浅层产生任何其他影响。第4节的图4支持了作者的分析。此外,HKS不仅有助于编码更丰富的多尺度特征,还确保了高效的推理。

如表1所示,将大Kernel卷积应用于高分辨率特征会产生较高的计算开销。然而,作者的HKS协议在低分辨率特征上采用大Kernel卷积,从而与仅使用大Kernel卷积相比,大大降低了计算成本。

在实践中,作者经验性地发现,采用HKS协议的YOLO-MS的推理速度几乎与仅使用深度可分离的3 × 3卷积相同。

如图所示,作者模型的Backbone由4个阶段组成,每个阶段后面跟随1个步长为2的3 × 3卷积进行下采样。在第3个阶段后,作者添加了1个SPP块,与RTMDet中一样。在作者的编码器上,作者使用PAFPN作为Neck来构建特征金字塔[31, 35]。它融合了从Backbone不同阶段提取的多尺度特征。Neck中使用的基本构建块也是作者的MS-Block,在其中使用3 × 3深度可分离卷积进行快速推理。

此外,为了在速度和准确性之间取得更好的平衡,作者将Backbone中多级特征的通道深度减半。作者提供了3个不同尺度的YOLO-MS变体,即YOLO-MS-XS、YOLO-MS-S和YOLO-MS。不同尺度的YOLO-MS的详细配置列在表2中。对于YOLO-MS的其他部分,作者将其保持与RTMDet相同。

9.系统功能展示

图9.1.系统支持检测结果表格显示

图9.2.系统支持置信度和IOU阈值手动调节

图9.3.系统支持自定义加载权重文件best.pt(需要你通过步骤5中训练获得)

图9.4.系统支持摄像头实时识别

图9.5.系统支持图片识别

图9.6.系统支持视频识别

图9.7.系统支持识别结果文件自动保存

图9.8.系统支持Excel导出检测结果数据

10. YOLOv11核心改进源码讲解

10.1 ui.py

以下是对代码的核心部分进行提炼和详细注释的版本:

python

import sys

import subprocess

def run_script(script_path):

"""

使用当前 Python 环境运行指定的脚本。

Args:

script_path (str): 要运行的脚本路径

Returns:

None

"""

# 获取当前 Python 解释器的路径

python_path = sys.executable

# 构建运行命令,使用 streamlit 运行指定的脚本

command = f'"{python_path}" -m streamlit run "{script_path}"'

# 执行命令并等待其完成

result = subprocess.run(command, shell=True)

# 检查命令执行结果,如果返回码不为0,表示执行出错

if result.returncode != 0:

print("脚本运行出错。")

# 程序入口

if __name__ == "__main__":

# 指定要运行的脚本路径

script_path = "web.py" # 这里可以直接指定脚本名称,假设它在当前目录下

# 调用函数运行脚本

run_script(script_path)代码核心部分分析:

-

导入模块:

sys:用于获取当前 Python 解释器的路径。subprocess:用于执行外部命令。

-

run_script函数:- 该函数接收一个脚本路径作为参数,并在当前 Python 环境中运行该脚本。

- 使用

sys.executable获取当前 Python 解释器的路径,以确保脚本在正确的环境中运行。 - 构建一个命令字符串,使用

streamlit模块运行指定的脚本。 - 使用

subprocess.run执行命令,并通过shell=True允许在 shell 中执行命令。 - 检查命令的返回码,如果不为0,表示脚本运行出错,打印错误信息。

-

程序入口:

- 使用

if __name__ == "__main__":确保只有在直接运行该脚本时才会执行以下代码。 - 指定要运行的脚本路径,并调用

run_script函数来执行该脚本。

- 使用

这个程序文件 ui.py 的主要功能是通过当前的 Python 环境来运行一个指定的脚本,具体来说是一个名为 web.py 的脚本。程序首先导入了必要的模块,包括 sys、os 和 subprocess,以及一个自定义的 abs_path 函数,这个函数来自于 QtFusion.path 模块,可能用于获取文件的绝对路径。

在 run_script 函数中,程序接受一个参数 script_path,这个参数是要运行的脚本的路径。函数内部首先获取当前 Python 解释器的路径,使用 sys.executable 来实现。接着,程序构建了一个命令字符串,这个命令使用了 streamlit 模块来运行指定的脚本。具体的命令格式是 "{python_path}" -m streamlit run "{script_path}",其中 {python_path} 和 {script_path} 会被实际的路径替换。

随后,程序使用 subprocess.run 方法来执行这个命令。shell=True 参数允许在 shell 中执行命令,这样可以处理更复杂的命令。如果脚本运行返回的状态码不为零,表示运行过程中出现了错误,程序会打印出 "脚本运行出错。" 的提示信息。

在文件的最后部分,程序通过 if __name__ == "__main__": 语句来确保只有在直接运行这个文件时才会执行后面的代码。在这个部分,程序调用 abs_path 函数来获取 web.py 的绝对路径,并将其存储在 script_path 变量中。最后,调用 run_script 函数来运行这个脚本。

总的来说,这个程序的作用是提供一个简单的接口来运行一个 Streamlit 应用,具体是通过调用 web.py 脚本来实现的。

10.2 test_selective_scan_speed.py

这个程序文件 test_selective_scan_speed.py 主要用于测试和比较不同选择性扫描(selective scan)算法的速度。选择性扫描是一种在时间序列数据上进行动态计算的技术,广泛应用于机器学习和深度学习中,尤其是在处理序列数据时。

文件的开头部分包含了一些版权信息和导入必要的库,包括 torch、pytest、einops 等。接下来,定义了一个函数 build_selective_scan_fn,该函数用于构建选择性扫描的前向和反向传播函数。这个函数内部定义了一个 SelectiveScanFn 类,继承自 torch.autograd.Function,并实现了 forward 和 backward 方法。

在 forward 方法中,首先对输入的张量进行处理,确保它们是连续的,并根据输入的维度进行必要的调整。接着,根据不同的模式(如 mamba_ssm、sscore 等)调用相应的 CUDA 函数进行前向计算。计算完成后,保存必要的上下文信息以供反向传播使用,并返回计算结果。

backward 方法则实现了反向传播的逻辑,使用保存的上下文信息来计算梯度。根据不同的模式,调用相应的 CUDA 函数进行反向计算,并返回各个输入的梯度。

接下来,定义了几个选择性扫描的参考实现函数,如 selective_scan_ref、selective_scan_easy 和 selective_scan_easy_v2,这些函数实现了选择性扫描的具体计算逻辑,并可以根据输入的不同参数进行调整。

文件的最后部分是 test_speed 函数,它用于测试不同选择性扫描实现的速度。通过设置不同的参数,如批量大小、序列长度、维度等,生成随机输入数据,并调用不同的选择性扫描函数进行多次测试。每次测试后,记录开始和结束时间,并计算出每种实现的运行时间。测试结果会打印到控制台,以便进行比较。

总的来说,这个程序文件实现了选择性扫描的前向和反向传播计算,并提供了一个速度测试框架,以便比较不同实现的性能。通过使用 CUDA 加速和优化的张量操作,旨在提高选择性扫描在深度学习中的效率。

10.2 transformer.py

以下是代码中最核心的部分,并附上详细的中文注释:

python

import torch

import torch.nn as nn

from functools import partial

# 导入自定义的归一化模块

from .prepbn import RepBN, LinearNorm

# 导入自定义的Transformer编码器层

from ..modules.transformer import TransformerEncoderLayer

# 定义一个包含AIFI_RepBN的模块

__all__ = ['AIFI_RepBN']

# 定义线性归一化和RepBN的组合

ln = nn.LayerNorm

linearnorm = partial(LinearNorm, norm1=ln, norm2=RepBN, step=60000)

# 定义带有RepBN的Transformer编码器层

class TransformerEncoderLayer_RepBN(TransformerEncoderLayer):

def __init__(self, c1, cm=2048, num_heads=8, dropout=0, act=..., normalize_before=False):

# 初始化父类的构造函数

super().__init__(c1, cm, num_heads, dropout, act, normalize_before)

# 初始化两个归一化层

self.norm1 = linearnorm(c1)

self.norm2 = linearnorm(c1)

# 定义AIFI transformer层,继承自TransformerEncoderLayer_RepBN

class AIFI_RepBN(TransformerEncoderLayer_RepBN):

"""定义AIFI transformer层。"""

def __init__(self, c1, cm=2048, num_heads=8, dropout=0, act=nn.GELU(), normalize_before=False):

"""使用指定参数初始化AIFI实例。"""

super().__init__(c1, cm, num_heads, dropout, act, normalize_before)

def forward(self, x):

"""AIFI transformer层的前向传播。"""

c, h, w = x.shape[1:] # 获取输入的通道数、高度和宽度

pos_embed = self.build_2d_sincos_position_embedding(w, h, c) # 构建位置嵌入

# 将输入从形状[B, C, H, W]展平为[B, HxW, C]

x = super().forward(x.flatten(2).permute(0, 2, 1), pos=pos_embed.to(device=x.device, dtype=x.dtype))

# 将输出转换回原始形状并返回

return x.permute(0, 2, 1).view([-1, c, h, w]).contiguous()

@staticmethod

def build_2d_sincos_position_embedding(w, h, embed_dim=256, temperature=10000.0):

"""构建2D正弦-余弦位置嵌入。"""

assert embed_dim % 4 == 0, "嵌入维度必须是4的倍数,以便进行2D正弦-余弦位置嵌入"

grid_w = torch.arange(w, dtype=torch.float32) # 创建宽度的网格

grid_h = torch.arange(h, dtype=torch.float32) # 创建高度的网格

grid_w, grid_h = torch.meshgrid(grid_w, grid_h, indexing="ij") # 生成网格坐标

pos_dim = embed_dim // 4 # 计算位置嵌入的维度

omega = torch.arange(pos_dim, dtype=torch.float32) / pos_dim # 计算频率

omega = 1.0 / (temperature**omega) # 应用温度缩放

# 计算宽度和高度的正弦和余弦值

out_w = grid_w.flatten()[..., None] @ omega[None]

out_h = grid_h.flatten()[..., None] @ omega[None]

# 返回拼接后的正弦和余弦位置嵌入

return torch.cat([torch.sin(out_w), torch.cos(out_w), torch.sin(out_h), torch.cos(out_h)], 1)[None]代码核心部分解释:

- 导入必要的库:导入了PyTorch和自定义的模块。

- 归一化层的定义 :使用

partial函数创建一个组合的归一化层,包含线性归一化和RepBN。 - Transformer编码器层的定义:创建一个新的编码器层类,继承自基础的Transformer编码器层,并在其中初始化两个归一化层。

- AIFI transformer层的实现:在AIFI_RepBN类中实现了前向传播方法,包含位置嵌入的构建和输入形状的转换。

- 位置嵌入的构建 :静态方法

build_2d_sincos_position_embedding用于生成2D正弦-余弦位置嵌入,确保嵌入维度为4的倍数,并使用温度缩放来调整频率。

这个程序文件 transformer.py 实现了一个基于 Transformer 架构的编码器层,特别是结合了重参数化批归一化(RepBN)和线性归一化(LinearNorm)的特性。文件中主要定义了两个类:TransformerEncoderLayer_RepBN 和 AIFI_RepBN。

首先,文件导入了必要的 PyTorch 库以及其他模块。RepBN 和 LinearNorm 是自定义的归一化模块,可能用于改进模型的训练效果和性能。TransformerEncoderLayer 是基础的 Transformer 编码器层,AIFI 可能是某种特定的 Transformer 变体。

在 TransformerEncoderLayer_RepBN 类中,构造函数接受多个参数,包括输入通道数 c1、中间层的通道数 cm、注意力头的数量 num_heads、dropout 概率、激活函数和是否在归一化之前进行处理的标志。这个类调用了父类的构造函数,并初始化了两个归一化层 norm1 和 norm2,这两个层使用了之前定义的 linearnorm 函数。

接下来,AIFI_RepBN 类继承自 TransformerEncoderLayer_RepBN,并定义了自己的构造函数。这个构造函数与父类相似,但默认激活函数设置为 GELU(高斯误差线性单元)。此外,它还实现了一个 forward 方法,负责前向传播。

在 forward 方法中,输入张量 x 的形状被调整,以便与位置嵌入相结合。具体来说,输入的形状从 [B, C, H, W] 被展平为 [B, HxW, C],然后通过调用父类的 forward 方法进行处理。位置嵌入是通过 build_2d_sincos_position_embedding 方法生成的,该方法使用二维正弦和余弦函数来创建位置编码,以增强模型对输入数据中空间信息的理解。

build_2d_sincos_position_embedding 方法接收宽度 w、高度 h 和嵌入维度 embed_dim 作为参数。它首先确保嵌入维度是4的倍数,以便能够正确地计算正弦和余弦值。然后,生成了宽度和高度的网格,并计算出对应的正弦和余弦位置编码,最后将这些编码合并并返回。

总体来说,这个文件实现了一个结合了重参数化批归一化和位置编码的 Transformer 编码器层,旨在提高模型的性能和表达能力。

10.3 UniRepLKNet.py

以下是简化后的代码,保留了核心部分,并添加了详细的中文注释:

python

import torch

import torch.nn as nn

import torch.nn.functional as F

class GRNwithNHWC(nn.Module):

"""

GRN (Global Response Normalization) 层

该层用于对输入进行全局响应归一化,输入假设为 (N, H, W, C) 格式。

"""

def __init__(self, dim, use_bias=True):

super().__init__()

self.use_bias = use_bias

self.gamma = nn.Parameter(torch.zeros(1, 1, 1, dim)) # 可学习参数

if self.use_bias:

self.beta = nn.Parameter(torch.zeros(1, 1, 1, dim)) # 可学习偏置

def forward(self, x):

Gx = torch.norm(x, p=2, dim=(1, 2), keepdim=True) # 计算L2范数

Nx = Gx / (Gx.mean(dim=-1, keepdim=True) + 1e-6) # 归一化

if self.use_bias:

return (self.gamma * Nx + 1) * x + self.beta # 应用归一化和偏置

else:

return (self.gamma * Nx + 1) * x # 仅应用归一化

class UniRepLKNetBlock(nn.Module):

"""

UniRepLKNet中的基本块

包含深度卷积、归一化、Squeeze-and-Excitation块和前馈网络。

"""

def __init__(self, dim, kernel_size, drop_path=0., deploy=False):

super().__init__()

self.dwconv = nn.Conv2d(dim, dim, kernel_size=kernel_size, stride=1, padding=kernel_size // 2, groups=dim) # 深度卷积

self.norm = nn.BatchNorm2d(dim) # 批归一化

self.se = SEBlock(dim, dim // 4) # Squeeze-and-Excitation块

self.pwconv1 = nn.Linear(dim, dim * 4) # 前馈网络第一层

self.pwconv2 = nn.Linear(dim * 4, dim) # 前馈网络第二层

self.drop_path = nn.Identity() if drop_path <= 0 else DropPath(drop_path) # 随机深度

def forward(self, inputs):

x = self.dwconv(inputs) # 深度卷积

x = self.norm(x) # 归一化

x = self.se(x) # Squeeze-and-Excitation

x = F.gelu(self.pwconv1(x)) # 激活函数

x = self.pwconv2(x) # 前馈网络

return self.drop_path(x) + inputs # 残差连接

class UniRepLKNet(nn.Module):

"""

UniRepLKNet模型的实现

包含多个UniRepLKNetBlock,构成深度网络。

"""

def __init__(self, in_chans=3, num_classes=1000, depths=(3, 3, 27, 3), dims=(96, 192, 384, 768)):

super().__init__()

self.stages = nn.ModuleList() # 存储各个阶段的块

for i in range(len(depths)):

stage = nn.Sequential(

*[UniRepLKNetBlock(dim=dims[i], kernel_size=3) for _ in range(depths[i])]

)

self.stages.append(stage)

def forward(self, x):

for stage in self.stages:

x = stage(x) # 通过每个阶段

return x

# 示例代码:创建模型并进行前向传播

if __name__ == '__main__':

inputs = torch.randn((1, 3, 640, 640)) # 随机输入

model = UniRepLKNet() # 创建模型

res = model(inputs) # 前向传播

print(res.shape) # 输出结果的形状代码说明:

- GRNwithNHWC: 实现了全局响应归一化层,用于对输入特征进行归一化处理,增强模型的稳定性。

- UniRepLKNetBlock: 这是模型的基本构建块,包含深度卷积、归一化、Squeeze-and-Excitation模块和前馈网络,支持残差连接。

- UniRepLKNet: 整个模型的实现,包含多个阶段,每个阶段由多个基本块组成,最终输出特征。

以上代码保留了模型的核心结构,并进行了简化和注释,便于理解其功能和结构。

这个程序文件 UniRepLKNet.py 实现了一个名为 UniRepLKNet 的深度学习模型,主要用于音频、视频、点云、时间序列和图像识别。该模型基于多个已有的深度学习框架和模型,如 RepLKNet、ConvNeXt、DINO 和 DeiT。程序的结构主要由多个类和函数组成,以下是对其主要部分的说明。

首先,程序导入了必要的库,包括 PyTorch 及其相关模块,以及一些用于深度学习模型构建的工具。接着,定义了一些核心组件,例如 GRN(全局响应归一化)层、NCHW 和 NHWC 格式转换的层、以及用于卷积操作的辅助函数。这些组件为后续的模型构建提供了基础。

在 GRNwithNHWC 类中,实现了 GRN 层的功能,通过计算输入张量的 L2 范数并进行归一化,增强了模型的表达能力。NCHWtoNHWC 和 NHWCtoNCHW 类则负责在不同的张量格式之间进行转换,以适应不同的操作需求。

接下来,get_conv2d 函数根据输入参数决定使用哪种卷积实现,特别是针对大卷积核的情况,尝试使用 iGEMM 优化实现。get_bn 函数则根据是否使用同步批归一化来返回相应的归一化层。

SEBlock 类实现了 Squeeze-and-Excitation 模块,通过自适应平均池化和全连接层来增强特征通道的表示能力。DilatedReparamBlock 类则实现了膨胀卷积的重参数化块,支持多种卷积核大小和膨胀率的组合,提升了模型在不同尺度下的特征提取能力。

UniRepLKNetBlock 类是 UniRepLKNet 的基本构建块,结合了深度卷积、归一化、Squeeze-and-Excitation 机制和前馈网络。该类支持在训练和推理模式之间切换,能够根据需要选择是否使用检查点来节省内存。

UniRepLKNet 类是整个模型的核心,负责构建模型的不同阶段和下采样层。根据输入的参数,模型会初始化不同的卷积层和归一化层,并通过前向传播函数处理输入数据。该类还实现了权重初始化和模型的推理模式切换功能。

最后,程序提供了一些函数,如 unireplknet_a、unireplknet_f 等,用于创建不同版本的 UniRepLKNet 模型,并可选择加载预训练权重。在主程序部分,创建了一个随机输入的张量,并实例化了模型进行前向传播,展示了模型的基本使用方式。

整体来看,UniRepLKNet.py 文件实现了一个复杂而灵活的深度学习模型,能够处理多种输入类型,并在不同的任务中表现出色。通过模块化的设计,便于扩展和维护,同时也为研究人员提供了丰富的功能和灵活性。

注意:由于此博客编辑较早,上面"10.YOLOv11核心改进源码讲解"中部分代码可能会优化升级,仅供参考学习,以"11.完整训练+Web前端界面+200+种全套创新点源码、数据集获取(由于版权原因,本博客仅提供【原始博客的链接】,原始博客提供下载链接)"的内容为准。

11.完整训练+Web前端界面+200+种全套创新点源码、数据集获取(由于版权原因,本博客仅提供【原始博客的链接】,原始博客提供下载链接)

参考原始博客1: https://gitee.com/Vision-Studios/Eye-Protection61

参考原始博客2: https://github.com/Qunmasj-Vision-Studio/Eye-Protection61