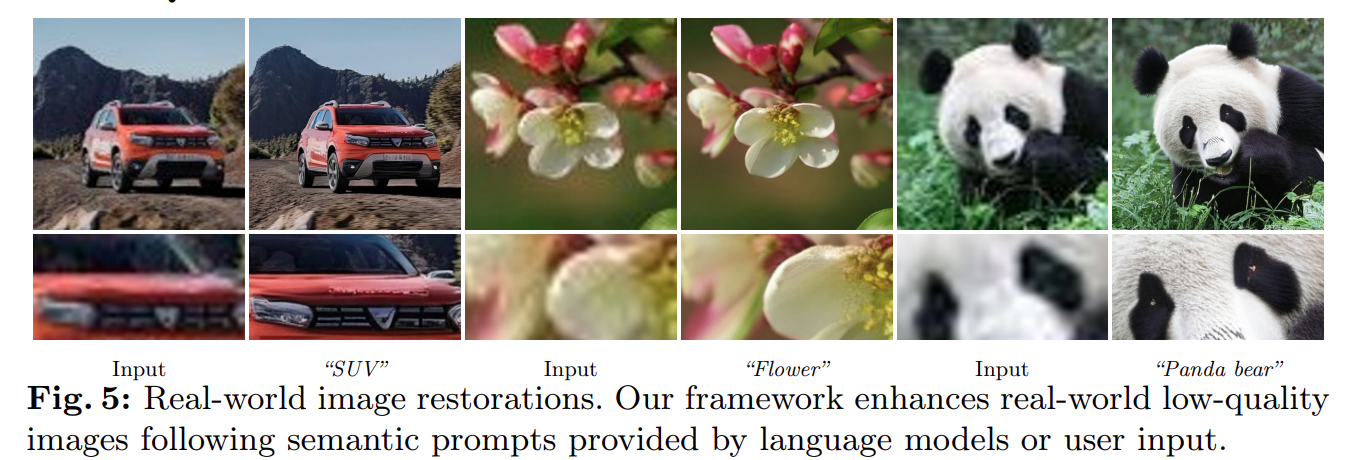

- 这是一篇港科大学生在google research 实习期间发在ECCV2024的语义引导生成式修复的文章,港科大陈启峰也挂了名字。从首页图看效果确实很惊艳,尤其是第三行能用文本调控修复结果牌上的字。不过看起来更倾向于生成,对原图内容并不是很复原(不过在生成式方法中已经做得很好了),适合超级噪声图这种原图信息丢失十分严重的场景:

- 整体方法流程如下图所示,用的是stable diffusion的框架,甚至模型参数都是pretrain好后fix住的,在此之上,用controlnet的风格添加了另外一部分网络,来接收restoration的描述和degraded image,网络中的feature来调制这个train好的stable diffusion的unet中的feature,然后是可train的:

- 现在diffusion有了两个目标,一个是原有的stable diffusion在denoise的过程中还是文本梯度,另一个是最终生成的图片要和输入的LQ图片内容一致,而这部分梯度分开由需要train的那个网络承担。:

- 可以看到,这个方法的PSNR确实不高,但是视觉效果真的很好,泛化性感觉也不错:

- 如果要一言以蔽之,这个工作可以说是controlnet的restoration 特供版,不过确实做得不错,可惜没看到有开源。