视频生成模型虽然可以生成一些看似符合常识的视频,但被证实目前还无法理解物理规律!

自从 Sora 横空出世,业界便掀起了一场「视频生成模型到底懂不懂物理规律」的争论。图灵奖得主 Yann LeCun 明确表示,基于文本提示生成的逼真视频并不代表模型真正理解了物理世界。之后更是直言,像 Sora 这样通过生成像素来建模世界的方式注定要失败。

Keras 之父 François Chollet 则认为,Sora 这样的视频生成模型确实嵌入了「物理模型」,但问题是:这个物理模型是否准确?它能否泛化到新的情况,即那些不仅仅是训练数据插值的情形?这些问题至关重要,决定了生成图像的应用范围 ------ 是仅限于媒体生产,还是可以用作现实世界的可靠模拟。最后他指出,不能简单地通过拟合大量数据来期望得到一个能够泛化到现实世界所有可能情况的模型。

此后,关于视频生成模型到底有没有在学习、理解物理规律,业界始终没有一个定论。直到近日,字节豆包大模型团队公布的一项系统性研究,为两者之间的关系「划上了不等号」。

该团队通过大规模实验发现 ------ 即便依照 Scaling Law 扩大模型参数与训练数据量,模型依然无法抽象出一般物理规则,甚至连牛顿第一定律、抛物线运动都无法领会。

「视频生成模型目前就像一个只会『抄作业』的学生,可以记忆案例,但还无法真正理解物理规律,做到『举一反三』。因此,模型遇到未学习过的场景就会『犯迷糊』,生成结果与物理规则不符。」研究作者表示。

相关推文在 X 发布后,获得 Yann LeCun 点赞转发,还评价道 ------ 结果虽不意外,但有人尝试研究确实是一件好事。

此外,CV 大牛谢赛宁和常年活跃的 Gary Marcus 等人也纷纷跟进关注。

-

论文标题:How Far is Video Generation from World Model: A Physical Law Perspective

,时长03:10

Sora 的世界里,物理学存在么?

此前 Sora 发布时,OpenAI 就在其宣传页面写道:我们的成果揭示了 ------ 提升视频生成模型参数与数据量,为构建物理世界通用模拟器,提供了一条可行之路。

给人希望的同时,业内质疑声纷至沓来,很多人并不认为基于 DiT 架构的视频生成模型能够真正理解物理规律。其中尤以 LeCun 为代表,一直以来,这位人工智能巨头一直坚称,基于概率的大语言模型无法理解常识,其中包括现实物理规律。

尽管大家众说纷纭,但市面上,系统性针对该问题的研究一直寥寥。出于对这一课题的好奇,字节豆包大模型相关团队于 2024 年初启动了这一研究立项,并历经 8 个月终于完成系统性实验。

原理与实验设计

在本次工作中,如何定量分析视频生成模型对于物理规律的理解,是一大挑战。

豆包大模型团队通过专门开发的物理引擎合成了匀速直接运动、小球碰撞、抛物线运动等经典物理场景的运动视频,用于训练基于主流 DiT 架构的视频生成模型。然后,通过检验模型后续生成的视频在运动和碰撞方面是否符合力学定律,判断模型是否真正理解了物理规律,并具有「世界模型」的潜力。

针对视频生成模型在学习物理定律时的泛化能力,团队探讨了下面三种场景的表现:

-

**分布内泛化 (In-Distribution, ID):**指训练数据和测试数据来自同一分布。

-

分布外泛化 (Out-of-Distribution, OOD):分布外泛化指的是模型在面对从未见过的新场景时,是否能够将已学过的物理定律应用到未知的情境。

-

**组合泛化 (Combinatorial Generalization):**组合泛化介于 ID 和 OOD 之间,此种情况下,训练数据已包含了所有「概念」或物体,但这些概念、物体并未以所有可能的组合或更复杂的形式出现。

在基于视频的观察中,每一帧代表一个时间点,物理定律的预测则对应于根据过去和现在的帧生成未来的帧。因此,团队在每个实验中都训练一个基于帧条件的视频生成模型,来模拟和预测物理现象的演变。

通过测量生成视频每个帧(时间点)中物体位置变化,可判断其运动状态,进而与真实模拟的视频数据比对,判断生成内容是否符合经典物理学的方程表达。

实验设计方面,团队聚焦于由基本运动学方程支配的确定性任务。这些任务能清晰定义分布内 (ID) 和分布外 (OOD) 泛化,并且能够进行直观的误差量化评估。

团队选择了以下三种物理场景进行评估,每种运动由其初始帧决定:

-

**匀速直线运动:**一个球水平移动,速度保持恒定,用于说明惯性定律。

-

**完美弹性碰撞:**两个具有不同大小和速度的球水平相向运动并发生碰撞,体现了能量与动量守恒定律。

-

**抛物线运动:**一个带有初始水平速度的球因重力作用下落,符合牛顿第二定律。

,时长00:06

针对组合泛化场景,团队使用 PHYRE 模拟器评估模型的组合泛化能力。PHYRE 是一个二维模拟环境,其中包括球、罐子、杆子和墙壁等多个对象,它们可以是固定或动态的,且能进行碰撞、抛物线轨迹、旋转等复杂物理交互,但环境中的底层物理规律是确定性的。

视频数据构造方面,每一个视频考虑了八种物体,包括两个动态灰色球、一组固定的黑色球、一个固定的黑色条形、一个动态条形、一组动态立式条形、一个动态罐子和一个动态立式棍子。

每个任务包含一个红色球和从这八种类型中随机选择的四个物体,总共形成

种独特的模板。数据示例如下:

,时长00:05

对于每个训练模板,团队保留了一小部分视频用于创建模板内测试集(in-template evaluation set),再保留 10 个未使用的模板,用于模板外测试集(out-of-template evaluation set),以评估模型对训练时未见过的新组合的泛化能力。

实验结果与分析

豆包大模型团队的实验发现,即使遵循「Scaling Law」增大模型参数规模和数据量,模型依然无法抽象出一般物理规则,做到真正「理解」。

以最简单的匀速直线运动为例,当模型学习了不同速度下小球保持匀速直线运动的训练数据后,给定初始几帧,要求模型生成小球在训练集速度区间内匀速直线运动的视频,随着模型参数和训练数据量的增加,生成的视频逐渐更符合物理规律。

然而,当要求模型生成未曾见过的速度区间(即超出训练数据范围)的运动视频时,模型突然不再遵循物理规律,并且无论如何增加模型参数或训练数据,生成的结果都没有显著改进。这表明,视频生成模型无法真正理解物理规律,也无法将这些规律泛化应用到全新的场景中。

不过,研究中也有一个好消息:如果训练视频中所有概念和物体都是模型已熟悉的,此时加大训练视频的复杂度,比如组合增加物体间的物理交互,通过加大训练数据,模型对物理规律的遵循将越来越好。这一结果可为视频生成模型继续提升表现提供启发。

具体而言,在分布内泛化(ID)的测试中,团队观察到,随着模型规模增大(从 DiT-S 到 DiT-L)或训练数据量的增加(从 30K 到 3M),模型在所有三种物理任务中的速度误差都降低。这表明,模型规模和数据量的增加对分布内泛化至关重要。

然而,分布外泛化(OOD)与分布内泛化(ID)结果形成鲜明对比:

-

更高的误差:在所有设置中,OOD 速度误差比 ID 高出一个数量级 (~0.02 v.s. ~0.3)。

-

扩展数据和模型规模的影响有限 :与分布内泛化不同,扩展训练数据和模型规模对降低 OOD 误差几乎没有影响。这表明,简单的数据量和模型规模的增加无法有效提升模型在 OOD 场景中的推理能力。

至于组合泛化场景,从下表可看到,当模板数量从 6 个增加到 60 个时,所有度量指标(FVD、SSIM、PSNR、LPIPS)在模版外测试集 上均显著的提升。尤其是异常率(生成视频违背物理定律的比例),从 67% 大幅下降至 10%。这表明,当训练集覆盖了更多组合场景时,模型能够在未见过的组合中展现出更强的泛化能力。

然而,对于模板内测试集,模型在 6 个模板的训练集上的 SSIM、PSNR 和 LPIPS 等指标上表现最佳,因为每个训练示例被反复展示。

这些结果表明,模型容量和组合空间的覆盖范围对组合泛化至关重要。这意味着,视频生成的 Scaling Law 应当侧重于增加组合多样性,而不仅仅是扩大数据量。

,时长00:05

图注:在模版外测试集上生成的样本视频。第一行:真实视频。第二行:使用 60 个模板训练的模型生成的视频。第三行:使用 30 个模板训练的模型生成的视频。第四行:使用 6 个模板训练的模型生成的视频。

机理探究:模型如何依赖记忆和案例模仿

前文提及,视频生成模型对于分布外泛化表现不佳,但在组合场景下,数据和模型 Scaling 可带来一定提升,这究竟来自于案例学习,还是对底层规律的抽象理解?团队着手进行了相关实验。

- 模型似乎更多依赖记忆和案例模仿

使用匀速运动视频进行训练,速度范围为 v∈2.5, 4.0,并使用前 3 帧作为输入条件。我们使用两个数据集训练,再对照结果,Set-1 只包含从左到右移动的球,而 Set-2 则包含从左到右移动的球和从右到左移动的球。

如下图所示,给定进行低速正向(从左到右)运动的帧条件,Set-1 模型生成视频只有正速度,且偏向高速范围。相比之下,Set-2 模型偶尔会生成负速度的视频,正如图中绿色圆圈所示。

面对两者之间的区别,团队猜测,这可能是由于模型认为,与低速度球更接近的是训练数据中反方向运动的小球,导致模型受到训练数据中「误导性」示例影响。换而言之,模型似乎更多依赖于记忆和案例模仿,而非抽象出普遍的物理规则,实现分布外泛化(OOD)。

- 模型更多靠颜色寻找模仿对象

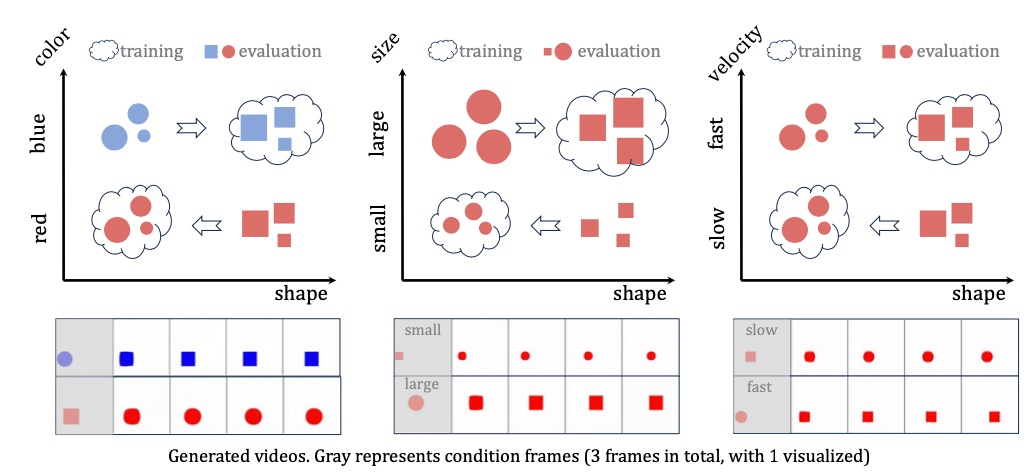

在前文,我们已探索获知 ------ 模型更多依赖记忆和相似案例进行模仿并生成视频,更进一步,则须分析哪些属性对其模仿影响较大。

在比对颜色、形状、大小和速度四个属性后,团队发现,基于扩散技术的的视频生成模型天生更偏向其他属性而非形状,这也可能解释了为什么当前的开放集视频生成模型通常在形状保持上存在困难。

如下图,第一行是真实视频,第二行是视频模型生成的内容,颜色很好的保持了一致,但其形状难以保持。

,时长00:06

两两对比后,团队发现视频生成模型更习惯于通过「颜色」寻找相似参考生成物体运动状态,其次是大小,再次是速度,最后才是形状。颜色 / 大小 / 速度对形状的影响情况如下图:

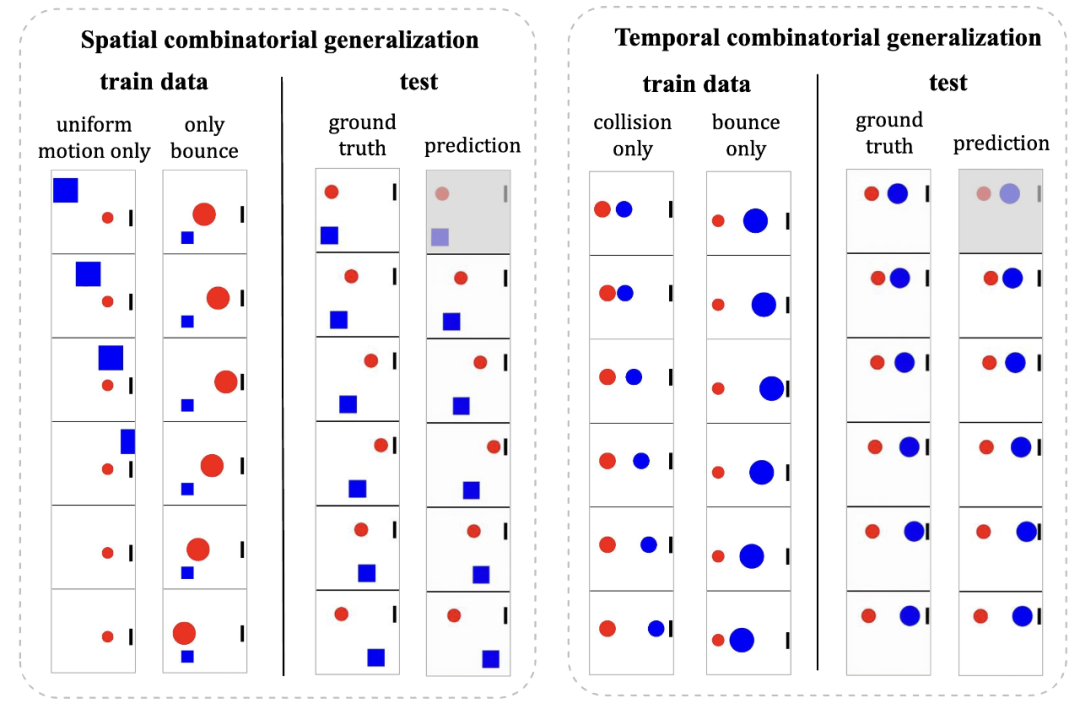

- 复杂组合泛化情况

最后,对于复杂的组合泛化为何能够发生,团队提出视频模型具有三种基本的组合模式,分别为:属性组合、空间组合 (多个物体不同运动状态)、时间组合(不同的时间点多个物体的不同状态)。

实验结果发现,对于速度与大小或颜色与大小等属性对,模型展现出一定程度的组合泛化能力。同时,如下图所示,模型能够通过对训练数据的局部片段进行时间 / 空间维度的再组合。

然而值得注意的是,并不是所有的情况下都能通过组合泛化生成遵循物理规律的视频。模型对案例匹配的依赖限制了其效果。在不了解底层规则的情况下,模型检索并组合片段,可能会生成不符合现实的结果。

- 视频表征的局限性

最后,团队探索了在视频表征空间进行生成是否足以作为世界模型,结果发现,视觉模糊性会导致在细粒度物理建模方面出现显著的误差。

例如下图,当物体尺寸差异仅在像素级别时,单纯通过视觉判断一个球是否能通过间隙变得十分困难,这可能导致看似合理但实际上错误的结果。

,时长00:05

图注:第一行是真实视频,第二行为模型生成的视频。

这些发现表明,单纯依赖视频表示不足以进行精确的物理建模。

团队介绍

该论文核心作者有两位,其中之一为豆包大模型团队 95 后研究员 Bingyi Kang,此前他负责的研究项目 Depth Anything 同样取得了业界的广泛关注,并被收入苹果 CoreML 库中。

据 Bingyi 分享,世界模型概念早已被提出,自 AlphaGo 诞生时,「世界模型」 一词已在业内传开,Sora 爆火后,他决定先从视频生成模型能否真正理解物理规律入手,一步步揭开世界模型机理。

这当中有三四周时间,项目毫无进展,直到一次实验,大家注意到一个很隐蔽的反常规现象,借此设计对比试验后,他们确认了「模型其实不是在总结规律,而是在匹配跟他最接近的样本」。

「做 research 往往不是说,你突然有个很好的 idea,然后你一试它就 work 了,很多时候你都是在排错。但经过一段时间的试错,你很可能突然发现某一个方向有解了。」Bingyi 表示。

尽管研究耗时 8 个月,每天对着视频中的虚拟小球做定量实验,但大家更多感受到的不是枯燥,而是「好玩」和「烧脑」,回忆这段,他感慨:「团队对基础研究给了充分的探索空间。」

另一位 00 后同学也是核心参与者之一,据他分享,本次研究是他经历过的最具挑战性、最耗时的项目,涉及对物理引擎、评测系统、实验方法的构建,非常繁琐,当中还有好几次项目「卡顿」住。不过,团队负责人和 Mentor 都给予了耐心和鼓励,「没人催赶紧把项目做完」。