探索大型语言模型新架构:从 MoE 到 MoA

当前,商业科技公司纷纷投身于一场激烈的竞赛,不断扩大语言模型的规模,并为其注入海量的高质量数据,试图逐步提升模型的准确性。然而,这种看似顺理成章的发展路径逐渐暴露出诸多内在局限。一方面,高质量数据的获取并非易事;另一方面,计算能力的瓶颈以及在普通用户硬件上运行这些庞然大物的实际困难,都成为了难以逾越的障碍。幸运的是,人工智能领域的最新研究为我们指明了一个新的方向------结合多个模型的预测和生成能力,或许才是破局的关键。而这其中,混合专家(MoE)模型和混合智能体(MoA) 架构尤为引人注目。

混合专家(MoE)模型:原理与发展

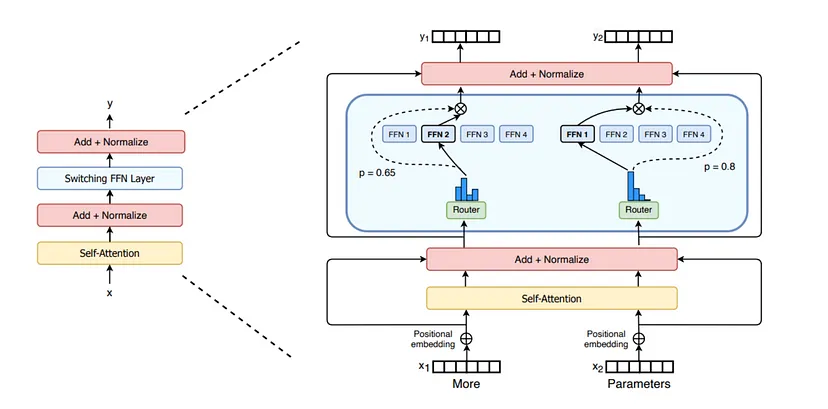

MoE 模型的核心设计理念是构建一个由多个前馈神经网络组成的网络架构,这些神经网络被形象地称为"专家"。每个专家都在特定的领域进行了专门的训练或预训练,其独特之处在于,任何类型的模型都可以作为专家被纳入其中,从而实现了多样化的专业分工。

MoE 模型成功的关键在于其内置的门控或路由机制。这个机制就像是一个智能导航系统,能够精准地将特定的输入导向在相应领域表现卓越的网络。并且,这个路由器是与整个网络同时进行预训练的,这确保了它与整个系统的无缝集成,从而保障了模型的最优性能。

回顾 MoE 模型的发展历程,自 1991 年开创性的论文首次提出其架构以来,它经历了多次演变和改进。2013 年的"Factored Representation of Deep MoE"论文和 2017 年的"Sparsely Gated MoE Layer"论文都对这一概念进行了重新审视和深化。而在 2023 年,"MoE Meets Instruction Tuning"论文更是进一步推动了该领域的发展,充分展示了 MoE 模型的多功能性和巨大潜力。

混合智能体(MoA)架构:创新与突破

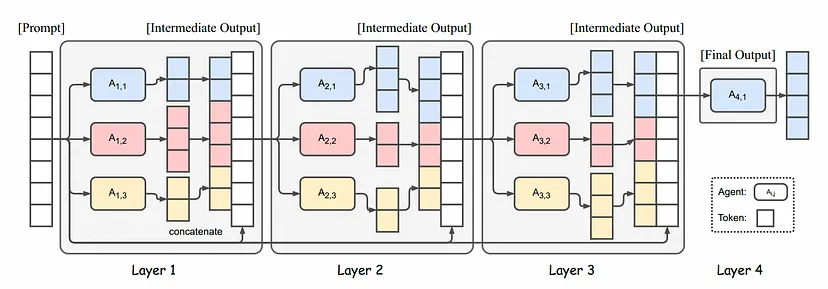

一篇名为**"Mixture-of-Agents Enhances Large Language Model Capabilities"**的论文横空出世,正式向我们介绍了 MoA 架构。该论文的作者敏锐地捕捉到了 LLMs 中一个内在的现象------协作性。他们发现,当 LLMs 接收到来自其他模型的输出时,能够生成质量更高的响应。

MoA 架构主要包含两个核心组件:提议者和聚合器,它们均是在协作方面表现出色的 LLMs。 例如,GPT - 4o、Qwen1.5、LLaMA - 3 等模型在协助和聚合任务中都展现出了良好的通用性;而 WizardLM 则在提议者角色上表现优异,但在聚合其他模型的响应时稍显逊色。

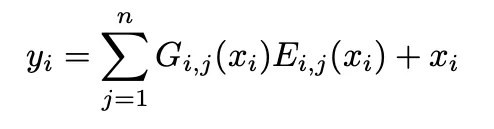

MoA 架构的具体运作方式如下:它拥有一个由 l 层 MoE 层堆叠而成的结构。每一层 MoE 层都包含 n 个专家 LLMs,这些专家 LLMs 可以在同一层或不同层中被重复使用,同时还配备了门控网络和残差连接。 每个 LLM 都会对输入文本进行处理,并在此基础上不断构建和完善输出。特别值得一提的是,MoA 方法无需进行微调,它是在模型层面而非激活层面进行操作的,这意味着它完全基于提示接口工作,无需对模型的权重进行任何修改。

在性能表现上,MoA 模型在 AlpacaEval 2.0、MT - Bench 和 FLASK 这三大基准测试中都取得了令人瞩目的成绩。在 AlpacaEval 2.0 基准测试中,MoA 方法成功登顶排行榜,相较于之前的顶级模型 GPT - 4o,实现了高达 8.2%的绝对提升。尤为值得关注的是,MoA 模型仅使用开源模型就超越了 GPT - 4o,从 GPT - 4o 的 57.5%提升到了 65.1%,绝对提升幅度达到 7.6%。 在 MT - Bench 基准测试中,尽管当前的模型已经取得了相当高的分数,但 MoA 依然在排行榜上独占鳌头,这充分证明了即使在已经高度优化的基准测试中,MoA 方法仍能突破极限,保持领先地位。在 FLASK 基准测试中,与聚合器 Qwen - 110B - Chat 的单模型得分相比,MoA 在稳健性、正确性、效率、真实性、常识性、洞察力、完整性等方面都有显著的提升。 此外,在正确性、真实性、洞察力、完整性和元认知等方面,MoA 也优于 GPT - 4 Omni。不过,MoA 在简洁性方面还有待提高,其生成的输出略显冗长。

MoA 架构的成功秘诀

MoA 聚合器的成功关键在于其精妙的输出融合策略。它并非简单地从众多响应中挑选出最佳答案,而是执行一个复杂的聚合过程,将所有最优输出无缝地融合在一起。这一独特的设计使得 MoA 与传统的基于 LLM 的排序器区分开来,并使其能够始终保持卓越的性能。

为了验证 MoA 方法的有效性,研究人员运用了 BLEU 和 Levenshtein 相似性等相似性分数,对聚合器的输出和提议者的输出进行了比较。结果显示,两者之间存在显著的正相关关系,这有力地证明了聚合器确实有效地整合了一层内所有 LLM 输出中的最佳答案。

此外,研究人员在模型选择上也下足了功夫。他们精心挑选聚合器和提议者的模型类型,确保每个组件都能针对底层任务实现专业化。这种策略性的方法使得 MoA 框架的每个部分都能为其特定角色进行优化,从而极大地提升了系统的整体准确性和性能。

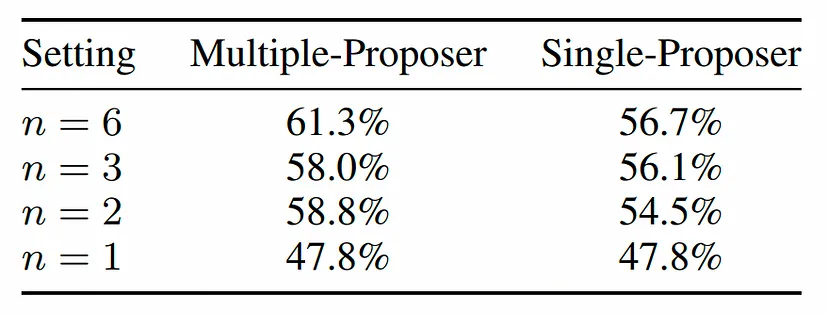

MoA 框架的另一个显著优势在于它能够充分利用多样化的 LLMs。研究人员通过实验证明,这种多样性能够显著提高系统的整体准确性,正如论文中的图 4 所展示的令人印象深刻的结果。随着提议者模型数量的增加,基于 MoA 的系统的整体准确性和性能都有了显著的提升,这充分凸显了在大型语言模型发展中采用协作式人工智能的优势。

如果你对文中提到的 MoE 和 MoA 模型感兴趣,想了解更多详细信息,可以参考以下文献:

- 混合专家(MoE) :

- 混合智能体(MoA) :https://arxiv.org/abs/2406.04692

希望今天的分享能让你对大型语言模型的前沿进展有更深入的了解,如果你有任何想法或建议,欢迎在评论区留言交流!让我们一起关注人工智能的发展动态,共同探索未来的无限可能!

以上就是今天为大家带来的全部内容,感谢阅读!

推荐阅读

3. AI Agent 架构新变革:构建自己的 Plan-and-Execute Agent

本文由mdnice多平台发布