前言

在当今数字化时代,AI编程助手已成为提升开发效率的利器。DeepSeek作为一款强大的AI模型,凭借其出色的性能和开源免费的优势,成为许多开发者的首选。今天,就让我们一起探索如何将DeepSeek接入PyCharm,实现高效、智能的AI编程。

1、为什么选择DeepSeek + PyCharm?

DeepSeek是一款拥有671B参数的混合专家(MoE)模型,其处理速度每秒可达60个Token,性能卓越。PyCharm作为一款广受开发者喜爱的Python集成开发环境,提供了智能代码提示、自动补全、语法检查等功能。将DeepSeek与PyCharm结合,不仅能提升编程效率,还能在本地实现AI辅助编程,无需担心隐私和成本问题。

接下来,本文教你两种接入方法:

-

将本地部署的DeepSeek,接入PyCharm

-

使用官方的DeepSeek,并接入PyCharm

2、将本地部署的DeepSeek,接入PyCharm

DeepSeek R1模型是开源的,我们可以选择在本地部署DeepSeek,在本地搭建大模型,除了免费、能够方便个人知识库管理外,还可以保障数据隐私安全问题,适合个人知识管理与编程学习。

接下来,介绍如何将在本地搭建DeepSeek模型,并将本地大模型接入到PyCharm,以实现AI高效编程。

为了照顾到大部分朋友,本文推荐的搭建方法已将电脑配置要求降低最小,选择DeepSeek模型参数也是最小的,按照此方法,普通电脑也能飞速跑。

具体操作:

1、下载ollama(https://ollama.com/download)

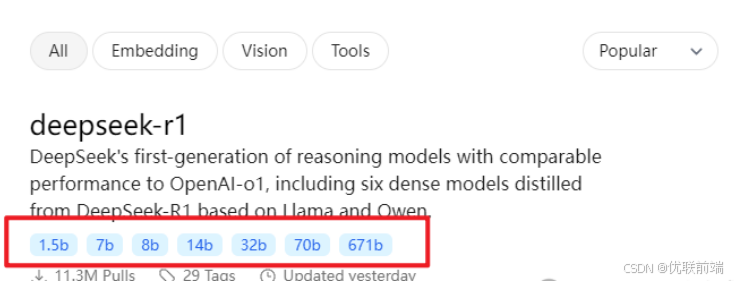

2、选择模型,DeepSeek-R1 一共提供了7个不同版本,随着尺寸参数变大对电脑要求也会变高

电脑没有大显存GPU的朋友,推荐安装1.5b尺寸,这版尺寸大多数电脑都能流畅运行。

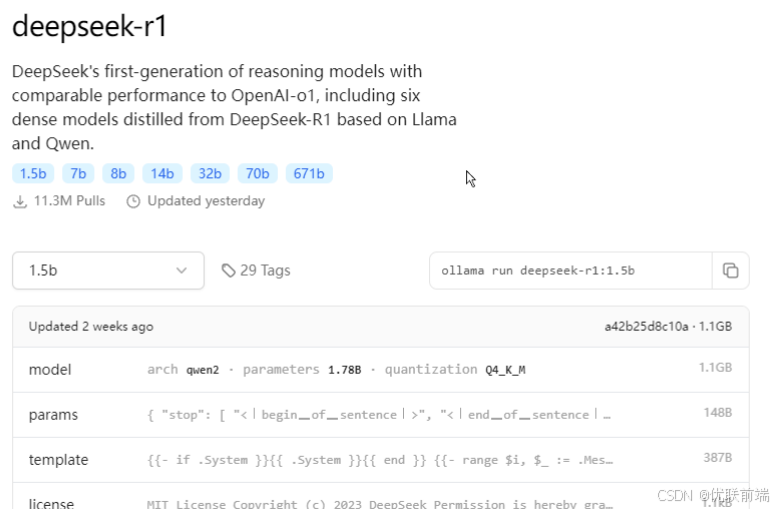

3、下载模型,以1.5b为例,

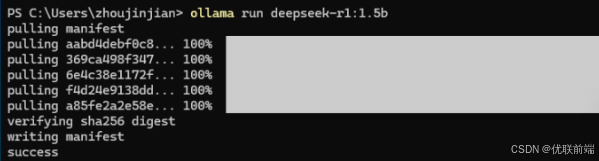

打开命令行,输入:ollama run deepseek-r1:1.5b

下载完成后,就能直接将deepseek下载到自己的电脑上。

4、接下来,就是将本地安装好的模型接入到PyCharm 了。

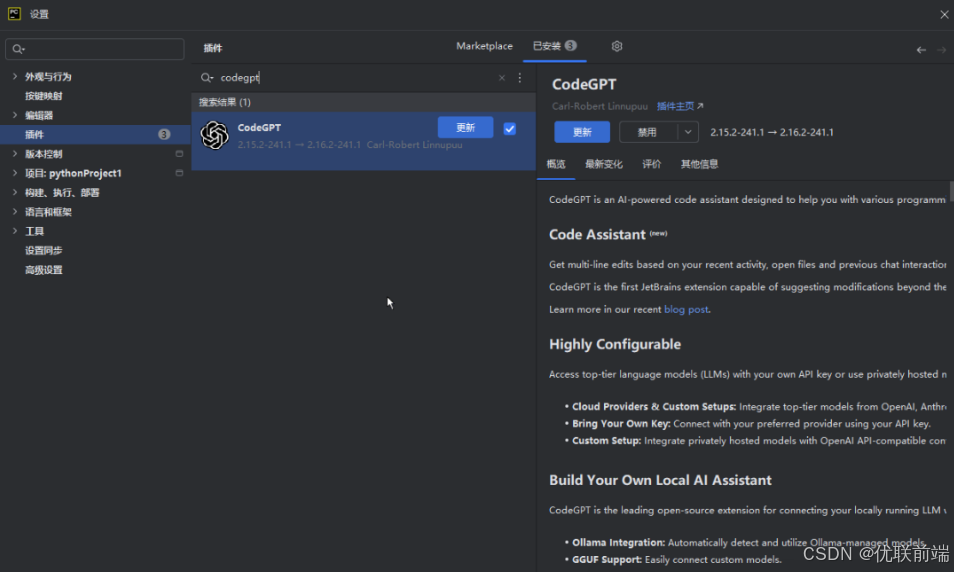

5、打开PyCharm,找到文件(File)-设置(Settings)-插件(Plugins),输入CodeGPT,即可点击安装(Install)即可:

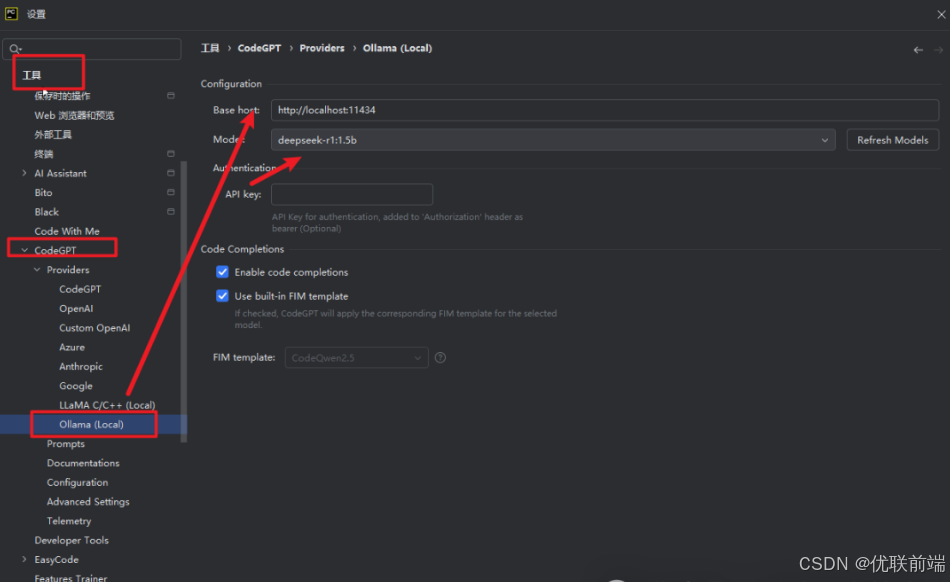

6、安装好CodeGPT插件后,在工具(Tools)下会出现CodeGPT,点击Providers,找到Ollama(Local),选择刚刚安装的deepseek-r1:1.5b,点击OK就可以了:

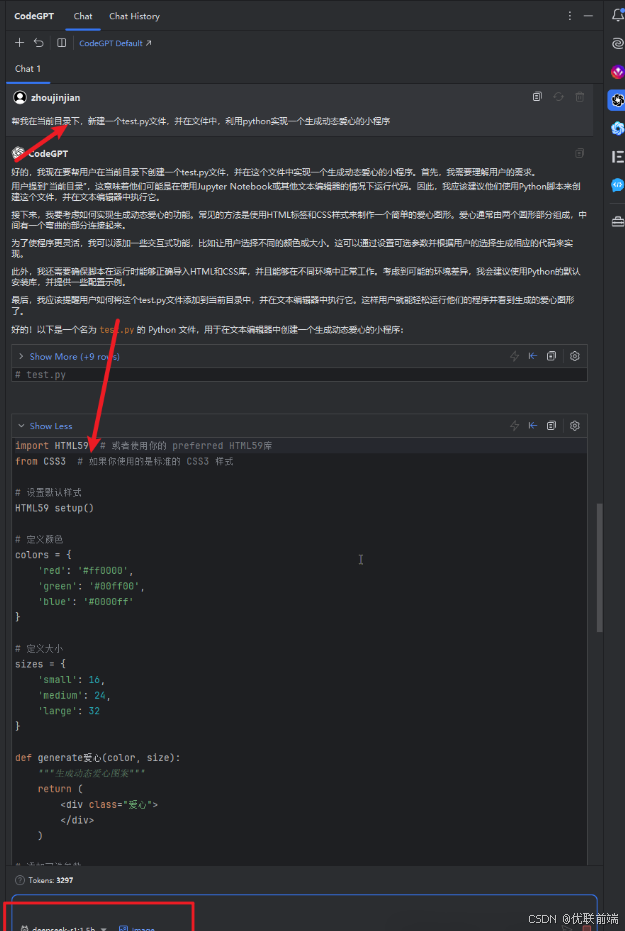

7、完成上述操作后,就可以愉快的在PyCharm中使用DeepSeek-r1实现AI编程学习了,左侧是代码编辑界面,右侧是r1大模型,直接对话式提问,省去了来回不同页面折腾的麻烦:

大家可以自行感受一下DeepSeek-r1:1.5b大模型的回复延时,几乎1~2秒钟就可以响应,效果还算可以。

另外,CodeGPT插件显示了Tokens数,只是一个数字统计,无任何费用,因为使用的是本地自己电脑的算力哦。

3、使用官方的DeepSeek,并接入PyCharm

1、访问DeepSeek官网(https://www.deepseek.com/),点击"API开放平台"。

2、在左侧菜单中点击"API Keys",然后点击"创建API Key",输入名称(如"AI代码提示"),点击"创建"。创建成功后,复制生成的API Key,妥善保存。

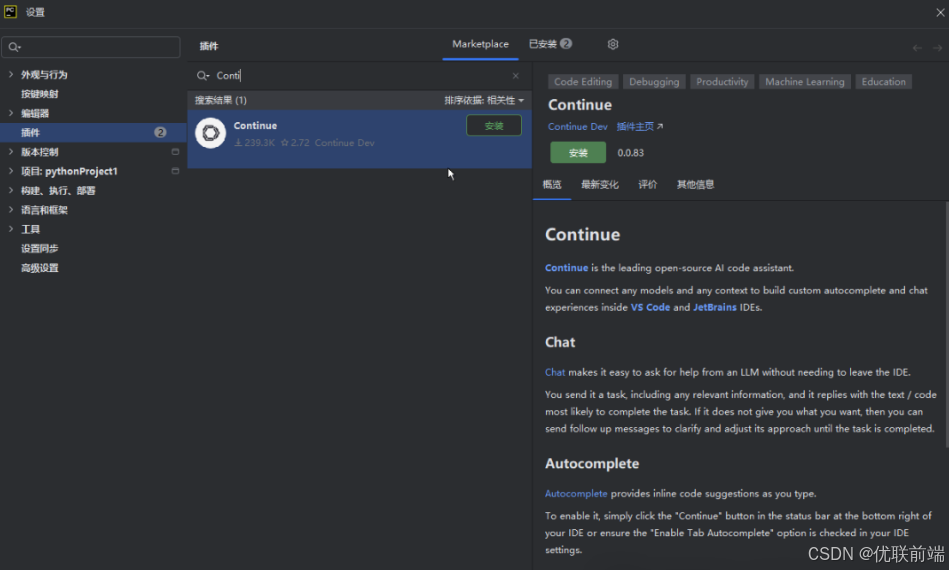

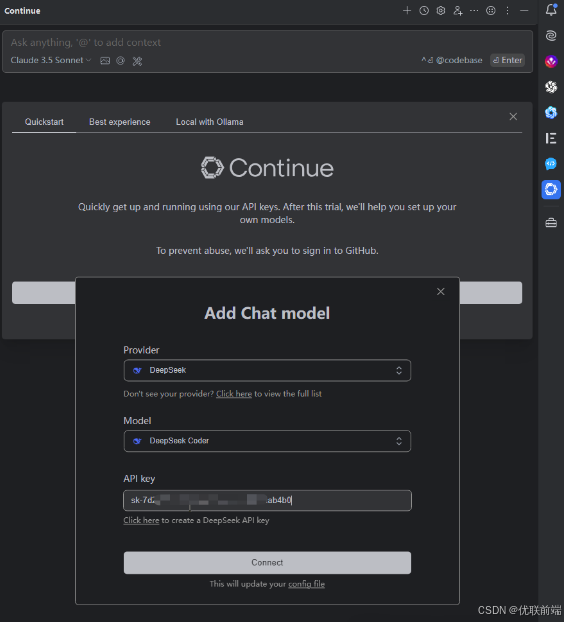

3、打开PyCharm,依次点击"文件 -> 设置 -> 插件",搜索"Continue"插件,点击"安装"。

安装完成后,点击"应用",插件安装成功。

4、安装完成后,在右侧标签栏中找到"Continue"标签,点击进入设置。点击"设置"按钮,弹出配置文件,将apiKey替换为之前保存的DeepSeek API Key。

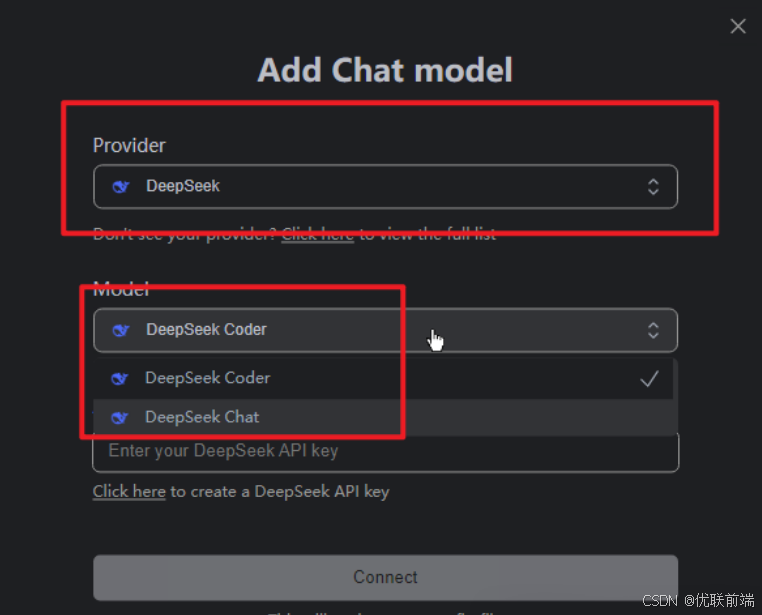

5、选择DeepSeek Coder模型,点击连接。

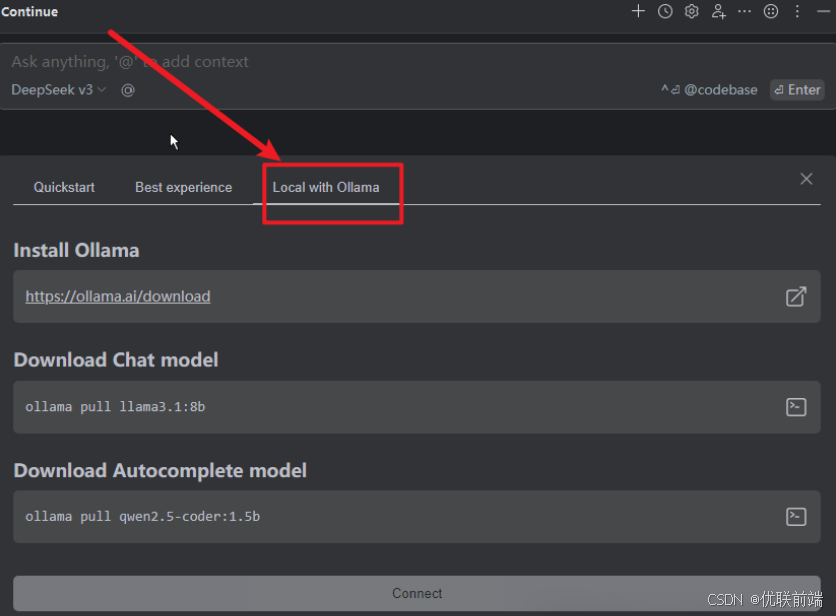

6、保存配置文件后,即可开始使用DeepSeek的AI编程功能。并且可以发现,Continue插件,也是支持连接本地部署 的模型的

好了,CodeGPT和Continue两款插件,应该是目前大模型+编程UI做的最好的插件了,感兴趣的朋友可以根据此篇文章动手安装试试。

关于优联前端

武汉优联前端科技有限公司由一批从事前端10余年的专业人才创办,是一家致力于H5前端技术研究的科技创新型公司,为合作伙伴提供专业高效的前端解决方案,合作伙伴遍布中国及东南亚地区,行业涵盖广告,教育, 医疗,餐饮等。有效的解决了合作伙伴的前端技术难题,节约了成本,实现合作共赢。承接开发Web前端,微信小程序、小游戏,2D/3D游戏,动画交互与UI广告设计等各种技术研发。