今天,我要给大家带来一个超级重磅的干货分享,这是一份来自清华大学的深度研究报告------《DeepSeek与AI幻觉》。如果你对人工智能感兴趣,或者想了解AI背后那些令人震惊的真相,那你绝对不能错过这篇文章!

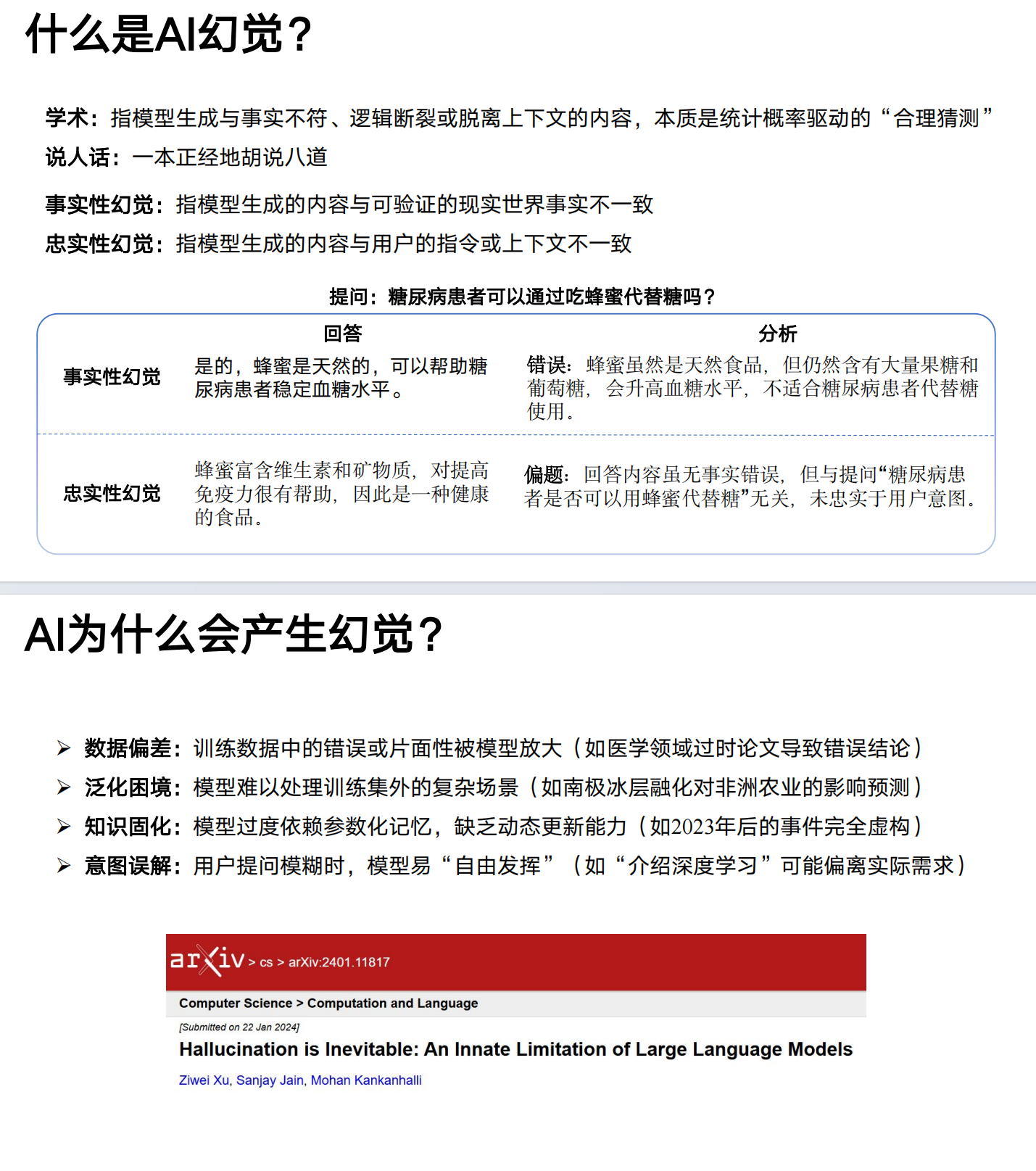

你有没有想过,那些看似智能的AI,有时候为什么会"一本正经地胡说八道"?其实,这就是所谓的"AI幻觉"。简单来说,就是AI生成的内容与事实不符、逻辑断裂,甚至完全脱离上下文。比如,AI告诉你"蜂蜜可以帮助糖尿病患者稳定血糖水平",但实际上,蜂蜜含有大量果糖和葡萄糖,会让血糖升高。这种现象,就是AI幻觉的典型表现。

清华大学第一版到第五版资料合集免费下载地址:夸克网盘分享

【清华大学第一版】DeepSeek从入门到精通

【清华大学第二版】DeepSeek赋能职场

【清华大学第三版】普通人如何抓住DeepSeek红利

【清华大学第四版】让科研像聊天一样简单

【清华大学第五版】DeepSeek与AI幻觉

DeepSeek为什么会产生幻觉?

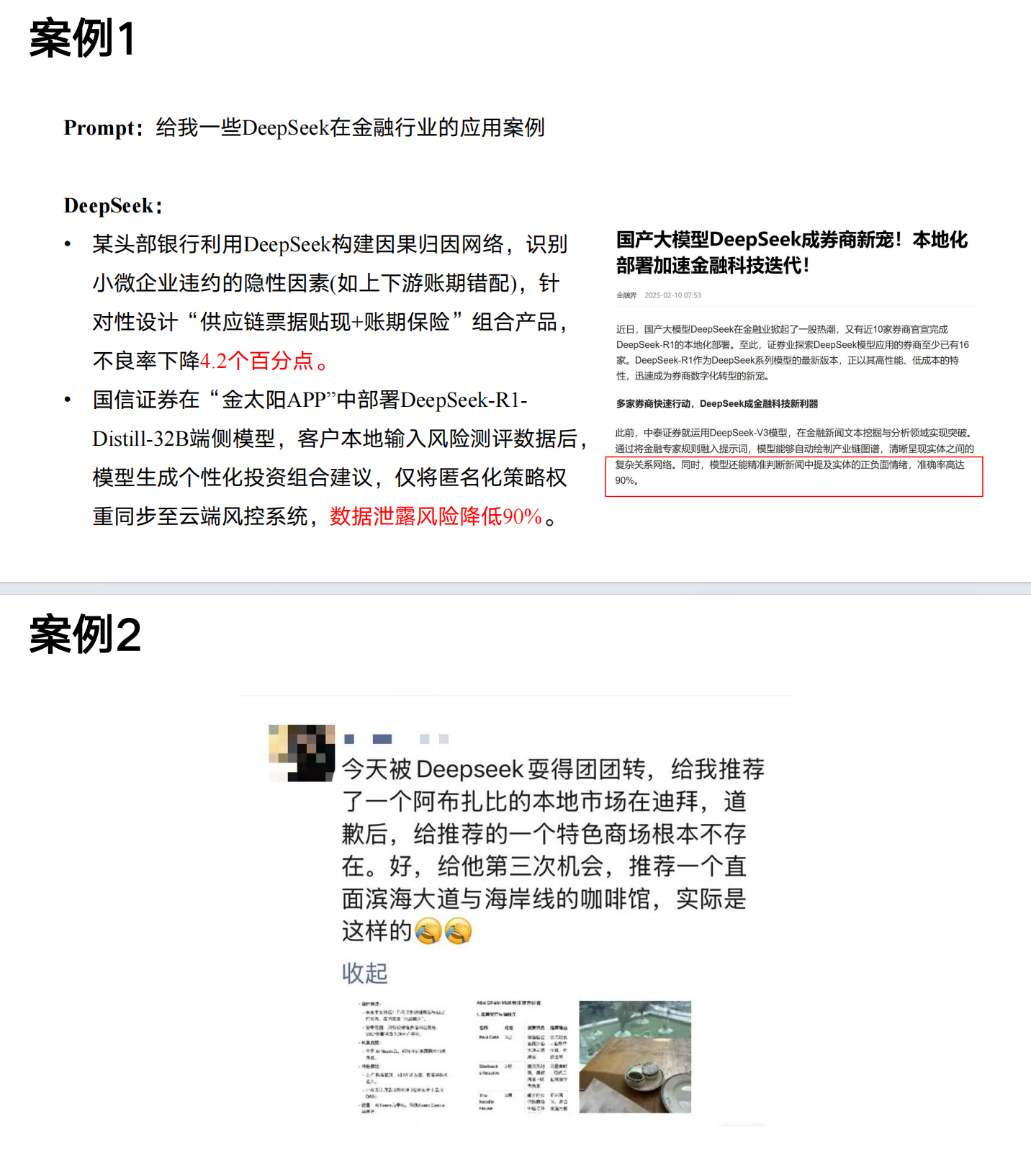

DeepSeek是一款非常先进的AI模型,但它也会产生幻觉。原因主要有四个方面:

-

数据偏差:训练数据中的错误或片面性会被模型放大。比如,如果医学领域的训练数据中有过时的论文,AI就可能得出错误的结论。

-

泛化困境:模型难以处理训练集外的复杂场景。比如,预测南极冰层融化对非洲农业的影响,AI可能就无能为力。

-

知识固化:AI过度依赖参数化记忆,缺乏动态更新能力。所以,对于2023年后的事件,它可能会完全虚构。

-

意图误解:当用户提问模糊时,AI容易"自由发挥"。比如,你问"介绍深度学习",它可能会偏离你的实际需求。

📊 AI幻觉的评测

研究人员对DeepSeek和其他大模型进行了严格的评测。结果显示,DeepSeek V3的幻觉率是2%,而DeepSeek R1的幻觉率是3%。不过,在事实性幻觉测试中,DeepSeek V3的幻觉率高达29.67%,DeepSeek R1也有22.33%。这说明,AI在生成内容时,确实存在不少问题。🔍

🛡️ 如何应对AI幻觉?

别担心,研究人员也给出了很多应对方法。比如,联网搜索可以显著降低幻觉率;双AI验证和大模型协作,可以让AI相互监督;提示词工程则可以通过限定知识边界、添加专业身份限定等方式,减少AI的错误。💪

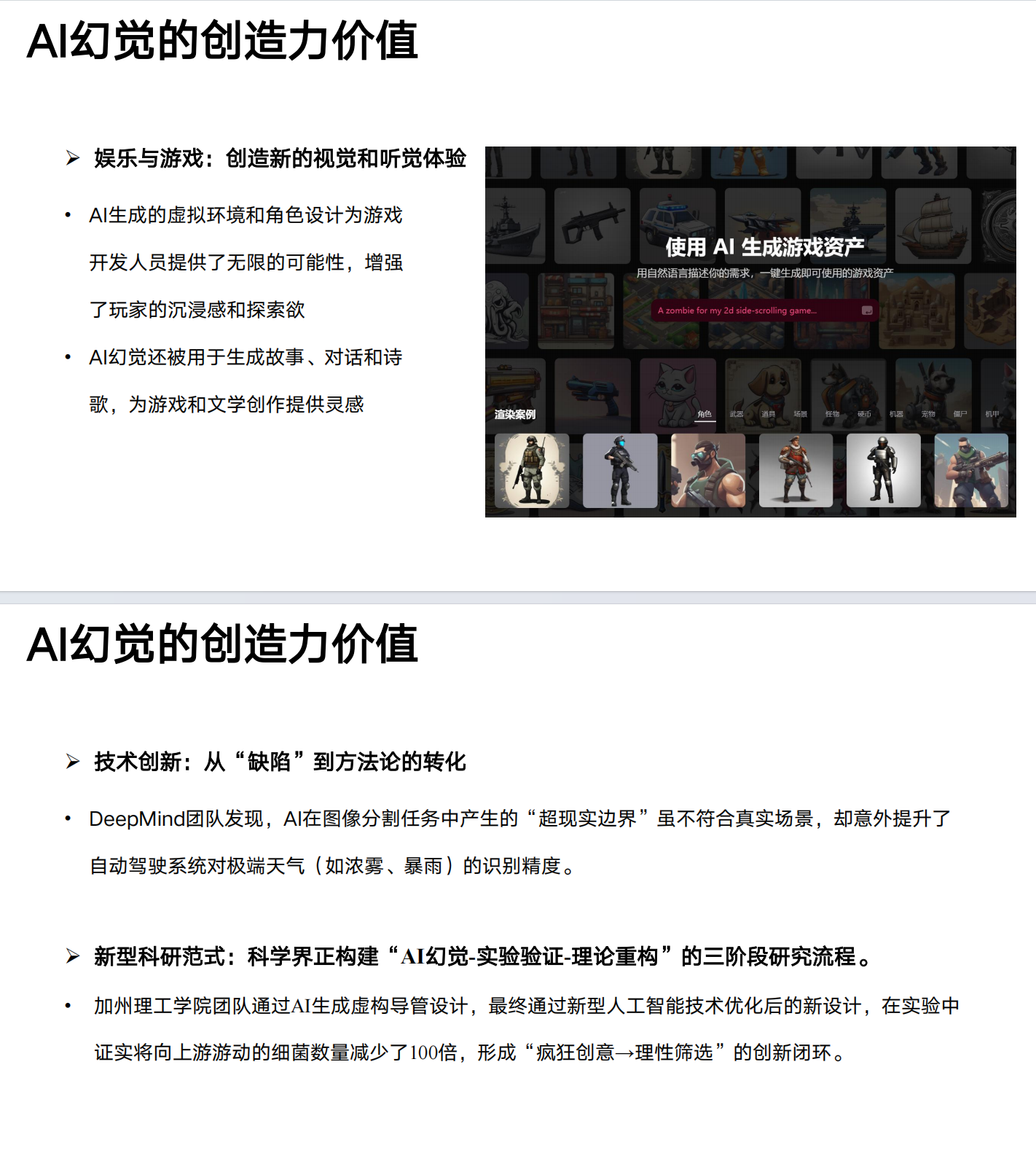

🎨 AI幻觉的创造力价值

虽然AI幻觉听起来很可怕,但它也有积极的一面。比如,在蛋白质设计领域,AI的"错误折叠"启发了新型蛋白质结构,甚至获得了2024年的诺贝尔化学奖!在文艺与设计领域,AI幻觉可以突破人类思维定式,创造出"超现实"的作品。在娱乐与游戏领域,AI生成的虚拟环境和角色设计,为玩家提供了全新的体验。