文章目录

背景

在使用大模型处理书籍 PDF 时,有时你会遇到扫描版 PDF,也就是说每一页其实是图像形式。这时,大模型需要先从图片中提取文本,而这就需要借助 OCR(光学字符识别)技术。

像 Gemini 2.5 这样的强大模型,具备非常强的从图片中提取文本的能力。实际上,我们完全可以利用它来执行 OCR 任务。

利用这样的大模型进行 OCR,不仅能处理复杂的图像场景,还能理解文本的结构,保留格式,并正确处理表格、标题等内容,为后续的文本分析、自动化处理和智能搜索提供强大的支持。这种结合 OCR 和 NLP 的智能文档处理方式,正在成为解决实际问题的强大工具。

然而,像 Gemini 这样的强大模型只能通过远程访问,且存在 API 受限和高成本的问题。那么,是否有可能在本地部署类似的大模型来完成这一任务呢?

虽然本地部署或直接安装已经有很多方案,后期文章中我们也将逐一比较 。但我们 更想自己手撸一个,想着将来大模型不断升级之中我们也能紧随其后直接升级是不**。**

大模型介绍

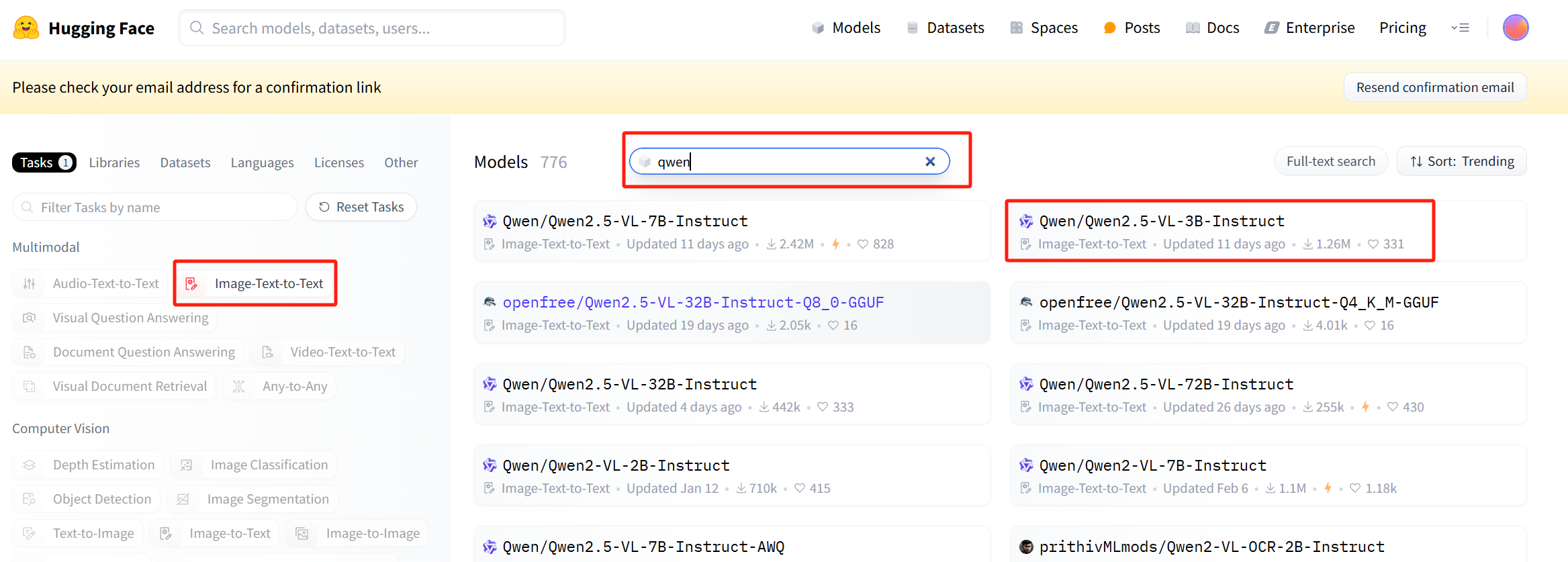

首先,我们去 Hugging Face 找找具有这种本事的大模型。

地址:https://huggingface.co/models?pipeline_tag=image-text-to-text\&sort=trending\&search=qwen

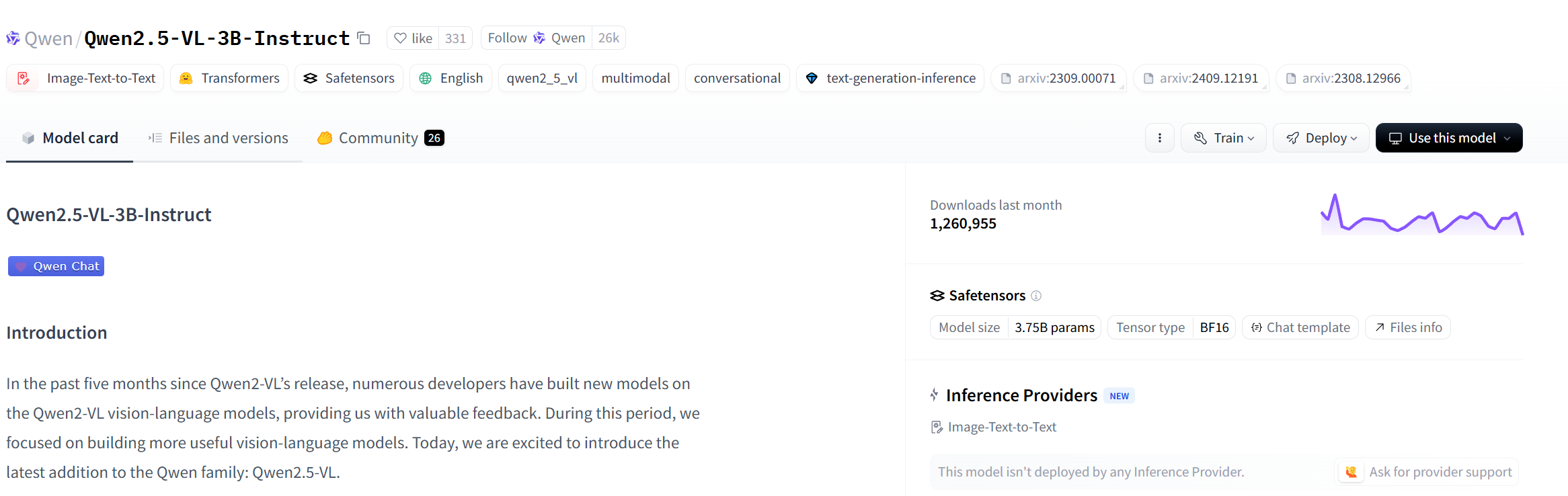

看到 Image-Text-to-Text 没有,它表示模型能够处理图像和文本输入,符合我们的任务要求。点击进去,首先看到的是一批新发布的模型,我们筛选Qwen模型,找到指定版本模型:https://huggingface.co/Qwen/Qwen2.5-VL-3B-Instruct

选这个模型的主要原因是参数数量少,配置要求低,可以在云端部署,也可以在本地笔记本上运行。我就先部署到Google Colab上运行试下,没问题可以部署在本机环境,对外发布进行调用。

原理分析

本项目的任务明确如下:实现一个本地部署的多模态大语言模型,如 Qwen2.5-VL,用于从 PDF 文件中提取文字内容并完成 OCR 任务,最好保留表格形式,并将其转换为 Markdown 文档。模型是可选的,只需调整参数即可切换到其他模型。尽管这个功能看似简单,但它为后续更复杂任务奠定了基础。

我们使用两款电脑来测试:Macbook Air M3 处理器,16G 内存;Ubuntu,V100 32G 显存。

用到的库

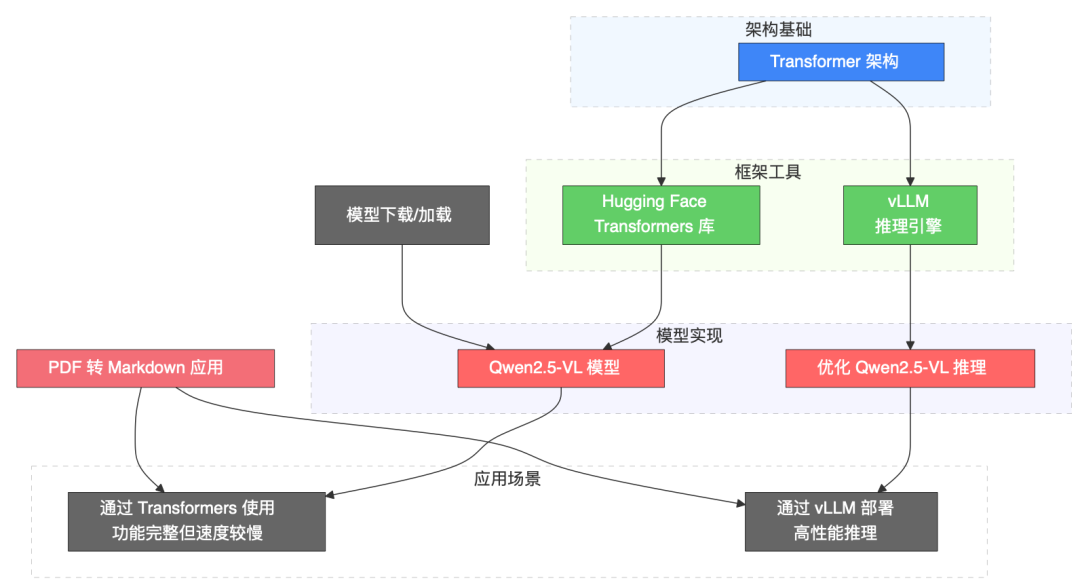

该项目主要涉及三部分,即 Transformers, vLLM 以及具体的大模型如 QWen2.5-VL。这个模型是基于 Transformer 架构开发的多模态模型。具体通过 Hugging Face 的 Transformers 库来加载和使用它,并选择使用 vLLM 来优化 Qwen2.5-VL 模型的推理性能。考虑到后期可能会实际部署到高性能电脑上,因此选择 vLLM,而不是 Ollama。

Transformers, vLLM 以及 QWen2.5-VL 之间的关系如下图所示。

这个关系图展示了三者之间的依赖和协作,具体如下,

Transformers是基础框架:QWen2.5-VL的代码和模型结构依赖于Hugging Face Transformers库。开发者和用户需要安装最新版本的Transformers来加载和运行QWen2.5-VL。vLLM是推理优化引擎:vLLM增强了QWen2.5-VL的推理性能,尤其是在处理视觉和视频任务时。它通过张量并行、动态内存管理等技术,使QWen2.5-VL能够在生产环境中高效运行。vLLM需要与Transformers配合使用,并确保版本兼容(例如,某些版本的Transformers可能需要从源代码安装)。QWen2.5-VL是应用模型:它是具体的多模态模型,利用Transformers提供的架构和vLLM的推理优化来实现其功能。换句话说,QWen2.5-VL的设计目标是处理复杂的视觉语言任务,而Transformers和vLLM则是其技术支撑。

程序流程

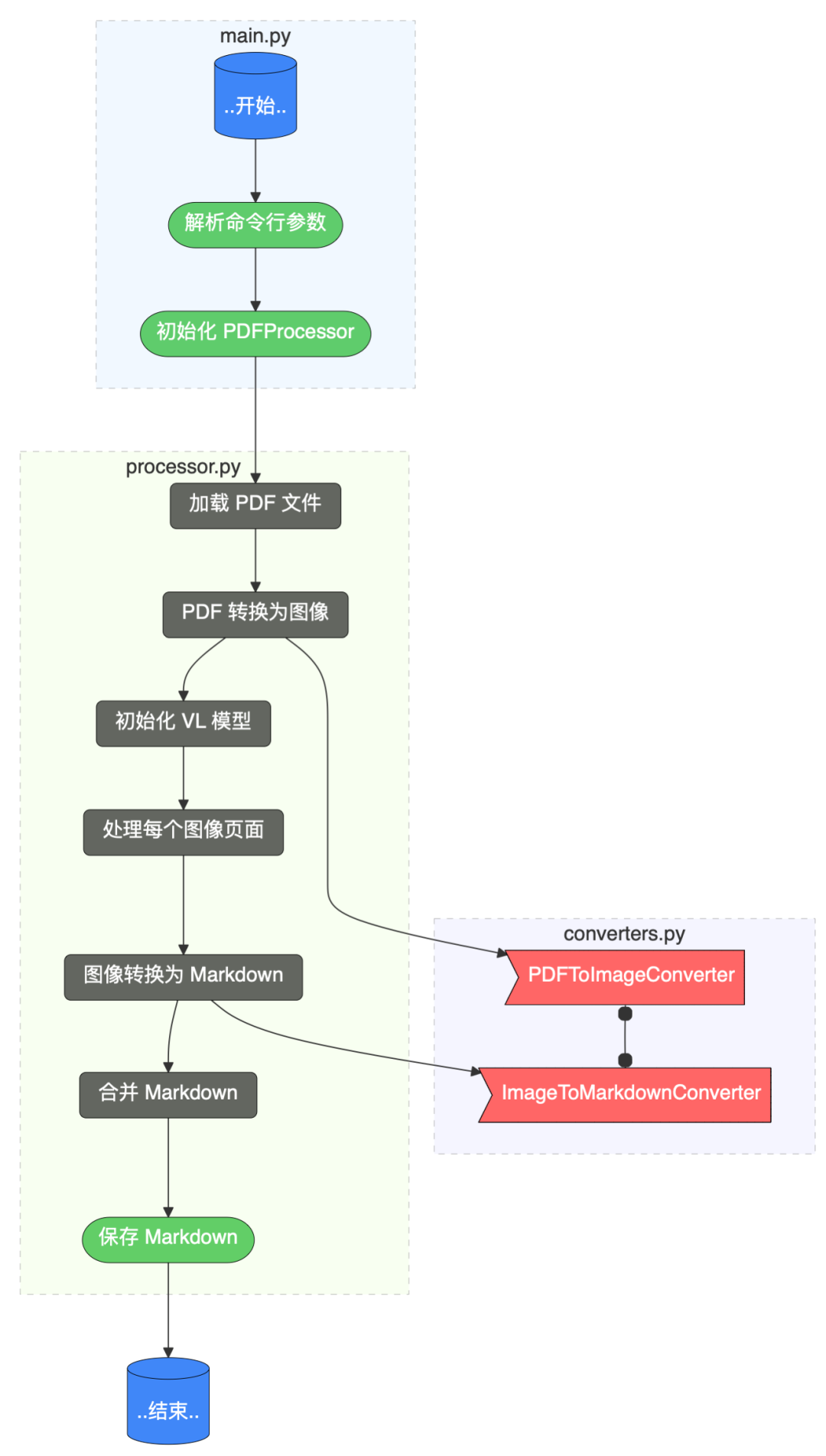

程序流程以及几个主要 Python 文件之间的关系如下图所示。

这个程序的主要功能是将 PDF 文件转换为 Markdown 格式,整个流程可以总结如下:

1、命令行参数解析:通过 cli.py 中的 parse_args 函数解析用户输入的命令行参数;主要参数包括:PDF 文件路径、模型路径、输出文件路径等。

2、初始化处理器:在 main.py 中初始化 PDFMarkdownProcessor 处理器;该处理器是整个转换过程的核心控制器。

3、PDF 处理阶段:加载指定的 PDF 文件;使用 PDFToImageConverter 将 PDF 文件转换为图像序列,图像分辨率默认为 1024 宽。

4、模型初始化:加载指定的视觉语言模型(如 Qwen2.5-VL-3B-Instruct);该模型需要提前下载到本地指定目录。

5、图像处理与转换:对每个 PDF 页面生成的图像进行处理;使用 ImageToMarkdownConverter 将图像内容转换为 Markdown 文本;这一步利用视觉语言模型识别图像中的文本、表格、图片等内容。

6、结果整合与输出:合并所有页面转换得到的 Markdown 内容;将最终的 Markdown 文本保存到指定的输出文件中。

整个流程体现了模块化设计思想,各个组件职责明确,便于维护和扩展。用户只需通过简单的命令行参数即可完成从 PDF 到 Markdown 的转换过程。

模型下载

可以通过命令 huggingface-cli download 来下载 Qwen2.5-VL

bash

! huggingface-cli download --resume-download --local-dir-use-symlinks False Qwen/Qwen2.5-VL-3B-Instruct --local-dir /content/samole_data/local_models/Qwen2.5-VL-3B-Instruct但如果 huggingface 不方便使用,可以选择用 modelscope。

比如我们要使用的这个模型文件放在这里:https://modelscope.cn/models/Qwen/Qwen2.5-VL-3B-Instruct/files

先安装 modelscope:

bash

! pip install modelscope然后用以下命令

! modelscope download --model Qwen/Qwen2.5-VL-3B-Instruct --local_dir /content/samole_data/local_models/Qwen2.5-VL-3B-Instruct将完整模型库文件下载到Google Colab的本地目录 /content/samole_data/local_models/Qwen2.5-VL-3B-Instruct 中。

转化效果

使用的GPU是T4,对于 1024 分辨率的图像,转化一页需要三、四分钟,虽然有点久,但至少也能跑起来了。

! python /content/pdf2md/main.py --pdf /content/pdf2md/test_ocr.pdf --model /content/samole_data/local_models/Qwen2.5-VL-3B-Instruct --output output.md

如果页面较清晰,可以降低分辨率,那样自然会提高转化效率。另外,程序中有个参数 quantization=None 表明没有启用量化,保持了模型的完整精度。如果想进一步提高效率,可以使用量化版本,即 Qwen/Qwen2.5-VL-3B-Instruct-AWQ。

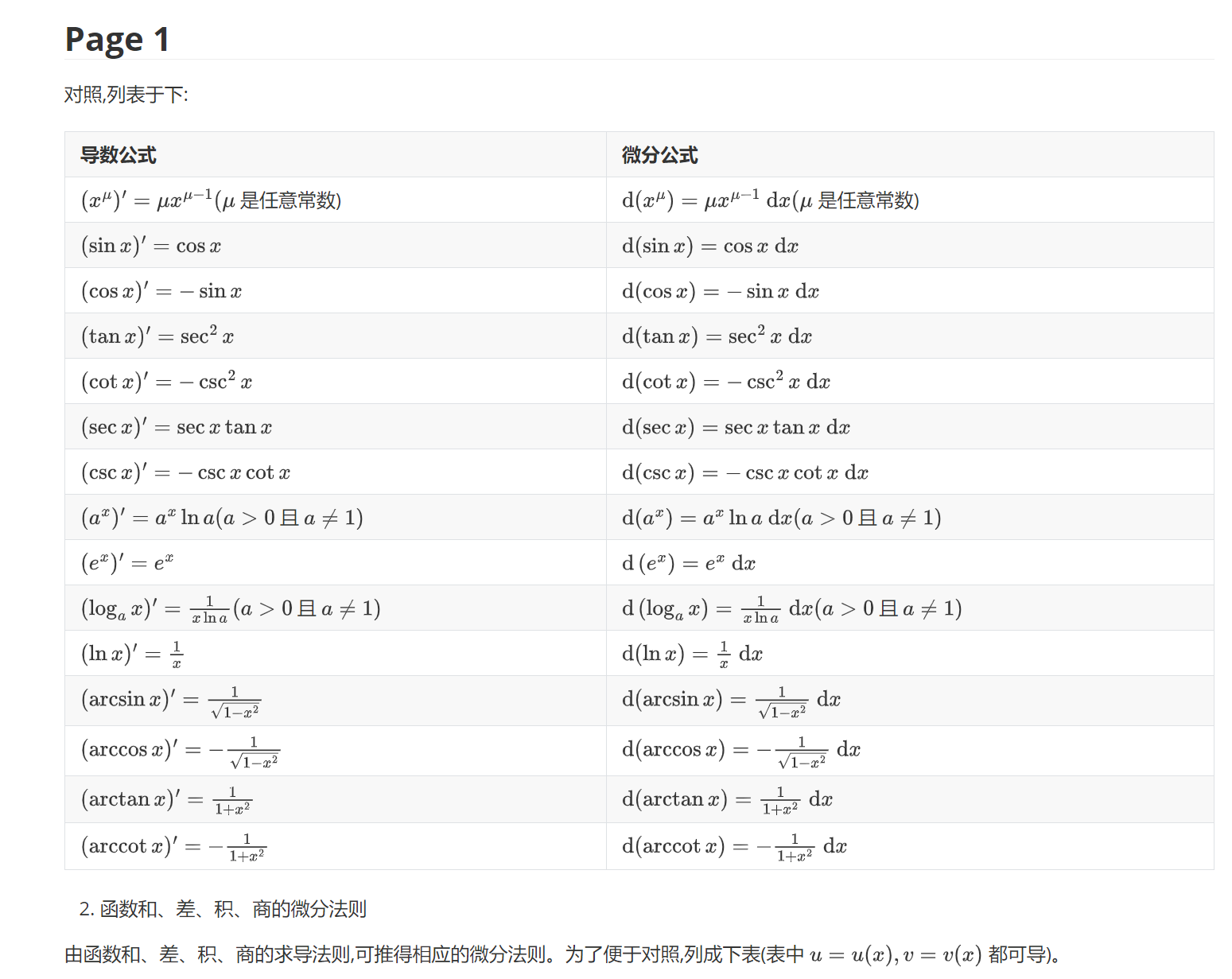

从 PDF 文件中提取的图像转化为 Markdown 后,效果如下图所示。是不是文字、表格和数学公式都还保持的不错。

参考文献

- https://huggingface.co/Qwen/Qwen2.5-VL-3B-Instruct/tree/main

- https://blog.csdn.net/weixin_43196262/article/details/135268100

- 机器学习与数学

- https://github.com/mathinml/pdf2md

3bd33c45f53d5e9f7ee53&sharer_shareinfo_first=e1f941a6f6c3bd33c45f53d5e9f7ee53#rd) - https://github.com/mathinml/pdf2md