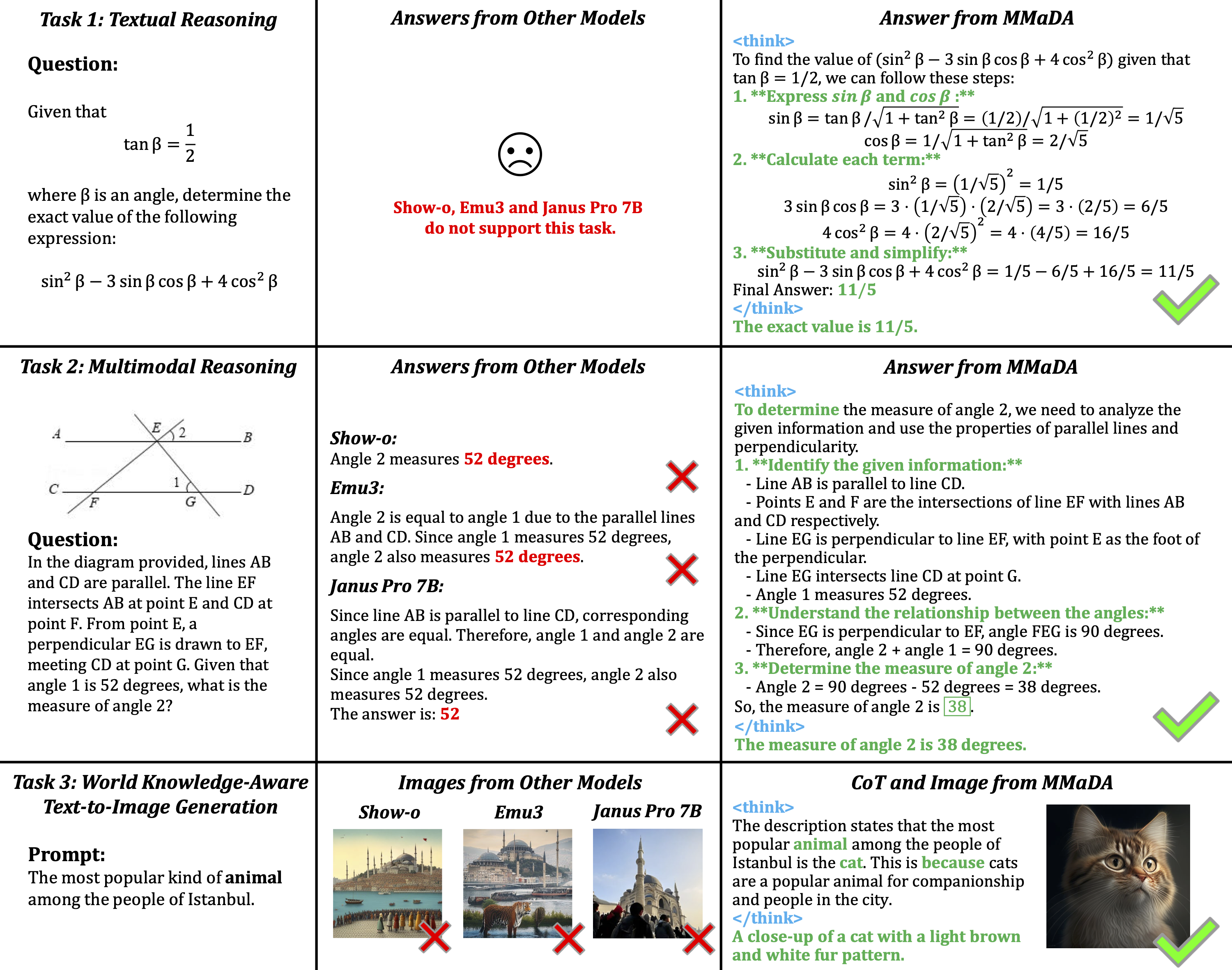

MMaDA是一个全新的多模态扩散基础模型家族,旨在文本推理、多模态理解和文生图等多个领域实现卓越性能。该模型凭借三大创新点脱颖而出:

- 采用统一扩散架构:共享概率框架与模态无关设计,无需特定模态组件

- 创新混合长思维链微调策略:跨模态构建统一思维链格式

- 开发专用强化学习算法UniGRPO:基于策略梯度的统一训练方法,通过多样化奖励建模实现推理与生成任务的后训练统一,确保持续性能提升

📰 最新动态

-

2025-05-22\] 我们发布了MMaDA模型的推理与训练代码,支持文本生成、多模态生成及图像生成任务。

-

2025-05-22\] 首篇统一多模态扩散模型MMaDA的[研究论文](https://arxiv.org/abs/2505.15809)及[演示平台](https://huggingface.co/spaces/Gen-Verse/MMaDA)正式上线。

MMaDA 包含一系列反映不同训练阶段的检查点:

- MMaDA-8B-Base: 在预训练和指令微调之后。具备基本的文本生成、图像生成、图像描述和思维能力。

- MMaDA-8B-MixCoT (coming soon): 经过混合长思维链(CoT)微调。具备复杂的文本、多模态和图像生成推理能力。将于两周内发布。

- MMaDA-8B-Max (coming soon): 经过UniGRPO强化学习后,擅长复杂推理和惊艳的视觉生成。将在一个月后发布。

⚙️ 快速入门

首先,设置环境:

bash

pip install -r requirements.txt启动本地 Gradio 演示:

bash

python app.py🚀 推理

对于批量级别的推理任务,我们在此提供相关的推理脚本。

1. 文本生成

在文本生成方面,我们遵循LLaDA的配置和生成脚本。只需运行:

bash

python generate.py2. 多模态生成

对于多模态生成和文本到图像生成,首先登录您的wandb账户:

bash

wandb login多模态生成推理演示,您可以在wandb上查看结果

bash

python3 inference_mmu.py config=configs/mmada_demo.yaml mmu_image_root=./mmu_validation question='Please describe this image in detail.' 3. 文本到图像生成

对于多模态生成和文本到图像生成,首先登录您的wandb账户:

bash

wandb login文本到图像生成的推理演示,您可以在wandb上查看结果

bash

python3 inference_t2i.py config=configs/mmada_demo.yaml batch_size=1 validation_prompts_file=validation_prompts/text2image_prompts.txt guidance_scale=3.5 generation_timesteps=15

mode='t2i'