一、 发布日期与背景

2025年5月29日,备受业界关注的DeepSeek推理模型DeepSeek-R1迎来重要更新------DeepSeek-R1-0528模型正式发布。此次更新采取了"静默发布"策略,未提前预告,而是通过官方渠道(官网、App、小程序)及开源平台(Hugging Face)同步开放。

Hugging Face 链接: https://huggingface.co/deepseek-ai/DeepSeek-R1-0528

尽管官方在社群中将其定位为一次"试升级"(小版本迭代,非预期的R2主版本),但实测性能,尤其在编程能力 与推荐系统表现上的跃升幅度远超预期,被开发者社群广泛评价为"具备R2雏形"或"R2的预演版",迅速引发全球AI社区的高度关注与热议。

部署与兼容性:

- 用户可通过DeepSeek官方网页、App及小程序,启用"深度思考"功能即刻体验DeepSeek-R1-0528。

- 关键兼容性: 本次升级保持了API接口与调用方式的完全兼容性,用户无需修改现有集成代码。

- 模型对应关系:

deepseek-chat模型(原对应DeepSeek-V3-0324/deepseek-reasoner)现已统一更新为DeepSeek-R1-0528。

二、 核心升级与技术亮点

DeepSeek-R1-0528在DeepSeek-V3的坚实基座上,通过扩展算力投入 和引入更高质量、更大规模、更具时效性的训练数据集 ,显著提升了模型的思维深度、逻辑严谨性 和复杂推理能力。

1. 参数规模与架构精进:

-

- 在原始DeepSeek-R1(6720亿参数)基础上,扩展至6780亿参数。

- 采用先进的稀疏混合专家(Sparse Mixture-of-Experts, MoE)架构。

- 核心优化:改进了专家激活机制 与内部路由策略 ,实现了更高效的专家参数利用分布。这不仅显著降低了推理时的显存占用 ,还进一步提升了推理速度。

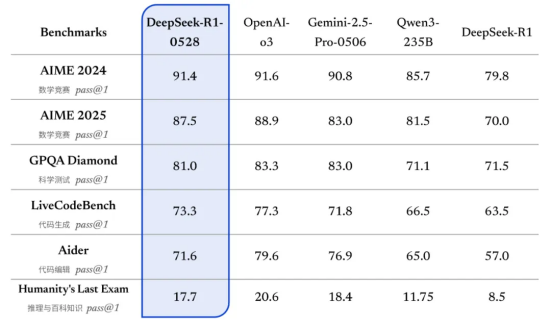

2. 性能显著跃升(关键指标):

-

- 代码生成能力:

- 在权威的LiveCodeBench基准测试中,R1-0528取得了73.1分的优异成绩。

- 代码生成准确率较前版本(DeepSeek-R1)提升3%-5% ,综合排名第四 ,性能已逼近OpenAI GPT-4o与Google Gemini 2.5 Pro。

- 推理效率:

- 平均推理速度提升8%-10%,在处理长代码文件、多步骤数学/逻辑推理任务时效率优势尤为明显。

- 事实性与逻辑性:

- "幻觉"问题(输出错误或捏造事实)的发生率被显著降低45%-50% ,输出结果的逻辑连贯性与事实准确性更接近人类专家水平。

- 代码生成能力:

3. 功能边界拓展:

-

- 前端开发能力增强: 生成的网页界面代码(HTML/CSS/JS)更符合现代设计规范 ,能够有效实现动态动画 和复杂交互逻辑(例如生成功能完整的SAS着陆页UI组件)。

- 多语言与长文本处理卓越:

- 中文长文本生成与理解能力突出 ,在需要深度推理的任务上表现优异(例如,在模拟AIME 2025数学竞赛题上,准确率从~70%跃升至87.5%)。

- 完整支持128K上下文窗口,有效处理超长文档、代码库分析等场景。

三、 与主流竞品对比分析

1. vs. OpenAI ChatGPT-4o:

在代码生成和纯逻辑推理任务上,R1-0528表现接近甚至局部超越GPT-4o。

在多模态理解和复杂工具调用(如联网搜索、代码执行器)方面,目前仍略逊于GPT-4o/Claude等闭源模型的集成方案。

2. vs. Anthropic Claude 3.7:

R1-0528的代码生成能力被广泛认为可类比Claude 3.7。

关键优势: R1-0528展现出更低的幻觉率,且在创意写作连贯性和特定场景下的工具调用灵活性上可能更具优势。

3. vs. 闭源模型(综合性价比):

以接近Claude 4级别(指Claude 3 Opus)的核心推理与编码性能,R1-0528通过API提供的成本仅为约$0.50 / 百万输入tokens。

此价格仅为主流闭源顶级模型API成本的约1/7,性价比优势极为显著。

4. vs. 其他开源模型:

在同等量级下,R1-0528在推理深度、代码能力、中文理解及长上下文处理方面确立了当前开源领域的领先地位。

四、 核心特色与应用场景

1. 高效推理引擎:

稀疏MoE架构是其高效处理复杂任务的基石,在保持高精度的同时优化资源消耗。典型应用:快速生成包含动态交互元素的完整前端模块(如SAS页面),并支持样式深度定制。

2. 多领域赋能潜力:

开发者生产力工具: 辅助生成高质量Python脚本、游戏逻辑、API接口代码等,无缝集成主流IDE,大幅减少编码与调试时间。

教育内容与创意生成: 在要求逻辑严密的长文本创作(如科幻小说)中,能高效生成数百行结构清晰、逻辑自洽的内容。

企业级应用: 已登陆百度智能云千帆、纳米搜索等平台,适用于智能客服、自动化报告生成、数据分析洞察、知识库问答等场景。

3. 强大的开源生态优势:

开放包容: 采用MIT许可证,允许用户自由下载模型权重、本地部署、微调及商用,极大降低技术应用门槛。

完整能力开放: 开源版本同样支持128K上下文,确保本地部署用户能体验到与API一致的核心能力。

社区活跃: 发布后在Hugging Face等平台迅速获得高关注度与下载量,社区围绕其进行的微调、应用开发与评测持续涌现。

五、 当前挑战与未来展望

1. 存在的局限:

过度思考倾向: 在部分开放式或模糊任务中,模型可能陷入过度的自我验证循环,导致响应延迟。

工具链整合: 与闭源竞品相比,内置工具调用(如代码执行、搜索)的成熟度和易用性仍有提升空间。

2. 社区期待:

官方尚未公布下一代R2模型的具体时间表,开发者期待其在推理深度优化、多模态能力整合(若适用)以及更智能的任务分解与工具使用上带来新的突破。

六、 结语

DeepSeek-R1-0528的发布,是开源大型语言模型发展历程中的一次重要里程碑。它不仅大幅提升了推理能力 与代码生成水平 ,逼近国际顶尖闭源模型,更凭借其卓越的性价比 和彻底的开源开放性 ,为全球开发者、企业及研究者提供了强大的AI基础设施。DeepSeek-R1-0528正在重新定义AI工具的可能性边界,并有力推动着中文乃至全球开源AI生态的创新与繁荣。其成功验证了开源路径在追求尖端AI能力上的巨大潜力,为行业的未来发展注入了强劲动力。