前言

特征点检测与匹配是计算机视觉中的基础技术,广泛应用于图像拼接、物体识别、三维重建、运动跟踪等领域。OpenCV 提供了多种特征检测与匹配算法的实现。

特征点检测与匹配是计算机视觉中的核心技术,广泛应用于多个领域。以下是其主要应用场景:

-

图像拼接(全景图生成):旅游摄影、卫星图像处理、医学图像拼接

-

图像修复与增强:老照片修复、艺术品数字化

-

产品质量检测:电子元件检测、包装完整性检查

-

自动光学检测(AOI):PCB板检测、液晶面板检测

-

运动目标跟踪:智能监控、交通流量分

-

人脸识别与验证:门禁系统、移动支付

常用算法:

特征点检测:

-

Harris 角点检测

-

Shi-Tomasi 角点检测

-

SIFT

-

SURF

-

ORB

特征匹配:

-

BFMatcher (暴力匹配)

-

FLANN 匹配器

一、角点

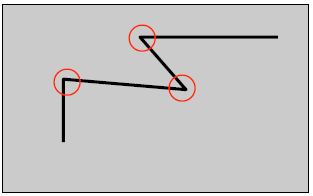

通常意义上来说,角点就是极值点,即在某方面属性特别突出的点, 是在某些属性上强度最大或者最小的孤立点、线段的终点。 对于图像而言,如图所示圆圈内的部分,即为图像的角点,其是物体轮廓线的连接点。

角点是指图像中各个方向上灰度变化都非常剧烈的点,具有以下特点:

-

在两个正交方向上都有明显的梯度变化

-

是图像中边缘的交点

-

局部窗口内无论向哪个方向移动,图像灰度都会发生显著变化

角点检测算法基本思想是使用一个固定窗口(取某个像素的一个邻域窗口)在图像上进行任意方向上的滑动,比较滑动前与滑动后两种情况,窗口中的像素灰度变化程度,如果存在任意方向上的滑动,都有着较大灰度变化,那么我们可以认为该窗口中存在角点。

二、Harris 角点检测

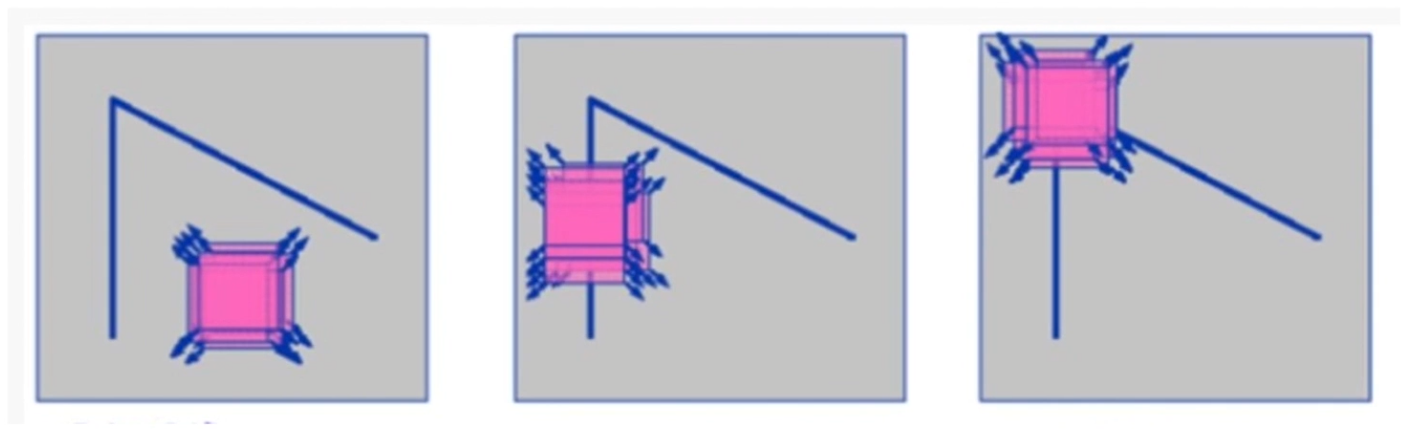

1. 基本思想

Harris角点检测基于一个核心观察:角点是图像中在各个方向上灰度变化都很剧烈的点。算法通过分析图像窗口在各个方向的移动引起的灰度变化来检测角点。

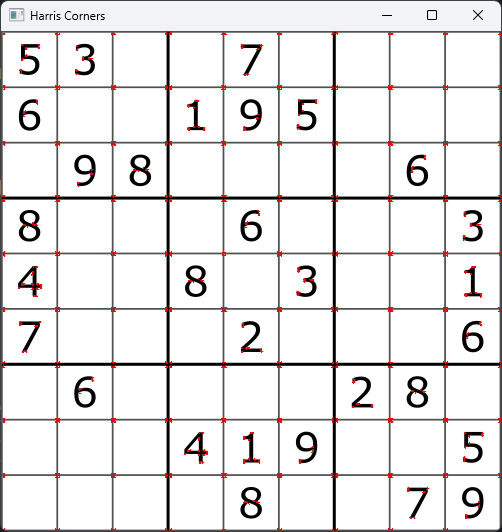

2.OpenCV实现

python

# harris角点检测

import cv2

img = cv2.imread('../chess.png')

# 灰度化

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# Harris角点检测

# 参数说明:

# blockSize - 邻域大小

# ksize - Sobel算子孔径

# k - Harris检测器自由参数

dst = cv2.cornerHarris(gray, 2, 3, 0.04)

# 角点展示

img[dst > 0.01 * dst.max()] = [0, 0, 255]

cv2.imshow('Harris Corners', img)

cv2.waitKey(0)

cv2.destroyAllWindows()运行后的结果:

3.函数解析

def cornerHarris(src, blockSize, ksize, k)

-

blockSize:

-

邻域窗口大小

-

值越大,检测的角点越"粗"

-

典型值:2-5

-

-

ksize:

-

Sobel算子的孔径参数

-

必须是奇数且≤31

-

影响梯度计算的精度

-

典型值:3或5

-

-

k:

-

Harris检测器的自由参数

-

值越小,检测到的角点越多

-

经验值范围:0.04-0.06

-

4.算法特点

优点

-

旋转不变性:角点旋转后仍能被检测

-

部分光照不变性:对均匀光照变化不敏感

-

计算效率高:适合实时应用

-

对噪声有一定鲁棒性(指该算法在图像存在噪声干扰的情况下,仍能相对稳定地检测出正确的角点位置,不会因小的噪声干扰而产生大量虚假角点或丢失真实角点)

缺点

-

不具有尺度不变性:图像缩放后可能检测不到相同角点

-

对阈值敏感:需要根据图像调整阈值参数

-

角点可能聚集:在纹理丰富区域可能检测到过多角点

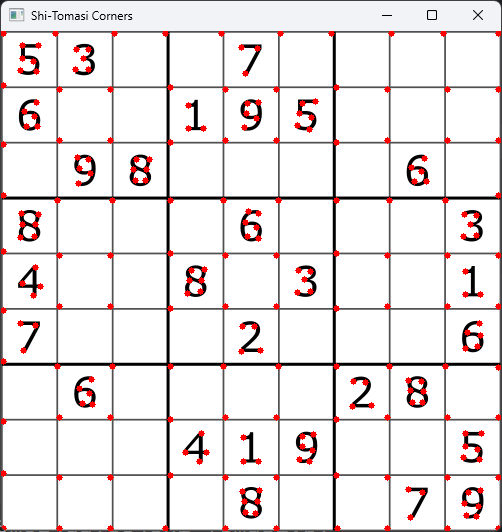

三、Shi-Tomasi 角点检测

Shi-Tomasi角点检测方法是基于Harris角点检测的一种改进,它在多个方面提供了更好的性能和精度。Shi-Tomasi方法的核心思想是通过评估图像的最小特征值来识别角点。

1.OpenCV实现

python

# Shi-Tomasi角点检测(常用)

import cv2

import numpy as np

img = cv2.imread('../chess.png')

# 灰度化

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# Shi-Tomasi参数

corners = cv2.goodFeaturesToTrack(gray, 1000, 0.01, 10)

# 转为整数

corners = np.int64(corners)

# 绘制角点

for i in corners:

x, y = i.ravel()

cv2.circle(img, (x, y), 3, (0, 0, 255), -1)

cv2.imshow('Shi-Tomasi Corners', img)

cv2.waitKey(0)

cv2.destroyAllWindows()运行后的结果:

2.函数解析

def goodFeaturesToTrack( src, maxCorners, qualityLevel, minDistance)

| 参数 | 说明 | 建议值 |

|---|---|---|

maxCorners |

表示最多可以检测到的角点数量,如果图像中存在更多角点,只保留质量最高的前 n 个。 | 根据需求设定 |

qualityLevel |

角点质量阈值(相对最佳角点的比例),角点质量分数的最小值。只有质量高于该值的点才会被保留。值越小,保留的角点数量越多。 | 0.01-0.1 |

minDistance |

角点间最小欧式距离,任意两个角点之间的像素距离必须大于该值,用于避免角点过于密集 | 3-10像素 |

3.算法特点

优势

-

更直观的阈值设定:直接使用特征值,无需调整k参数

-

角点分布更均匀:通过minDistance参数控制

-

计算效率更高:避免计算完整的响应函数

劣势

-

对阈值的绝对依赖:qualityLevel需要根据图像调整

-

固定角点数量:可能遗漏部分角点

四、SIFT(尺度不变特征变换)

1.核心特征

-

尺度不变性:

-

通过高斯差分金字塔检测不同尺度的特征

-

自动确定特征点所在的最佳尺度

-

-

旋转不变性:

-

基于局部梯度方向分配主方向

-

描述符相对于主方向构建

-

-

光照鲁棒性:

-

使用梯度信息而非绝对灰度值

-

对线性光照变化不敏感

-

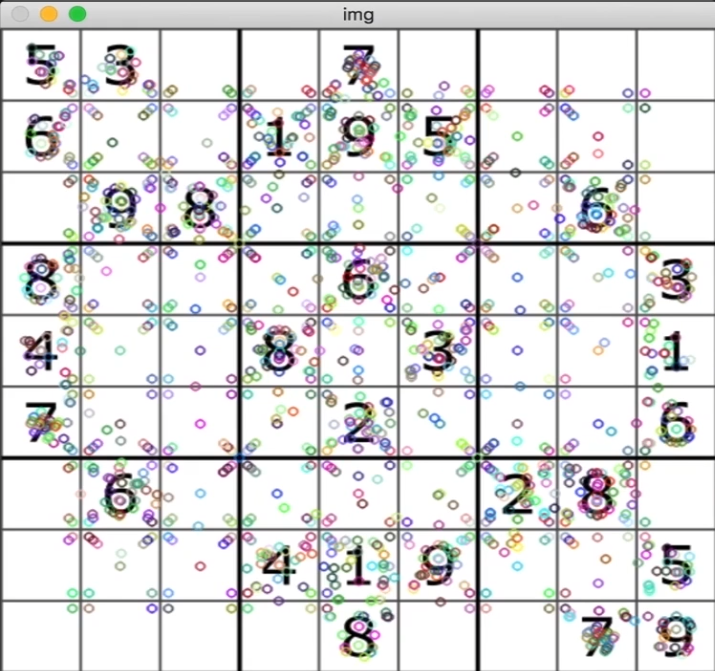

2.OpenCV实现

这里我使用的版本是4.12,因为sift的专利已经过期,可以直接使用

import cv2

img = cv2.imread('../chess.png')

# 灰度化

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 创建sift对象

sift = cv2.SIFT_create()

# 检测关键点与描述子

kp, des = sift.detectAndCompute(gray, None)

# 绘制关键点

cv2.drawKeypoints(gray, kp, img)

cv2.imshow('img', img)

cv2.waitKey(0)

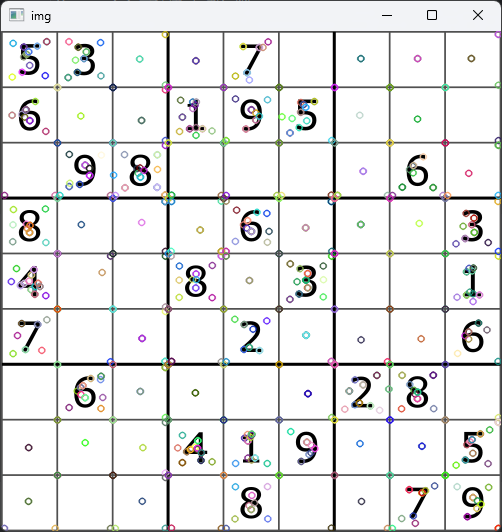

cv2.destroyAllWindows()运行结果:

3.关键点与描述子

关键点

- 本质:图像中具有显著特性的局部特征位置

- 核心属性:空间信息(坐标、尺度(σ))、几何特性(主方向、响应强度)

描述子:记录了关键点周围对其有贡献的像素点的一组向量值,其不受仿射变换、光照变换等影响

4.算法特性

优点:

- 尺度不变性:在图像缩放±50%时仍能保持80%以上的特征重复率

- 旋转不变性:图像旋转30°时匹配准确率>90%

- 光照鲁棒性:对光照变化和对比度拉伸的抵抗能强

- 高区分度描述子:128维向量提供丰富的特征信息

缺点:

- 计算复杂度高

- 对模糊敏感:模糊图像下的性能衰减

- 边缘响应问题

五、SURF

SURF是SIFT算法的高效改进版本,在保持类似性能的同时显著提高了运算速度。

1.OpenCV实现

python

import cv2

img = cv2.imread('../chess.png')

# 灰度化

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 因为版权原因,不能使用

surf = cv2.xfeatures2d.SURF_create()

# 检测关键点与描述子

kp, des = surf.detectAndCompute(gray, None)

cv2.drawKeypoints(gray, kp, img)

cv2.imshow('img', img)

cv2.waitKey(0)运行后的结果:

2.与SIFT对比

| 特性 | SURF | SIFT |

|---|---|---|

| 计算速度 | 快3-5倍 | 较慢 |

| 描述符维度 | 64/128维 | 128维 |

| 尺度空间构建 | 盒式滤波器+积分图像 | 高斯金字塔 |

| 旋转不变性 | 基于Haar小波响应统计 | 梯度方向直方图 |

| 专利状态 | 有专利(OpenCV需特殊编译) | 已过期 |

| 光照鲁棒性 | 略优于SIFT | 优秀 |

六、ORB特征检测算法

ORB(Oriented FAST and Rotated BRIEF)兼具实时性和良好匹配性能,可以做到实时检测。

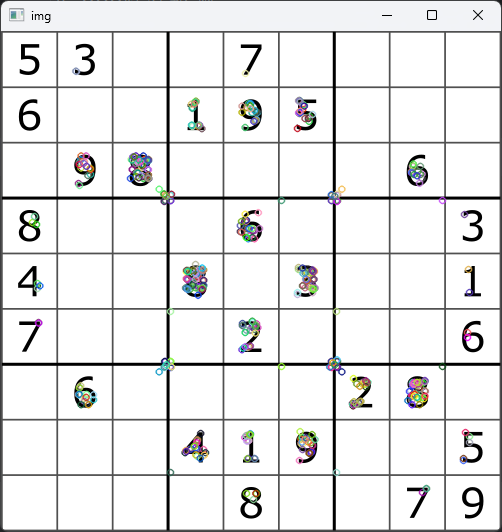

1.OpenCV实现

python

# ORB特征检测

import cv2

img = cv2.imread('../chess.png')

# 转为灰度图

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 创建ORB对象

orb = cv2.ORB_create()

kp, des = orb.detectAndCompute(gray, None)

# 绘制关键点

cv2.drawKeypoints(gray, kp, img)

cv2.imshow('img', img)

cv2.waitKey(0)

cv2.destroyAllWindows()运行后的结果:

2.算法特点

优点:

- 计算效率高

- 旋转不变性改进

- 尺度不变性(结合金字塔)

- 二进制描述符:匹配时可通过汉明距离(异或运算)快速计算,适合硬件加速

缺点:

- 对光照和噪声敏感:在光照剧烈变化或噪声较多时性能下降明显

- 缺乏仿射不变性:在极端视角变化下匹配效果较差

- 特征点分布不均

- 描述符区分性有限:在高相似纹理或重复场景中易误匹配,需依赖后续筛选

七、对比特征点检测算法

| 算法 | 速度 | 尺度不变性 | 旋转不变性 | 光照鲁棒性 | 适用场景 |

|---|---|---|---|---|---|

| Harris | 中 | ❌ | ❌ | 中 | 静态角点检测(如标定板) |

| Shi-Tomasi | 中 | ❌ | ❌ | 中 | 需要稳定角点的场景 |

| SIFT | 慢 | ✔️ | ✔️ | ✔️ | 高精度匹配(如全景拼接、3D重建) |

| SURF | 中 | ✔️ | ✔️ | ✔️ | 实时性要求较低的鲁棒匹配 |

| ORB | 快 | ✔️(金字塔) | ✔️(改进BRIEF) | ❌ | 实时应用(SLAM、AR、移动端) |

选择建议

-

实时性优先:选 ORB(如无人机、移动端 AR)。

-

精度优先:选 SIFT/SURF(如医学图像、三维重建)。

-

简单角点检测:Harris/Shi-Tomasi(如标定、低动态场景)。

-

平衡速度与鲁棒性:SURF 或 ORB + RANSAC 后处理。

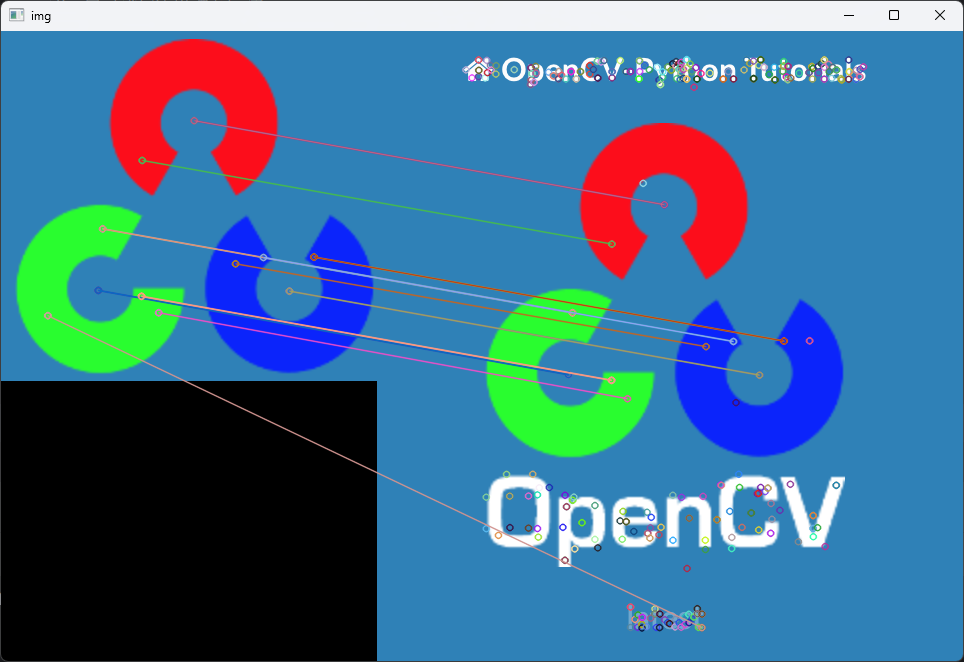

八、BFMatcher (暴力匹配)

BFMatcher 是 OpenCV 中一种基于暴力搜索(Brute-Force)的特征匹配方法,通过计算所有特征点之间的相似度来寻找最佳匹配。它适用于各种特征描述符(如 SIFT、SURF、ORB、BRIEF 等),但计算复杂度较高,适合小规模特征匹配或精度要求高的场景。

BFMatcher 的核心思想是 穷举搜索,即对两组特征描述符进行两两比对,选择最相似的匹配对。

1.OpenCV实现

python

# 暴力特征匹配方法

import cv2

img1 = cv2.imread('../opencv_search.png')

img2 = cv2.imread('../opencv_orig.png')

# 转为灰度图

gray1 = cv2.cvtColor(img1, cv2.COLOR_BGR2GRAY)

gray2 = cv2.cvtColor(img2, cv2.COLOR_BGR2GRAY)

# 创建sift对象

sift = cv2.SIFT_create()

# 检测关键点与描述子

kp1, des1 = sift.detectAndCompute(gray1, None)

kp2, des2 = sift.detectAndCompute(gray2, None)

# 暴力匹配

bf = cv2.BFMatcher(cv2.NORM_L1)

matches = bf.match(des1, des2)

# 绘制关键点

img3 = cv2.drawMatches(img1, kp1, img2, kp2, matches, None)

cv2.imshow('img', img3)

cv2.waitKey(0)

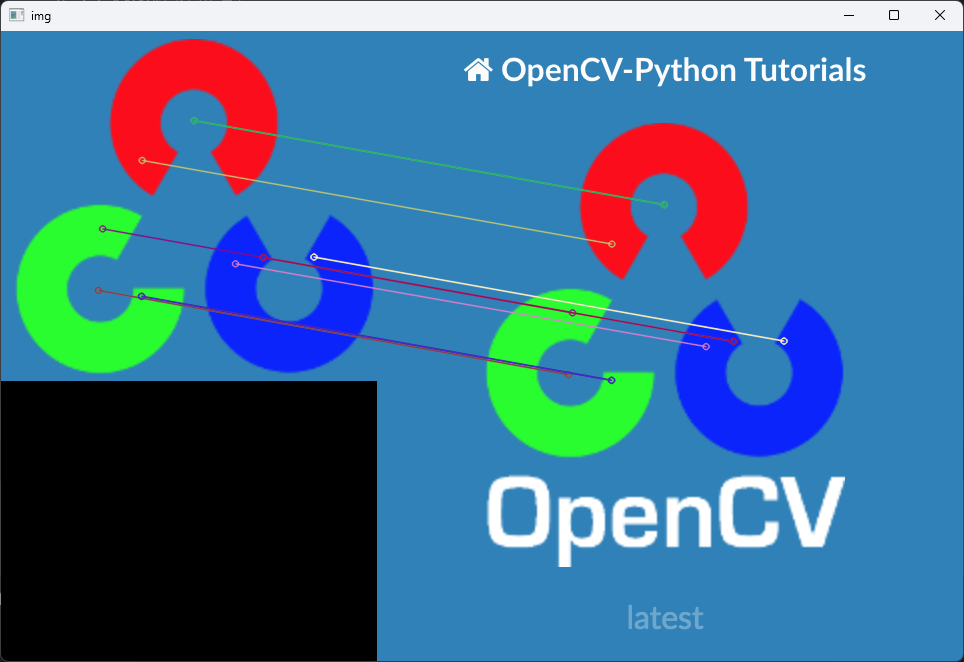

cv2.destroyAllWindows()运行结果:

2.算法特点

优点

✅ 高精度 :暴力搜索确保找到全局最优匹配,适合对匹配质量要求高的场景(如 SIFT/SURF)。

✅ 灵活性 :支持任意距离度量(如 NORM_L2 用于浮点描述符,NORM_HAMMING 用于二进制描述符)。

✅ 简单易用:OpenCV 提供直接接口,无需复杂参数调优。

缺点

❌ 计算复杂度高 :时间复杂度为 ,大数据量时极慢。

❌ 内存消耗大:需存储所有特征点的距离矩阵,不适合实时或大规模匹配。

九、FLANN 匹配器

FLANN 是 OpenCV 中用于高效近似最近邻搜索 的库,适用于大规模特征匹配(如 SIFT、SURF、ORB)。相比暴力匹配(BFMatcher),它通过空间分割(如 KD 树) 或层次聚类加速搜索,牺牲少量精度换取速度的大幅提升。

1.LANN 的核心原理

FLANN 通过以下两种主要方法加速最近邻搜索:

-

KD 树(KD-Tree)

-

适用于浮点型描述符(如 SIFT、SURF)。

-

将特征空间递归划分为超矩形区域,搜索时跳过无关区域。

-

需设置树的数量(

trees=4)和搜索次数(checks=32)。

-

-

局部敏感哈希(LSH)

-

适用于二进制描述符(如 ORB、BRIEF)。

-

通过哈希函数将相似特征映射到相同桶中,减少比较次数。

-

参数包括哈希表数量(

table_number)和键值长度(key_size)。

-

2.OpenCV实现

python

# FLANN特征匹配

import cv2

img1 = cv2.imread('../opencv_search.png')

img2 = cv2.imread('../opencv_orig.png')

# 转为灰度图

gray1 = cv2.cvtColor(img1, cv2.COLOR_BGR2GRAY)

gray2 = cv2.cvtColor(img2, cv2.COLOR_BGR2GRAY)

# 创建sift对象

sift = cv2.SIFT_create()

# 检测关键点与描述子

kp1, des1 = sift.detectAndCompute(gray1, None)

kp2, des2 = sift.detectAndCompute(gray2, None)

# flann

# FLANN索引的参数

index_params = dict(algorithm=1, trees=5)

# 搜索时的参数

search_params = dict(checks=50)

flann = cv2.FlannBasedMatcher(index_params, search_params)

# 对描述子进行匹配计算

matches = flann.knnMatch(des1, des2, k=2)

# 筛选匹配

good = []

for i, (m, n) in enumerate(matches):

if m.distance < 0.7 * n.distance:

good.append(m)

# 绘制关键点

img3 = cv2.drawMatchesKnn(img1, kp1, img2, kp2, [good], None, flags=2)

cv2.imshow('img', img3)

cv2.waitKey(0)运行后的结果:

3. 算法特点

优点

✅ 速度快 :比 BFMatcher 快 10~100 倍(尤其适合大规模数据)。

✅ 灵活性 :支持浮点和二进制描述符,参数可调。

✅ 内存友好:索引结构优化,适合嵌入式设备或实时系统(如 SLAM)。

缺点

❌ 近似匹配 :返回的结果是近似最优,可能遗漏真实最近邻。

❌ 参数敏感 :需根据数据分布调整 trees、checks 等参数。

参考文献:

角点(corner point)、关键点(key point)、特征点(feature point)概念辨析_关键角点-CSDN博客