近期,阿里巴巴旗下通义万相实验室开源了先进 AI 视频生成模型 Wan2.2, 包含文生视频、图生视频和统一视频生成三款模型,总参数量达 27B 。作为全球首个 MoE 架构视频模型,Wan2.2 不仅显著提升了视频生成的质量与计算效率,更实现了在英伟达 RTX 4090 等消费级显卡上的高效运行, 大幅降低了高质量视频生成的硬件门槛。同时首创电影级美学控制系统, 能精准控制光影、色彩、构图等美学效果,生成电影级质感效果,丰富完善了 AI 视频生成的艺术表达。在多个内部和外部 Benchmark 中,Wan2.2 领跑现有开源与闭源视频生成模型,展现出明确且显著的性能优势。

此次开源既是技术普惠之举,更为 AI 应用的开放生态持续注入活力。 短期来看,Wan2.2 的开源会吸引开发者共建工具链,加速行业创新;长期而言,结合全球 AI 算力需求增长和影视行业数字化趋势,有效推动了从工具赋能到生态共建的产业变革。

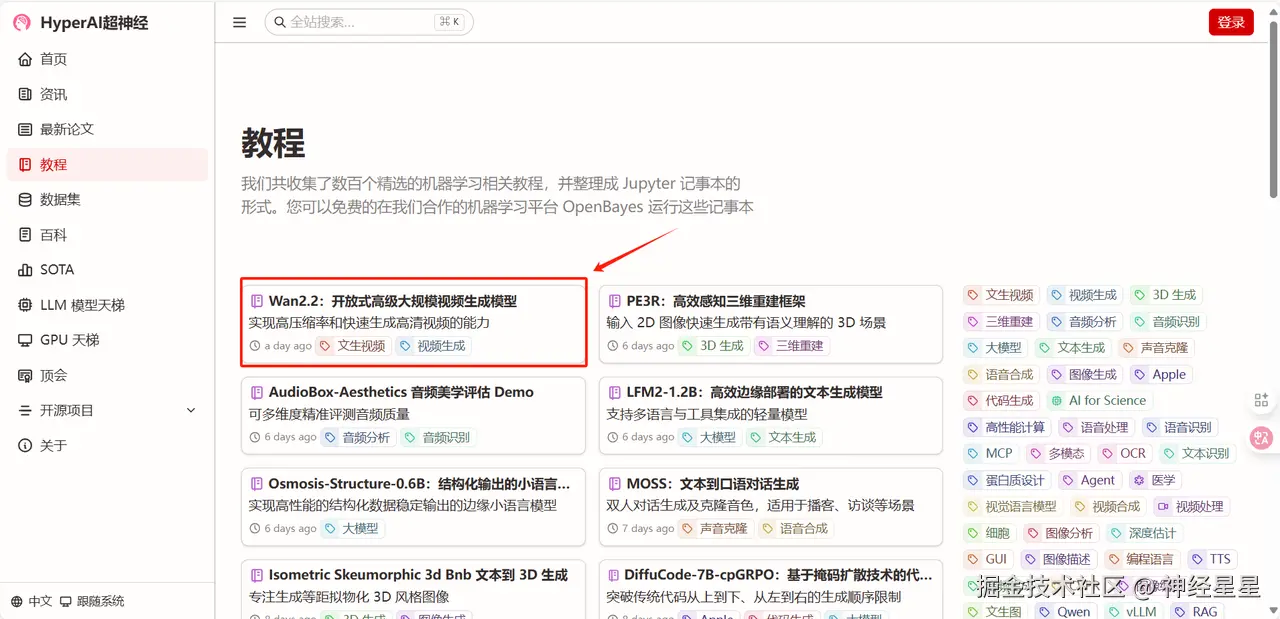

「Wan2.2:开放式高级大规模视频生成模型」现已上线 HyperAI 超神经官网(hyper.ai)的「教程」板块, 快来体验成为电影级视频的掌镜人!

教程链接:

Demo 运行

- 进入 hyper.ai 首页后,选择「教程」页面,并选择「Wan2.2:开放式高级大规模视频生成模型」,点击「在线运行此教程」。

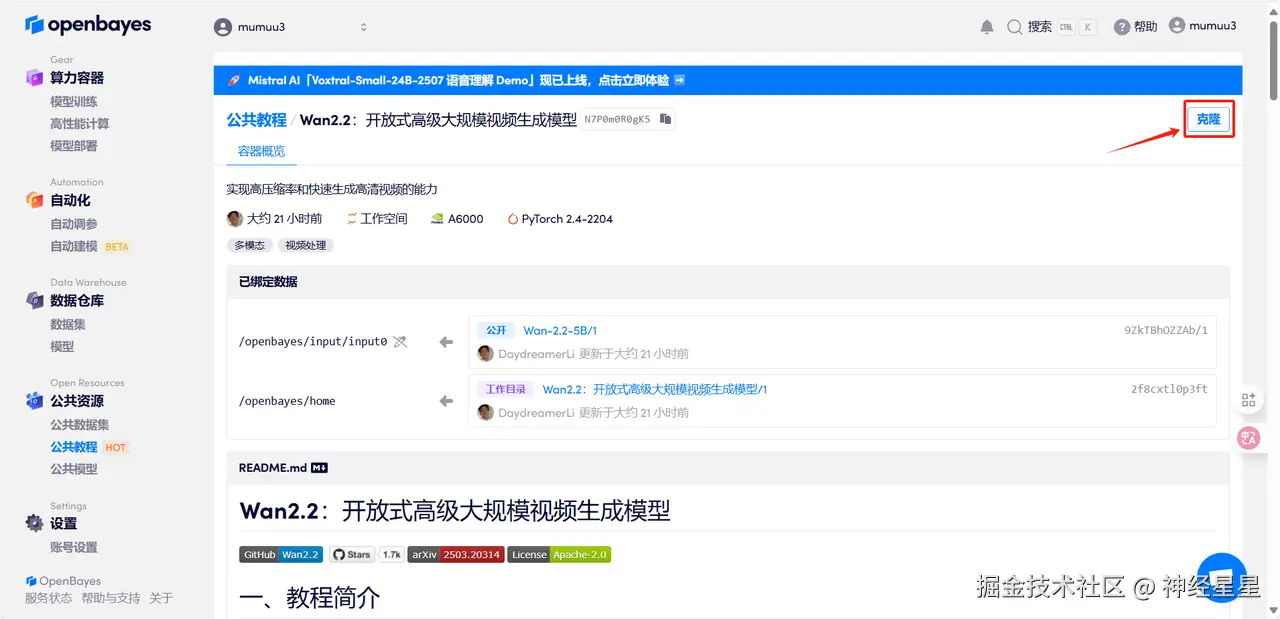

- 页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

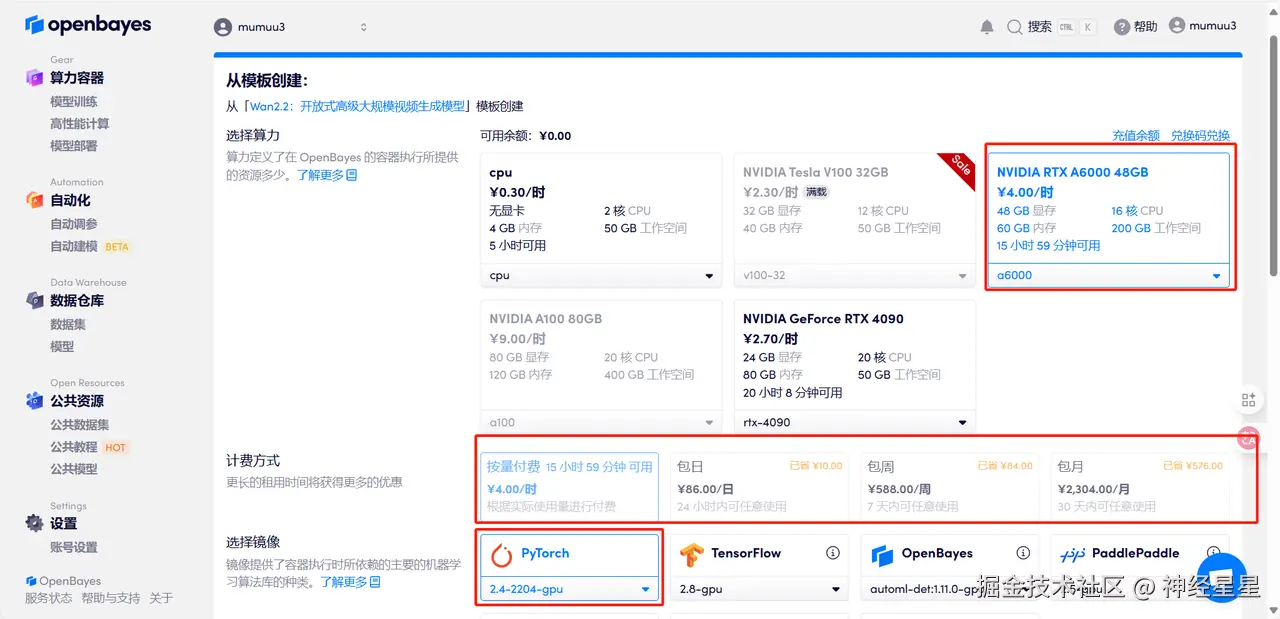

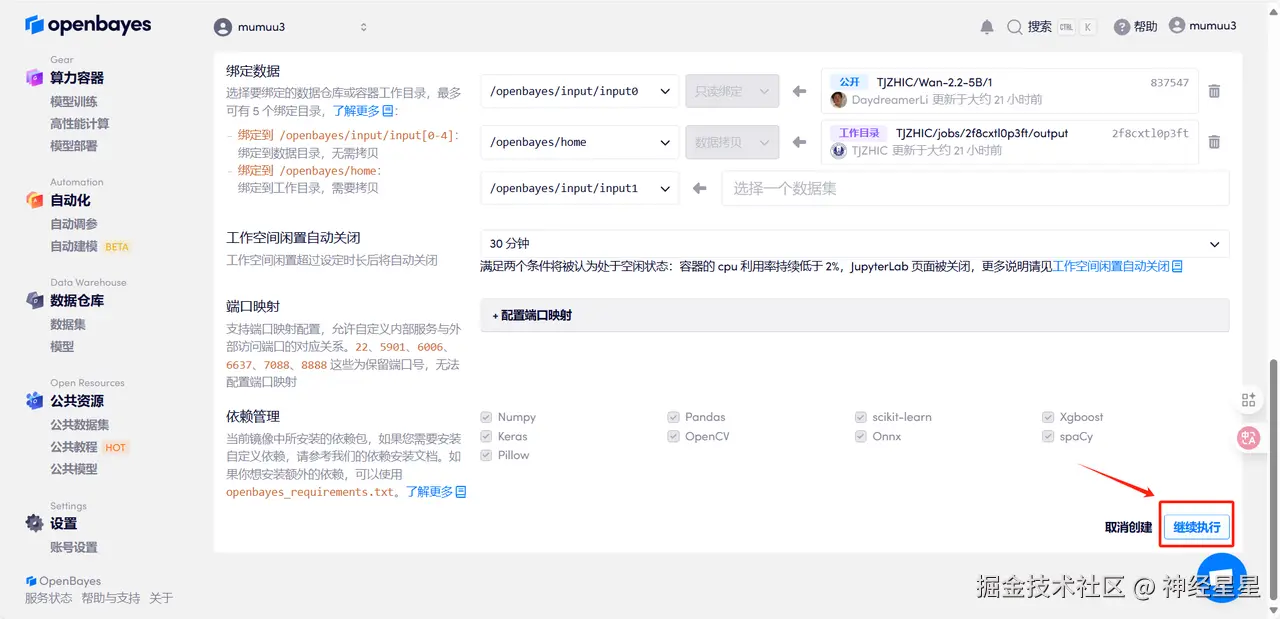

- 选择「NVIDIA RTX A6000 48GB」以及「PyTorch」镜像,按照需求选择「按量付费」或「包日/周/月」,点击「继续执行」。新用户使用下方邀请链接注册,可获得 4 小时 RTX 4090 + 5 小时 CPU 的免费时长!

HyperAI 超神经专属邀请链接(直接复制到浏览器打开):

https://openbayes.com/console/signup?r=Ada0322_NR0n

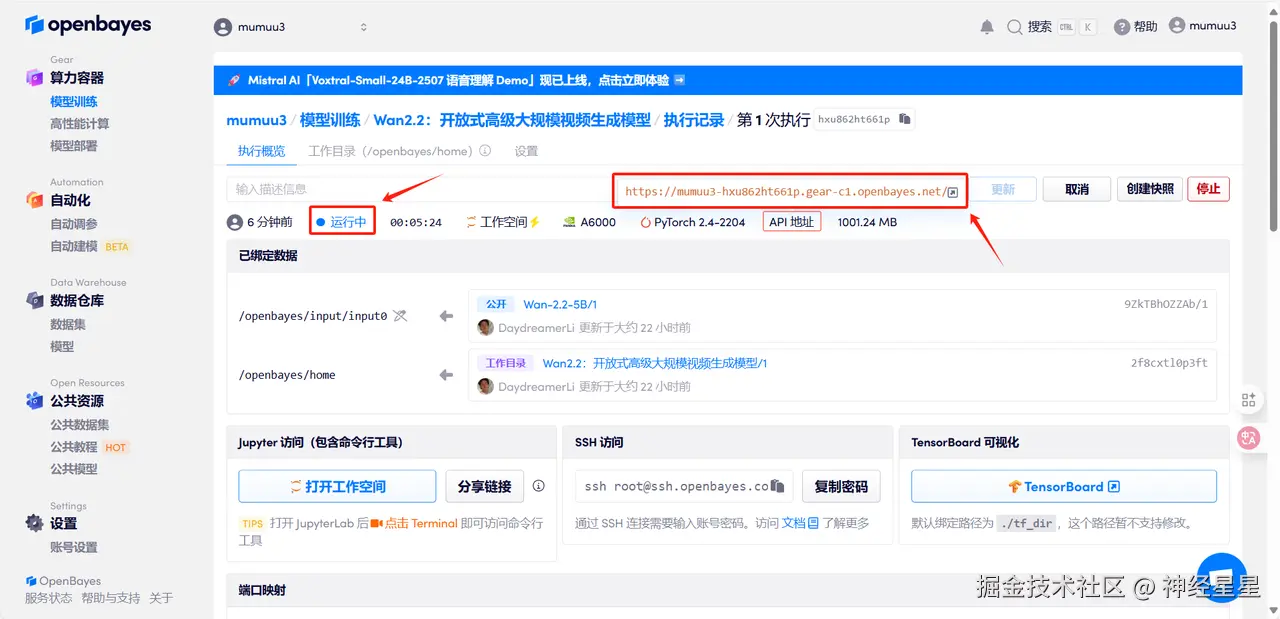

- 等待分配资源,首次克隆需等待 3 分钟左右的时间。当状态变为「运行中」后,点击「API 地址」旁边的跳转箭头,即可跳转至 Demo 页面。请注意,用户需在实名认证后才能使用 API 地址访问功能。

效果演示

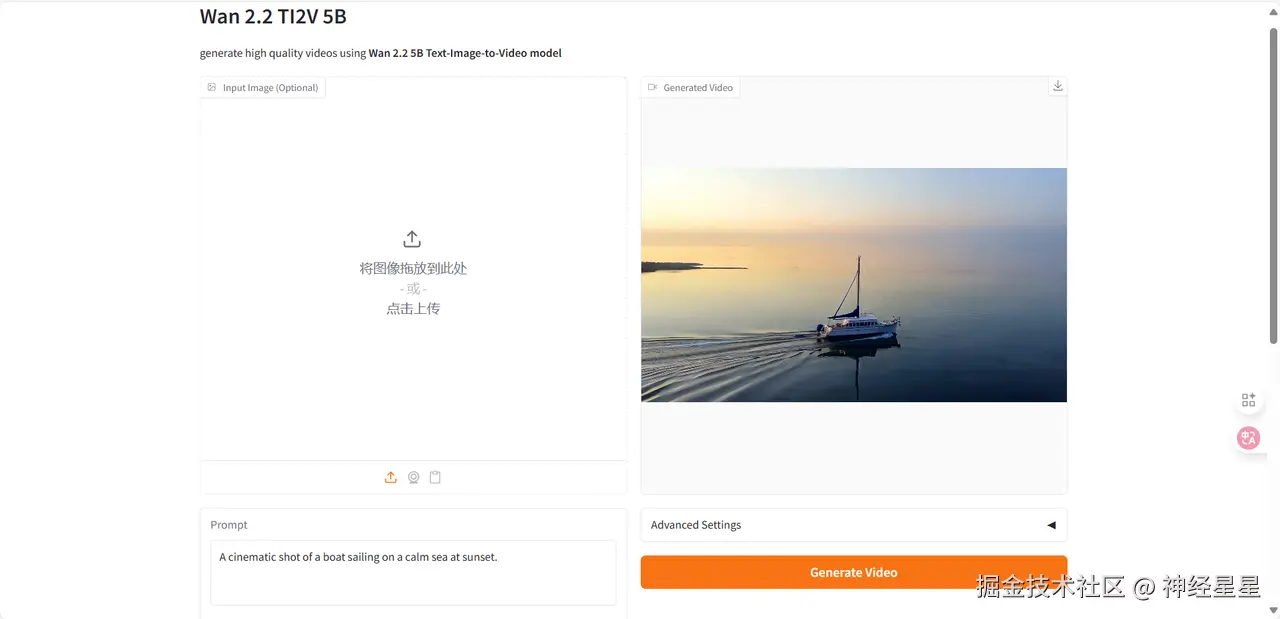

Text-to-Video Generation 文生视频

进入 Demo 页面后,输入 Prompt,点击「Generate Video」。

因平台限制,视频效果可到 HyperAI超神经公众号观看~

Prompt: A cinematic shot of a boat sailing on a calm sea at sunset.

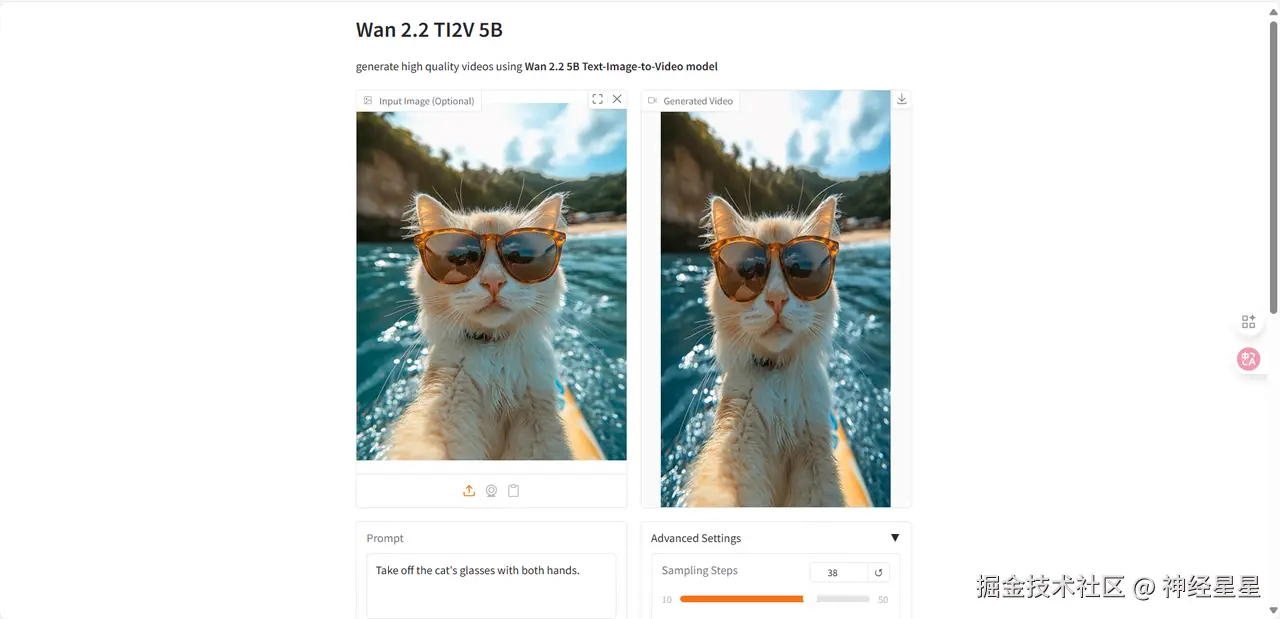

Image-to-Video Generation 图生视频

进入 Demo 页面后,上传图片并输入 Prompt,点击「Generate Video」。

因平台限制,视频效果可到 HyperAI超神经公众号观看~

Prompt: Take off the cat's glasses with both hands.

以上就是 HyperAI 超神经本期推荐的教程,欢迎大家前来体验!

教程链接: