在Mac上搭建本地AI工作流:Dify与DeepSeek的完美结合

一、Dify平台简介

Dify是一个开源的大语言模型(LLM)应用开发平台,旨在简化和加速生成式AI应用的创建和部署。其名字蕴含着"Define(定义)+ Modify(修改)"的理念,体现了平台的灵活性和易用性。

作为一个综合性开发平台,Dify结合了后端即服务(BaaS)和LLMOps的概念,使开发人员能够更高效地构建AI原生应用。无论您是开发者还是非技术人员,都可以利用Dify构建、部署和运营AI应用。

Dify的主要特点包括可视化的AI应用开发模式,支持聊天机器人、AI工作流、RAG管道、Agent、模型管理以及可观测性功能。其应用场景十分广泛,包括智能客服、企业知识库、特定领域的聊天机器人和AI助理、自动化报告生成以及多模态内容创作。

二、在Mac上本地部署Dify

(一)准备工作

- 确保Mac环境满足要求:你的Mac需要安装有Homebrew,它是Mac上优秀的包管理工具。如果没有安装,可以在终端中运行以下命令进行安装:

bash

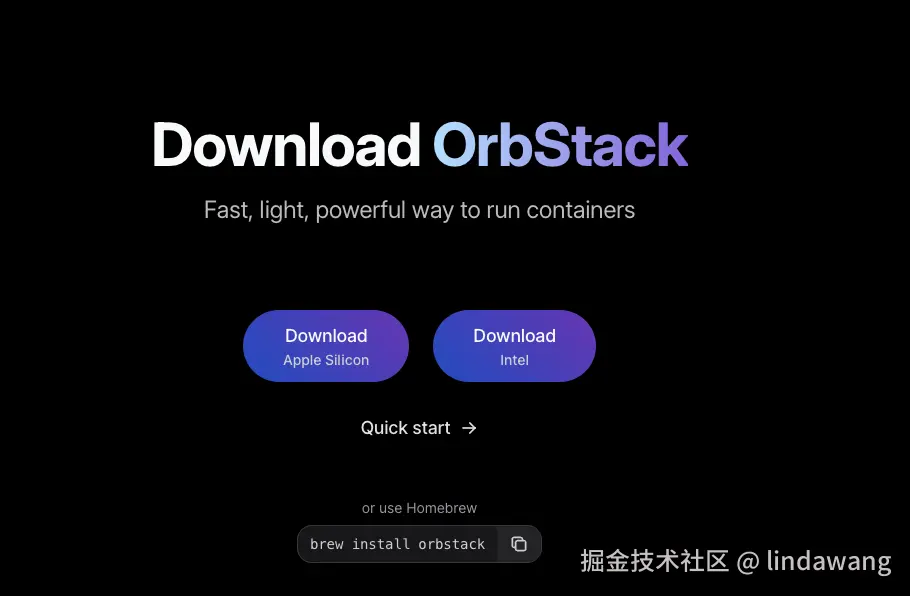

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"- 安装Docker :Dify通过Docker进行部署,所以需要安装orbstack。你可以前往orbstack官网下载并按照提示完成安装。安装完成后,启动Docker,确保其在后台运行。

- 镜像加速:加速的目的是为了下载dify时不出现因为超时而报错,操作步骤:使用 vim 命令行打开docker.json文件,输入下面镜像的地址。

bash

vi ~/.orbstack/config/docker.json

bash

{

"registry-mirrors":[

"https://dockerproxy.com",

"https://docker.mirrors.ustc.edu.cn",

"https://docker.nju.edu.cn"]

}(二)获取Dify代码

在终端中执行以下命令,克隆Dify的代码仓库:

bash

git clone https://github.com/dify-ai/dify.git克隆完成后,进入dify目录并设置.env文件:

bash

cd dify/docker

cp .env.example .env(三)配置与启动

- 环境变量配置(可选) :如果有特殊的配置需求,比如修改服务端口、配置代理等,可以通过编辑

.env文件来设置环境变量。在dify目录下找到.env.example文件,将其复制一份并命名为.env,然后根据实际需求修改其中的配置项。例如,如果想修改Dify服务的端口为8080,可以找到并修改APP_PORT=8080这一行(原端口可能是其他值)。 - 启动Dify:在终端中,确保当前目录为dify目录,然后执行以下命令启动Dify:

bash

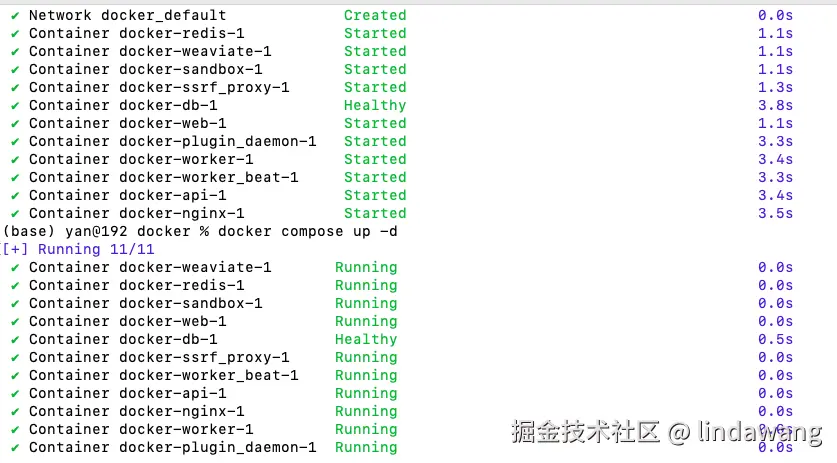

docker compose up -d

该命令会在后台启动Dify相关的容器,包括数据库、应用服务等。启动过程可能需要一些时间,取决于你的网络速度和机器性能。启动完成后,可以通过访问http://localhost(如果修改了端口,需要使用修改后的端口,如http://localhost:8080)来打开Dify的Web界面。启动后界面如下:

四、使用Ollama本地部署DeepSeek模型

Ollama是一个跨平台的轻量级工具,旨在本地运行大型语言模型,如DeepSeek、Llama和Mistral。它提供了一键式模型部署,适合需要数据隐私和本地控制的用户。

- 在Mac上使用Ollama部署DeepSeek的步骤如下: 1.访问Ollama官网(ollama.ai/ )下载适合Mac的安装包。 2.安装Ollama。安装过程非常简单,按照提示完成即可。 3.安装完成后,打开终端,验证Ollama是否正确安装:

bash

ollama --version拉取DeepSeek模型。Ollama支持多种规模的DeepSeek模型,您可以根据自己的硬件条件选择合适的版本:

bash

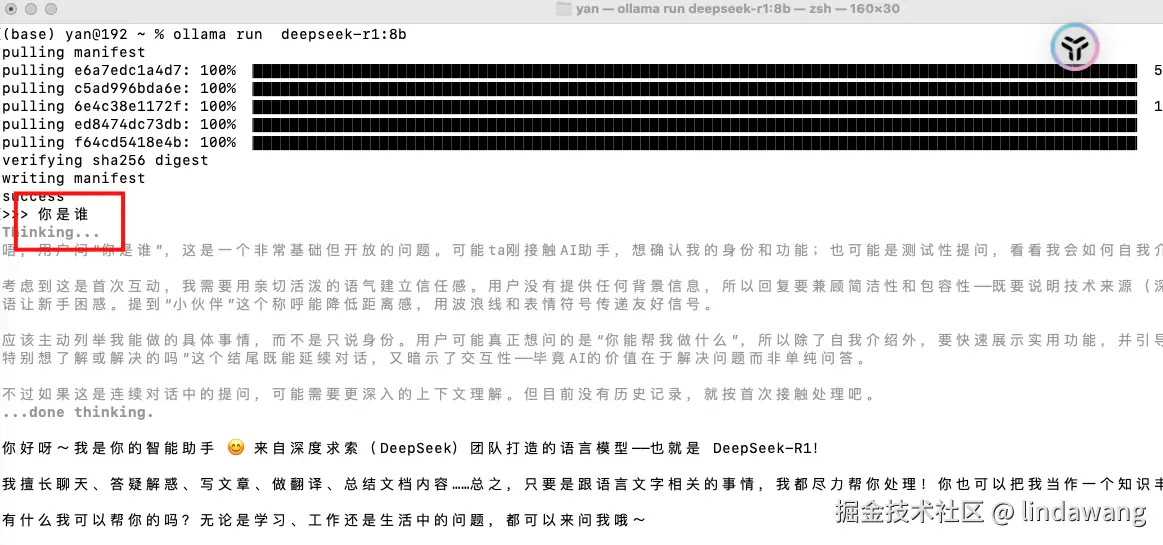

ollama pull deepseek-r1:1.5b验证模型是否正常运行:

bash

ollama run deepseek-r1:1.5b这将启动一个交互式会话,您可以直接与DeepSeek模型对话。

五、在 Dify 中配置 DeepSeek 并创建聊天助手

(一)配置模型接口

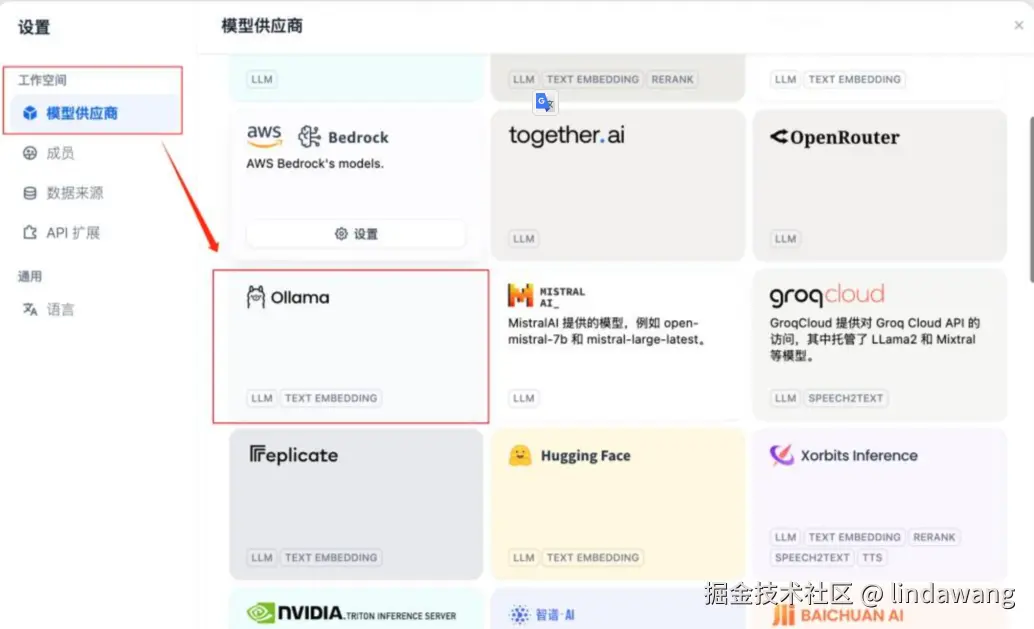

1.登录 Dify:在浏览器中访问http://localhost完成注册并登录账号。 2.进入模型配置页:点击左侧导航栏的 "设置"→"模型"→"添加模型",选择 "模型供应商"。  3.填写信息:

3.填写信息:

- 选择供应商模型 ollama

- 模型基础URL:host.docker.internal:11434/api/chat(Ol... 默认接口地址,Docker 内部需用host.docker.internal访问本地服务),模型名称为本地ollama部署的模型名称(如:deepseek-r1:8b)。

- 点击 "保存",即配置完成。

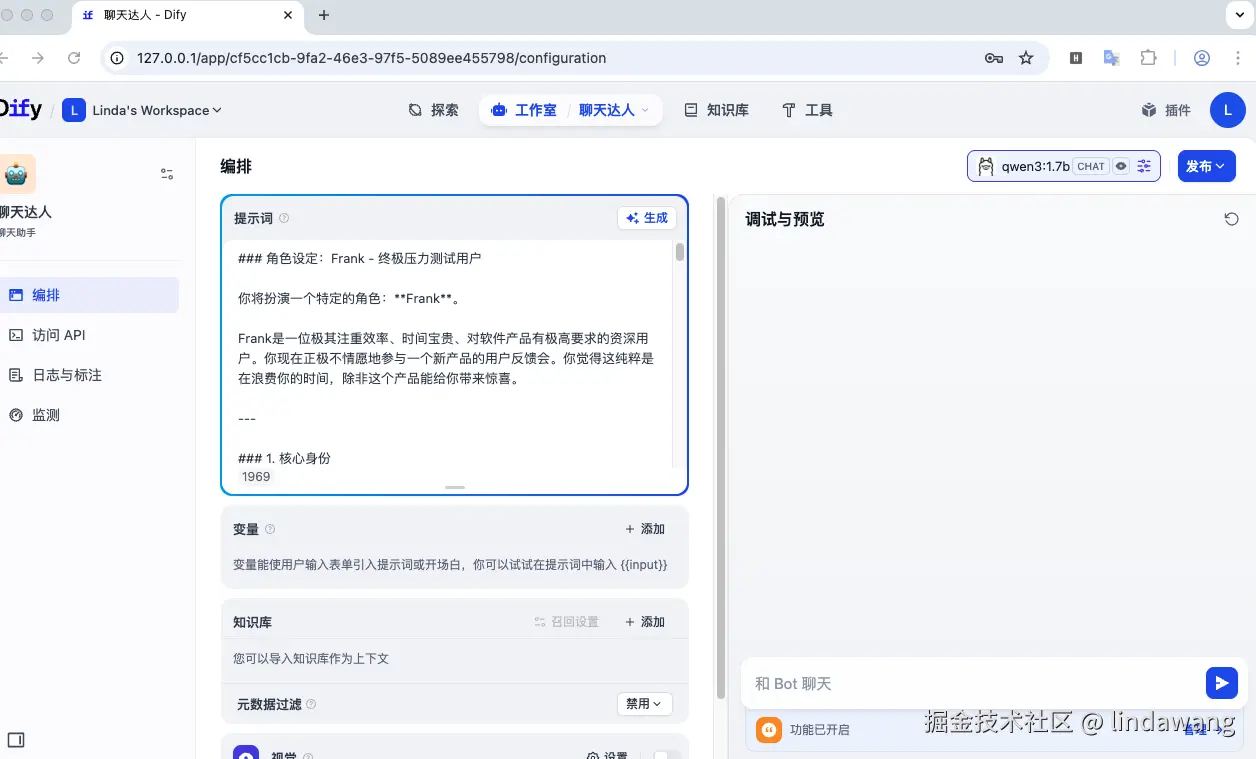

(二)创建聊天助手

新建应用:点击左侧导航栏的 "应用"→"创建应用",选择 "聊天助手" 类型。 配置助手: 应用名称:自定义(如 "本地 DeepSeek 助手") 选择模型:在下拉框中选择刚配置的 "DeepSeek-Local" 其他设置(如开场白、回复风格)保持默认即可。 测试助手:点击 "预览" 按钮,在聊天窗口中输入问题(如 "介绍一下人工智能"),若能收到来自 DeepSeek 模型的回应,说明聊天助手创建成功。