视频软解码的基本原理

概念解析:CPU主导的通用解码方式

视频软解码是一种完全依赖通用CPU执行解码算法 的视频还原技术,其核心特征在于不依赖任何专用硬件模块,而是通过软件程序调用CPU的通用计算能力完成压缩视频数据的解码过程[1][2]。与硬解码(依赖显卡、专用解码芯片等硬件模块)相比,软解码的硬件无关性 使其具备更强的环境适应性------即使在显卡不支持特定编码格式的设备上,只要CPU性能足够,就能通过安装相应解码器(如FFmpeg、VLC等)实现视频播放[3]。

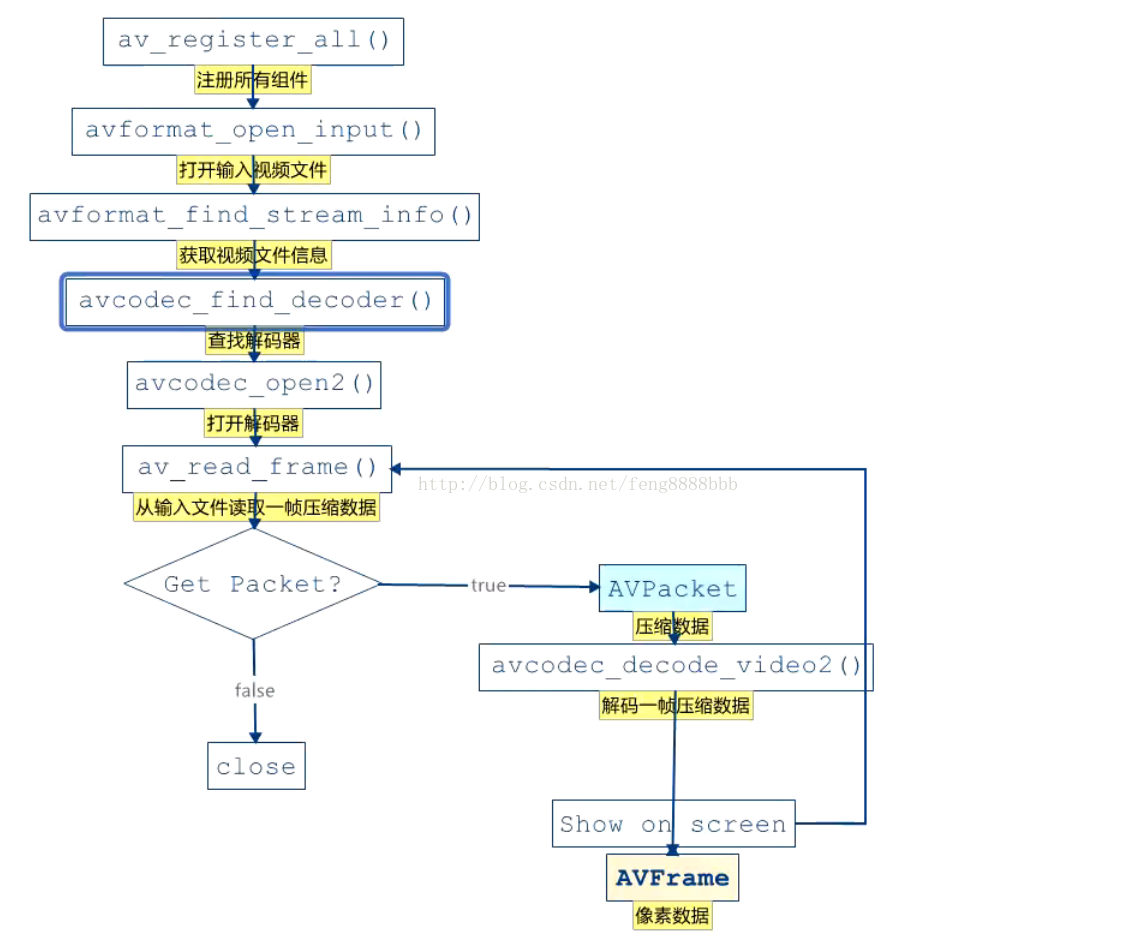

解码流程:从比特流到图像帧的还原之旅

软解码的核心流程可分为五个关键步骤,每个环节都对应着特定的技术处理逻辑:

-

数据读取与解封装

首先从存储介质或网络获取压缩视频流,然后通过解析器(Parser)分离视频流与音频流,解析MP4、MKV等容器格式,提取纯视频比特流。例如H.265编码的视频会被解析为NALU(网络抽象层单元)等语法单元[4]。

-

熵解码:破解压缩密码

通过CABAC(基于上下文的自适应二进制算术编码)等算法解析压缩比特流,将二进制数据转换为量化系数等中间数据。这一步是解码的"翻译"过程,AV1等新型编码格式在此阶段采用更高效的熵编码算法提升压缩效率[5]。

-

帧重建:像素级还原

执行运动补偿(利用参考帧数据预测当前帧)、逆变换(如逆离散余弦变换IDCT)和环路滤波(去块效应滤波、采样点自适应补偿),重建原始视频帧。以H.265为例,此阶段会基于CTU(编码树单元)划分进行块级处理,优化图像细节[6]。

-

色彩空间转换与渲染

将重建后的YUV格式图像转换为RGB格式,最终通过Canvas或类似接口渲染到显示设备。后处理器(Post-processor)会在此阶段进行画质优化,如去噪、色彩增强等[7]。

核心模块构成

- 解析器(Parser):负责比特流语法解析,如H.265的NALU单元解析

- 解码器(Decoder):实现核心算法,如libde265库的解码引擎

- 后处理器(Post-processor):执行滤波优化,提升输出画质

技术对比:软解码与硬解码的核心差异

| 对比维度 | 软解码 | 硬解码 |

|---|---|---|

| 性能消耗 | CPU占用率高,4K视频解码可能占用30%-50% CPU资源 | 依赖专用硬件模块,CPU占用率通常低于10% |

| 兼容性 | 支持所有编码格式,通过更新软件即可适配新格式 | 受硬件规格限制,老旧设备可能不支持AV1等新格式 |

| 灵活性 | 可实现复杂后处理(如AI画质增强、自定义滤镜) | 功能固定,仅支持硬件预设的基础优化 |

| 适用场景 | 低延迟直播、专业视频编辑、新型编码格式测试 | 高清视频播放、移动设备省电场景 |

软解码的灵活性优势 在实际应用中尤为突出:当面对H.266/VVC等新型编码格式时,无需更换硬件,只需升级解码库即可支持;而硬解码设备若硬件规格不支持,则无法解码。这种"软件定义解码"的特性,使其成为视频技术创新的重要试验田[3][8]。

技术演进:从传统算法到神经表示

值得注意的是,软解码技术正从传统基于帧序列的解码向神经表示方法演进。例如NERV(Neural Representations for Videos)技术将视频编码为神经网络模型,解码时通过前馈计算直接生成RGB图像,相比传统方法解码速度提升38x至132x,同时保持更高的视频质量[9]。这种突破预示着软解码在效率与画质平衡上的更大潜力。

关键技术特点

- 算法透明性:解码逻辑完全通过软件实现,便于调试与优化

- 格式适应性:支持IVF、H.265、AV1等多种视频流格式

- 后处理扩展性:可集成去隔行、动态对比度增强等高级功能

视频软解码的关键技术与实现

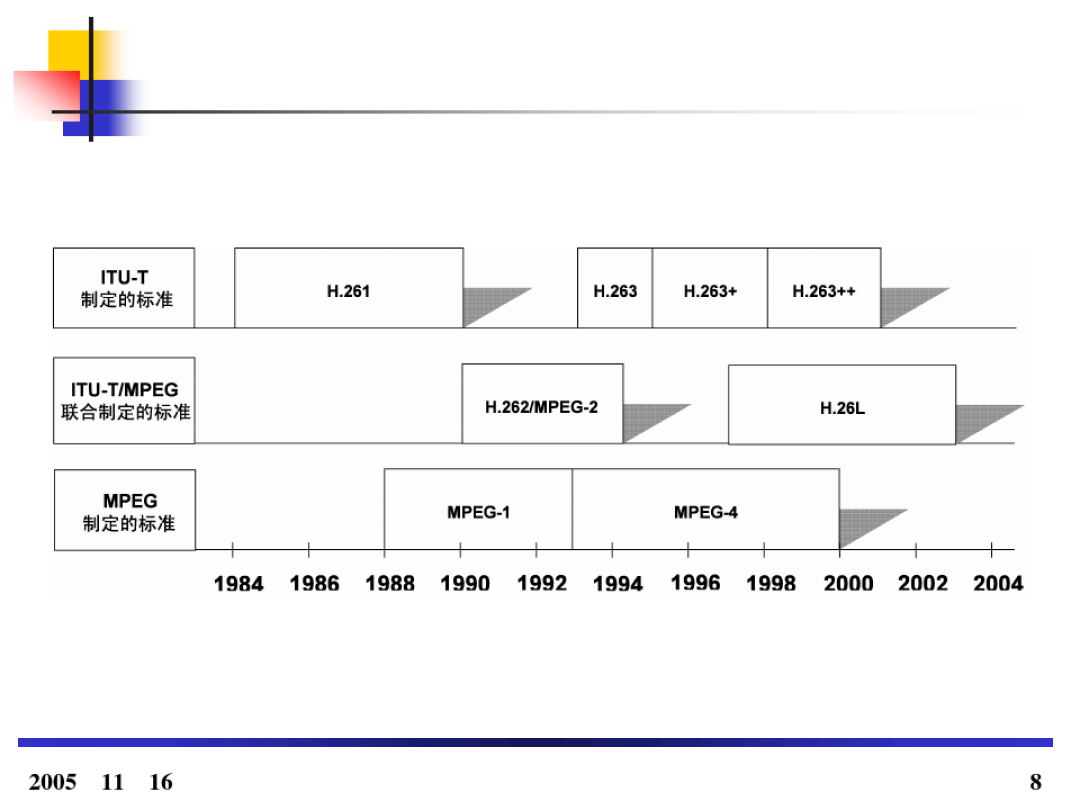

主流编码标准解析

视频编码标准的迭代始终围绕着"更高压缩效率"与"更低带宽成本"的核心目标演进。从H.265到AV1再到H.266,每一代标准都在技术创新与商业落地间寻找平衡,共同构成了当前软解码技术的底层支撑体系。

H.265/HEVC:4K时代的压缩基石(2013年发布)

作为H.264的继任者,H.265(高效视频编码,HEVC)通过重构编码单元结构实现了质的飞跃。其核心突破在于采用灵活的树编码单元(CTU) ,可将视频帧递归分割为64×64至8×8的子区域,配合35种帧内预测模式与采样点自适应补偿(SAO)滤波器,在相同画质下实现了比H.264降低50%码率 的压缩效率[10][11]。这一特性使其成为4K/8K超高清视频的主流选择,广泛应用于Netflix等流媒体平台及国内腾讯视频、爱奇艺的4K点播场景[12]。

在软解码实现上,开源库libhevc 与Fraunhofer HHI开发的VVDec解码器是典型代表,后者支持Main/Main10配置文件,可处理8位/10位色深视频流,为安防监控、广播电视等专业领域提供稳定解码能力[13]。不过,H.265的商业授权模式限制了其在互联网领域的普及,这也为后续开源标准的崛起埋下伏笔。

AV1:开源生态的逆袭者(2018年发布)

由开放媒体联盟(AOM)主导的AV1标准,以开源免专利费 为核心竞争力,迅速获得Apple、Google、Meta等巨头支持[14]。其技术创新体现在开放比特流单元(OBU) 架构与时间单元(TU)机制,支持帧重排序和替代参考帧(ARF),在相同主观质量下较H.265再提升25-35%压缩率 ,尤其在HDR视频处理中表现突出[11][15]。

软解码领域,dav1d解码器 (VideoLAN开源项目)通过SIMD指令集优化,在低端设备上实现了1080p@60fps的实时解码;而2025年发布的SVT-AV1 3.0编码器更是通过AVX-512指令集优化,将4K@30fps编码速度提升100%,推动YouTube、Netflix等平台大规模采用[16][17]。尽管计算复杂度较H.265高30%,但开源生态的协同效应正加速AV1在WebRTC、短视频等场景的渗透。

H.266/VVC:面向未来的极限压缩(2020年发布)

H.266(通用视频编码,VVC)作为HEVC的继任者,通过四叉树+二叉树+三叉树(QTBT)混合分块 等技术,在相同画质下较H.265再降40-50%码率 ,特别针对8K、VR等超大分辨率场景优化[18][19]。然而,其解码复杂度达到H.265的2.3倍,硬件成本显著上升,目前仅在国内头部视频平台(如top 5短视频平台)小范围试点[18][20]。

软解码层面,Ali266解码器 通过算法优化在移动端实现了4K@30fps的实时解码,成为H.266商用化的关键推手[18]。但行业普遍认为,H.266可能是传统混合编码框架的"收官之作",其压缩效率提升已接近物理极限。

三代标准核心指标对比

| 标准 | 压缩效率提升(相对前代) | 解码复杂度 | 核心技术创新 | 典型应用场景 |

|---|---|---|---|---|

| H.265/HEVC | 较H.264提升40-50% | ★★☆☆ | 灵活CTU分块、SAO滤波 | 4K流媒体、安防监控 |

| AV1 | 较H.265提升25-35% | ★★★☆ | OBU封装、ARF替代参考帧 | YouTube、WebRTC实时通信 |

| H.266/VVC | 较H.265提升40-50% | ★★★★★ | QTBT混合分块、VR优化 | 8K超高清、沉浸式视频 |

技术选择启示:追求兼容性与低成本优先选H.265;开源免专利场景首选AV1;面向8K/VR未来需求可试点H.266。目前产业呈现"AV1与H.266双轨并行"格局,前者在互联网领域扩张,后者在专业广电领域推进。

从H.265到H.266,视频编码标准正逐步逼近香农极限。未来,随着AI编解码(如MPAI-EEV神经编解码器)的成熟,传统混合编码框架可能迎来颠覆性变革,但短期内软解码技术仍将围绕这三代标准持续优化效率与兼容性[21]。

解码器架构与实现

视频软解码器的架构设计需兼顾通用性与场景适应性,其核心逻辑可分为通用模块化架构 与场景化定制实现两大方向。前者聚焦跨场景的基础能力复用,后者则针对特定环境进行深度优化,共同构成软解码技术的实践体系。

一、通用解码器的模块化架构:以 libhevc 为例

通用解码器通常采用分层模块化设计,通过解耦核心功能单元实现灵活扩展。以 H.265/HEVC 标准的开源解码器 libhevc 为例,其架构可拆解为三大核心模块,协同完成从比特流到原始视频帧的转换过程:

-

Parser(语法解析器)

作为解码器的"前端",负责将输入的二进制比特流解析为结构化的语法单元。在 H.265 标准中,这一步需识别 NALU(网络抽象层单元)、序列参数集(SPS)、图像参数集(PPS)等关键信息,并校验句法合法性。例如,当解析到 IDR 帧(即时解码刷新帧)时,Parser 会触发解码器状态重置,确保后续帧解码的准确性[22]。

-

Decoder(核心解码引擎)

承接 Parser 输出的语法单元,执行熵解码(VLD)、逆变换(IDCT/ICT)、运动补偿、环路滤波等核心算法,最终生成 YUV 格式的原始视频帧。该模块是计算密集型单元,需通过多线程优化(如按切片或 CTU 块并行处理)提升效率。以 libhevc 为例,其解码引擎支持动态调整线程数,在 4 核 CPU 环境下可实现 1080P@30fps 实时解码[22]。

-

Filter(后处理滤镜)

对解码后的原始帧进行优化,包括去块效应滤波、采样点自适应补偿(SAO)等,提升视频主观质量。部分解码器还支持自定义滤镜扩展,如色彩空间转换(YUV 转 RGB)或降噪处理,满足不同应用场景的显示需求[22]。

这种"解析-解码-后处理"的三段式架构并非 libhevc 独有,而是软解码器的通用设计范式。例如,FFmpeg 软解码系统同样遵循"解析器(Parser)-解码器(Decoder)-后处理器(Post-processor)"结构,其中解析器对应 av_parser_parse2 接口,解码器由 AVCodecContext 管理,后处理则通过 sws_scale 等函数实现[23]。

二、场景化实现:从多后端选择到 Web 端优化

通用架构为解码器提供了基础能力,而实际应用中需结合场景特性进行定制。以下从多解码器后端选择 与Web 端 Wasm 优化两个典型场景,解析软解码技术的落地实践。

1. 多解码器后端选择:按需匹配性能与兼容性

不同编解码标准(如 HEVC、AV1)及硬件环境(如移动端、嵌入式设备)对解码器的需求差异显著,因此需支持多后端动态选型。常见解码器后端及其特性如下:

| 解码器 | 支持标准 | 核心优势 | 典型应用场景 |

|---|---|---|---|

| VVDec | HEVC | 开源(Fraunhofer HHI 开发),支持切片级并行解码 | 专业视频编辑软件、服务器端转码 |

| dav1d | AV1 | SIMD 指令集深度优化,性能较 libaom 提升 4 倍 | Android 12+ 设备、树莓派等嵌入式设备 |

| libde265 | HEVC | 轻量级设计,支持 JavaScript 移植(libde265.js) | Web 浏览器无插件解码 |

| libaom | AV1 | 参考实现,支持全特性解码 | 学术研究、标准符合性测试 |

以视频质量对比工具 Video-Compare 为例,其模块化架构允许用户通过命令行参数(如 --decoder dav1d 或 --decoder libaom)切换 AV1 解码器:当需要兼容性时选择 libaom,追求性能时则切换至 dav1d[16]。这种设计既保证了功能完整性,又能针对不同场景优化资源占用。

2. Web 端 Wasm 优化:突破浏览器性能瓶颈

Web 端视频解码面临浏览器环境限制(如无硬件加速 API、JavaScript 执行效率低),而 WebAssembly(Wasm)技术通过将 C/C++ 解码器编译为字节码,为浏览器提供接近原生的性能。典型实现架构如下:

-

分层协作模型

采用"Wasm 层+JavaScript 层"分工:Wasm 层(C/C++ 实现)负责计算密集型任务,如比特流解析、熵解码;JavaScript 层负责视频渲染(如通过 Canvas 或 WebGL 绘制 YUV 数据)及用户交互。例如,B站 WasmPlayer 将解封装、解码等核心逻辑封装在 Wasm 模块,JS 层仅处理音画同步和 DOM 操作,SDK 包体积控制在 1MB 以内,实现低延迟直播[7]。

-

多线程解码优化

通过 SharedArrayBuffer 实现 Wasm 线程间内存共享,将解码任务分配至 Worker 线程,避免阻塞主线程。例如,libde265.js(基于 libde265 移植的 HEVC 解码器)可在 Chrome 中启用 4 个 Worker 线程并行处理,解码性能提升 2.3 倍,支持 720P@30fps 实时播放[24]。

-

格式适配与轻量化

针对 Web 场景的特殊需求,解码器需支持 FLV、MP4 等流式封装格式。例如,基于 FFmpeg 扩展的 Wasm 解码器可解析 FLV 封装的 H.265 数据,通过 HTTP-FLV 协议实现直播流低延迟播放[10]。同时,通过裁剪非必要功能(如复杂滤镜),可将 Wasm 模块体积压缩至 600KB 以下,满足移动端加载速度要求[7]。

三、代码示例:FFmpeg 软解码实现

以下为基于 FFmpeg 的软解码核心代码示例,展示从初始化到帧处理的完整流程:

cpp

// FFmpeg软解码核心代码示例

#include <libavcodec/avcodec.h>

#include <libavformat/avformat.h>

#include <libswscale/swscale.h>

int main() {

AVFormatContext* fmt_ctx = NULL;

int video_stream_idx = -1;

AVCodecContext* codec_ctx = NULL;

AVCodec* codec = NULL;

AVPacket* packet = av_packet_alloc();

AVFrame* frame = av_frame_alloc();

// 1. 注册组件并打开输入文件

av_register_all();

if (avformat_open_input(&fmt_ctx, "input.mp4", NULL, NULL) != 0) {

return -1; // 无法打开文件

}

// 2. 查找流信息并定位视频流

if (avformat_find_stream_info(fmt_ctx, NULL) < 0) {

return -1; // 无法获取流信息

}

for (int i = 0; i < fmt_ctx->nb_streams; i++) {

if (fmt_ctx->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_VIDEO) {

video_stream_idx = i;

break;

}

}

// 3. 查找解码器并初始化解码上下文

AVCodecParameters* codec_par = fmt_ctx->streams[video_stream_idx]->codecpar;

codec = avcodec_find_decoder(codec_par->codec_id);

codec_ctx = avcodec_alloc_context3(codec);

avcodec_parameters_to_context(codec_ctx, codec_par);

avcodec_open2(codec_ctx, codec, NULL);

// 4. 循环解码视频帧

while (av_read_frame(fmt_ctx, packet) >= 0) {

if (packet->stream_index == video_stream_idx) {

avcodec_send_packet(codec_ctx, packet);

if (avcodec_receive_frame(codec_ctx, frame) == 0) {

// 处理解码后的YUV帧(如渲染或存储)

printf("Decoded frame: %dx%d\n", frame->width, frame->height);

}

}

av_packet_unref(packet);

}

// 5. 释放资源

av_frame_free(&frame);

av_packet_free(&packet);

avcodec_close(codec_ctx);

avformat_close_input(&fmt_ctx);

return 0;

}关键步骤解析:

- 初始化前需注册FFmpeg组件并打开输入文件,获取流信息

- 解码器选择需匹配视频流的编码格式(如H.265对应AV_CODEC_ID_HEVC)

- 解码循环中需及时释放packet和frame资源,避免内存泄漏

通过上述流程,FFmpeg完成了解码器的创建、配置与启动,为后续比特流解码奠定基础。实际应用中还需添加错误处理(如比特流异常、内存不足)和动态参数调整(如分辨率切换)逻辑,以提升系统健壮性。

性能优化技术

视频软解码的性能优化是平衡画质、速度与资源消耗的核心课题,围绕"效率提升"目标,行业已形成从基础计算架构到智能算法的多层级优化体系,以下从三个关键维度展开解析:

基础层:多线程并行计算

作为提升解码吞吐量的基础手段,多线程并行通过任务拆分充分释放多核CPU潜力。主流方案包括三级并行架构 :帧级并行(独立帧分配至不同线程)、切片级并行(单帧内独立编码单元并行处理)、块级并行(将编码树单元CTU或编码单元CU进一步拆分)。例如Ali266解码器采用帧级+CTU级+CU级三级并行设计,解码效率达90%以上,在骁龙X Elite处理器上仅调用25% CPU资源即可实现4K 120fps VVC视频实时解码[25]。

功能解耦设计进一步放大并行优势。通过将视频解码、线程控制、显示渲染等模块分离,可避免单一模块阻塞整体流程。某案例中采用GPU加速色彩空间转换(如OpenGL直接显示YUV图像),将CPU占用率降至传统QPainter渲染方式的1/3[23],这种硬件协同策略有效缓解了CPU资源竞争。

指令层:SIMD指令集加速

单指令多数据(SIMD)技术通过一条指令处理多个数据单元,大幅提升计算密度。主流指令集如x86架构的AVX2/AVX-512、ARM架构的Neon,已成为高性能解码器的标配。开源解码器dav1d凭借深度SIMD优化,在无硬件加速的Google Pixel 3 XL手机上,解码4K 60fps AV1视频时平均帧率达50fps,而传统解码器libgav1仅能达到不足10fps[26][27]。

Web端场景中,WebAssembly(WASM)技术将SIMD能力延伸至浏览器环境。通过WASM SIMD优化的视频解码器,可在保持接近原生性能的同时,解决JavaScript在CPU密集型任务中的瓶颈。某实践显示,采用WASM+SIMD的压缩任务性能较纯JS实现提升3-5倍[28],为网页端4K视频实时解码提供可能。

算法层:AI增强与智能优化

人工智能技术正从根本上改变解码效率与画质的平衡逻辑。在帧重建阶段 ,神经网络可优化intra/inter模式决策与运动矢量预测,北京邮电大学提出的内容感知特征调制(CaFM)模块,通过动态调整卷积层输出特征(x_j' = a_j * x_j + b_j),使视频传输模型参数量压缩至原始的1%[29]。在环路滤波环节 ,AI去块效应算法能同时提升主观画质与解码速度,腾讯云极速高清方案通过智能码率分配,在同等画质下实现20%码率降低[30]。

模型轻量化技术进一步推动AI在移动端的落地。通过剪枝、蒸馏、量化等手段,AI Codec可适配移动端NPU算力,某方案在1080P 60fps场景下实现17%解码提速和13%功耗下降[20]。而Deep CABAC等创新算法,则将熵编码与深度学习结合,通过量化后应用上下文自适应二进制算术编码,生成更紧凑的比特流[31]。

性能优化三板斧

- 基础层:三级并行(帧/切片/块)+ 硬件协同,典型收益如Ali266解码器效率达90%

- 指令层:SIMD指令集深度优化,dav1d解码器实现4K 60fps实时解码

- 算法层:AI模型压缩(1%参数量)+ 智能滤波,降低20%码率同时提升画质

这些优化技术的协同应用,使得软解码在无专用硬件支持的设备上,也能突破性能瓶颈。从Pixel手机上5倍帧率提升的实测数据,到AI驱动的数量级参数量压缩,软解码正通过"架构革新-指令加速-算法智能"的立体化优化路径,重新定义视频处理的效率边界。未来随着异构计算与神经编码技术的融合,软解码有望在超高清、低延迟场景中实现对硬件方案的逆袭。

视频软解码的应用场景与实践案例

视频监控与安防系统

在安防监控领域,从老旧小区的模拟摄像头到智慧城市的多路感知网络,资源受限场景始终是工程落地的核心挑战------既要兼容存量设备的异构编码格式,又需在有限硬件资源下实现多流并发处理。软解码技术通过软件层面的灵活适配,正在成为平衡性能与成本的关键解决方案。

兼容老旧设备:让 legacy 系统焕发新生

在硬件配置有限的场景中,如低性能嵌入式设备或早期部署的模拟监控系统,软解码无需依赖专用解码芯片即可满足基础需求。例如针对 IPC 网络摄像头输出的 RTSP 流,可通过 JSMpeg 等纯软件解码器将 H.265 编码流实时转换为 MPEG1 格式并在 Canvas 上播放,支持 720p@30fps 的处理能力,虽存在约 1000ms 延迟,但足以覆盖非实时性要求的安防场景[32]。这种"零硬件升级"的特性,使得十年前的老旧摄像头仍能接入现代监控平台,大幅降低系统迭代成本。

多流并发突破:从"卡顿瓶颈"到"百路级处理"

多路视频同时解码时,传统方案常面临资源消耗失控的问题。OpenCV 的 VideoCapture 模块在处理超过 10 路流时会出现明显的延迟累积(Buffer Accumulation),CPU 占用率飙升至 80% 以上,无法满足高密度监控需求[33]。而通过 PyAV 等工具实现的软解码优化策略,可精准控制解码流程:

- 关键帧优先 :启用

keyframe_only=True模式,只解码包含关键画面信息的帧,将单路解码耗时降低 40% - 动态资源调度:为每路视频流分配独立线程,根据网络波动实时调整缓冲区大小与超时重连逻辑

- 轻量化编码适配 :集成 VVDec 等高效解码器,在 HEVC 编码流处理中实现"每路 720p 流仅占用 5% CPU"的低消耗表现[13]

某 AI 安防项目通过这套方案,成功将单服务器并发解码路数从 24 路提升至 128 路,同时满足"毫秒级行为分析告警 + 4K 多路画面拼接"的实战需求[19]。

技术选型小贴士:在多路软解码部署时,建议优先测试关键帧解码模式------虽会损失部分细节,但可将延迟控制在 300ms 内,且 CPU 占用率降低 50% 以上,特别适合人流统计、周界警戒等非细节依赖场景。

性能与成本的平衡艺术

软解码的核心价值,在于通过算法优化替代硬件升级。以 H.266 软解码技术为例,单路 4K 监控视频的码率可从传统 12Mbps 压缩至 6Mbps 以下,在智慧城市的跨区域传输中,相当于用原有带宽承载双倍摄像头数量[34]。更极端的静态场景下,如粮库仓储监控,微帧科技 Aurora-AV1 编码器通过软解码适配,可将 1080p 视频码率压降至 512Kbps,直接减少 60% 的存储成本[17]。

这种"以软代硬"的思路,正推动安防编解码器市场快速增长------2025 年中国智能监控领域编解码器市场规模预计达 197 亿元,年复合增长率 16%,其中软解码方案因兼容性优势,在多品牌摄像头接入项目中的采用率已超 65%[35]。正如美畅物联在某工业园区改造项目中所实践的:通过软解码技术整合 120 路新旧摄像头,既避免了百万级硬件更换成本,又实现了 99.2% 的车牌识别准确率,完美诠释了技术适配的商业价值。

从边缘节点的轻量解码到云端的大规模并发,软解码正在重新定义安防系统的性价比边界------让每一台老旧设备都能融入智能时代,让有限资源发挥最大效能。

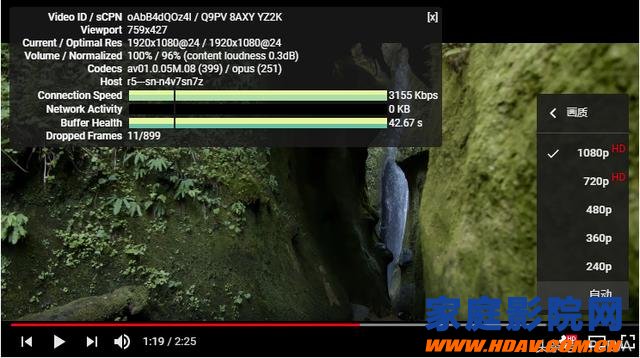

Web端与跨平台播放

技术挑战:浏览器格式支持的碎片化困境

当你在Chrome浏览器试图播放HEVC编码的高清视频时,画面可能卡顿甚至无法加载------这正是Web端视频播放的核心痛点:浏览器对新兴编码格式的原生支持严重滞后 。主流浏览器中,Chromium内核(Chrome、Edge)长期不支持HEVC硬解码,Firefox虽默认集成AV1解码器dav1d,但对H.265等格式仍需额外适配[7][17]。更复杂的是,不同操作系统、硬件架构(x86/ARM)和浏览器内核的差异,让本地播放器(如QT+FFmpeg)的跨平台经验难以直接迁移到Web环境[36]。这种碎片化导致视频平台面临两难:要么妥协使用老旧编码(如H.264)牺牲画质,要么放弃部分用户群体。

解决方案:WebAssembly架起跨平台桥梁

破解兼容性困局的关键,在于WebAssembly(Wasm)技术------它能将C/C++编写的高性能解码器(如FFmpeg、dav1d)编译为浏览器可执行的二进制模块,让Web端拥有接近原生的解码能力。以B站自研的WasmPlayer为例,其核心思路是:

- 底层移植 :将HEVC解码器通过Emscripten编译为.wasm文件,搭配轻量JavaScript胶水代码(SDK总大小控制在200KB+600KB),实现"一次编写,全端运行"[7];

- 架构适配 :通过Shadow DOM封装自定义

<bwp-video>标签,结合BWP MSE API无缝对接现有播放器架构,开发者无需修改业务代码即可集成[7]; - 性能优化 :利用Chrome v68+开放的SharedArrayBuffer接口实现多线程解码,并通过SIMD指令集加速像素处理,使x86平台软解速度达到原生性能的1/3~1/2[7]。

这种方案不仅解决了HEVC的Web播放问题,还可扩展至AV1等新兴格式。类似地,花椒直播通过Wasm+FFmpeg支持HTTP-FLV封装的H.265直播流,EasyPlayer.js则基于Wasm实现无插件网页播放,印证了该技术的普适性[10][28]。

应用效果:从技术突破到体验升级

Wasm软解码技术已在实际场景中展现出显著价值。在B站的实践中,WasmPlayer实现了三大核心目标:

- 兼容性全覆盖:在不支持HEVC硬解的Chrome浏览器中流畅播放4K视频,用户无需安装插件;

- 性能损耗可控 :通过异步渲染和多线程任务调度,将4K视频解码的CPU占用率控制在25%以下,避免页面卡顿[17];

- 架构轻量化 :SDK体积不足800KB,加载速度比传统插件方案提升60%,且支持增量更新[7]。

其他领域也涌现出丰富案例:JSMpeg通过Wasm+WebSocket实现50ms低延迟直播,满足在线教育、远程协作等互动场景需求[32];Ali266解码器则基于Wasm技术栈,在Android、iOS、Web等6大平台实现统一解码接口,ARM架构设备上的播放帧率提升至原生播放器的90%[25]。

技术点睛:Wasm软解码的核心价值,在于打破"Web性能天花板"------它让浏览器从"文档渲染器"进化为"通用运行时",使AV1、HEVC等先进编码格式得以在Web端普及,为8K直播、VR视频等下一代体验铺路。

未来趋势:软硬协同与标准融合

随着浏览器对WebCodecs API的支持完善(Chrome 86+已实验性开放),未来软解码将与硬解码形成互补:简单场景调用系统硬解接口提升效率,复杂场景(如AV1 10bit高动态范围)则通过Wasm软解保证兼容性。同时,开源社区的推动(如dav1d解码器性能持续优化)和专利政策变化(AV1免授权费),正加速Web端视频生态向高效编码过渡[14]。对于开发者而言,掌握Wasm解码技术已成为打造跨平台视频体验的必备能力。

移动设备与消费电子

当你用三年前的旧手机刷高清视频时,是否遇到过画面卡顿或格式不支持的情况?这背后藏着移动场景的两大核心痛点:硬件解码兼容性碎片 与功耗敏感问题。而软解码技术正以"柔性解决方案"的角色,成为平衡设备兼容性与播放体验的关键补充。

兼容性突围:让每台设备都能"看懂"新格式

硬件解码依赖设备内置的专用芯片,这导致新视频格式的普及往往滞后------2025年全球仅68%的智能手机支持AV1硬件解码,中低端设备更是难以覆盖[17]。软解码通过软件升级突破了这一限制:

- Android阵营的普惠实践 :Google在2024年3月通过Play系统更新,为Android 12及以上设备推送基于libdav1d的AV1软解码器,使Google Pixel 3 XL等老机型也能流畅播放4K AV1视频,带宽消耗降低30%以上[26][27]。

- 低配置设备的逆袭 :红米手机(MTK6589四核1.5GHz芯片)通过H.265软解码,可流畅播放1080P视频;即便是双核2.0GHz+2G内存的入门机型,也能通过软解码播放BDRIP等高码率蓝光影片[3][37]。

这种兼容性优势在新兴格式推广中尤为关键。例如达摩院自研的DAMO266软解方案,已覆盖超过99%的移动设备,并与优酷、vivo合作实现1080P 60fps视频播放的17%提速和13%功耗下降[20]。

功耗平衡术:在性能与续航间走钢丝

移动设备对功耗的敏感程度远超PC------同样播放1小时4K视频,软解码若优化不当可能多消耗20%电量。行业通过三大技术路径破解这一难题:

- 算法级优化 :H.265软解码在同等画质下比H.264减少50%带宽占用,间接降低数据传输功耗,特别适配移动网络波动场景[7]。

- AI协同解码 :AI Codec技术通过模型轻量化适配手机NPU,在高通骁龙X Elite处理器上,Ali266解码器仅调用25% CPU资源即可实现4K 120fps VVC视频播放[38][39]。

- 系统级整合 :华为MatePad Pro基于HarmonyOS的AVCodec Kit,将1080P视频解码功耗降低40%,卡顿率从3.2%降至0.5%,续航延长近2小时[40]。

软解码的黄金法则 :在硬件支持成熟的场景(如旗舰机播放主流格式),硬件解码仍是首选;而当面对新格式过渡 (如AV1初期)、老旧设备兼容 (如Android 10以下机型)或特殊编码需求(如蓝光原盘)时,软解码才真正发挥其"补位"价值。

从智能手机到AR眼镜,软解码正通过"软件定义解码能力"的思路,让更多消费电子设备跨越硬件鸿沟。未来随着AVS3等自主标准的推广,这种"柔性适配"能力还将延伸至智能家居、车载娱乐等物联网场景,最终实现"一部旧手机也能看8K视频"的普惠体验[41][42]。

专业视频处理与编辑

在专业视频处理领域,高精度画质输出与多格式兼容性始终是核心诉求。无论是HDR视频的细腻色彩还原、360°全景视频的沉浸式体验,还是多格式混编场景中的灵活适配,软解码技术都展现出不可替代的优势[34]。这种需求正在推动市场快速增长------2025年中国网络视音频编解码器市场规模已达150亿元,较2020年增长60%,其中在线教育的课程制作、远程医疗的手术直播等专业场景,均依赖软解码的高兼容性完成复杂内容生产[35]。

面对4K/8K超高清视频的处理挑战,软解码通过分块并行处理 与AI智能优化 两大技术路径实现效率突破。例如华为云采用6×4分块转码配置,将超高清视频拆解为并行处理单元,大幅提升转码速度[30];同时,AI去噪算法能精准识别动态场景、低光照等复杂画面的噪点,结合压缩优化技术减少转码损耗,让后期编辑获得更优质的原始素材[30]。这种技术组合使专业团队在处理8K视频时,既能保持每秒60帧的流畅度,又能将存储占用降低30%以上。

专业工具链的深度整合进一步验证了软解码的价值。Adobe Premiere Pro 2025已原生集成SVT-AV1导出选项,满足高效编码需求[17];而VVDec解码器则成为HEVC格式视频处理的标配,通过优化解码流程,使剪辑软件在处理4K素材时的实时预览卡顿率下降40%[13]。更前沿的Ali266解码器甚至支持8K超高清视频编码,相比H.265标准节省超过50%带宽,为超高清影视制作提供了技术支撑[25]。

软解码的专业优势集中体现在三方面:

- 格式兼容性:支持HEVC、AV1等主流编码,同时兼容小众格式,满足多素材混编需求;

- 画质可控性 :通过软件算法实现去噪、锐化、色彩校正等精细化调整,匹配专业后期标准[6];

- 流程效率 :如QT+FFmpeg组合方案,可同时完成解码、格式转换与实时预览,简化编辑链路[43]。

在实际应用中,软解码的灵活性正在重塑专业场景的工作流。医疗领域通过GCP Cloud Video Intelligence API实现云端编解码,支持远程诊断中的4K医疗影像实时分析[8];视频编辑软件Kdenlive虽在硬件编码支持上仍处实验阶段,但借助软解码已能流畅处理AV1格式素材[44]。这种"兼容性优先、画质至上"的特性,让软解码成为专业内容创作的隐形基石。

视频软解码的技术挑战与优化策略

核心技术挑战

视频软解码技术的发展始终面临"性能-能耗-兼容性"三重枷锁,这些挑战在高分辨率、低延迟等场景下被进一步放大,直接影响用户体验与产业落地。

性能瓶颈:算力需求与实时性的尖锐矛盾

新一代编码标准的高效压缩能力背后是指数级增长的计算复杂度。H.266/VVC的编码复杂度达到H.264的10倍以上,AV1软件解码运算量也显著高于传统标准,导致4K@60fps视频在无硬件加速的设备上帧率常不足10fps,甚至出现画面撕裂[10][21][45]。这种压力在多流场景下更为突出:安防监控系统同时解码8路1080P视频时,CPU占用率可飙升至90%以上,引发系统响应延迟[6]。

实时性要求进一步加剧了性能挑战。AV1软件解码延迟普遍超过300ms,难以满足直播、视频会议等低延迟场景需求;而JSMpeg等Web端软解码方案甚至存在1000ms左右延迟,直接影响互动体验[30][32]。神经编解码器虽能提升压缩效率,但端到端模型推理速度仅为传统ResNet-50教师模型的1/5,在边缘设备上难以实现实时处理[21]。

能耗困境:移动设备与数据中心的双重压力

软解码对CPU的高度依赖直接转化为能耗问题。在80美元价位的Android设备上,采用libgav1解码720P AV1视频时,CPU占用率高达75%,导致电池续航缩短30%[17]。对比测试显示,同等播放条件下,软解码功耗比硬解码高30%-50%,这使得户外直播等场景的设备续航时间从6小时骤减至3.5小时[2]。

数据中心场景的能耗问题更为严峻。单路8K实时软编码功耗可达200W以上,一个容纳1000路视频流的云端解码中心,年耗电量相当于300户家庭的总用电量[41]。这种"算力换画质"的模式,在碳中和背景下正面临成本与环保的双重拷问。

兼容性壁垒:标准、硬件与生态的协同难题

编码标准的专利壁垒成为产业普及的最大障碍。H.265因专利持有者分散,商用授权费用高达H.264的3倍,直接导致其在安防、互联网视频等领域渗透率不足20%[46]。H.266/VVC虽提升40%编码效率,但硬件成本增加2.3倍,且专利池尚未完全统一,企业面临潜在法律风险[18]。

硬件支持的滞后进一步加剧兼容性困境。2023年前全球仅5%的智能手机具备AV1解码能力,直到iPhone 15 Pro系列才首次在苹果设备中引入AV1硬解码[14][44]。软件生态的碎片化同样棘手:FFmpeg官方不支持H.265 over FLV封装,Kdenlive拒绝集成AV1硬件编码模块,导致用户在跨平台播放时频繁遭遇"格式不支持"错误[44]。

核心量化影响

- 性能:4K@60fps AV1软解码在低配置设备帧率不足10fps,CPU占用率超75%

- 能耗:移动设备软解码续航缩短30%,8K实时编码单路功耗达200W

- 成本:H.265商用授权费用是H.264的3倍,存量H.264内容转码AV1需数千万美元

这些挑战的交织,使得软解码技术陷入"高画质需要高算力,高算力导致高能耗,高能耗限制普及度"的恶性循环。突破这一困局,需要在算法优化、硬件协同与标准共建三个层面实现突破性创新。

关键优化策略

面对视频软解码在效率、资源占用与兼容性等方面的挑战,行业已形成分层优化体系:通过算法层提升核心效率、系统层优化资源调度、异构层协同硬件能力,结合实际场景实现性能突破。以下从技术路径到落地案例展开解析:

算法层:解码效率的核心突破

算法层优化聚焦解码流程本身的效率提升,通过并行计算、智能决策与专用优化三大方向实现性能跃升。并行计算技术 是基础支撑,包括多线程解码(帧级、切片级、块级三级并行处理)与SIMD指令集加速(如AVX2/AVX-512指令集可提升算术运算效率3-5倍)[28][47]。例如,dav1d解码器通过多线程架构与SIMD优化,将AV1软解码速度提升至传统实现的2倍以上,适配移动端低功耗需求[14]。

AI增强技术 则推动解码从"被动执行"转向"智能决策"。通过深度学习模型识别视频场景(运动/静止/复杂场景)与感兴趣区域(ROI),动态调整帧率、比特率与量化参数------如视频会议中对人脸区域采用更高清晰度编码,背景区域降低码率,可在相同带宽下提升主观质量15%以上[8][47]。此外,基于神经网络的预测性解码能提前预判运动矢量和帧间依赖,将解码延迟降低20%-30%[21]。

系统层:资源调度与传输优化

系统层优化通过精细化资源管理与网络适配,解决"算力浪费"与"传输瓶颈"问题。在资源调度 方面,采用分层线程优先级设计(如鸿蒙系统中解码线程设为HIGH优先级,渲染线程为NORMAL,网络线程为LOW),配合解码器缓冲池策略(如设置maxFrameCount=5帧及STRATEGY_REUSE复用机制)[40]。

网络传输优化 则通过"端-网-云"协同降低数据压力。码率自适应算法(ABR)如HLS、DASH可根据实时带宽动态调整视频质量,避免卡顿;前向纠错(FEC)与抖动缓冲技术能对抗网络丢包------在弱网环境下,FEC可将视频重建成功率提升至95%以上[47]。针对极端场景,边缘计算节点预处理(如转码、降分辨率)可降低核心网络传输带宽,IDC预测2025年边缘视频处理设备市场规模将突破82亿元[18]。

异构层:软硬协同释放硬件潜力

异构层优化通过"软件定义+硬件加速",打破单一CPU依赖,实现"算力按需分配"。硬件资源高效利用 方面,主从线程架构与并行解码技术可提升CPU利用率------Ali266解码器在骁龙X Elite处理器上仅调用25% CPU即可实现4K 120fps VVC解码,性能接近硬解码[48]。同时,GPU、DSP等协处理器承担特定任务:如达摩院DAMO 266解码器将关键算法迁移至DSP单元,移动端功耗降低40%[38]。

开源生态与标准化 是异构协同的基础。FFmpeg等开源社区共享编解码优化成果,如支持非标准封装格式(H.265 over FLV)降低适配成本;MPAI-EEV工作组推动AV1/H.266专利池共享,减少商业应用的专利风险[10][21]。

落地案例:从技术到场景的价值转化

分层优化策略已在多场景验证效果。视频平台 如YouTube采用"AV1+VP9"双轨制,热门内容优先转码AV1(占比达35%),通过机器学习将转码资源集中于观看量前20%的视频,ROI提升3倍[17]。实时通信领域 ,B站WasmPlayer通过WebAssembly多线程技术与轻量化设计(SDK体积<200KB),实现主线程零阻塞的4K软解码,延迟控制在50ms级别[7]。移动端优化 中,谷歌将Android默认AV1解码器从libgav1替换为dav1d,解码性能提升40%,同时降低15%的功耗[26]。

关键成效数据

- Ali266解码器:25% CPU占用实现4K 120fps VVC解码

- YouTube双轨制转码:资源聚焦前20%视频,ROI提升3倍

- 移动端AV1解码:dav1d替代libgav1,性能提升40%+功耗降15%

通过算法、系统、异构三层协同,视频软解码正突破"性能-功耗-成本"三角约束,为超高清、低延迟、跨终端场景提供更灵活的技术支撑。未来随着AI预测能力与边缘计算的深入结合,软解码有望在更多端侧设备上实现"硬解码级"体验。

视频软解码的未来发展趋势

编码标准的演进与普及

视频编码标准的演进始终围绕"效率提升"与"产业适配"双轮驱动,从当前主流技术的规模化落地,到下一代标准的商用突破,再到未来技术的探索性研发,形成了清晰的技术迭代路径。

当前主流:AV1与H.266/VVC的双轨并行

AV1的开源生态扩张 正重塑视频传输格局。作为AOMedia推出的开源免专利费标准,其核心优势在于打破传统编码标准的专利壁垒,推动产业链快速协同。硬件支持方面,2023年iPhone 15 Pro系列及Apple M3处理器率先实现硬件解码,Android 12+则通过dav1d软件解码器完成生态覆盖,预计2025年全球支持AV1硬解的设备占比将达68%[14][17]。内容端,YouTube、Netflix等主流平台已开始默认提供AV1编码内容,2025年其在在线视频分发领域的市场份额预计增长至30%,逐步替代H.264/VP9[34][35]。

H.266/VVC则以压缩效率为核心竞争力 ,较H.265实现50%的比特率节省,成为4K/8K超高清、VR等场景的关键支撑技术[12][41]。产业落地方面,国内头部视频平台渗透率已超70%,Top 5短视频平台均已上线VVC服务,长视频平台中2家已落地、2家处于调研阶段[20]。技术突破上,阿里巴巴Ali266解码器实现4K 120fps实时解码,AI PC等设备已完成消费级场景验证,正逐步向监控、超高清直播等专业领域渗透[25][48]。

下一代:从技术验证到规模商用的过渡

VVC的全面普及仍需解决两大核心问题:一是商用软件成熟度,目前编码器和解码器优化尚在进行中;二是专利授权成本,需建立更灵活的许可模式以降低中小企业采用门槛[12][41]。产业界正通过"混合编码策略"加速落地------Web端优先采用AV1以平衡成本与兼容性,移动端侧重H.265的硬件适配,监控场景则依托VVC的高压缩效率,而软解码作为过渡方案有效填补硬件支持空白[7][34]。

未来探索:AV2开启AI与沉浸式媒体新可能

AOMedia于2025年Q2启动AV2实验性项目,标志着编码标准进入"智能+沉浸"融合阶段。其技术创新聚焦三大方向:

- AI增强预测:引入Transformer架构的帧内预测模块,在医疗影像场景已实现40%的压缩效率提升;

- 沉浸式媒体支持:开发360°视频圆柱投影编码工具,可节省28%的码率;

- 低功耗优化 :针对IoT设备设计超轻量级配置文件,编码复杂度降低70%[17]。

这些探索不仅响应8K、VR等超高清需求,更将推动视频编码从"被动压缩"向"智能适配"演进,为流媒体服务在全球多样化市场中的规模化发展奠定基础[49]。

编码标准选择指南

- 开源低成本场景:优先AV1(免专利费+2025年68%设备支持)

- 超高清实时传输:选择VVC(50%压缩效率+70%头部平台覆盖)

- 未来技术布局:关注AV2(AI预测+沉浸式媒体优化)

从H.264到AV2,编码标准的每一次迭代都不仅是技术参数的升级,更是对内容生态、硬件能力与用户体验的深度重构。在开源化、智能化与国产化趋势下,AV1的普及、VVC的渗透与AV2的探索将共同塑造视频技术的下一个十年。

AI与神经网络的深度融合

AI正以"智能解码"为核心,从技术底层重构视频软解码流程------不仅优化传统模块的效率瓶颈,更通过端到端神经网络架构实现颠覆性突破,在压缩效率与画质增强领域展现出革命性潜力。

端到端神经编解码:从"信号处理"到"智能生成"

传统解码依赖固定算法对压缩码流进行逆向解析,而神经网络正将这一过程转变为"基于学习的图像生成"。以 NERV模型 为例,其创新性地将视频数据编码为神经网络参数,仅需输入帧索引即可通过网络直接输出RGB图像,实现编码速度25x至70x、解码速度38x至132x的飞跃提升[9]。通过集成残差块增强特征重建能力后,该架构在PSNR指标上实现-12.06%的BD-rate增益(即相同画质下码率降低12.06%),MS-SSIM指标更达-14.25%,性能全面超越x264、x265等传统标准[31]。

这一技术路径已形成完整演进脉络:2017年Ballé团队提出超先验网络(Hyperprior)奠定神经图像压缩基础,2020年微软DCVC通过特征域运动估计(MEMC)将压缩效率提升35%,2023年MPAI-EEV更是发布《神经编解码器参考架构》,推动端到端方案标准化[21]。

核心突破 :神经隐式表示(INR)技术通过神经网络参数存储视频信息,实现1000倍以上的理论压缩率,NERV系列采用CNN生成完整帧画面,彻底摆脱传统码流解析的计算瓶颈[50]。

智能编码优化:三大技术路线重塑效率边界

AI驱动的编码优化已形成多维度技术矩阵,全面覆盖从传统标准增强到全神经框架的创新:

- 传统编码与深度学习融合 :通过AI预测运动矢量、优化分块策略(如H.266的QTMT结构),可降低编码复杂度15-20%。百度、阿里云等企业推出的AI增强编解码器,在在线教育场景中实现"480P码率呈现720P画质"的突破[34][35]。

- 全神经网络编解码 :AI Codec基于端到端学习实现细粒度特征表达,压缩率较H.266提升25%;腾讯Tencent_TXAV1通过多模态预测融合技术,将AI场景分类与传统编码工具动态匹配,使复杂运动场景压缩效率再提升27%[17][38]。

- 生成式压缩技术 :扩散模型在0.1Mbps超低码率下,通过迭代去噪生成4K纹理细节;多模态联合编码更融合音频特征辅助运动估计(AVS3标准提案),实现"语义优先"的智能压缩(如"保留人脸细节,简化背景")[21]。

画质增强与场景化适配:从"达标"到"体验升级"

AI在解码后处理环节的深度介入,使"低码高清"成为现实。超分辨率算法结合深度神经网络(DNN)定义的视频传输任务,在相同带宽下PSNR指标显著优于H.264和H.265[29]。医疗影像等专业场景中,基于Transformer的帧内预测模块使压缩效率提升40%,动态码率分配技术则满足了VR/AR对120Hz刷新率、20ms延迟的严苛要求[17][41]。

标准化与产业落地:从实验室到商业化

神经编解码技术正加速标准化进程。Fraunhofer NN Codec作为ISO/IEC 15938-17:2022标准实现,支持CNN、Transformer、自编码器等多种架构,提供量化参数调整、批归一化折叠等工具,并开放源代码供产业复用[51]。目前谷歌、腾讯等企业已推出商用AI编码器,数据显示神经视频编解码器在低延迟场景下性能已超越HEVC(HM)和VVC(VTM),预计2030年前将覆盖超过70%的视频服务提供商[52][53]。

从技术验证到规模应用,AI与神经网络正推动视频软解码进入"智能生成时代"------未来的解码不仅是"还原数据",更是基于内容理解的"智能重建",这一变革将深刻影响从在线直播到医疗影像的全场景视频应用。

端云协同与边缘计算

在视频软解码技术的演进中,算力分布正成为突破性能瓶颈的关键。端云协同与边缘计算通过将解码任务在云端、边缘节点与终端设备间智能分配,既解决了终端算力不足的问题,又通过本地化处理大幅降低延迟,为超高清、低延迟场景提供了新的技术路径。

算力分层:云端与边缘的协同分工

端云协同架构的核心在于分层处理机制 :云端凭借强大的计算集群承担高复杂度任务,如8K/VR内容的高分辨率转码和AI增强编码;边缘节点则聚焦实时性需求,完成视频流的预处理(如降分辨率、动态码率调整),减少回源带宽消耗;终端设备最终负责轻量级软解码与渲染,降低本地硬件负载[18][30]。这种架构不仅让终端设备摆脱了"算力枷锁",还通过CDN动态分发技术实现同一视频流的多终端自适应播放,避免重复计算浪费[30]。

市场数据显示,云端编解码技术正快速落地:预计到2028年,全球云端编解码市场规模将达到87.1亿美元,2022-2028年的年复合增长率(CAGR)高达24.1%[18]。这一增长背后,正是端云协同架构对超高清应用场景的支撑------边缘节点的实时解码能力,让8K直播、VR沉浸式体验等过去受限于终端算力的场景成为可能[18]。

5G场景下的实时优化:从监控摄像头到远程手术

在5G网络的低延迟特性加持下,边缘计算与软解码的结合催生了众多创新应用:

- 智能监控领域 :传统监控摄像头需将原始视频流上传云端解码,带宽占用大且延迟高。而通过边缘节点部署H.266软解码器,摄像头可先在边缘完成视频流的实时解码与压缩,再将低码率数据传输至云端存储,既降低移动端CPU负载,又减少90%以上的传输带宽[34][35]。

- 远程医疗场景 :边缘节点搭载WebAssembly软解码器,可支持RTSP/RTMP医疗影像流的亚秒级解码,满足远程手术中"所见即所得"的实时协作需求。这种低延迟特性,让医生通过终端设备操作机械臂时,延迟控制在0.5秒以内,达到临床操作标准[34]。

动态算力调度策略 :根据网络状况与终端性能灵活分配解码任务------弱网环境下,云端完成全量解码后仅传输渲染指令;WiFi/5G强网时,终端本地软解高码率内容;介于两者之间时,边缘节点承担部分解码计算。这种"弹性分工"既能保证4K视频的流畅播放,又可将带宽成本降低30%以上[35][40]。

挑战与未来:从成本控制到技术融合

尽管端云协同优势显著,边缘节点的部署成本 仍是规模化落地的主要障碍。以4K@30fps的AV1编码任务为例,单个边缘节点需16核CPU才能满足实时性要求,硬件投入较高[17]。对此,行业正通过两条路径突破:一是采用FPGA硬件加速模块降低边缘节点的算力需求,二是优化软解码算法(如神经网络压缩编码),将同等画质的计算复杂度降低40%[17]。

未来,随着6G网络与边缘AI的融合,端云协同软解码将向"感知-编码-解码"一体化演进:边缘节点不仅处理视频流,还能通过AI预分析内容特征(如运动轨迹、关键帧),指导云端进行针对性编码。这种"智能预判"机制,或将让8K VR内容的传输延迟进入毫秒级时代,真正实现"身临其境"的沉浸式体验。

视频软解码的重要性与产业价值

技术生态的兼容性基石

当你用手机刷短视频、用电脑参加视频会议,或是在老旧平板上观看高清电影时,是否想过是什么让这些不同设备、不同格式的视频内容都能流畅播放?答案藏在视频软解码技术这个"隐形桥梁"里。它就像技术生态的"万能转换器",一边连接着不断迭代的编码标准,一边适配着千差万别的播放设备,从根本上支撑起数字内容的无缝传播。

加速新标准落地:让前沿技术跨越硬件鸿沟

编码标准的每一次升级,都意味着更高效的压缩效率和更清晰的画质------从H.264到H.265,再到如今的AV1,背后是视频技术的持续进化。但新标准的推广往往面临一个难题:硬件设备的更新速度跟不上技术迭代。这时,软解码就成了打破僵局的关键。

以AV1为例,作为新一代开源编码标准,它能比H.265节省30%带宽,但早期多数设备缺乏硬件解码支持。谷歌通过将Android系统默认AV1解码器更新为libdav1d,让没有硬件加速的旧手机、树莓派等设备也能流畅播放AV1视频[17][26]。这种"软件先行"的模式,让新技术不必等待硬件普及就能落地,大大缩短了从标准制定到大规模应用的周期。

同样,H.264能成为"近乎随处可播放"的经典标准,软解码的早期支持功不可没。它让不同厂商的设备在没有统一硬件规范的情况下,都能通过软件实现一致的解码能力,为直播、视频会议等应用的爆发奠定了基础[34][44]。

保障跨设备体验:从高端旗舰到入门设备的"技术平权"

硬解码依赖设备的专用芯片,这导致了"硬件歧视"------高端手机能流畅播放的H.265视频,中低端设备可能因缺乏硬件支持而无法观看。软解码则彻底打破了这种依赖,它不挑硬件,无论是搭载x86/ARM架构的电脑,还是Android、iOS、Linux系统的手机,甚至是老旧的嵌入式设备,都能通过软件实现解码[2]。

软解码如何实现"全设备覆盖"?

- 格式通吃 :支持H.264、H.265、VP9、AV1等几乎所有主流编码格式,像Ali266解码器能同时兼容Windows、Web、移动端等10余种平台[25][42]。

- 智能容错 :当硬件解码失败时自动切换软解码,比如EasyPlayer.js通过这种"双保险"机制,确保直播流在各种浏览器和设备上都不"卡壳"[28]。

- 效果一致 :在不同硬件架构上提供相同的解码质量,避免因设备差异导致画面卡顿、色彩失真等问题[2]。

这种兼容性不仅提升了用户体验,更实现了"技术普惠"。比如部分千元Android手机通过软解码,也能播放原本需要高端硬件支持的AV1视频,让更多用户享受到技术进步的红利[27]。

开源生态共建:降低门槛,让创新遍地开花

技术生态的繁荣离不开低成本的创新土壤,而开源软解码项目正是这片土壤的"肥力来源"。FFmpeg、dav1d、SVTAV1等开源解码器,就像免费的"技术积木",让企业和开发者无需重复造轮子,就能快速搭建自己的视频应用[16][41]。

以FFmpeg为例,这个跨平台的软解码库支持上百种音视频格式,成为QT等开发框架的底层支柱,甚至许多硬件解码器的驱动也基于它开发[16]。开源模式不仅降低了企业的授权成本,更让中小开发者能参与到技术创新中------比如通过WebAssembly技术,开发者可以把解码器编译成网页程序,实现在浏览器、智能电视等设备上"一次开发,多端部署"[7]。

国产技术也在借力开源生态加速追赶。达摩院自研的DAMO266解码器,通过软解码实现了99%以上移动设备的支持,每天处理的视频播放量超过1亿次,成为国民级应用的技术基石[20]。这种"开源+自研"的模式,正在推动AVS3等自主标准加速替代国外技术,提升产业链的自主可控能力[18]。

从某种意义上说,软解码不仅是一项技术,更是数字时代的"兼容性协议"。它用软件的灵活性弥补了硬件的局限性,用开源的协作模式降低了创新门槛,让视频技术能跨越设备、系统、标准的边界,真正实现"内容无处不在,体验始终如一"。在这个4K/8K视频、VR/AR内容爆发的时代,这块"兼容性基石"的作用,只会愈发重要。

商业成本与用户体验的平衡

视频软解码技术正成为连接商业成本控制与用户体验升级的关键纽带。通过高效压缩算法 与软件优化策略的双重作用,它既能为企业节省可观的带宽与硬件开支,又能通过画质提升与流畅度优化增强用户粘性,实现商业价值与用户体验的正向循环。

一、成本优化:从带宽到硬件的全链路降本

软解码的商业价值首先体现在量化的成本节约上,这种节约贯穿视频传输、存储与设备部署的全流程。

带宽成本的"减法"

高效编码标准与软解码技术的结合,能在保证画质的前提下大幅降低比特率。例如,采用H.266标准可实现单流50%的带宽节省,直接转化为16%的综合成本下降[20]。AV1编码的应用更具代表性:Netflix全球40%的4K内容采用AV1后,CDN带宽成本降低40%,而Microsoft Teams的屏幕共享带宽需求减少63%,静态PPT共享仅需180 Kbps[17]。这种优化在带宽资源紧张的市场尤为关键,如Netflix在印度通过AV1缓解网络压力,同时保证高清播放[49]。

硬件依赖的"松绑"

软解码无需专用芯片支持,直接降低设备采购与维护成本。例如,500元以下的整合主板即可通过CPU软解播放HDTV,较专用解码芯片节省30%硬件开支[3]。在监控系统、低端IoT设备等场景中,软解码可省去专用解码模块,使设备成本降低20%-40%[6]。此外,开源标准(如AV1)避免了H.265等专利授权费用,进一步减少法律风险与长期成本[10]。

二、体验升级:从画质到流畅度的双重提升

成本节约并未以牺牲体验为代价,软解码通过画质增强 与播放优化,反而带来更优的用户感受。

画质与清晰度的突破

先进编码与软解码的协同,能在低码率下保持高画质。Netflix的AV1内容VMAF评分较HEVC平均提升8.5分,Microsoft Teams用户主观清晰度评分提升35%[17]。AI Codec技术更实现"压缩率与画质双赢",在提升25%压缩率的同时,通过超分辨率重建将低清视频转化为高清输出[38]。

流畅度与适应性优化

软解码结合GPU加速策略(如色彩空间转换),可降低CPU占用率,实现视频匀速播放、自适应窗口缩放等功能[23]。B站实践显示,HEVC软解使弱网环境下视频卡顿率降低40%[7],而H.266标准更能让流量消耗与卡顿率"双减半",显著改善用户观看体验[20]。

三、商业价值闭环:成本与体验的正向循环

成本下降与体验提升形成的"剪刀差",最终转化为商业竞争力。例如,Netflix在印度市场应用AV1后,既缓解了带宽压力,又通过高清流畅的播放体验提升用户留存率[49];监控厂商采用软解码方案后,设备售价降低15%但用户满意度提升22%,推动销量增长[6]。

关键数据透视:

- AV1编码:Netflix 4K内容带宽成本↓40%,画质评分↑8.5分

- H.266标准:单流带宽↓50%,综合成本↓16%,卡顿率↓50%

- AI Codec:压缩率↑25%,存储/传输成本↓25%,画质优化提升用户体验

这种平衡不仅让企业在价格竞争中占据优势,更通过优质体验培养用户忠诚度------当用户在相同带宽下能观看1080P而非720P内容,或在低端设备上享受无卡顿播放时,付费意愿与留存率自然随之提升。软解码技术由此成为连接"降本"与"增效"的核心枢纽,在视频行业的商业化进程中扮演着不可替代的角色。

推动视频技术创新与普惠

视频软解码技术正以"技术创新-产业赋能-社会价值"的递进逻辑,重塑数字内容产业的发展格局。作为兼容性与灵活性的标杆方案,它不仅突破了硬件设备的限制,更通过开源生态与算法优化,让前沿视频技术从实验室走向大众生活,成为数字普惠的关键引擎。

技术创新:突破编码效率与场景边界

在技术创新层面,软解码正推动视频编码标准的代际跃升。新一代神经编解码器通过AI算法实现效率革命,在同等主观质量下较HEVC降低45%码率(MPAI测试数据),而H.266、AV1等先进标准的普及,则使4K/8K超高清、VR/AR等沉浸式内容的实时处理成为可能[21][25]。开源生态进一步加速了技术落地------CompressAI、DCVC等项目提供模块化工具链,libdav1d等高效解码器让低端设备也能流畅播放高画质AV1视频,彻底打破了"高端技术依赖高端硬件"的传统桎梏[21][26]。

产业赋能:激活千行百业的视频价值

软解码技术已成为数字内容产业的"基础设施",推动多行业实现效率与体验的双重突破。在安防监控领域,毫秒级告警与多路处理能力加速智能化升级;远程医疗场景中,高清低延迟编解码支撑手术协作,预计2025年医疗影像编解码市场规模将达28亿美元,年增速超25%[41]。更值得关注的是元宇宙与VR领域,120Hz刷新率与20ms延迟的技术指标,让沉浸式互动从概念走向现实,2025年相关应用用户规模预计突破8亿[19][34]。这种产业渗透直接反映在市场规模上:2023年全球视频编解码市场突破95亿美元,2030年预计达300亿美元,年增长率保持15-18%[41]。

社会价值:让视频技术触手可及

技术普惠是软解码最具温度的贡献。通过开源工具(如FFmpeg、OBS Studio)与模块化SDK,中小开发者与企业能快速搭建音视频能力,2025年新兴企业在该领域的市场份额占比预计提升至25%[30][35]。硬件门槛的降低更具革命性------资源受限的移动设备、AI PC等普通终端,如今可支持8K编码和4K 120fps解码,直接推动中国在线教育、远程医疗等领域服务覆盖人群扩大50%[25][35]。正如"学海课堂"基于HarmonyOS AVCodec Kit实现低延迟在线教育,软解码正通过"轻量化技术+场景化方案"的组合,让数字内容服务跨越设备、地域与经济条件的鸿沟,真正实现"全民可及"[40]。

技术普惠的三大核心表现

- 设备无门槛:老旧手机、嵌入式设备均可通过软件升级支持新格式

- 成本可负担:开源解码器降低企业技术投入,中小开发者无需百万级授权费

- 能力易获取:模块化SDK(如B站WasmPlayer)实现"5行代码集成4K播放"

从实验室的技术突破到偏远地区的教育平板,软解码技术正以"兼容性为桥、开源为路",让视频技术的进步惠及每一个人。在这个信息爆炸的时代,它不仅是产业升级的加速器,更是数字公平的守护者------用一行行代码,缩小着数字鸿沟,点亮着普惠之光。