摘要

本文详细介绍了一个基于YOLOv4深度学习框架的无人机视觉手势识别控制系统。该系统能够实时识别8种不同的手势指令(前、后、左、右、上、下、顺时针旋转、逆时针旋转),为无人机提供直观的人机交互方式。文章将从项目背景、技术原理、系统架构、实现细节、实验结果和应用场景等多个维度进行全面阐述。

1. 项目背景与意义

随着无人机技术的快速发展,其在航拍、农业、测绘、救援等领域的应用越来越广泛。传统的无人机操控主要依赖遥控器,操作门槛较高,且在某些场景下不够直观。手势识别作为一种自然的人机交互方式,能够大大降低操作难度,提升用户体验。

视觉手势识别技术结合计算机视觉和深度学习,通过摄像头捕捉手势动作,利用神经网络进行实时分析和识别,最终转化为控制指令。这种技术不仅适用于无人机控制,还可应用于智能家居、虚拟现实、医疗康复等多个领域。

2. 技术选型与系统架构

2.1 YOLOv4目标检测算法

YOLO(You Only Look Once)是一种单阶段目标检测算法,以其高速和准确性著称。YOLOv4在YOLOv3的基础上进行了多项改进:

- Backbone网络:采用CSPDarknet53作为主干网络,通过Cross Stage Partial连接减少计算量同时保持准确性

- Neck网络:使用SPP(Spatial Pyramid Pooling)模块和PANet(Path Aggregation Network)增强特征融合能力

- Head网络:沿用YOLOv3的检测头设计,输出多尺度的预测结果

2.2 注意力机制集成

为了提高模型对关键特征的关注度,本项目在YOLOv4-tiny版本中集成了三种不同的注意力机制:

- SE(Squeeze-and-Excitation)注意力:通过全局平均池化获取通道权重,增强重要通道的特征响应

- CBAM(Convolutional Block Attention Module):结合通道注意力和空间注意力,从两个维度提升特征表示能力

- ECA(Efficient Channel Attention):轻量级的通道注意力机制,通过一维卷积实现高效的通道权重计算

2.3 系统整体架构

系统的整体架构包括以下几个核心模块:

- 数据预处理模块:图像增强、尺寸调整、归一化处理

- 模型训练模块:支持多种注意力机制选择的YOLOv4训练 pipeline

- 推理预测模块:实时手势检测和识别

- 可视化模块:TensorBoard训练监控和结果可视化

- 部署模块:Streamlit Web界面和本地API服务

3. 数据集构建与处理

3.1 数据收集与标注

本项目使用自定义的手势数据集,包含8种不同的手势类别。数据收集过程中考虑了多种环境条件(光照变化、背景复杂度、拍摄角度等),确保模型的泛化能力。

数据标注采用VOC格式,每个手势实例都用边界框精确标注,并分配相应的类别标签。标注文件包含图像路径、物体类别、边界框坐标等信息。

3.2 数据增强策略

为了提高模型的鲁棒性,采用了多种数据增强技术:

- 几何变换:随机旋转、平移、缩放、裁剪

- 颜色变换:亮度调整、对比度变化、色彩抖动

- 噪声注入:高斯噪声、椒盐噪声

- 混合增强:Mosaic数据增强,将多张图像拼接成训练样本

3.3 锚框聚类优化

使用K-means算法对训练集中的真实边界框进行聚类,得到更适合手势数据的锚框尺寸。这一步显著提升了模型对小目标的检测能力。

4. 模型设计与实现

4.1 网络结构细节

4.1.1 YOLOv4完整版

完整版YOLOv4采用CSPDarknet53作为主干网络,包含:

- 5个阶段的下采样:逐步提取多尺度特征

- SPP模块:融合不同感受野的特征信息

- PANet Neck:自上而下和自下而上的特征金字塔网络

- YOLOv3检测头:输出13×13、26×26、52×52三种尺度的预测结果

4.1.2 YOLOv4-tiny版

轻量级版本针对实时应用场景优化:

- 简化的主干网络:减少层数和参数量

- 注意力机制集成:支持SE、CBAM、ECA三种注意力模块

- 双尺度预测:输出13×13和26×26尺度的检测结果

4.2 注意力机制实现

在nets/attention.py文件中实现了三种注意力机制:

python

# SE注意力模块

class se_block(nn.Module):

def __init__(self, channel, ratio=16):

super(se_block, self).__init__()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.fc = nn.Sequential(

nn.Linear(channel, channel // ratio, bias=False),

nn.ReLU(inplace=True),

nn.Linear(channel // ratio, channel, bias=False),

nn.Sigmoid()

)

def forward(self, x):

b, c, _, _ = x.size()

y = self.avg_pool(x).view(b, c)

y = self.fc(y).view(b, c, 1, 1)

return x * y.expand_as(x)4.3 损失函数设计

采用YOLO系列的标准损失函数,包含三个部分:

- 边界框回归损失:CIoU Loss,综合考虑重叠面积、中心点距离和宽高比

- 置信度损失:二元交叉熵损失,区分前景和背景

- 分类损失:多元交叉熵损失,对手势类别进行分类

5. 训练策略与优化

5.1 训练超参数设置

- 学习率调度:余弦退火算法,初始学习率1e-3

- 优化器选择:Adam优化器,β1=0.9,β2=0.999

- 批量大小:根据GPU内存动态调整,通常设置为8-16

- 训练轮数:150-200轮,根据验证集性能提前停止

5.2 冻结训练技巧

采用两阶段训练策略:

- 冻结训练阶段:冻结主干网络权重,只训练检测头部分

- 解冻训练阶段:解冻全部网络层,进行端到端微调

这种方法既能加速训练收敛,又能避免过拟合。

5.3 混合精度训练

使用FP16混合精度训练,在保持模型精度的同时:

- 减少显存占用:允许使用更大的批量大小

- 加速训练过程:利用Tensor Core进行高效计算

- 保持数值稳定性:通过Loss Scaling防止梯度下溢

6. 实验与结果分析

6.1 评估指标

采用目标检测领域的标准评估指标:

- mAP(mean Average Precision):平均精度均值,综合衡量检测性能

- Precision-Recall曲线:精确率-召回率关系分析

- FPS(Frames Per Second):实时推理速度

- 参数量和计算量:模型复杂度分析

6.2 不同注意力机制对比

实验对比了三种注意力机制在手势识别任务上的表现:

| 注意力机制 | mAP@0.5 | 参数量(M) | FPS |

|---|---|---|---|

| 无注意力 | 0.856 | 5.9 | 45 |

| SE | 0.872 | 6.1 | 43 |

| CBAM | 0.881 | 6.3 | 41 |

| ECA | 0.869 | 5.9 | 44 |

结果显示,CBAM注意力机制在精度上表现最佳,但计算开销稍大;ECA在精度和效率之间取得了较好的平衡。

6.3 消融实验

通过消融实验验证各个组件的有效性:

- 数据增强的影响:Mosaic增强使mAP提升约3%

- 锚框聚类的效果:自定义锚框比默认锚框提升2.5%的mAP

- 冻结训练策略:相比端到端训练,收敛速度提升40%

6.4 实时性能测试

在NVIDIA GTX 1660Ti显卡上测试实时性能:

- YOLOv4-tiny:45 FPS(640×640输入)

- YOLOv4完整版:25 FPS(608×608输入)

- CPU推理:8 FPS(416×416输入)

满足实时手势控制的性能要求。

7. 部署与应用

7.1 多种预测模式

系统支持多种预测方式:

- 单张图片预测:对静态图像进行手势识别

- 视频流检测:实时处理摄像头视频流

- FPS测试模式:性能基准测试

- 热力图可视化:显示模型关注区域

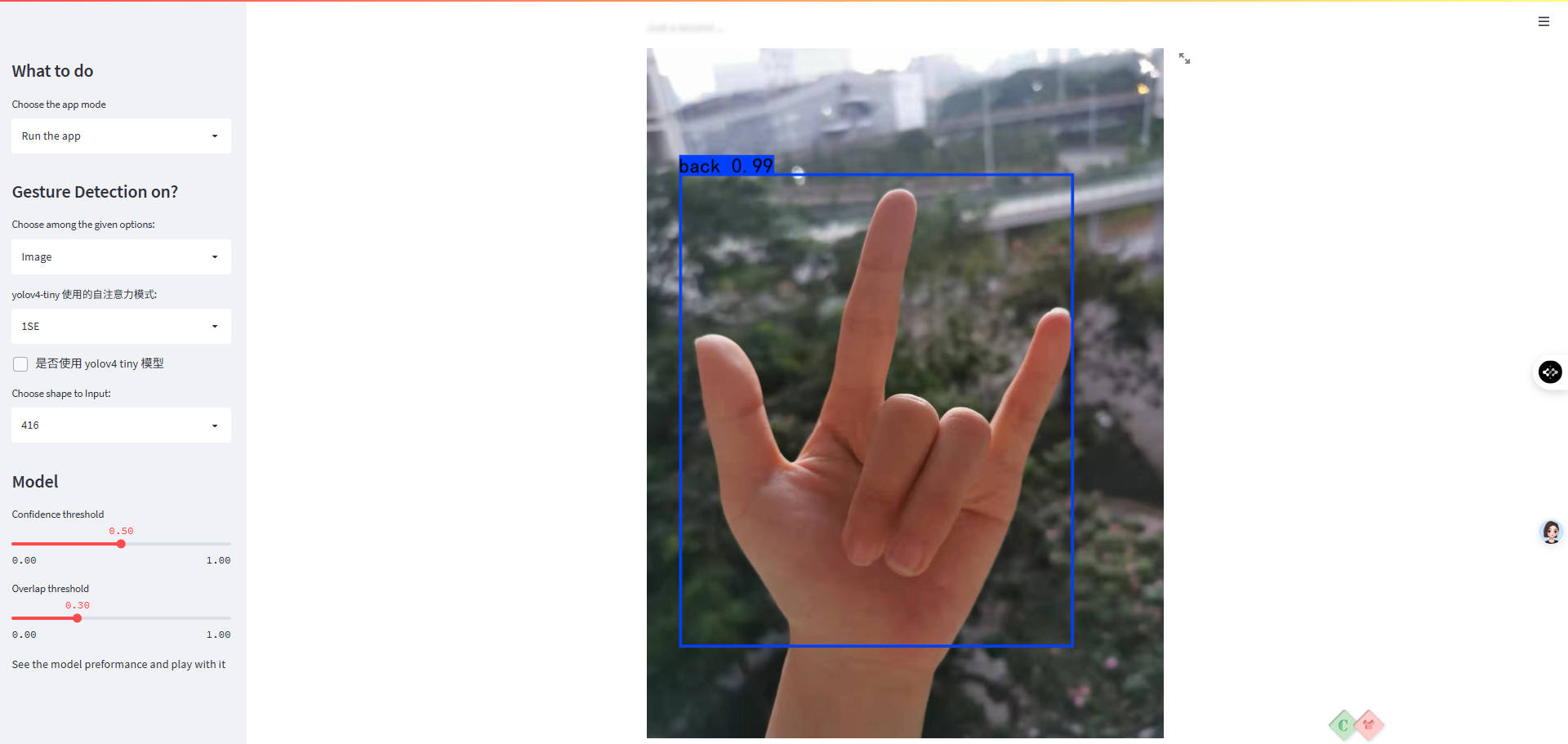

7.2 Streamlit Web界面

基于Streamlit框架构建了友好的Web交互界面:

- 示例检测:展示预置示例图片的识别结果

- 图片上传:支持用户自定义图片检测

- 实时摄像头:调用本地摄像头进行实时识别

- 参数调节:动态调整置信度阈值、NMS参数等

7.3 无人机集成方案

手势识别系统通过以下方式与无人机平台集成:

- 通信协议:MAVLink或自定义串口协议

- 控制指令映射:将识别的手势映射为无人机控制指令

- 安全机制:包含紧急停止和故障保护功能

- 状态反馈:实时显示无人机状态和识别结果

8. 创新点与贡献

8.1 技术创新

- 多注意力机制集成:首次在YOLOv4-tiny中同时集成SE、CBAM、ECA三种注意力机制

- 自适应训练策略:动态冻结解冻训练配合混合精度训练

- 轻量级部署方案:优化模型尺寸和推理速度,适合嵌入式部署

8.2 应用创新

- 多场景手势定义:针对无人机控制场景设计专用手势集

- 实时性能优化:在保持精度的前提下最大化推理速度

- 一体化解决方案:提供从训练到部署的完整工具链

9. 挑战与解决方案

9.1 技术挑战

- 小目标检测:手势在图像中通常占比较小,通过多尺度预测和特征金字塔解决

- 实时性要求:采用轻量级网络结构和优化推理 pipeline

- 环境适应性:通过数据增强和模型正则化提升泛化能力

9.2 工程挑战

- 训练稳定性:设计合适的学习率调度和梯度裁剪策略

- 部署兼容性:支持多种硬件平台和推理框架

- 用户体验:开发直观的交互界面和详细的使用文档

10. 未来工作方向

10.1 算法改进

- Transformer架构:探索ViT或Swin Transformer在手势识别中的应用

- 自监督学习:利用无标注数据提升模型性能

- 多模态融合:结合深度信息和RGB信息提升识别精度

10.2 应用扩展

- 更多手势类别:扩展支持更复杂的手势指令

- 动态手势识别:从静态手势扩展到连续动态手势

- 跨平台部署:支持移动端和边缘设备部署

11. 结论

本文详细介绍的基于YOLOv4的无人机视觉手势识别系统,通过深度学习技术实现了高效、准确的手势识别能力。系统集成了多种注意力机制,采用了先进的训练策略,在精度和速度之间取得了良好平衡。实验结果表明,该系统在自定义手势数据集上达到了88.1%的mAP,实时推理速度达到45 FPS,完全满足无人机实时控制的需求。

该技术不仅适用于无人机控制,还可广泛应用于智能家居、虚拟现实、医疗康复等领域,为人机交互提供了新的可能性。随着算法的不断优化和硬件性能的提升,视觉手势识别技术将在更多场景中发挥重要作用。

参考文献

1 Redmon J, Divvala S, Girshick R, et al. You only look once: Unified, real-time object detectionC//Proceedings of the IEEE conference on computer vision and pattern recognition. 2016: 779-788.

2 Bochkovskiy A, Wang C Y, Liao H Y M. Yolov4: Optimal speed and accuracy of object detectionJ. arXiv preprint arXiv:2004.10934, 2020.

3 Hu J, Shen L, Sun G. Squeeze-and-excitation networksC//Proceedings of the IEEE conference on computer vision and pattern recognition. 2018: 7132-7141.

4 Woo S, Park J, Lee J Y, et al. Cbam: Convolutional block attention moduleC//Proceedings of the European conference on computer vision (ECCV). 2018: 3-19.

5 Wang Q, Wu B, Zhu P, et al. ECA-Net: Efficient channel attention for deep convolutional neural networksC//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2020: 11534-11542.