上节内容讲解了wan2.2 fun control本节内容对wan2.2 fun系列模型的camera镜头控制模型与lnp首尾帧视频模型进行测试与讲解。

Wan2.2-Fun-Camera-Control是阿里基于Wan2.2框架推出的图生视频运镜控制模型 。它支持512、768、1024等多分辨率的视频预测,以81帧、每秒16帧视频数据集训练,还支持多语言预测。该模型能实现丰富运镜效果,包括摇镜上移、左移、右移、下移,推镜、拉镜,以及摇镜上移与左移或右移的组合等。借助它,创作者无需复杂提示词,就能精准实现复杂运镜视频控制,极大提升视频创作中镜头语言的表现力 。

Wan2.2-Fun-Inp是阿里巴巴PAI团队开源的视频首尾帧生成模型,采用Apache 2.0许可协议,支持商业使用。它允许用户输入首帧与尾帧图像,模型自动补全中间过渡动画,有效提升视频连贯性与创作自由度。基于先进的Wan2.2架构,它能输出影视级高质量视频,在画面细节、光影和色彩表现上十分出色。并且,该模型支持512×512、768×768、1024×1024等多分辨率视频生成,可满足广告制作、影视创作、短视频制作等不同场景需求 。(wan2.2基础模型也具备首尾帧视频功能,详见wan2.2基础模型对应文章内容)

文末附相关模型的网盘下载地址。

1 模型下载

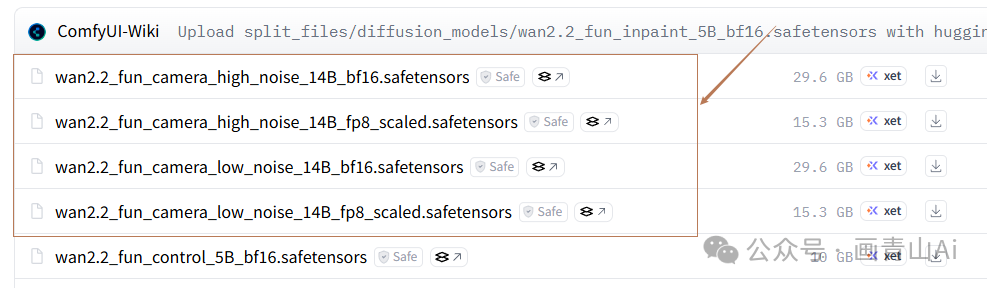

1.1 wan2.2 fun camera镜头控制模型

模型下载地址(需科学上网):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/diffusion_models

模型分为5B和14B模型两种规格。

14B模型划分为高噪声模型与低噪声模型,且每类模型又分为fp16与fp8两种模型。

模型安装位置:..\ComfyUI\models\diffusion_models

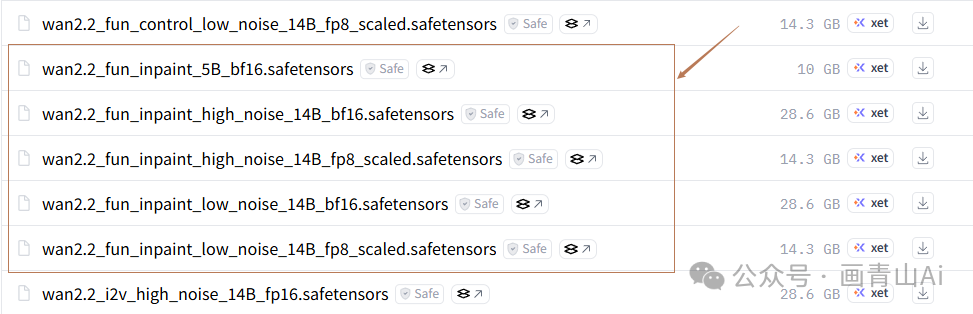

1.2 Wan2.2-Fun-Inp首尾帧视频模型

上述模型下载地址中,下载名称为wan2.2funinpaint相关模型。

模型安装位置:..\ComfyUI\models\diffusion_models

注:wan2.2系列模型对应的VAE等模型使用方式一致,如已按前文内容下载VAE等模型,则后续模型无需再重复下载。

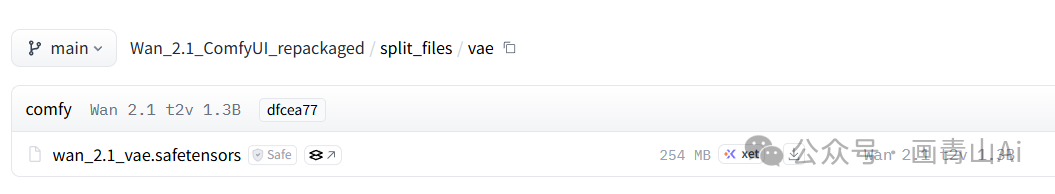

1.3 VAE模型

(1)14B版本模型工作流中所使用的VAE模型仍是wan2.1版本的VAE模型。

下载地址:

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/tree/main/split_files/vae

文件存放目录:..\comfyui\models\vae

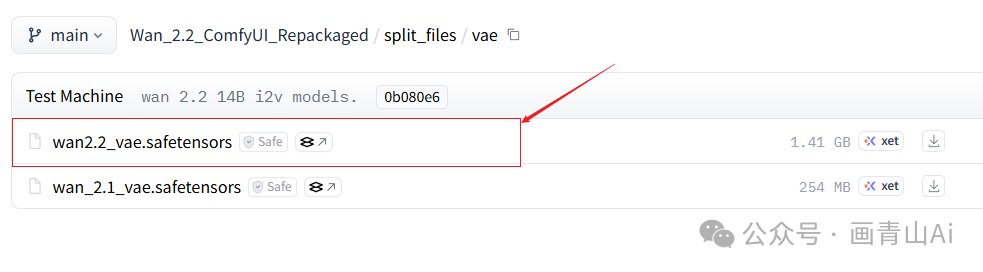

(2)5B混合模型使用wan2.2专用VAE模型,下载地址:

wan2.2_vae.safetensors

模型下载地址(需科学上网):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/vae

模型安装位置:..\comfyui\models\vae

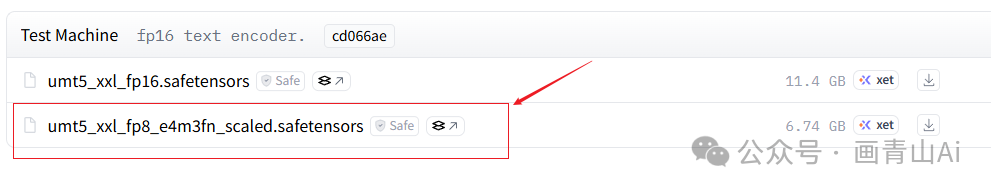

1.4Text Encoder文本编码器

umt5_xxl_fp8_e4m3fn_scaled.safetensors

模型下载地址(需科学上网):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/text_encoders

注:该模型与wan2.1/2.2系列模型共用,如已使用过wan模型则无需重复下载。

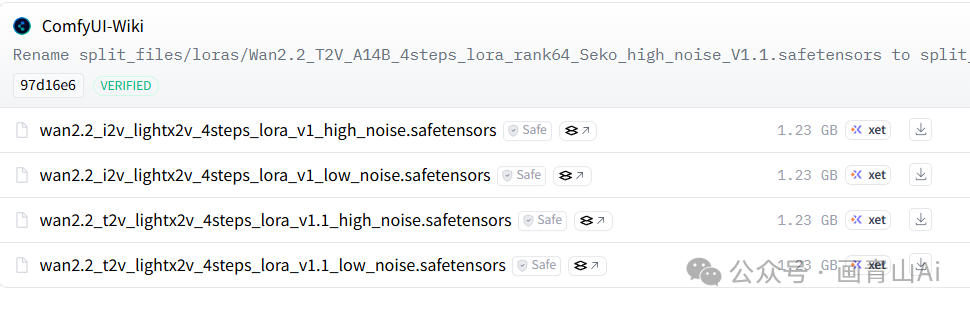

1.5加速lora模型(lightx2v_4steps_lora)

模型下载地址(需科学上网):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/loras

模型安装目录:..\comfyui\models\loras

高噪声和低噪声模型加载器后均需链接对应版本的加速lora模型。

使用了 lightx2v 的 Wan2.2-Lightning 4 步 LoRA : 但可能导致生成的视频动态会有损失,但速度会更快。下面是comfyorg官方使用RTX4090D 24GB显存GPU 测试的结果 640*640 分辨率,81 帧长度的用时对比:

|-----------------------|---------|------|--------|---------|

| 模型类型 | 分辨率 | 显存占用 | 首次生成时长 | 第二次生成时长 |

| fp8_scaled | 640×640 | 83% | ≈ 524秒 | ≈ 520秒 |

| fp8_scaled + 4步LoRA加速 | 640×640 | 89% | ≈ 138秒 | ≈ 79秒 |

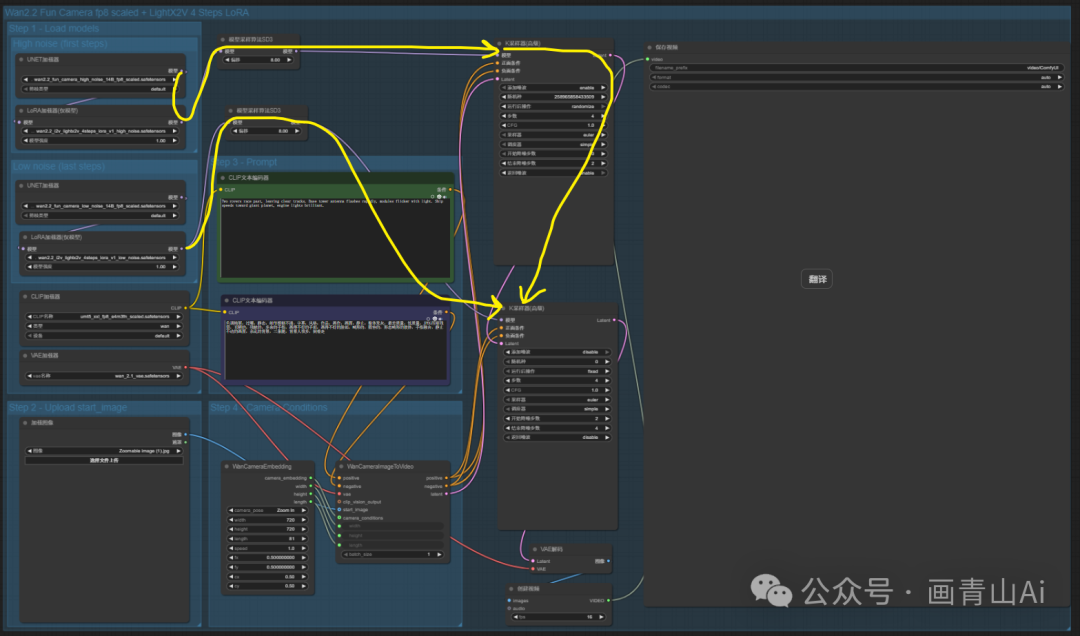

2 工作流

2.1 wan2.2 fun camera镜头控制模型

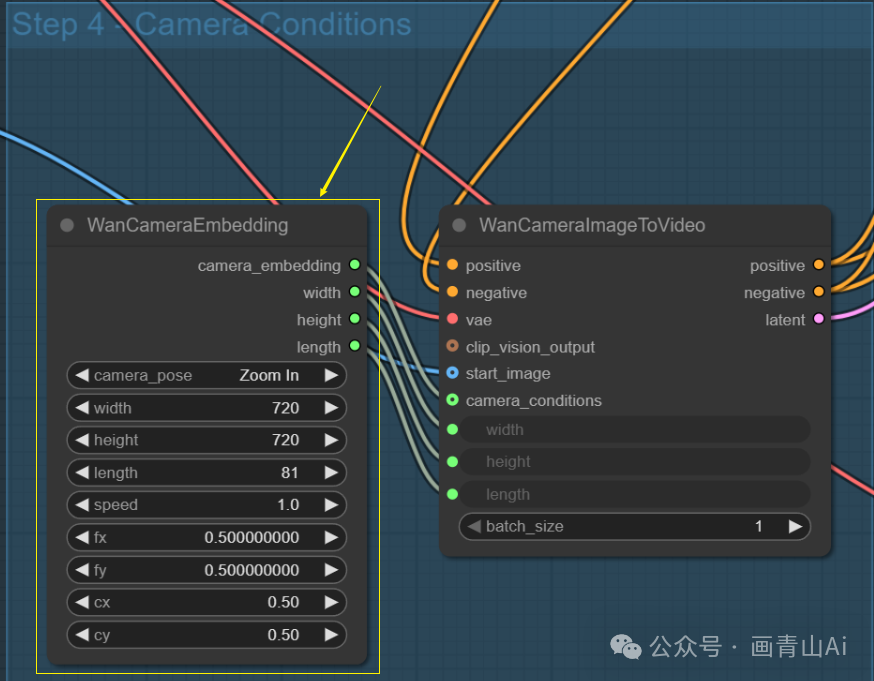

在 WanCameraEmbedding 节点设置相机控制参数:

Camera Motion: 选择相机运动类型(Zoom In、Zoom Out、Pan Up、Pan Down、Pan Left、Pan Right、Static 等)

Width/Height: 设置视频分辨率

Length: 设置视频帧数(默认81帧)

Speed: 设置视频速度(默认1.0)

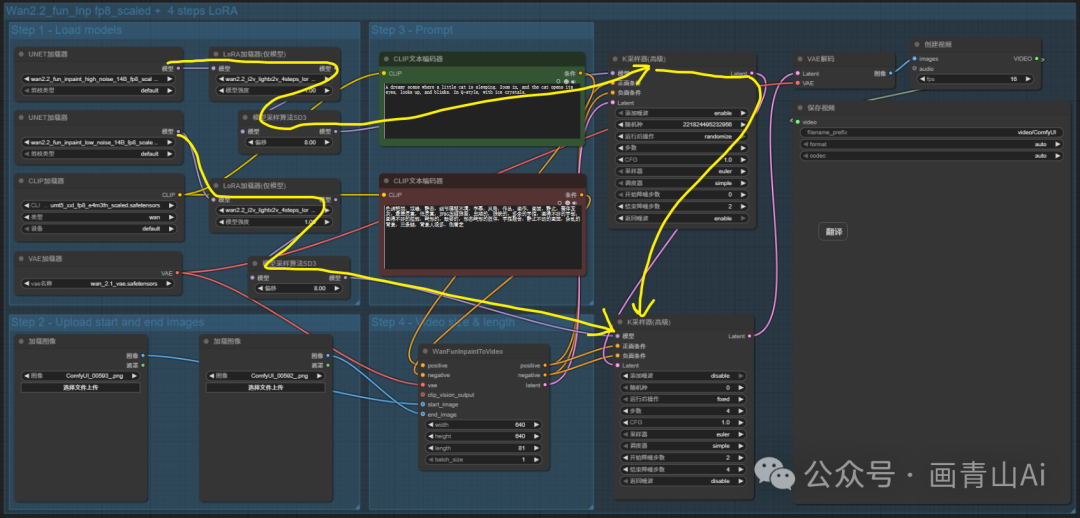

2.2wan2.2 fun lnp首尾帧视频模型

(1)首尾帧图片上传,分别上传首尾帧图片素材

(2)WanFunInpaintToVideo 节点尺寸和视频长度调整:

调整 width 和 height 的尺寸,默认为 640, 我们设置了较小的尺寸你可以按需进行修改:

调整 length, 这里为视频总帧数,当前工作流 fps 为 16, 假设你需要生成一个 5 秒的视频,那么你应该设置 5*16 = 80

3 附件

本节内容涉及模型网盘地址:https://pan.quark.cn/s/0062f602f8b4

模型文件已进行整理,网盘内包含工作流获取方式,适合不方便科学上网的的小伙伴下载使用。模型文件数量较多且尺寸较大,为避免下载中断等问题,可先转存再下载。

欢迎正在学习comfyui等ai技术的伙伴V加 huaqs123 进入学习小组。在这里大家共同学习comfyui的基础知识、最新模型与工作流、行业前沿信息等,也可以讨论comfyui商业落地的思路与方向。 欢迎感兴趣的小伙伴,群共享资料会分享博主自用的comfyui整合包(已安装超全节点与必备模型)、基础学习资料、高级工作流等资源......

致敬每一位在路上的学习者,你我共勉!Ai技术发展迅速,学习comfyUI是紧跟时代的第一步,促进商业落地并创造价值才是学习的实际目标。

------画青山Ai学习专栏---------------------------------------------------------------------------------------------

零基础学Webui:

https://blog.csdn.net/vip_zgx888/category_13020854.html

Comfyui基础学习与实操:

https://blog.csdn.net/vip_zgx888/category_13006170.html

comfyui功能精进与探索:

https://blog.csdn.net/vip_zgx888/category_13005478.html

系列专栏持续更新中,欢迎订阅关注,共同学习,共同进步!