Flux官方模型发布后,开源社区很快就训练出了flux生态下的controlne,本节内容我们就开源社区发布的几种不同的controlnet模型及应用进行尝试。

1 Xlabs-Ai系列controlnet

XLabs-AI共发布三款controlnet模型,分别为 canny(硬边缘)、depth(深度) 和 hed(软边缘) ,目前均已经更新至V3版本。

1.1 模型下载

canny V3版模型下载链接:

https://huggingface.co/XLabs-AI/flux-controlnet-canny-v3/tree/main

depth V3版模型下载链接:

https://huggingface.co/XLabs-AI/flux-controlnet-depth-v3/tree/main

hed V3版模型下载链接:

https://huggingface.co/XLabs-AI/flux-controlnet-hed-v3/tree/main

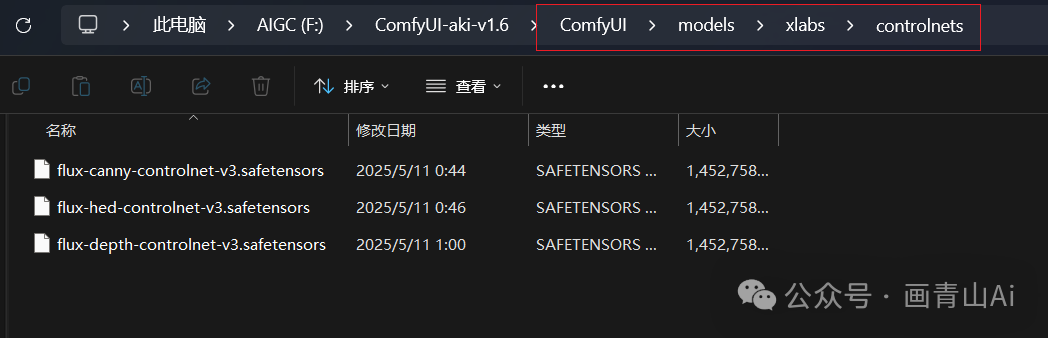

模型放置位置..\ComfyUI\models\xlabs\controlnets

(如没有对应文件夹,新建即可)

1.2 插件安装

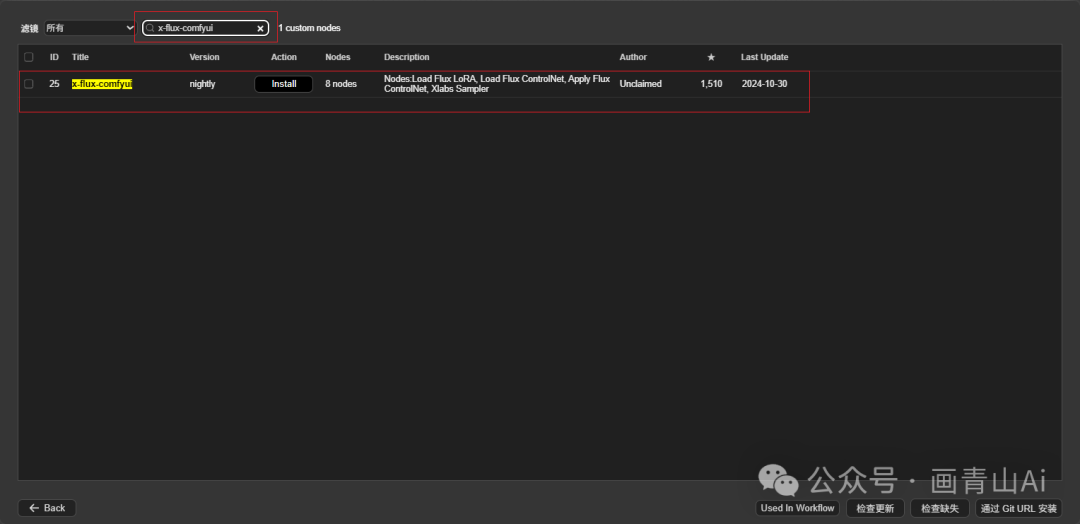

使用xlabs-ai的controlnet,需要使用对应的插件与对应的工作流程。

插件地址:https://github.com/XLabs-AI/x-flux-comfyui

插件也可以通过管理器搜索"x-flux-comfyui"进行安装。

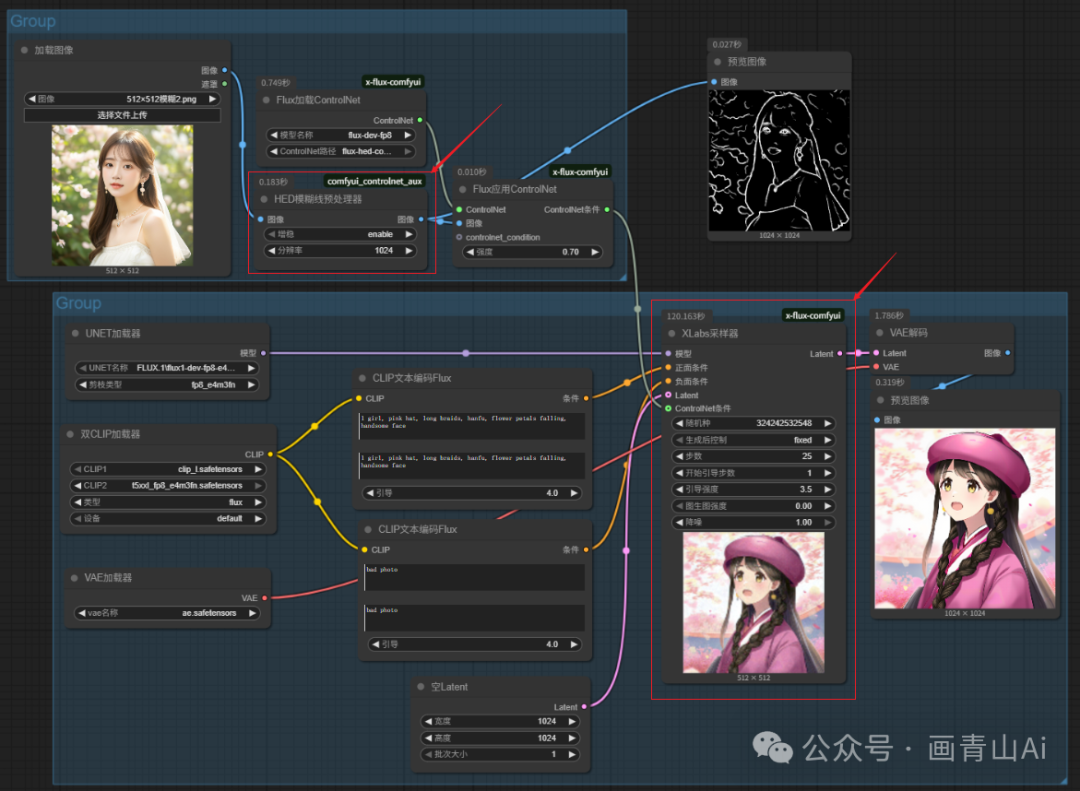

1.3 示例工作流

插件安装完成后,可以在..\ComfyUI\custom_nodes\x-flux-comfyui\workflows中看到示例工作流。

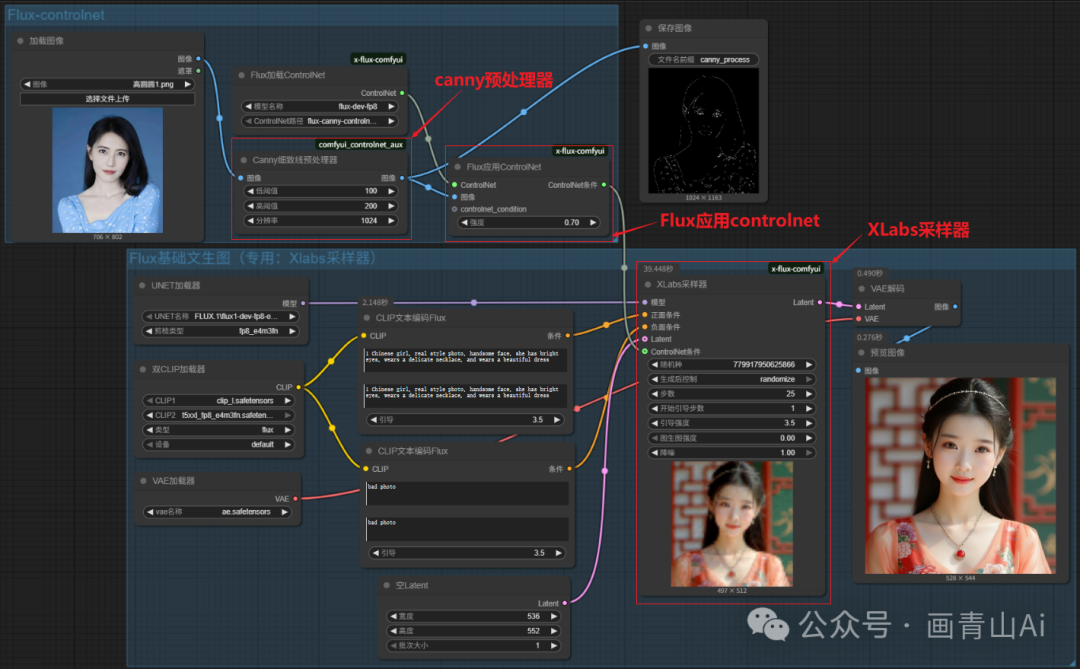

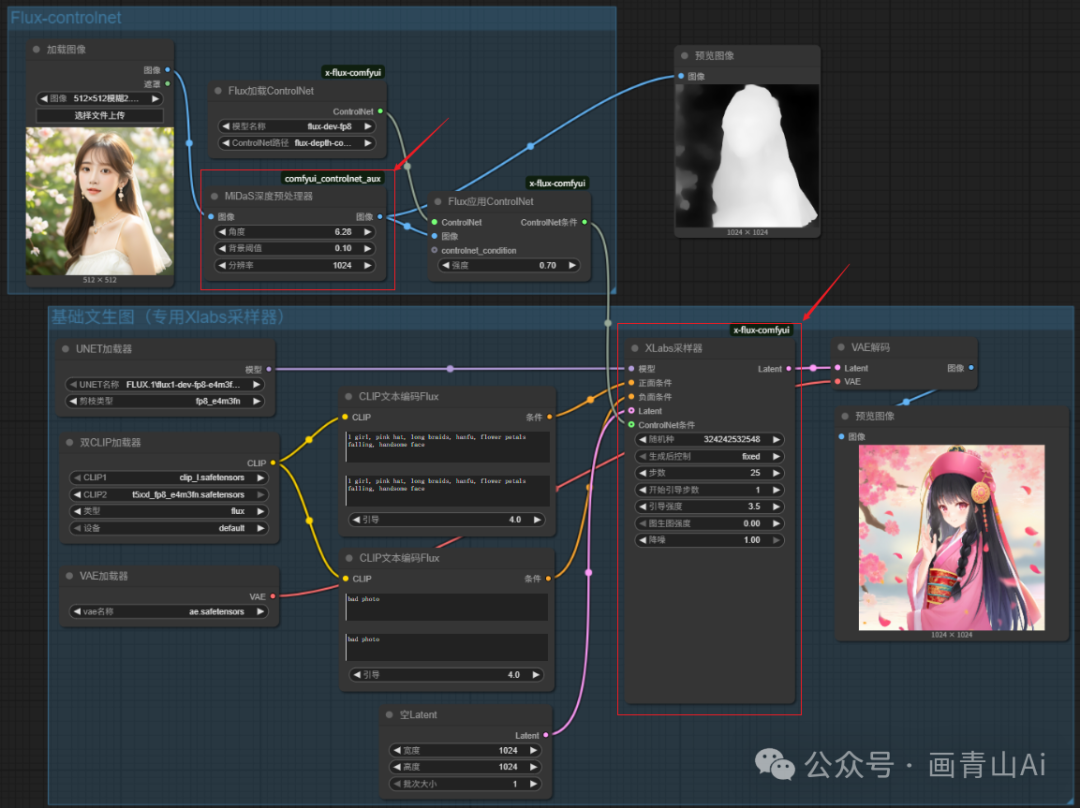

Flux模型的controlnet工作流逻辑与1.5/xl系列模型的逻辑相同,特殊点是需要使用Flux模型专用的"Flux应用controlnet"节点,不同的controlnet使用不同的预处理器。另外,采样器需要使用专用的"XLabs采样器"。

注意:Xlabs-ai的controlnet仅支持dev版本的flux模型。

我们重新整理示例工作流,如下:

canny:

depth:

hed:

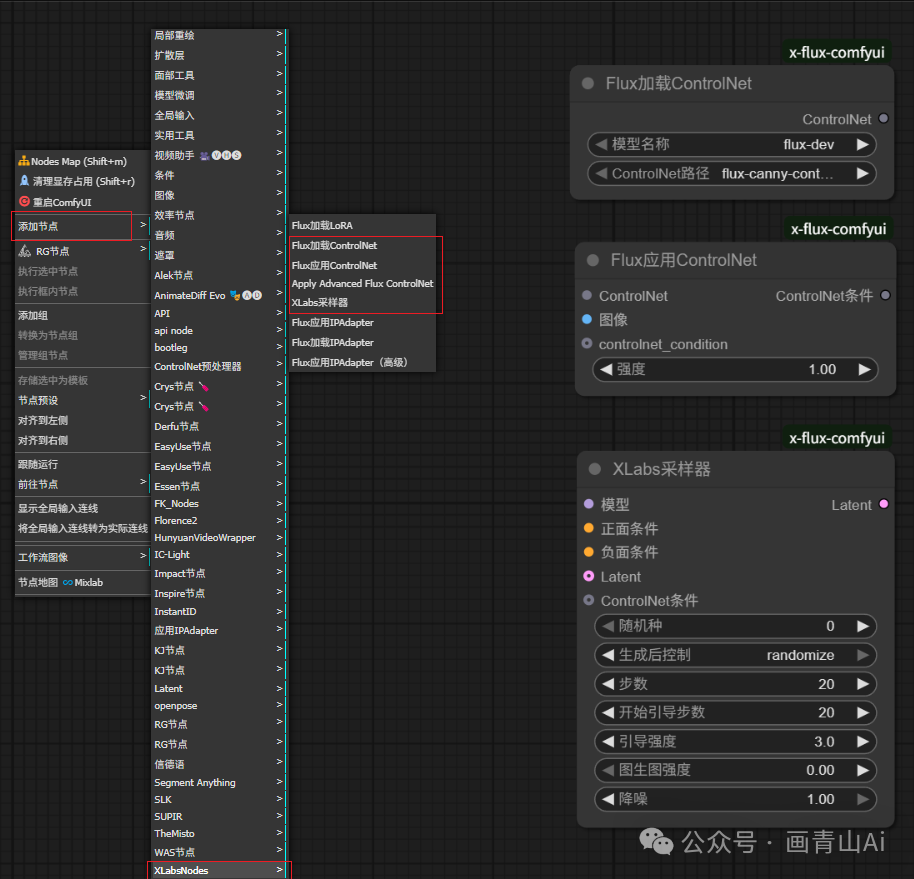

如果是新建工作流,xlabs相关节点的添加路径

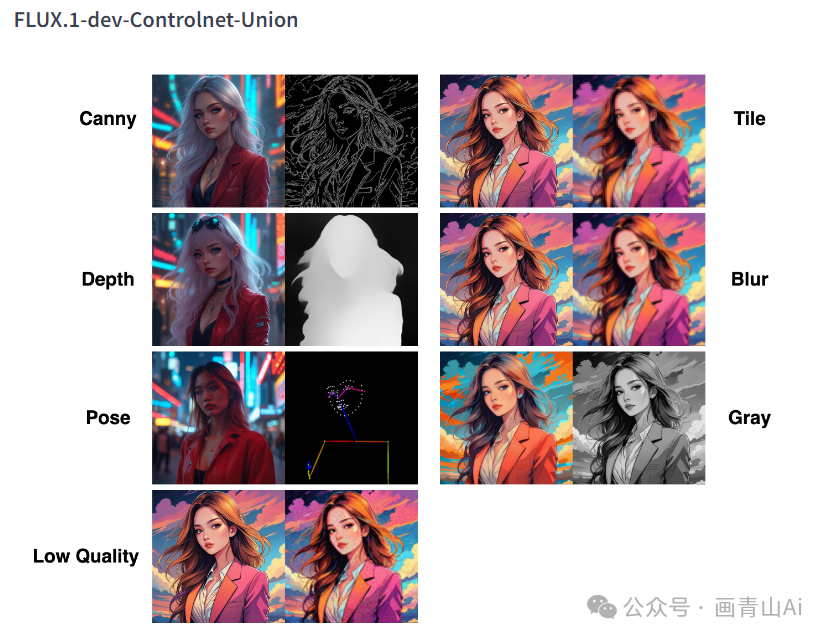

2 Union-alpha集成controlnet

我们在使用XL大模型的controlnet时,多合一的controlnet-union-sdxl-1.0一个模型同时具备多项controlnet功能,使用时不用再选择模型,十分便捷。Flux模型目前也有类似的controlnet,这就是InstantX团队发布的FLUX.1-dev-Controlnet-Union模型,一个模型可以适配canny、depth、Pose、Tile等多个控制条件。

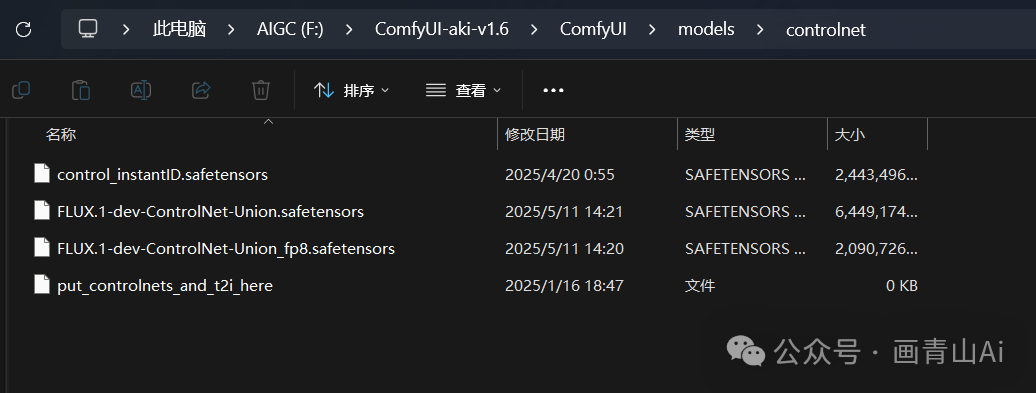

2.1 模型下载

官方模型地址:https://huggingface.co/InstantX/FLUX.1-dev-Controlnet-Union/tree/main

模型放置位置/comfyui/models/controlnet

2.2 插件安装

union的controlnet模型在刚发布时还需要安装ComfyUI-eesahesNodes插件才可以使用,不过随着comfyui的更新发展,新版本的comfyui原生节点已支持使用union-controlnet模型,官方页面也宣布弃用原eesahesNodes节点,并给出新的工作流示例。

原插件地址如下,不过作者已注明节点已弃用,可以无需再进行安装:

https://github.com/EeroHeikkinen/ComfyUI-eesahesNodes

原作者给出的新的工作流示例地址:

https://civitai.com/models/709352

2.3 示例工作流

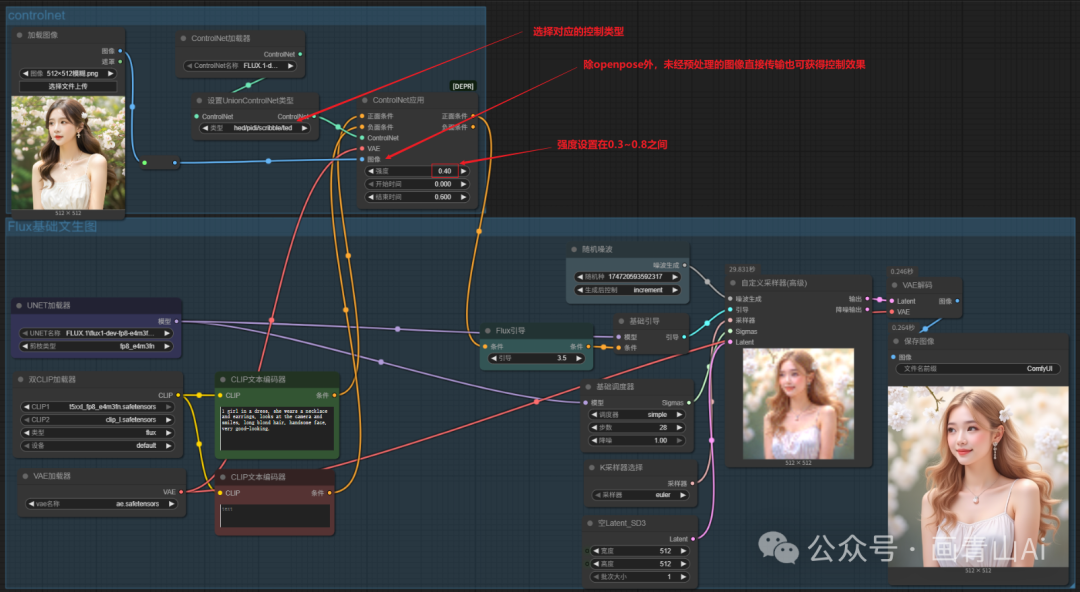

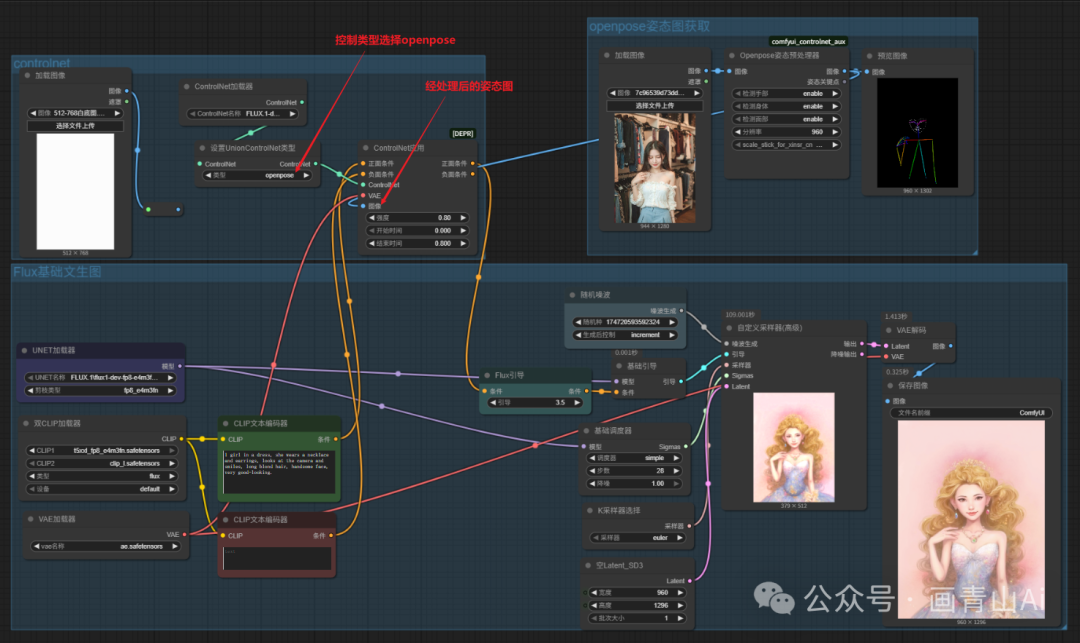

作者给出的示例工作流比较杂乱,我们重新整理分区,可以获得工作流如下:

该工作流中,"加载图像"节点将图像信息直接传入给"controlnet应用",虽然未经预处理器处理,但是除了openpose以外实测也能获得控制效果,而openpose则必须传入预处理后的姿态图才能生效。

"controlnet应用"节点中的"强度"参数推荐范围是0.5~0.8。

正常使用时,我们可以在"加载图像"节点后增加controlnet的预处理器,获取预处理后的图像再传入"controlnet应用"节点。这样的组合和1.5及XL模型的工作流类同。

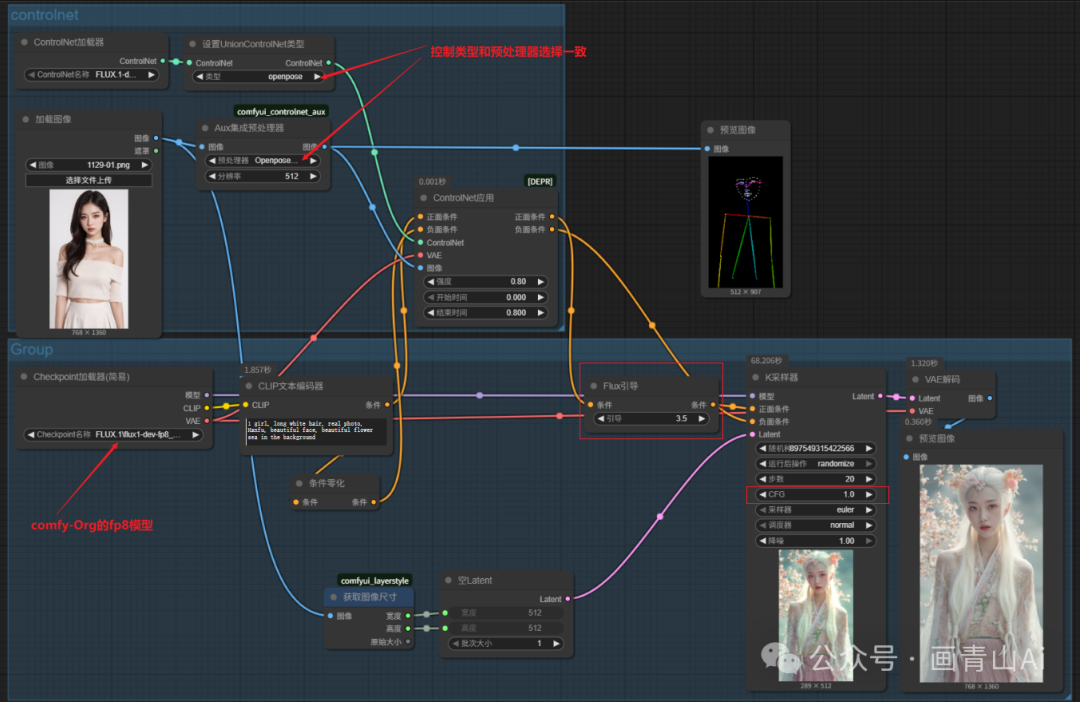

我们使用comfy-Org的fp8模型,获取更加精简的工作流如下:

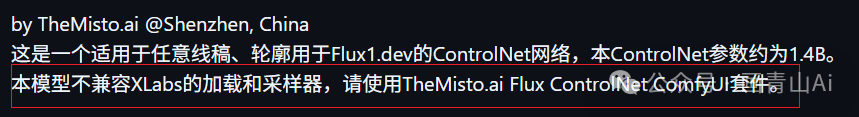

3 MistoControlNet-Flux-dev

MistoControlNet是Mistoai开发的专门用于线稿或轮廓控制的controlnet模型,它在线条控制方面有着优于其他模型的能力。

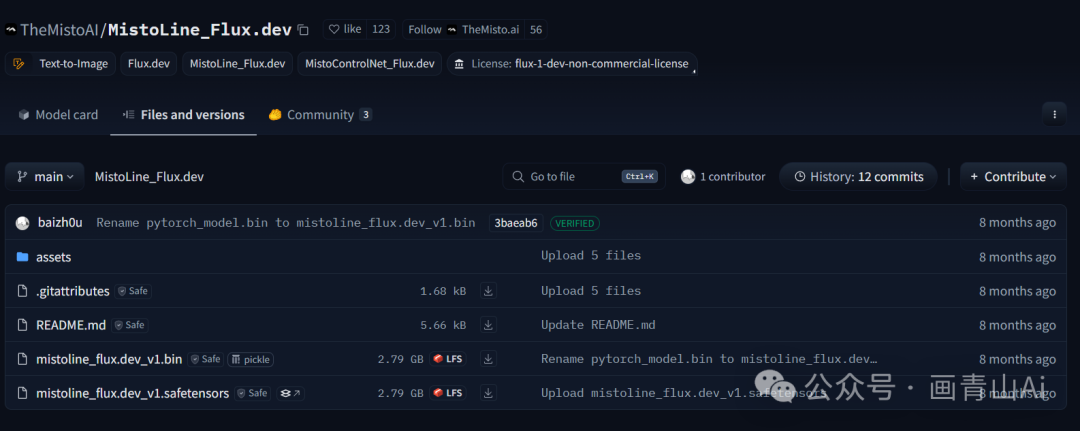

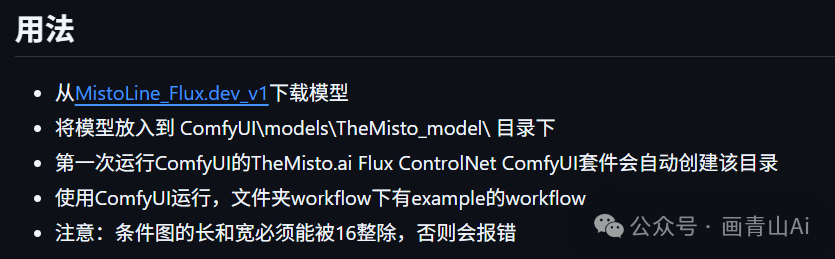

3.1 模型下载

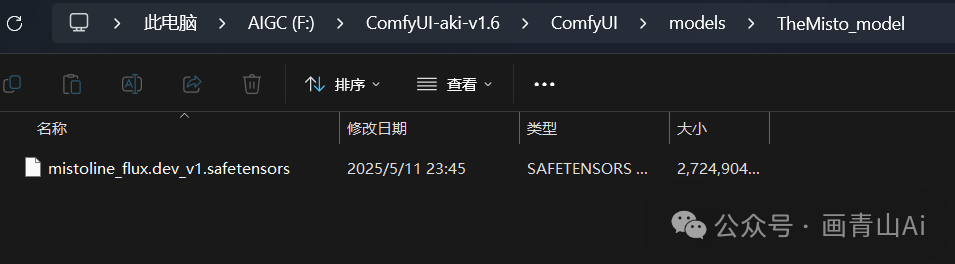

模型名称为mistoline_flux.dev_v1.safetensors

TheMistoAI/MistoLine_Flux.dev at main

模型放置目录ComfyUI\models\TheMisto_model\

(需要自行新建该文件夹,或首次运行对应插件时会自动新建该文件夹)

3.2 插件安装

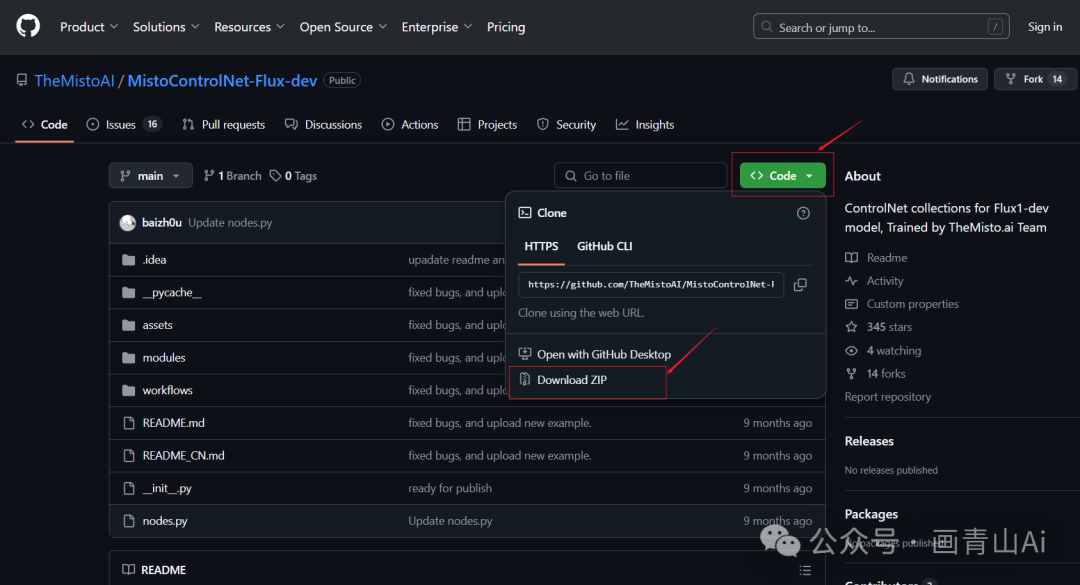

目前MistoControlNet-Flux-dev还没有入库,无法通过comfyui管理器安装。

项目地址:GitHub - TheMistoAI/MistoControlNet-Flux-dev: ControlNet collections for Flux1-dev model, Trained by TheMisto.ai Team

不过根据测试,通过启动器的url方式安装显示错误,通过git的方式也无法安装成功。最终仅可以使用手动下载的方式进行安装。

在MistoControlNet-Flux-dev主页,按上述方式手动下载插件模型并进行解压缩。

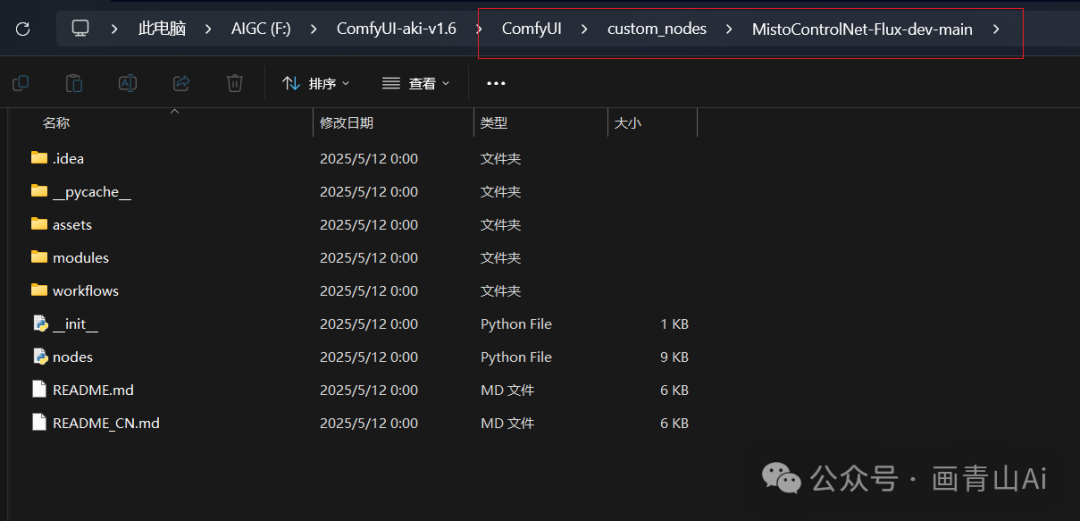

解压缩文件复制到..\ComfyUI\custom_nodes目录下,注意解压缩文件含重名子文件夹,需删除,安装完成参考下图所示。

3.3 示例工作流

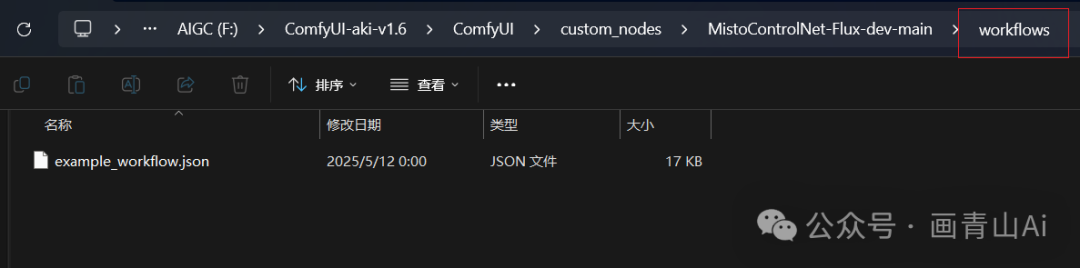

../Comfyui/custom_nodes/MistoControlNet-Flux-dev/workflows文件夹下有官方提供的示例工作流

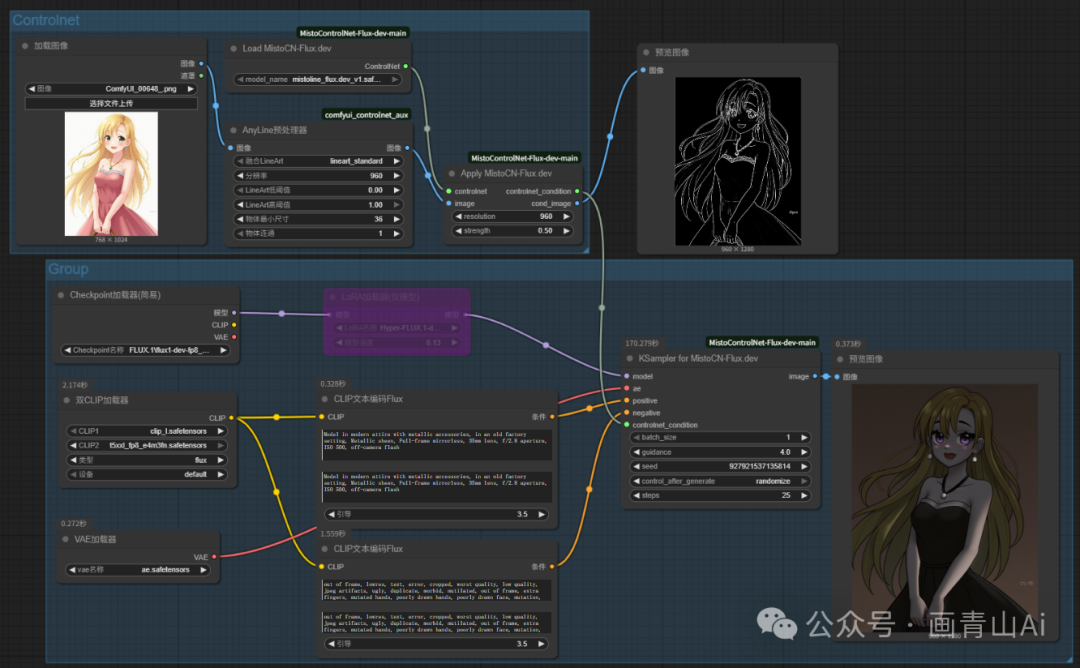

将示例工作流拖入comfyui工作界面,并对工作流重新整理排版如下:

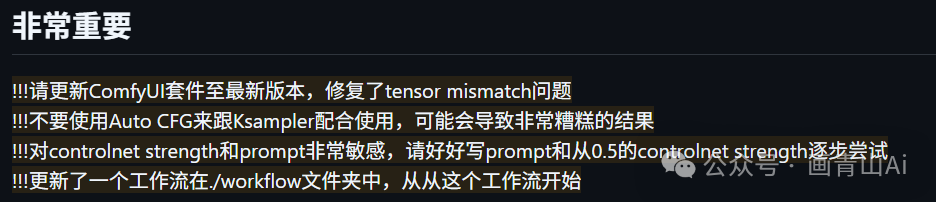

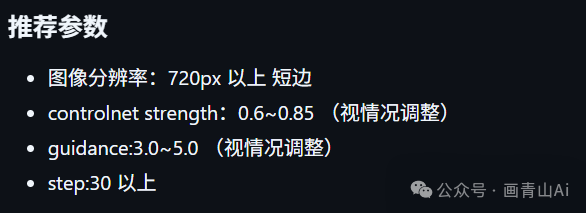

注意事项:

官方主页提供了中文说明,针对注意事项有相关提示,摘抄如下:

本节内容中的模型已上传至网盘,网盘链接如下:

https://pan.quark.cn/s/644de81a4f21

模型文件已进行整理,网盘内包含工作流获取方式,适合不方便科学上网的的小伙伴下载使用。模型文件数量较多且尺寸较大,为避免下载中断等问题,可先转存再下载。

欢迎正在学习comfyui等ai技术的伙伴V加 huaqs123 进入学习小组。在这里大家共同学习comfyui的基础知识、最新模型与工作流、行业前沿信息等,也可以讨论comfyui商业落地的思路与方向。 欢迎感兴趣的小伙伴,群共享资料会分享博主自用的comfyui整合包(已安装超全节点与必备模型)、基础学习资料、高级工作流等资源......

致敬每一位在路上的学习者,你我共勉!Ai技术发展迅速,学习comfyUI是紧跟时代的第一步,促进商业落地并创造价值才是学习的实际目标。

------画青山Ai学习专栏---------------------------------------------------------------------------------------------

零基础学Webui:

https://blog.csdn.net/vip_zgx888/category_13020854.html

Comfyui基础学习与实操:

https://blog.csdn.net/vip_zgx888/category_13006170.html

comfyui功能精进与探索:

https://blog.csdn.net/vip_zgx888/category_13005478.html

系列专栏持续更新中,欢迎订阅关注,共同学习,共同进步!