你刷视频的时候是否也遇到过这些烦恼:看教学视频没有字幕,步骤总被错过;看比赛时听不懂专业术语,全程不知所云......别怕,你的救星来啦!新加坡国立大学 Show Lab 与字节跳动公司于 2025 年 4 月 25 日推出了 LiveCC 模型,这是一个专注于大规模流式语音转录的视频大语言模型项目,旨在通过创新的视频 - 自动语音识别(ASR)流式方法训练出首个具备实时评论能力的视频大语言模型。简单来说,它就是你的专属解说员,分析视频内容、解析字幕对它来说都是小菜一碟。

使用云平台:OpenBayes

openbayes.com/console/sig...

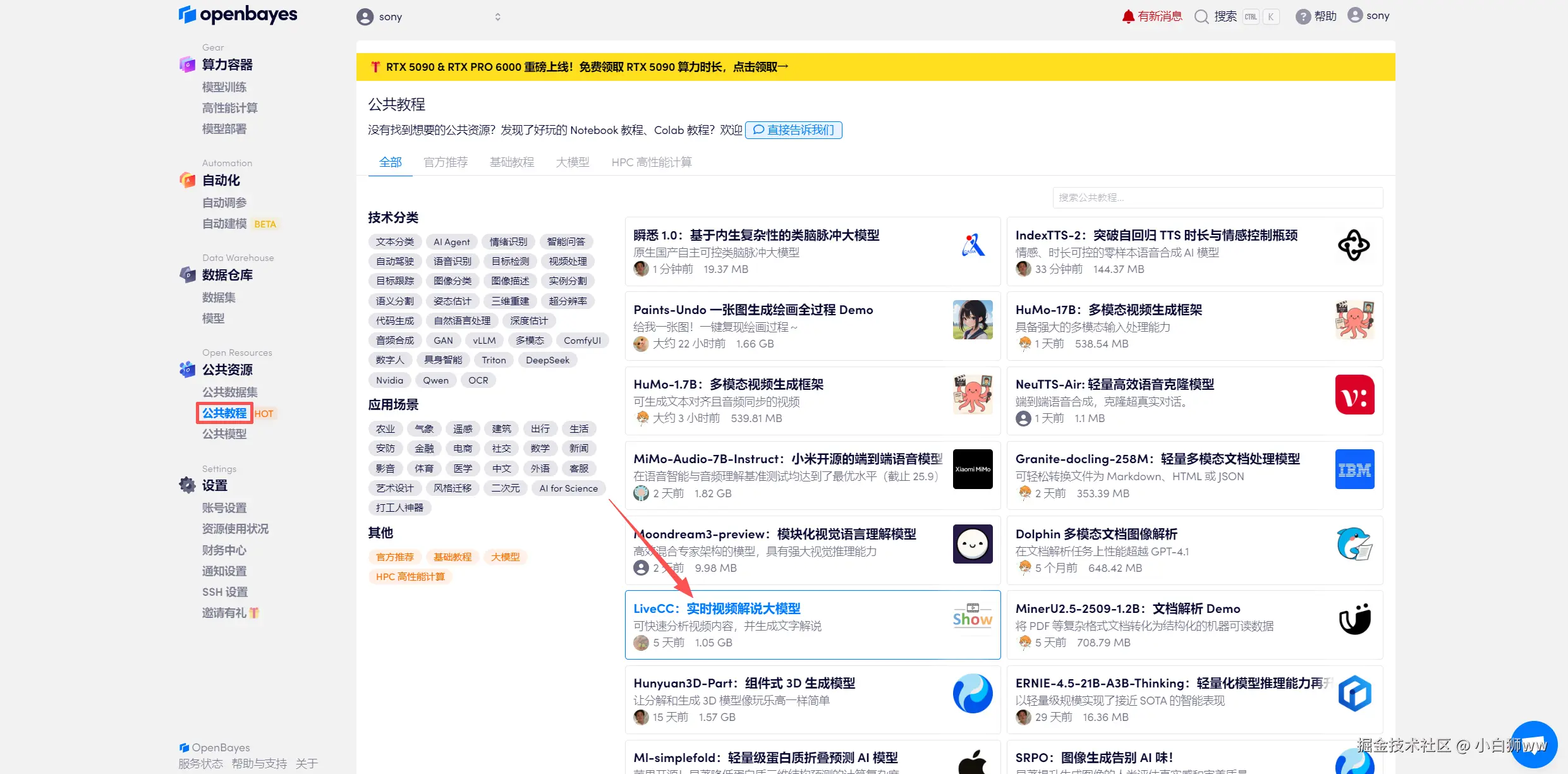

登录 OpenBayes.com,在「公共教程」页面,选择一键部署 「LiveCC:实时视频解说大模型」教程。

页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

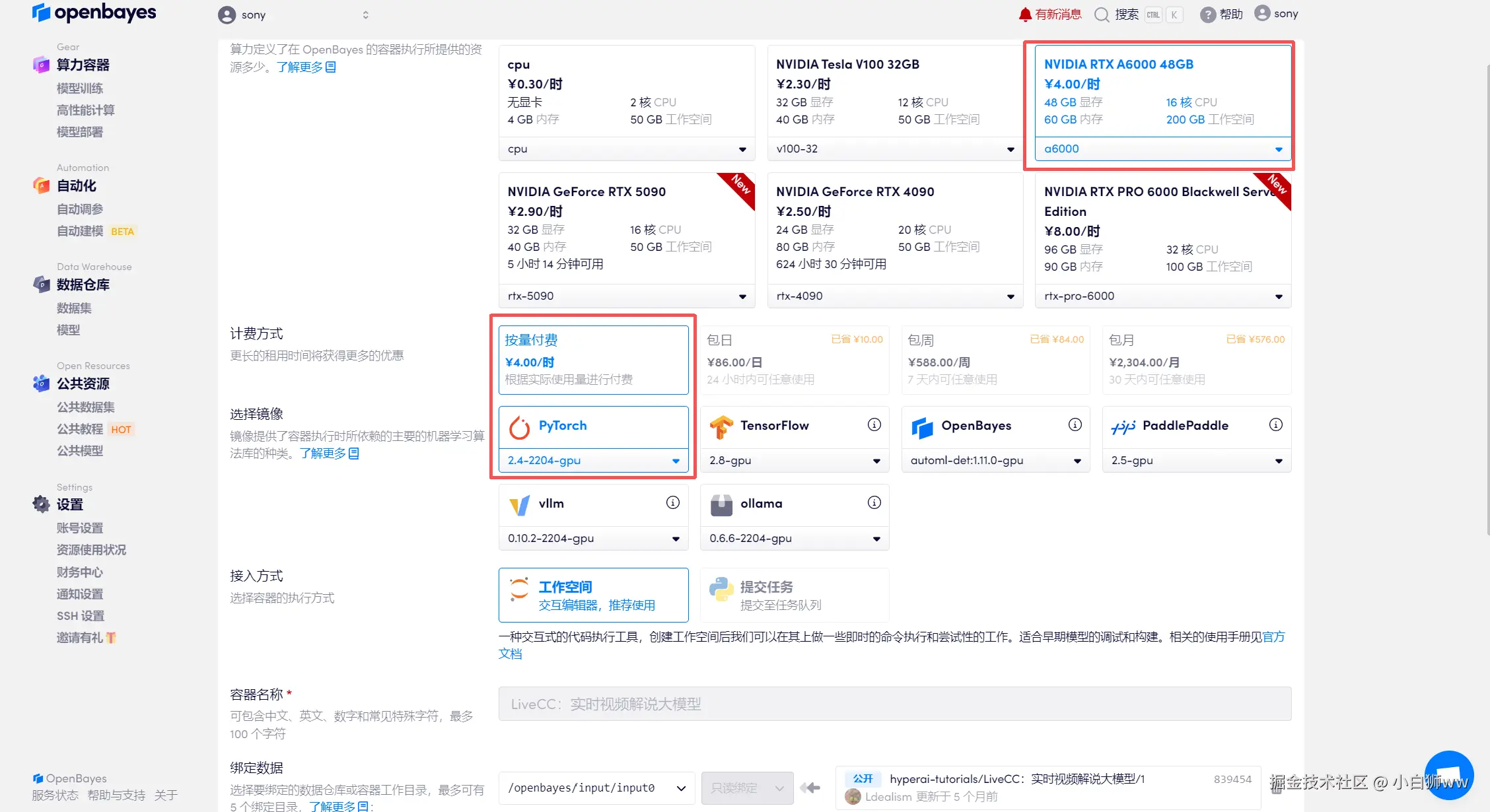

页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

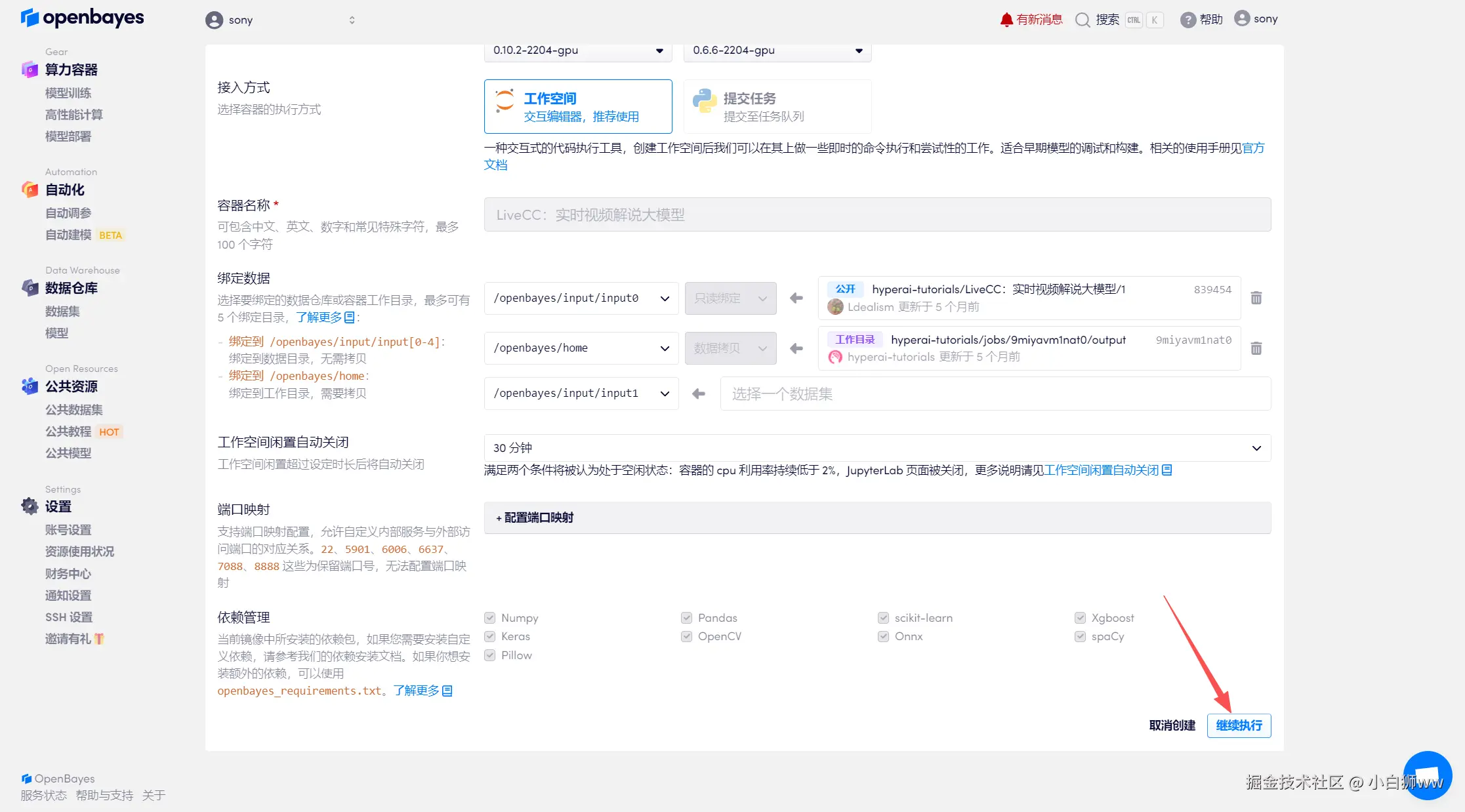

在当前页面中看到的算力资源均可以在平台一键选择使用。平台会默认选配好原教程所使用的算力资源、镜像版本,不需要再进行手动选择。点击「继续执行」,等待分配资源。

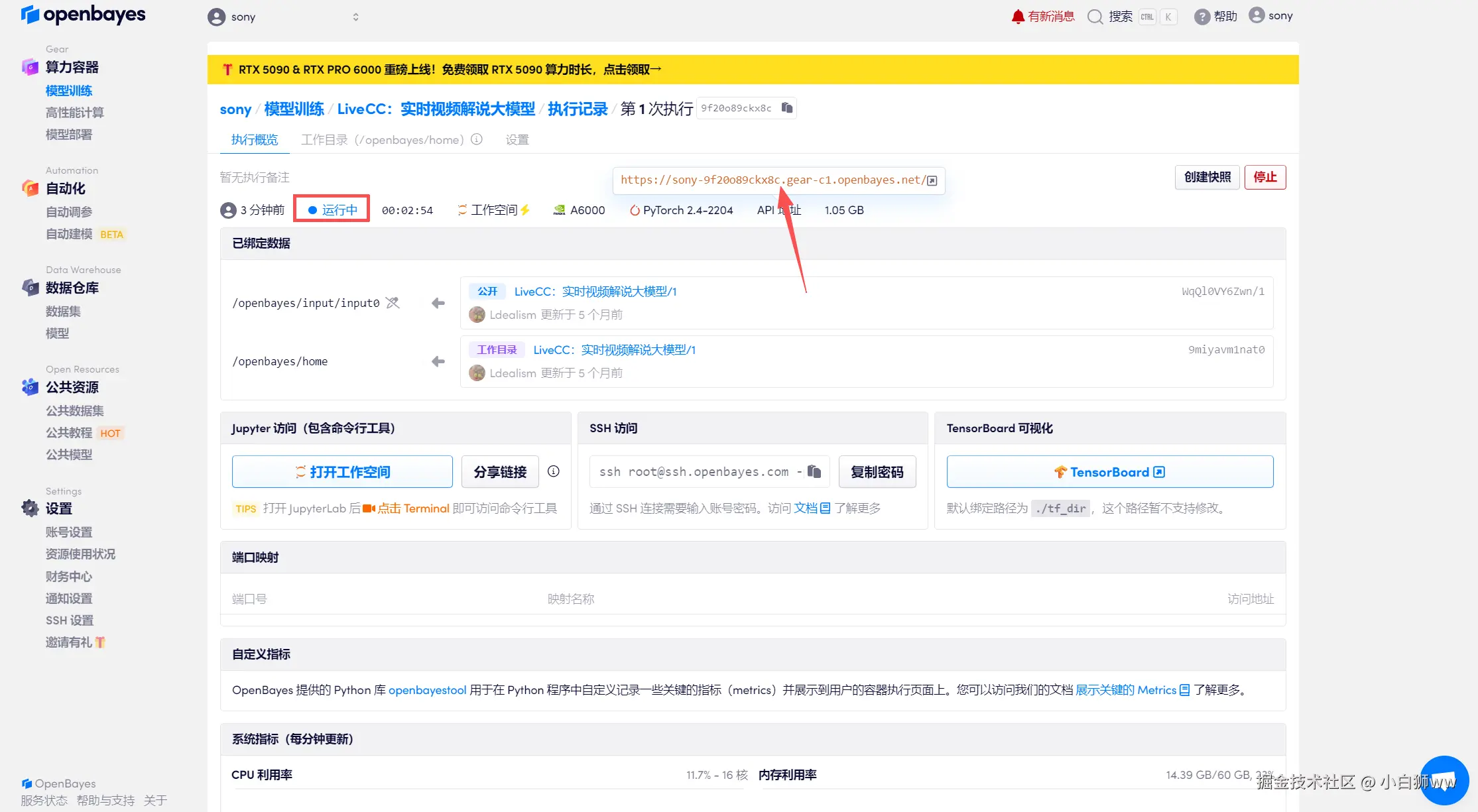

待系统分配好资源,当状态变为「运行中」后,点击「API 地址」边上的跳转箭头,即可跳转至 Demo 页面。

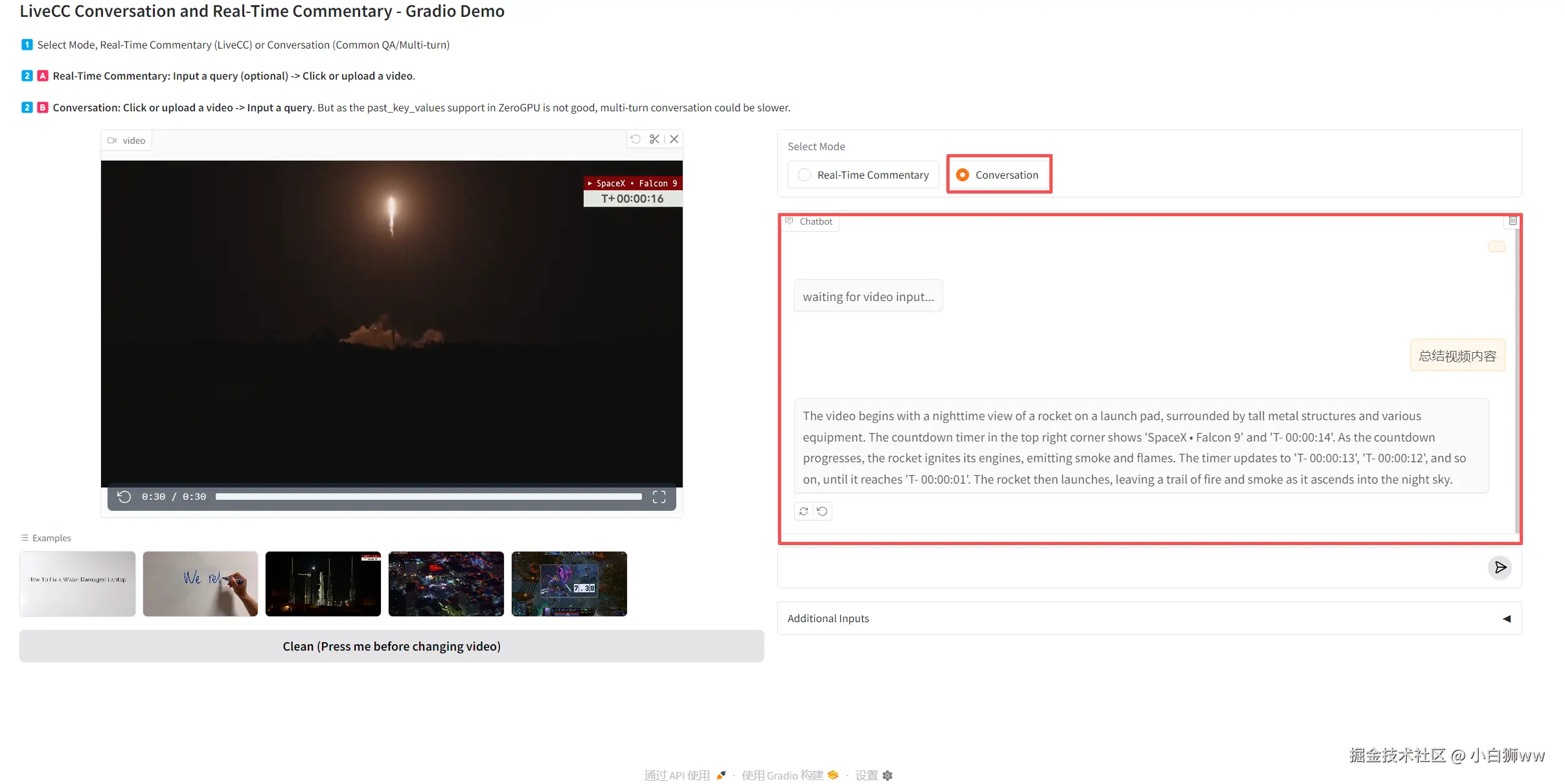

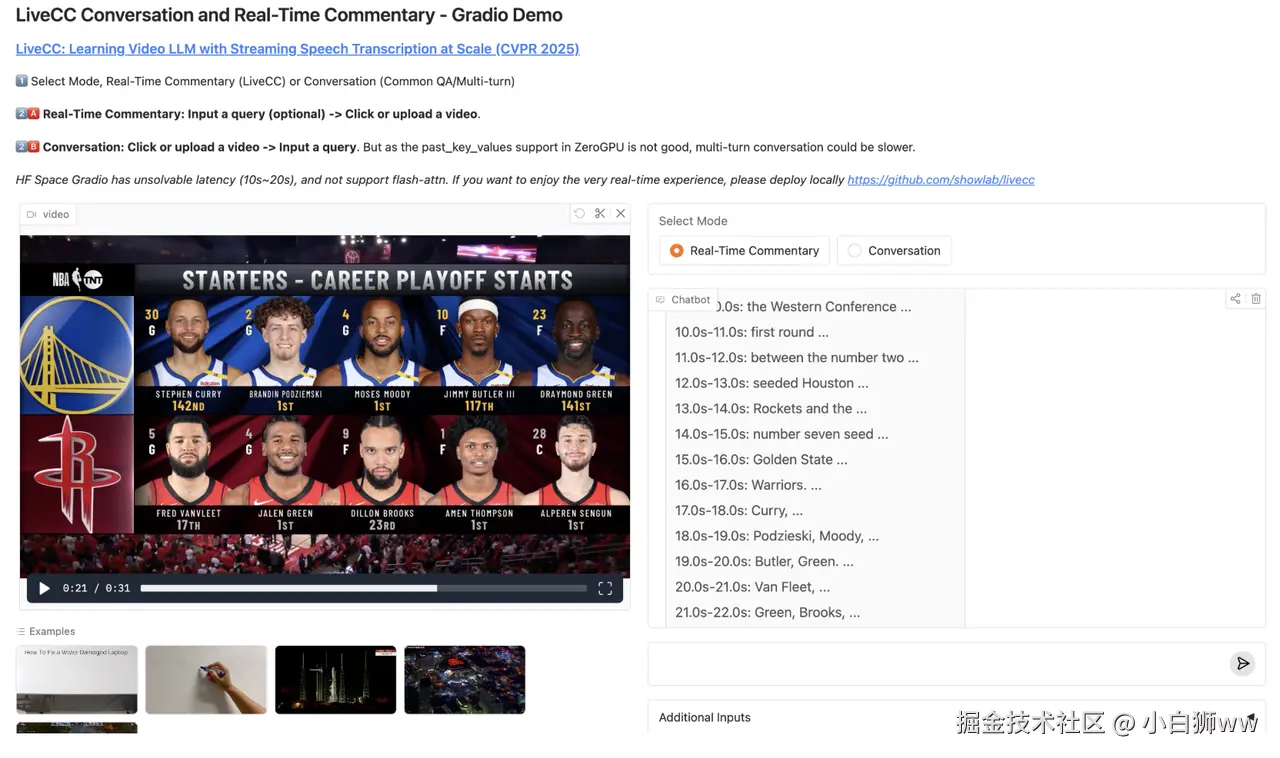

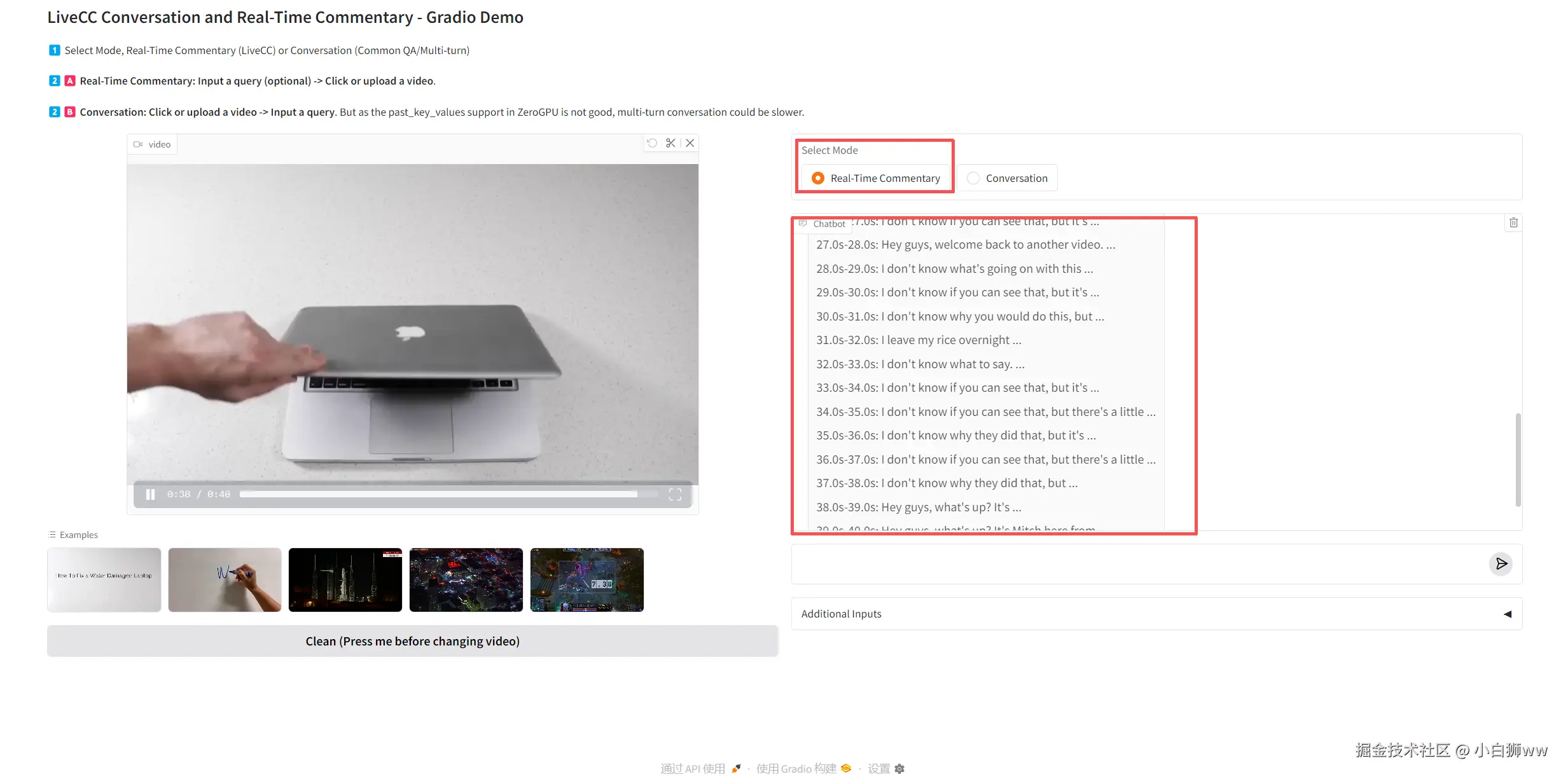

本教程提供两种模块测试: Real-Time Commentary 和 Conversation 模块。

Real-Time Commentary

进入 Demo 页面后,首先上传一段视频,选择「Real-Time Commentary(实时字幕)」,按下回车开始运行。

Conversation

上传一段视频,输入好关键词,然后按下回车开始运行。