Q1:机器学习、深度学习、大模型 是什么关系? 他们之间的层次关系,需要前置概念。如何学习这些内容呢?

非常好的问题,这其实是人工智能(AI)知识体系的核心结构 问题。

我们来一步步建立清晰的层次图、逻辑关系和学习路线

一、总体层次结构(由大到小)

bash

人工智能(AI)

├── 机器学习(Machine Learning, ML)

│ ├── 深度学习(Deep Learning, DL)

│ │ └── 大模型(Large Models, LLM, Foundation Models)1. 人工智能(AI)

AI 是最广义的概念。

目标: 让机器"像人一样"思考、学习、推理、决策。

例子:

-

早期规则系统(专家系统、决策树)

-

下棋的 AlphaGo

-

ChatGPT、文生图、自动驾驶等

AI 是整个领域的总称,下面的"机器学习"是它最重要的分支。

2. 机器学习(Machine Learning, ML)

ML 是"让机器自己学"的方法。

核心思想:

机器不是靠人工写规则,而是从数据中自动学习规律。

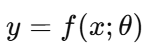

公式化理解:

机器学习 ≈ 用算法让计算机从数据中"拟合出函数"

算法通过训练找到最合适的参数 θ。

常见类型:

-

监督学习(Supervised Learning)

有标签数据,训练分类或回归模型

例:房价预测、图片分类、语音识别 -

无监督学习(Unsupervised Learning)

无标签数据,发现结构

例:聚类、降维、异常检测 -

强化学习(Reinforcement Learning)

通过奖励与惩罚学习策略

例:AlphaGo、游戏AI、自动驾驶

- 深度学习(Deep Learning, DL)

深度学习是机器学习的一种特殊方法。

核心特征:

使用 多层神经网络(Deep Neural Networks, DNN) 自动提取特征。

区别:

-

传统 ML:依赖人工设计特征(feature engineering)

-

深度学习:直接从原始数据(如图片、语音、文本)学习特征层次表示

-

卷积神经网络(CNN)------图像识别

-

循环神经网络(RNN)------序列建模

-

Transformer ------ 现代大模型核心架构

4. 大模型(Large Models / Foundation Models)

大模型是"深度学习的超级进化形态"。

核心思想:

-

使用 海量数据 + 超大模型参数 + 算力

-

形成"通用智能基础",再微调到特定任务

代表:

-

GPT 系列(语言大模型)

-

CLIP、DALL·E(跨模态)

-

Stable Diffusion(文生图)

-

Gemini、Claude、LLaMA、Mistral ...

技术基础:

-

深度学习(尤其是 Transformer 架构)

-

自监督学习(Self-supervised Learning)

-

大规模分布式训练

二、概念的层级关系图

bash

AI(人工智能)

│

├─ 机器学习(ML)

│ ├─ 监督学习 / 无监督学习 / 强化学习

│ │

│ └─ 深度学习(DL)

│ └─ 神经网络(CNN, RNN, Transformer)

│ └─ 大模型(GPT, LLaMA, Diffusion)可以理解为:

大模型 = 一种超大规模的深度学习模型

深度学习 = 机器学习的一种方法

机器学习 = 实现人工智能的关键技术之一

三、学习路线建议(由浅入深)

| 阶段 | 学习内容 | 推荐教材 / 课程 | 实践建议 |

|---|---|---|---|

| 阶段1:数学与编程基础 | 线性代数、概率论、微积分、Python | 《线性代数及其应用》 3Blue1Brown 系列视频 | 用 Numpy 写线性回归 |

| 阶段2:机器学习入门 | 回归、分类、聚类、SVM、决策树 | 吴恩达《Machine Learning》课程(Coursera) | 用 scikit-learn 练习 |

| 阶段3:深度学习基础 | 神经网络、CNN、RNN、优化算法 | 吴恩达《Deep Learning Specialization》 | 用 PyTorch 训练手写数字识别 |

| 阶段4:Transformer 与大模型 | Self-Attention、LLM 原理、Prompt、微调 | Stanford CS324 / Hugging Face 课程 | 尝试微调 LLaMA 或 BERT |

| 阶段5:AI 应用与部署 | NLP、图像、语音、多模态、AI Agent | Fast.ai / Hugging Face Hub | 构建自己的小 AI 应用 |

四、关键学习心法

-

先理解直觉,再看公式:别一开始陷进符号堆里。

-

用代码验证理论:小实验最能加深理解。

-

层层抽象,不求一步到位:每层知识都有自己的世界。

-

保持长期投入:AI 是一个马拉松,不是速成。

Q2:这个是人工智能的技术全部内容吗?

你已经开始从"AI 的分支关系"上往全貌层级 思考了。

我来系统地告诉你:

机器学习 / 深度学习 / 大模型 ------ 只是 人工智能(AI)技术体系中的"学习"方向的一部分 ,

但 AI 的完整内容远远不止这些。

一、人工智能的完整技术版图(全景图)

AI 是一个综合性超级领域,它包含的方向可以分成六大类

bash

人工智能(AI)

│

├─ A. 理论与基础

├─ B. 知识与推理

├─ C. 学习(机器学习 / 深度学习 / 大模型)

├─ D. 感知(计算机视觉、语音识别)

├─ E. 自然语言处理(NLP)

├─ F. 决策与行动(智能控制、强化学习、机器人)

└─ G. 系统与应用(AI 工程化、伦理、安全)下面我们一层层展开

A. 理论与基础(AI 的底层支撑)

这是所有 AI 的"地基"。

| 模块 | 内容 |

|---|---|

| 数学基础 | 线性代数、概率论、最优化理论 |

| 算法与复杂性 | 搜索、图算法、启发式算法 |

| 计算理论 | 可计算性、自动机、逻辑推理 |

| 信息论与统计学 | 熵、互信息、统计推断 |

这些理论支撑了机器学习、推理、规划等所有模块。

B. 知识与推理(Symbolic AI / GOFAI)

这是早期人工智能的主流,也叫 符号主义 AI。

| 模块 | 内容 |

|---|---|

| 知识表示(Knowledge Representation) | 用逻辑、图结构等表示知识 |

| 推理(Reasoning) | 基于规则的逻辑推理、模糊推理 |

| 专家系统(Expert Systems) | 早期 AI 系统,靠"知识库+推理机"实现 |

| 知识图谱(Knowledge Graph) | 将知识表示为"实体-关系-实体"的网络结构 |

代表技术:Prolog、Ontology、本体论、RDF、SPARQL

现在的大模型也在向"符号 + 神经"融合的方向发展(Neuro-symbolic AI)。

C. 学习(Machine Learning / Deep Learning / LLM)

这个是现代 AI 的核心(你之前问的那一层)。

| 模块 | 内容 |

|---|---|

| 传统机器学习 | SVM、决策树、聚类、回归 |

| 深度学习 | 神经网络、CNN、RNN、Transformer |

| 大模型(Foundation Models) | GPT、Gemini、Claude、Diffusion 模型 |

| 强化学习(RL) | Agent 学习策略、奖励机制 |

| 迁移学习 / 自监督 / 元学习 | 让模型"更聪明地学" |

D. 感知(Perception)

让机器"感知世界",是 AI 的感官部分。

| 模块 | 内容 | 代表应用 |

|---|---|---|

| 计算机视觉(CV) | 图像识别、检测、分割、三维重建 | 自动驾驶、监控、医学影像 |

| 语音识别(ASR) | 从声音识别语义 | 智能音箱、语音助手 |

| 语音合成(TTS) | 从文本合成语音 | ChatGPT 语音模式、配音 |

| 多模态学习 | 同时理解图像 + 文本 + 音频 | GPT-4V、Gemini、CLIP |

E. 自然语言处理(NLP)

理解和生成语言,让机器"会说话"。

| 模块 | 内容 | 例子 |

|---|---|---|

| 文本分析 | 分词、命名实体识别、情感分析 | 微博舆情分析 |

| 机器翻译 | 中英互译 | Google 翻译 |

| 问答与对话系统 | Chatbot、搜索问答 | ChatGPT、Siri |

| 大语言模型(LLM) | Transformer-based 自回归模型 | GPT、Claude、Mistral |

F. 决策与行动(Decision & Robotics)

让机器"能自主行动"。

| 模块 | 内容 | 应用 |

|---|---|---|

| 规划(Planning) | 自动生成行动序列 | 路径规划、任务分配 |

| 强化学习(RL) | 通过试错学习策略 | AlphaGo、自动驾驶 |

| 机器人控制 | 感知 + 决策 + 执行 | 工业机器人、服务机器人 |

| 多智能体系统(MAS) | 多个智能体协作 | 群体无人机、智能交通 |

G. 系统与应用(AI 工程化与伦理)

AI 不只是算法,还包括工程实现、部署与治理。

| 模块 | 内容 |

|---|---|

| AI 工程(MLOps / LLMOps) | 模型训练、部署、监控、数据管理 |

| AI 安全与伦理 | 隐私、公平、可解释性、可信度 |

| AI 法规与社会影响 | 监管、版权、社会风险 |

二、AI 技术体系的"知识金字塔"

bash

┌─────────────────────────────┐

│ AI 应用层(机器人 / 助手 / 智能系统) │

├─────────────────────────────┤

│ 决策层(强化学习 / 规划 / 推理) │

├─────────────────────────────┤

│ 感知层(CV / NLP / 语音 / 多模态) │

├─────────────────────────────┤

│ 学习层(ML / DL / LLM) │

├─────────────────────────────┤

│ 理论层(数学 / 逻辑 / 信息论) │

└─────────────────────────────┘三、总结一句话

人工智能 = 理论 + 感知 + 学习 + 推理 + 决策 + 行动 + 工程化。

机器学习、深度学习、大模型只是 AI 的"学习核心"部分,

但真正的 AI 还包括推理、规划、知识、感知、行动与伦理治理。

Q3: 人工智能 是计算机专业 还是数据科学专业呢?

这其实是很多人刚接触 AI 时都会困惑的一个核心点------

人工智能到底属于计算机科学(Computer Science)还是数据科学(Data Science)?

答案是:

人工智能(AI)起源于计算机科学,是它的一个分支;

但在现代发展中,它又与 数据科学、数学、统计学 深度交叉,

所以可以说------

AI 是计算机科学与数据科学的融合领域。

下面我帮你完整地梳理清楚 :

一、从学科体系看:AI 的"出生地"是计算机科学

AI 最早的学术归属是:

Computer Science → Artificial Intelligence

在大学或研究机构的课程体系中,一般是:

bash

计算机科学(Computer Science)

├─ 软件工程

├─ 操作系统

├─ 计算机网络

├─ 数据结构与算法

├─ 数据库

├─ 人工智能(AI)

│ ├─ 机器学习

│ ├─ 深度学习

│ ├─ 自然语言处理

│ ├─ 计算机视觉

│ └─ 强化学习解释:

AI 的目标是让机器"具备智能",而智能的实现离不开:

-

算法(算法设计)

-

程序实现(Python、C++ 等)

-

系统运行(算力、GPU、操作系统)

-

数据结构(模型存储、图结构)

这些都是计算机科学的核心内容。

所以从根本上说:

人工智能 = 计算机科学的高阶应用方向。

二、从应用角度看:AI 又是数据科学的"核心引擎"

数据科学(Data Science)则更偏向于:

"如何从数据中提取知识与价值"。

bash

数据科学(Data Science)

├─ 数据收集与清洗

├─ 数据可视化

├─ 统计建模与假设检验

├─ 机器学习(ML)

│ ├─ 监督学习

│ ├─ 无监督学习

│ ├─ 强化学习

│ └─ 深度学习(DL)

├─ 大数据处理(Spark, Hadoop)

└─ 商业智能(BI)可以看到:

-

数据科学用 AI 技术(特别是机器学习) 来分析数据。

-

AI 则需要 数据科学方法 来训练模型。

所以:

AI 是数据科学的工具核心;

数据科学是 AI 的应用土壤。

三、两者的核心差异对比表

| 维度 | 计算机科学(CS) | 数据科学(DS) | 人工智能(AI) |

|---|---|---|---|

| 学科定位 | 工程技术 | 应用与分析 | 智能技术 |

| 关注焦点 | 算法、系统、编程 | 数据、统计、洞察 | 模型、学习、决策 |

| 基础学科 | 数学 + 编程 + 系统 | 统计学 + 编程 + 商业 | 数学 + 算法 + 数据 |

| 代表技能 | 数据结构、算法设计、软件架构 | Pandas、SQL、统计分析 | TensorFlow、PyTorch、Transformer |

| 主要目标 | 构建高效系统 | 提取数据价值 | 模拟人类智能 |

| 典型岗位 | 软件工程师、算法工程师 | 数据分析师、数据科学家 | AI 工程师、机器学习工程师 |

四、三者的关系图(核心理解)

bash

┌──────────────────────────────┐

│ 人工智能 (AI) │

│ ┌────────────────────────┐ │

│ │ 机器学习 (ML) │ │

│ │ ┌──────────────────┐ │ │

│ │ │ 深度学习 (DL) │ │ │

│ │ └──────────────────┘ │ │

│ └────────────────────────┘ │

└──────────────────────────────┘

▲

│ 使用算法和模型处理数据

│

┌───────────────────────────────┐

│ 数据科学 (Data Science) │

└───────────────────────────────┘

AI ←→ DS 之间以 "数据 + 算法" 为桥梁,

两者都属于计算机科学的广义范畴。五、在大学中的专业关系

在不同国家和学校,AI 可能放在不同专业下:

| 学科名称 | 所属学院 | 特点 |

|---|---|---|

| Artificial Intelligence | 计算机学院 | 偏算法与模型原理 |

| Computer Science (AI Track) | 计算机学院 | 传统计算机+AI 方向 |

| Data Science and AI | 信息学院 / 统计学院 | 偏数据与模型应用 |

| Machine Learning | 工程学院 | 偏研究与理论 |

| Cognitive Science / Robotics | 理工学院 | 偏跨学科(心理、工程) |

所以:

-

如果你喜欢算法、系统、底层架构 → 选 计算机科学方向的 AI;

-

如果你喜欢分析、统计、数据洞察 → 选 数据科学方向的 AI。

六、总结一句话

人工智能是计算机科学的一个重要分支,

同时又是数据科学最核心的技术引擎。

它站在两者交叉点上:

bash

计算机科学 → 提供算法与系统能力

数据科学 → 提供数据与应用场景

人工智能 → 融合两者,实现"智能化"Q4:计算机专业使用人工智能解决问题的目标?

这正是理解"计算机科学为什么需要人工智能"的关键。

我们可以一句话总结:

计算机专业使用人工智能的目标,是让计算机从"被动执行"转变为"主动理解与决策",从而自动、高效、智能地解决现实世界中的复杂问题。

一、计算机的两种时代思维

| 时代 | 特征 | 计算机角色 | 限制 |

|---|---|---|---|

| 传统计算机时代(规则驱动) | 程序员写清所有规则 | 被动执行者 | 只能做"确定的事" |

| 人工智能时代(学习驱动) | 机器从数据中学习规律 | 主动学习者 | 可应对"不确定问题" |

例子:

-

传统计算机 :

"如果温度 > 30℃,打开空调"

→ 完全靠人工规则。

-

AI 计算机 :

从历史气象 + 用户行为中学习"何时开空调更舒适、更省电"。

→ 自主判断与优化。

目标:让计算机能"理解""学习""推理""决策"。

二、计算机专业使用人工智能的根本目标

1. 让机器具备智能行为能力

AI 的核心目标是让机器能像人一样去:

-

感知(看、听、读)

-

理解(理解场景、语义、意图)

-

推理(根据知识作出判断)

-

决策(选择最优行动)

-

学习(从经验中提升自己)

对计算机专业来说,这意味着:

不只是写出程序,而是让程序会"思考"。

2. 解决传统算法无法应对的复杂问题

传统算法依赖"明确的逻辑规则",但现实世界充满不确定性:

-

自然语言是模糊的

-

图像是连续的

-

环境是动态变化的

这些问题 无法写出固定公式解决 。

而 AI 通过机器学习与深度学习,可以从数据中自动建模,捕捉复杂模式。

举例:

| 传统算法无能为力的问题 | AI 解决方式 |

|---|---|

| 识别人脸 | CNN(卷积神经网络) |

| 理解语言语义 | Transformer(BERT, GPT) |

| 自动驾驶 | 感知 + 强化学习 |

| 智能推荐 | 协同过滤 + 深度学习 |

3. 提升软件系统的自适应性与智能化水平

在计算机系统中引入 AI,可让系统:

-

自动学习用户偏好(个性化)

-

动态优化性能(智能调度)

-

自主检测异常(智能安全)

-

自动生成内容或代码(AIGC)

比如:

-

智能 IDE(代码补全、Bug 预测)

-

智能运维系统(自动检测瓶颈)

-

智能搜索引擎(理解意图)

这些都让"系统自己变聪明"。

4. 推动跨领域计算机应用

AI 已成为几乎所有计算机子领域的加速器:

| 计算机分支 | AI 应用方向 |

|---|---|

| 计算机视觉 | 图像识别、医学影像、自动驾驶 |

| 自然语言处理 | 翻译、聊天机器人、搜索引擎 |

| 网络与安全 | 攻击检测、异常识别、流量预测 |

| 数据库 | 智能查询优化、自适应索引 |

| 软件工程 | AI 辅助编码、代码生成、缺陷检测 |

| 人机交互 | 语音助手、智能界面、脑机接口 |

AI 让传统计算机科学的每个分支都"升级成智能版"。

5. 最终目标:通用人工智能(AGI)

从计算机专业的角度看,AI 的终极目标是:

让计算机像人一样,能在不同领域灵活地理解、学习和创造。

-

GPT-5、Gemini、Claude 等大模型正是朝 AGI 方向的实践。

-

它们是"能自我学习与适应"的计算机系统雏形。

三、从"工程目标"角度总结

| 层次 | AI 在计算机中的目标 | 举例 |

|---|---|---|

| 感知层 | 让计算机能看、听、读 | 图像识别、语音识别 |

| 理解层 | 让计算机能理解世界 | NLP、知识图谱 |

| 决策层 | 让计算机能做出判断与选择 | 智能推荐、自动驾驶 |

| 创造层 | 让计算机能创造内容 | AIGC、ChatGPT |

| 系统层 | 让软件和硬件系统自我优化 | 智能运维、自动化调度 |

四、总结一句话

💡 计算机专业使用人工智能的目标是:

通过算法和数据,使计算机具备感知、理解、学习与决策能力,

以智能化的方式高效解决传统计算无法处理的复杂现实问题。

换句话说:

从"会算" → "会想" → "会学" → "会创造"。

Q5: 距离这个目标还有多远?有哪些待突破的难点?

你问到了"人工智能在计算机专业中的终极目标实现还差多远?"这个问题,其实就是:

🎯 离通用人工智能(AGI, Artificial General Intelligence)还有多远?

目前有哪些关键技术瓶颈?

我来系统地帮你梳理清楚,从现实到理想,一步步看清AI的"进展---瓶颈---方向"

一、我们已经实现了什么?(AI 的现阶段能力)

当前的 AI(特别是大模型)已经在很多方面接近"狭义智能(Narrow AI)"的极限。

| 领域 | AI 能做到的事情 | 技术代表 |

|---|---|---|

| 语言理解与生成 | 写文章、编程、对话、总结、翻译 | GPT、Claude、Gemini |

| 图像与视频 | 识别、生成、理解、编辑 | Stable Diffusion、Sora |

| 语音 | 识别语音、生成语音、情感语调 | Whisper、VALL-E |

| 推理与决策 | 逻辑问答、数理推理(部分) | GPT-4、DeepSeek-R1 |

| 自动化控制 | 自动驾驶、机器人抓取 | Tesla FSD、Boston Dynamics |

| 智能助理 | 自动化办公、代码生成 | Copilot、ChatGPT、Cursor |

💡可以说:

AI 在"单任务"上表现出超人级能力,

但在"多任务理解与长期推理"上仍有巨大差距。

我们现在的 AI 是:

非常聪明的工具(Narrow AI) ,

还不是真正懂世界的智能体(General AI)。

二、理想目标(通用人工智能 AGI)是什么?

AGI 的定义:

能像人类一样,跨领域理解、学习、迁移、创造、决策的智能系统。

理想能力包括:

-

🧩 多模态理解(听说读写看)

-

🧩 跨任务迁移(举一反三)

-

🧩 逻辑与常识推理(像人一样理解因果)

-

🧩 持续学习(不断积累知识)

-

🧩 自我反思与规划(有目标与长期计划)

-

🧩 道德与价值判断(理解"为什么做")

目前这些能力只有局部萌芽,远未整合在同一个系统中。

三、AI 离这个目标还有多远?

专家共识是:

从技术可行性角度看,AGI 已进入可见的早期阶段,但离真正"通用智能"至少还需 10--30 年。

我们现在处于:

狭义智能(Narrow AI) → 通用智能过渡期(Proto-AGI)

当前阶段的特点:

| 阶段 | 能力 | 代表 |

|---|---|---|

| Narrow AI(专用智能) | 解决单一任务 | AlphaGo、ChatGPT、Stable Diffusion |

| Proto-AGI(原型通用智能) | 具备多模态、上下文记忆、工具使用 | GPT-4、Gemini 2、Claude 3 |

| AGI(通用智能) | 跨任务自适应学习、持续进化 | 尚未实现 |

四、目前的关键瓶颈与待突破难点

| 维度 | 现状 | 待突破的难点 |

|---|---|---|

| 1. 理解与推理能力 | 大模型能模仿逻辑,但缺乏真正理解 | 缺乏常识、因果、物理世界模型(World Model) |

| 2. 记忆与长期学习 | 模型一次性训练后"固定",无法真正"持续学习" | 需要动态更新参数而不遗忘旧知识(Catastrophic Forgetting) |

| 3. 数据依赖 | 模型靠海量数据堆叠智能 | 缺乏"少样本学习"与"自我学习"机制 |

| 4. 可解释性 | 模型内部像"黑箱" | 需要可解释AI(XAI)与因果建模 |

| 5. 推理与规划 | 无法像人那样制定长期计划 | 需要符号推理 + 神经网络融合(Neuro-symbolic AI) |

| 6. 物理交互与现实感知 | 模型缺乏真实世界反馈 | 需要与机器人结合形成"具身智能(Embodied AI)" |

| 7. 能耗与效率 | 模型训练消耗巨大(数千张GPU) | 需要更高效算法与硬件(量子AI、类脑芯片) |

| 8. 价值与伦理问题 | 难以判断"什么是正确的" | 需要 AI Alignment(对齐)与安全机制 |

五、技术突破方向(未来十年关键路线)

| 路线 | 核心目标 | 关键技术 |

|---|---|---|

| 1️⃣ 神经网络 + 符号推理结合 | 理性 + 感性融合 | Neuro-symbolic AI |

| 2️⃣ 持续学习(Continual Learning) | 不遗忘旧知识地学习新知识 | Elastic Weight Consolidation, Replay Memory |

| 3️⃣ 世界模型(World Model) | 构建环境理解与因果推理能力 | 物理仿真、因果图学习 |

| 4️⃣ 具身智能(Embodied AI) | AI 与物理世界交互 | 机器人、视觉-动作融合 |

| 5️⃣ 多智能体系统(Multi-Agent AI) | 多个AI协作 | Agent Society, Collective Intelligence |

| 6️⃣ AI 对齐(AI Alignment) | 保证目标与人类价值一致 | 价值学习、RLHF、安全评估 |

| 7️⃣ 高效算力与算法优化 | 降低能耗、加速训练 | 稀疏模型、量子计算、边缘AI |

六、整体进展展望(时间线预测)

| 阶段 | 时间 | 代表性成果 | 状态 |

|---|---|---|---|

| Narrow AI | 2010--2024 | 深度学习革命、GPT、Stable Diffusion | ✅ 已成熟 |

| Proto-AGI | 2025--2035 | 多模态+记忆+推理+工具使用 | 🔄 正在进行 |

| AGI(通用智能) | 2035--2050 | 可跨领域自主学习的智能体 | 🔜 远期目标 |

| ASI(超人工智能) | 2050+ | 超越人类认知的智能 | 🧩 未知、伦理阶段 |

七、总结一句话

目前的人工智能在"理解、记忆、推理、对齐"上仍不具备人类式的通用智能。

但在感知、生成、语言、控制等"狭义智能"方面已达或超越人类。

我们正处在从"工具智能"向"通用智能"的过渡期。

换句话说:

现在的 AI 很聪明,但还不会真正"懂"世界 。

离"像人一样思考"的目标,还有 一个世界模型 + 长期学习 + 对齐机制 的距离。