目录

- 前言

- [一、调用 AI 的 LLM / Vision / Embedding 生成文本或 UI 组件](#一、调用 AI 的 LLM / Vision / Embedding 生成文本或 UI 组件)

-

- [1、前端调用 LLM(生成文本)](#1、前端调用 LLM(生成文本))

- [2、前端调用 Vision 模型(图像生成 / 分析)](#2、前端调用 Vision 模型(图像生成 / 分析))

- [3、前端调用 Embedding(向量化 / 相似度搜索)](#3、前端调用 Embedding(向量化 / 相似度搜索))

- [4、结合 LLM + Vision + Embedding 的前端 UI 示例](#4、结合 LLM + Vision + Embedding 的前端 UI 示例)

- 5、技术选型建议(前端友好)

- 6、安全与实用注意事项

- [二、前端用 AI-Agent 开发项目](#二、前端用 AI-Agent 开发项目)

-

- [0、 AI-Agent 体系结构](#0、 AI-Agent 体系结构)

- [1、前端开发者该如何"拥抱 Agent 思维"](#1、前端开发者该如何“拥抱 Agent 思维”)

-

- [(1)、从"写功能"转向"定义能力 + 让 AI 运行"](#(1)、从“写功能”转向“定义能力 + 让 AI 运行”)

- [(2)、从"以 UI 为中心"转向"以任务为中心"](#(2)、从“以 UI 为中心”转向“以任务为中心”)

- [(3)、从"用户输入 → 界面交互"变成 "用户意图 → AI action chain"](#(3)、从“用户输入 → 界面交互”变成 “用户意图 → AI action chain”)

- [2、Vue / React 程序员最该学的 AI-Agent 技术栈(分三个层级)](#2、Vue / React 程序员最该学的 AI-Agent 技术栈(分三个层级))

-

- [(1)、在前端项目里集成 AI(马上可以做)](#(1)、在前端项目里集成 AI(马上可以做))

-

- [①、React / Vue 直接接 OpenAI Realtime API](#①、React / Vue 直接接 OpenAI Realtime API)

- ②、在前端自动化你的工作流(你会爱上这个)

- [(2)、在后端实现代理(Agent Framework 实战)](#(2)、在后端实现代理(Agent Framework 实战))

-

- [①、OpenAI Agent + Function Calling(最简单)](#①、OpenAI Agent + Function Calling(最简单))

- [②、LangChainJS / LangGraph(项目大可以考虑)](#②、LangChainJS / LangGraph(项目大可以考虑))

- [③、Vercel AI SDK(前端最友好)](#③、Vercel AI SDK(前端最友好))

- [(3)、让你的前端 App "被 AI-Agent 控制"(下一代应用形态)](#(3)、让你的前端 App “被 AI-Agent 控制”(下一代应用形态))

-

- [①、AI 自动操作你的前端 UI(RPA)](#①、AI 自动操作你的前端 UI(RPA))

- [②、AI 直接生成 Vue / React 页面(可写可运行)](#②、AI 直接生成 Vue / React 页面(可写可运行))

- [③、AI 调用你的前端组件作为"工具"](#③、AI 调用你的前端组件作为“工具”)

- [3、前端 → Agent 的晋升级别路线图(做任务)](#3、前端 → Agent 的晋升级别路线图(做任务))

-

- [(1)、AI 嵌入你的前端](#(1)、AI 嵌入你的前端)

- [(2)、做一个你的第一个 Agent(Node + OpenAI)](#(2)、做一个你的第一个 Agent(Node + OpenAI))

- [(3)、构建真实 AI 产品(多 Agent 协作)](#(3)、构建真实 AI 产品(多 Agent 协作))

- [三、构建 AI-native 应用(生态层)](#三、构建 AI-native 应用(生态层))

- 四、拓展

-

- [1、AI-Agent 与 Agent 只是叫法不同吗?](#1、AI-Agent 与 Agent 只是叫法不同吗?)

-

- [(1)、传统 Agent 是理论模型](#(1)、传统 Agent 是理论模型)

- [(2)、AI-Agent 是 LLM 驱动的"新物种"(重点)](#(2)、AI-Agent 是 LLM 驱动的“新物种”(重点))

-

- ①、能自主规划

- [②、能调用工具(Tool Calling)](#②、能调用工具(Tool Calling))

- ③、能执行循环动作(Autonomous)

- [(3)、AI-Agent 与 Agent 差异总结](#(3)、AI-Agent 与 Agent 差异总结)

- [(4)、为什么现在大家都说 Agent,但其实指的是 AI-Agent?](#(4)、为什么现在大家都说 Agent,但其实指的是 AI-Agent?)

- [(5)、你实际需要学的 AI-Agent 能力](#(5)、你实际需要学的 AI-Agent 能力)

前言

在人工智能领域,Agent 到底扮演着什么角色?

我们可以把这个世界抽象成 能力 → 执行 → 系统 → 生态 四层:

| 层级 | 核心能力 | 特点 | 举例 |

|---|---|---|---|

| AI(模型层) | 推理、语言理解、生成 | 只能"说",不会主动执行 | ChatGPT、Claude |

| Agent(行动层) | 调用工具、执行多步任务 | 会自动完成一个任务链 | LangChain Agent、AutoGPT |

| Multi-Agent System / Orchestrator(协作层) | 多 Agent 协作、任务分发、资源调度 | 像"公司调度中心",管理多 Agent,实现复杂目标 | AutoGPT + Worker 集群、LangGraph |

| Autonomous System / AI-native 应用(生态层) | 人类最小化干预,自动化业务系统 | 整个系统能自动运营、自动优化、自动进化 | AI 驱动的自动化 SaaS、AI DevOps 平台、智能金融投研系统 |

用类比理解:

- AI = 大脑

- Agent = 雇员(会思考、能行动)

- Multi-Agent System = 公司(协调多个雇员完成复杂项目)

- Autonomous System = 企业生态(公司自己找业务、优化流程、持续迭代)

"人工智能+前端工程师" 的进阶路径:

- AI:会调用 LLM / Vision / Embedding,生成文本或 UI 组件

- Agent:能把 AI 生成的东西变成实际操作 → 自动执行任务

- Multi-Agent / Orchestrator:管理多个 Agent,实现复杂任务闭环

- Autonomous App / System:前端 + Agent + 后端 + 工具链一体,用户只看结果

- 自动生成报表

- 自动运营 SaaS

- 自动化 DevOps / CI/CD

- 自动生成前端页面 / 数据可视化

前端工程师不需要深入研究 Multi-Agent System 的理论或复杂的编排系统。

但需要理解"如何使用现有 Agent 框架"来构建 AI 增强型 UI / 工具 / 产品。

你要学的不是"造 Agent 系统",而是"调用并使用它们"。

学习重点应该是:

| 主题 | 是否需要掌握 | 解释 |

|---|---|---|

| 如何调用 LLM/Embedding/Images API | ✅ 必须 | 前端必须掌握,最基础的能力 |

| 如何构建前端 + AI 的交互流程 | ✅ 必须 | 例如智能表单、自动 UI 生成、自定义聊天 |

| 如何使用现成的 Agent 框架(OpenAI Swarm、LangGraph Lite、ReAct) | ⭐ 推荐 | 了解即可,不需要深入实现,不需要懂过多理论 |

| 自己实现 Orchestrator / 核心调度系统 | ❌ 不需要 | 这属于后端 + AI Infra 的工作 |

| 深入 Multi-Agent System 理论(博弈论、协作/竞争智能体模型) | ❌ 完全不需要 | 这是学术方向,不是前端需要的 |

一、调用 AI 的 LLM / Vision / Embedding 生成文本或 UI 组件

1、前端调用 LLM(生成文本)

LLM = Large Language Model,例如 OpenAI GPT 系列、Claude、Mistral 等。

用途:

- 文本生成(文章、报告、提示语)

- 代码生成(Vue/React 组件)

- JSON / schema 生成(表格列、表单 schema)

- 自动补全

示例:React + OpenAI GPT-4

cpp

// 安装依赖

// npm install openai

import { OpenAI } from "openai";

const client = new OpenAI({

apiKey: process.env.OPENAI_API_KEY

});

async function generateText(prompt: string) {

const response = await client.chat.completions.create({

model: "gpt-4",

messages: [{ role: "user", content: prompt }],

temperature: 0.7

});

return response.choices[0].message?.content;

}

// 使用示例

const text = await generateText("帮我写一个 Vue 3 + Naive UI 的用户表格组件示例");

console.log(text);Vue 使用:

cpp

<template>

<div>{{ generatedText }}</div>

</template>

<script setup lang="ts">

import { ref } from "vue";

import { OpenAI } from "openai";

const generatedText = ref("加载中...");

const client = new OpenAI({ apiKey: import.meta.env.VITE_OPENAI_KEY });

async function generateText() {

const res = await client.chat.completions.create({

model: "gpt-4",

messages: [{ role: "user", content: "生成一个 Naive UI 用户表格组件" }]

});

generatedText.value = res.choices[0].message?.content || "生成失败";

}

generateText();

</script>2、前端调用 Vision 模型(图像生成 / 分析)

Vision 模型 = DALL·E / MidJourney / OpenAI 图片生成 / HuggingFace 视觉模型

用途:

- 生成 UI mockup

- 生成图标 / 插图

- 识别图像内容

- OCR 或图像标注

示例:生成图像

cpp

const response = await client.images.generate({

model: "gpt-image-1",

prompt: "生成一个现代风格的仪表盘 UI mockup",

size: "1024x1024"

});

const imageUrl = response.data[0].url;展示在前端:

cpp

<template>

<img :src="imageUrl" alt="AI 生成 UI" />

</template>

<script setup lang="ts">

import { ref } from "vue";

import { OpenAI } from "openai";

const imageUrl = ref("");

const client = new OpenAI({ apiKey: import.meta.env.VITE_OPENAI_KEY });

async function generateImage() {

const res = await client.images.generate({

model: "gpt-image-1",

prompt: "生成一个现代风格的仪表盘 UI mockup",

size: "1024x1024"

});

imageUrl.value = res.data[0].url;

}

generateImage();

</script>3、前端调用 Embedding(向量化 / 相似度搜索)

Embedding = 将文本、图像、代码转成向量,方便相似度搜索或检索增强。

用途:

- 文档检索(RAG, Retrieval-Augmented Generation)

- 代码片段搜索

- 个性化推荐

- 内容聚类

示例:文本嵌入

cpp

const embeddingRes = await client.embeddings.create({

model: "text-embedding-3-small",

input: "生成 Vue 3 用户表格组件的示例"

});

const vector = embeddingRes.data[0].embedding; // 数值向量实战:

- 将 vector 存入向量数据库(Pinecone / Weaviate / Milvus)

- 用户输入 query → embedding → 相似度匹配 → 获取对应代码或文档

- 可用在前端:比如在 IDE 或后台管理系统里做智能搜索

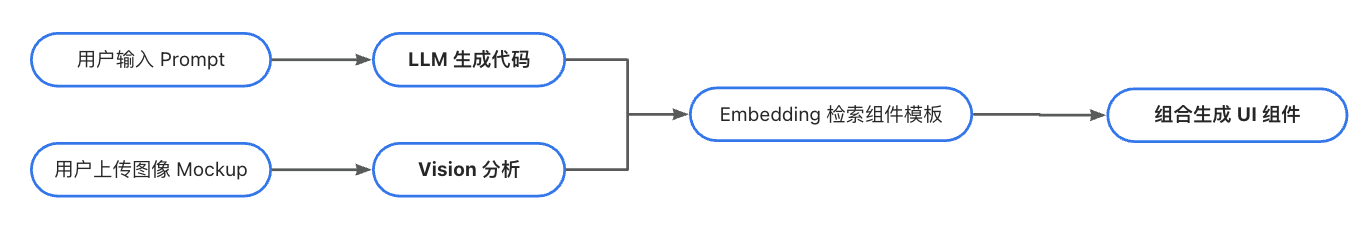

4、结合 LLM + Vision + Embedding 的前端 UI 示例

假设我们要实现一个 "AI 自动生成可运行 Vue/React 组件"的系统":

- 用户输入 prompt(文本) → LLM 生成组件代码

- 用户上传图像 mockup → Vision 识别颜色/布局 → 生成对应组件样式

- Embedding 用于组件库检索 → 找到最相似的组件模板

- 最终生成一个可直接在项目中运行的 Vue/React 组件

数据流示意:

5、技术选型建议(前端友好)

| 模型类型 | API / SDK | 适合前端场景 |

|---|---|---|

| LLM | OpenAI Chat Completions / Replit / Claude | 文本生成、代码生成、表单/表格 schema |

| Vision | OpenAI Image API / Stability AI / Replicate | UI mockup、图标、图片生成、分析 |

| Embedding | OpenAI Embeddings / Cohere / HuggingFace | 文档检索、组件检索、相似度搜索 |

6、安全与实用注意事项

- API Key 不要直接暴露在前端

- 前端调用可以通过你自己的 Node/Next.js / Vite Server 中转

- 流式输出更好体验

- LLM chatCompletion + streaming → 实时显示生成文本

- 生成组件要可验证

- 可以在沙箱中运行(如 vue-sfc-rollup 或 react-live)

- Vision 模型要控制尺寸

- 避免前端直接加载大图生成

二、前端用 AI-Agent 开发项目

现代语境里: "Agent"几乎默认为"AI-Agent(基于 LLM 的智能体)"。但严格讲,两者是不同概念。

⭐ 你需要理解的"AI-Agent 思维模型"。

把 AI-Agent 想象成:

- 可以被调用的函数,但这个函数是 AI 驱动的,并且能自己完成任务。

前端开发者要学的就是:

- 如何向 Agent 发指令(prompt 设计)

- 如何让前端 UI 与 Agent 交互(消息流)

- 如何解析 Agent 生成的 JSON / UI 配置

- 如何在前端执行 Agent 的工具调用(Tool Calling)

你 不需要 实现 Agent 的协作控制机制,比如:

- 多 agent 并发协调

- DAG graph 调度

- memory replay

- semantic routing

这些都有现成框架帮你做。

0、 AI-Agent 体系结构

cpp

┌──────────────────────────────────────────────┐

│ 🧠 LLM / Foundation Model │

│ (GPT-5, Claude, Gemini, Llama, Qwen...) │

└──────────────────────────────────────────────┘

▲

│自然语言推理 / 规划 / 思考

▼

┌──────────────────────────────────────────────┐

│ 🤖 AI-Agent Core │

│ - 思考(Reasoning) │

│ - 规划(Planning) │

│ - 记忆(Memory) │

│ - 决策(Action Selection) │

│ - 工具选择(Tool Routing) │

└──────────────────────────────────────────────┘

▲

│调用工具 / 获取上下文

▼

┌──────────────────────────────────────────────┐

│ 🔧 Tools / Actions │

│ (由前端、后端、第三方提供的能力模块) │

│ - fetchAPI() │

│ - queryDB() │

│ - readFile() │

│ - writeFile() │

│ - generateUI(schema) │

│ - callModel(embedding/vision) │

│ - browserOps(click, fillForm, navigate) │

└──────────────────────────────────────────────┘

▲

│返回工具执行结果

▼

┌──────────────────────────────────────────────┐

│ 🧩 Orchestrator / Agent Runtime │

│(LangGraph, OpenAI Swarm, ReAct, Dify, LobeChat)│

│ - 状态机(State) │

│ - 步骤控制(Steps) │

│ - 多Agent协作(Multi-Agent) │

│ - 循环/条件执行(Loops/If) │

│ - 事件/订阅(Event Stream) │

└──────────────────────────────────────────────┘

▲

│交互协议(JSON / Streaming)

▼

┌──────────────────────────────────────────────┐

│ 🎨 Frontend (Vue / React) │

│ - 注册前端工具:JS 函数变为 Agent 的 Action │

│ - 渲染 AI 生成的 UI(Schema → Component) │

│ - 显示 Agent 状态(执行中 / 规划中 / 等待工具) │

│ - 多 Agent 的可视化 Workflow │

│ - 与 Orchestrator 进行双向流通信 │

└──────────────────────────────────────────────┘

▲

│用户意图(自然语言)

▼

┌──────────────────────────────────────────────┐

│ 🧑💻 User │

└──────────────────────────────────────────────┘1、前端开发者该如何"拥抱 Agent 思维"

Agent 并不是一个框架,而是一套 自动化 + 调度 + 工具调用 的新范式。

你需要掌握的核心思维转变如下三点。

(1)、从"写功能"转向"定义能力 + 让 AI 运行"

传统前端:

- 你写组件、写接口、写逻辑。

Agent开发:

- 你告诉 AI --- 它能访问哪些工具(API)、能操作哪些组件、能执行哪些动作。

- AI 负责自己决策、自己调用。

像:

- 搜索 API

- 数据库 CRUD

- 文件生成器

- UI 操作(RPA)

(2)、从"以 UI 为中心"转向"以任务为中心"

传统前端是界面驱动:

- 人类控制流程

Agent 应用是任务驱动:

- AI 控制流程、人类偶尔给反馈

(3)、从"用户输入 → 界面交互"变成 "用户意图 → AI action chain"

例如用户说:

- "帮我做个上海天气趋势图放到报告里"

在 agent 中会自动转化为:

- 调用天气 API

- 调用图表生成工具

- 调用文档生成器(ppt/pdf/docx)

- 输出文件

你只定义 工具 ,AI 负责 调用顺序。

2、Vue / React 程序员最该学的 AI-Agent 技术栈(分三个层级)

(1)、在前端项目里集成 AI(马上可以做)

①、React / Vue 直接接 OpenAI Realtime API

如果你用 Naive UI、Element Plus、AntD、Tailwind 做项目

你可以快速加入:

- 流式对话输入框

- AI 自动补全

- AI 自动生成表格

- AI 自动生成表单 schema(Naive UI + zod + AI 很配)

示例:

AI 自动生成 NDataTable 的 columns & row schema

(完全契合你现在的技术栈)

②、在前端自动化你的工作流(你会爱上这个)

例如:

- 自动生成 TypeScript 类型(OpenAI JSON schema)

- 自动根据接口文档生成封装好的 API hooks

- 自动生成 React/Vue 页面原型(比 Figma to Code 更好用)

- 自动生成 Naive UI 表格提取配置

- 自动为 React/Pinia/RTK/Query 生成状态逻辑骨架

不需要构建 Agent,但你会开始"AI 工具化"。

(2)、在后端实现代理(Agent Framework 实战)

你需要一个后端来挂"工具"。

最推荐的两个框架:

- OpenAI Agent + Function Calling(最简单)

- LangChainJS / LangGraph(项目大可以考虑)

- Vercel AI SDK(前端最友好)

①、OpenAI Agent + Function Calling(最简单)

适合:

- React + Node

- Vue + NestJS

你将 API 封装为 tools,例如:

cpp

{

name: "getUserOrders",

description: "获取用户订单",

parameters: { type: "object", properties: { userId: { type: "string" } } },

execute: async ({ userId }) => {

return fetch(`/api/orders/${userId}`).then(r => r.json())

}

}然后 Prompt 里告诉 AI:

如果用户问"我的订单?"

就自动调用 getUserOrders

从此 AI 会自动帮你调用你的后端。

非常适合前后端一体的团队。

②、LangChainJS / LangGraph(项目大可以考虑)

适合:

- 多工具调用

- 工作流图(Graph State)

- 多 Agent 协作

- 工具链长达 10+ 步

你可以做:

- 爬虫 Agent

- 富流程表单 Agent(审批流)

- 文档生成 Agent

- 自动化数据分析 Agent

③、Vercel AI SDK(前端最友好)

前后端同构,非常适合 React + Next.js。

你可以做:

- AI 流式聊天

- 多工具 Agent

- Vision Agent(图像内容生成 UI)

- Realtime Agent(语音实时交互)

- 未来 Agent 应用的主流方式。

(3)、让你的前端 App "被 AI-Agent 控制"(下一代应用形态)

这是未来方向,也最能体现前端优势。

示例场景:

①、AI 自动操作你的前端 UI(RPA)

你定义:

- 页面按钮

- 组件 id

- 表单 action

Agent 会自动:

- 点击

- 输入

- 切换 tab

- 提交表单

- 读取列表

你只写 UI → AI 操作 UI → 用户走任务流

这是未来 Agent-native UI。

②、AI 直接生成 Vue / React 页面(可写可运行)

你定义:

- 你项目的组件集(如 Naive UI / AntD / shadcn)

- Routing structure

- Tailwind preset

AI 就可以生成:

- 完整页面

- 状态管理

- Action handler

- API 调用

- 表格/表单

你只需要 review & commit。

③、AI 调用你的前端组件作为"工具"

例如你的 NTable / Charts / FormBuilder 本身就可以作为工具:

- AI 自动帮你渲染数据表格

- AI 自动帮你生成图表

- AI 自动帮你创建 JSON schema form

这是未来"可自描述 UI 指令语言"(DSL)的雏形。

3、前端 → Agent 的晋升级别路线图(做任务)

(1)、AI 嵌入你的前端

- 会用 Streaming(流式输出)

- 会用 Vision API 帮你生成 UI

- 会用 JSON schema 生成类型

- 会用工具自动生成 React/Vue 代码

完成时间:1--3 天

(2)、做一个你的第一个 Agent(Node + OpenAI)

实现:

- tools 注册

- tool 调用链

- memory 机制(上下文)

- 守护逻辑(如校验参数)

- action chain(多步执行)

完成时间:3--7 天

(3)、构建真实 AI 产品(多 Agent 协作)

你可以做:

- 自动报告生成 Agent(财报、KPI、风控)

- 自动 UI 生成 Agent(低代码)

- 自动化运维 Agent(DevOps)

- 自动可视化 Dashboard Agent

- 自动表格清洗 Agent

完成时间:7--30 天

三、构建 AI-native 应用(生态层)

AI-native 应用是什么?

不是把 AI"加到应用里",而是把"应用构建在 AI 之上"。

重点:

- 让 UI 成为可被 AI 控制的"工具"

- 让 AI 主动使用页面组件

- 让人类只提供反馈,而不是点击 UI

典型特征:

- UI 只是"外壳",核心逻辑由 AI 决定

- 应用不是 CRUD,而是自主行动

- 从"页面逻辑"变成"任务 + 目标 + 工具调用"

- AI 拥有记忆(memory)、状态(state)、策略(policy)

前端需要理解这种新模式,因为 UI 将变得更像:

- 可视化 AI 工作流

- 智能表单

- 智能仪表盘

- 动态生成的 UI

- AI 作为编排器(Agent Orchestrator)

这是下一代前端范式。

四、拓展

1、AI-Agent 与 Agent 只是叫法不同吗?

不是只是叫法不同。

AI-Agent 和 Agent 含义相关,但语义范围不同、应用场景不同,也代表两种时代的产物。

所有 AI-Agent 都是 Agent,但不是所有 Agent 都是 AI-Agent。

| 概念 | 如何理解 | 核心差异 |

|---|---|---|

| Agent(传统 Agent) | 一种抽象概念:能自主执行任务的实体(可以是软件、机器人、规则系统) | 概念更大,历史更久,不一定包含 AI |

| AI-Agent(现代 AI 代理) | 基于 LLM 的智能体,具备理解语言、工具调用、自主规划能力 | 专指 LLM 驱动的 Agent,是新时代产物 |

(1)、传统 Agent 是理论模型

比如:

- 游戏 NPC AI(基于规则)

- 决策系统(Rule-based)

- 感知-思考-行动(PEAS)

- 机器人导航模型

这些都叫 Agent,但没有 LLM。

它们更像写死的逻辑,不是真 AI。

(2)、AI-Agent 是 LLM 驱动的"新物种"(重点)

从 2023--2024 开始才真正兴起。

特点:

- 能理解自然语言

用户一句话:"帮我生成一个 Vue3 上传组件",它能完全理解。

①、能自主规划

能把任务拆分并执行多步:

- 分析要求

- 规划结构

- 生成组件

- 检查错误

- 修改代码

②、能调用工具(Tool Calling)

前端能为 AI 注册工具:

cpp

{

name: "fetchAPI",

description: "从后端获取数据",

function: async (args) => { ... }

}AI 会主动调用。

③、能执行循环动作(Autonomous)

比如自动:

- 搜集数据

- 监控状态

- 自动刷新 UI

- 完成多轮任务

(3)、AI-Agent 与 Agent 差异总结

| 特征 | 传统 Agent | AI-Agent |

|---|---|---|

| 是否使用 LLM | ❌ 否 | ✅ 是 |

| 是否能理解自然语言 | ❌ 不行 | ✅ 可以 |

| 决策机制 | 规则/算法 | LLM + 记忆 + 工具调用 |

| 自主能力 | 中等 | 很强 |

| 适用场景 | 游戏、机器人、自动化系统 | AI 应用、AI-native 产品、自动工作流 |

| 前端是否需要学习 | 几乎无需求 | 必须,未来前端核心技能 |

(4)、为什么现在大家都说 Agent,但其实指的是 AI-Agent?

因为 2023 年 LLM 爆发后,"Agent"这个词被整个行业重塑。

今天:

- OpenAI 的 Agent = AI-Agent

- Anthropic 的 Agent = AI-Agent

- LangChain/LangGraph 的 Agent = AI-Agent

- Dify/LobeChat 的 Agent = AI-Agent

- ProductHunt 上说 Agent = AI 应用

所以现代语境里: "Agent"几乎默认为"AI-Agent(基于 LLM 的智能体)"。但严格讲,两者是不同概念。

作为前端开发者,你要关注的是 AI-Agent(现代智能体),而不是传统 Agent。

因为:

- AI-Agent 才跟 LLM、API、UI、工具调用相关

- AI-Agent 才会用到 Vue / React

- AI-Agent 才是未来应用架构的核心

- AI-Agent 才是你需要学的技能

- AI-native 应用一定基于 AI-Agent,而不是传统 Agent

(5)、你实际需要学的 AI-Agent 能力

cpp

Level 1 ------ 让前端会用 AI(LLM 基础)

Level 2 ------ 让前端调用 AI(Tool Calling / Schema)

Level 3 ------ 让前端与 Agent 协作(Agent Runtime)

Level 4 ------ 让前端构建 AI-native UI(动态 UI / 工作流)

Level 5 ------ 构建完整的 AI-Agent 应用(自主 + 协作)